Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Departamento de ciencias básicas

Probabilidad

&

Estadística

Resumen de la materia V.1

F.E.P

(Actualizada al 11-08-12)

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

El documento fue realizado en base al libro: Probabilidad y estadística para

la ciencia y la tecnología – Walpole.

El mismo fue recomendado en la cursada.

El apunte no contiene la totalidad de las demostraciones a conocer por

parte del alumno a la hora de dar el examen, solo sirve como ayuda una vez

conocidos los temas de forma adecuada.

El resumen no busca reemplazar a los libros ni a la teoría dada en clase.

El resumen puede contener nomenclatura que la cual no coincida con los

apuntes tomados en clase.

Realizado por: Fernando (F.E.P) para:

UTNnianos

www.utnianos.com.ar

Página 2 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Unidad I - Probabilidad.

Experimento: Proceso que genera un conjunto de datos.

Espacio muestral: Conjunto de todos los resultados posibles de un experimento

estadístico. Se representa con el símbolo S.

Suceso o evento: Sub conjunto del espacio muestral.

- Evento imposible: ∅

- Evento cierto: S

- Suceso binario: {o,1} (dos resultados posibles)

Operaciones entre eventos (sucesos)

Suceso unión:

- Mutuamente excluyentes: 𝐴 ∩ 𝐵 = 0

- No son mutuamente excluyentes: 𝐴 ∩ 𝐵 ≠ 0

Suceso intersección:

- Independientes. Ej: Un dado.

- No independientes -> condicionados. Ej: Mazo de cartas.

Complemento: A -> A῾; Ac

Propiedad: Au AC

P(a) + P(Ac) = 1

Leyes de De Morgam:

o

o

𝐴∪𝐵 =𝐴∩𝐵

𝐴∩𝐵 =𝐴∪𝐵

Probabilidad: Se calcula a los eventos para medir su incertidumbre.

𝑃 𝐴 = 𝐾, 𝐾𝜖𝑅/

1 0≤𝑃 𝐴 ≤1

2 𝑃 𝑠 =1

3 𝑃 𝐴 ∪ 𝐵 = 𝑃 𝐴 + 𝑃 𝐵 𝑐𝑜𝑛 𝐴 ∩ 𝐵 = 0

Página 3 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

4 𝑃 𝐴 ∪ 𝐵 = 𝑃 𝐴 + 𝑃 𝐵 − 𝑃 𝐴 ∩ 𝐵 𝑐𝑜𝑛 𝐴 ∩ 𝐵 ≠ 0

5 𝑃 𝐴 ∩ 𝐵 = 𝑃 𝐴 𝑃 𝐵 𝑐𝑜𝑛 𝐴 𝑦 𝐵 𝑖𝑛𝑑𝑒𝑝𝑒𝑛𝑑𝑖𝑒𝑛𝑡𝑒𝑠.

Probabilidad compuesta:

𝑃 𝐴 ∩ 𝐵 = 𝑃 𝐴 𝑃(𝐵|𝐴)

Probabilidad condicional:

𝑃 𝐵𝐴 =

Consecuencias de la definición axiomatica (Probabilidad)

1

2

3

4

𝑃 𝐴∩𝐵

𝑃(𝐴)

𝑃 𝐴 =1−𝑃 𝐴

𝑃 ∅ =0

𝐴∁𝐵 => 𝑃 𝐴 ≤ 𝑃 𝐵

𝑃 𝐴−𝐵 = 𝑃 𝐴 −𝑃 𝐴∩𝐵

Cantidad de combinaciones posibles:

𝑛

(𝑛∁𝑟)

𝐾

Donde:

N: cantidad de objetos

K: grupos de “x” cantidad.

N: cantidad de objetos

K: grupos tomados.

Permutaciones posibles:

𝑛

(𝑛𝑃𝑟)

𝐾

Donde:

Página 4 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Teorema de Bayes.

Si los eventos: 𝐵1 , 𝐵2 , … … , 𝐵𝑘 constituyen una partición del espacio

muestral S, donde 𝑃 𝐵𝑖 ≠ 0∀𝑖 / 1 ,2,3. . 𝑘 entonces para cualquier evento A en

S tal que 𝑃(𝐴) ≠ 0 se cumple:

𝑃 𝐵𝑟 𝐴 =

𝑃 𝐵𝑟 ∩ 𝐴

𝐾

𝑖=1 𝑃(𝐵𝑖 ∩

𝐴)

=

𝑃 𝐵𝑟 𝑃

𝐾

𝑖=1 𝑃 𝐵𝑖

𝐴 𝐵𝑟

𝑃 𝐴 𝐵𝑖

𝑝𝑎𝑟𝑎 𝑟 = 1,2, … , 𝑘

Demostración:

Por la definición de probabilidad condicional.

𝑃 𝐵𝑟 𝐴 =

𝑃 𝐵𝑟 ∩ 𝐴

𝑃(𝐴)

Si los eventos 𝐵1 , 𝐵2 , … … , 𝐵𝑘 constituye una partición del espacio muestral S tal que

𝑃(𝐵𝑖 ) ≠ 0 para i=1,2,3,….,k entonces cualquier evento de A de S:

𝐾

𝑃 𝐴 =

𝐾

𝑃(𝐵𝑖 ∩ 𝐴) =

𝑖=1

𝑃 𝐵𝑖 𝑃(𝐴|𝐵𝑖 )

𝑖=1

Y con el teorema en el denominador:

𝑃 𝐵𝑟 𝐴 =

𝑃 𝐵𝑟 ∩ 𝐴

=

𝐾

𝑖=1 𝑃(𝐵𝑖 ∩ 𝐴)

𝑃 𝐵𝑟 𝑃 𝐴 𝐵𝑟

𝐾

𝑖=1 𝑃 𝐵𝑖 𝑃 𝐴 𝐵𝑖

Si A y B son dos sucesos independientes 𝐴𝑦𝐵

también lo son.

Fin tema: Probabilidad.

Página 5 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

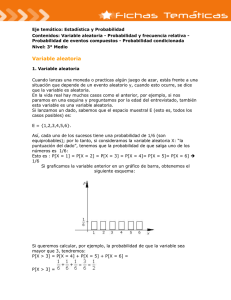

Unidad II – Variables aleatorias.

Variable aleatoria: Función que asocia un numero real con cada elemento del espacio

muestral.

-

Tipos de variables:

-

Discretas: Una variable aleatoria se llama: Varaible aleatoria discreta

(V.A.D) si se puede contar su conjunto de resultados posibles.

-

Continuas: Una variable aleatoria cuyo conjunto de valores posibles es un

intervalo completo de números no es discreta.

Funciones:

-

Representación: 𝑋, 𝑌, 𝑍, 𝑊

Recorrido: 𝑅𝑥 = {0,1,2, … }

𝑋: 𝑆 → 𝑅

Función de probabilidad variable discreta.

Función de densidad de probabilidad variable continua

Función de distribución o probabilidad acumulada (V.D)

Función de distribución o probabilidad acumulada ( V.C)

Función de probabilidad variable discreta

𝑓 𝑥 = 𝑃(𝑋 = 𝑥)

El conjunto de pares ordenados (𝑥, 𝑓 𝑥 ) se llama función de probabilidad de la

variable aleatoria discreta X.

Definición:

El conjunto de pares ordenados (𝑥, 𝑓 𝑥 ) es una función de probabilidades o

distribución de probabilidad de la variable aleatoria X si para cada resultado

posible de X:

-

𝐹 𝑥 ≥0

𝑓 𝑥 =1

𝑃 𝑋=𝑥 =𝑓 𝑥

Página 6 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Función de densidad de probabilidad Variable continua.

Definición:

La función f(x) es una función de densidad de probabilidad para la variable

aleatoria continua X, definida en el conjunto de números reales R si:

-

𝑓 𝑥 ≥0

-

∫−∞ 𝑓 𝑥 𝑑𝑥 = 1

-

𝑃 𝐴 < 𝑥 < 𝐵 = ∫𝐴 𝑓 𝑥 𝑑𝑥

+∞

𝐵

Nota: La probabilidad puntual es cero (0)

Función de distribución o probabilidad acumulada (V.D)

Definición:

La función de la distribución acumulada F(x) de una variable aleatoria discreta

X con distribución de probabilidad f(x) es:

𝐹 𝑥 =𝑃 𝑋≤𝑥 =

𝑡≤𝑥

𝑓(𝑡) para −∞ < 𝑥 < ∞

Función de distribución o probabilidad acumulada (V.C)

Definición:

La función de distribución acumulada F(x) de una variable aleatoria continua X

con función de densidad f(x) es:

𝑥

𝐹 𝑥 = 𝑃 𝑋 ≤ 𝑥 = ∫−∞ 𝑓 𝑡 𝑑𝑡 para −∞ < 𝑥 < ∞

Esperanza o valor esperado de una variable aleatoria.

Sea X una variable aleatoria con distribución de probabilidad f(x) la media o valor

esperado de X es:

Página 7 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

-

Si X es discreta:

𝜇=𝐸 𝑥 =

𝑥 . 𝑓(𝑥)

𝑥

-

Si S es continua:

+∞

𝜇=𝐸 𝑥 =

𝑥 . 𝑓 𝑥 𝑑𝑥

−∞

Teorema:

Sea X una variable aleatoria con distribución de probabilidad f(x). El

valor esperado de la variable aleatoria g(x) es:

-

Si X es discreta:

𝜇𝑔(𝑥) = 𝐸 𝑔 𝑥

=

𝑔(𝑥) . 𝑓(𝑥)

𝑥

-

Si X es continua:

+∞

𝜇𝑔(𝑥) = 𝐸 𝑔 𝑥

=

𝑔(𝑥) . 𝑓 𝑥 𝑑𝑥

−∞

Propiedades de la esperanza.

1

2

3

4

5

𝐸

𝐸

𝐸

𝐸

𝐸

𝑘 =𝐾

𝐾𝑋 = 𝐾 . 𝐸 𝑋

𝑋∓𝑌 =𝐸 𝑋 ∓𝐸 𝑌

𝑎𝑋 + 𝑏𝑌 = 𝑎 . 𝐸 𝑋 ∓ 𝑏 . 𝐸 𝑌

𝑋 . 𝑌 = 𝐸 𝑋 . 𝐸(𝑌)

Función distribución “Características”

-

Es una función continua

Es creciente

lim𝑥→−∞ 𝐹 𝑥 = 0

lim𝑥→+∞ 𝐹 𝑥 = 1

Página 8 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Varianza.

Si X una variable aleatoria con distribución de probabilidad f(x) y media E(µ); la variaza

de x es:

𝑉 𝑥 = 𝐸 𝑋 2 − 𝐸 2 (𝑋)

Demostración:

𝑉

𝑉

𝑉

𝑉

𝑉

𝑋

𝑋

𝑋

𝑋

𝑋

=𝐸

=𝐸

=𝐸

=𝐸

=𝐸

2

𝑋−𝐸 𝑋

𝑋 2 − 2𝑋𝐸 𝑋 + 𝐸 2 𝑋

𝑋 2 + 𝐸 −2𝑋𝐸 𝑋 + 𝐸 𝐸 2 𝑋

𝑋2 − 2 𝐸 𝑋 𝐸 𝑋 + 𝐸2 𝑋

𝑋2 − 𝐸2 𝑋

Calculo de E(X2)

-

Variable aleatoria discreta:

𝐸 𝑋2 =

𝑥 2 . 𝑓(𝑥)

𝑥 𝑒 𝑅𝑥

-

Variable aleatoria continua:

+∞

𝐸 𝑋2 =

𝑋 2 . 𝑓 𝑥 𝑑𝑥

−∞

Propiedades de varianza.

1

2

3

4

5

𝑉

𝑉

𝑉

𝑉

𝑉

𝐾 =0

𝐾𝑋 = 𝐾 2 ∗ 𝑉 𝑋

𝑎𝑋 + 𝑏 = 𝑎2 ∗ 𝑉 𝑋

𝑐𝑜𝑛 𝑎 𝑦 𝑏 𝑐𝑜𝑛𝑠𝑡𝑎𝑛𝑡𝑒𝑠.

𝑋 + 𝑌 = 𝑉 𝑋 + 𝑉 𝑌 𝑠𝑜𝑙𝑜 𝑠𝑖 𝑋 𝑒 𝑌 𝑠𝑜𝑛 𝑣𝑎𝑟𝑖𝑎𝑏𝑙𝑒𝑠 𝑖𝑛𝑑𝑒𝑝𝑒𝑛𝑑𝑖𝑒𝑛𝑡𝑒𝑠.

𝑋 − 𝑌 = 𝑉 𝑋 + 𝑉(𝑌)

Teorema

Sea X una variable aleatoria con distribución de probabilidad f(x). La varianza

de la variable aleatoria g(x) es:

Página 9 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

-

Si es discreta:

2

𝜎𝑔(𝑥)

= 𝐸 𝐺 𝑥 − 𝜇𝐺 𝑋

2

=

𝐺 𝑥 − 𝜇𝐺 𝑋

2

. 𝑓 𝑥

𝑥

-

Si es continua:

2

𝜎𝑔(𝑥)

= 𝐸 𝐺 𝑥 − 𝜇𝐺 𝑋

+∞

2

=

𝐺 𝑥 − 𝜇𝐺 𝑋

2

. 𝑓 𝑥 𝑑𝑥

−∞

Desvió estándar (dispersión)

𝜎=

𝑉(𝑥) 𝑐𝑜𝑛 𝜎 ≥ 0

Fin tema: Variables Aleatorias.

Página 10 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Unidad III – Distribuciones especiales.

Tipos de distribuciones:

Distribuciones discretas:

- Binomial

- Hipergeométrica

- Geometrica

- Poisson

Distribuciones continuas:

- Exponencial

- Uniforme

- Normal

- Gamma

Distribución Binomial (pág 144 – Walpole)

Características:

(1) Sucesos dicotómicos:

- Éxito (P)

- Fracaso (Q) (me interesa que salga lo que quiero si no, no me importa)

- 𝑃 𝐸 =𝑝

- 𝑃 𝑞 =𝑄

- 𝑄 =1−𝑃 ; 𝑃+𝑄 =1

(2) Ocurre en “n” pruebas o repeticiones independientes.

(3) Se mantiene probabilidad constante de prueba en prueba.

(4) Se denota como: 𝑋~B(n, p)

Donde:

N: Cantidad de ensayos;

P: Probabilidad de éxito en 1 ensayo.

X: Numero de éxito en n eventos.

(5) 𝑋~B n, p = b x, n, p

𝑃 𝑋=𝑘 =

𝑛

𝑥

. 𝑃𝑥 . 1 − 𝑃

𝑛−𝑥

Donde:

K: éxitos

X: numero de … que …

Página 11 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

(6) Esperanza: 𝐸 𝑋 = 𝑛𝑝

(7) Varianza: 𝑉 𝑋 = 𝑛𝑝 1 − 𝑝

Distribución hipergeométrica.

La distribución hipergeométrica encuentra aplicaciones en el muestreo de aceptación,

donde lotes de material o las partes se muestran con la finalidad de determinar si se

acepta o no el lote completo.

Ej: Mazo de 40 cartas -> extraigo 8 -> 3 de oro; 5 cualesquiera.

𝑃 𝑋 = 3; 𝑌 = 5 =

𝐶𝑎𝑠𝑜𝑠 𝑓𝑎𝑣𝑜𝑟𝑎𝑏𝑙𝑒𝑠

=

𝐶𝑎𝑠𝑜𝑠 𝑝𝑜𝑠𝑖𝑏𝑙𝑒𝑠

10

3

30

5

40

8

Características:

(1) Esperanza: 𝐸 𝑋 =

𝑛𝑘

𝑁

Donde:

N: Lote.

N: Elementos que tomo al azar.

K: Número de éxitos.

𝑁−𝑛

(2) Varianza: 𝑉 𝑋 = 𝑁−1

Distribución de Poisson.

Características:

(1) Sucesos raros que suceden en un continuo.

Continuo:

- Temporal

- Espacial: longitud, superficie, volumen.

(2)

(3)

(4)

(5)

La variable aleatoria X es el número de sucesos raros que ocurren en un continuo.

Recorrido: 𝑅𝑥 = 0,1,2,3,4, … . . , 𝑛 … . .

Parámetro: λ (lambda) –> Valor esperado.

Se expresa como: 𝑋~Poi λ con λ > 0

Página 12 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

𝑓 𝑥 = 𝑃 𝑋 = 𝑘 = 𝑒 −λt

λt k

𝐾!

Donde:

K: Prob. Que llegue ese valor.

(6) Esperanza: 𝐸 𝑋 = λ

(7) Varianza: 𝑉 𝑋 = λ con λ > 0

Distribución uniforme.

Características:

(1) Se expresa como: 𝑋~Unif a, b

(2) La función de densidad de la variable aleatoria uniforme continua X en el intervalo

[a,b] es:

1

𝑓 𝑥, 𝑎, 𝑏 = 𝐵 − 𝐴 𝑠𝑖 𝐴 ≤ 𝑋 ≤ 𝐵

0 𝑒𝑛 𝑜𝑡𝑟𝑜 𝑐𝑎𝑠𝑜

Nota: La función de densidad forma un rectángulo con base B-A la altura:

𝟏

𝑩−𝑨

𝑎+𝑏

2

𝑏−𝑎 2

12

(3) Esperanza: 𝐸 𝑋 =

(4) Varianza: 𝑉 𝑋 =

Distribución exponencial.

Aplicación:

- Tiempo medio entre fallas.

- Cantidad de continuo entre eventos de Poisson.

Página 13 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Características:

(1) Se expresa como: 𝑋~exp

(α)

(2) Función de distribución exponencial:

𝑓 𝑥 =

𝛼𝑒 −𝛼𝑥 𝑐𝑜𝑛 𝑥 > 0

(Función densidad)

0 𝑒𝑛 𝑜𝑡𝑟𝑜 𝑐𝑎𝑠𝑜

1

(3) Esperanza: 𝐸 𝑋 = 𝛼

1

(4) Varianza: 𝑉 𝑋 = 𝛼 2

(5) Función de probabilidad acumulada o distribución.

𝐹 𝑋 =

0 𝑒𝑛 𝑜𝑡𝑟𝑜 𝑐𝑎𝑠𝑜

1 − 𝑒 −𝛼𝑡 𝑠𝑖 𝑥 > 0

(6) Propiedad Pérdida de memoria.

Sea: 𝑋~exp

(α)

𝑓 𝑥 =

𝛼𝑒 −𝛼𝑥 𝑐𝑜𝑛 𝑥 > 0

0 𝑠𝑖 𝑥 ≤ 0

Entonces:

𝑃 𝑥 > 𝑎 + 𝑏 𝑥 > 𝑏 = 𝑒 −𝛼𝑎 = 𝑃(𝑋 > 𝑎)

Relación Poisson con exponencial.

Sea: 𝑋~Poi λ y 𝑇~ exp 𝛼

Relación: λ = 𝛼

Covarianza:

𝐶𝑜𝑣 𝑋, 𝑌 = 𝐸[(𝑋 − 𝐸(𝑋)(𝑌 − 𝐸 𝑌 ]

Página 14 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Distribución normal.

Características:

(1) Se expresa como: 𝑋~N

(μ, σ)

(2) Características:

-

Grafica: Campana de Gauss

Área total bajo la curva = 1

Área a cada lado de 𝑋 = 𝜇 = 0,5

Curva simétrica respecto de 𝑋 = 𝜇

La curva es asintótica al eje X.

-

∫−∞ 𝑓 𝑥 𝑑𝑥 = 1

+∞

(3) Función que la describe:

𝑓 𝑥 =

1

2𝜋 . 𝜎

𝑒

1 𝑥−𝜇 2

−

2 𝜎

𝑐𝑜𝑛 𝑥 𝜖𝑅

Distribución Normal estándar.

(1)

(2)

(3)

(4)

Se expresa como: 𝑍~

(0,1)

𝜇=0

𝜎=1

Función que describe:

𝑓 𝑧 =

1

2𝜋

1 2

𝑒 −2 𝑧

𝑐𝑜𝑛 𝑧 ∈ 𝑅

(5) Propiedad: Pasaje de normal a normal estándar.

Si 𝑋 ~𝑁 𝜇, 𝜎 => 𝑍 =

𝑋−𝜇

𝜎

~𝑁 0,1

∴ 𝑋 = 𝜎𝑍 + 𝜇

Página 15 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Distribución Gamma.

Función que la describe:

𝑥 𝛼−1 −𝛽𝑥

𝑒

𝑐𝑜𝑛 𝑥 ≥ 0

𝛽

0 𝑒𝑛 𝑜𝑡𝑟𝑜 𝑐𝑎𝑠𝑜

1

𝑓 𝑥 𝛼, 𝛽 = 𝛽 𝜗 𝛼

Características:

(1) Se expresa como: 𝑋~𝜗

(𝛼, 𝛽)

Donde:

α: Parámetro de la forma.

Β: Parámetro de la escala.

(2) Función gamma:

+∞

𝑥 𝛼−1 𝑒 −𝑥 𝑑𝑥

𝜗 𝛼 =

0

(3) Esperanza: 𝐸 𝑋 = 𝛼𝛽

(4) Varianza: 𝑉 𝑋 = 𝛼𝛽 2

Fin tema: Distribuciones Especiales.

Página 16 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Unidad IV – Estimación.

Estadística inferencial:

- Estimadores puntuales.

- Intervalos de confianza.

- Test de hipótesis. (Unidad V)

Estadística descriptiva:

- Media muestral.

- Varianza muestral.

- Desvió estándar.

- Mediana

- Moda o modo

- Coeficiente de variabilidad.

-

Nota: La estadística descriptiva se ocupa del análisis de datos. Representación del

resultado de un experimento.

Población: Totalidad de observaciones que nos interesan, de número finito o infinito.

Muestra: Sub-conjunto de la población.

Nota: Si se eligen muestras seleccionando a los miembros más convenientes de la

población puede producir una estimación errónea con respecto a la población.

Cualquier procedimiento que sobreestime o subestime alguna característica de la

población se dice que esta “SESGADO” para eliminar el sesgo se toman muestras de

forma aleatoria.

Definición:

Sean X1, X2, …, Xn variables aleatorias independientes, cada una con la

misma distribución de probabilidad (I.I.D) f(x). Definimos X1, X2, …, Xn

como una muestra aleatoria de tamaño n de la población f(x) y

escribimos su distribución de probabilidad conjunta como:

𝐹 𝑋1 , 𝑋2 , … . 𝑋𝑛 = 𝑓 𝑋1 𝑓 𝑋2 … . . 𝑓 𝑋𝑛

Página 17 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Media de la muestra:

Si X1,X2,…,Xn representa una muestra aleatoria de tamaño n, entonces

la media de la muestra se define mediante el estadístico:

𝑋=

𝑛

𝑖=1 𝑋𝑖

𝑛

Donde: 𝑋 𝑒𝑠 𝑙𝑎 𝑣𝑎𝑟𝑖𝑎𝑏𝑙𝑒 𝑎𝑙𝑒𝑎𝑡𝑜𝑟𝑖𝑎.

Definición:

Cualquier función de las variables aleatorias X1, X2, …, Xn que forman

una muestra aleatoria se llama ESTADISTICO.

Mediana de la muestra:

El que está en el medio de la muestra.

𝑛

Se busca el valor: 𝑋 = 2

Moda o Modo:

Valor de la serie de mayor frecuencia, nomenclatura: 𝑋

Varianza de la muestra:

La variabilidad en la muestra es como se dispersan las observaciones a partir

del promedio.

𝑣𝑎𝑟𝑖𝑎𝑏𝑖𝑙𝑖𝑑𝑎𝑑 = 𝑘 ∗

1

𝑐𝑜𝑛𝑓𝑖𝑎𝑛𝑧𝑎

Definición:

Si X1, X2, …, Xn representa una muestra aleatoria de tamaño n, entonces la

varianza de la muestra se define con el estadístico:

𝑛

2

𝑆 =

𝑖=1

𝑋𝑖 − 𝑋

𝑛−1

2

Página 18 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Desviación estándar de la muestra:

La desviación estándar de la muestra que se denota con S, es la raíz cuadrada

positiva de la varianza de la muestra.

𝑆=

Coeficiente de variabilidad.

𝐶. 𝑉 =

𝑆2

𝐷𝑒𝑠𝑣í𝑜 𝑆

=

𝑀𝑒𝑑𝑖𝑎 𝑋

Serie de frecuencia de datos:

-

Frecuencia absoluta: 𝑛𝑖 (del dato 𝑥𝑖 )

-

Frecuencia relativa:

𝑛𝑖

𝑛

donde n: total de datos.

Definición:

Como un estadístico es una variable aleatoria que depende solo de la

muestra observada, debe tener una distribución de probabilidad. La

distribución de probabilidad de un estadístico se llama distribución

muestral. La distribución de probabilidad de 𝑋 se llama distribución

muestral de la media, está depende del tamaño de la población y del

método de elección de datos.

Distribuciones muestrales:

- Normal

- Chi-Cuadrado

- T-Student

- F-Snedecor

Estimadores puntuales:

Dado (X1, X2, …, Xn) llamamos estamiador 𝜃 a cualquier función de la muestra

aleatoria.

Página 19 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Parámetro

(Fijo y desconocido)

Estimador

(Variable aleatoria)

µ

𝑋

𝜎2

𝑆2

λ

𝑋

p

𝑝

Propiedad.

{X1,X2,…,Xn} Muestra aleatoria de tamaño n (V.A.I.I.D)

∀𝑖 : 𝐸 𝑋𝑖 = 𝜇

𝑉 𝑋𝑖 = 𝑆 2

𝑆𝑖 𝑋 =

𝑛

𝑖=1 𝑋𝑖

𝑛

𝐸 𝑋 =𝐸 𝑋

Propiedades (deseables) de Estimadores Puntuales:

(1) Insesgamiento:

𝑠𝑒𝑠𝑔𝑜 𝜃 = 𝐸 𝜃 − 𝜃

𝜃 es insesgado si 𝑠𝑒𝑠𝑔𝑜 𝜃 = 0

(2) Eficiencia relativa:

Si 𝜃1 y 𝜃2 son dos estimadores insesgados de 𝜃, decimos que 𝜃1 es más

eficiente que 𝜃2 si 𝑉𝑎𝑟(𝜃1 ) < 𝑉𝑎𝑟(𝜃2 )

Página 20 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Propiedad:

{X1,X2,…,Xn} V.A.I.I.D muestra aleatoria de tamaño “n”

𝑉 𝑋 =

Desvió estándar:

𝜎𝑋 =

𝜎2

𝑛

𝜎

𝑛

Error cuadrático medio:

𝐸. 𝐶. 𝑀 𝜃 = 𝐸 𝜃 − 𝜃

2

Distribución Media muestral (NORMAL)

(1) Distribución exacta.

-

𝐸 𝑋 =𝜇

-

𝑉𝑎𝑟 𝑋 =

𝜎2

𝑛

(X1,X2,…,Xn) 𝑋𝑖 ~𝑁 𝜇, 𝜎

Si 𝑋𝑖 ~𝑁 𝜇, 𝜎 entonces la variable media muestral se distribuye en

forma exactamente normal.

𝑋~𝑁(𝜇,

𝜎

𝑛

)

(2) Distribucion asintótica.

Teorema central del límite (VER HOJA DE FORMULAS)

Sean (X1,X2,…,Xn) una sucesión de variables aleatorias independientes

e idénticamente distribuidas (I.I.E.D) tales que 𝐸 𝑋𝑖 = 𝜇 y 𝑉 𝑋𝑖 = 𝜎 2

𝑋 → 𝑁 𝜇,

𝜎

𝑛

𝑝𝑎𝑟𝑎 𝑛 𝑠𝑢𝑓𝑖𝑐𝑖𝑒𝑛𝑡𝑒𝑚𝑒𝑛𝑡𝑒 𝑔𝑟𝑎𝑛𝑑𝑒 (𝑛 ≥ 30)

Página 21 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Distribución Chi-Cuadrado.

Si S2 es la varianza de una muestra aleatoria de tamaño n que se toma de una

población normal que tiene la varianza 𝜎 2 , entonces el estadístico:

≄~

𝑛 − 1 𝑆2

~ ≄2𝑛−1

𝜎2

𝐻=

𝑛 − 1 𝑆2

𝜎2

Distribución T-Student.

Aplicación: Se utiliza para inferencia sobre la media poblacional cuando 𝜎 2

desconocido.

Si 𝑛 → +∞ 𝑛 ≥ 30 entonces 𝑇 → 𝑁𝑜𝑟𝑚𝑎𝑙

𝑋~𝑁 𝜇,

𝑍=

𝜎

𝑛

𝑋−𝜇

𝜎 ~𝑁𝑜𝑟(0,1)

𝑛

Distribución de 𝑝

𝑝=

-

Esperanza de 𝑝: 𝐸 𝑝 = 𝑝

-

Varianza de 𝑝: 𝑉𝑎𝑟 𝑝 =

𝑛

𝑖=1 𝑋𝑖

𝑛

𝑝𝑞

𝑛

Página 22 de 29

es

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Intervalos de confianza.

La estimación por intervalo de un parámetro poblacional 𝜃 es un intervalo de la

forma 𝜃𝑙 ≤ 𝜃 ≤ 𝜃𝑙 donde 𝜃𝑙 𝑦 𝜃𝑙 𝑑𝑒𝑝𝑒𝑛𝑑𝑒𝑛 𝑑𝑒𝑙 𝑒𝑠𝑡𝑎𝑑𝑖𝑠𝑡𝑖𝑐𝑜 𝜃.

A medida que se aumenta el tamaño de la muestra, nuestra estimación está

más cerca del parámetro lo cual tiene como resultado un intervalo más

pequeño.

De esta manera, el intervalo estimado, indica por su longitud, la precisión de la

estimación puntual.

Tipos:

(1)

(2)

(3)

(4)

Intervalo de confianza para la media poblacional.

Intervalo de confianza par la media poblacional con 𝜎 2 desconocido.

Intervalo de confianza para la proporción P.

Intervalo de confianza para la varianza poblacional.

Intervalo de confianza para estimar la media poblacional.

-

Muestra aleatoria {X1,X2,….,Xn} V.A.I.I.D

𝑋~𝑁(𝜇, 𝜎) con 𝜇 desconocida y 𝜎 conocida.

-

Estimador: 𝑍 =

𝑋 −𝜇

~𝑁(0,1)

𝜎

𝑛

𝜎

𝑛

𝐼: (𝑋 − 𝑍1−𝛼

2

; 𝑋 + 𝑍1−𝛼

2

𝜎

𝑛

)

Observaciones:

(1) El intervalo de confianza está centrado en 𝑋

𝜎

𝑛

2

(2) Longitud del intervalo: 2 . 𝑍1−𝛼

(3) Si aumento la muestra -> disminuye la longitud del intervalo.

(4) Error: 𝜖 = 𝑍1−𝛼

2

𝜎

𝑛

Intervalo de confianza para la media poblacional con 𝜎 2 desconocido.

-

Estimador: 𝑇 =

𝑋 −𝜇

𝑠

𝑛

~𝑇𝑛−1

𝐼: (𝑋 − 𝑇𝛼

2

𝑠

𝑛

; 𝑋 + 𝑇𝛼

2

𝑠

𝑛

)

Página 23 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Intervalo de confianza para la proporción p.

-

Estimador: 𝑍 =

𝑝 −𝑝

𝑝𝑞

𝑛

~𝑁(0,1)

𝑝𝑞

; 𝑝 + 𝑍1−𝛼

𝑛

2

𝐼: (𝑝 − 𝑍1−𝛼

2

Intervalo de confianza para la varianza poblacional.

-

Estimador:

𝑛−1 ∗𝑠 2

~

𝜎2

𝐼: (

≄2𝑛−1

𝑛 − 1 ∗ 𝑠2 𝑛 − 1 ∗ 𝑠2

;

)

≄2𝛼

≄2 𝛼

1−

2

𝑝𝑞

)

𝑛

2

Relación entre error y confiabilidad:

-

Para n: fijo mayor precisión -> menor confiabilidad y viceversa.

Si se quiere mejorar la precisión sin perder confiabilidad debe aumentarse

el tamaño de la muestra.

Intervalo más amplio -> mayor longitud.

Fin tema: Estimaciones e intervalos de confianza.

Página 24 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Unidad V – Prueba de hipótesis.

Hipótesis:

Una hipótesis estadística es una conjetura (información) acerca de un

parámetro poblacional con respecto a una o más poblaciones.

Nota: La verdad o falsedad de una hipótesis nunca se sabe con absoluta

certidumbre, a menos que se examine toda la población algo poco práctico.

Papel de probabilidad en la prueba de hipótesis:

El rechazo de una hipótesis implica que la evidencia de la muestra la refuta.

Por otro lado significa que hay una pequeña probabilidad de obtener la

información muestral observada cuando, de hecho, la hipótesis es verdadera.

El planteamiento de una hipótesis está influido por la estructura de la

probabilidad de una conclusión errónea.

Ej: Para probar que un medidor es más preciso que otro el ingeniero prueba la

hipótesis de que no hay diferencia en la precisión de los dos tipos de

medidores.

Hipótesis nula e hipótesis alternativa.

-

Hipótesis nula:

Se refiere a cualquier hipótesis que deseamos probar y se denota

con H0.

Nota: El rechazo de H0 conduce a la aceptación de una hipótesis

alternativa que se denota con H1.

-

Hipótesis alternativa:

Representa la pregunta que debe responderse, la teoría que debe

probarse y, por ello, su especificación es muy importante.

Nota: La hipótesis nula H0 anula o se opone a H1

Página 25 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Conclusión del análisis.

(1) Rechazo H0: A favor de H1 debido a evidencia suficiente en los datos.

(2) No rechazo H0: Debido a evidencia insuficiente en los datos.

Decisiones en hipótesis.

Dos decisiones:

Rechazo H0:

-

Siendo H0 falsa -> CORRECTO

Siendo H0 verdadera -> ERROR TIPO I

Acepto H0:

Siendo H0 falsa -> ERROR TIPO II

Siendo H0 verdadera -> CORRECTO

Error tipo I:

El rechazo de la hipótesis nula cuando es verdadera.

Error tipo II:

No rechazar hipótesis nula cuando es falsa.

Probabilidades.

-

P

P

P

P

rechazar H0 falsa = potencia del test = 1 − β

rechazar H0 verdadera = nivel de significación = α

aceptar H0 falsa = β

aceptar H0 verdadera = 1 − α

Nota:

Si para un tamaño de muestra fijo:

Si reducimos la probabilidad de cometer un error de tipo II, aumenta la

probabilidad de cometer un error de tipo I.

La probabilidad de cometer ambos errores se puede disminuir al

aumentar el tamaño de la muestra.

Página 26 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Propiedades importantes.

-

-

-

Los errores de tipo I y II están relacionados. Por lo general una disminución

en la probabilidad de uno tiene como resultado un incremento en la

probabilidad del otro.

El tamaño de la región critica y, por lo tanto, la probabilidad de cometer

un error de tipo I, siempre se puede reducir al ajustar el (los) valor (es)

critico (s).

Un aumento en el tamaño muestral n reducirá a α y β de forma

simultánea.

Si la hipótesis nula es falsa, β es máximo cuando el valor real de un

parámetro se aproxima al valor hipotético. Cuanto más grande sea la

distancia entre el valor real y el valor hipotético, β será menor.

Potencia del test.

La potencia de una prueba (α) es la probabilidad de rechazar H0 dado que una

alternativa específica es verdadera, se puede calcular como: 1-β

Test o prueba de hipótesis para la media (de una población) con varianza conocida.

-

Estadístico de prueba: 𝑍 =

-

Casos:

𝑋 −𝜇0

𝜎

𝑛

~𝑁𝑜𝑟(0,1)

Caso 1

Caso 2

Caso 3

𝐻0: 𝜇 = 𝜇0

𝐻1: 𝜇 > 𝜇0

𝐻0: 𝜇 = 𝜇0

𝐻1: 𝜇 < 𝜇0

𝐻0: 𝜇 = 𝜇0

𝐻1: 𝜇 ≠ 𝜇0

Para los test restantes solo variará el estadístico de prueba, según los estimadores

vistos en cada uno de los intervalos de confianza.

Página 27 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Valor y cálculo del P-Valor.

𝑃 𝑋 > 𝑋0 ; 𝑐𝑢𝑎𝑛𝑑𝑜 𝜇 = 𝑣𝑎𝑙𝑜𝑟 𝑠𝑒𝑙𝑒𝑐𝑐𝑖𝑜𝑛𝑎𝑑𝑜

=

𝑃 − 𝑣𝑎𝑙𝑜𝑟

2

Nota:

-

Si P-valor > α: no rechazo H0.

Si P-valor ≤ α: rechazamos H0

Fin tema: Prueba de hipótesis.

Página 28 de 29

Universidad Tecnológica Nacional

Facultad Regional Buenos Aires

Unidad VI – Regresión Lineal.

Nota: Este es un tema el cual se puede resolver en su totalidad con la tabla de fórmulas

y la calculadora, en el apunte figura una introducción mínima para poder resolver

ejercicios y entender la tabla.

Recta de regresión poblacional:

𝑌 = 𝑏0 + 𝑏1 𝑋

Obtención de los coeficientes de la recta:

𝑆𝑥𝑦

-

𝑏1 =

-

𝑏0 = 𝑌 − 𝑏1𝑋

𝑆𝑥𝑥

Cantidades básicas que se calculan.

𝑋=

1

𝑋𝑖

𝑛

𝑆𝑥𝑥 =

𝑋𝑖 − 𝑋

𝑆𝑥𝑦 =

𝑌=

2

𝑛

𝑆𝑦𝑦 =

𝑌𝑖

𝑌𝑖 − 𝑌

2

𝑋𝑖 − 𝑋 𝑌𝑖 − 𝑌

Coeficiente de determinación:

𝑟2 =

1

𝑆𝐶𝑒𝑥𝑝

𝑆𝐶𝑡𝑜𝑡

Coeficiente de correlación lineal:

𝑟=

𝑆𝑥𝑦

𝑆𝑥𝑥 𝑆𝑦𝑦

Fin tema: Regresión Lineal.

Página 29 de 29