Variable aleatoria discreta

Anuncio

4. Variable aleatoria discreta

El mismo Doob explicaba el origen del término variable aleatoria

(random variable): "Cuando estaba escribiendo mi libro [Stochastic

Processes] tuve una discusión con William Feller. Él aseguraba que todo

el mundo decía "variable aleatoria" (random variable), mientras que yo

sostenía que se usaba "variable al azar" (chance variable).

Obviamente, debíamos usar el mismo nombre en nuestros libros, así que

optamos por tomar la decisión mediante un procedimiento aleatorio:

1

lanzamos una moneda y él ganó".

Variable aleatoria

Una variable aleatoria X es una función que asocia a

cada suceso del espacio muestral E de un experimento

aleatorio un valor numérico real:

X :E →ℜ

w → X ( w)

Llamar variable a una función resulta algo confuso,

por ello hay que insistir en que es una función.

La variable aleatoria puede ser discreta o continua.

Veremos en este capítulo el caso discreto.

2

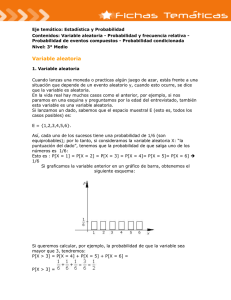

Ejemplo de variable aleatoria discreta:

Número de caras al lanzar

3 monedas.

Elementos del

espacio muestral

+++

++C +C+

C++

CC+

C+C

+CC CCC

Ley de

correspondencia

Nº reales

(# de caras)

0

Establecer una variable aleatoria

para un experimento aleatorio no

es más que una manera de asignar

de "manera natural" números a los

eventos.

1

2

X :E →ℜ

w → X ( w)

3 caras

3

Función de probabilidad

Voy a pensar un número entero del 1 al 100.

“¿Qué numero será?”

Intentaremos representar el estado de incertidumbre

mediante una función matemática: la función de

probabilidad.

P

1/100

1 2 3

........

99 100 X

4

Distribución uniforme discreta

En muchos casos asumimos que todos los resultados de

un experimento aleatorio son igualmente posibles.

Si X es una variable aleatoria que representa los resultados

posibles del experimento, decimos que X se distribuye

uniformemente.

Si el espacio muestral consta de n sucesos simples,

0 < n < ∞ , entonces la función de probabilidad discreta se

define como p(x) = 1/n para todo x del espacio muestral.

En un ordenador podemos generar una distribución de valores

con esta probabilidad con:

1 + int [n (rnd)]

5

Supongamos que me preguntáis si es par.

Y respondo que no. ¿Cómo modifica la función?

P

1/50

1 2 3

........

99 100 X

Os pido una pregunta de modo que mi respuesta

genere una función de incertidumbre, de probabilidad,

tal que los valores del espacio muestral posibles (con

probabilidad distinta de cero) no tengan todos la misma

probabilidad. ¿Son válidas: “¿Tiene dos cifras el número?”

6

o “¿Es un número primo?” ?

Función de probabilidad o distribución

Una vez definida una variable aleatoria X, podemos

definir una función de probabilidad o distribución

de probabilidad asociada a X, de la siguiente forma:

p : ℜ → [0,1]

x → p( x) = P( X = x)

La función de probabilidad debe cumplir:

(i ) 0 ≤ p ( x) ≤ 1 ∀x ∈ ℜ

(ii ) ∑ p ( x) = 1

x

(Suma sobre todos los posibles valores

7

que puede tomar la variable aleatoria).

Función de probabilidad discreta

Z

Z

Z

Valores

Probabilidad

0

1/4 = 0.25

1

2/4 = 0.50

2

1/4 = 0.25

Z

X :E →ℜ

w → X ( w)

p : ℜ → [0,1]

x → p( x) = P( X = x)

8

Requerimientos de una distribución de

probabilidad

X

P(X)

X

P(X)

X

P(X)

-1

0

1

2

3

.1

.2

.4

.2

.1

1.0

-1

0

1

2

3

-.1

.3

.4

.3

.1

1.0

-1

0

1

2

3

.1

.3

.4

.3

.1

1.2

0 ≤ p ( x ) ≤ 1 para todo x

∑ p( x) = 1

x

9

Observa que aun si el espacio muestral es infinito

numerable, también podemos definir una variable

aleatoria discreta y una función de probabilidad.

Ejemplo: Sea X = Número de lanzamientos de una

moneda antes de que aparezca una cara.

Entonces:

P(X = 1) = P(C) = 1/2

P(X = 2) = P(+C) = 1/2 ∙ 1/2 = 1/4

P(X = 3) = P(++C) = 1/2 ∙ 1/2 ∙ 1/2 = 1/8

...

y en general P(X = n) = (1/2)n, n = 1, 2,…

Demuestra que está normalizada.

10

Sea el experimento “lanzar dos dados”. Definamos

el espacio muestral E como:

E = {(1,1),(1,2),...(1,6),...,(5,6),(6,6)}

Definamos la variable aleatoria discreta X como:

con S = {2,3,...,12} la suma de puntos.

Una posible función de probabilidad es:

f : ℜ → [0,1]

f (2) = P(X = 2 ) = P( (1,1) ) = 1/ 36

f (3) = P(X = 3 ) = P( (1,2) ∪ (2 ,1) ) = 2 / 36

f (4) = P(X = 4 ) = P( (1,3) ∪ (3,1) ∪ (2,2) ) = 3 / 36

...

11

Función de probabilidad de la variable aleatoria X

6/36

P

5/36

5/36

4/36

4/36

3/36

3/36

2/36

2/36

1/36

2

1/36

3

4

5

6

7

8

9

10

11

12

X

Observa que cumple las dos condiciones: es siempre

positiva (y menor o igual a 1) y está normalizada. 12

Función de distribución (acumulada)

Dada una variable aleatoria discreta X se llama

función de distribución a la función F definida

como:

F : ℜ → [0,1]

x → F ( x) = P( X ≤ x)

En nuestro ejemplo de los dos dados:

F(5) = P(X ≤ 5) = P(x = 2 o x = 3 o x = 4 o x = 5)

F(5) = 1/36 + 2/36 +3/36 + 4/36 = 10/36

13

Función de distribución de la variable aleatoria X

F

1,0

0,5

0,028

2

3

4

5

6

7

8

9

10 11

12

x

14

Ejemplo: Dibuja la función de probabilidad f(x) y la función

de distribución F(x) de una variable discreta definida

como:

X = Número en la cara de un dado.

X tiene como posibles valores x = 1, 2, 3, 4, 5, 6 cada

uno con probabilidad 1/6

1

6

1

F(x)

f(x)

0.5

0

1

6

x

0 1

x

6

15

Función de probabilidad f(x)

Función de distribución F(x)

Algunos problemas de probabilidad están relacionados

con la probabilidad P(a <X ≤ b) de que X asuma algún

valor en un intervalo (a, b]. Observa que:

P(a < X ≤ b) = F(b) - F(a)

Para demostrarlo observa que, como los sucesos

X ≤ a y a < X ≤ b son mutuamente excluyentes, entonces:

F(b) = P(X ≤ b) = P(X ≤ a) + P(a < X ≤ b)

= F(a) + P(a < X ≤ b)

En el ejemplo de los dos dados, calcula la probabilidad de

que los dos dados sumen al menos 4 pero no más de 8:

P(3 < X ≤ 8) = F(8) - F(3) = 26/36 - 3/36 = 23/36

16

Algunas propiedades de la función de distribución

F (+∞) = lim F ( x) = lim P( X ≤ x) = P( E ) = 1

x → +∞

x → +∞

F (−∞) = lim F ( x) = lim P( X ≤ x) = P(∅) = 0

x → −∞

x → −∞

P( x1 < X ≤ x2 ) = F ( x2 ) − F ( x1 )

F es monótona creciente.

F es continua por la derecha: la probabilidad de

que la variable aleatoria discreta X tome un valor

concreto es igual al salto de la función de distribución

17

en ese punto.

Monte Carlo

Por método de Monte Carlo en general entendemos la simulación de

los resultados de un experimento utilizando una computadora y un

generador de números aleatorios. Se utiliza cuando un cálculo es

difícil de realizar por otros métodos numéricos o algebraicos, o

cuando somos demasiado vagos o ignorantes como para solucionarlo

por métodos más elegantes.

y

Ejemplo clásico: área debajo de una curva.

Dada un área A fácil de medir, que contiene

una curva f(x) difícil de integrar, se puede

calcular el área debajo de la curva mediante la

generación de N pares de números aleatorios

(x,y) que representan coordenadas. Se

cuentan los puntos que caen por debajo de la

curva y entonces:

∫ f ( x )dx = A ×

Rectángulo de área A

# de puntos bajo la curva

# de puntos

f(x)

x

Aleatoriedad

Deborah J. Bennett

Alianza Editorial, 2000.

19

Método de Monte Carlo

Realicemos ahora el siguiente

experimento aleatorio: girar la

ruleta de la imagen y apuntar el

número del sector que coincide

con la flecha.

La variable aleatoria X de este experimento asocia cada sector

a un número entero, como podemos observar en la imagen.

Es una variable aleatoria discreta. Los resultados posibles son:

{0, 1, 2, 3, 4, 5, 6, 7}. Por simetría podemos establecer una

función de probabilidad: la probabilidad de cada resultado es

20

1/8.

Repitamos un experimento aleatorio semejante, pero ahora con

esta nueva ruleta:

Ahora el espacio muestral

está compuesto por 4

eventos. Establecemos una

nueva variable aleatoria

discreta X' que asocia cada

sector (evento) a los

números: {0, 1, 2, 3}.

Ahora teniendo en cuenta el tamaño relativo de los sectores

podemos establecer una función de probabilidad, que asocia

a cada uno de los valores de la variable aleatoria

{0, 1, 2, 3} las probabilidades {1/4, 1/2, 1/8, 1/8},

respectivamente (proporcionales al ángulo del sector).

21

La variable aleatoria X en el primer ejemplo de la ruleta

está uniformemente distribuida, ya que todos los

resultados tienen la misma probabilidad. Sin embargo, en

el segundo ejemplo, la variable aleatoria X, no está

uniformemente distribuida.

El problema crucial de la aplicación de los métodos de

Monte Carlo es hallar los valores de una variable aleatoria

(discreta o continua) con una distribución de probabilidad

dada por la función p(x) a partir de los valores de una

variable aleatoria uniformemente distribuida en el

intervalo [0, 1], proporcionada por el ordenador.

22

¿Cómo simular con

el ordenador la

distribución de

probabilidad de las

ruletas?

Resultado Función de

probabilidad

P. acumulada

(Función de

distribución)

0

1

2

3

0.25

0.75

0.875

1

0.25

0.5

0.125

0.125

Condición

Resultado

0 ≤ γ < 0.25

0.25 ≤ γ < 0.75

0.75 ≤ γ < 0.875

0.875 ≤ γ < 1

0

1

2

3

23

Una vez visto un caso particular, el problema general puede

formularse del siguiente modo:

Si X es una variable aleatoria discreta cuyos posible resultados

son {x0, x1, x2 , ... xn} y sean {p0, p1, p2, ... pn} sus respectivas

probabilidades. Al sortear un número aleatorio γ,

uniformemente distribuido en el intervalo [0, 1), se obtiene el

resultado xi, si se verifica la siguiente condición:

i −1

∑p

j =0

i

j

≤ γ <∑ p j

j =0

24

Esperanza matemática o media

de una función de probabilidad discreta

µ = E ( X ) = ∑ xi P( X = xi ) = ∑ xi p( xi )

i

i

X

P(X)

X P(X)

-1

0

1

2

3

.1

.2

.4

.2

.1

-.1

.0

.4

.4

.3

1.0

Siempre que no genere

ambigüedad pasaremos

de arrastrar la variable

aleatoria: en vez de poner

X = xi ponemos

directamente xi.

25

Calcular la esperanza de la variable aleatoria X en

el ejemplo de los dos dados:

12

µ = E ( X ) = ∑ P(i ) ⋅ i =

i =2

1

6

2

1

⋅ 2 + ⋅ 3 + ... + ⋅ 7 + ... + ⋅12 = 7

36

36

36

36

26

Sean a, b y c constantes. Demuestra que:

(1)

E (c ) = c

(2)

E ( P1 ( x) + P2 ( x)) = E ( P1 ( x)) + E ( P2 ( x))

(3)

(1)

(2)

E (aX + b) = aE ( X ) + b

µ = E (c ) = 1⋅ c = c

E (P1 ( x) + P2 ( x) ) = ∑ xi (P1 ( X = xi ) + P2 ( X = xi ) ) =

i

∑ x P ( X = x ) + ∑ x P ( X = x ) = E (P ( x ) ) + E (P ( x ) )

i 1

i

i 2

i

i

i

1

2

27

Supongamos que tenemos que hacer unos análisis clínicos

de sangre. Queremos detectar una enfermedad que

afecta a 1 de cada 1000 personas. Los pacientes acuden

en grupos de 50. ¿Qué nos sale económicamente más

a cuenta: analizar paciente a paciente o mezclar la sangre de

los 50 y analizar la mezcla?

P(1 persona sana) =

999

;

1000

999

P(50 personas sanas) =

1000

999

P(Al menos una persona de 50 enferma) = 1 -

1000

50

50

50

50

999

999

# esperado de análisis = 1 ⋅

≅ 21

+ 51 ⋅ 1 -

1000

1000

Tomando la mezcla, en promedio tendremos que hacer

unos 21 análisis en vez de 50 por grupo.

28

Juegos

A un juego de azar podemos asignarle una variable aleatoria X,

cuyos valores son las ganancias correspondientes a los

posibles resultados. La esperanza matemática de la variable

aleatoria X representa el beneficio medio o ganancia media

que se obtiene en cada jugada cuando se juega un número

elevado de veces.

Si la esperanza matemática es 0 se dice que el juego es justo.

Si es mayor que 0 se dice que el juego es favorable al jugador.

Si es menor que 0 se dice que perjudica al jugador y no es

favorable.

Sea el juego que consiste en sacar una bola de una urna que

contiene 7 bolas rojas y 3 bolas negras. Ganamos 50 euros si la

bola extraída es roja y pagamos 150 euros en el caso de que sea

29

negra. ¿Qué podemos esperar si jugamos muchas veces?

Espacio muestral E = {R, N}. Consideramos las ganancias

como positivas y las pérdidas negativas:

Variable aleatoria X

Función de probabilidad

R

50

0,7

N

-150

0,3

µ = 50 ⋅ 0,7 + (−150) ⋅ 0,3 = −10

Ganancia media

30

Una compañía de seguros domésticos tiene que determinar

el gasto medio por póliza suscrita, sabiendo que cada año

1 de cada 10.000 pólizas termina en una reclamación de

20 millones, 1 de cada 1.000 en 5 millones, 1 de cada 50 en

200.000 y el resto en 0.

1

1

7

6

µ = 2 ⋅10 ⋅

+

+ 5 ⋅10 ⋅

1000

10000

1 9789

5

+ 2 ⋅10 ⋅ + 0 ⋅

= 11000

50 10000

31

32

Marc Kac, en Enigmas of Chance (1985), explica cómo aplicar el

concepto de esperanza a la vida real:

"Una semana, apareció un anuncio del Imperial College of Science

and Technology ofreciendo un puesto de profesor de Matemáticas

con un salario de 150 libras anuales; ser ciudadano británico no era

requisito necesario. El salario era tan escaso que supuse que ningún

ciudadano británico respetable estaría interesado en ese trabajo. Fui

a preguntar a Steinhaus si debía o no optar al puesto. Por entonces

no sabía ni una palabra de inglés, pero estaba dispuesto a jurar que

mis conocimientos eran los suficientes.

"Déjame pensar", me dijo Steinhaus. "Estimaría que la probabilidad

de que consigas el trabajo es de una entre mil. Si multiplicas esto

por ciento cincuenta libras, tienes tres chelines. Eso es mucho más

de lo que cuesta enviar la carta, así que deberías hacerlo". Lo hice,

pero el trabajo fue al final para un ciudadano británico (después de

todo, sí que había alguno interesado)”.

33

Momento de orden k de una variable

aleatoria discreta

De forma más general podemos definir la esperanza

matemática o media no solo para una variable aleatoria X,

sino para cualquier función T(X) como:

µ = E (T ( X ) ) = ∑ T ( xi ) p( xi )

i

Tomando como casos particulares a las funciones:

T ( X ) = X ; k = 1, 2, 3, ...

k

obtenemos los momentos de orden k centrados en el origen:

mk = E ( X ) = ∑ x p ( xi )

k

k

i

i

34

Y tomando como casos particulares a las funciones:

T ( X ) = ( X − µ ) ; k = 1, 2, 3, ...

k

obtenemos los momentos de orden k centrados en

la media de X:

M k = E (( X − µ ) ) = ∑ ( x − µ ) p ( xi )

k

k

i

Observa que:

m1 = E ( X ) = µ

M1 = E( X − µ ) = E( X ) − µ = 0

35

Varianza y desviación estándar o típica

de una función de probabilidad discreta

Varianza

σ = Var ( X ) = M 2 = E (( X − µ ) ) =

2

2

∑ (x − µ)

i

2

P ( X = xi )

i

Desviación estándar

o típica

σ = Var ( X )

Ambas miden la “dispersión de los datos”. Observa que la desviación

36

típica lo hace con las mismas unidades que los propios datos.

Ejemplo

X

P(X)

X −µ

-1

0

1

2

3

.1

.2

.4

.2

.1

-2

-1

0

1

2

( X − µ ) ( X − µ ) ⋅ P( X )

2

4

1

0

1

4

2

.4

.2

.0

.2

.4

1.2

σ = ∑ ( xi − µ ) P( xi ) = 1,2

2

2

i

σ = Var ( X ) = 1.10

37

Calcula la varianza y desviación típica de la variable

aleatoria X en el ejemplo de los dos dados:

12

Var ( X ) = ∑ P(i) ⋅ (i − 7) =

2

i =2

1

2

1

2

2

2

⋅ (2 − 7) + ⋅ (3 − 7) + ... + ⋅ (12 − 7) = 5,83

36

36

36

σ = Var ( X ) = 5,83 = 2,41

38

Algunas propiedades de la varianza

Var ( X ) = σ = ∑ ( xi − µ ) p ( xi ) =

2

2

i

∑ (x

i

2

+ µ − 2 µxi ) p ( xi ) =

2

i

∑x

2

i

i

p ( xi ) + µ − 2 µ ∑ xi p ( xi ) =

2

i

E ( X ) + µ − 2 µ = E ( X ) − ( E ( X ))

2

2

2

2

σ = E ( X ) − ( E ( X ))

2

2

2

39

2

La apuesta de Pascal

Usted tiene dos cosas que perder: la verdad y el bien, y dos cosas que comprometer: su razón

y su voluntad, su conocimiento y su bienaventuranza; y su naturaleza posee dos cosas de las

que debe huir: el error y la miseria. Su razón no está más dañada, eligiendo la una o la otra,

puesto que es necesario elegir. He aquí un punto vacío. ¿Pero su bienaventuranza? Vamos a

pesar la ganancia y la pérdida, eligiendo cruz (de cara o cruz) para el hecho de que Dios existe.

Estimemos estos dos casos: si usted gana, usted gana todo; si usted pierde, usted no pierde

nada. Apueste usted que Él existe, sin titubear.

Pensamientos, Blaise Pascal (1670)

Dios existe

Dios no existe

Creer en Dios

+∞ (CIELO)

NADA

No creer en

Dios

−∞

(INFIERNO)

NADA

«Deberías vivir tu vida e intentar hacer del mundo un lugar mejor

estando en él, tanto si crees en dios como si no. Si no hay dios, no

habrás perdido nada y serás recordado al morir por todos los que

dejaste atrás. Si existe un dios benevolente, te juzgará a ti y a tus

méritos y no por el hecho de si has creído o no en él».

40

Michael Martin

La paradoja de Parrondo

(perder + perder = ganar)

Juego A

Prob.

de

ganar

Prob.

de

perder

1/2 - ε 1/2 + ε

Sea X(t), el capital en el

instante t. Diremos que un

juego es ganador

(perdedor) si el promedio

<X(t)> es una función

monótona creciente

(decreciente) de t. Y será

un juego justo si <X(t)>

es constante.

Es fácil probar que el juego A es un juego

perdedor si ε positivo:

<X(t+1)>-<X(t)> = <X(t+1)-X(t)> =

(1/2 - ε) − (1/2 + ε) = −2ε

La paradoja de San Petersburgo

«Se comienza con un “bote” de dos euros.

Se lanza una moneda al aire: si sale cruz,

yo doblo la cantidad que hay en el bote; si

sale cara, usted se lleva el bote disponible

en ese momento. Es decir, si la primera

tirada es cara, usted gana 2 euros, si la

primera tirada es cruz y la segunda cara,

gana 4 euros, si la primera cara sale en la

tercera tirada gana 8 euros, y si la primera

cara sale en la tirada n-ésima gana 2n

euros. Obviamente, lo que a usted más le

conviene es que salga cara lo más tarde

posible. En cualquier caso, usted gana

siempre algo de dinero, por lo que es justo

que yo le cobre alguna cantidad o cuota

para permitirle participar en el juego».

J. M. Parrondo

INVESTIGACIÓN Y CIENCIA, febrero, 2007

Daniel Bernoulli 1738

San Petersburgo.

«La pregunta que se hizo

Bernouilli, y que en cierto

modo sigue sin resolverse,

es: ¿cuál es la cuota de

entrada que se debería

cobrar para que el juego

fuera justo?»

44

La paradoja de San Petersburgo

Sea X la ganancia. Su valor esperado o ganancia media, es:

1 n

E ( X ) = ∑ n 2 = +∞

n ≥1 2

(La probabilidad de que salga cara por primera vez en la n-ésima

tirada es: 1/2n )

¡El jugador debería pagar una cantidad infinita para que el juego fuera justo!

«En otras palabras, si yo le ofrezco entrar en el juego con una cuota de,

digamos, un millón de euros, usted debería aceptar, porque la ganancia

media en el juego, que es infinita, supera esa y cualquier otra cantidad.

Sin embargo, nadie en su sano juicio aceptaría semejante trato. Esta es

la paradoja de San Petersburgo: el sentido común nos dice que el valor

medio de la ganancia no determina la cuota de entrada aceptable.

¿Cómo determinamos entonces dicha cuota?»

45

El problema fundamental del juego de San Petersburgo es que proporciona

premios muy cuantiosos con probabilidad extremadamente pequeña. Por ejemplo,

si la primera cara aparece en la tirada décima, la ganancia es de 1024 euros, y esto

ocurre con una probabilidad de 1 entre 1024. Las ganancias crecen

exponencialmente mientras que las probabilidades decrecen también

exponencialmente, siendo siempre el valor medio de cada posible premio igual a un

euro.

Cruz 23 veces seguidas: más de 16

millones de ganancia (en un millón de

turnos, esto puede ocurrir

con una probabilidad

superior al 5 %).

La paradoja del vaticinio

(paradoja de William A. Newcomb 1969)

Vas a jugar contra el supercomputador HAL 9000, capaz de vaticinar la elección

de su contrincante. HAL es un oráculo moderno. Te presenta dos cajas cerradas:

la caja 1 que puede contener 0 o 1.000 euros y la caja 2 que puede contener 0 o

1.000.000 euros.

Piensa que HAL vaticina con total seguridad lo que vas a escoger:

(a) Si HAL vaticina que optarás por las dos cajas, pondrá 1.000 euros en la caja 1 y nada en la

caja 2.

(b) Si HAL vaticina que optarás por la caja 2, pondrá 1.000 euros en la caja 1 y 1.000.000 de

euros en la caja 2.

(c) Si HAL vaticina que elegirás las dos cajas, y sin embargo, optas por la caja 2, no ganas nada.

(d) Si HAL vaticina que optarás por la caja 2, y sin embargo, optas por las dos cajas, ganas las

sumas contenidas en las cajas 1 y 2, es decir: 1.001.000 euros.

Matriz de pagos (Teoría de juegos):

HAL

Vaticina que

elegirás caja 2

Tú

Vaticina que

elegirás las dos

cajas

Eliges la

caja 2

1.000.000

0

Elige las

dos cajas

1.001.000

1.000

¿Qué eliges: recibir el contenido de ambas cajas o sólo el de la caja 2?

Todo está ya listo: ¿Qué opción eliges?

La gente (incluidos los matemáticos y filósofos profesionales) suele dividirse en dos

bandos:

Los que optan por la caja 2:

Si optas por las dos cajas: HAL lo habrá vaticinado y habrá colocado 1.000 euros en la caja

1 y nada en la 2. Premio: 1.000 euros.

Pero si optas por la caja 2: HAL lo habrá vaticinado y habrá colocado 1.000 euros en la

caja 1 y 1.000.000 de euros en la caja 2. Premio: 1.000.000 euros.

Es preferible tener la casi plena certeza de ganar 1.000.000 de euros que ganar 1.000 euros.

Los que optan por las dos cajas:

HAL ya ha efectuado su vaticinio, de modo que el contenido de la caja 2 ya está

determinado: así que la caja 2 contiene 1.000.000 euros o nada.

Si HAL puso 1.000.000 de euros en la caja 2, al optar por las dos cajas, ganaré 1.001.000

euros. Si HAL solo puso 1.000 euros en la caja 1, me conviene también optar por las dos,

puesto que mejor 1.000 euros que nada.