Análisis numérico de sistemas no lineales

Anuncio

Análisis numérico

de sistemas no lineales

Índice

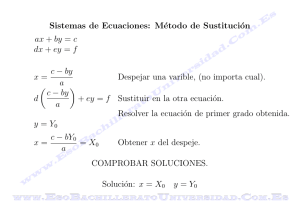

1. Introducción.

2. El 2o método de Lyapunov.

3. El 1er método de Lyapunov.

4. Teorı́a de catástrofes.

5. Teorı́a de singularidades.

6. Métodos de continuación.

7. Bifurcaciones locales de puntos de equilibrio.

8. Ciclos lı́mite.

9. Perturbación, promediado y perturbación singular.

10. Bifurcaciones locales de sistemas en tiempo discreto.

11. Caos determinista.

12. Sistemas hamiltonianos.

Introducción

Una gran parte de la actividad ingenieril consiste en observar la evolución de las cosas a lo

largo del tiempo. Matemáticamente, se estudian sistemas dinámicos.

3

Introducción

Por ejemplo, sea el circuito

descrito por la ecuación diferencial:

RC

dV

+V = E

dt

V (0) = V0

4

Introducción

Alternativamente, el comportamiento del circuito se puede describir mediante la solución

de la ecuación diferencial:

t

− RC

V (t) = E + (V0 − E)e

5

Introducción

O sea una cuenta bancaria

ptas(k + 1) = (1 + r)ptas(k)

ptas(0) = ptas0

6

Introducción

Una forma alternativa de expresar este sistema

es por su solución:

ptas(k) = (1 + r)k ptas0

7

Introducción

La solución es lo importante Se deine un

sistema dinámico como una aplicación Φ

Φ

X ×I →X

con

• X algún conjunto.

• I un conjunto dotado de un orden completo

(normalmente < o Z): el tiempo.

8

Introducción

Por ejemplo:

• En el circuito, X = < e I = <. Φ(x, t) =

t ).

E + (x − E) exp(− RC

• En el banco, X = < e I = Z +. Φ(x, t) =

(1 + r)tx.

9

Introducción

Diferentes selecciones de X e I conducen a

diferentes tipos de sistemas dinámicos:

• X = <n e I ∈ <: sistemas diferenciales.

• X = <n e I ∈ Z: sistemas en diferencias.

• X una variedad algebraica de <n e I ∈ <:

sistemas algebraicos-diferenciales.

• X ∈ N e I ∈ Z: autómatas celulares.

• X ∈ C k e I ∈ <: algunas ecuaciones en

derivadas parciales.

• ...

10

Introducción

Dos términos muy usados:

• Φ se llama el flujo.

• Una función particular de I a X definida

por Φ(x0, t), para un x0 concreto, se llama

la trayectoria u órbita de x0.

11

Introducción

La definición que hemos dado supone que los

sistemas estudiados son independientes del tiempo. En el caso más general se tiene un flujo

Φ(x, t, t0). El caso independiente del tiempo

corresponde a

Φ(x, t, t0) = Φ(x, t − t0)

12

Introducción

La anterior restricción no es seria, en el sentido de que se puede suspender un sistema

dependiente del tiempo en uno independiente

añadiendo la ecuación de estado

dt

=1

dt

13

Introducción

Supongamos que existe un x∗ que verifica:

Φ(x∗, t) = x∗ ∀t ∈ I

es un punto de equilibrio del sistema.

14

Introducción

Es posible dar otras caracterizaciones de los

puntos de equilibrio para tipos de sistemas dinámicos

particulares. Por ejemplo:

• Sistemas diferenciales ẋ = f (x, t): f (x∗, t) =

0.

• Sistemas en diferencias xk+1 = f (xk , k):

f (x∗, k) = x∗

15

Introducción

Una trayectoria que una dos puntos de equilibrio se llama una órbita heteroclı́nica. Una

órbita que una un punto de equilibrio consigo

mismo se llama una órbita homoclı́nica.

16

Introducción

Por ejemplo, consideremos el modelo de crecimiento de algas en un pantano:

ut = uxx + ζu(1 − u)

Esta ecuación tiene dos soluciones estacionarias

u = 0, 1

17

Introducción

Supongamos que buscamos una solución en

forma de onda:

u(x, t) = U (x − ct)

Substituyendo en la EDP

Ü + cU̇ + ζU (1 − U ) = 0

18

Introducción

La ecuación anterior es una ecuación diferencial con dos puntos de equilibrio

(U, U̇ ) = (0, 0), (1, 0)

El retrato de fases es

Las órbitas heteroclı́nicas representan ondas

que transforman un estado en otro.

19

Introducción

Desde un punto de vista más general, se llaman

conjuntos invariantes a aquellos conjuntos S ∈

X que verifican:

Φ(S, t) = S

20

Introducción

Si S es una trayectoria periódica que no es un

punto de equilibrio, es un ciclo lı́mite.

21

Introducción

Por ejemplo, consideremos el oscilador de van

der Pol

dvc

= −20il

dt

dil

1 3

= 0.05(vc − ( il − il ))

dt

3

22

Introducción

El retrato de fase es

23

Introducción

Si se dota a X de una noción de proximidad, es

decir, de una topologı́a, se pueden hacer cosas

interesantes.

24

Introducción

Se supone que se tiene una distancia (una métrica)

sobre X. Se recuerdan las siguientes definiciones:

• Una -bola de un punto x0 ∈ X es el conjunto de puntos x que verifican d(x, x0) < .

• Un conjunto abierto es un conjunto que no

contiene su frontera (más o menos).

• Un entorno de x0 es un abierto que contiene una bola de x0.

• Un entorno de un conjunto es un abierto

que contiene a una bola de cada uno de los

puntos que lo forman.

25

Introducción

Decimos que un conjunto invariante S es un

atractor cuando

• Existe algun entorno V de S tal que todas

las trayectorias Φ(x, t) que comienzan en V

permanecen en V ∀t > t0.

• Dado un punto x0 ∈ S con una -bola B,

cualquiera de las trayectorias anteriores pasa

infinitas veces por B.

26

Introducción

El dominio de atracción es el conjunto de

puntos x ∈ X que tienden al atractor.

27

Introducción

Sea S un conjunto invariante.

(manifold) estable local de S es

La variedad

s (S) = {x ∈ V | Φ(x, t) → S si t → ∞,

Wloc

Φ(x, t) ∈ V ∀t > 0}

siendo V un entorno de S.

El inestable es

u (S) = {x ∈ V | Φ(x, t) → S si t → −∞,

Wloc

Φ(x, t) ∈ V ∀t < 0}

28

Introducción

Las veriedades estables e inestables globales se

obtienen como

s (S), t)

W s(S) = ∪t≤0Φ(Wloc

u (S), t)

W u(S) = ∪t≥0Φ(Wloc

29

Introducción

En el caso de un sistema diferencial lineal ẋ =

Ax las variedades W s y W u del origen son los

subespacios E s y E u generados por los autovalores con parte real negativa y positiva respectivamente.

30

Introducción

En el caso de un sistema en diferencias lineal

xk+1 = Axk las variedades W s y W u del origen

son los subespacios E s y E u generados por los

autovalores con módulo mayor y menor que 1

respectivamente.

31

Introducción

Consideremos un sistema diferencial no lineal

ẋ = f (x). Sea x∗ un punto de equilibrio. Sea

∆x = x − x∗. El sistema linealizado es

∆ẋ = fx∆x

32

Introducción

Se demuestra que los subespacios E s y E u del

sistema linealizado son tangentes en el punto

de equilibrio a las variedades W s y W u del sistema sin linealizar.

33

Introducción

Si el sistema linealizado tiene autovalores de

parte real nula y su subespacio asociado E c,

nada puede decirse de la dinámica de la estabilidad de la dinámica en variedades tangentes

a este subespacio. Por ejemplo,

ẋ = ±x2

ẏ = −1

34

Introducción

Los mismos resultados son válidos para sistemas en diferencias en vez de diferenciales.

35

Introducción

Consideremos ahora dos flujos Φ1 y Φ2 sobre el mismo espacio X. Nos gustarı́a saber

cuando los dos flujos son cualitativamente iguales: conjugados.

36

Introducción

Dos flujos son conjugados cuando existe una

biyección continua (un homeomorfismo) y una

función estrictamente creciente t2 = T (t1) que

hacen conmutativo el diagrama:

X

↓h

X

Φ1 (.,t1 )

→

Φ2 (.,t2 )

→

X

↓h

X

37

Introducción

Dos sistemas lineales ẋ = A1x y ẋ = A2x son

conjugados si A1 y A2 tienen el mismo número

de autovalores con la parte real negativa y el

mismo de autovalores con la parte real positiva.

38

Introducción

Considérese el sistema en <2

ẋ = Ax

donde A tiene dos valores reales distintos λ1

y λ2. Es sabido entonces que A admite una

factorización:

A = V −1

"

λ1 0

0 λ2

#

V = V −1ΛV

39

Introducción

El sistema ẋ1 = Ax1 es conjugado con ẋ2 =

Λx2 sin más que considerar como función T la

identidad ( t1 = t2 ) y como homeomorfismo

h la aplicación lineal x2 = V x1

40

Introducción

Ahora, si se supone que λ1,2 < 0 el sistema 2

es conjugado con

"

ẋ3 =

1

−λ

λ2

0

0

−1

#

x3

sin más que considerar como homeomorfismo

la identidad y como función T la función monótona creciente t2 = − λ1 t1.

2

41

Introducción

1

Defı́nase α = λ

λ2 . El flujo del sistema 3 es una

función lineal dada por la matriz de transición

"

x3(t) = Φ3(t)x3(0) =

exp(−αt)

0

0

exp(−t)

42

#

x3(0)

Introducción

Considerese ahora el sistema 4 dado por ẋ4 =

−I x4, donde I es la matriz identidad. Su flujo

viene dado por

x4(t) = Φ4(t)x4(0) = exp(−t)x4(0)

Entonces, los sistemas 3 y 4 son conjugados

si se consideran como función T la identidad y

como homeomorfismo h:

"

h(x) =

signo(x(1)) | x(1) |α

#

x(2)

43

Introducción

En efecto, es fácil comprobar que

(Φ3 ◦ h)(x) = (h ◦ Φ4)(x)

donde ◦ indica la composición de funciones.

Nótese que h es continúa en el origen si y solo

si α > 0, por lo que si α < 0 no es ni siquiera

un homemorfismo.

44

Introducción

Considérese ahora un quinto sistema definido

por

"

ẋ5 =

−1 1

−1 −1

#

x5

Su flujo viene ahora dado por:

x5(t) = Φ5(t)x5(0)

"

#

cos(t) sin(t)

= exp(−t)

x5(0)

− sin(t) cos(t)

45

Introducción

Es fácil ahora comprobar que el homeomorfismo dado por:

"

h(x) =

cos(ln || x ||) sin(ln || x ||)

− sin(ln || x ||) cos(ln || x ||)

#"

x(1)

x(2)

#

verifica

(Φ4 ◦ h)(x) = (h ◦ Φ5)(x)

Nótese que h tiene una discontinuidad evitable

en el origen, y no es allı́ diferenciable.

46

Introducción

Puede procederse de manera análoga para comprobar que Φ5 es conjugado a todos los sistemas lineales oscilatorios con autovalores de

parte real negativa.

47

Introducción

Consideremos ahora un conjunto de objetos Oλ

dependientes de forma continua de parámetros

λ, que viven en algún espacio topológico. Supongamos que existe también una relación de

equivalencia R entre los objetos O. Si para un

valor λ0 existe un vecindad V, tal que todos los

Oλ para λ ∈ V tienen la relación R con Oλ0 , se

dice que Oλ0 no es una bifurcación.

48

Introducción

Dos casos importantes

• O son flujos dependientes de parámetros

Φλ(x, t) y R es la relación de conjugación.

• O son sistemas de ecuaciones no lineales

fλ(x) = 0 y R es el tener el mismo número

de soluciones.

49

Introducción

Consideremos un determinado diagrama de difurcación. Si el diagrama permanece cualitativamente igual para pequeñas variaciones en

el modelo (es decir, substituir, p. ej., Φλ(x, t)

por Φλ(x, t) + δΦλ(x, t)) se dice que el modelo

es estructuralmente estable.

50

Introducción

Por ejemplo, consideremos el modelo de este

sistema fı́sico

51

Introducción

El hamiltoniano del sistema es:

1

1 2

K(l − l0)2 +

pθ

2

2I

h

1

=

K (L2 + (L + l0 − d)2−

2

H =

2L(L + l0 −

1

d) cos θ) 2

− l0

2

1 2

pθ

2I

= Hd(θ, pθ )

+

Y las ecuaciones del movimiento

dθ

∂H

=

dt

∂pθ

dpθ

∂H

= −

dt

∂θ

52

Introducción

Centrémonos en los puntos de equilibrio

∂H

∂pθ

∂H

0 = −

∂θ

0 =

De la primera ecuación se sigue

p∗θ = 0

Substituyendo en la segunda

1 K(l − l )2

d2

dU

0

=

=0

dθ

dθ

53

Introducción

Haciendo la derivada

dl

dθ

dl dl2

= K(l − l0) 2

dl dθ

1

= K(l − l0) 2L(L + l0 − d) sin θ

2l

0 = K(l − l0)

Hay dos soluciones

θ = 0

l(θ) = l0

54

Introducción

De la segunda solución se obtiene

2 = L2 + (L + l − d)2 − 2L(L + l − d) cos θ

l0

0

0

Luego

2

(L + l0 − d)2 + L2 − l0

cos θ =

2L(L + l0 − d)

Por supuesto, | cos θ |≤ 1. Es fácil comprobar

que para d = 0 , cos θ = 1. Si d > 0, cos θ < 1,

y si d < 0, cos θ > 1.

55

Introducción

En resumen:

• Si d > 0 existen tres soluciones: θ = 0 y

las dos dadas por cos θ = . . ..

• Si d < 0 sólo hay una solución: θ = 0.

56

Introducción

Toda esta información la podemos resumir en

el diagrama de bifurcación:

57

Introducción

Supongamos que consideramos el peso de la

barra M g. El hamiltoniano será ahora:

1

1 2

1

2

p

H = (l − l0) + M gL sin θ +

2

2

2I θ

y procedamos como antes.

58

Introducción

El diagrama de bifurcación es ahora

Ası́ pues, el problema original no tenı́a estabilidad estructural.

59

El 2o método de Lyapunov

Sea un sistema diferencial

ẋ = f (x)

Supongamos que existe una función escalar

V (x) que verifica

• V está inferiormente acotada: V > V0.

• Si x0 no es un punto de equilibrio, dV

dt (x0 ) <

0.

Entonces V es una función de Lyapunov.

60

El 2o método de Lyapunov

Si un sistema tiene una función de Lyapunov,

entonces no tiene más atractores que puntos

de equilibrio.

En efecto, la variación de V se puede escribir

dV

dt

=

X ∂V dxi

i ∂ xi dt

= ∇V.f

Por tanto, es un punto de equilibrio dV

dt = 0,

y en un punto de no equilibrio dV

dt < 0. No

puede haber ciclos lı́mites, porque si x1 y x2

son dos puntos del ciclo, se tendrı́a V (x1) >

V (x2) > V (x1). Tampoco puede haber toros

invariantes o otros atractores por parecidas razones.

61

El 2o método de Lyapunov

Por ejemplo, consideremos el sistema

ẋ1 = −2x1 − x2

2

ẋ2 = −x2 − x1x2

Y escojamos

2

V = x2

1 + x2 ≥ 0

62

El 2o método de Lyapunov

Es fácil comprobar que

2

V̇ = −4x2

1 − 2x2 ≤ 0

V̇ = 0 si y solo si x1 = x2 = 0. Ası́ pues el

único atractor del sistema es el origen.

Por otra parte, V tiende a ∞ cuando | x |→

∞. Por tanto, todas la órbitas permanecen

acotadas, y el origen es un atractor global.

63

El 2o método de Lyapunov

Por esto a veces se exige además que V → ∞

cuando | x |→ ∞, para asegurar convergencia

a algún punto de equilibrio.

64

El 2o método de Lyapunov

Aunque los sistemas que tienen funciones de

Lyapunov son limitados, existen unos cuantos

en que han de existir por razones fı́sicas. Por

ejemplo . . .

65

El 2o método de Lyapunov

Sistemas de gradiente

ẋ = −∇V (x)

Se tiene

dV

dt

= ẋT ∇V (x)

= −(∇V )2

< 0

66

El 2o método de Lyapunov

Sistemas hamiltonianos con rozamiento

∂H

∂pi

∂F

∂H

−

p˙i = −

∂qi

∂pi

q˙i =

siendo F la función de disipación. Es fácil comprobar que

X ∂F ∂H

dH

=−

dt

i ∂pi ∂pi

Se puede comprobar que el segundo término

es negativo, pues F se opone al movimiento,

luego H es una función de Lyapunov.

67

El 2o método de Lyapunov

Consideremos un péndulo no lineal

1 2

H(θ, pθ ) =

pθ − mgl cos θ

2I

1 2

Dp

F =

2 θ

Luego

dH

D

= − p2

θ <0

dt

I

68

El 2o método de Lyapunov

Estas mismas ideas se pueden aplicar a sistemas en diferencias xk+1 = f (xk ). Entonces

V (x) es función de Lyapunov si

• V está inferiormente acotada.

• V (xk+1) < V (xk ) si xk no es punto de equilibrio.

69

El 2o método de Lyapunov

Por ejemplo, f puede ser un algoritmo de optimización, xk el valor de las variables en cada

iteración, y V la función objetivo.

70

El 2o método de Lyapunov

En general, la teorı́a de Lyapunov se aplica relajando alguna de las condiciones; o añadiendo

condiciones nuevas (como todas las cosas relevantes, es una idea, no una receta). Por ejemplo, supongamos que encontramos un punto

de equilibrio x∗, una función V , y un dominio

D que verifican:

• V , inferiormente acotada, tiene un mı́nimo

en D para x = x∗.

• Dentro de D \ x∗, se cumple dV

dt < 0.

• La frontera de lal dominio ∂D coincide con

alguna curva de nivel de V .

Entonces D ∈ el dominio de atracción de x∗

71

El 2o método de Lyapunov

Consideremos de nuevo el oscilador de van der

Pol

dvc

= −20il

dt

1

dil

= 0.05(vc − ( i3

l − il ))

dt

3

Sabemos que este sistema tiene en el origen

un foco inestable y un ciclo lı́mite estable.

72

El 2o método de Lyapunov

Si cambio t por −t el foco inestable se convierte en estable. Su dominio de atracción es

ahora un ciclo lı́mite inestable. Consideremos

ese sistema:

dvc

= 20il

dt

dil

1 3

= −0.05(vc − ( il − il ))

dt

3

73

El 2o método de Lyapunov

Consideremos la función de Lyapunov

V = vc2 + 400i2

l

Se comprueba que

dV

1 2

2

= 800il ( il − 1)

dt

3

Ası́ pues

dV

< 0 si i2

l <3

dt

74

El 2o método de Lyapunov

Si se escoge

V = vc2 + 400i2

l < 1200

se cumple la desigualdad del dominio anterior. Por lo tanto, el dominio D dado por esta

curva de nivel debe pertenecer al dominio de

atracción del origen. Como el dominio real esta

definido por el ciclo lı́mite, este debe estar por

fuera de esa elipse.

75

El 2o método de Lyapunov

De hecho . . .

76

El 2o método de Lyapunov

El punto importante es que la utilización de

funciones de Lyapunov permite estimar, aunque

de forma conservativa, dominios de atracción.

Este hecho se ha empleado en, entre otras

cosas, el estudio de la estabilidad trasitoria de

sistemas eléctricos.

77

El 2o método de Lyapunov

Tenemos un sistema eléctrico que sufre una

perturbación (un corto, p. ej.). Después del

mismo se encuentra en un punto que no es

el punto de equilibrio deseado, que suponemos

estable. La pregunta es: ’ ? Podrá o no alcanzar este punto?.

78

El 2o método de Lyapunov

Modelamos el sistema eléctrico por las ecuaciones:

X

d2δi

dδi

Mi 2 + Di

= Pi −

Cij sin(δi − δj )

dt

dt

j6=i

i = 1, n Cij simetrica

Introducimos la variable pi = Miδ˙i y las funciones

"

H =

X

i

1 2

p −

2Mi i

Piδi −

F =

X1

X Di

i 2Mi

j 2

Cij cos(δi − δj )

p2

i

79

El 2o método de Lyapunov

Las ecuaciones del movimiento quedan en forma

cuasi-hamiltoniana:

∂H

∂pi

∂H

∂F

p˙i = −

−

∂δi

∂pi

δ˙i =

Por tanto

X ∂H ∂F

dH

=−

<0

dt

i ∂pi ∂pi

Por tanto, H es una función de Lyapunov.

80

El 2o método de Lyapunov

Supongamos que se desea saber el dominio de

atracción de un punto de equilibrio (δi, pi) =

(δi∗, 0). Para determinar la frontera del dominio

buscamos donde Ḣ = 0. Pero

X ∂H ∂F

dH

0=

= −

dt

i ∂pi ∂pi

⇒ pi = 0

⇒ δ˙i = 0

Ası́, Ḣ = 0 sólo en alguno de los restantes

puntos de equilibrio.

81

El 2o método de Lyapunov

Llamemos al resto de puntos de equilibrio (δis1, 0),

sj

. . ., (δi , 0), . . .. Sea H ∗ y H j el valor del hamiltoniano en cada punto. Nos interesa la curva

de nivel H = H j tal que

• El dominio encerrado por H = H j y que

pase por el punto de equilibrio j contenga

al punto de equilibrio ∗.

• De entre todas las curvas H = H j que verifiquen el punto anterior, la que tenga el

valor más pequeño.

82

El 2o método de Lyapunov

La figura aclara porqué.

83

El 2o método de Lyapunov

Sea (δiu, 0) el punto que se escoge con el criterio antes expuesto, y H u el valor que alcanza

en él el hamiltoniano. El gran problema es determinarlo, ya que en una red eléctrica con n

generadores existen del orden de 2n puntos de

equilibrio.

Aquı́ entra un poco de heurı́stica basada en la

fı́sica del sistema.

84

El 2o método de Lyapunov

La observación clave es que los puntos de equilibrio están próximos a los puntos

(δ1, δ2, . . . , δn) ≈ (0 ó π, 0 óπ , . . . , 0 ó π)

Por otra parte, en el punto inicial, que no suele

estar muy lejos del (0, 0, . . . , 0) hay uno o unos

generadores que se mueven rápido (grandes

δi), y que llamaremos el conjunto S r ; y el resto

que se mueven despacio: el conjunto S l .

85

El 2o método de Lyapunov

Se supone entonces que el punto u es aquel

que está cerca del punto que tiene ángulo 0

para los δi ∈ S l y ángulo π para los δi ∈ S r .

86

El 2o método de Lyapunov

Por lo tanto, se plantea el algoritmo:

1. Determinar los conjuntos S l y S r a partir de las condiciones en el punto incial

(δi(0), pi(0)).

2. Calcular el punto u resolviendo las ecuaciones para los puntos de equilibrio con

un método iterativo (Newton-Ralphson, p.

ej.) partiendo del punto (0 ó π, 0 ó π, . . . , 0 ó π)

definido por S l y S r .

3. Cacular H u y H(0).

4. Si H(0) < H u el sistema no pierde estabilidad.

87

El 2o método de Lyapunov

Ejemplo, la red de New England.

88

El 2o método de Lyapunov

Las curvas de oscilación.

89

El 2o método de Lyapunov

Los resultados

90

El 2o método de Lyapunov

Queda el problema de determinar una función

de Lyapunov para un sistema concreto. No hay

método general para ello.

91

El 2o método de Lyapunov

En ocasiones, se pueden encontrar funciones

de Lyapunov por razones fı́sicas: energı́a, potenciales termodinámicos, etc.

92

El 2o método de Lyapunov

Para sistemas lineales estables se pueden calcular funciones cuadráticas de Lyapunov.

En efecto, sea P definida positiva.

función V = xT P x del sistema

Sea la

ẋ = Ax

Entonces

V̇

= ẋT P x + xT P ẋ

= x(AT P + P A)x

93

El 2o método de Lyapunov

Entonces V es función de Lyapunov si la matriz

Q definida por

−Q = AT P + P A

es positiva. Recı́procamente, podemos escoger

una matriz definida positiva Q y resolver la matriz P de la ecuación lineal anterior (ecuación

de Lyapunov).

94

El 2o método de Lyapunov

Se demuestra entonces que:

Si A es una matriz estable y Q una matriz

(semi-)definida positiva, entonces la solución

P de la ecuación

AT P + P A = −Q

es (semi-)definida positiva.

95

El 2o método de Lyapunov

Prueba

La matriz

P (t) =

Z ∞

t

T

eA (τ −t)QeA(τ −t)dτ

Verifica

Ṗ = −Q − AT P − P A

96

El 2o método de Lyapunov

Por otra parte, la integral sólo converge si A

es estable. Haciendo el cambio de variables

τ´= τ − t se comprueba que P (t) no depende

de t, luego Ṗ = 0. Ası́ pues,

P =

Z ∞

0

T

eA tQeAtdt

es solución de la ecuación de Lyapunov.

97

El 2o método de Lyapunov

Por otra parte, si Q es definida positiva, M T QM

T

lo es también para cualquier M , por tanto eA tQeAt

lo es para cualquier A, y por lo tanto lo es la

integral, si converge.

98

El 2o método de Lyapunov

Esto sugiere el siguiente procedimiento para

obtener una estimación del dominio de atracción de un punto de equilibrio x∗

99

El 2o método de Lyapunov

1. Linealizar el sistema dinámico alrededor de

x∗: ∆˙ x = fx∆x.

2. Escoger una serie de matrices definidas positivas Qi.

3. Resolver las ecuaciones fxT Pi + Pifx = −Qi.

4. Calcular la curva de nivel más baja para la

cual V̇i = 0 (ejemplo del osc. de van der

Pol).

5. Llamar Ei a las elipses limitadas por esas

curvas de nivel.

6. El dominio de atracción D ⊃ ∪Ei

100

El 2o método de Lyapunov

Existen algunos métodos sistemáticos para encontrar funciones de Lyapunov (gradiente variable, Zubov, etc. ), pero requieren mucho

cálculo, incluso para sistemas de orden moderado.

101

El 1er método de Lyapunov

Sea un sistema diferencial

ẋ = f (x)

Y supongamos que xs es un punto de equilibrio.

0 = f (xs)

102

El 1er método de Lyapunov

Para analizar su estabilidad se puede linealizar

en torno al mismo:

∆ẋ = fx∆x

Lo cual permite estudiar la evolución del sistema en primera aproximación.

103

El 1er método de Lyapunov

El propósito del primer método de Lyapunov

es obtener una solución más exacta por medio

de una serie de aproximaciones.

Primero, un poco de notación.

104

El 1er método de Lyapunov

La serie de Taylor de f (x) en torno a 0 es:

f (x) = fxx +

1

fxx(x ◦ x) +

2

1

fxxx(x ◦ x ◦ x) + . . .

6

105

El 1er método de Lyapunov

Con, el producto de Kronecker

∆x ◦ ∆x

=

∆x1

∆x2

...

∆xn

◦

∆x1

∆x2

=

...

∆xn

∆x1∆x1

∆x1∆x2

...

∆x1∆xn

∆x2∆x1

∆x2∆x2

...

∆x2∆xn

...

∆xn∆xn

106

Y

∂ 2 fn

∂x1 ∂x2

...

∂ 2 fn

∂x1 ∂x1

...

∂ 2 f1

∂x1 ∂x2

∂ 2 f2

∂x1 ∂x2

∂ 2 f1

∂x1 ∂x1

∂ 2 f2

∂x1 ∂x1

...

...

...

...

∂ 2 fn

∂x1 ∂xn

...

∂ 2 f1

∂x1 ∂xn

∂ 2 f2

∂x1 ∂xn

∂ 2 fn

∂x2 ∂x1

...

∂ 2 f1

∂x2 ∂x1

∂ 2 f2

∂x2 ∂x1

...

∂ 2 fn

∂x2 ∂x2

∂ 2 f1

∂x2 ∂x2

∂ 2 f2

∂x2 ∂x2

fxx =

...

...

...

...

∂ 2 fn

∂x2 ∂xn

...

∂ 2 f1

∂x2 ∂xn

∂ 2 f2

∂x2 ∂xn

...

...

...

...

∂ 2 fn

∂xn ∂xn

...

∂ 2 f1

∂xn ∂xn

∂ 2 f2

∂xn ∂xn

El 1er método de Lyapunov

107

El 1er método de Lyapunov

Supongamos, sin pérdida de generalidad, que

el punto de equilibrio es el origen. O sea,

ẋ = f (x)

0 = f (0 )

108

...

1

2

3

1

2

3

2 fxx (x + x + x + . . .) ◦ (x + x + x + . . .) +

1

ẋ1 + ẋ2 + ẋ3 + . . . =

f (x1 + x2 + x3 + . . .)

fx(x1 + x2 + x3 + . . .)+

Substituyendo en la ecuación diferencial:

x = x1 + x2 + x3 + . . .

Escribamos la solución como una serie:

El 1er método de Lyapunov

109

1

1

ẋ3 = fxx3 + 2 2 fxx(x1 ◦ x2)+ 6 fxxx(x1 ◦ x1 ◦ x1)

... = ...

1

ẋ2 = fxx2+ 2 fxx(x1 ◦ x1)

ẋ1 = fxx1

Escribiendo los términos del mismo orden

El 1er método de Lyapunov

110

El 1er método de Lyapunov

Estas ecuaciones pueden resolverse por orden:

primero x1, después se inserta la solución en

la segunda ecuación y se resuelve x2, después

x3, etc.

111

El 1er método de Lyapunov

Por ejemplo, consideremos el sistema no lineal:

dx

= −x + x2

dt

Y busquemos una solución

x = x 1 + x 2 + x3 + . . .

112

El 1er método de Lyapunov

Substiuyendo, se tiene

dx2

dx3

dx1

+

+

+ ... =

dt

dt

dt

−x1 − x2 − x3 + . . . + (x1 + x2 + x3 + . . .)2

113

El 1er método de Lyapunov

Igualando términos del mismo orden

dx1

dt

dx2

dt

dx3

dt

...

dxr

dt

= −x1

= −x2 + x2

1

= −x3 + 2x1x2

= ...

= −xr +

r−1

X

xj xr−j

j=1

114

El 1er método de Lyapunov

La solución de la primera ecuación es:

x1 = ae−t

Substituyendo en la segunda y resolviendo

x2 = −a2e−2t

Y en general

xr = −(−a)r e−rt

115

El 1er método de Lyapunov

Por tanto

x = ae−t − a2e−2t + a3e−3t + . . .

Sea q = ae−t. Entonces:

x = q − q2 + q3 + . . .

116

El 1er método de Lyapunov

La suma converge si −1 < q < 1. En este caso:

x = q(1 + q)−1 = a(1 + et)−1

117

El 1er método de Lyapunov

Analizemos con más cuidado la solución obtenida.

El primer término es:

ẋ1 = fxx1

Luego x1 es una función suma de exponenciales exp(λit), donde λi son los autovalores

de la matriz fx.

118

El 1er método de Lyapunov

El segundo término es:

1

ẋ2 = fxx2 + fxx(x1 ◦ x1)

2

que es un sistema lineal forzado con exponenciales exp(λit). Es bien sabido que sus soluciones son exponenciales suma de estas más

las exponeciales que resultan de fx, es decir,

hay exponenciales de la forma exp[(λi + λj ]t).

119

El 1er método de Lyapunov

Por si no es bien sabido

ẋ = fxx + g(t)

Una solución particular

x = exp(fxt)A +

Z t

−∞

exp[fx(τ − t)]g(τ )dτ

120

El 1er método de Lyapunov

Análogamente, se puede ver fácilmente que en

el paso r la solución incluye exponenciales de

la forma

exp(

X

λi1 + . . . + λir )

r terminos

121

El 1er método de Lyapunov

Por ejemplo, consideremos el problema del movimiento de los asteriodes troyanos:

122

El 1er método de Lyapunov

Las ecuaciones del movimiento son:

dr

= pr

dt

pφ

dφ

= 2 −ω

dt

r

p2

dpr

γm1

φ

= 3 − 3 (r − r1 cos(φ − φ1))

dt

r

s1

γm

− 32 (r − r2 cos(φ − φ2))

s2

dpφ

γm

= − 31 rr1 sin(φ − φ1))

dt

s1

γm

− 32 rr2 sin(φ − φ2))

s2

123

El 1er método de Lyapunov

Con

m2

R

m1 + m2

m1

r2 =

R

m1 + m2

φ2 = 0

r1 =

φ1 = π

s1 =

s2 =

q

r12 + r 2 + 2r1r cos(φ − φ1)

q

r22 + r 2 + 2r2r cos(φ − φ1)

124

El 1er método de Lyapunov

Los puntos de equilibrio estables de estas ecuaciones tienen dos autovalores imaginarios, pues

no se disipa energı́a.

125

El 1er método de Lyapunov

Una trayectoria en el plano r − φ:

126

El 1er método de Lyapunov

La función r(t):

127

El 1er método de Lyapunov

La transformada de Fourier de la función r(t):

128

El 1er método de Lyapunov

Moraleja: En estructuras, hay que tener cuidado

no sólo de que las frecuencias naturales no

puedan excitarse, sino tampoco sus diferencias

y sumas.

129

Teorı́a de catástrofes

Consideremos un sistema que tiene una función

de Lyapunov (un potencial) dependiente de

parámetros

U (x, p)

130

Teorı́a de catástrofes

En los puntos de equilibrio x∗ el potencial es

estacionario:

∂U

|x=x∗,p=p∗ = 0

∂xi

De ahora en adelante supondremos, sin pérdida

de generalidad, que x∗ = 0 y que p∗ = 0.

131

Teorı́a de catástrofes

Por lo tanto el desarrollo de Taylor de V es:

U (x, p) = U0 +

X ∂U

l

∂pl

pl +

1 X ∂ 2U

xi x j +

2 i,j ∂xi∂xj

1 X ∂ 2U

xk pm +

2 k,m ∂xk ∂pm

1 X ∂ 2U

pnps + t.m.o.

2 n,s ∂pn∂ps

132

Teorı́a de catástrofes

Los puntos de equilibrio xe(p) son función del

valor de los parámetros. Resultan de igualar el

gradiente de U a 0. Luego:

X ∂ 2U

i,j ∂xi∂xj

xej +

∂ 2U

pm + t.m.o. = 0

i,m ∂xi∂pm

X

133

Teorı́a de catástrofes

De la expresión anterior:

−1

X ∂ 2U

X ∂ 2U

e

x =

pm + t.m.o.

i,j ∂xi∂xj

i,m ∂xi∂pm

134

Teorı́a de catástrofes

Lo importante es que si

X ∂ 2U

i,j ∂xi∂xj

es regular, la solución cambia un poco cuando

cambian un poco los parámetros. No aparecen

nuevas soluciones, no desaparece ninguna. Un

punto ası́ no es un punto de bifurcación.

135

Teorı́a de catástrofes

Ası́ pues, los puntos entretenidos son aquellos

dode esa matriz es singular. Eso implica que

tiene al menos un autovalor nulo.

136

Teorı́a de catástrofes

Recordando:

AV

= VΛ

W A = ΛW

WV

= I

Λ =

λ1 0 . . . 0

0 λ2 . . . 0

· · · · · · ... · · ·

0 0 . . . λn

Luego

A = V ΛW

Luego, si A es simétrica, V T = W .

137

Teorı́a de catástrofes

Sean entonces V y W los autovectores derechos e izquierdos de

X

∂ 2U

i,j ∂xi∂xj

Y consideremos el cambio de variables

y =Vx

Este cambio es una biyección que no puede

introducir ni eliminar soluciones.

138

Teorı́a de catástrofes

Sea Ũ (y, p) = U (W y, p) el potencial trás el

cambio de variables. Ahora bien, como:

X ∂ 2Ũ

i,j ∂yi∂yj

yi yj =

X ∂ 2U

∂xk ∂xl

k,l

xk xl

Se sigue que

∂ 2Ũ

∂ 2U

xk xl W = Λ

yi yj = V

∂yi∂yj

∂xk ∂xl

139

Teorı́a de catástrofes

Ası́ pues. se tiene:

Ũ (y, p) = U0 +

X ∂ Ũ

∂pl

l

pl +

1X

λiyi2 +

2 i

1 X ∂ 2Ũ

yk pm +

2 k,m ∂yk ∂pm

1 X ∂ 2Ũ

pnps + t.m.o.

2 n,s ∂pn∂ps

El caso interesante es cuando hay uno o más

autovalores nulos. Sean estos los r primeros

(λ1 = . . . = λr = 0).

140

Teorı́a de catástrofes

Se puede demostrar el llamado lema de descomposición, que esencialmente afirma que el

tipo de singularidad que se tiene puede estudiarse exclusivamente en término a las variables

x1, . . . , xr , ignorándose todas las demás.

Más que demostrarlo en el caso general, lo veremos en los casos particulares de 1 o 2 autovalores nulos.

141

Teorı́a de catástrofes

En el caso de un autovalor nulo, se tiene que

U = U0 +

n

X

λiyi2 + yiOi(y, p) +

i=2

ay1k + P1(y1, p) + Q(p)

donde las funciones Oi son polinomios en y y

p de grado al menos 2 en y si p = 0, y P1 es

un polinomio en y1. Q es un polinomio en p.

142

Teorı́a de catástrofes

Consideremos ahora el cambio de variables:

z1 = y1

zi2 = yi2 + yiOi(y, p)

con sign(zi) = sign(yi) i = 2 . . . n

Considerado como una función de y a z es

claramente continuo y derivable infinitas veces. Para que sea un ”buen” cambio de coordenadas alrededor del origen, tendrı́a que ser

también biyectivo: un difeomorfismo.

143

Teorı́a de catástrofes

Alrededor del origen el cambio de variables se

aproxima a una transformación lineal. Será

biyectivo si la matriz de la transformación, que

es su jacobiano, es regular. Entonces, si es regular (biyectiva) en el origen, por continuidad lo

es en un entorno del mismo.

144

Teorı́a de catástrofes

Evaluemos entonces la matriz ddyz en torno al

origen.

Es evidente que

dz1

= 1

dy1

dz1

= 0 j = 2...n

dyj

145

Teorı́a de catástrofes

dzi

. Se tiene que:

Consideremos ahora dy

i

∂Oi(y, p)

2zidzi = 2yidyi + Oi(y, p)dyi + yi

dyi

∂yi

Pero Oi es un polinomio de grado al menos 2 en

monomios que no contengan p, luego al particularizar para p = 0, los dos últimos términos

son despreciables frente al primero. Luego

dzi

y

= i

dyi

zi

146

Teorı́a de catástrofes

Pero

zi2

Oi(y, p)

=1+

2

yi

yi

Al particularizar para p = 0 se tiene que el

cociente es un polinomio en al menos yi2. Por

lo tanto, en un entorno del origen

dzi

= 1 + t.m.o.

dyi

147

Teorı́a de catástrofes

dzi

. Se tiene que

Calculemos ahora dy

j

∂Oi(y, p)

2zidzi = yi

dyj

∂yj

Se tiene que

dzi

1 yi ∂Oi(y, p)

=

dyj

2 zi

∂yj

i (y,p) → 0, se tiene que

Y como yzi → 1 y ∂O∂y

i

j

dzi

= 0 + t.m.o.

dyj

148

Teorı́a de catástrofes

En conclusión

dz

= I + t.m.o. alrededor z = 0, p = 0

dy

149

Teorı́a de catástrofes

Ası́ pues, se tiene que

U = U0 +

n

X

λizi2 + az1k +

i=2

P1(z1, p) + Q(p

Ahora bien, es claro que en cualquier punto

estacionario z2 = . . . = zn = 0. Por lo tanto,

podemos olvidarnos de estas variables y considerar:

U = U0 + az1k + P1(z1, p) + Q(p)

= U0 + ay1k + P1(y1, p) + Q(p)

150

Teorı́a de catástrofes

En esta expresión se puede desarrollar en P1

en series de potencias de y1. Ası́:

U = U0 +

k−1

X

y1i ai(p) +

i=1

ay1k (1 + ak (p)) + Q(p) + t.m.o.

donde ai(0) = 0.

151

Teorı́a de catástrofes

En el último término ak es despreciable frente

a 1 para un entorno del origen. Ası́

U = U0 +

k−1

X

y1i ai(p) + ay1k + Q(p) + t.m.o.

i=1

152

Teorı́a de catástrofes

Ahora, desarrollando en serie cada ai se tiene

que:

ai(p) = aT

i p + t.m.o.

Luego

U = U0 +

k−1

X

k + Q(p) + t.m.o.

y1i aT

p

+

ay

1

i

i=1

Nótese que

∂ i+1U

ai(j) = i

∂ y1∂pj

153

Teorı́a de catástrofes

Por último, el término en y1k−1 siempre se puede

eliminar mediante un cambio de coordenadas.

En efecto, si se define

x = y1 − y0

Y se substituye, se obtiene:

U = U0 +

k−1

X

i

k

(aT

i p)(x + y0) + a(x + y0) + Q(p)

i=1

154

Teorı́a de catástrofes

Los términos de grado k − 1 son:

aTk−1pxk−1 + kxk−1y0

Luego con

y0 = −

aTk−1p

k

desaparecen los términos k − 1

155

Teorı́a de catástrofes

Substituyendo lo anterior, y despreciando términos de orden mayor al lineal en p, se obtiene

U = U0 +

k−2

X

i + axk + Q̃(p)

(bT

p

)x

i

i=1

Si se consideran caambios adicionales de coordenadas, es fácil de comprobar substituyendo

la serie de Taylor que no es posible eliminar

más términos.

156

Teorı́a de catástrofes

Por otra parte, si se trata de optimizar U , los

términos U0 y Q̃(p) no juegan ningún papel,

luego pueden omitirse. Además, igual da calcular el extremo de U o el de Ua . Dividiendo

todo por a se encuentra finalmente que el potencial es equivalente a:

W =

k−2

X

i + xk

( cT

p

)x

i

i=1

157

x3 + ux

x4 + ux2 + vx

x5 + ux3 + vx2 + wx

x6 + tx4 + ux3 + vx2 + wx

pliegue

cúspide

cola de milano

mariposa

Cada cT

i p puede considerarse como un nuevo parámetro.

Las primeras singularidades tienen nombre propio:

Teorı́a de catástrofes

158

Teorı́a de catástrofes

Un poco de nomenclatura:

• x3, x4, etc son los gérmenes de las catástrofes.

• x3 +ux, etc, son los despliegues universales.

• El número de parámetros del despliegue

universal es la codimensión de la catástrofe.

159

Teorı́a de catástrofes

Por ejemplo, consideremos un pliegue W =

x3 + ux. Recordemos que x es lo que varı́a la

solución a lo largo del autovector derecho correspondiente al autovalor nulo, y u es una determinada combinación lineal de los paránetros

p.

Derivando W respecto a x, se tiene

dW

= 3x2 + u

dx

160

Teorı́a de catástrofes

Los puntos de equilibrio verifican dW

dx = 0, de

donde

s

−u

xe = ±

3

Hay dos soluciones para u < 0 (un máximo y

un mı́nimo) y ninguna si u > 0. El autovalor

nulo se da en u = 0.

161

Teorı́a de catástrofes

El diagrama de catástrofe es:

162

Teorı́a de catástrofes

O consideremos la cúspide W = x4 + ux2 + vx.

Se tiene que, en los puntos de equilibrio se

verifica:

dW

= 4x3 + 2ux + v = 0

dx

Esta ecuación define una superficie en el espacio x, u, v.

163

Teorı́a de catástrofes

Por otra parte, el autovalor 0 implica

d2W

2 + 2u = 0

=

12x

dx2

Junto con la ecuación anterior nos da una curva,

que se proyectará como una curva en el plano

u, v.

164

Teorı́a de catástrofes

En efecto, tenemos que

u

2

x =−

6

Y que

x(4x2 + 2u) = −v

Luego

x

4u

= −v

3

165

Teorı́a de catástrofes

Elevando al cuadrado

x216u2 = 9v 2

De donde, substituyendo x2

8 3

− u = 9v 2

3

o

8u3 + 27v 2 = 0

166

Teorı́a de catástrofes

El diagrama de catástrofe es:

167

Teorı́a de catástrofes

Consideremos el problema de una viga articulada en sus extremos sujeta a una fuerza horizontal:

168

Teorı́a de catástrofes

La energı́a acumulada en la barra es proporcional a:

U (Φ, λ) =

Z l( 1 dΦ 2

0

2

ds

)

+ λ cos Φ

Y las condiciones en los extremos son:

dΦ

dΦ

(0) =

(l) = 0

ds

ds

169

Teorı́a de catástrofes

La solución del problema será la función Φ(s)

que minimice U y que esté sujeta a las condiciones de contorno.

Este es un problema en infinitas dimensiones.

Podemos pensar que Φ es el vector que antes

llamábamos x, y que sus componentes son sus

valores en cada punto.

170

Teorı́a de catástrofes

La solución será cuando la primera variación

de U respecto a Φ se anule. Como

U (Φ + δΦ) =

Z l( 1 dΦ + δΦ 2

+

2

ds

0

λ cos(Φ + δΦ)}

)

2

Z l( 1 dΦ

+ λ cos(Φ + δΦ)

=

0 2 ds

Z l

dΦ dδΦ

+

− λ sin(Φ)δΦ +

ds ds

0

t.m.o.

= U (Φ) −

)

Z l( 2

d Φ

δΦ + λ sin(Φ)δΦ

ds2

0

Z l

d dΦ

+

δΦ

0 ds ds

= U (Φ) −

)

Z l( 2

d Φ

δΦ + λ sin(Φ)δΦ

ds2

0

171

El último término se anula por las condiciones

de contorno.

Teorı́a de catástrofes

En conclusión, hemos encontrado que:

)

Z l( 2

d Φ

U (Φ + δΦ) − U (Φ) =

+ λ sin(Φ) δΦ

2

ds

0

Esta fórmula no es nada más que:

U (x + δ x) − U (x) = ∇U.x

172

Teorı́a de catástrofes

Ası́ pues, ∇U = 0 no es más que:

d2Φ

+ λ sin(Φ) = 0

2

ds

con

dΦ

dΦ

(0) =

(l) = 0

ds

ds

Una solución obvia es Φ = 0.

173

Teorı́a de catástrofes

Para buscar posibles puntos de catástrofe tenemos que mirar la segunda variación (derivadas

segundas) alrededor de Φ = 0.

Ası́, se tiene:

Z l 1 dΦ + δΦ 2

0 2

ds

=

Z l( 1 dΦ 2

2 ds

2 )

1 dδΦ

2

ds

0

+

dΦ dδΦ

+

ds ds

Y que

Z l

0

λ cos(Φ + δΦ) =

Z l

0

{λ cos Φ − λ sin(Φ)δΦ

1

− λ cos(Φ) (δΦ)2

2

174

Teorı́a de catástrofes

Luego, en conclusión,

δ 2U =

Z l( 1 dδΦ 2

0

2

ds

1

− λ cos Φ (δΦ)2

2

)

Esta fórmula se puede transformar mediante

integración por partes. En efecto

d

δΦ

ds

d2

!

d

d δΦ

δΦ =

δΦ −

δΦ δΦ

2

ds

ds ds

ds

Al integrar, el primer término se anula por las

condiciones de contorno.

175

Teorı́a de catástrofes

En conclusión:

δ 2U = −

Z l( 2

d

1

2 0

ds2

)

δΦ + λ cos(Φ)δΦ δΦ

Esta expresión es análoga a:

(

δ 2U = xT

∂ 2U

∂xixj

)

x

La existencia de un autovalor nulo implica la

anulación del término entre llaves. El vector

distinto de cero que lo anule es el autovector

correspondiente.

176

Teorı́a de catástrofes

Ası́, hay que resolver

d2

0 =

δΦ + λ cos(Φ)δΦ

2

ds

d2

=

δΦ + λδΦ

2

ds

dδΦ

dδΦ

(0) =

(l) = 0

con

ds

ds

Sólo hay soluciones no triviales cuando

√

m2π 2

λ=

, δΦ = k cos( λs)

2

l

Vamos a analizar la primera bifurcación m = 1.

177

Teorı́a de catástrofes

Por el lema de descomposición, hemos

√ de desarrollar U en la dirección de cos( λs). Entonces

δ 3U =

Z l

1

0 6

λ sin Φ(δΦ)3 = 0

Y

δ 4U

=

=

=

=

=

=

Z l

1

λ cos(Φ)(δΦ)4

0 24

Z l

1

λ

(δΦ)4

24 0

Z

√

λk4 l

4

cos ( λs)

24 0

Z

λk4 l

π

4

cos ( s)

24 0

l

λk4 3

l

24 8

π 2k4

64l

178

Teorı́a de catástrofes

En esencia, tenemos una cúspide

π2 4

k + t.m.o.

U = U0 +

64l

Sabemos que el despliegue universal de una

cúspide tiene dos parámetros, mientras que en

nuestro problema solamente hay uno.

Introduzco un parámetro adicional para seguir

un análisis ”normal”.

179

Teorı́a de catástrofes

Supongamos que el problema es ligeramente

más complicado. Sea pues, una viga con un

imán en el punto medio, que puede ser atraido

por un electroimán recorrido por una corriente

i.

180

Teorı́a de catástrofes

Habrá una contribución adicional a la energı́a

de la forma

1

Um = Ai 3

r

donde r es la distancia del punto medio de la

viga al electroimán.

l

r = r0 − y( )

2

Como

l

dy

l

2

= sin Φ → y( ) =

sin Φ

ds

2

0

Z

181

Teorı́a de catástrofes

Luego

Ai

Um =

R

!3

l

2

r0 − 0 sin Φ

Y

U =

(

Z l

dΦ 2

1

0 2

ds

)

Ai

+ λ cos Φ +

R

!3

l

2

r0 − 0 sin Φ

2

Estamos analizando en torno a i = 0 y λ = πl2 .

Por conveniencia introducimos el incremento

2

λ̃ = λ − πl2 .

182

Teorı́a de catástrofes

El despliegue de la cúspide es de la forma:

π2 4

U = U0 +

k +

64l

a1(λ̃, i)k + a2(λ̃, i)k2 +

a3(λ̃, i)k3 + a0(λ̃, i)

Lo que interesa calcular para caractrizar la cúspide

son los términos lineales de las funciones a1,a2

y a3 .

183

Teorı́a de catástrofes

La variación de U respecto a λ̃ es:

δU =

Z l

0

cos(Φ)λ̃

Substituyendo Φ = 0 + k cos( πl s)

Z l"

1

k2

#

π

2

cos ( ) + O(k4) λ̃

1−

2 0

2

l

l

k2l

=

λ̃ −

λ̃ + t.m.o.

2

8

δU =

184

Teorı́a de catástrofes

La variación de U respecto a i es:

A

δU =

R

l

2

!3 i

r0 − 0 sin Φ

Haganos

=

=

Z

l

2

0

Z l

2

0

Z l

sin Φ

sin(0 + δΦ)

π

2

=

sin k cos( s)

l

0

!

Z l

3

π

k

π

2

=

k cos( s) −

cos3( s) + t.m.o

l

6

l

0

kl k3l

=

−

+ t.m.o.

π

9π

185

Teorı́a de catástrofes

Por otra parte

A

i

δU =

(r0 − )3

A(r0 + )3

=

i + t.m.o.

r06

r03 + 3r02 + 3r02 + 3

=

Ai + t.m.o.

6

r0

Interesan los términos hasta k3, luego

k3l

"

!

Ai 3

2 kl −

+

r

+

3r

0

0

6

π

9π

r0

#

2

2

3

3

k l

k l

3r0 2 + 3

π

π

"

3r02l

Ai 3

3r0l2 2

= 6 r0 +

k+

k

2

π

π

r0

δU =

"

+

l3

π3

#

#

2

3r l

− 0 k3

9π

186

Teorı́a de catástrofes

En conclusión, el despliegue queda, tras omitir

los términos que no dependen de k

3lA

3l2A 2

l

π2 4

k + 4 ki + 2 5 k i − k2λ̃ +

W ∼

64l

8

r0

π r0

"

l3 A

#

3lA

3i

−

k

r06π 3 9r04π

192l3A 2

8l2 2

192l2A

4

∼ k + 4 2 ki + 5 4 k i − 2 k λ̃ +

π

r0 π

r0 π

"

#

4

2

64l A 64l A 3

− 4 3 k i

6

5

r0 π

3r0 π

∼ k4 + ak3 + bk2 + ck

187

Teorı́a de catástrofes

Haciendo k → x−k0 se puede eliminar el término

en k3. En efecto, tras la transformación los

términos cúbicos son

a

3

3

−4x k0 + ax → k0 =

4

Con esto, se tiene:

W ∼ (x − k0)4 + a(x − k0)3 +

b(x − k0)2 + c(x − k0)

∼ x4 + 6x2k02 − 4xk03

−3ax2k0 + 3axk02 + bx2 − 2bk0x + cx

4

2

∼ x + 6k0 − 3ak0 + b x2 +

2

3ak0 − 2bk0 + c x

188

Teorı́a de catástrofes

#

2

4

a

1 64l A 64l A

− 4 3 i

k0 = =

6

5

4

4 r0 π

3r0 π

"

Ası́ pues, es lineal en i. a, b, c son lineales

también. Si solo queremos conservar los términos lineales en los parámetros, se puede escribir

W ∼ x4 + bx2 + cx

189

Teorı́a de catástrofes

De otra manera

W ∼ x4 + ux2 + vx

con

#

4

2

1 64l A 64l A

− 4 3 i

x = k−

6

5

4 r0 π

3r0 π

8l2

192l3A

"

i − 2 λ̃

π

r05π 4

192l2A

v =

i

4

2

r0 π

u =

190

Teorı́a de catástrofes

En el diagrama de bifurcación

191

Teorı́a de catástrofes

Nótese que si i = 0 nos movemos a lo largo

de u. Sin embargo, la más mı́nimo i cambia

cualitativamente la solución.

En cambio, si hubiera más parámetros, la cúspide serı́a cualitativamente la misma. u y v

serian también función lineal de los nuevos parámetros.

192

Teorı́a de catástrofes

En conclusión, una catástrofe con un número de parámetros igual o mayor que su codimensión es estructuralmente estable. Si no,

no.

193

Teorı́a de catástrofes

En análisis por elementos finitos, se transforma

primero una ecuación diferencial en un funcional de la solución U (Φ) que hay que minimizar. Despues se busca una base de funciones

P

φi, se aproxima Φ ≈ i αiφi, y se transforma la

minimización del funcional en la minimización

de una función U (αi).

Por tanto, las únicas singularidades que aparecen son catástrofes.

194

Teorı́a de catástrofes

Se puede proceder de forma análoga para el

caso de dos autovalores nulos (corrango dos).

Entonces, se tiene que

U = U0+

n

X

λiyi2+yiOi(y, p)+P (y1, y2, p)+Q(p)

i=3

donde P es un polinomio de grado 3 al menos

en y1 e y2.

195

Teorı́a de catástrofes

Sea el cambio de variables

z1 = y1

z2 = y2

zi2 = yi2 + yiOi(y, p)

con sign(zi) = sign(yi) i = 3 . . . n

Como antes, es fácil comprobar que esta transformación es un difeomorfismo.

196

Teorı́a de catástrofes

Con este cambio se tiene:

U = U0 +

n

X

λizi2 + P (z1, z2, p) + Q(p)

i=3

donde P es un polinomio de z1 y z2 de grado

al menos tres.

197

Teorı́a de catástrofes

Como antes, es claro que en los extremos de

U , zi = 0 si i > 2. Por lo tanto, el estudio

queda reducido al de

U = U0 + P (z1, z2, p) + Q(p)

= U0 + P (y1, y2, p) + Q(p)

= U0 + P (x, y, p) + Q(p)

Se usa el cambio de notación y1 = x e y2 = y.

198

Teorı́a de catástrofes

Consideremos ahora el polinomio de tercer grado

P . Se puede escribir como

P (x, y, p) = (a1x + b1y)(a2x + b2y)(a3x + b3y)

+R(x, y, p)

= j 3 + t.m.o.

199

Teorı́a de catástrofes

Hay varias posibilidades respecto a los coeficientes ai y bi. La primera es que sean todos

reales y que todas las razones ab i sean distintas.

i

Entonces, se pueden hacer varios cambios de

variables (difeomorfismos):

j 3 ∼ (ax + by)xy

usando x → a2x + b2y, y → a3x + b3y

∼ (x + y)xy

∼ x(x2 − y 2) usando x → x + y, y → x − y

200

Teorı́a de catástrofes

Tenemos, por lo tanto, un germen

x3 − xy 2

Es la catástrofe umbı́lica elı́ptica.

201

Teorı́a de catástrofes

Consideremos ahora el caso en que a1 y b1 son

reales y a2 y b2 y a3 y b3 complejos conjugados.

j 3 = (a1x + b1y)(a2x + b2y)(a¯2x + b¯2y)

202

Teorı́a de catástrofes

Es inmediato que

j 3 = (a1x + b1y)

(<(a2)x + <(b2)y )2 (=(a2)x + =(b2)y )2

Mediante el difeomorfismo

x → <(a2)x + <(b2)y

y → =(a2)x + =(b2)y

Se obtiene:

j 3 ∼ (ax + by)(x2 + y 2)

203

Teorı́a de catástrofes

Entonces

j 3 ∼ (ax + by)(x2 + y 2)

∼ x(x2 + y 2) usando x → ax + by, y → bx − ay

∼ x3 + xy 2

∼ x3 + y 3 usando x → x + y, y → x − y

204

Teorı́a de catástrofes

Tenemos, por lo tanto, un germen

x3 + y 3

Es la catástrofe umbı́lica hiperbólica.

205

Teorı́a de catástrofes

Hasta ahora hemos supuesto que todas las razones ab i eran distintas. Consideremos ahora

a1 i a2

que b = b . Entonces:

1

2

j 3 ∼ (a1x + b1y)2(a3x + b3y)

∼ x2 y

206

Teorı́a de catástrofes

Intuitivamente, parece claro que no es posible describir el comportamiento en dos dimensiones con un monomio. Más adelante demostraremos

esto. Por el momento, baste decir que el último

germen requiere que desarrollemos hasta cuarto

grado.

207

Teorı́a de catástrofes

Sea entonces

j 4 ∼ x2y + ay 4 + by 3x +

cy 2x2 + dyx3 + ex4

Mediante el difeomorfismo

x → x − (cy 2 + dxy + ex2)

1

y → y − y2

2

Se transforma en

j 4 ∼ x2 y + y 4

Es la catástrofe umbı́lica parabólica.

208

Teorı́a de catástrofes

En conclusión, tenemos tres nuevos gérmenes:

3

2

x − xy

η(x, y) = x3 + y 3

2

x y + y4

Entonces, se tiene que

W ∼ η(x, y) +

X

ai,j (p)xiy j

209

Teorı́a de catástrofes

Consideremos difeomorfismos de la forma

x → x + φ(x, y)

y → y + ψ(x, y)

Con φ y ψ polinomios con coeficientes pequeños.

El efecto sobre η(x, y) es

η(x, y) → η(x, y) + φ(x, y)

∂η

∂η

+ ψ(x, y)

∂x

∂y

210

Teorı́a de catástrofes

Luego, con un difeomorfismo adecuado, podemos

∂η

y

eliminar todos los monomios múltiplos de ∂x

∂η

∂y .

211

Teorı́a de catástrofes

Una manera de determinar los despliegues universales es mediante el truco de Siersma:

x

x2

x3

x4

...

...

y

x2 y

x3 y

...

y2

xy

...

xy 2

x2y 2

...

...

y3

xy 3

...

...

y4

...

212

Teorı́a de catástrofes

Por ejemplo, para el despliegue universal de la

umbı́lica hipérbolica x3 + y 3:

∂x3 + y 3

= 3x2

∂x

∂x3 + y 3

= 3y 2

∂y

x

x2

x3

x4

...

...

y

x2 y

x3 y

...

y2

xy

...

xy 2

x2y 2

...

...

y3

xy 3

...

...

y4

...

El despliegue universal es:

W = x3 + y 3 + wxy + ux + vy

213

Teorı́a de catástrofes

Para deternminar el despliegue universal de la

umbı́lica elı́ptica x3 − xy 2

∂x3 − xy 2

= 2xy

∂y

∂x3 − xy 2

= 3x2 − y 2

∂x

x

x2

x3

x4

...

...

y

x2 y

x3 y

...

y2

xy

...

xy 2

x2y 2

...

...

y3

xy 3

...

...

y4

...

214

Teorı́a de catástrofes

Además, si consideremo un término de despliegue

x2 + y 2

3x3 = x(3x2 − y 2) − y(xy)

y 3 = −y(3x2 − y 2) + 3x(xy)

4x2 = (3x2 − y 2) + (x2 + y 2)

−4y 2 = (3x2 − y 2) − 3(x2 + y 2)

Luego, un despliegue universal es:

W = x3 − xy 2 + w(x2 + y 2) + ux + vy

215

Teorı́a de catástrofes

Por último, la umbı́lica parabólica y 4 + x2y

∂y 4 + x2y

= 2xy

∂x

∂y 4 + x2y

= 4y 3 + x2

∂y

x

x2

x3

x4

...

...

y

x2 y

x3 y

...

y2

xy

...

xy 2

x2y 2

...

...

y3

xy 3

...

...

y4

...

216

Teorı́a de catástrofes

Se tiene en cuenta:

x3 = (4y 3 + x2)x − 4y 2(xy)

4y 4 = y(4y 3 + x2) − x(xy)

4y 3 = (4y 3 + x2) − x2

Luego, el dsdoblamiento universal es:

W = y 4 + x2y + wx2 + ty 2 + ux + vy

217

x3 + ux

x4 + ux2 + vx

x5 + ux3 + vx2 + wx

x6 + tx4 + ux3 + vx2 + wx

x3 − xy 2 + w(x2 + y 2) + ux + vy

x3 + y 3 + wxy + ux + vy

y 4 + x2y + wx2 + ty 2 + ux + vy

pliegue

cúspide

cola de milano

mariposa

umbı́lica elı́ptica

umbı́lica hipérbolica

umbı́lica parabólica

En resumen, tenemos las catástrofes:

Teorı́a de catástrofes

218

Teorı́a de catástrofes

Claramente, existen más catástrofes si las derivadas terceras se anulan, o hay condiciones

adicionales de degeneración (las tres razones

ai

bi iguales). Pero estas catátrofes tienen codimensión mayor que 4.

Las catástrofes de la lista son las 7 catástrofes

elementales (codimensión no mayor que 4).

219

Teorı́a de catástrofes

La superficie de equilibrio viene dada por la

solución de la ecuación

∂W

=0

∂x

o

∂W

∂W

=

=0

∂x

∂y

220

Teorı́a de catástrofes

El conjunto de bifurcación requiere la condición

adicional

∂ 2W

=0

2

∂x

o

det

∂ 2W

∂x∂y

!

=0

221

Teorı́a de catástrofes

El pliegue:

222

Teorı́a de catástrofes

La cúspide:

223

Teorı́a de catástrofes

La cola de milano:

224

Teorı́a de catástrofes

La umbı́lica elı́ptica:

225

Teorı́a de catástrofes

La umbı́lica hiperbólica:

226

Teorı́a de catástrofes

La mariposa (i):

227

Teorı́a de catástrofes

La mariposa (ii):

228

Teorı́a de catástrofes

La umbı́lica parabólica:

229

Teorı́a de singularidades

Consideremos un sistema de ecuaciones dependiente de parámetros:

F(x, p) = 0

cuya linealización es:

Fx∆x + Fp∆p = 0

230

Teorı́a de singularidades

De ahora en adelante se supondrá, sin pérdida

de generalidad, que se lineliza en torno al origen x = 0, p = 0. Ası́

Fx x + Fp p = 0

231

Teorı́a de singularidades

Si Fx no es singular

x = −Fx−1Fpp

Es decir, la solución se continua suavemente.

Ası́ pues, los sitios en que suceden cosas interesates (soluciones que se crean o se destruyen)

son aquellos donde Fx es singular: las singularidades.

232

Teorı́a de singularidades

Se supone ası́ que Fx es singular. Una forma

sistemática de determinar la forma de las soluciones es mediante la reducción de LyapunovSchmidt.

233

Teorı́a de singularidades

Dado que Fx es una aplicación singular de <n

en <n, se podrá escribir:

<n = ker Fx ⊕ M

<n = N ⊕ rangoFx

Sea E la proyección de <n en el rangoFx. Entonces F(x, p) es equivalente al par de ecuaciones:

E F((x, p) = 0

(I − E)F(x, p) = 0

234

Teorı́a de singularidades

Por otra parte, se puede escribir x = v + u, con

v ∈ ker Fx y u ∈ M . Luego

E F(v + u, p) = 0

Esta última expresión la podemos considerar

como una función de (v, u, p). En torno a la

singularidad, todos estos vectores serán pequeños. Luego:

E Fxv + E Fxu + E Fpp + t.m.o. = 0

235

Teorı́a de singularidades

Pero v ∈ ker Fx, luego Fxv = 0. Se tiene entonces que, hasta términos de segundo orden

E Fxu = Fxu = −E Fpp

Si se considera esto como un sistema lineal a

resolver en u, el término independiente está en

el rango de Fx, luego el sistema tiene solución. La solución no serı́a única, sino que se

la podrı́a sumar cualquier vector en el kernel

de Fx. Pero como u es perpendicular a todos

estos vectores, es único.

236

Teorı́a de singularidades

Se ha probado que la ecuación

E F(v + u, p) = 0

tiene una única solución hasta términos cuadráticos. Esto quiere decir que tiene, localmente, una única solución. Por lo tanto, se

puede invertir para escribir:

u = U(v, p)

237

Teorı́a de singularidades

Substituyendo esta solución, se obtiene:

(I − E)F(v + U(v, p), p) = 0

Esta es una función de v ∈ ker Fx en el corrango de Fx. Ahora bien, el kernel está generado por los autovectores derechos vi correspondientes al autovalor nulo, y el corrango está

generado por los autovectores izquierdos wj .

238

Teorı́a de singularidades

Ası́, la ecuación previa es equivalente a:

wjT (I − E)F(

X

yivi + U(

i

X

yivi, p), p) = 0

i

i, j = 1 . . . rangoFx

O

wjT F(

X

i

yivi + U(

X

yivi, p), p) = 0

i

i, j = 1 . . . rangoFx

239

Teorı́a de singularidades

Dicho de otra forma, tenemos las ecuaciones

reducidas:

gj (yi, p) = 0

240

Teorı́a de singularidades

Las ecuaciones gj son difı́ciles de obtener en

forma analı́tica, debido a la dificultad existente

en obtener la función U. No obstante, es bastante fácil obtener su serie de Taylor, lo que

suele ser suficiente en muchas aplicaciones.

241

Teorı́a de singularidades

En efecto, se tiene:

"

#

∂gj

∂U

T

= wj Fx(vi +

) =0

∂yi

∂yi

∂gj

= wjT Fp + FxUp

∂p

"

!

2

∂ gj

∂U

∂U

T F

=

w

(

v

+

)

◦

(

v

+

) +

xx

i

i

j

2

∂yi

∂yi

∂yi

#

∂ 2U

Fx 2

∂yi

"

!

2

∂ gj

∂U

∂U

T

= wj Fxx (vi +

) ◦ (vk +

) +

∂yiyk

∂yi

∂yk

#

∂ 2U

Fx

∂yiyk

... = ...

242

Teorı́a de singularidades

La única dificultad para aplicar estas fórmulas

es conocer las derivadas de U. Pero esta función

viene de invertir

E F(

X

yivi + u, p) = 0

i

Se recuerda que desarrollando hasta el primer

orden se obtiene:

E Fx u + E Fp p = 0

Ası́ pues, u no depende en primer orden de yi

y por lo tanto

∂U

=0

∂yi

243

Teorı́a de singularidades

Por otra parte, derivando dos veces

E F(

X

yivi + U(yi, u, p)) = 0

Se obtiene:

"

∂ 2U

∂U

∂U

E Fx 2 + Fxx (vi +

) ◦ (vi +

)

∂yi

∂yi

∂yi

!#

=0

De donde

∂ 2U

−1 E F (v ◦ v )

=

−

F

x

xx i

i

∂yi2

244

Teorı́a de singularidades

Análogamente se demuestra que:

Up = −Fx−1E Fp

245

Teorı́a de singularidades

Una vez obtenidos los desarrollos en serie de

las gi, se pueden aplicar cambios de variables

(difeomorfismos) adicionales para eliminar los

términos de orden mayor que el primero que

aparece con coeficiente no nulo (exactamente

igual que en teorı́a de catástrofes).

246

Teorı́a de singularidades

En el caso de un autovalor nulo, tenemos tan

solo una gi: g(y, p). Desarrollando en serie:

g(y, p) = ay k +

k−1

X

b(p)y i + t.m.o.

i=0

con

b(0) = 0

247

Teorı́a de singularidades

Haciendo la transformación y → y−y0 podemos

eliminar el término en k − 1: obtenemos las

catástrofes con una variable de estado.

248

Teorı́a de singularidades

Por ejemplo, consideremos que k = 2. Sea v

el autovector derecho correspondiente al autovalor nulo, y w el izquierdo. Entonces

I − E = vT v

249

Teorı́a de singularidades

Aplicando las fórmulas anteriores:

∂g

=

∂y

=

∂g

=

∂p

=

"

w T F x (v +

∂U

)

∂y

0

wT Fp + FxUp

w T Fp − E F p

= w T Fp

∂ 2g

∂y 2

#

"

!

∂U

∂U

) ◦ (v +

) +

Fxx (v +

∂y

∂y

#

2

∂ U

Fx 2

∂y

= wT

= wT [Fxx (v ◦ v) − E Fxx(v ◦ v)]

= wT [Fxx (v ◦ v)]

250

Teorı́a de singularidades

En suma, se tiene que

1 T

w Fxx(v ◦ v)y 2 + wT Fpp + t.m.o. = 0

2

Esta es la expresión de la forma normal de la

bifurcación pliegue.

251

Teorı́a de singularidades

Una lista de singularidades:

252

Métodos de continuación

Sea la ecuación

f (x, λ) = 0

donde λ es un parámetro que varı́a en un determinado intervalo. El problema es calcular el

comportamiento de la solución en dicho intervalo.

253

Métodos de continuación

Se parte de una solución conocida x0, λ0. Se

pretende entonces obtener una serie de soluciones

{(xk , λk )}

254

Métodos de continuación

Para pasar de la soluciók k a la k + 1 se realiza

un proceso en dos pasos:

1. Predicción: A partir de la solución conocida (xk , λk ) se estima una solución (x̃k+1, λ̃k+1).

2. Corrección: La solución estimada (x̃k+1, λ̃k+1).

se corrige a una nueva solución (xk+1, λk+1).

255

Métodos de continuación

Es preciso dar también algún control sobre la

distancia de (xk , λk ) a (xk+1, λk+1): el control

de longitud de paso. También es preciso, en

el caso de que haya ramas de soluciones que se

unan o desparezcan, dar algún procedimiento

para escoger rama: la estrategia de parametrización.

256

Métodos de continuación

Un método de continiación queda definido cuando

se especifica:

1. El predictor.

2. La estrategia de parametrización.

3. El corrector.

4. El control de la longitud del paso.

257

Métodos de continuación

Los predictores pueden ser divididos en dos

clases:

• Predictores EDO, basados en f (x, λ) y sus

derivadas.

• Extrapolación polinomial, que sólo usa soluciones de la ecuación f (x, λ) = 0.

258

Métodos de continuación

Métodos EDO

Tomando el diferencial de la ecuación a resolver:

0 = df = fxdx + fλdλ

de donde

dx

−1 f

=

−

f

x

λ

d

λ

Ası́, si integro esta EDO (Euler, Runge-Kuta,

etc) obtengo la rama de soluciones.

259

Métodos de continuación

Si nos acercamos a un punto donde det(fx) =

0, vamos a tener dificultades con esta ecuación.

Una solución es cambiar el parámetro de λ a

la longitud de arco s:

Sea x = x(s), y λ = λ(s).

260

Métodos de continuación

0 = fx

dλ

dx

+ fλ

ds

ds

Y además:

2

dx1 2

dxn 2

dλ

+ ... +

+

=1

ds

ds

ds

Esta es una ED implı́cita en las incógnitas

x1, x2, . . . , λ. Más adelante veremos como se

integra.

261

Métodos de continuación

Un predictor EDO importante es el predictor

de la tangente. De:

fxdx + fλdλ = 0

Se sigue

[fx, fλ] z = 0

con

zi = dxi 1 ≤ i ≤ n zn+1 = dλ

262

Métodos de continuación

La tangente z no tiene un módulo definido.

Una manera de dárselo es hacer, por ejemplo:

eTk z = zk = 1

De donde

"

fx, fλ

eTk

#

z = en+1

263

Métodos de continuación

La ecuación anterior tiene solución simpre que

rango [fx, fλ] = n

Lo cual es posible (o no) incluso si det fx = 0.

264

Métodos de continuación

Una vez calculado z se construye el predictor

(x̃k+1, λ̃k+1) = (xk , λk ) + σ z

siendo σ el paso apropiado.

El método ası́ descrito (de la tangente) se

puede considerar análogo al método de Euler

para EDO.

265

Métodos de continuación

Volviendo al método de la longitud de arco.

Consideremos las ecuaciones

dxn+1

dx

0 = fx + fλ

ds

ds

!2

2

2

dxn+1

dx1

dxn

1 =

+ ... +

+

ds

ds

ds

Con λ = xn+1.

266

Métodos de continuación

Supongamos ahora que se hace temporalmente,

m = 1. Entonces la primera

para algún m, dx

ds

ecuación (lineal) puede resolverse en el resto

de las incógnitas para obtener:

dxi

= ci

ds

267

Métodos de continuación

Debido a la linealidad, la solución real verificará:

dxi

dxm

= ci

ds

ds

Substituyendo en la segunda ecuación (no lineal):

2

dx

m

2

2

2

=1

(c2

+.

.

.+c

+1+c

+.

.

.+c

)

1

m−1

m+1

n+1

ds

m , y después el resto.

De donde se despeje dx

ds

268

Métodos de continuación

Extrapolación polinomial

Se puede hacer pasar un polinomio de grado ν

a través de los ν + 1 puntos

(xj , λj ), (xj−1, λj−1), . . . , (xj−ν , λj−ν

269

Métodos de continuación

Por ejemplo,

• El predictor de orden 0:

(xj+1, λj+1) = (xj , λj )

• El prdictor de orden 1:

(xj+1, λj+1) = (xj , λj )+σj (xj −xj−1, λj −λj−1)

270

Métodos de continuación

Parametrización

Una parametrización es algo que nos permite

identificar de manera no ambigua cada solución

a lo largo de una rama de soluciones.

Por ejemplo, λ no es un buen parámetro, mientras que [y ] lo es.

271

Métodos de continuación

Una manera sistemática de tratar las parametrizaciones es introduciendo el parámetro γ a

través de la ecuación:

p(x, λ, γ) = 0

El sistema original de ecuaciones se agranda:

F(X, γ) =

f (x, λ)

p(x, λ, γ)

!

con X = (x, λ).

272

Métodos de continuación

Distintas parametrizaciones corresponden a diferentes funciones p. Por ejemplo, si se toma el

propio λ como parámetro de continuación, se

tiene γ = λ, y:

p(x, λ) = λ − λj+1

273

Métodos de continuación

Otra solución más interesante, que evita problemas en los pliegues, es hacer que γ sea algo

similar a la longitud del arco:

p(x, λ, γ) =

n

X

(xi−xi(sj ))2+(λ−λ(sj ))2−(s−sj )2

i=1

274

Métodos de continuación

A veces conviene pesar distinto variables y parámetros:

p(x, λ, γ) = ζ

n

X

(xi − xi(sj ))2 +

i=1

(1 − ζ)(λ − λ(sj ))2 − (s − sj )2

275

Métodos de continuación

También puede escogerse cualquier componente

de x como parámetro γ. Esto conduce a ecuaciones:

p(x, λ, γ) = xk − γ

276

Métodos de continuación

Esta selección se llama parametración local. Si

se utiliza en conjunción con el predictor de la

tangente, es habitual escoger el ı́ndice k tal

que

n

kzk k = max kz1k, . . . , kznk, kzn+1k

o

277

Métodos de continuación

Correctores

Un corrector es un procedimiento para encontrar una solución de la ecuación f (xj+1, λj+1) a

˜ ).

partir de una solución aproximada (xj+1

˜ , λj+1

278

Métodos de continuación

El sistema de ecuaciones f (x, λ) = 0 tiene n

ecuaciones y n + 1 incógnitas. Se necesita una

ecuación adicional. Por ejemplo:

1. λ = λ̃j .

2. xk = x̃k .

279

Métodos de continuación

Si se utiliza el predictor de la tangente se puede

dat como ecuación adicional

T

∆x , ∆λ z = 0

280

Métodos de continuación

Una vez escogida la ecuación adicional, se resuelve por algún método tradicional, como NewtonRaphson.

281

Métodos de continuación

Control de longitud de paso

Depende mucho del predictor y corrector usados. Dos simples estrategias son:

• Paso constante.

• Decidir el número de iteraciones que queremos en el corrector Nopt y actualizar el

N

paso multiplicando el paso previo por Nopt ,

j

donde Nj son las iteraciones que de hecho

se tuvieron con el corrector.

282

Métodos de continuación

En ocasiones, la longitud del paso depende de

lo que estemos interesados en calcular. Por

ejemplo, en estudios de estabilidad iremos más

lentos al acercarnos al punto donde la estabilidad se pierde.

283

Bifurcaciones locales de puntos de equilibrio

Sea un sistema diferencial:

ẋ = f (x, p)

Supongamos que existe un punto de equilibrio

xs:

0 = f (xe, pe)

284

Bifurcaciones locales de puntos de equilibrio

El primer paso para analizar la estabilidad de