MODELOS DE VARIABLES LATENTES : ANALISIS FACTORIAL

Anuncio

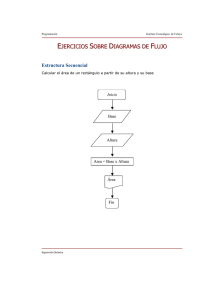

MODELOS DE VARIABLES LATENTES : ANALISIS FACTORIAL José Luis Vicente Villardón Departamento de Estadística Universidad de Salamanca MODELOS DE VARIABLES LATENTES INtTRODUCCION: EL PROBLEMA ESTADÍSTICO Los métodos estadísticos basados en modelos de variables latentes juegan un importante papel en el análisis de datos multivariantes. Se han desarrollado para responder a necesidades prácticas en diversos campos de la ciencia pero, especialmente, en psicología y en las ciencias sociales. Los sondeos estadísticos a gran escala generan mucha más información de la que puede ser asimilada por la persona que interpreta los resultados. Incluso con las medidas de resumen clásicas como tablas de frecuencias, coeficientes de correlación, etc… es difícil encontrar patrones en las interrelaciones entre las variables , especialmente si el número es muy elevado. Los métodos basados en variables latentes pretenden reducir la dimensionalidad del conjunto de datos a dos o tres dimensiones manteniendo la mayor parte de la información posible. Esto puede hacerse debido a que muchas de las cuestiones planteadas en los sondeos o muchas de las variables medidas en un estudio son, en realidad, aspectos de la misma característica básica. Por ejemplo, cuando preguntamos en un cuestionario de salud general ¿Ha pensado de Ud. es una persona que no vale nada? y ¿Ha tenido el sentimiento de que la vida no merece la pena vivirse?, se trata en realidad de preguntar por pensamientos relacionados con la depresión desde distintos puntos de vista. Comenzamos con una matriz de datos que contiene las observaciones para p variables tomadas sobre n in individuos x 11 x 21 X= M x n1 x 12 x 22 M x n2 K x 1p K x 2P M K x np Las observaciones pueden ser variables medidas o códigos asignados a las respuestas a cada pregunta. El problema consiste en sustituir X por otra matriz con un número reducido de columnas y que sea tan cercana a X como sea posible. La segunda aproximación a los modelos de variables latentes es más teórica y procede del ámbito de las ciencias sociales. La aproximación tiene que ver con cantidades que se tratan como si fueran medibles pero para las que no existe un instrumento de medida. Por ejemplo, oimos hablar de la calidad de vida, el conservadurismo, o la inteligencia general e incluso hacemos afirmaciones sobre su incremento o disminución y les asignamos valores numéricos, aunque tales variables son solo hipotéticas y no son directamente medibles. El problema del estadístico es desarrollar un marco teórico en el que pueda hacerse esto. En la práctica se elige un conjunto de indicadores que pueden medirse y entonces se trata de extraer lo que es común a todos ellos. En cualquiera de los dos casos llegamos al mismo punto, el número de variables tiene que resumirse. La terminología usual para lo que hemos llamado variables hipotéticas o factores es la de variables latentes o factores. En la práctica existen dos formas de entender las variables latentes, una realista, en la que las variables latentes son consideradas como cantidades reales, definidas teóricamente antes de los indicadores, que incluso podrían ser medibles y para las que construimos una cantidad cercana a partir de los indicadores, y una instrumentalista en la que las variables latentes se obtienen después de los indicadores, como resultado de la medida de los mismos. Una buena parte del debate filosófico actual en lo que se refiere a modelos de variables latentes se centra en lo que en la literatura anglosajona se denomina “reification”, que consiste en la discusión de si las variables latentes son reales en el sentido que los son, por ejemplo, la talla o el peso. La utilidad y la validez de los métodos que trataremos a continuación no depende de si se utiliza la visión realista o la instrumentalista, en cualquiera de los dos casos es posible utilizar los métodos para predicción o para establecer relaciones como si estuviéramos tratando con cantidades reales. Los métodos que se incluyen en este apartado son los relacionados con el análisis factorial en sus distintas versiones, el análisis de clases latentes, el análisis de la estructura latente y el estudio de mezclas de distribuciones. Las variables que pueden observarse directamente se conocen como variables manifiestas y serán denotadas con X. Una colección de p variables manifiestas se distinguirá mediante subíndices y se escribirá como vector columna X = (X1 , X 2 ,K, X p )' Denotaremos la observación de un individuo h sobre una variable Xi se denotará con xhi, y xh será el vector para todas las variables sobre el individuo. Las variables latentes se denotarán con F (U en algunos casos) y su número será q. Para el restos clasificaremos el nivel de medida de las variables en métrico y categórico (no métrico). Serán métricas aquellas que toman valores en el conjunto de los números reales y pueden ser discretas o continuas. Las categóricas asignan a los individuos a un cierto número de categorías, y pueden ser ordenadas o no. Las técnicas relacionadas con variables latentes pueden clasificarse como se muestra en la tabla siguiente. Variables Manifiestas Métricas Métricas Categóricas Análisis Factorial Análisis de la estructura latente Variables Análisis Factorial de datos categóricos Latentes Categóricas Análisis de perfiles latentes An. De clases latentes. El propósito general es explicar las relaciones entre las variables manifiestas a través de un conjunto de variables latentes de forma que, dadas éstas las otras sean independientes. Desde un punto de vista más intuitivo se trata de extraer que es lo que tienen en común las variables manifiestas y resumirlo en un conjunto reducido de variables latentes. ANALISIS FACTORIAL Método del Análisis Multivariante que intenta explicar las relaciones entre un conjunto de variables observables mediante un número reducido de variables hipotéticas MODELO FACTORIAL LINEAL: Sean X1, …, X2 variables aleatorias observables sobre una población. Se trata de encontrar p+q nuevas variables denominadas factores, F1, …, Fq, U1, …, Up, tales que X 1 = a11 F1 + a12 F2 + Ka1q Fq + d1U1 X 2 = a21 F1 + a22 F2 + Ka2qFq + d2U 2 KKKKKKKKKKKKKKKK X p = ap1F1 + ap2 F2 +Ka pq Fq + dpU p con F1 ,K,Fq ≡ Factores Comunes U1 ,K,U p ≡ Factores Unicos En el modelo factorial lineal suponemos: - q<p (queremos explicar las variables observadas con un número reducido de variables hipotéticas – factores) - Los q+p factores son variables incorreladas. SATURACIONES, COMUNALIDAD Y UNICIDAD Suponemos que los factores y las variables observadas están centrados y estandarizados (reducidos) E[X i ] = E[ Fj ] = E[ Ui ] = 0 Var[X i ] = Var[ Fj ] = Var[U i ] = 1 i = 1,K,p; j = 1,K,q A los coeficientes a ij se les denomina saturaciones de la variable Xi en el factor F j. Como las variables y los factores están reducidos 2 2 2 Var(Xi ) = ai1Var(F1 ) + K + aiq Var(Fq ) + di Var(Ui ) de donde 2 2 2 1 = ai1 + K + aiq + di 2 de aquí se deduce que aij es la contribución del Factor Fj a la variabilidad total 2 de la variable Xi, mientras que di , es la contribución del factor único y se denomina unicidad. A la suma de las contribuciones de todos los factores comunes 2 hi2 = ai1 +K + aiq2 se la denomina comunalidad, de forma que la variabilidad de una variable cualquiera es la suma de su comunalidad más su unicidad 1 = hi2 + di2 , i = 1,K, p El modelo factorial lineal puede expresarse en notación matricial como X = AF + DU X = (X 1 ,K, X p ) ′ ; F = (F1 ,K, Fq ); U = (U 1 ,K, U p )′ A = (a ij ); D = diag(di ) EJEMPLOS TIPICOS EN LOS QUE SE UTILIZA ANALISIS FACTORIAL - Las diferentes asignaturas que componen la enseñanza media se dividen en ciancias y letras. - Ciertos síntomas clínicos propios de los enfermos mentales se clasifican en síntomas de tipo neurótico y síntomas de tipo psicótico. - El estudio de los conflictos internos de las naciones descubre la existencia de tres factores: Agitación, revolución y subversión. - La estructura de la personalidad medida a través de los diferentes items de un test, está dominada por dos dimensiones: Factor neuroticismoestabilidad y factor introversión-extroversión. - Los items de un test de inteligencia se pueden agrupar en varios factores que miden capacidades verbales, numéricas, espaciales, etc EJEMPLO PREVIO Los datos siguientes corresponden a 8 alumos en las asignaturas de Matemáticas, Ciencias Naturales, Francés y Latín. Alumno 1 2 3 4 5 6 7 8 Matem. 9 10 3 9 7 5 5 4 C. Nat. 8 9 5 9 6 5 5 4 Francés 6 10 9 8 3 5 7 3 Latín 7 10 8 8 5 5 6 4 Es bien conocida la división clásica de las asignaturas de la enseñanza media en asignaturas de Ciencias y asignaturas de Letras. En lineas generales, las primeras se caracterizan por un factor racional y empírico, mientras que las segundas tienen un significado más especulativo, siendo la memoria una de sus características más importantes. Cada una de las asignaturas tendrá un poco de ambas componentes, aunque será mayoritariamente de uno de los dos grupos. Por ejemplo, las Ciencias Naturales son consideradas de Ciencias pero es indudable que también tienen una importane componente de memoria. Además, cada asignatura tendrá tambien un componente propio, más alla de lo que tengan de Ciencias o Letras. Estructura de correlaciones entre las variables Correlation Matrix matemáticas C. Naturales Francés Latín 1,000 ,943 ,302 ,560 C. Naturales ,943 1,000 ,544 ,758 Francés ,302 ,544 1,000 ,934 Latín ,560 ,758 ,934 1,000 matemáticas Observese como las asignaturas consideradas de Ciencias están altamente correlacionadas entre si y lo mismo ocurre con las asignaturas de letras. Las correlaciones entre los dos grupos son más bajas, aunque todavía de una magnitud importante, esto se debe a que los alumnos buenos suelen serlo en todas las asignaturas aunque tengan preferencias por uno de los dos grupos, ésto se muestra también en el hecho de que las correlaciones son todas positivas. Trataremos, entonces de resumir la información de las cuatro variables en sólo dos factores, que esperamos que se correspondan con Ciencias y Letras. Téngase en cuenta que los factores están definidos en teoría sólo a priori, y que el procedimiento de análisis puede no detectarlos. La variabilidad recogida por los distintos factores (2) se muestra en la tabla siguiente Eigenvalues Magnitude Variance Prop. Value 1 3,016 ,754 Value 2 ,891 ,223 Es decir, con sólo dos factores recogemos el 97,7% de la variabilidadtotal. Supongamos que las saturaciones (correlaciones) de las asignaturas con cada uno de los dos factores son las siguientes, después de haber aplicado una solución para el problema planteado en Análisis Factorial. Matriz Factorial Orthogonal Solution Factor 1 Factor 2 matemáticas ,974 ,158 C. Naturales ,901 ,416 Francés ,154 ,971 Latín ,429 ,894 La solución obtenida muestra claramente los dos factores teóricos (Ciencias y letras) y como cabía esperar de los principios de la teoría relacionada con el problema, las Ciencias Naturales tienen, además de su parte de Ciencias, una componente clara relacionada con las Letras debida a la componente memorística de la asignatura. Lo mismo ocurre con el latín en relación a la componente de azonamiento. Las contribuciones, comunalidades y unicidades son Matemáticas C. naturales Francés Latín Contribuciones Factor 1 Factor 2 Comunalidad Unicidad ,949 ,025 ,974 ,026 ,812 ,173 ,985 ,015 ,024 ,943 ,967 ,033 ,184 ,799 ,983 ,017 Los dos factores explican prácticamente el 100% (Alrededor del 97-98%) de la variabilidad en la nota de las 4 asignaturas. Las unicidades, en torno al 2-3% muestran que, en los datos del ejemplo, la parte propia de cada una es muy pequeña. Podríamos calcular, entonces, puntuaciones para los alumnos en las dos materias generales. La puntuaciones que se muestran están escalasdas para que tengan media cero y varianza 1, y se han calculado con las variables escaladas de la misma forma. Alumno 1 2 3 4 5 6 7 8 Matem. ,95 1,34 -1,34 ,95 ,19 -,57 -,57 -,95 C. Nat. ,81 1,32 -,69 1,32 -,19 -,69 -,69 -1,19 Francés -,14 1,39 1,00 ,62 -1,29 -,53 ,24 -1,29 Latín ,19 1,69 ,69 ,69 -,81 -,81 -,31 -1,32 Ciencias 1,11 ,80 -1,73 1,09 ,59 -,43 -,80 -,63 Letras -,46 1,20 1,68 ,20 -1,30 -,52 ,25 -1,04 Las puntuaciones sobre los ejes factoriales nos permiten la representación de los individuos en dos dimensiones para estudiar las similitudes entre ellos con respecto a los dos factores considerados. Búsqueda de la Matriz Factorial: Métodos de extracción de factores. LA MATRIZ DE CORRELACIONES REDUCIDA A partir de la expresión matricial de del modelo factorial X = AF + DU X = (X 1 ,K, X p ) ′ ; F = (F1 ,K, Fq ); U = (U 1 ,K, U p )′ A = (a ij ); D = diag(di ) podemos expresar la matriz de correlaciones entre las variables observadas como R = AA ′ + D 2 La diagonal de R* = AA ′ contiene la comunalidades y las correlaciones entre 2 las variables observadas fuera de la diagonal y D es una matriz diagonal que contiene las unicidades. A la matriz AA ′ , es decir, la matriz de correlaciones en la que los unos de la diagonal se sustituyen por las comunalidades se la denomina “matriz de correlaciones reducida”. El problema factorial se reduce, pues, a descomponer una matriz de correlaciones en otra factorial A de forma que el producto de ella por su traspuesta reproduzca la matriz de correlaciones reducida. Si la matriz de correlaciones fuera conocida a priori, la solución sería sencilla, basata con calcular los valores y vectores propios de la misma. R* = VΛV' y tomar A = VΛ1/2 ' El problema consiste en que las comunalidades dependen de las saturaciones y éstas solo son conocidas después de la estimación. METODO DE LAS COMPONENTES PRINCIPALES Método de estimación de la matriz factorial a partir del modelo que considera sólo los factores comunes y prescinde de los factores únicos. Calcula los valores y vectores propios directamente de la matriz de correlaciones de las variables originales sin utilizar las comunalidades en la diagonal. El método de las componentes principales fue estudiado como técnica descriptiva (geométrica) para la reducción de la dimensión y puede considerarse tambien como una solución para el problema factorial. METODO DEL FACTOR PRINCIPAL (ITERATIVO) Básicamente consiste en la diagonalización de la matriz de correlaciones reducida utilizando distintas formas para estimar la comunalidad a priori y siguiendo un proceso iterativo en el que en cada paso se reestiman las comunalidades. El proceso sería: Paso 1: Calcular la matriz de correlaciones y sustituir la diagonal por un estimador de la comunalidad Paso 2: Diagonalizar la matriz de correlaciones educida obtenida en el paso 1 para obtener la matriz factorial Paso 3: Recalcular las comunalidades a partir de la matriz factorial. Paso 4: Comparar as comunalidades antes y despueés de la diagonalización. Si la diferencia es lo suficientemente pequeña, terminar el proceso y sino, volver al paso 1 con las nuevas comunalidades calculadas. Las estimaciones de la comunalidad habitualmente utilizadas en la primera iteración son las siguientes: • SMC: (Square Múltiple Correlation) Las comunalidades se estiman a partir del cuadrado del coeficiente de correlación múltiple de la variable con todas las demás. • OFF-DIAGONAL: utiliza el coeficiente de correlación más grande de cada variable con todas las demás. • 1 : utiliza el valor uno como estimación inicial para las comunalidades. ¿CUÁNTOS EJES DEBEMOS RETENER? • VALORES PROPIOS MAYORES QUE UNO El número de factores estará determinado por el número de valores propios mayores que uno. • REGLA DEL 75% DE LA VARIANZA El número de factores esta determinado por la absorción de inercia. Se tomarán tantos valores propios como sean necesarios para conseguir un 75% de inercia absorbida. • REGLA DEL CODO (CATTELL (1966) ;CATTELL & JESPERS (1967)). SCREE PLOT El procedimiento del scree plot de Cattell consiste en representar gráficamente los valores propios en orden descendente y dibujar una recta a través de las componentes con los valores propios más bajos. Se retienen las componentes que se corresponden con los autovalores que quedan por encima de la línea. • ESPECIFICACION DEL USUARIO Es posible especificar personalmente el número de factores. Usualmente no será mayor que el número de variables dividido por dos. En el caso en que se sobrestime éste valor, el nº será ajustado por el ordenador. INTERPRETACIÓN DE LOS EJES FACTORIALES. Se analizan las saturaciones (en valor absoluto). Aquellas variables que presentan altas saturaciones son las que tiene mayor importancia en la interpretación del eje. Las más interesantes suelen ser las que presentan altas saturaciones para ese eje y bajas para los demás. Las saturacionas se suelen colocar sobre un diagrama que permite la interpretación factorial de las mismas. ROTACIÓN Los ejes factoriales se rotan para mejorar la interpretabilidad, de forma que aumenten unas saturaciones y disminuyan otras. Se mantiene la solución general paro cambian los factores individuales para que sean más interpretables. Hay dos tipos de rotaciones: • ORTOGONALES: Los nuevos factores siguen siendo incorrelados (ortogonales). ROTACIÓN VARIMAX (KAISER, 1958) Transforma la matriz factorial hasta conseguir la solución que verifique que la suma de las simplicidades de los factores sea máxima. Simplicidad = varianza de los cuadrados de las saturaciones Rota los factores forzando a que unas saturaciones se aproximen más a uno y las otras a cero, para facilitar así su interpretación. ROTACIÓN QUARTIMAX (CARROL, 1953) Halla la matriz factorial transformada de modo que la curtosis de los cuadrados de las saturaciones sea máxima. La mayor parte de la varianza es absorbida por el primer factor. Generalmente los otros ejes no tienen una estructura sencilla. • OBLICUOS: No se respeta la ortogonalidad. ROTACION EQUAMAX (SAUNDER, 1962) La varianza se reparte por igual entre todos los factores. LA ESTRUCTURA SIMPLE NECESIDAD DE LA ROTACION El rpincipal objeto del Análisis Factorial es el de sugerir y comprobar hipótesis científicas El problema consiste en comparar los factores hallados con los factores previstos Una misma matriz de correlaciones piede ser factorizada de infinitas formas Si R = AA ′ es una factorización válida, tambien lo es R = AT ′ TA ′ con T ′T = I donde T es una matriz ortogonal que define una rotación del espacio. La solución obtenida del procedimiento de factorización responde sólo a un criterio matemático pero es arbitraria desde el punto de vista aplicado. El problema es ¿Cuál es la posición de los ejes que tiene un mayor interés científico? ¿Hay alguna posición que pueda considerarse como especialmente relevante? ¿Cómo giramos los ejes a esa posición? EL PRINCIPIO DE LA ESTRUCTURA SIMPLE a) La configuración simple Podemos ver la estructura factorial (la matriz factorial) como puntos en un espacio multidimensional con dimensión igual al número de factores y en el que cada variable está representada por un vector cuya longitud es igual a la raíz cuadrada de la comunalidad. Eje II V3 V5 V6 Eje I V2 V1 V4 Esperamos que cada una de las variables eté relacionada con unos pocos factores y no relacionada con el resto. Por ejemplo, si la variable está relacionada con un solo factor, será colineal al eje correspondiente en la representación, si etá relacionada con 2, estará en el plano definido por los mismos, etc… Una configuración en la que todos los vectores estén en rectas, planos o hiperplanos de menor dmensión se denomina una configuración simple. Una definición más rigurosa: Se dice que p vectores, en un espacio de q dimensiones, forman una configuración simple cuando todos están comprendidos en q hiperplanos de dimensión q-1. (algunos pueden estar an las intersecciones y en los subespacios de menores dimensiones). b) La estructura simple Una vez obtenida una solución factorial la pregunta es ¿Cuál es la estructura que mejor refleja las características de la configuración? Ó lo que es lo mismo ¿Dónde situamos los ejes de coordenadas para recoger la configuración simple? Los ejes sirven para interpretar un factor y el factor se interpreta a través de las proyecciones , luego el eje debe situarse en la posición más conveniente para la interpretación, tratando de reflejar en lo posible la configuración simple. Llamaremos estructura (factorial) simple a aquella que refleja una configuración simple. c) Propiedades de la estructura simple La estructura simple permite una mayor sencillez en la interpretación de los factores ya que, estos están fuertementemente relacionados con unas variables y escasamente relacionados con el resto. Resumen de las propiedades - Cada una de las columnas de la matriz factorial tiene varios elementos prácticamente nulos. - Cada fila tendrá uno o más ceros. - Para cada par de columnas habrá pocos elementos no nulos en ambas. LA ESTRUCTURA SIMPLE COMO HIPOTESIS DE TRABAJO Generalmente, en la investigación aplicada, la hipótesis de trabajo inicial es que la información que proporcionan un conjunto elevado de variables manifiestas puede resumirse en unos cuantos factores hipotéticos claramente definidos y que contienen información no relacionada, es decir que muestran aspectos independientes (linealmente) del mismo problema. Esto se traduce, desde el punto de vista de lo explicado antes en una estructura simple para el problema. Si partimos de la hipótesis de que en nuestro problema tenemos una estructura simple, y la hipótesis es cierta, podremos girar los ejes hasta la posición que recoge dicha estructura. Incluso en el caso de que en nuestro campo no esté bien desarrollado el problema a estudiar (no tengamos una idea previa de cómo deben ser los factores), podemos guiarnos por el principio de la estructura simple ya que, si ésta existe, probablemente la encontraremos en el análisis. LA ROTACION El método para encontrar la estrucra simple consiste simplemente en rotar el espacio de los factores hasta conseguir la mayor “simplicidad” posible. Supongamos que tenemos la siguiente estructura factorial: Si hubiera una estrucra factorial simple, los vectores estarían en dos rectas, (a y B). No hay estructura simple, tampoco la hay en la mayor parte de las aplicaciones, pero es posible rotar para obtener una estructura mucho más simple que la actual (Eje II) B (Eje II) V5 B V5 V3 V6 V3 V6 V1 (Eje I) V2 V1 V2 V4 A (EJE I) V4 A Ahora se ha conseguido que, al menos algunas de las proyecciones sean cero en algunos de los ejes. Con un ejemplo numérico A 1 2 3 4 5 6 I 0,81 0,78 0,35 0,70 0,45 0,64 T x II 0,00 -0,44 0,61 -0,40 0,78 0,32 I II = A 0,87 -0,50 A* B 0,50 0,87 1 2 3 4 5 6 A 0,7 0,9 0,00 0,81 0,00 0,4 B 0,40 0,01 0,71 0,00 0,90 0,60 La segunda de las soluciones es mucho más clara ya que, se ha conseguido que los coeficientes sean muy altos para algunas de las variables y muy bajos en otras con lo que se mejora la interpretabilidad. En algunos casos la estructura simple no se consigue con una rotación ortogonal, De forma que para obtenerla es necesario tomar ejes relacionados. (Eje II) V5 V3 B V6 (Eje I) V2 V1 V4 A En este caso obtendríamos una roración oblicua por lo que tedríamos que añadir, además la correlación entre los ejes ya que éstos están relacionados. OBTENCION DE LAS PUNTUACIONES DE LOS INDIVIDUOS Las puntuaciones de los individuos en un análisis factorial pueden utilizarse para realizar una reprresentación gráfica de la misma manera que hacíamos en Componentes Principales. Método basado en los autovectores. Cuando la matriz factorial se calcula a partir de un conjunto de vectores propios el cálculo de las puntuaciones es simple ya que se trata de una simple proyección como en las CP Si llamamos F a la matriz de puntuaciones F = Λ−1 A ′ X y para los factores rotados, si las puntuaciones están en G G = T ′F donde T es la matriz de rotación. Método basado en regresiones Queremos poner los factores en función de las variables F = BX de donde obtenemos FX ′( X ′X ) −1 = B B = A' R −1X si los factores son incorrelados. COMPARACION DEL ANALISIS FACTORIAL CON EL ANALISIS DE COMPONENTES PRINCIPALES Análisis Factorial Explica correlaciones Trata de explicar las variables observadas en función de unos cuantos factores hipotéticos Los factores son incorrelados solo dentro del espacio de los factores comunes Los residuales son incorrelados (en teoría) Hay varios procedimientos de estimación. Hay varias soluciones. Añadir un nuevo factor puede cambiar los anteriores Componentes Principales Explica variabilidad Proyecta las observaciones en un espacio de dimensión reducida con pérdida de información mínima Las componentes principales son incorreladas incondicionalmente Los residuales están normalmente correlacionados Un único procedimiento de estimación. La solución es única. Añadir una nueva componente principal no cambia a las anteriores. Algunas soluciones son invariantes La solución cambia con los con respecto a los cambios de cambios de escala escala En algunos modelos es difícil No hay que estimar comunalidades estimar las comunalidades En algunos modelos complejos los Los cálculos son bastante simples. cálculos son problemáticos