Matrices y determinantes. Espacios vectoriales. Sistemas de

Anuncio

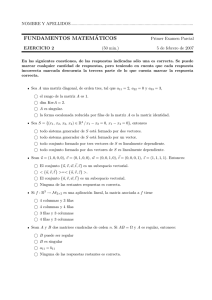

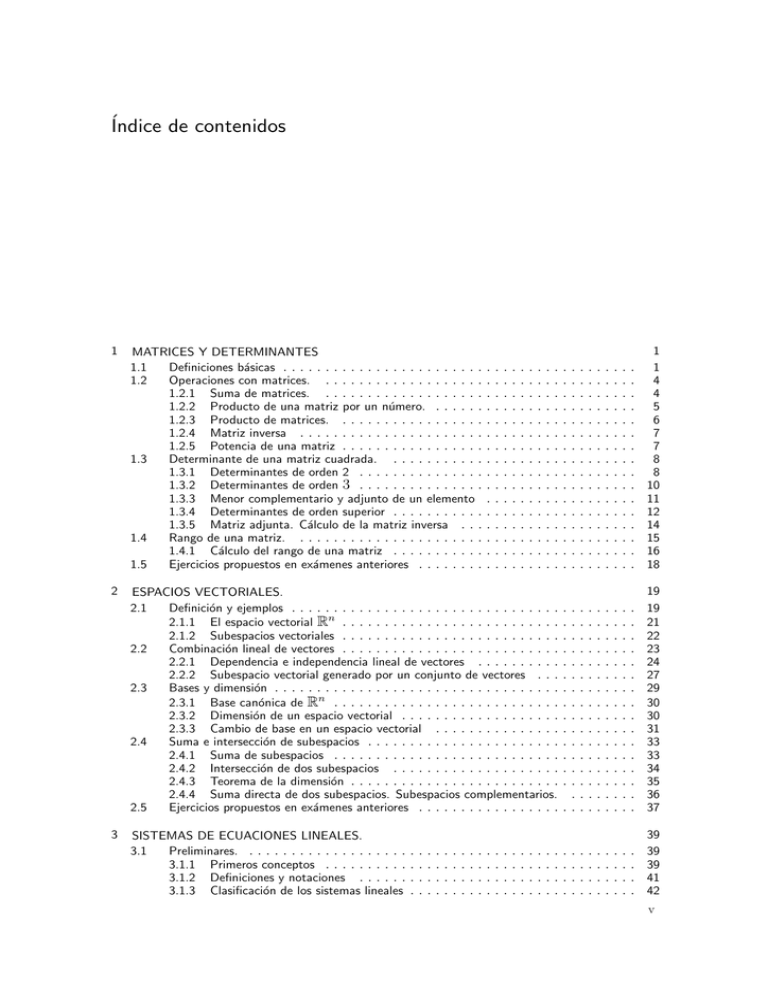

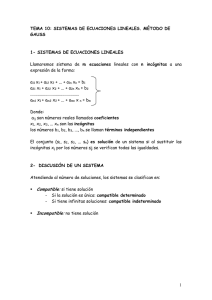

Índice de contenidos

1

2

3

MATRICES Y DETERMINANTES

1.1

Definiciones básicas . . . . . . . . . . . . . . . . . . . . . . . .

1.2

Operaciones con matrices. . . . . . . . . . . . . . . . . . . .

1.2.1 Suma de matrices. . . . . . . . . . . . . . . . . . . .

1.2.2 Producto de una matriz por un número. . . . . . .

1.2.3 Producto de matrices. . . . . . . . . . . . . . . . . .

1.2.4 Matriz inversa . . . . . . . . . . . . . . . . . . . . . .

1.2.5 Potencia de una matriz . . . . . . . . . . . . . . . . .

1.3

Determinante de una matriz cuadrada. . . . . . . . . . . .

1.3.1 Determinantes de orden 2 . . . . . . . . . . . . . . .

1.3.2 Determinantes de orden 3 . . . . . . . . . . . . . . .

1.3.3 Menor complementario y adjunto de un elemento

1.3.4 Determinantes de orden superior . . . . . . . . . . .

1.3.5 Matriz adjunta. Cálculo de la matriz inversa . . .

1.4

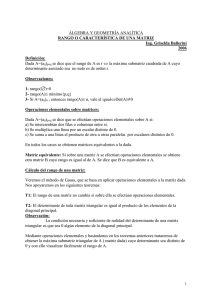

Rango de una matriz. . . . . . . . . . . . . . . . . . . . . . .

1.4.1 Cálculo del rango de una matriz . . . . . . . . . . .

1.5

Ejercicios propuestos en exámenes anteriores . . . . . . . .

..................

..................

..................

..................

..................

..................

..................

..................

..................

..................

..................

..................

..................

..................

..................

..................

.........

.........

.........

.........

.........

.........

.........

.........

.........

.........

.........

.........

.........

.........

........

.........

19

19

21

22

23

24

27

29

30

30

31

33

33

34

35

36

37

...........................

...........................

...........................

...........................

39

39

39

41

42

ESPACIOS VECTORIALES.

2.1

Definición y ejemplos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.1.1 El espacio vectorial Rn . . . . . . . . . . . . . . . . . . . . . . . . . .

2.1.2 Subespacios vectoriales . . . . . . . . . . . . . . . . . . . . . . . . . .

2.2

Combinación lineal de vectores . . . . . . . . . . . . . . . . . . . . . . . . . .

2.2.1 Dependencia e independencia lineal de vectores . . . . . . . . . .

2.2.2 Subespacio vectorial generado por un conjunto de vectores . . .

2.3

Bases y dimensión . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.3.1 Base canónica de Rn . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.3.2 Dimensión de un espacio vectorial . . . . . . . . . . . . . . . . . . .

2.3.3 Cambio de base en un espacio vectorial . . . . . . . . . . . . . . .

2.4

Suma e intersección de subespacios . . . . . . . . . . . . . . . . . . . . . . .

2.4.1 Suma de subespacios . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.4.2 Intersección de dos subespacios . . . . . . . . . . . . . . . . . . . .

2.4.3 Teorema de la dimensión . . . . . . . . . . . . . . . . . . . . . . . . .

2.4.4 Suma directa de dos subespacios. Subespacios complementarios.

2.5

Ejercicios propuestos en exámenes anteriores . . . . . . . . . . . . . . . . .

SISTEMAS DE ECUACIONES LINEALES.

3.1

Preliminares. . . . . . . . . . . . . . . . . . . .

3.1.1 Primeros conceptos . . . . . . . . . .

3.1.2 Definiciones y notaciones . . . . . .

3.1.3 Clasificación de los sistemas lineales

1

1

4

4

5

6

7

7

8

8

10

11

12

14

15

16

18

v

vi

3.2

3.3

3.4

3.1.4 Teorema de Rouché-Frobenius. . . . . . . . . . . . . . . . . . . .

Resolución de sistemas . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3.2.1 Sistemas diagonales . . . . . . . . . . . . . . . . . . . . . . . . . .

3.2.2 Sistemas triangulares . . . . . . . . . . . . . . . . . . . . . . . . .

3.2.3 Sistemas equivalentes. Método de resolución de Gauss . . . .

3.2.4 Método de Cramer . . . . . . . . . . . . . . . . . . . . . . . . . .

3.2.5 Método de Gauss-Jordan para el cálculo de la matriz inversa

3.2.6 Sistemas homogéneos. . . . . . . . . . . . . . . . . . . . . . . . .

Resolución de sistemas con Mathematica. . . . . . . . . . . . . . . .

Ejercicios propuestos en exámenes anteriores . . . . . . . . . . . . . . .

...........

...........

...........

...........

...........

...........

...........

...........

...........

...........

43

45

45

45

47

50

52

54

55

57

1

MATRICES Y DETERMINANTES

Este primer capı́tulo está dedicado a introducir los conceptos básicos relativos

a las matrices y determinantes. Aunque tales cuestiones son de un amplio

uso en diferentes sectores no sólo de la economı́a sino de cualquier disciplina

del saber, nosotros inicialmente usaremos dichos conceptos como herramienta

adecuada para la resolución, en el siguiente capı́tulo, de sistemas de ecuaciones lineales. Ası́ la estructura del capı́tulo y los conceptos en él estudiados

persiguen primordialmente dicho objetivo.

1.1

DEFINICIONES BÁSICAS

Llamamos matriz de números reales con m filas y n columnas, o de tipo m × n, a

una lista de números reales ordenados

en la forma:

a11 a12 · · · a1n

a21 a22 · · · a2n

A = (aij )m×n =

..

..

...

...

.

.

am1 am2 · · · amn

donde aij ∈ R, para todo i = 1, . . . , m, j = 1, . . . , n. El elemento aij es el que se

encuentra en la fila i y la columna j. Al conjunto de todas las matrices de orden

m × n se le denota mediante Mm×n . Cuando una matriz es del tipo 1 × n se le llama

matriz fila o vector fila de orden n y una matriz columna o vector columna de orden

m si es del tipo m × 1.

Dos matrices se dicen iguales si tienen igual número de filas y columnas y coinciden

elemento a elemento.

- Ejemplo 1.1

µ

¶

−2 1 0

• La matriz A =

es una matriz de orden 2 × 3.

4 2 4

µ ¶

1

La matriz B =

es una matriz columna de orden 2.

0

1

2

DEFINICIONES BÁSICAS

Dada una matriz A = (aij ), una submatriz de A es cualquier matriz obtenida desde

A suprimiendo filas y/o columnas.

- Ejemplo 1.2

• Dada la matriz A =

Ã

!

1 2 3 4

5 6 7 8 , la matriz

9 0 1 2

µ

¶

6 7 8

B=

0 1 2

es una submatriz de A obtenida suprimiendo

de A. De igual forma, la matriz

Ã

1 2

C= 5 6

9 0

es la submatriz de A obtenida suprimiendo la

la primera fila y la primera columna

!

4

8

2

tercera columna de A.

Una matriz con igual número de filas que de columnas (de tipo n × n) se dice que es

una matriz cuadrada de orden n. Denotaremos mediante Mn al conjunto de matrices

cuadradas de orden n.

Sea A ∈ Mm×n . La matriz transpuesta de A, At ∈ Mn×m , es la matriz que se

obtiene, desde A, cambiando la posición de las filas y columnas, entre sı́.

- Ejemplo 1.3

Ã

!

µ

¶

1 2

1 0 −1

0 3 .

•

es la matriz transpuesta de

2 3 2

−1 2

De forma evidente, se obtiene la propiedad (At )t = A.

La matriz de orden m × n con todos los elementos nulos se llama matriz cero. Se

denotará mediante 0m×n o simplemente por 0.

0 0 0 ... 0

0 0 0 . . . 0

0 0 0 . . . 0 .

0=

. . . .

.. .. .. . . ...

0 0 0 ... 0

Dada A ∈ Mn , la diagonal principal de A es la matriz fila

(a11 , a22 , . . . , ann ).

Es decir, los elementos en negrita en la figura siguiente:

a11 a12 a13 . . . a1n

a21 a22 a23 . . . a2n

a31 a32 a33 . . . a3n .

A=

.

..

.. . .

..

..

.

.

.

.

an1 an2 an3 . . . ann

MATRICES Y DETERMINANTES

3

La traza de A ∈ Mn , tr(A), es la suma de los elementos de la diagonal principal:

n

X

tr(A) = a11 + a22 + · · · + ann =

aii .

i=1

- Ejemplo 1.4

−1 0

3

1

• La traza de la matriz A = 0 0

es

2

0 0 −1

tr(A) = a11 + a22 + a33 = −1 + 0 − 1 = −2.

Una matriz cuadrada A se dice triangular superior (inferior) si todos los elementos

por debajo (encima) de la diagonal principal son nulos y se llamará diagonal si es

tanto triangular superior como triangular inferior (esto es, todo elemento fuera de la

diagonal es cero). En muchas ocasiones, para simplificar la notación, designaremos

por diag(a1 , a2 , · · · , an ) a la matriz diagonal

a1 0 0 · · · 0

0 a2 0 · · · 0

diag(a1 , a2 , · · · , an ) =

... ... ... . . . ... .

0 0 0 · · · an

- Ejemplo 1.5

• Las matrices

−1 0

3

1

0 0

,

2

0 0 −1

1

1

1

1

0

1

1

1

0

0

1

1

0

0

0

1

µ

y

1 0

0 1

¶

son, respectivamente, triangular superior, triangular inferior y diagonal.

Llamamos matriz identidad de orden n y la denotaremos por In ó simplemente por

I, a la matriz diagonal de orden n con todos los elementos de la diagonal principal

iguales a 1.

1 0 ... 0

0 1 . . . 0

n)

In = diag(1, 1, · · ·, 1) =

... ... . . . ... .

0 0 ... 1

4

OPERACIONES CON MATRICES.

1.2

OPERACIONES CON MATRICES.

1.2.1

Suma de matrices.

No siempre es posible sumar dos matrices, para ello será necesario que ambas sean

del mismo tipo. Dadas dos matrices A = (aij ), B = (bij ) ∈ Mm×n la matriz suma

de A y B es una matriz (del mismo tipo a las anteriores), A + B = C ∈ Mm×n ,

cuyos elementos se obtienen sumando término término a término los elementos de

A y de B, es decir, cij = aij + bij , i = 1, 2, · · · , m, j = 1, 2, · · · , n.

a11 a12

a21 a22

A+B =

..

...

.

am1 am2

a11 + b11

a21 + b21

=

..

.

am1 + bm1

. . . a1n

b11 b12 . . . b1n

. . . a2n b21 b22 . . . b2n

+ .

..

.. . .

..

..

.

.

. ..

.

.

. . . amn

bm1 bm2 . . . bmn

a12 + b12 . . . a1n + b1n

a22 + b22 . . . a2n + b2n

.

..

..

..

.

.

.

am2 + bm2 . . . amn + bmn

- Ejemplo 1.6

µ

• Si A =

1 2

3 4

¶

µ

yB=

¶

−2

0

, entonces

1 −4

µ

A+B =

1 2

3 4

¶

µ

+

−2

0

1 −4

¶

µ

=

−1 2

4 0

¶

.

Como primeras propiedades de la suma de matrices obtenemos las siguientes:

+ Resultado 1.2.1 Sean A, B, C ∈ Mm×n y 0 ∈ Mm×n la matriz cero. Entonces se verifica:

• (Conmutativa) A + B = B + A.

• (Asociativa) A + (B + C) = (A + B) + C.

• (Elemento neutro) A + 0 = 0 + A = A.

• (Elemento opuesto) Existe una matriz A ∈ Mm×n , que llamaremos matriz

opuesta de A, tal que A + A = 0.

• (A + B)t = At + B t .

Resulta inmediato comprobar que la matriz A se obtiene cambiando de signo todos

los elementos de la matriz A, es decir, aij = −aij , i = 1, 2, · · · , n, j = 1, 2, · · · , m.

En lo sucesivo denotaremos a esta matriz por −A.

MATRICES Y DETERMINANTES

1.2.2

5

Producto de una matriz por un número.

Sea A ∈ Mm×n y λ ∈ R, definimos la matriz producto de

mediante λ · A ∈ Mm×n como:

λ a11 λ a12

a11 a12 . . . a1n

a21 a22 . . . a2n λ a21 λ a22

= .

λ·

..

..

..

..

...

.

.

.

. ..

λ am1 λ am2

am1 am2 . . . amn

λ por A, y la denotamos

. . . λ a1n

. . . λ a2n

.

..

..

.

.

. . . λ amn

Con esta definición resulta que la matriz opuesta de A es precisamente la matriz

(−1) · A, es decir, −A = (−1) · A.

- Ejemplo 1.7

µ

4·

1 −1 2 0

2

3 0 0

¶

µ

=

4 −4 8 0

8 12 0 0

¶

.

+ Resultado 1.2.2 Sean λ, µ ∈ R y A, B ∈ Mm×n . Entonces se cumplen las

siguientes propiedades:

• (Distributiva respecto a la suma de matrices) λ · (A + B) = λ · A + λ · B,

• (Distributiva respecto a la suma de escalares) (λ + µ) · A = λ · A + µ · A,

• (Elemento unidad) 1 · A = A,

• (Pseudoasociativa) (λ µ) · A = λ · (µ · A),

• λ · 0 = 0, 0 · A = 0,

• (λ · A)t = λ · At ,

Una matriz cuadrada A se dice simétrica si coincide con su transpuesta, esto es,

A = At . Esto, a su vez, se traduce en la relación entre coeficientes siguiente: aij =

aj i , para cualesquiera i, j = 1, . . . , n.

La matriz cuadrada A se dirá antisimétrica si, cumple que At = −A. Esto es, si

aij = −aji , para cualesquiera i, j = 1, . . . , n. Es fácil deducir, empleando la relación

entre coeficientes anterior para el caso i = j, que los elementos de la diagonal

principal de matrices antisimétricas son todos nulos.

- Ejemplo 1.8

Ã

•

1 2 −1

2 4

0

−1 0

6

!

Ã

es una matriz simétrica y

0

2 −1

−2

0

3

1 −3

0

!

es antisimétrica.

Toda matriz cuadrada se puede expresar como suma de una matriz simétrica y otra

antisimétrica. Más concretamente, dada la matriz A ∈ Mn se puede escribir como

A = B + C,

donde B es la matriz simétrica B = 12 (A + At ) y C es la matriz antisimétrica

C = 21 (A − At ).

6

OPERACIONES CON MATRICES.

- Ejemplo 1.9

Ã

• Dada la matriz A =

1

4 −2

0

4

3

0 −3

6

Ã

!

1

2

−1

Ã

0

1

C = (A − At ) = −2

2

1

1

B = (A + At ) =

2

1.2.3

, entonces A = B + C, donde

!

2 −1

4

0

es una matriz simétrica y

0

6

!

2 −1

0

3

es antisimétrica.

−3

0

Producto de matrices.

Al igual que ocurrı́a con la suma, no siempre será posible multiplicar dos matrices

entre sı́. De hecho, sólo existirá la multiplicación cuando exista una cierta compatibilidad entre el número de filas y columnas de ambas. Más concretamente, dadas

las matrices A ∈ Mm×n y B ∈ Mn×p se define la matriz producto de A y B, y

la notaremos por A · B, como una matriz C = A · B ∈ Mn×p cuyos elementos se

obtienen en la forma

n

X

cij =

air brj ,

i = 1, . . . , m, j = 1, . . . , p.

r=1

Es decir, el elemento de la matriz A · B en la posición (i, j) se obtiene sumando los

productos término a término de los elementos de la fila i de A y la columna j de B.

- Ejemplo 1.10

−1

1

µ

¶

3

2 −1 0

2

·

=

0 −2

1 −1 1 2×3

2

0 4×2

−1 · (−1) + 1 · (−1) −1 · 0 + 1 · 1

−1

0

1

2 · (−1) + 3 · (−1)

2 · 0 + 3 · 1 7 −5

3

=

0 · (−1) − 2 · (−1)

0 · 0 − 2 · 1 −2

2 −2

2 · (−1) + 0 · (−1)

2·0+0·1

4 −2

0 4×3

−1 · 2 + 1 · 1

2·2+3·1

0·2−2·1

2·2+0·1

+ Propiedad 1.2.1 Propiedades del producto de matrices

• (A · B) · C = A · (B · C), para A ∈ Mm×n , B ∈ Mn×p y C ∈ Mp×q .

• (A + B) · C = A · C + B · C, para A, B ∈ Mm×n y C ∈ Mm×p .

• A · (B + C) = A · B + A · C, para A ∈ Mm×n y B, C ∈ Mm×n .

• I · A = A · I = A, 0 · A = A · 0 = 0, donde las matrices I y 0 han sido

convenientemente elegidas, para que tengan sentido las operaciones, y A ∈

Mn×m .

• (A · B)t = B t · At , para A ∈ Mm×n y B ∈ Mn×p .

MATRICES Y DETERMINANTES

7

Una observación interesante es que, en general, el producto de matrices, aún cuando

esté definido en ambos sentidos, no siempre es conmutativo. Es decir, dadas matrices

A ∈ Mm×n y B ∈ Mn×m , A · B no tiene porqué coincidir con B · A. (De hecho,

A · B ∈ Mm y B · A ∈ Mn ; la propiedad conmutativa tampoco es cierta, en general,

para el caso m = n).

1.2.4

Matriz inversa

Una matriz B ∈ Mn se dice inversa de otra A ∈ Mn si satisfacen las igualdades

A · B = B · A = I.

En tal caso, a la matriz B se le denotará mediante A−1 y, como es lógico, también

A es inversa de B, (es decir, A = B −1 y A = (A−1 )−1 ).

Además, la matriz inversa de A, en caso de existir, es siempre única. Una matriz

A ∈ Mn que posee inversa se le llama matriz regular. En caso contrario, se dice que

A es singular.

- Ejemplo 1.11

µ

• La matriz

1.2.5

¶

µ

¶

1 1

0

1

es inversa de

, pues

1 0

1 −1

µ

¶µ

¶ µ

¶µ

¶ µ

¶

1 1

0

1

0

1

1 0

1 0

=

=

1 0

1 −1

1 −1

0 1

0 1

Potencia de una matriz

Dada una matriz cuadrada A y número natural k ∈ N0 , donde N0 = N∪0, definimos

la potencia k-ésima de A, de forma inductiva como

½

I

si k = 0

k

A =

Ak−1 · A si k > 0

Las potencias de matrices, como productos matriciales que son, se rigen por las

mismas propiedades del producto de matrices; sin embargo, destacamos dos nuevas

propiedades de particular interés.

+ Resultado 1.2.3 Propiedades de las potencias de una matriz:

• Dada A ∈ Mn y k, l ∈ N0 ,

Ak · Al = Al · Ak = Ak+l ,

(Ak )l = Akl .

• Si A ∈ Mn es una matriz diagonal, esto es,

A = diag(a1 , a2 , · · · , an )

y k ∈ N0 , entonces Ak es también una matriz diagonal, siendo

¡

¢

Ak = diag ak1 , ak2 , · · · , akn .

8

1.3

1.3.1

DETERMINANTE DE UNA MATRIZ CUADRADA.

DETERMINANTE DE UNA MATRIZ CUADRADA.

Determinantes de orden 2

Supongamos que queremos resolver un sistema lineal de dos ecuaciones con dos

incógnitas

½

a11 x1 + a22 x2 = c1

(1.3.1)

S≡

a21 x1 + a22 x2 = c2

Usando el producto matricial y la igualdad de matrices, el sistema anterior puede

escribirse matricialmente enµla forma ¶ µ ¶ µ ¶

a11 a12

x1

c1

=

.

a21 a22

x2

c2

µ

¶

a11 a12

se denomina matriz de coeficientes del sistema.

La matriz A =

a21 a22

Para resolver el sistema (1.3.1) aplicamos el método de reducción: (multiplicamos

la primera ecuación por a22 y la segunda ecuación por −a12 )

½

½

a22 (a11 x1 + a22 x2 ) = c1 a22

a11 a22 x1 + a12 a22 x2 = c1 a22

⇒

−a12 (a21 x1 + a22 x2 ) = −c2 a12

−a21 a12 x1 − a22 a12 x2 = −c2 a12

Sumando ambas ecuaciones se obtiene:

(a11 a22 − a21 a12 )x1 = c1 a22 − c2 a12 .

c1 a22 − c1 a21

Si a11 a22 − a21 a12 6= 0, entonces x1 =

.

a11 a22 − a21 a12

c2 a11 − c1 a21

Procediendo de forma análoga se llegarı́a a que x2 =

.

a11 a22 − a21 a12

El número a11 a22 − a12 a21 se denomina determinante de la matriz A y se denota

por

¯

¯

µ

¶

¯ a11 a12 ¯

a11 a12

¯ = a11 a22 − a12 a21 .

det(A) = det

= |A| = ¯¯

a21 a22

a21 a22 ¯

Utilizando la definición de determinante podemos enunciar el siguiente resultado

conocido como regla de Cramer para sistemas de orden 2 × 2.

+ Resultado 1.3.1 (Regla de Cramer para sistemas de orden 2 × 2)

Si el determinante de la matriz de coeficientes del sistema (1.3.1) es distinto de

cero, entonces las solución de (1.3.1) viene dada por

¯

¯

¯

¯

¯ a11 c1 ¯

¯ c1 a12 ¯

¯

¯

¯

¯

¯ a21 c2 ¯

¯ c2 a22 ¯

¯ , x2 = ¯

¯

x1 = ¯¯

¯

¯ a11 a12 ¯ .

¯

¯ a11 a12 ¯

¯

¯ a21 a22 ¯

¯ a21 a22 ¯

1.3.1.1 Propiedades de los determinantes de orden 2. Enunciamos a continuación algunas de las propiedades de los determinantes de orden 2 cuya comprobación resulta inmediata. Dichas propiedades se generalizarán posteriormente a

determinantes de orden superior.

MATRICES Y DETERMINANTES

9

+ Resultado 1.3.2

a) El determinante de una matriz coincide con el de su transpuesta

¯

¯ ¯

¯

¯ a11 a12 ¯ ¯ a11 a21 ¯

¯

¯=¯

¯

¯ a21 a22 ¯ ¯ a12 a22 ¯ .

(Esta propiedad nos permite que todos los resultados que enunciamos a continuación

para las filas de una matriz sean también válidos para las columnas).

b) Si una matriz tiene una fila (columna) de ceros, su determinante es cero.

c) Si intercambiamos dos filas (columnas) de una matriz, el determinante cambia

de signo.

d) Si una matriz tiene sus dos filas (columnas) iguales su determinante es cero.

e) Si multiplicamos cada elemento de una fila (columna) por un número, el determinante queda multiplicado por ese número,

¯

¯

¯

¯

¯ λa11 a12 ¯

¯ a11 a12 ¯

¯

¯

¯

¯

¯ λa21 a22 ¯ = λ ¯ a21 a22 ¯ .

f) Si una matriz tiene dos filas (columnas) proporcionales, el determinante vale

cero.

g) Si los elementos de una fila (columna) de una matriz vienen expresados como

suma de dos elementos, entonces el determinante se descompone en suma de

dos determinantes del siguiente modo

¯

¯ ¯

¯ ¯

¯

¯ a11 + a0 a12 ¯ ¯ a11 a12 ¯ ¯ a0 a12 ¯

11

11

¯

¯

¯

¯

¯

¯

¯ a21 + a021 a22 ¯ = ¯ a21 a22 ¯ + ¯ a021 a22 ¯ .

h) Si a una fila (columna) le sumamos la otra fila (columna) multiplicada por un

número, el determinante no cambia.

¯

¯ ¯

¯

¯ a11 + λa12 a12 ¯ ¯ a11 a12 ¯

¯

¯=¯

¯

¯ a21 + λa22 a22 ¯ ¯ a21 a22 ¯ .

1.3.1.2 Una interpretación geométrica del determinante. En el siguiente paralelogramo se representa gráficamente la suma de los vectores (x1 , y1 ) y (x2 , y2 ).

(x2 , y2 )

(x1 , y1 )

Para calcular el área comprobamos que

10

DETERMINANTE DE UNA MATRIZ CUADRADA.

A

Área del paralelogramo

= Área del rectángulo − Área de A

− Área de B − · · · − Área de F

= (x1 + x2 )(y1 + y2 ) − x2 y1 − x1 y1 /2

− x2 y2 /2 − x2 y2 /2 − x1 y1 /2 − x2 y1

= x1 y 2 − x2 y 1

B

y2

D

y1 C

E

x2

F

x1

Ası́, es fácil concluir que el área del paralelogramo coincide con el valor del determinante siguiente

¯

¯

¯x1 x2 ¯

¯

¯

¯ y1 y2 ¯ = x1 y2 − x2 y1 .

1.3.2

Determinantes de orden 3

Los determinantes de orden 3 surgen de forma análoga al considerar un sistema

lineal de 3 ecuaciones y 3 incógnitas

(

Ã

!Ã ! Ã !

a11 x1 + a12 x2 + a13 x3 = c1

a11 a12 a13

x1

c1

x2 = c2 .

S ≡ a21 x1 + a22 x2 + a23 x3 = c2 ⇔ a21 a22 a23

a31 x1 + a32 x2 + a33 x3 = c3

a31 a32 a23

x3

c3

Mediante un proceso de reducción (un poco más engorroso) se llega a expresiones

del tipo

∆1

∆2

∆3

x1 =

, x2 =

,

x3 =

,

∆

∆

∆

supuesto que ∆ 6= 0, donde

∆ = a11 a22 a33 + a21 a32 a13 + a31 a12 a23 − a31 a22 a23 − a21 a12 a33 − a11 a32 a23 . (1.3.2)

Ã

!

a11 a12 a13

El valor de ∆ se llama determinante de la matriz A = a21 a22 a23 y se denota

a31 a32 a23

por

¯

¯

Ã

!

¯ a11 a12 a13 ¯

a11 a12 a13

¯

¯

det(A) = det a21 a22 a23 = |A| = ¯ a21 a22 a23 ¯ .

¯

a

a

a

a

a

a ¯

31

32

23

31

32

23

Para recordar la fórmula (1.3.2) se recurre a la regla de Sarrus. Para ello se repiten

las dos primeras filas del determinante. Las diagonales trazadas desde a11 , a21 y a31

corresponden a los sumandos positivos y las diagonales trazadas desde a13 , a23 y a33

a los sumandos negativos.

a11 a12 a13 −

+ a11 a12 a13

&

.

+ a21 a22 a23

a21 a22 a23 −

& &

. .

+ a31 a32 a33

a31 a32 a33 −

& &

. .

a11 a12 a13

a11 a12 a13

&

.

a21 a22 a23

a21 a22 a23

MATRICES Y DETERMINANTES

11

- Ejemplo 1.12

¯

¯

¯ 1 −1 0 ¯

¯

¯

2 0 ¯ = 1 · 2 · 1 − 1 · 0 · 3 − 2 · 2 · 0 − 2 · 3 · 0 + 1 · 2 · 1 + 1 · 2 · 0 = 4.

¯2

¯ 3 −2 1 ¯

1.3.2.1 Propiedades de los determinantes de orden 3. Las propiedades de los

determinantes de orden 3 son análogas a las de los determinantes de orden 2. De

hecho las propiedades a)-g) que figuran en la Proposición 1.3.2 se enuncian exactamente igual para determinantes de orden 3. Por otra parte, la propiedad h) admite

una formulación más general.

+ Resultado 1.3.3

h) Si a una fila (columna) le sumamos una combinación lineal de las restantes

filas (columnas), el determinante no varı́a.

i) Si una fila (columna) es combinación lineal de las restantes filas (columnas),

el determinante es cero.

La propiedad h) es especialmente interesante porque nos permite efectuar transformaciones en las filas y columnas de una matriz A sin que se altere el valor de su

determinante. De hecho esté será el procedimiento que seguiremos para el cálculo

de determinantes de orden superior.

1.3.3

Menor complementario y adjunto de un elemento

Consideremos la matriz

Ã

A=

a11 a12 a13

a21 a22 a23

a31 a32 a23

!

.

Se llama menor complementario del elemento aij , y lo representamos por αij , al

determinante de la submatriz de orden 2 × 2 obtenida al suprimir la fila i y la

columna j de la matriz A, es decir, al suprimir la fila y la columna en la que se

encuentra dicho elemento. Por ejemplo:

¯

¯

¯

¯

¯

¯

¯ a11 a13 ¯

¯ a11 a12 ¯

¯ a22 a23 ¯

¯

¯

¯

¯ , α23 = ¯

α11 = ¯¯

¯ a31 a32 ¯ , a22 = ¯ a31 a33 ¯ .

a32 a33 ¯

Se llama adjunto del elemento aij , y lo denotaremos por Aij , al número

Aij = (−1)i+j αij ,

es decir, el adjunto del elemento aij tiene el mismo valor que el menor complementario αij anteponiendo el signo + o − según que la suma de los ı́ndices i, j sea par

o impar. Por ejemplo:

¯

¯

¯

¯

¯ a11 a12 ¯

¯ a22 a23 ¯

2+3

1+1

¯.

¯

¯

¯

,

A23 = (−1) α23 = − ¯

A11 = (−1) α11 = ¯

a31 a32 ¯

a32 a33 ¯

12

DETERMINANTE DE UNA MATRIZ CUADRADA.

+ Resultado 1.3.4 El determinante de la matriz A se puede obtener como la

suma de los elementos de una fila o columna multiplicados por sus adjuntos correspondientes

Comprobemos que se cumple esta propiedad. En efecto,

|A| = a11 a22 a33 + a21 a32 a13 + a31 a12 a23 − a31 a22 a23 − a21 a12 a33 − a11 a32 a23

= a11 (a22 a33 − a32 a23 ) − a12 (a21 a33 − a31 a23 ) + a13 (a21 a32 − a31 a22 )

¯

¯

¯

¯

¯

¯

¯ a21 a22 ¯

¯ a21 a23 ¯

¯ a22 a23 ¯

¯

¯

¯

¯ − a12 ¯

= a11 ¯¯

¯ a31 a33 ¯ + a13 ¯ a31 a32 ¯

a32 a33 ¯

= a11 A11 + a12 A12 + a13 A13 .

(1.3.3)

En la expresión (1.3.3) se dice que el determinante se obtiene desarrollando los

elementos de la primera fila por sus adjuntos correspondientes. De igual forma puede

comprobarse fácilmente que se obtiene el mismo resultado desarrollando por los

elementos de cualquier fila o columna.

1.3.3.1 Interpretación geométrica de un determinante de orden 3. También

puede darse una interpretación geométrica para determinantes de orden 3. En este

caso, el volumen del paralelepı́pedo determinado por los vectores

(x1 , y1 , z1 ),

(x2 , y2 , z2 ) y (x3 , y3 , z3 )

coincide (salvo el signo) con el valor del determinante de la matriz cuyas filas o

columnas vienen dadas por las coordenadas de los vectores.

- Ejemplo 1.13

• El volumen de la siguiente figura puede calcularse mediante el determinante

(−1, 0, 1)

(2, 0, 2)

¯

¯

¯2 0 −1¯

¯

¯

¯0 3 0 ¯ = 12

¯2 1 1 ¯

(0, 3, 1)

1.3.4

Determinantes de orden superior

La generalización de la definición de adjunto a matrices de orden n y la Proposición

1.3.4 nos permitirán calcular, de forma inductiva, el determinante de una matriz

cuadrada de orden superior a 3. Basta observar que los menores complementarios

de los elementos de una matriz de orden 4 serán determinantes de orden 3 que ya

sabemos calcular. De hecho vamos a definir los determinantes de orden superior

utilizando un desarrollo análogo al dado en la expresión (1.3.3).

MATRICES Y DETERMINANTES

13

Sea A una matriz cuadrada de orden n

a11 a12 . . . a1n

a21 a22 . . . a2n

A=

.. . .

. ,

...

. ..

.

an1 an2 . . . ann

se define el determinante de A, y lo notaremos por cualquiera de las expresiones

siguientes,

¯

¯

¯ a11 a12 . . . a1n ¯

a11 a12 . . . a1n

¯

¯

¯ a21 a22 . . . a2n ¯

a21 a22 . . . a2n

det(A) = det

.. . .

. ¯,

.. . .

. = |A| = ¯¯ ..

...

. .. ¯¯

. ..

.

.

¯ .

¯ an1 an2 . . . ann ¯

an1 an2 . . . ann

al valor obtenido desarrollando los elementos de la primera fila por sus adjuntos

correspondientes, es decir,

n

X

det(A) = a11 A11 + a12 A12 + · · · + a1n A1n =

a1j A1j .

(1.3.4)

j=1

Observaciones:

• El adjunto de un elemento tiene el mismo significado que el dado para matrices

cuadradas de orden 3.

• La definición de determinante dada en (1.3.4) es inductiva, es decir, si sabemos

calcular determinantes de orden 2 sabemos calcular de orden 3 y, por tanto, de

orden 4 y, por tanto, de orden 5, etc.

• Puede probarse que el valor dado en (1.3.4) no varı́a si hacemos el desarrollo

por los elementos de cualquier otra fila o columna.

• De igual forma, puede probarse por inducción, que los determinantes de orden

superior cumplen las mismas propiedades que las enunciadas para determinantes

de orden 2 y 3.

- Ejemplo 1.14

¯

¯ 7

¯

¯ 2

¯ 5

¯

¯ −1

4

0

1

7

¯

¯

¯

¯

¯

¯

¯

¯

¯

1 9¯

¯

¯ 2 6 3¯

¯ 7 1 9¯

¯ 7 1 9¯

¯7 1 9 ¯

6 3¯

¯

¯

¯

¯

¯

¯

¯

¯

= −4 ¯ 5 6 11 ¯ + 0 ¯ 5 6 11 ¯ − 1 ¯ 2 6 3 ¯ + 7 ¯ 2 6 3 ¯ = 1628.

6 11 ¯¯

¯ −1 2 8 ¯

¯ −1 2 8 ¯

¯ −1 2 8 ¯

¯ 5 6 11 ¯

2 8¯

En el ejemplo anterior hemos calculado el determinante haciendo el desarrollo de los

elementos de la segunda columna por sus adjuntos correspondientes. El cálculo del

determinante queda reducido al cálculo de (como máximo) 4 determinantes de orden

3. Observemos que la presencia de un cero en el elemento a22 de la matriz nos ahorra

el cálculo del adjunto correspondiente en el desarrollo. Por tanto, resulta conveniente

utilizar para el desarrollo del determinante aquella fila o columna que tenga mayor

número de ceros. La presencia de un cero nos ahorra cálculos y tiempo. Precisamente

en esto se basa la técnica de cálculo de determinantes de orden superior: “Si no hay

ceros, los hacemos”. Para ello utilizaremos la propiedad h) de los determinantes:

“Si a una fila (columna) le sumamos una combinación lineal de las restantes filas

(columnas), el determinante no varı́a”.

14

DETERMINANTE DE UNA MATRIZ CUADRADA.

- Ejemplo 1.15

¯

¯ 7

¯

¯ 2

¯ 5

¯

¯ −1

4

0

1

7

¯

¯

¯ −13 0 −23 −35 ¯

F1 → F1 − 4F3

¯

¯

F2 → F2

2 0

6

3¯

¯

=¯

=

F3 → F3

5 1

6

11 ¯¯

¯

¯

¯

F4 → F4 − 7F3

−36 0 −40 −69

¯

¯

¯ −13 −23 −35 ¯

¯

¯

6

3 ¯ = 1628.

= −1 ¯ 2

¯ −36 −40 −69 ¯

¯

1 9¯

¯

6 3¯

=

6 11 ¯¯

¯

2 8

desarrollando por

los elementos de la

segunda columna

Otras propiedades interesantes de los determinantes vienen recogidas en la proposición siguiente:

+ Resultado 1.3.5 Sean A, B ∈ Mn , entonces

a) Si A ∈ Mn es una matriz triangular, entonces el determinante de A se obtiene

multiplicando los elementos situados en la diagonal principal, es decir,

|A| = a11 a22 · · · ann .

b) En particular, si A es una matriz diagonal A = diag(a1 , a2 , · · · , an ), entonces

|A| = a1 a2 · · · an .

En particular, |I| = 1.

c) (Fórmula de Binet-Cauchy): |A · B| = |A| · |B|.

d) A es regular si, y sólo si, |A| 6= 0. Además, en tal caso, |A−1 | =

1

.

|A|

e) |Ak | = |A|k , para k ∈ N0 .

1.3.5

Matriz adjunta. Cálculo de la matriz inversa

Dada una matriz A ∈ Mn se define la matriz adjunta de A, y se denota por adj(A),

a la matriz cuyos elementos en la posición (i, j) son los adjuntos Aij de la matriz A.

El cálculo de la matriz adjunta nos proporciona un método para calcular la matriz

inversa, A−1 , de una matriz A regular.

+ Resultado 1.3.6 Sea A ∈ Mn una matriz regular, entonces

¢t

¡ ¢

1 ¡

1

A−1 =

adj(A) =

adj At .

|A|

|A|

- Ejemplo 1.16

• Supongamos que queremos calcular la inversa de la matriz

1 1 1

1

1

−1 0 0

A=

.

1 2 1 −1

3 0 0

1

MATRICES Y DETERMINANTES

15

En primer lugar hemos de probar que A es una matriz regular. Para ello calculamos

su determinante

¯

¯

¯

¯

¯ 1 1 1

¯ 1 1 1

1¯

F1 → F1

1¯

¯

¯

¯

¯

F2 → F2

1¯

1¯

¯ −1 0 0

¯ −1 0 0

|A| = ¯

=

=

¯

¯ 0 1 0 −2 ¯

F3 → F3 − F1

¯ 1 2 1 −1 ¯

¯

¯

¯ 3 0 0

¯ 3 0 0

¯

F4 → F4

1

1¯

¯

¯

¯ −1 0

1¯

¯

¯

= 1 ¯ 0 1 −2 ¯ = −4.

¯ 3 0

1¯

Como el determinante es distinto de cero, la matriz

namos la matriz adjunta, calculando los adjuntos de

la matriz A,

¯

¯

¯

¯0 0

¯ −1

1¯

¯

¯

¯

A11 = ¯ 2 1 −1 ¯ = 0,

A12 = − ¯ 1

¯0 0

¯

¯ 3

1

A es regular. Ahora determicada uno de los elementos de

¯

0

1¯

¯

1 −1 ¯ = 4,

0

1¯

···

La matriz adjunta viene dada por

0

4 −8

0

8 −3

1 −6

.

adj(A) =

0 −4

4

0

−1 −2

4 −1

Finalmente, la matriz inversa será

1

0

0 − 41

4

0

1

0 −1 t

3

1

¢t

1 ¡

1 4 −6 −4 −2

1

−1

2

2 .

=

adj(A) = −

=

−8

8

4

4

|A|

4

2 −2 −1 −1

0

3

0 −1

3

1

0

0

4

4

A−1

También con ayuda del Mathematica podrı́amos haber obtenido dicho inversa

1.4

RANGO DE UNA MATRIZ.

Si en una matriz A ∈ Mm×m seleccionamos r filas y r columnas (r ≤ m, r ≤ n)

se forma una submatriz cuadrada de orden r. Al determinante de esta matriz lo

llamaremos menor de orden r de la matriz A.

El rango de A es el mayor de los ordenes de los menores de A no nulos; es decir, el

mayor orden de las submatrices cuadradas de A con determinante distinto de cero.

De forma evidente, se cumple que si A es una submatriz de B, entonces el rango de

A es siempre menor o igual que el rango de B.

- Ejemplo 1.17

1 −1 1

0 2

0

• La matriz A =

tiene rango 3.

1

2 1

0

0 1

16

RANGO DE UNA MATRIZ.

En efecto, la submatriz cuadrada de orden 3 obtenida a partir de la matriz A seleccionando las 3 primeras filas y las 3 primeras columnas

Ã

!

1 −1 1

0

0 2

1

2 1

tiene determinante no nulo.

Este nuevo concepto nos permite obtener una caracterización de las matrices regulares en función de él.

+ Resultado 1.4.1 Una matriz cuadrada A ∈ Mn es regular si, y sólo si, su

rango es n.

Como es lógico, desde esta proposición también se concluye una caracterización de

la singularidad de una matriz cuadrada: A ∈ Mn es singular si, y sólo si, su rango

es estrictamente menor que n.

1.4.1

Cálculo del rango de una matriz

Para la determinación del rango de una matriz resulta conveniente tener en cuenta

las siguientes observaciones:

• De la definición inductiva de los determinantes se deduce inmediatamente que

si todos los memores de orden r de una matriz A son nulos, entonces también

serán nulos todos los menores de orden mayor que r que pudieran formarse en la

matriz A. Esto nos sugiere una estrategia para calcular el rango de una matriz:

seleccionar menores no nulos comenzando por menores de orden 1, 2, etc.

• Como sabemos, la operación de sumar a una fila (columna) una combinación

lineal de las restantes filas (columnas) no afecta al valor del determinante de

una matriz y, por tanto, dicha operación tampoco afectará al rango de la matriz.

De igual modo las operaciones de permutación de filas o columnas (que sólo

afectan al signo del determinante) y la de multiplicación de los elementos de

una fila o columna por un número distinto de cero (que sólo afecta al valor del

determinante pero no al hecho de que éste sea o no distinto de cero), tampoco

alterará el valor del rango de la matriz.

Estas operaciones se llamarán operaciones elementales y constituyen una buena

herramienta para simplificar el cálculo del rango de una matriz.

• Por otra parte, también sabemos que si una matriz cuadrada tiene una fila

(columna) que es combinación lineal de las restantes filas (columnas), el determinante vale cero. Esto se traduce en la siguiente propiedad: si una matriz tiene

una fila (columna) que es combinación lineal de las restantes filas (columnas),

dicha fila (columna) puede suprimirse dado que no afectará al rango de la matriz.

Las observaciones anteriores nos sugieren el siguiente procedimiento para calcular el

rango de una matriz:

MATRICES Y DETERMINANTES

17

1) Comprobar si hay alguna fila (columna) que sea combinación lineal de las

restantes filas (columnas). En tal caso, ésta se suprime.

2) Seleccionar un menor de orden 2 que sea distinto de cero y marcarlo sobre la

matriz. Si esto no es posible, el rango serı́a 1 (salvo en el caso trivial de que

todos los elementos de la matriz sean cero en que el rango serı́a 0).

3) Formar posibles menores de orden 3 que contengan al menor de orden 2 seleccionado anteriormente (este proceso se llama orlar filas o columnas). Si todos

estos menores son cero, el rango serı́a 2; en caso contrario tomarı́amos el menor

de orden 3 y continuamos estudiando los de orden 4, etc.

- Ejemplo 1.18

• Para calcular el rango de la matriz

−1

3

0

1 2

5

1

2 3

0

,

A=

−3 −1 −2 −1 0

3 11

4

5 6

procedemos de la siguiente manera:

1) Comprobamos si hay alguna fila (columna) que sea combinación lineal de las

restantes filas (columnas). Aparentemente no.

2) Buscamos un menor de orden 2 que sea distinto de cero y lo señalamos en la

matriz. En nuestro caso, el menor obtenido tomando las dos primeras filas y las

dos primeras columnas satisface esta condición,

¯

¯

¯ −1 3 ¯

¯

¯

¯ 0 5 ¯ = −5 6= 0.

3) Orlamos la 3a fila y formamos menores de orden 3 con

¯

¯

¯

¯

¯ −1

¯ −1

3

0¯

3

1¯

¯

¯

¯

¯

5

1 ¯ = 0,

5

2 ¯ = 0,

¯ 0

¯ 0

¯ −3 −1 −2 ¯

¯ −3 −1 −1 ¯

las columnas 3a , 4a y 5a .

¯

¯

¯ −1

3 2¯

¯

¯

5 3 ¯ = 0.

¯ 0

¯ −3 −1 0 ¯

Todos los menores de orden 3 obtenidos orlando la 3a fila son cero, lo cual

significa que la 3a fila es combinación lineal de la 1a y 2a filas y, por tanto, puede

suprimirse.

4) Continuamos formando determinantes de orden 3 orlando ahora la 4a fila con las

columnas 3a , 4a y 5a .

¯

¯

¯

¯

¯

¯

¯ −1 3 2 ¯

¯ −1 3 1 ¯

¯ −1 3 0 ¯

¯

¯

¯

¯

¯

¯

¯ 0 5 3 ¯ = 0.

¯ 0 5 2 ¯ = 0,

¯ 0 5 1 ¯ = 0,

¯ 3 11 6 ¯

¯ 3 11 5 ¯

¯ 3 11 4 ¯

De nuevo todos los menores obtenidos orlando la 4a fila son cero, lo cual significa

que también la 4a fila es combinación lineal de la 1a y 2a filas y, por tanto, puede

suprimirse.

En consecuencia, se concluye que rango(A) = 2.

Para concluir esta sección, indicaremos que el rango del producto de dos matrices

es menor o igual que el mı́nimo del rango de las dos matrices.

18

1.5

EJERCICIOS PROPUESTOS EN EXÁMENES ANTERIORES

EJERCICIOS PROPUESTOS EN EXÁMENES ANTERIORES

1.- Calcular el determinante de la matriz cuadrada de orden n, A = (aij ), cuyos

elementos vienen dados por

aij = i + j − 1, i, j = 1, 2, . . . , n.

2.- Dada la matriz

0

A = 13 0 0

0 0 13

0

1

3

calcular S = I + A + A2 + A3 + · · · + An .

3.- Obtener el valor de x para que se cumpla que

¯

¯

¯ 1

¯

1

1

1

¯

¯

π

¯ sen 0 sen 6 −1 −x ¯

¯

¯ = 0.

¯ sen2 0 sen2 π 1

x2 ¯¯

¯

6

¯ sen3 0 sen3 π −1 −x3 ¯

6

4.- Sabiendo que a 6= −1, obtener el valor de x en la siguiente ecuación:

¯

¯

¯ 7a + 7 a + 1 a + 1 a + 1 ¯

¯

¯

−1

1

−1 ¯

¯ 7

¯ 7

2

4

8 ¯¯ = 0.

¯

2

¯ 7

x

x

x3 ¯

5.- Sabiendo que

1 −1 0

0

0

1

0 1 −1 0

0

0

1 −1 0 y A−1 = 0

A = 0 0

0 0

0

0

1 −1

0 0

0

0

1

0

calcular la inversa de la matriz

2 −1 0

0

0

−1 2 −1 0

0

B = 0 −1 2 −1 0

0

0 −1 2 −1

0

0

0 −1 1

sabiendo que B = A.A> .

6.- Calcular a, b, c, d ∈ R para que

2

µ

1

1

0

0

0

1

1

1

0

0

¶

1 2

,

0 −1

A − (a + d)A + (ad − bc)I + A =

µ

¶

a b

siendo A =

.

c d

7.- Resolver la ecuación

¯

¯

¯a

−1

1

−1 ¯

¯

¯

a

a2

a3 ¯

¯a

= 0.

¯a

−b

b2

−b3 ¯¯

¯

¯ a (a − b) (a − b)2 (a − b)3 ¯

1

1

1

1

0

1

1

1 ,

1

1

2

ESPACIOS VECTORIALES.

Los espacios vectoriales constituyen una de las estructuras algebraicas más

importantes en Matemáticas. La mayorı́a de los objetos matemáticos que

usamos habitualmente: vectores, matrices, polinomios, funciones, ... tienen

estructura de espacio vectorial.

2.1

DEFINICIÓN Y EJEMPLOS

Sea V un conjunto, cuyos elementos llamaremos vectores y notaremos por ~u, ~v , · · · ,

en el que tenemos definidas dos operaciones: la operación ‘+’ que llamaremos suma

de vectores y la operación ‘·’ que llamaremos producto a izquierda por un número

real . Diremos que (V, +, ·) es un espacio vectorial real si se cumple que:

1.- La suma de vectores es una operación interna en V, es decir, si ~v , w

~ ∈ V,

entonces ~v + w

~ ∈ V, verificando las siguientes propiedades:

a1) Conmutativa: ∀~u, ~v ∈ V, ~u + ~v = ~v + ~u.

a2) Asociativa: ∀~u, ~v , w

~ ∈ V, (~u + ~v ) + w

~ = ~u + (~v + w).

~

a3) Existencia de elemento neutro: Existe un vector, ~0 ∈ V, que llamaremos

vector nulo tal que ~v + ~0 = ~v , para todo ~v ∈ V .

a4) Existencia de elemento opuesto: Para cada vector ~v ∈ V existe otro vector ~v 0 ∈ V, que llamaremos vector opuesto de ~v , tal que ~v + ~v 0 = ~0.

19

20

DEFINICIÓN Y EJEMPLOS

2.- La operación de multiplicación a izquierda por un número real es una operación

externa sobre V, es decir, si λ ∈ R y ~v ∈ V, entonces λ · ~v ∈ V, verificando las

siguientes propiedades:

b1) Distributiva respecto a la suma de números reales: ∀ λ, µ ∈ R y ∀ ~v ∈ V,

(λ + µ) · ~v = λ · ~v + µ · ~v .

b2) Distributiva respecto a la suma de vectores:∀ λ, µ ∈ R, ∀~u, ~v ∈ V,

λ · (~u + ~v ) = λ · ~v + µ · ~v .

b3) Pseudoasociativa: ∀ λ, µ ∈ R, ∀ ~v ∈ V, (λ µ) · ~v = λ · (µ · ~v ).

b4) Elemento unidad: ∀ v ∈ V, 1 · ~v = ~v .

En lo que sigue, para simplificar la notación, el producto de un número real λ por

un vector ~v ∈ V también lo notaremos simplemente por λ ~v .

- Ejemplo 2.1

• El conjunto de vectores del plano es un espacio vectorial. Geométricamente un vector

del plano viene representado mediante un segmento orientado. Algebraicamente, un

vector ~u del plano viene dado por un par de números reales ~u = (u1 , u2 ) que se

denominan coordenadas del vector. El conjunto de vectores del plano se identifica

con el conjunto

R2 = R × R = {~x = (x1 , x2 ) : x1 , x2 ∈ R},

en el que se definen las operaciones usuales de suma de vectores y multiplicación por

un número real dadas por

~x + ~y = (x1 , x2 ) + (y1 , y2 ) = (x1 + y1 , x2 + y2 ),

λ ~x = λ (x1 , x2 ) = (λ x1 , λ x2 ).

(2.1.1)

Entonces (R2 , +, ·) es un espacio vectorial real.

• El conjunto P2 [x] de los polinomios grado menor o igual que 2 en la variable x,

es decir, expresiones de la forma p(x) = a0 + a1 x + a2 x2 con a0 , a1 , a2 ∈ R, tiene

estructura de espacio vectorial con las operaciones algebraicas usuales:

p(x) + q(x) = (a0 + a1 x + a2 x2 ) + (b0 + b1 x + b2 x2 )

= (a0 + b0 ) + (a1 + b1 )x + (a2 + b2 )x2 .

λ · p(x) = λ(a0 + a1 x + a2 x2 ) = (λa0 ) + (λa1 ) + (λa2 )x2 .

En general, el conjunto Pn [x] (polinomios de grado menor o igual que n en la variable

x con las operaciones usuales) tiene estructura de espacio vectorial).

• El conjunto de matrices cuadradas reales de orden 2 que notaremos por M2×2 (R)

tiene estructura de espacio vectorial. Las operaciones de suma y producto por

escalares vienen dadas por:

µ

¶ µ

¶ µ

¶

a11 a12

b11 b12

a11 + b11 a12 + b12

A+B =

+

=

.

a21 a22

b21 b22

a21 + b21 a22 + b22

µ

¶ µ

¶

a11 a12

λ a11 λ a12

λ·A=λ·

=

a21 a22

λ a21 λ a22

ESPACIOS VECTORIALES.

21

En general, el conjunto Mm×n (R), de las matrices reales com m filas y n columnas

y las operaciones usuales de suma de matrices y multiplicación de una matriz por

un número real, es un espacio vectorial.

• El espacio de las funciones f : R → R es un espacio vectorial con las operaciones

usuales:

(f + g)(t) = f (t) + g(t),

(λ f )(t) = (λ · f )(t) = λ f (t),

t ∈ A.

+ Propiedad 2.1.1 En un espacio vectorial (V, +, ·) se satisfacen las identidades

siguientes:

p1) 0 · ~v = ~0,

p2) ~v + (−1)~v = ~0,

p3) λ · ~0 = ~0.

para todo ~v ∈ V y λ ∈ R.

Observemos que la propiedad p2) nos indica que el vector opuesto de un vector ~v

es precisamente el vector (−1)~v . En lo sucesivo notaremos a este vector por −~v .

Asimismo, definiremos la operación de restar dos vectores en la forma

~u − ~v = ~u + (−~v ).

- Ejercicio 2.2

• Escribe el vector nulo en cada uno de los espacios vectoriales del Ejemplo 1.1.

• Da un ejemplo concreto de un vector en cada uno de los espacios vectoriales del

Ejemplo 1.1 y escribe su vector opuesto.

2.1.1

El espacio vectorial Rn

La estructura de espacio vectorial definida sobre R2 puede extenderse fácilmente a

Rn , conjunto de vectores de n coordenadas,

Rn = {~x = (x1 , x2 , . . . , xn ) : xi ∈ R, i = 1, 2, . . . , n},

definiendo las operaciones

~x + ~y = (x1 , x2 , . . . xn ) + (y1 , y2 , . . . , xn ) = (x1 + y1 , x2 + y2 , . . . , xn + yn ),

λ · ~x = λ (x1 , x2 , . . . xn ) = (λ x1 , λ x2 , . . . λ xn ).

- Ejemplo 2.3

• El espacio R3 (vectores de 3 coordenadas) se identifica con el conjunto de los vectores

en el espacio tridimensional.

22

DEFINICIÓN Y EJEMPLOS

Observaciones:

• Aunque hemos denotado a los elementos de Rn como vectores fila de orden

n, en ocasiones, puede resultar más ventajoso utilizar la notación de vectores

columna de orden n,

x1

x2

~x =

... .

xn

En este caso, las operaciones definidas anteriormente vendrán dadas por

x1

y1

x1 + y 1

x1

λ x1

x2 y 2 x2 + y 2

x λ x

, λ · .2 = . 2 . (2.1.2)

~x + ~y =

..

... + ... =

.. ..

.

xn

yn

xn + y n

xn

λ xn

• Por otra parte, si ~x = (x1 , x2 , · · · , xn ) es un vector fila en Rn , también podemos utilizar la operación de transposición de matrices, para denotar por xt =

(x1 , x2 , · · · , xn )t , al correspondiente vector columna en Rn .

x1

x2

~x = (x1 , x2 , . . . , xn ) ⇒ ~xt =

... .

xn

• En lo que sigue utilizaremos indistintamente ambas notaciones, si bien, cuando

sea necesario, distinguiremos entre vectores fila y vectores columna.

2.1.2

Subespacios vectoriales

Sea (V, +, ·) un espacio vectorial real y sea S un subconjunto no vacı́o de V. Diremos

que S es un subespacio vectorial de V si (S, +, ·) tiene estructura de espacio vectorial

con las operaciones ‘+’ y ‘·’ definidas en V.

Notemos que el hecho de que (V, +, ·) sea un espacio vectorial real y que S ⊂ V,

simplifica mucho las cosas a la hora de probar que (S, +, ·) tiene o no estructura de

espacio vectorial.

+ Resultado 2.1.1 Sea (V, +, ·) un espacio vectorial real y S un subconjunto no

vacı́o de V. Entonces S es un subespacio vectorial de V si, y sólo si,

i) ∀ ~u, ~v ∈ S ⇒ ~u + ~v ∈ S,

ii) ∀ λ ∈ R, ∀ ~v ∈ S ⇒ λ ~v ∈ S.

ESPACIOS VECTORIALES.

23

- Ejemplo 2.4

• El conjunto S de las matrices cuadradas de orden 2 de la forma

µ

¶

0 a

b c

es un subespacio vectorial de M2×2 (R).

Solución: Hemos de comprobar que se cumplen las condiciones i) y ii) del Resultado 2.1.1.

i) Tomemos dos matrices A, B ∈ S y veamos que A + B ∈ S.

µ

¶

µ

¶

0 a

0 a0

A=

, B=

,

b c

b0 c0

¶ µ

¶ µ

¶

µ

0 a0

0

a + a0

0 a

+

=

∈ S.

A+B =

b c

b0 c0

b + b0 c + c0

1.- Tomemos λ ∈ R y A ∈ S y probemos que λ · A ∈ S.

µ

¶ µ

¶

0 a

0 λa

λ·A=λ·

=

∈ S.

b c

λb λc

- Ejercicio 2.5

• Indica si los siguientes conjuntos son subespacios vectoriales:

1) El conjunto de funciones trigonométricas de la forma

x(t) = a0 + a1 cos t + b1 sen t, a0 , a1 , b1 ∈ R.

2) El conjunto de matrices cuadradas de orden 2 cuya traza es 0 con las operaciones

usuales.

3) El conjunto de vectores del plano cuyas coordenadas suman 1, con las operaciones

usuales.

4) El conjunto de polinomios de grado menor o igual que 2 que se anulan en el

punto x = 1, con las operaciones usuales.

2.2

COMBINACIÓN LINEAL DE VECTORES

+ Definición 1 Sea V un espacio vectorial. Se dice que el vector ~v es combinación

lineal de los vectores {~v1 , ~v2 , . . . , ~vk } ⊂ V, si puede escribirse en la forma

~v = λ1~v1 + λ2~v2 + · · · + λk~vk .

- Ejemplo 2.1

• El vector ~v = (4, −5, −2) de R3 es combinación lineal de los vectores ~v1 = (1, 1, 1) y

~v2 = (2, −1, 0), dado que

~v = −2~v1 + 3~v2 .

• Para saber si el vector ~v = (3, 0, −5) es combinación lineal de los vectores ~v1 y ~v2

anteriores, planteamos la igualdad

~v = λ · ~v1 + µ · ~v2 ⇒ (3, 0, −5) = λ(1, 1, 1) + µ(2, −1, 0)

24

COMBINACIÓN LINEAL DE VECTORES

que conduce al sistema

(

λ + 2µ =

3

λ−µ =

0

λ = −5

Dado que el sistema anterior es incompatible (no tiene solución) concluimos que el

vector ~v no es combinación lineal de los vectores ~v1 y ~v2 .

µ

¶

3 1

• En M2×2 (R), para averiguar si la matriz A =

es combinación lineal de

−6 4

las matrices

¶

¶

µ

µ

1 −1

3 −1

,

A2 =

,

A1 =

2

0

0

2

planteamos la igualdad

A = λ · A1 + µ · A2 ⇒

que conduce al sistema

µ

3 1

−6 4

¶

λ + 3µ

λ−µ

2λ

2µ

µ

=λ

1 −1

2

0

¶

µ

+µ

3 −1

0

2

¶

=

3

=

0

= −6

=

4

de donde se obtiene λ = −3, µ = 2. Por tanto, la matriz A es combinación lineal de

las matrices A1 y A2 ya que

A = −3A1 + 2A2 .

- Ejercicio 2.2

• Determina si el polinomio p(x) = −1 − 6x2 + 19x − x3 es combinación lineal de los

polinomios p1 (x) = 1 + 3x − x3 , p2 (x) = 2 − 3x + x2 , p3 (x) = 4x − 4x2 + 2x3 .

• Determina si el vector v = (1, 0, −1, 4) de R4 es combinación lineal de los vectores

~v1 = (1, 1, 0, 1) y ~v2 = (2, 1, −1, 1).

µ

¶

3 1 0

• En M2×3 (R), determina si la matriz A =

es combinación lineal de

−6 4 2

las matrices

µ

¶

µ

¶

µ

¶

1 −1

0

3 −1 −1

0 0 −1

A1 =

, A2 =

, A3 =

.

2

0 −1

0

0

2

1 0

2

2.2.1

Dependencia e independencia lineal de vectores

+ Definición 2 Un conjunto de vectores S = {~v1 , v~2 , . . . , ~vk } de un espacio vectorial V se dice que es linealmente independiente, si ninguno de los vectores de S

puede escribirse como combinación lineal de los restantes vectores de S. En caso

contrario, se dice que es un conjunto de vectores linealmente dependiente.

ESPACIOS VECTORIALES.

25

- Ejemplo 2.3

• El conjunto S = {(−2, 1), (1, 0)} de R2 es linealmente independiente, ya que ninguno

de ellos puede ponerse como combinación lineal del otro.

• El conjunto de vectores S = {(4, −5, −2), (1, 1, 1), (2, −1, 0)} de R3 es linealmente

dependiente dado que el primer vector puede escribirse como combinación lineal de

los restantes:

(4, −5, −2) = −2(1, 1, 1) + 3(2, −1, 0).

+ Propiedad 2.2.1 Un conjunto de vectores S = {~v1 , v~2 , . . . , ~vk } es linealmente

independiente si se cumple que

λ1~v1 + λ2~v2 + · · · + λk~vk = ~0 ⇒ λ1 = λ2 = · · · = λk = 0,

es decir, si la única forma de escribir el vector nulo como combinación lineal de

los vectores de S es que todos los coeficientes sean nulos.

La propiedad anterior también puede enunciarse de esta otra forma:

+ Propiedad 2.2.2 Un conjunto de vectores S = {~v1 , v~2 , . . . , ~vk } es linealmente

dependiente si es posible expresar el vector nulo como combinación lineal de ellos

con al menos un coeficiente no nulo. Dicho en términos matemáticos, es posible

encontrar números λ1 , λ2 , · · · , λk no todos nulos, de forma que

λ1~v1 + λ2~v2 + · · · + λk~vk = ~0

- Ejemplo 2.4

• Para determinar si el conjunto de vectores S = {(−2, 1), (1, 0)} de R2 es linealmente

independiente planteamos la igualdad

λ(2, −1) + µ(1, 0) = (0, 0),

que conduce al sistema

½

2λ + µ = 0

−λ = 0

cuya única solución es λ = µ = 0. Por tanto, deducimos que el conjunto S es

linealmente independiente.

• Para determinar si el conjunto de vectores S = {(4, −5, −2), (1, 1, 1), (2, −1, 0)} de

R3 es linealmente independiente planteamos la igualdad

α(4, −5, −2) + β(1, 1, 1) + γ(2, −1, 0) = (0, 0, 0).

que conduce al sistema

(

4α + β + 2γ

−5α + β − γ

−2α + β

que admite soluciones distintas de la trivial:

(

α=t

β = 2t ,

γ = −3t

= 0

= 0

= 0

t ∈ R.

(2.2.1)

26

COMBINACIÓN LINEAL DE VECTORES

Tomando, por ejemplo, t = 1, obtenemos la solución particular α = 1, β = 2,

γ = −3, por lo que la igualdad (2.2.1) nos asegura que es posible expresar el vector

nulo como una combinación lineal de los vectores de S con coeficientes no nulos.

En el caso particular de que trabajemos con vectores de Rn , podemos aplicar el

siguiente resultado para determinar si son linealmente independientes:

+ Resultado 2.2.1 El conjunto de vectores S = {~v1 , ~v2 , . . . , ~vk } de Rn es linealmente independiente si, y solo si,

rango (~v1 | ~v2 | . . . | ~vk ) = k.

- Ejemplo 2.5

• El conjunto de vectores S = {(−2, 1), (1, 0)} de R2 es linealmente independiente ya

que

¯

¯

¯ −2 1 ¯

¯

¯

¯ 1 0 ¯ 6= 0.

• Para determinar si el conjunto de vectores S = {(4, −5, −2, 4), (1, 1, 1, 1), (2, −1, 0, 2)}

de R4 es linealmente independiente calculamos el rango de la matriz

Ã

A=

4 −5 −2 4

1

1

1 1

2 −1

0 2

!

.

1) En primer lugar observamos que la 4a columna es igual que la 1a por lo que

puede suprimirse, es decir,

Ã

rango

4 −5 −2 4

1

1

1 1

2 −1

0 2

!

Ã

= rango

4 −5 −2

1

1

1

2 −1

0

!

.

2) Por otra parte,

¯

¯

¯ 4 −5 ¯

¯ = 9 6= 0,

¯

¯1

1¯

¯

¯

¯ 4 −5 −2 ¯

¯

¯

1

1 ¯ = 0,

¯1

¯ 2 −1

0¯

de donde se concluye que rango(A) = 2 y por tanto, el conjunto de vectores S es

linealmente dependiente.

ESPACIOS VECTORIALES.

27

+ Propiedad 2.2.3 En un espacio vectorial V se cumplen las siguientes

propiedades:

1) El conjunto S = {~v } formado por un sólo vector es linealmente dependiente

si, y solamente si, ~v = ~0.

2) Si ~0 ∈ S, entonces S es un conjunto linealmente dependiente.

3) El conjunto S = {~u, ~v } es linealmente dependiente si, y solamente si, ~v = λ~u

(vectores proporcionales).

4) Si S es un conjunto linealmente independiente y S 0 ⊂ S, entonces S 0 es linealmente independiente.

5) Si S es un conjunto linealmente dependiente y S ⊂ S 0 , entonces S 0 es linealmente dependiente.

2.2.2

Subespacio vectorial generado por un conjunto de vectores

Sea S = {~v1 , ~v2 , . . . , ~vn } un conjunto de vectores de un espacio vectorial V. El

conjunto L(S) de todos los vectores que se pueden obtener como combinación lineal

de los vectores de S es subespacio vectorial de V que se llama subespacio vectorial

generado por S y se representa por

L(S) = h~v1 , ~v2 , . . . , ~vn i .

El conjunto S se llama sistema de generadores de L(S).

Un vector ~x ∈ L(S) si se puede expresar como combinación lineal de los vectores de

S, es decir, si ~x se puede escribir en la forma

~x = λ1~v1 + λ2~v2 + · · · + λn~vn ,

λ1 , λ2 , . . . , λn ∈ R.

- Ejemplo 2.6

• Sea S = {~u, ~v } un conjunto de vectores de R4 con ~u = (1, −1, 1, 2) y ~v = (1, 3, −2, 1).

El subespacio vectorial L(S) viene dado por el conjunto de vectores ~x ∈ R4 tales

que

~x = λ ~u + µ ~v , con λ, µ ∈ R.

Si tomamos ~x = (x1 , x2 , x3 , x4 ), la igualdad anterior se escribe como

(x1 , x2 , x3 , x4 ) = λ(1, −1, 1, 2) + µ(1, 3, −2, 1),

λ, µ ∈ R.

La igualdad anterior se denomina ecuación vectorial de L(S).

De la ecuación anterior se obtienen las igualdades

x =λ+µ

1

x2 = −λ + 3µ

,

λ, µ ∈ R.

x3 = λ − 2µ

x4 = 2λ + µ

Los números λ, µ son números reales arbitrarios que reciben el nombre de parámetros.

De ahı́ que a las ecuaciones anteriores se denominen ecuaciones paramétricas de

L(S).

Las ecuaciones paramétricas son útiles para obtener vectores que pertenezcan a

L(S). Para ello basta darle valores concretos a los parámetros λ y µ. Por ejemplo,

para λ = 1 y µ = 1, se obtiene el vector ~x = (2, 2, −1, 3) ∈ L(S).

28

COMBINACIÓN LINEAL DE VECTORES

Si despejamos (por ejemplo) λ en la primera igualdad λ = x1 − µ y sustituimos en

las restantes ecuaciones se obtiene

(

(

x2 = −x1 + 4µ

x2 = −(x1 − µ) + 3µ

x3 = x1 − 3µ

x3 = (x1 − µ) − 2µ

⇒

x4 = 2(x1 − µ) + µ

x4 = 2x1 − µ

Si ahora repetimos lo mismo con el parámetro µ (lo despejamos en la última ecuación

porque es más fácil), µ = 2x1 − x4 , y sustituimos en las restantes ecuaciones, se

obtiene

½

½

x2 = −x1 + 4(2x1 − x4 )

7x1 − x2 − 4x4 = 0

⇒

x3 = x1 − 3(2x1 − x4 )

5x1 + x3 − 3x4 = 0

Se obtienen 2 ecuaciones donde no intervienen los parámetros λ, µ. Estas ecuaciones

se denominan ecuaciones cartesianas o ecuaciones implı́citas de L(S).

Las ecuaciones cartesianas de L(S) son útiles para comprobar si un determinado

vector pertenece o no a L(S). Por ejemplo, el vector (2, −1, 3, 4) no pertenece a

L(S) ya que no se cumplen las dos ecuaciones paramétricas.

7x1 − x2 − 4x4 = 7(2) − (−1) − 4(4) = −2 6= 0.

El vector (3, 1, 0, 5) ∈ L(S) ya que

7x1 − x2 − 4x4 = 7(3) − (1) − 4(5) = 0,

5x1 + x3 − 3x4 = 5(3) + (0) − 3(5) = 0.

• Sea M el subespacio vectorial de R3 dado por las ecuaciones paramétricas

(

x1 = µ

x2 = λ − µ ,

λ, µ ∈ R.

x3 = λ + 2µ

Para determinar un sistema de generadores de M podemos escribir las ecuaciones

paramétricas en la forma

Ã

!

à !

Ã

!

x1

0

1

x2

= λ 1 + µ −1 .

x3

1

2

Entonces resulta que S = {(0, 1, 1), (1, −1, 2)} es un sistema de generadores de L, es

decir, podemos escribir

M = L(S) = h(0, 1, 1), (1, −1, 2)i

• Sea L el subespacio vectorial de R5 determinado por las ecuaciones cartesianas

½

x1 − 2x3 + x5 = 0

x1 + 2x2 − 3x3 + x4 = 0

Para determinar un sistema de generadores de L resolvemos el sistema dado por las

ecuaciones cartesianas.

ESPACIOS VECTORIALES.

29

+ Propiedad 2.2.4 Sean S = {~v1 , ~v2 , . . . , ~vn } y S 0 = {~v1 , ~v2 , . . . , ~vn , w}.

~ Si w

~ es

combinación lineal de ~v1 , ~v2 , . . . , ~vn , entonces se cumple que:

L(S) = L(S 0 ),

es decir, los subespacios vectoriales generados por S y S 0 son el mismo.

2.3

BASES Y DIMENSIÓN

+ Definición 3 Sea V un espacio vectorial y L un subespacio vectorial de V. Se

dice que L es finitamente generado si existe un conjunto de vectores S = {~v1 , ~v2 , . . . , ~vn }

de V de forma que

L = L(S) = h~v1 , ~v2 , . . . , ~vn i.

El conjunto S se dice que es un sistema de generadores del subespacio L. Si además,

S es un conjunto de vectores linealmente independientes entonces se dice que S es

una base del subespacio vectorial L.

La propiedad 2.2.4 nos dice que si S es un sistema de generadores de L y eliminamos aquellos vectores de S que sean combinación lineal de los restantes, entonces

seguimos teniendo un sistema de generadores de L. De esta forma siempre será

posible obtener un sistema de generadores que además sea linelmente independiente

y, en definitiva, siempre será posible obtener una base de un subespacio vectorial

finitamente generado.

- Ejemplo 2.7

• Los vectores {(1, 0), (0, 1)} forman un base de R2 .

• Sea S el subespacio vectorial de R3 generado por los vectores

~v1 = (1, 1, 1, 1),

~v2 = (2, −1, 0, 1),

~v3 = (0, 3, 2, 1).

El conjunto {~v1 , ~v2 , ~v3 } es un sistema de generadores de S, sin embargo no es una

base de S dado que no son linealmente independientes al ser ~v3 combinación lineal

de ~v1 y v~2 ,

~v3 = 2~v1 − ~v2 .

Ahora bien, teniendo en cuenta que

® ­

®

­

S = ~v1 , ~v2 , ~v3 = ~v1 , ~v2 ,

donde ahora los vectores ~v1 y ~v2 son linealmente independientes. Por tanto, podemos

concluir diciendo que {~v1 , ~v2 } es una base de S.

+ Propiedad 2.3.1 Un conjunto de vectores B = {~v1 , ~v2 , . . . , ~vn } es una base de

un espacio vectorial V si, y sólo si, cualquier vector de V se expresa de forma única

como combinación de los vectores de B.

Sea B = {~v1 , ~v2 , . . . , ~vn } una base de V. Por la Propiedad 2.3.1, cualquier vector

~v ∈ V puede escribirse como combinación lineal única de los vectores de B, es decir,

~v = λ1 ~v1 + λ2 ~v2 + λk ~vk ,

30

BASES Y DIMENSIÓN

donde λ1 , λ2 , . . . , λk , son números reales unı́vocamente determinados.

Los números reales λ1 , λ2 , . . . , λk se denominan coordenadas del vector ~v respecto de

la base B.

2.3.1

Base canónica de Rn

Como sabemos el conjunto B = {(1, 0), (0, 1)} es una base de R2 . Dicha base recibe

el nombre de base canónica de R2 y es la que suele utilizarse para estudiar los

problemas de geometrı́a en el plano. Cualquier vector de R2 viene determinado de

forma única como combinación lineal de los vectores de B. Más concretamente,

cualquier (x, y) ∈ R2 , puede escribirse como

(x, y) = x(1, 0) + y(0, 1).

Los números x e y se denominan coordenadas del vector (x, y).

En general, el conjunto B = {~e1 , ~e2 , · · · , ~en } de vectores de Rn , definidos por

i

|{z}

~ei = (0, 0, . . . , 1 , 0, . . . , 0),

para i = 1, 2, · · · , n, determinan una base de Rn que se denomina base canónica de

Rn . Cualquier vector ~x = (x1 , x2 , . . . , xn ) ∈ Rn se escribe como

~x = x1~e1 + x2~e2 + · · · + xn~en .

2.3.2

Dimensión de un espacio vectorial

Un espacio vectorial V no tiene una base única. Ası́, por ejemplo, los conjuntos

B = {(1, 0), (0, 1)} y B 0 = {(1, 1), (0, 1)} son bases de R2 (De hecho, una base de

R2 estará formada por dos vectores cualesquiera ~v1 y ~v2 , no nulos, que no sean

proporcionales; geométricamente significarı́a que tienen distinta dirección).

Sin embargo, todas las bases de un espacio vectorial V tienen algo en común: el

mismo número de vectores. A tal número se le llamará dimensión del espacio vectorial V, y lo denotaremos mediante dim(V ).

- Ejemplo 2.8

• Dado que la base canónica de Rn tiene n vectores, podemos asegurar que cualquier

base de Rn tendrá n vectores y que, por tanto, dim(Rn ) = n. .

• El conjunto de polinomios {1, x, x2 , x3 , . . . , xn } forman una base de Pn [x], por lo que

dim(Pn [x]) = n + 1.

• Las matrices

µ

1 0

0 0

¶ µ

¶ µ

¶ µ

¶

0 1

0 0

0 0

,

,

,

0 0

1 0

0 1

forman una base de M2 (R), por lo que dim (M2×2 (R)) = 4.

En general, se cumple que dim (Mm×m (R)) = m n.

ESPACIOS VECTORIALES.

31

El siguiente resultado nos permite decidir cuando un conjunto de n vectores de Rn

forman una base de Rn .

+ Resultado 2.3.1 Un conjunto B = {~v1 , ~v2 , . . . , ~vn } de vectores de Rn es una

base de R si, y sólo si,

det (~v1 | ~v2 | . . . | ~vn ) 6= 0.

- Ejemplo 2.9

• Los vectores ~v1 = (1, 0, 1), ~v2 = (0, −1, 3) y ~v3 = (3, 1, 1) forman una base de R3 ,

¯

¯

dado que

¯1

0 3¯

¯

¯

det (~v1 | ~v2 | ~v3 ) = ¯ 0 −1 1 ¯ = −1 6= 0.

¯1

3 1¯

• Los vectores ~v1 = (1, 2), ~v2 = (−2, −4) no¯ son una ¯base de R2 , dado que

¯ 1 −2 ¯

¯ = 0.

det (~v1 | ~v2 ) = ¯¯

−2

4¯

El resultado anterior puede establecerse de manera más general como sigue,

­

®

+ Resultado 2.3.2 Sea S = ~v1 , ~v2 , . . . , ~vk , donde ~v1 , ~v2 , . . . , ~vk ∈ Rn . Entonces se cumple que

dim(S) = rango (~v1 | ~v2 | . . . | ~vk ) .

- Ejemplo 2.10

• Sea S el subespacio vectorial de R4 , generado por los vectores,

~v1 = (1, 1, 1, 1) , ~v2 = (2, −1, 0, 1) y ~v3 = (0, 3, 2, 1) .

Ã

!

1

1 1 1

Entonces, dim(S) = rango (~v1 | ~v2 | ~v3 ) = rango 2 −1 0 1 = 2.

0

3 2 1

2.3.3

Cambio de base en un espacio vectorial

Sea V un espacio vectorial de dimensión n y supongamos que tenemos dos bases

B = {~u1 , ~u2 , . . . , ~un } y B 0 = {~v1 , ~v2 , . . . , ~vn }. Como sabemos, cualquier vector ~x de

V podrá escribirse de forma única como combinación lineal de los vectores de B y

de B 0 .

Respecto de la base B, el vector ~x tendrá unas coordenadas (x1 , x2 , . . . , xn ), es decir,

se podrá expresar en la forma

~u1

~u2

(2.3.1)

~x = x1~u1 + x2~u2 + · · · + xn~un = (x1 , x2 , . . . , xn )

... .

~un

32

BASES Y DIMENSIÓN

Análogamente, el vector ~x tendrá unas coordenadas (x01 , x02 , . . . , x0n ) respecto de la

base B 0 , es decir,

~v1

~v2

~x = x01~v1 + x02~v2 + · · · + x0n~vn = (x01 , x02 , . . . , x0n )

(2.3.2)

... .

~vn

¿Qué relación existe entre (x1 , x2 , . . . , xn ) y (x01 , x02 , . . . , x0n )?

A partir de (2.3.1) y (2.3.2) obtenemos la igualdad en forma matricial

~v1

~u1

~u2

~v

0

0

0 2

(x1 , x2 , . . . , xn )

... = (x1 , x2 , . . . , xn ) ...

~vn

~un

(2.3.3)

que se llama ecuación general del cambio de base. La ecuación (2.3.3) puede escribirse abreviadamente en la forma

(x1 , x2 , . . . , xn )B = (x01 , x02 , . . . , x0n )B 0 ,

(2.3.4)

donde B y B 0 son las matrices cuyos vectores fila son las coordenadas de los vectores

de las bases B y B 0 respectivamente. Dado que B y B 0 son bases, entonces necesariamente las matrices B y B 0 son regulares (su determinantes es distinto de cero) y,

por tanto, existen sus matrices inversas B −1 y (B 0 )−1 .

La ecuación (2.3.3) nos permite conocer las coordenadas (x01 , x02 , . . . , x0n ) respecto de

B 0 conocidas las coordenadas (x1 , x2 , . . . , xn ) respecto de B o viceversa, mediante las

igualdades

(x01 , x02 , . . . , x0n ) = (x1 , x2 , . . . , xn )B(B 0 )−1 ,

(x1 , x2 , . . . , xn ) = (x01 , x02 , . . . , x0n )B 0 B −1 .

- Ejemplo 2.11

• En R2 se consideran la base canónica B = {(1, 0), (0, 1)} y la base B0 = {(2, −1), (3, 0)}.

La ecuación general del cambio de base vendrá dada por

µ

¶

µ

¶

1 0

2 −1

0

0

(x1 , x2 )

= (x1 , x2 )

.

0 1

3

0

Si el vector ~x = (1, −5) respecto de la base B para determinar sus coordenadas

respecto de la base B0 utilizamos la igualdad

µ

¶

µ

¶

1 0

2 −1

0

0

(1, −5)

= (x1 , x2 )

,

0 1

3

0

de donde se obtiene que

µ

¶µ

¶−1

µ

0

1 0

2 −1

(x01 , x02 ) = (1, −5)

= (1, −5)

0 1

3

0

−1

luego ~x = (13, −1) respecto de B 0 .

1

3

2

3

¶

= (13, −1),

ESPACIOS VECTORIALES.

33

- Ejercicio 2.12

• Si ~x = (1, 2, −1) respecto de la base B = {(1, 1, 0), (0, 1, 1), (1, 0, 1)}, hallar las coordenadas del vector ~x respecto de la base canónica de R3 .

• Sean B = {~u1 , ~u2 , u~3 } y B = {~v1 , v~2 , ~v3 } dos bases de R3 , tales que ~v1 = ~u2 + ~u3 ,

~v2 = u~1 + ~u3 y ~v3 = ~u1 + ~u2 . Hallar las ecuaciones del cambio de la base B a B 0 y

de la base B0 a B.

• Dadas las bases de R3 , B = {~u1 = (2, 1, 0), ~u2 = (−1, 0, 1), ~u3 = (0, 1, −2)} y B 0 =

{~v1 = (0, 1, 1), ~v2 = (1, 0, 0), ~v3 = (2, 0, 1)}.

a) Hallar la expresión analı́tica del cambio de base de B a B 0 , de B 0 a B y de B 0 a

la base canónica.

b) Si ~a = (1, 1, 1) respecto de B, ¿cuáles son sus coordenadas respecto de B 0 .?

c) Si ~b = ~v1 − ~v2 , escribir la expresión de ~b respecto de B.

2.4

SUMA E INTERSECCIÓN DE SUBESPACIOS

2.4.1

Suma de subespacios

+ Definición 4 Sea V un espacio vectorial y L y M dos subespacios vectoriales

de V. Se define el conjunto

L + M = {w

~ :w

~ = ~u + ~v con u ∈ L, v ∈ M },

es decir, un vector w

~ ∈ L + M si se puede escribir como suma de un vector de L y

un vector de M .

El conjunto L + M es un subespacio vectorial de V que llamaremos subespacio vectorial suma de L y M .

Si conocemos un sistema de generadores de los espacios L y M , entonces es muy

fácil determinar cuál es el subespacio L + M .

+ Propiedad 2.4.1 Si L = L(S) y M = L(S 0 ), entonces L + M = L(S ∪ S 0 ).

- Ejemplo 2.13

• Consideremos los subespacios vectoriales de R4 dados por

½

2x2 − x3 = 0

L = h(1, 2, 3, 4), (−1, 1, 2, 1)i,

M=

.

x1 + x4 = 0

Para determinar el subespacio L + M necesitamos conocer un sitema de generadores

de L y de M . En nuestro caso, sólo hemos de determinar un sistema de generadores

de M . Para ello resolvemos el sistema dado por las ecuaciones cartesianas de M .

x1 = −x4

x = −µ

½

½

1

2x2 − x3 = 0

x1 = −x4

x2 = λ

x2 = λ

⇒

⇒

⇒

x3 = 2x2

x1 + x4 = 0

x

=

2x

2

3

x3 = 2λ

x4 = µ

x4 = µ

x1

−1

0

x2

0

1

⇒ = λ

+ µ .

x3

0

2

x4

1

0

34

SUMA E INTERSECCIÓN DE SUBESPACIOS

Luego M = h(−1, 0, 0, 1), (0, 1, 2, 0)i y, por tanto,

L + M = h(1, 2, 3, 4), (−1, 1, 2, 1), (−1, 0, 0, 1), (0, 1, 2, 0)i.

Ahora bien, dado que

¯

¯ 1

¯

¯ −1

¯ −1

¯

¯ 0

2

1

0

1

3

2

0

2

¯

4¯

¯

1¯

=0

1 ¯¯

0¯

dichos vectores no forman una base de L + M .

Para determinar una base de L+M debemos seleccionar un conjunto de vectores que

sean linealmente independientes. Para ello podemos calcular el rango de la matriz

1 2 3 4

−1 1 2 1

A=

−1 0 0 1

0 1 2 0

De esta forma sabremos cuántos vectores hay linealmente independiente y cuáles

son. Para ello procedemos de la siguiente forma:

1) Seleccionamos un menor de orden 2 distinto de cero. En nuestro caso, podemos

tomar el menor formado por las dos primeras filas y las dos primeras columnas

dado que

¯

¯

¯ 1 2¯

¯

¯

¯ −1 1 ¯ 6= 0.

2) Tomamos los menores de orden 3 obtenidos orlando filas y columnas al menor

de orden 2 seleccionado anteriormente hasta encontrar un menor de orden 3 que

sea distinto de cero.

Orlamos la 3a fila y la 3a columna

¯

¯

¯ 1 2 3¯

¯

¯

¯ −1 1 2 ¯ = −1 6= 0,

¯ −1 0 0 ¯

Por lo que concluimos que rango(A)=3 y que una base de L + M viene dada por