- Ninguna Categoria

investigación operativa

Anuncio

INVESTIGACION OPERATIVA

Tercer curso de Ingeniería Técnica de Gestión

CURSO 2010-2011

Profesor:

Alejandro Quintela del Río

TEMA 0: Historia de la investigación de operaciones.

La Investigación Operativa en la segunda guerra mundial:

-La máquina Enigma, El sónar, El proyecto Manhattan.

TEMA 1: MODELOS DE PROGRAMACION LINEAL y APLICACIONES.

. Formulación de modelos de programación lineal. Ejemplos.

. Solución gráfica de problemas de programación lineal con

dos variables. Interpretación. Definiciones

básicas.

. Problemas de programación lineal en forma estándar.

.

Sistemas de ecuaciones lineales simultáneas. Definiciones básicas: solución factible, variables

básicas y no básicas, sistema canónico, solución básica, solución factible básica.

TEMA 2: EL METODO DEL SIMPLEX.

. Esquema básico de funcionamiento del método del Simplex. Beneficios relativos, criterio de entrada, criterio

de salida (regla de la mínima proporción), elemento pivote, pivotaje.

. El método del Simplex por tablas.

. Problemas de cálculo: empates en el criterio de entrada, empates en el criterio de salida, degeneración,

ciclaje.

.

Obtención de una solución factible básica inicial: Método de las Dos Fases y Método de las

Penalizaciones.

- Otros: Consideraciones computacionales, Método del punto interior.

TEMA 3: EL METODO REVISADO DEL SIMPLEX.

. El método revisado: Conceptos básicos. Vector de Multiplicadores.

. Desarrollo del método.

. Ventajas del método revisado del Simplex sobre el método del Simplex regular.

TEMA 4: TEORIA DE LA DUALIDAD.

. Fomulación del problema dual.

. Problemas primal-dual simétrico. Propiedades y relaciones de los problemas primal y duaL

. Teoremas de la dualidad.

. Condiciones de holguras complementarias.

. Problemas asimétricos primal-duaL

. Lectura de la solución dual óptima en la tabla óptima primaL

TEMA 5: EL METODO DUAL DEL SIMPLEX.

. Conceptos fundamentales. Bases factibles dual y primaL

. Desarrollo del método dual del Simplex.

. Identificación de problemas no factibles.

TEMA

6:

ANALISIS

DE

SENSIBILIDAD

PARAMETRICA.

. Modificaciones en los coeficientes de la función del objetivo.

. Modificaciones en las constantes de la derecha de las restricciones.

. Modificaciones en la matriz de coeficientes de las restricciones.

. Adición de nuevas variables.

. Adición de nuevas restricciones.

. Variación paramétrica de los coeficientes de la función del objetivo.

. Variación paramétrica de las constantes de la derecha de las restricciones.

TEMA 7: PROGRAMACION LINEAL ENTERA.

. Formulación de modelos.

. Algoritmo de ramificación y acotación.

. Aspectos computacionales.

Y

PROGRAMACION

PROBLEMAS ESPECIALES DE PROGRAMACION LINEAL.

1 Problemas de Transporte.

. Formulación del Problema Standard del Transporte.

. Obtención de una solución factible básica inicial: método de la esquina noroeste y método del coste mínimo.

. Algoritmo de Stepping-Stone.

2 Problemas de Asignación.

. Formulación del Problema Standard de Asignación.

. Método Húngaro.

BIBLIOGRAFÍA

. ANDERSON, D.R. - SWEENEY, D.J. - WILLIAMS, T.A.

Introducción a los modelos cuantitativos para administración.

Grupo Editorial Iberoamericana.

. ARREOLA, J. – ARREOLA, A.

Programación lineal. Una introducción a la toma de decisiones cuantitativa.

Thomson

. BRONSON. R.

Teoría y problemas de investigación de operaciones.

Schaum, McGrawHill

. DANTZIG, G.B.

Linear programming and extensions

Princeton University Press

. GARCIA, J. - FERNANDEZ, L. - TEJERA, P.

Técnicas de investigación operativa.

Ed. Paraninfo.

. HILLIER,F. - LIEBERMAN, G.

Introducción a la investigación de operaciones.

McGraw-Hill

. INFANTE MACIAS, R.

Métodos de programación matemática.

UNED

. MATHUR - SOLOW

Investigación de operaciones.

Prentice Hall

. PARDO, L.

Programación lineal continua: aplicaciones prácticas en la empresa.

Ed. Díaz de Santos.

. PARDO, L.

Programación lineal entera: aplicaciones prácticas en la empresa.

Ed. Díaz de Santos.

. RAVINDRAN, A. - PHILLIPS, D. - SOLBERG, J.

Operations Research. Principles and Practice.

Wiley.

. RIOS INSUA, S.

Investigación Operativa. Optimización.

Ed. Centro de Estudios Ramón Areces.

. GASS, S. – ASSAD, AR.

An annotated timeline of operations research. An informal history.

Kluwer Academic Publishers

. TAHA, H.

Investigación de Operaciones.

Prentice Hall

INVESTIGACIÓN OPERATIVA. XESTIÓN. CURSO 2010-2011.

PROBLEMAS DE PROGRAMACIÓN LINEAL

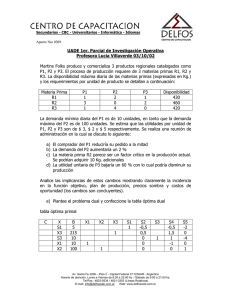

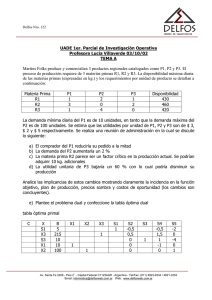

1.-) Una compañía armamentística americana desea proyectar la fabricación de un cohete

antitanque casero para vender en supermercados. La Compañía ha considerado 3

modelos y su departamento de producción ha elaborado la siguiente tabla:

modelo

Trabajo

A

B

C

(horas 7

3

6

4

5

20$

30$

por unidad)

Material

(titanio 4

Por unidad)

Beneficios

(por 40$

unidad fabricada)

El suministro de material se restringe a 200 kg de titanio por día, y la disponibilidad

total diaria de los trabajadores es de 150 horas. Formular un problema de programación

lineal para determinar la producción diaria de cada modelo, en orden a maximizar el

beneficio total.

2.- ) El gobierno provisional ha decidido repartir cereales en los colegios iraquíes a la hora

de la merienda. Los niños podrán tomar Cereales "A" o Cereales "B", o bien una mezcla de

ambos. Por recomendación de la ONU, los niños deben recibir en su desayuno, cuando

menos, 1 miligramo de tiamina, 5 miligramos de miacina y 400 calorías. Una unidad (100

gramos) de cereales "A" tiene 0.10 mg de tiamina, 1 mg de miacina y 110 calorías,

mientras que una unidad de cereales "B" tiene 0.25 mg de tiamina, 0.25 de miacina y 120

calorías. La unidad de cereales "A" cuesta 180 centavos de dólar y la de cereales "B" 234

centavos de dólar. Formular un problema de programación lineal que sirva para establecer

la dieta óptima más barata.

Problemas 1

3.- ) El administrador de un club de carretera ha elaborado una lista de necesidad de

camareras para su establecimiento cada 24 horas

Periodo

Horas

Numero mínimo de camareras

1

6 a 10

60

2

10 a 14

70

3

14 a 18

60

4

1 8 a 22

50

5

6

22 a 2

2a6

20

30

El administrador ha acordado con las camareras que éstas comiencen a trabajar al

principio de cada periodo y trabajen 8 horas seguidas. El administrador quiere determinar

el número mínimo de camareras que sea suficiente para la atención correcta del

establecimiento.

Formular un modelo de programación lineal para este caso.

4.-) Una organización terrorista da trabajo a 1000 personas. En una semana, cada uno de

ellos puede producir 2 barriles de sustancias químicas “mantrax” para enviar a países del

eje del mal, o bien transformar un barril en otro de un arma de destrucción masiva

“agente amarillo” (tras mezclado de sustancias indicadas por un químico español aburrido

de no cobrar un duro como becario), pero no ambas cosas a la vez. Actualmente, la

fábrica tiene un amplio surtido de materia prima porque se la envió Irak poco antes de la

invasión. Después de tres semanas de producción, los barriles de “mantrax” se venden a

20$ unidad y los barriles de “agente amarillo” a 75 por unidad.

Plantear un problema de programación- lineal que nos sirva para calcular cuántos

terroristas deben dedicarse a la fabricación de cada producto durante cada semana, en

orden a obtener el máximo beneficio (supóngase que un barril de mantrax puede

convertirse en agente amarillo tan sólo a la semana siguiente de su fabricación).

5.- ) Para la fabricación de dos herramientas de defensa personal A y B son necesarias 2

operaciones. Cada unidad de la herramienta A requiere de 2 horas de la operación 1 y 3

horas de la operación 2. Cada unidad de la herramienta B requiere de 3 horas de la

operación 1 y 4 horas de la operación 2. La operación 1 puede desarrollarse durante 16

horas y la 2 durante 24 horas.

Problemas 2

Al fabricar la herramienta B también se produce un polvillo mata-suegras sin coste

adicional, pero sólo una parte puede venderse con provecho en sobres en quioscos; el

resto debe destruirse. Se obtienen 2 sobres del polvillo C por cada herramienta B

fabricada, y sólo se podrán vender 5 sobres de C para que la policía no sospeche y

clausure la fábrica

La ganancia de la herramienta A es de 4 euros por unidad y la de B es de 10 euros.

por unidad. El producto C, si se vende proporciona una ganancia de 3 euros/unidad, pero

si se destruye su coste es de 2 euros/unidad.

Plantear un problema de p.l.. de manera que se maximicen las ganancias.

6.-) Una tienda de máquinas tiene un taladro a presión y 5 máquinas moledoras, las

cuales son utilizadas para producir un destornillador-navaja que consta de dos piezas

A(destornillador) y B (navaja). La productividad de cada máquina para las dos piezas

viene dada por:

Tiempo de producción en minutos por pieza

TALADRO

MOLEDORA

PIEZA A

3

20

PIEZA B

5

15

Se desea mantener un equilibrio entre todas las máquinas de lal forma que ninguna

máquina trabaje 30 minutos por día más que otra (se supone que la carga de trabajo de

cada moledora es la media de las 5 máquinas). Plantear un problema de programación

lineal para obtener el número máximo de herramientas completas en 8 horas diarias de

trabajo.

7.-) Un alumno de Quinto de Ingeniería Informática al que sólo le queda Álgebra y

Estadística para licenciarse, y que sólo dispone de 30 días para prepararlas, recibe de su

padre la siguiente proposición:

Por cada asignatura que apruebe le premiará de la siguiente forma:

. Por cada punto que saque en Álgebra le dará 900 euros.

. Por cada punto que saque en Estadística le dará 500 euros.

Al alumno le ha salido un curre como striper por el que le pagan a 15 euros la hora,

y no puede hacer más de 200 horas al mes sin que su abuela (católica ferviente desde que

nació) se entere y lo desherede. El alumno piensa que:

. Tiene que dormir necesariamente 8 horas diarias.

Problemas 3

. Va a dedicar, sin excusa alguna, 100 horas en chats y hackeos a los ordenadores

de varios alumnos pelotas que han subido el nivel de estudios ese año.

Sabe que para cada punto de álgebra necesitará 30 horas de estudio, y de

Estadística 20 horas.

¿Cómo distribuirá su tiempo para obtener máximo beneficio económico, si no está

realmente obligado a aprobar, puesto que un arreglo con un Vicedecano (al que pagaría

600 euros) le permite obtener el título igual ¿Cuánto dinero le queda una vez transcurridos

estos 30 dias tan apurados?

Nota: El padre le paga por la nota que saque, pero solo si aprueba. Se aprueba con nota

mayor o igual a 5. El problema es más difícil de plantear de lo habitual, pero fácil de

resolver.

8.-) Utilizando el método del simplex resolver:

Maximizar Z =x1 + 3x2

s uj e t o a

x1 ≤ 5

x1 + 2x2 ≤ 10

x2 ≤ 4

x1,x2 ≥ 0

Dibujar la región factible. Seguir gráficamente los pasos del método del simples,

interpretando el cambio de una solución factible básica a la siguiente en dicha región

factible.

9.-) Sean Y1, Y2 2 soluciones óptimas de un p.p.l en forma estándar.

Max (o Min) Z=CX

AX = b

X ≥0

Demostrar que cualquier vector de la forma Y=a1 Y1+a2Y2 con a1+a2=1, a1,a2≥0 es

también una solución óptima.

Generalización.- demostrar que, si en vez de tener 2 soluciones óptimas se tienen n, el

vector Y= a1 Y1+…+anYn con a1+a2+…+an=1, a1,a2,…,an≥0 es también una solución

óptima.

10.-) Resolver el siguiente problema utilizando el método de las penalizaciones:

MINIMIZAR Z = 2X1 - X2 + 2X3

SUJETO A

-X1 + X2 + X3 = 4

Problemas 4

- X1 + X2 - X3 ≤ 6

X1≤0, X2≥0, X3 cualquier signo

11.-) Obtener tres soluciones óptimas del siguiente problema:

Minimizar Z = 3X1+ X2+ X3 + X4

sujeto a - 2X1 + 2X2 + X3= 4

3X1 + X2+ X4 = 6

Xi≥ 0

12.-) Se ha resuelto un problema de programación lineal y se ha obtenido solución óptima

múltiple. Se tiene que Y1 = (2,3,0), y2 = (3,1,1) Y y3 = (1,2,2) son tres soluciones

óptimas. ¿Puede saberse si y4 = (2,2,1) es también una solución óptima? Justifíquese la

respuesta.

PROBLEMAS DE PROGRAMACION LINEAL AVANZADA.

1.-) Dado MINIMIZAR Z = 2x1 - x2 + 3x3

Sujeto a

X1

-2x3 ≥ 6

2x1 - x2 + 2x3 ≥ -2

x1,x3 ≥ 0, x2 cualquier signo

a) Escribir el problema dual y resolverlo gráficamente.

b) A partir de la solución dual calcular la del primal utilizando las condiciones de

holguras complementarias.

2.-) La tabla óptima de un p.p.1. de maximización con 3 restricciones del tipo ≤ y

2 incógnitas (x1 ,x2) es

Base

x3

x2

x1

Cj-

Xl

0

0

1

0

x2

0

1

0

0

x3 x4

Xs Constantes

1

1 -1

2

0

1

0

6

0

-1

1

2

0

-3 -2

Donde x3,x4,x5 son variables de holgura. Calcular el valor óptimo de la función del

Problemas 5

objetivo de 2 formas diferentes.

3.-) Sabiendo que los 2 siguientes sistemas de restricciones

i) 2x1+x2+4x3 ≤10, 3x1+2x2-x3≥1, 2x1-x2+x3≤ 5; xi≥ 0

ii) 4y1+y2+y3≥ 5, -2y1+3y2-2y3≤ 1, -y1+2y2+y3≤ 1, yi≥ 0

son los conjuntos de restricciones de un problema de p.l. y de su dual,

respectivamente (las restricciones no están ordenadas), determinar cuáles de las

siguientes parejas de soluciones dadas por las ternas (x1,x2,x3) e (y1,y2,y3)

pueden ser soluciones óptimas de los correspondientes p.p.l, justificando la

respuesta.

a)

b)

c)

d)

(1,1,1)

(1,0,2)

(1,0,2)

(1,2,0)

y

y

y

y

(1,1,0)

(1,1,0)

(0,2,1)

(0,2,1)

4-) Dado el p.p.l

Max Z= 15x1 + 25x2 + 10x3

Sujeto a

-6x2+3x3≥ 12

3x1+12x2+6x3=30

xi≥ 0

a) resolver el problema dual gráficamente

b) a partir de la solución óptima del problema dual, calcular la solución óptima

del primal utilizando las condiciones de holgura complementarias

5.-) Comprobar, utilizando el método del simplex dual, que el siguiente problema no

tiene solución:

MAXIMIZAR Z= -4X1 – 3X2

Sujeto a

X1 + x2 <=1;

-x2 <=-1;

-x1+2x2<=1;

x1,x2>=0

6.-) Resolver el siguiente p.p.l., utilizando el método dual del simplex:

Min Z =40x1+36x2

Sujeto a x1<=8

X2 <=10

Problemas 6

5x1+3x2>=45

x1,x2 >=0 y enteros

7.-) Considérese el problema

maximizar Z= 5x1 – 6x2 –6x3

sujeto a

x1+5x2 + 2x3 <= b1

x1 – x2 - x3 <= b2

xi>=0

para unos valores específicos de b1 y b2 la solución óptima es:

Base

X1

X4

cj

X1

1

0

0

X2

b

c

a

X3

-1

3

-1

X4

0

1

d

X5

1

-1

e

ctes

30

10

Z=150

Calcular

a) Los valores de b1 y b2 que proporcionan la solución óptima especificada

b) los valores de a, b y c en la tabla óptima

c) si se requiriera aumentar Z0 óptimo, ¿debería aumentarse b1 ó b2 y en cuánto?

d) Supongamos que la función objetivo del problema anterior se cambia a minimizar,

esto es, queda Min Z=5x1 – 6x2 –6x3. Obtener la nueva solución óptima y el nuevo Z

óptimo a partir de la solución óptima inicial, sin resolver el problema otra vez

8.-) Una banda de “querubines del purgatorio” posee un laboratorio clandestino en el que

fabrican 3 tipos diferentes de droga: “Peleona” (P), “Juliana” (J) y “Marijuana” (M). Para la

fabricación son necesarios, además de pastillas sedantes, pegamento y caldo avecrem

–para los cuales no hay limitación de disponibilidad-, crack y cocaína, que limitan la

cantidad diaria de producción. La siguiente tabla nos da la cantidad necesaria de estos 2

últimos recursos para producir 1 kg de cada una de las distintas drogas, los kg disponibles

de cada recurso, y el beneficio por kg de droga producida

Crack

Cocaína

Beneficio (en

millones de

euros)

P

2

1

4

J

1

2

7

M

2

2

3

disponibilidad

30

45

El jefe de la banda es un experto en IO, y calcula la producción óptima mediante la

programación lineal. Obtiene que, como más dinero ganarán será fabricando 5 kg de

droga P, 20 de J y no fabricando la M.

Problemas 7

Responder:

a) ¿Por qué no sale rentable fabricar la droga Marijuana? ¿Qué debería ocurrir para

que sí se fabricase?

b) Resulta que, por cada kg de crack que sobre, hay un millonario colgado que se lo

compra, pagándolo a 2 millones el kg. ¿Sigue siendo la solución inicial la óptima?

c) La policía ha incautado en el puerto un alijo de crack procedente de Nueva Zelanda.

Un policía corrupto le vende a la banda 6 kg a cambio de 5 millones. ¿Les compensa

comprárselos?

d) Un robo salvaje a una banda rival les proporciona nada menos que 63 kg más de

crack. Lógicamente, ahora la solución inicial no puede seguir siendo la óptima.

Calcular la nueva.

e) Gracias a una nueva formula robada en el Monsergas, no es necesario utilizar

cocaína para fabricar la droga M.¿Cuánto dinero ganará la banda con esta nueva

fórmula?

f) Se introduce en el plan de producción la posibilidad de añadir tomate, de forma que

la fabricación de 1 kg de droga P requiere 3 kg de tomate, 1 kg de J requiere 1 kg

de tomate, y 1 kg de M requiere también 1 kg de tomate. Se tienen 30 kg de

tomate. ¿Cómo varía la solución óptima? Si es el caso, calcular la nueva

g) A la chorba del jefe se le ocurre fabricar un nuevo tipo de droga que coloque más

rapidamente (Veloz), que requiere 1 kg de crack y 1 kg de cocaína por kg fabricado,

y supone que les reportará 5 millones de euros por kg. Ella dice que la fabricación

de esta droga les hará ganar más dinero. ¿Es cierto lo que piensan los de la banda

acerca de que el jefe es un calzonazos, y que su novia está equivocada? ¿Cuánto

ganan o pierden con esta idea?

9.-) Una empresa fabrica los productos A, B y C, para lo que son necesarios recursos de

trabajo y material. Se quiere determinar la producción que maximiza la ganancia. Para

ello se plantea el siguiente p.p.l.

Maximizar Z= 3x1 + x2 + 5x3

Sujeto a

6x1 + 3x2 + 5x3 <= 45 (trabajo)

3x1 + 4x2 + 5x3 <= 30 (material)

xi>=0

y se obtiene la siguiente solución óptima x1=5, x3=3, x2=0.

Utilizando el análisis de sensibilidad, responder a las siguientes cuestiones

a) calcular el campo de variación de c1 que mantiene esta solución óptima, y calcular

la solución óptima para c1=2

b) disponemos de 6 unidades adicionales de material a un coste de 10 (en total). ¿Es

rentable adquirirlas?

c) Encontrar la solución óptima cuando el material disponible es de 60 unidades.

d) Si el material que se necesita para el producto B fuese de 2 unidades, ¿afectaría a

la solución óptima?

e) Se añade al problema una condición de control 2x1+x2+3x3<=20. ¿Cómo afecta

esto a las soluciones primal y dual?

10.-) La siguiente tabla da una solución óptima a un p.p.l estándar donde suponemos que

x4 y x5 forman la base inicial (son variables de holgura)

Problemas 8

Base

X1

X2

cj

X1

1

0

0

X2

0

1

0

X3

-1

2

-3

X4

3

-1

-3

X5

-1

1

-1

ctes

1

2

a) calcular el campo de variación de λ para que la solución actual siga siendo óptima si el

vector original b de constantes de la derecha es reemplazado por b+λb*, con

b*=(1,-1). Encontrar la solución óptima para λ=1/2

b) calcular la solución óptima si se añade la nueva restricción x1 + x3>=2 al problema

original.

c) calcular los precios sombra de las restricciones.

11.-) Dado el p.p.l. paramétrico siguiente

Maximizar Z = (4-λ)x1 + (3-2λ)x2 + (6-λ)x3

Sujeto a

3x1 + x2 + 3x3 <=30

2x1 + 2x2 + 3x3 <= 40

xi>=0

calcular la solución óptima y el valor de λ que daría un beneficio óptimo de 62.

12.-) Resolver el siguiente p.p.l. entera, usando el algoritmo de ramificación y acotación

Min Z =10x1+9x2

Sujeto a x1<=8

X2 <=10

5x1+3x2>=45

x1,x2 >=0 y enteros

PROBLEMAS DE TRANSPORTE

1.-) Una compañía de conservas tiene 2 plantas de producción. Tres cultivadores le surten

de fruta fresca en las siguientes cantidades

Felipe: 200 toneladas a 10.000 unidad

Carrascal: 300 toneladas a 9000 unidad

Problemas 9

Andrés: 400 toneladas a 8000 unidad

Los costes de transporte en miles de euros por tonelada son

Hacia

Desde

Planta A

Planta B

Felipe

2

2.5

Carrascal

1

1.5

Andrés

5

3

Las capacidades de las plantas y los costes de producción son:

Planta A: Capacidad 450 toneladas a 25000 euros la tonelada

Planta B: Capacidad 550 toneladas a 20000 euros la tonelada

La fruta en conserva se vende a 50000 la tonelada. La compañía puede vender a

este precio todo lo que produce. ¿Qué cantidad se deberá enviar desde cada cultivador a

cada planta de manera que la compañía obtenga el máximo beneficio?

Plantearlo como un problema de transporte y resolverlo.

2.-) Se pretende distribuir a los estudiantes de tres barrios de una ciudad (A,B,C) entre 4

colegios (E,O,N,S). Hay 50 estudiantes en cada barrio y los colegios admiten 20,40,30 y

60 estudiantes, respectivamente. El coste de tranporte en autobús viene dado en la

siguiente tabla

BARRIOS

A

B

C

E

7

9

8

COLEGIOS

O

6

7

8

N

5

3

7

S

4

6

3

La delegación de educación desea planificar la distribución de los estudiantes minimizando

el coste del transporte.

a) calcular la solución óptima a partir de una solución inicial calculada por el método

del coste mínimo.

b) Debido a un rodeo que hay que dar por obras para llegar a la escuela E, el coste del

transporte desde cada barrio hasta dicha escuela se incrementa una unidad.

Explicar cómo modificará este hecho la solución óptima obtenida en el apartado

anterior.

3.-) Desde 3 pantanos se envía agua a 4 ciudades. La capacidad de los pantanos es de 15,

20 y 25 millones de litros diarios. Las demandas de las ciudades es de 8, 10, 12 y 15. El

coste de bombeo por millón de litros está dado en la siguiente tabla:

Problemas 10

PANTANO

CIUDAD

B

3

2

1

A

2

3

4

1

2

3

C

4

5

2

D

5

2

3

Utilizando el algoritmo del transporte, planificar los envíos de agua a las ciudades con el

mínimo coste.

4.-) Un problema de transporte se caracteriza por la siguiente matriz

D1

D2

D3

D4

D5

Existencias

14

16

17

12

18

120

18

12

21

16

22

190

20

15

19

18

19

60

17

13

25

20

21

160

80

100

120

110

60

En donde cada uno de los números de la matriz denota el coste unitario de transporte del

origen al destino correspondiente y los restantes números las existencias y las demandas.

Plantear la tabla de transporte con la que empezar a resolver el problema (No

resolverlo), teniendo en cuenta que no se pueden transportar más de 70 unidades desde

O1 hasta D4.

01

02

03

04

PROBLEMAS DE ASIGNACIÓN

1.-) Una escuela de Ingeniería decide realizar seminarios sobre 4 temas de actualidad.

Estos seminarios se realizarán una vez por semana. Al planificarlos, se ha procurado que

el número de estudiantes que no pueda asistir a un seminario sea mínimo. Un cuidadoso

estudio indica que el número de estudiantes que no pueden asistir a un seminario

particular un día específico es el siguiente

Lunes

Martes

Miércoles

Jueves

Viernes

Ecología

50

40

60

30

10

Energía

40

30

20

30

20

Transporte

60

40

30

30

10

Bioingeniería

20

30

20

30

30

Obtener la planificación óptima de los seminarios.

2.-) Para realizar 4 tareas (A,B,C,D), un empresario dispone de 3 empleados, cada uno de

los cuales cobra las siguientes cantidades por realizar cada tarea.

Problemas 11

1

2

3

A

10

14

18

B

12

18

15

C

8

16

16

D

15

12

14

Para poder realizar las cuatro tareas, el empresario puede optar entre: a) contratar a un

nuevo empleado, que cobraría 20 por realizar cualquier tarea, o b) que uno de sus

empleados realice 2 tareas, una de ellas en horas extraordinarias, de forma que tendría

que pagarle un 20 por ciento más que si la realizara en horario normal.

Determinar cuál de las 2 opciones es más ventajosa para el empresario, y

determinar la asignación de los empleados a las tareas, de forma que el coste total sea

mínimo.

3.-) Un millonario tiene 4 hijas muy feas, que no logran conseguir marido. Después de

muchos avatares, consigue convencer a 4 incautos, sobornándoles de acuerdo a los

gustos de cada uno, para que se casen con ellas. La cantidad de millones que tendrá que

pagar a los interesados amantes según con quien elijan casarse viene dado en la siguiente

tabla

Torrente

Rodríguez

Carpintero

Felipe Lotas

Bartol O. Me

Hija 1

2

10

Hija 2

3.5

22

Hija 3

5

34

Hija 4

6.5

46

8

0

14

6

20

12

26

18

Decidir los emparejamientos que comporten el menor gasto para el sufrido padre

Problemas 12

Referencia Histórica de la Investigación Operativa

Suele ser difícil hacer una referencia histórica de la Investigación Operativa.

Principalmente, porque no es sencillo establecer sus orígenes. Son muchas las áreas que

componen la Investigación Operativa, y hasta que apareció un elemento aglutinador en

los años 40 del siglo XX, cada una tuvo su propia referencia histórica, haciendo muy

difícil establecer la fecha exacta del nacimiento de la Investigación Operativa.

La necesidad de tomar decisiones es tan antigua como el hombre mismo, por

ello, hemos de preguntarnos por qué la Investigación Operativa nace en un momento

histórico preciso. Esto fue así, porque la realidad humana se fue complicando poco a

poco y las decisiones que en un principio eran triviales, se convirtieron en decisiones

difíciles. Con la llegada de la Revolución Industrial, la sociedad se hizo mucho más

compleja y las decisiones habían de tomarse con más cuidado porque involucraban a

más personas en sus consecuencias. Veamos a continuación lo que esto supuso

históricamente.

Proceso Introductorio

Las diferentes ciencias han de ser comprendidas con profundidad antes de poder ser

analizadas desde un punto de vista histórico. Quizás no sea fácil establecer los orígenes

de la Investigación Operativa, porque no se tuvo conciencia de la misma hasta mucho

más tarde de que algunas de sus ramas nacieran y se desarrollaran. No obstante, es

necesario relacionar el alumbramiento de la Investigación de Operaciones, por lo menos

nominalmente, con el transcurso de la II Guerra Mundial. Por esta razón, hemos de

pensar en los orígenes de la ciencia operacional como en los de una técnica de

naturaleza militar.

Dichos orígenes han supuesto una impronta decisiva en el tratamiento de las técnicas

operacionales. En este sentido, cuando se pretende trazar una historiografía de una

ciencia es muy importante delimitar la frontera de la misma en los terrenos conceptual e

histórico.

Prolegómenos y rudimentos de la Investigación Operativa: la

ciencia de la gestión

La gestión y la organización han sido necesarias para la humanidad desde sus albores.

La necesidad de planificación y organización aparece ya en el antiguo Egipto hacia el

año 4.000 a.C. y se va desarrollando a través de toda la Antigüedad hasta el

advenimiento del Imperio Romano. En Israel y China también aparecen tímidos

escarceos de organización y dirección hacia el año 1.000 a.C. Nabucodonosor establece

algunas ideas sobre control de la producción hacia el año 600 a.C. En Grecia, se

desarrollan en el 350 a.C. los primeros métodos de organización del trabajo y del

tiempo. Alrededor del año 30 a.C., Julio César establece diversas ideas de planificación,

control y unidad de mando, que luego pone en práctica en todo el Imperio Romano.

Todos los estudios y planteamientos organizacionales de la Antigüedad tienen su

proyección, que no su continuación, a lo largo de toda la Edad Media, en donde se

aprovechan sin posteriores desarrollos. Durante el siglo XV, en la Italia renacentista se

Historia

1

vuelven a plantear de nuevo las cuestiones organizativas y aparecen diversos estudios

sobre costes y sobre control de existencias.

No es fácil establecer otros hitos acerca de la organización hasta el siglo XVIII, cuando

Pierre de Montmort inicia sus primeras ideas directivas que luego dan lugar a la teoría

de juegos.

Con los inicios de la I Revolución Industrial, el sentido y la forma de estudio de la

Ciencia de la Gestión adquieren su ser más pleno. Por otra parte, el desarrollo de las

matemáticas durante los siglos XVIII y XIX permite disponer de las herramientas

necesarias para la futura construcción de la Investigación de Operaciones. De esta

forma, en 1767, Gaspard Monge descubre la manera geométrica de resolver un

programa lineal. Posteriormente, Adam Smith establece el principio de especialización

en los trabajos, y Robert Owen, ya en el siglo XIX, realiza un estudio sobre tareas en un

proceso productivo, y advierte de la necesidad de adiestramiento en las mismas por

parte de los operarios. Una aportación fundamental la realiza Babbage, en 1832,

construyendo lo que se podría llamar el primer computador digital, que vendría a ser el

antecesor de los modernos ordenadores. A finales del siglo XIX, Joseph Wharton hace

de la dirección estratégica e industrial un saber universitario. No obstante, el auge de las

revoluciones industriales del XIX permiten establecer un caldo de cultivo adecuado para

el estudio de la ciencia operacional. Así, Frederick W. Taylor y Henry L. Gantt, ante la

necesidad de planificación de la producción, establecen el método científico de

dirección y las gráficas de programación productiva (de Gantt), respectivamente. A

partir de este momento aparece la aportación nuclear del siglo XX a la Investigación de

Operaciones, sabiendo que es en esta centuria cuando se produce su nacimiento real.

Génesis de la Investigación Operativa en el siglo XX

Entre otros hechos que ayudaron a construir lo que se llamaría “investigación de

operaciones” o “investigación operativa” citaremos: a) los rudimentos de la teoría de

colas, con A.K. Erlang, y b) la construcción del modelo económico del tamaño del lote,

con F.W. Harris. Sin embargo, estos hitos que luego constituyeron elementos clave de la

Investigación Operativa, no permitieron establecer la misma como un saber

independiente.

Es hacia 1935 cuando Inglaterra se da cuenta de que necesita dar una respuesta

adecuada al creciente poderío militar alemán. Por esta razón, el gobierno inglés urge a

un grupo de científicos a que realicen experimentos que conduzcan a un mejor control

del espacio aéreo. Fruto de esta experimentación aparece el radar, que constituye el

inicio de la lucha por la supremacía aérea. Este grupo de investigadores tomó su base en

Bawdsey, y por esta razón se llamó grupo de Bawdsey.

De forma paralela, se estableció otro grupo durante 1936 para desarrollar el

experimento Biggin Hill, que permitía la simulación de aviones enemigos y su

detección. La conjunción de estos dos grupos, permitió ofrecer a la RAF (Royal Air

Force) una estructura operacional, para sus equipos materiales y humanos, que le

posibilitó librar la batalla de Inglaterra en 1940-41. El grupo de Bawdsey fue dirigido en

1938 por A.P. Rowe, el cual acuñó la expresión 'Operations Research', que

posteriormente se extendió dentro del ámbito científico al resto de países occidentales.

Historia

2

La batalla de Inglaterra se recrudece en el otoño de 1940. Por esta razón, se

solicita la ayuda de P.M.S. Blackett, un físico que después conseguirá el Premio Nobel

por sus trabajos en rayos cósmicos, con objeto de establecer una sección de

Investigación Operativa dentro de los comandos de acción de la RAF. Del mismo modo,

Blackett fue consultado en diciembre de 1941, sobre la posibilidad de constituir una

sección similar dentro de la Armada. Dicha sección fue constituida en enero de 1942.

Los dos primero miembros del grupo eran fisiólogos, otros dos eran físicosmatemáticos, un astrofísico, un oficial del Ejército y un ex-topógrafo. El equipo se

completó más tarde con un tercer fisiólogo, un físico general y dos matemáticos. Se les

conoció como el “ Circo de Blackett “, Es evidente que en este grupo de 11 científicos

se tenía una amplia gama de disciplinas. El grupo creció y luego se dividió en dos, uno

del Ejército y otro de la Marina, con lo cual, las fuerzas militares de la Gran Bretaña

tuvieron todas un grupo de investigación de operaciones encargado de la investigación

militar.

Cuando los Estados Unidos entran en la guerra, son conscientes de la necesidad

de tales grupos operativos y de la constitución de secciones operacionales para el éxito

de los mismos. De esta manera, constituyen en 1942 un grupo operacional de lucha

antisubmarina (ASWORG - Anti-Submarine Warfare Operations Research Group) que

recoge toda la experiencia inglesa desarrollada por Blackett. De forma similar, la Fuerza

Aérea Americana estructura diversos grupos operacionales para llevar a cabo sus

labores logísticas. Al final de la guerra, la Armada americana disponía de un

departamento de Investigación Operativa compuesto por más de setenta científicos, y la

Fuerza Aérea disponía de más de dos docenas de secciones operacionales.

No puede decirse que las potencias del Eje hicieran uso de las técnicas

operacionales durante la II Guerra Mundial, mientras que el número de científicos e

investigadores involucrados en Investigación Operativa en la contienda por parte de

ingleses, americanos y canadienses superó los setecientos. Las aportaciones que

hicieron todos estos investigadores supusieron un giro copernicano en la manera de

concebir la Ciencia de la Gestión en los años siguientes. De alguna manera, todos estos

estudiosos que trabajaban de manera aislada en los años treinta se aglutinaron

holísticamente con ocasión de la guerra, y produjeron un conjunto de técnicas y teorías

que ocasionaron el alumbramiento de la Investigación de Operaciones como ciencia.

Investigaciones sobresalientes durante la segunda guerra mundial:

El sónar

("Sound navigation ranging") Técnica para detectar y determinar la distancia y

dirección de objetos bajo el agua mediante señales acústicas. Las ondas sonoras

emitidas por o reflejadas desde el objeto son detectadas por el aparato de sónar y

analizadas para extraer la información.

Historia

3

El sónar se propuso en un primer momento para la detección de icebergs. El

interés en el sónar aumentó con su aplicación en los submarinos de la primera guerra

mundial. En el campo militar hay un largo número de sistemas que detectan, identifican

y localizan submarinos. El sónar se usa también para la detección de minas, torpedos.

Usos no militares son búsqueda de peces, mapeado del fondo del mar y localización

acústica de barcos.

El descifrado de códigos emitidos por la máquina cifradora Enigma.

(referencia: “códigos secretos” de Simon Singh)

Historia

4

Historia

5

Bletchley Park es el nombre de una instalación militar localizada en Buckinghamshire, Inglaterra en la

que se realizaron los trabajos de descifrado de códigos alemanes durante la Segunda Guerra Mundial.

Recibe su nombre de la mansión victoriana que domina el enclave. La primera computadora Colossus fue

diseñada y construida en Bletchley Park permitiendo romper los códigos de la máquina alemana Enigma.

Existía un centro, en otro pueblo, dónde interceptaban las señales de radio de los

alemanes, con multitud de antenas para la intercepción. Posteriormente se hacían 2

copias; una se quedaba en este centro y la otra se enviaba a Bletchley para su

descifrado. Ahí el trabajo se dividía en la que se denominaban cabañas, con numeración

para cada una de ellas, cabaña 1, cabaña 2,...Dentro de las cabañas se dividían en

sectores, y los sectores en secciones. El personal era civil y era reclutado en función de

sus aptitudes para cada una de las secciones, sectores y cabaña correspondiente, yendo

de la gente de la cabaña 8 con gente que se dedicaba a descifrar los mensajes alemanes

con analistas en criptografía, que provenían de distintas nacionalidades y también de

distintas disciplinas como matemáticos, físicos, ... , como también ocurre en

Investigación de Operaciones que está integrada por distintas disciplinas; mientras que

la cabaña 2 se dedicaba únicamente a pasar los textos y a archivar información, con

personal mayoritariamente femenino, aún pudiendo tener aptitudes para estar en cabaña

8 pero por ser mujeres se las relegaba a puestos administrativos.

El director de la sección naval enigma era Alan Turing.

Historia

6

Después de la guerra, su carrera profesional de Turing se vio truncada cuando

lo procesaron por su homosexualidad. En 1952 Arnold Murray, el amante de Turing,

ayudó a un cómplice a entrar en la casa de Turing para robarle. Turing acudió a la

policía a denunciar el delito. Como resultado de la investigación policial, Turing fue

acusado de mantener una relación sexual con un varón de 19 años y se le imputaron los

cargos de "indecencia grave y perversión sexual". Convencido de que no tenía de qué

disculparse, no se defendió de los cargos y fue condenado. Según su ampliamente

difundido proceso judicial, se le dio la opción de ir a prisión o de someterse a un

tratamiento hormonal de reducción de la libido. Finalmente escogió las inyecciones de

estrógenos, que duraron un año y le produjeron importantes alteraciones físicas, como la

aparición de pechos o un apreciable aumento de peso, y que además le convirtieron en

impotente. Dos años después del juicio, en 1954, murió por envenenamiento con

cianuro, aparentemente tras comerse una manzana envenenada que no llegó a ingerir

completamente. La mayoría piensa que su muerte fue intencionada y se la consideró

oficialmente como un suicidio

Gordon Brown se disculpa ante Alan Turing

Publicado el 11-9-2009 a las 08:48 por

F. Figueroa Fagandini

Estatua conmemorativa de Alan Turing en Sackville Park (cc) Wikimedia Commons

El sitio Number 10 es, según ellos mismos dicen, el sitio oficial del Primer Ministro del Reino Unido.

No el sitio de Gordon Brown sino el de todos los primeros ministros que han habitado la casa que

está en Downing Street número 10 desde 1721. A través de ese canal, la gente puede entre otras

cosas enviar peticiones, y la más bullada del último tiempo fue la exigencia, 55 años después de

su muerte, de disculpas públicas para Alan Turing.

Historia

7

Este señor, para los que no lo sepan, trabajó con el gobierno británico durante la segunda guerra

mundial desencriptando códigos interceptados a la Alemania nazi, una tarea a través de la cual

desarrolló gran parte de lo que hoy conocemos como ciencias de la computación. Estableció las

bases para distintas líneas de estudio que hoy son nuestra fuente de trabajo: la cibernética, la

inteligencia artificial, el concepto de algoritmo y diagrama de flujo para ejecución de programas y

la Tésis de Church-Turing que a su modo es la piedra pilar de la computación actual.

Alan Turing tuvo un final muy triste, luego de que reconociera abiertamente su homosexualidad -a

la sazón un delito en el Reino Unido- y fuera condenado a la castración química, una circunstancia

que lo llevó al suicidio un par de años más tarde.

Ayer, Gordon Brown emitió un comunicado reconociendo que el trato recibido por Alan Turing fue

inaceptable. En un extenso comunicado recorre someramente los méritos de Turing para cerrar

diciendo: “Lo siento Alan Turing, merecías algo mucho mejor”.

Link: Treatment of Alan Turing was “appalling” - PM (Number10)

Historia

8

El Proyecto Manhattan

El 6 de diciembre de 1941, un día antes del ataque japonés a Pearl Harbor,

Vannevar Bush, jefe del Departamento de Investigación y Desarrollo Científico de

Estados Unidos, lograba la aprobación presidencial de un plan de acción total en el

ámbito de la investigación atómica. En 1942, el primer ministro británico W. Churchill

y el presidente norteamericano F. D. Roosevelt acordaron concentrar en el territorio

estadounidense los equipos científicos de ambos países que ya trabajaban en la bomba.

La dirección general del llamado Proyecto Manhattan recayó en el Comité Militar

Político, compuesto por tres militares, los generales Styer, Groves, y el almirante

Purnell, y por dos civiles, V. Bush y J. B. Conant. Vannevar Bush, ingeniero

electricista, había sido vicepresidente del Massachusetts Institute of Technology, y

James B. Conant, químico orgánico, había sido presidente de la Universidad de

Harvard.

Cerca de 150 000 personas llegaron a participar en el Proyecto, la mayoría de

ellas sin saber cuál era su objetivo. No más de una docena de individuos tenía una

visión global de la empresa. Los científicos que accedieron a entregarse totalmente a la

construcción de un arma nuclear lo hicieron convencidos de la necesidad de contar con

tal recurso si es que Hitler también lo obtenía. Muchos opinaban que, una vez logrado

un equilibrio entre ambos bandos en guerra, se debería renunciar al uso del artefacto. La

existencia de una bomba alemana era una idea siempre presente en sus mentes, hasta el

punto de referirse a ella como si fuese una realidad.

El 17 de septiembre de 1942, el general Leslie Richard Groves fue nombrado

jefe del supersecreto y superprioritario Proyecto Manhattan. Se construyeron tres

ciudades para realizar los diferentes trabajos:

-

Oak Ridge en el estado de Tennessee, donde se trabajaba en la separación

del uranio para obtener el isótopo fisionable 235.

Hanford en el estado de Washington, donde se producía otro isótopo

fisionable, el plutonio 239.

Los Álamos en Nuevo México, donde se diseñaban y fabricarían las

primeras tres bombas.

Muy importante para estos proyectos fue la labor dirigida por Fermi en el

Laboratorio Metalúrgico de la Universidad de Chicago, que culminó con la puesta en

marcha en diciembre de 1942 del primer reactor nuclear. Inmediatamente después de

este logro, el gobierno norteamericano destinó 400 millones de dólares al Proyecto

Manhattan. Los costos totales se estiman en unos 3 000 millones de dólares.

Historia

9

Fermi

Einstein,

Historia

10

Oppenheimer

Niels Bohr y Albert Einstein debatiendo la teoría cuántica en casa de Paul Ehrenfest en Leiden

(deciembre de 1925).

El crecimiento de la Investigación Operativa, de 1945 a la actualidad

Es muy difícil condensar en unas líneas todo lo que han supuesto las décadas

anteriormente mencionadas para la ciencia operacional, habida cuenta de su importancia

y de la riqueza de trabajos producidos. Realmente, se ha construido más ciencia

operacional

durante

estos

Historia

11

años que en todo el resto de la historia de la humanidad. Puede decirse, por tanto, que la

verdadera historia de la Investigación Operativa se ha desarrollado durante este período:

se han establecido líneas de investigación, han aparecido sociedades profesionales, se

han creado revistas de investigación, se han publicado libros y se ha incluido la materia

dentro del currículum educativo.

Una vez finalizó la segunda guerra mundial y habida cuenta del éxito cosechado

por las técnicas operativas, éstas continuaron desarrollándose dentro del ámbito militar,

puesto que era el ejército quien poseía la mayor parte de los investigadores y quien

estaba interesado en proseguir dicha línea de trabajo. A mediados de los años cincuenta

se desplazó el centro de gravedad de interés de la Investigación Operativa, y alcanzó el

terreno industrial y el académico. Aparece el interés por la Ciencia de la Gestión

(Management Science). En la década de los setenta, ha continuado el desarrollo

expansivo de la Investigación Operativa, llegando al ámbito de la administración

pública, tratando los siguientes tipos de problemas: transporte urbano, administración de

justicia, construcción de edificios públicos, educación, hospitales y servicios sociales.

De esta manera, el peso investigador de la Investigación Operativa se desplaza desde el

Reino Unido a los Estados Unidos, en donde se constituyen diversos institutos y

organizaciones de estudio, como The Urban Institute (1968) y The New York CityRand Institute (1969). También, son muchas las empresas que, a partir de los años

cincuenta, se ayudan de técnicas operativas para diseñar sus políticas de producción y

de distribución.

Por ejemplo, a partir de una encuesta que realiza Turban en 1972 en Estados

Unidos sobre las 500 empresas más importantes del país (de acuerdo con la revista

Fortune), se deduce que la mitad de las empresas que contestaron la encuesta poseían un

departamento especial dedicado a tareas de Investigación de Operaciones o Ciencia de

la Administración. No obstante, la Investigación Operativa forma cada día más, una

parte de las actividades normales de la empresa moderna y, por tanto, ya no se trata de

una función especializada que deba llevarse a cabo en un departamento separado. De

acuerdo con este estudio las técnicas operacionales más empleadas eran el análisis

estadístico, la simulación, la programación lineal, la teoría de inventarios y la

programación dinámica. Otras técnicas empleadas, aunque de menor uso, eran la

programación no lineal, las líneas de espera, la teoría de juegos, el análisis de decisión

de Bayes y la programación entera.

Posteriormente, se realizaron otras encuestas de resultados similares: a) en 1977,

Leadbetter y Cox (1977); b) en 1979, Thomas y DaCosta (1979); c) en 1983, Forgionne

(1983). En todas ellas se comprueba cómo cada vez son mayores en número las técnicas

operativas empleadas, y cómo dichas técnicas aparecen con más frecuencia en otras

áreas o departamentos de la empresa. Estudios de otro tipo fueron los de Fabozzi y

Valente (1976) que encuestaron, en 1976, mil compañías americanas en relación con el

uso de la programación matemática (programación lineal, no lineal y dinámica). Estos

autores descubrieron que era la dirección de Producción (mezclas de productos,

asignación de recursos, diseño de planta y maquinaria,...) el área en donde más se

aplicaba la Investigación de Operaciones dentro del ámbito de la empresa. En número

de aplicaciones le seguía el área de Inversión y Financiación.

Especificaciones y concreciones históricas de la Investigación Operativa: la

programación matemática

Historia

12

La Programación Matemática ha formado parte de la Investigación Operativa

desde la constitución de la misma como ciencia hasta la actualidad. Sin embargo,

muchos de los problemas tratados por la Programación Matemática eran conocidos

desde mucho antes. Grandes matemáticos de los siglos XVIII y XIX, como Euler,

Gauss y Lagrange trabajaron en problemas de optimización con restricciones y

establecieron las primeras condiciones de optimalidad. Lo cual quiere decir que los

problemas que la Programación Matemática planteaba en los años cuarenta de nuestro

siglo no eran nuevos en su formulación, pero sí en su enfoque. Los métodos

matemáticos clásicos no estaban pensados para una resolución en dimensiones altas,

como iban a requerir las nuevas necesidades industriales. Esta fue la aportación de la

ciencia operacional, máxime cuando se desarrollaron las técnicas computacionales que

permitieron hacer realidad el cálculo rápido y a gran escala. La Investigación Operativa

supuso un giro copernicano en la manera de tratar los programas matemáticos. Se

implementaron algoritmos que computacionalmente eran más eficientes que los clásicos

y, de esta manera, problemas que tradicionalmente habían sido complejos, ahora

resultaron asequibles.

El cambio de mentalidad era notable y, por tanto, un nuevo modelo científico se

estaba abriendo paso. Para el desarrollo de las distintas técnicas algorítmicas, era básico

el estudio de los sistemas de desigualdad como habían hecho los matemáticos Julius

Farkas, Jean Baptiste Fourier y T.S. Motzkin. El análisis de los problemas económicos

se debe a John Von Neumann y a Abraham Wald. No obstante, cuando se trata de

presentar una descripción histórica de la Programación Matemática, hay que tener en

cuenta la gran aportación de Dantzig con su método simplex para programación lineal.

Este hito ha supuesto la demarcación de la época fundacional de la Programación

Matemática. Dicho evento se ha considerado como el inicio de la Investigación

Operativa, puesto que lo ha sido de la programación lineal, y ha traído consigo la

resolución de muchos problemas operacionales.

George Bernard Dantzig nació en 1914 y murió en 2005. Su padre era profesor de Matemáticas, se retiró dejando su

puesto de Jefe del Departamento de Matemáticas en la Universidad de Maryland poco después de la Segunda Guerra

Mundial. Su madre era una lingüista especializada en idiomas eslavos. Dantzig estudió su carrera en la Universidad de

Maryland, donde se graduó en 1936. Le disgustaba el hecho de no haber visto "ni una sola aplicación en alguno de los

cursos de Matemáticas que había tomado en Maryland". Al año siguiente hizo estudios de posgrado en la escuela de

Matemáticas de la Universidad de Michigan. Sin embargo, exceptuando la Estadística, le pareció que los cursos eran

demasiado abstractos; "tan abstractos, que él sólo deseaba una cosa: abandonar sus estudios de posgrado y conseguir

Historia

13

un trabajo".

En 1937 Dantzig dejó Michigan para trabajar como empleado en Estadística en el Bureau of Labor Statistics. Dos años

después se inscribía en Berkeley para estudiar un Doctorado en Estadística.

La historia de la tesis doctoral de Dantzig es ahora parte del anecdotario de las Matemáticas. Durante su primer año en

Berkeley, llevó un curso de Estadística con el famoso Jerzy Neymann. En una ocasión llegó tarde a una de las clases de

Neymann. En la pizarra estaban escritos dos problemas que él supuso eran problemas de tarea. Dantzig,

consecuentemente, los copió y los resolvió, aun cuando le parecieron "un poco más difíciles que los problemas

ordinarios". Unos días después se los entregó a Neymann, disculpándose por haber llegado tarde.

Aproximadamente seis semanas después -a las 8:00 de un domingo por la mañana-, Neymann llegó aporreando la puerta

de Dantzig, explicándole que había escrito una introducción a uno de los artículos de Dantzig y que quería que la leyera a

fin de poder enviar el artículo para su publicación. Los dos "problemas de tarea" que Dantzig había resuelto eran, en

realidad, dos famosos problemas no resueltos de la Estadística. Las soluciones de estos problemas se convirtieron en su

tesis doctoral, a sugerencia de Neymann.

NOTA: Parece ser que esta anécdota inspiró escenas de la película que lanzó a la fama a Matt Damon “El indomable Will

Hunting”. Lo que el propio Dantzig reveló es que se trata de una leyenda urbana, pues dista mucho de la realidad.

Poco después del comienzo de la Segunda Guerra Mundial se unió a la Fuerza Aérea de Estados Unidos y trabajó con el

Combat Analysis Branch of Statistical Control. En 1946, Después de recibir su Doctorado, regresó a la Fuerza Aérea como

el asesor de Matemáticas del U. S. Air Force Controller. Fué en ese trabajo donde encontró los problemas que le llevaron

a hacer sus grandes descubrimientos. La Fuerza Aérea necesitaba una forma más rápida de calcular el tiempo de duración

de las etapas de un programa de despliegue, entrenamiento y suministro logístico.

El trabajo de Dantzig generalizó lo hecho por el economista, ganador del Premio Nobel, Wassily Leontief. Dantzig pronto

se dio cuenta de que los problemas de planeación con los que se encontraba eran demasiado complejos para las

computadoras más veloces de 1947 (y aun para las de la actualidad). La siguiente es la explicación de Dantzig acerca de

las dificultades que tuvo que encarar: "Un ejemplo sencillo ilustra la dificultad fundamental de formular un problema de

planeación utilizando un enfoque de análisis de actividades. Considere el problema de asignar 70 hombres a 70 empleos.

Una "actividad" consiste en asignar el iésimo hombre al jésimo empleo. Las restricciones son dos: en primer lugar hay 70

hombres, cada uno de los cuales debe asignarse a un puesto y en segundo lugar, cada uno de los 70 puestos existentes

debe estar ocupado. El nivel de una actividad puede ser 1, lo cual indica que está siendo usada, o 0, lo cual significa que

no. En consecuencia hay 2 x 70 = 140 restricciones y 70 x 70 = 4900 actividades con 4900 variables correspondientes de

decisión uno-cero. Por desgracia también hay factorial de 70 permutaciones o formas de hacer las asignaciones. El

problema consiste en comparar el factorial de las 70 formas y elegir la que sea la óptima o "mejor" según algún criterio

Historia

14

previamente establecido.

En el ejemplo anterior,factorial de 70 es un número muy grande. A fin de tener una idea de qué tan grande es,

supóngase que se hubiese tenido una computadora IBM del tipo mainframe en el instante en el que ocurrió el Big Bang

hace quince millones de años. ¿Habría podido, entre ese entonces y ahora, examinar todas las soluciones posibles? ¡No!

No obstante, supóngase que se hubiese tenido una computadora aun más poderosa, una que pudiese examinar mil

millones de asignaciones por segundo. La respuesta seguiría siendo negativa. Aún si la tierra se llenase con computadoras

cuyas rapideces fueran de nanosegundos, todas ellas trabajando en paralelo, la respuesta aún sería no. Sin embargo, si

existiesen diez tierras, todas llenas con computadoras del tipo mencionado, todas programadas en paralelo desde el

instante del Big Bang hasta que el sol fuese una esfera fría, entonces quizás la respuesta podría ser sí. Lo notable es que

el método símplex, con la ayuda de una computadora moderna, puede resolver este problema en una fracción de

segundo".

Antes de que Dantzig pudiese descubrir el método símplex, le fue necesario primero tener un modelo práctico de

Programación Lineal. He aquí la descripción de Dantzig del proceso: "Cuando el problema de la planeación fue formulado

inicialmente para la Fuerza Aérea, no existía la noción exacta de una función objetivo, la idea de una meta claramente

definida. Por supuesto, teníamos sólo un falso respeto hacia el concepto de objetivo. En el discurso de los militares

escuché a menudo decir, "nuestro objetivo es ganar la guerra" En el mundo de los negocios se escucharía quizás "nuestro

objetivo es obtener ganancias". Sin embargo, era imposible hallar alguna relación directa entre la meta establecida y las

acciones emprendidas para tal fin. Si se estudiaba con cuidado el paso siguiente, se podía ver que algún líder había

promulgado un montón de reglas básicas que, en su concepto, llevarían hacia la meta. Esto distaba mucho de lo que sería

honestamente estudiar todas las combinaciones alternativas de las acciones para elegir la mejor combinación. Los que

mandan generalmente mueven las manos y dicen "He considerado todas las alternativas", pero es casi siempre basura.

Lo más probable es que no pudiesen estudiar todas las combinaciones. Antes de 1947 era inconcebible pensar en la

existencia de una herramienta como la Programación Lineal que permitiese examinar millones de combinaciones. No

había algoritmo o herramienta computacional que pudiera hacer eso.

No descubrí el modelo de la Programación Lineal en un instante, sino que tuvo un proceso de evolución. Se dedicó casi un

año completo a la tarea de decidir si mi modelo podría ser utilizado en la formulación de problemas prácticos de

distribución de tiempos. Como usted sabe, la planeación y la distribución de tiempos se llevaron a una escala inmensa

durante la guerra.El funcionamiento de la Fuerza Aérea fue equivalente al funcionamiento de la economía de toda una

nación. En el proceso intervinieron cientos de miles de personas. La logística tuvo una magnitud difícil de entender para

alguien que no haya estado ahí. Mi colega Marshall Wood y yo revisamos miles de situaciones tomadas de nuestra

experiencia durante la guerra.

Esta intuición llevó a la primera formulación del método símplex en el verano de 1947. El primer problema práctico que se

resolvió con este método fue uno de nutrición (el famoso problema de la dieta).

El 3 de octubre de l947 Dantzig visitó el Institute for Advanced Study donde conoció a John von Neumann, quien por

entonces era considerado por muchos como el mejor Matemático del mundo. Von Neumann le platicó a Dantzig del

trabajo conjunto que estaba realizando con Oscar Morgenstern acerca de la teoría de juegos. Fue entonces cuando

Dantzig supo por primera vez del importante teorema de la dualidad.

En 1976 el presidente Gerald Ford otorgó a Dantzig la Medalla Nacional de Ciencias, que es la mención más alta de los

Estados Unidos en Ciencia. En la ceremonia en la Casa Blanca se citó a George Bernard Dantzig "Por haber inventado la

Programación Lineal, por haber descubierto métodos que condujeron a aplicaciones científicas y técnicas en gran escala a

problemas importantes en logística, elaboración de programas, optimización de redes y al uso de las computadoras para

hacer un empleo eficiente de la teoría matemática".

Historia

15

FOTO DE G. B. DANTZIG Y L. G. KHACHIAN

Realmente, el nuevo estilo marcado por el método simplex ha construido el auténtico

espíritu de la optimización matemática. A principios de la década de los sesenta,

Abraham Charnes y William Cooper (1961) publicaron un libro de gran influencia para

los años posteriores: Management Models and Industrial Applications of Linear

Programming. Esta obra supuso un gran impacto en el desarrollo de la práctica y de las

aplicaciones industriales de la programación lineal (principalmente en las compañías

petrolíferas y químicas). Pudo comprobarse la potencia de esta nueva herramienta, a la

hora de resolver los problemas decisionales de las grandes empresas. De igual modo, se

aplicó la programación lineal a la teoría económica como muestran las aportaciones de

Historia

16

Robert Dorfman, Paul Samuelson y Robert Solow (1958), o las de David Gale (1960), o

bien las de Gérard Debreu (1963).

Nuevos desarrollos de la programación lineal

La Programación Lineal fue una de las primeras herramientas cuantitativas con

la que contó la Investigación Operativa. Rápidamente se descubrió su eficiencia. Por

esta razón, era muy interesante conseguir nuevos métodos de resolución que hicieran la

competencia al algoritmo simplex.

Como una innovación destacable en los años ochenta aparece un nuevo y

poderoso algoritmo para la resolución de programas lineales: en 1984, Narendra

Karmarkar (1984) de AT&T Laboratories publicó un artículo presentando

esquemáticamente un método para resolver programas lineales de gran tamaño. Este

método llamado algoritmo de Karmarkar se presenta como un buscador de óptimos a

partir de puntos interiores, siendo ésta la gran novedad en relación con el método

simplex.

Dicho artículo de Karmarkar no describe totalmente el método resolutorio y,

además, afirma que es mucho más rápido que el simplex para problemas de gran

dimensión. El intento de descubrimiento de un remedo de dicho método puso a toda la

comunidad científica en pie de búsqueda. Pasaron cuatro años hasta que se logró un

conocimiento general del método y su distribución comercial. Esta extensión del

algoritmo de Karmarkar fue debida a AT&T Laboratories, que llamó a esta versión

'AT&T KORBX Linear Programming System'. La instalación completa de esta versión

tuvo un costo inicial de $8.900.000.

Desde un principio se realizaron multitud de comparaciones entre el método

simplex y el de Karmarkar, con objeto de determinar cuál de los dos era el más

eficiente. Sin embargo, esto no es fácil de determinar puesto que hay que especificar

qué es exactamente lo que significa eficiencia. Es necesario efectuar la comparación en

multitud de situaciones diversas y a partir de ellas establecer la correspondiente tesis. Se

han realizado estudios que cotejan el método de Karmarkar con un paquete informático

estándar del método simplex llamado MINOS. Para problemas de tamaño grande (a

partir de varios miles de restricciones) las mejoras en tiempo de cálculo del método de

Historia

17

Karmarkar sobre el simplex son notables (factores entre 10 y 50 son comunes). No

obstante, esta situación no supone la supremacía del método de Karmarkar en todo tipo

de problemas. No hay que olvidar que para problemas de dimensión pequeña, el método

simplex es más intuitivo y fácil de aplicar.

También es posible realizar algunos comentarios acerca de la complejidad

computacional de cada uno de los métodos. El método de Karmarkar es un algoritmo de

tiempo polinomial, mientras que el simplex no goza de esta propiedad, sino que es de

tiempo exponencial. De esta forma, tenemos explicada la razón por la cual el método de

Karmarkar obtiene mejores resultados para problemas de gran dimensión.

Es llamativo que los problemas que hasta hace unos años necesitaban de

computadoras de tamaño medio, ahora sean resolubles mediante ordenadores

personales. En la actualidad, prácticamente cualquier usuario de la Investigación

Operativa puede resolver problemas lineales mediante LINDO (u otro paquete

informático semejante) en un ordenador portátil.

De esta manera, mediante LINDO se pueden manejar problemas con hasta

50.000 restricciones y 200.000 variables. De igual modo, se desarrolló el paquete

MINOS (empleando para programación lineal el método simplex) en el Systems

Optimization Laboratory del Departamento de Investigación Operativa de la

Universidad de Stanford, que ha sido usado más frecuentemente como herramienta

optimizadora en programación no lineal. Otros lenguajes de modelización se han

desarrollado para ordenadores personales.

Así, ha aparecido GAMS/MINOS que es una combinación de los dos programas

bien conocidos con objeto de construir un lenguaje de modelización algebraica

implementado por IBM. De la misma forma, ha aparecido el paquete XPRESS-LP; y el

lenguaje MPL (Mathematical Programming Language) desarrollado por Maximal

Software en Islandia. Esta misma casa produjo la utilidad Turbo-Simplex.

En los años noventa fueron apareciendo otras utilidades informáticas, como son

las hojas de cálculo y sus complementos asociados, capaces de resolver programas

lineales. Entre algunos de estos complementos se pueden citar los siguientes: Solver,

VINO, What's Best? y XA. Casi todas estas utilidades fueron construidas por IBM para

sus propias computadoras, sin embargo, poco a poco, se van obteniendo versiones para

Macintosh.

Aunque estas son las más recientes aplicaciones informáticas de los últimos

cinco años, en los próximos años se mejorarán, a la vez que se extenderán los lenguajes

y paquetes informáticos que permitirán resolver con relativa facilidad problemas de

programación lineal complejos.

Películas relacionadas:

Enigma (2001). Director: Michael Apted. Dougray Scott, Kate Winslet, Saffron

Burrows, Jeremy Northam, Corin Redgrave, Tom Hollander, Nikolaj Coster-Waldau, Donald Sumpter,

Matthew Macfadyen

Historia

18

U-571 (2000). Director: Jonathan Mostow. Matthew McConaughey, Bill Paxton, Harvey

Keitel, Jon Bon Jovi, David Keith, Thomas Kretschmann, Jake Weber, Jack Noseworthy

Una mente maravillosa (2001). Director: Ron Howard. Russell Crowe, Jennifer

Connelly, Ed Harris, Paul Bettany, Adam Goldberg, Christopher Plummer, Judd Hirsch, Josh Lucas,

Anthony Rapp

Otras:

Sobre Hitler:

Hitler, el reinado del mal (2003). DIRECTOR Christian Duguay Robert Carlyle, Stockard

Channing, Jena Malone, Julianna Margulies, Matthew Modine, Liev Schreiber, Peter Stormare, Friedrich

von Thun, Peter O'Toole

Sobre Pearl Harbor (y/o equipos de descifrado de código)

Pearl Harbor (2001) DIRECTOR Michael Bay REPARTO Ben Affleck, Josh

Hartnett, Kate Beckinsale, Cuba Gooding Jr., Alec Baldwin, Jon Voight, Tom

Sizemore, Dan Aykroyd, Colm Feore, Cary-Hiroyuki Tagawa, Matthew Davis, Ewen

Bremner, Jaime King, William Fichtner, John Diehl, Leland Orser, Tomas Arana,

Jennifer Garner

Tora! Tora! Tora! (1970) DIRECTOR Richard Fleischer, REPARTO Jason Robards,

Martin Balsam, Soh Yamamura, Tatsuya Mihashi, E.G. Marshall, Joseph Cotten, James

Whitmore, George Macready, Neville Brand

La batalla de Midway (1976). DIRECTOR Jack Smight REPARTO Charlton Heston, Edward

Albert, Henry Fonda, James Coburn, Glenn Ford, Robert Mitchum, Toshiro Mifune, Hal Holbrook, Cliff

Robertson, Robert Wagner

Creadores de Sombras (1990) DIRECTOR Roland Joffé REPARTO Paul Newman, Dwight Schulz,

Laura Dern, Bonnie Bedelia, John Cusack, Natasha Richardson, John McGinley, Ron Vawter, Ron

Frazier, Clark Gregg

Historia

19

INVESTIGACIÓN OPERATIVA:

Es la aplicación del método científico para asignar los recursos o actividades de forma

eficaz, en la gestión y organización de sistemas complejos

Tema 1. Modelos de programación lineal y aplicaciones.

Formulación de modelos de programación lineal

Un problema de programación se refiere, en general, al uso o asignación

(reparto) de una serie de recursos (dinero, material, trabajadores,...) de “la mejor

manera posible”, es decir, de manera que se maximicen las ganancias o se

minimicen los costes (de utilización de dichos recursos).

Para que un problema de programación se diga lineal ha de cumplir dos

características:

1. La regla o criterio para seleccionar los mejores valores de las

variables usadas para construir el problema se puede escribir como

una ecuación lineal de las mismas (sin potencias de grado mayor que

1 - Metodo del Simplex

uno, sin productos cruzados, ...), que habrá que maximizar /

minimizar. A esta función se la llama función del objetivo.

Z=c1x1+c2x2+...+cnxn

2. Las relaciones existentes entre las variables del problema (también

llamadas restricciones) se pueden escribir como un conjunto de

ecuaciones o inecuaciones lineales de las variables anteriores. A este

conjunto de ecuaciones se le denomina conjunto de restricciones.

a11x1+a12x2+...+a1nxn (≤, ≥, =) b1

a21x1+a22x2+...+a2nxn (≤, ≥, =) b2

...

am1x1+am2x2+...+amnxn (≤, ≥, =) bm

m filas o ecuaciones y n variables o incógnitas

¿Cómo “escribir” un problema de programación lineal? Debemos conocer (en

este orden):

1) Las variables del problema xi (variables de decisión o actividad)

2) El conjunto de restricciones

3) La función del objetivo que habrá que maximizar o minimizar, Z

2 - Metodo del Simplex

Ejemplo:

"Una compañía armamentística americana desea proyectar la fabricación de un

cohete antitanque casero para vender en supermercados. La compañía ha

considerado 3 modelos y su departamento de producción ha elaborado la siguiente

tabla:

MODELO

A

B

C

Trabajo

(horas/unidad)

7

3

6

Material

(titanio/unidad)

4

4

5

Beneficios (por

unidad

fabricada)

40$

20$

30$

El suministro de material se restringe a 200 kg de titanio por día, y la disponibilidad

total diaria de los trabajadores es de 150 horas. Formular un problema de

programación lineal para determinar la producción diaria de cada modelo, en orden

a maximizar el beneficio total."

1. Identificación de las variables:

X1= "unidades diarias a producir del modelo A"

X2 = "unidades diarias a producir del modelo B"

X3 = "unidades diarias a producir del modelo C"

2. Restricciones:

Las restricciones vienen dadas por los límites de disponibilidad de los dos

recursos: trabajo y material.

1 unidad modelo A lleva 7 horas de trabajo, entonces X1 unidades -> 7· X1

1 unidad modelo B lleva 3 horas ... X2 unidades -> 3· X2

1 unidad modelo C lleva 6 horas ... X3 unidades -> 6· X3

TOTAL Horas de trabajo: 7· X1+3· X2+6· X3

1 unidad modelo A necesita 4 ... X1unidades -> 4· X1

1 unidad modelo B necesita 4 ... X2 unidades -> 4· X2

1 unidad modelo C necesita 4 ... X3 unidades -> 5· X3

TOTAL Material: 4· X1+4· X2+5· X3

Tendremos, por tanto que:

3 - Metodo del Simplex

7· X1+3· X2+6· X3 ≤150

4· X1+4· X2+5· X3 ≤200

3. Función objetivo:

MODELO

BENEFICIO POR

UNIDAD

UNIDADES

PRODUCIDAS

A

40

X1

40 X1

B

20

X2

20 X2

C

30

X3

30 X3

Tendremos, por tanto:

Z = 40· X1 + 20· X2 + 30· X3

Por último, tendríamos la formulación completa del problema:

Maximizar Z = 40X1 + 20X2 + 30X3

Sujeto a:

7X1+3X2+6X3 ≤150

4X1+4X2+5X3 ≤200

X1 ≥ 0

X2 ≥ 0

X3 ≥ 0

X1, X2, X3 enteros

4 - Metodo del Simplex

Solución gráfica de problemas de programación lineal con 2 variables

Z = 40x1+36x2

x1 ≤

Ejemplo: Minimizar

Sujeto a

8

x2 ≤ 10

5x1+3x2 ≥ 45

x1,x2 ≥ 0

Resolver el p.p.l. es encontrar un par de valores (x1opt, x2opt) que cumplan las

restricciones y hagan mínima la función del objetivo

a)

x1=8

x2=10

Satisface las restricciones

b)

x1=7

x2=9

Satisface las restricciones

ambas son soluciones factibles

Z(a)=40•8+36•10=680

Z(b)=40•7+36•9=604

b es “mejor” solución que a (estamos minimizando)

El conjunto de todas las soluciones factibles de un problema de

programación lineal (p.p.l.) se llama región factible. Resolver un p.p.lineal es

encontrar la mejor solución factible en la región factible. Esta última se llama

solución óptima.

Gráficamente:

5 - Metodo del Simplex

5x1+3x2≥45

puntos

Æ5x1+3x2=45

Ec. Recta pasa por los

x1=0 Æ x2=15

x1=9 Æ x2=0

· Se coge un punto cualquiera, por ejemplo X1=X2=0, el punto (0,0), y vemos:

5·0 + 3·0 <= 45

6 - Metodo del Simplex

5·0 + 3·0 >= 45 NO CIERTO

· La región factible será el triángulo formado por los puntos A, B y C, con los bordes

incluidos.

Función objetivo 40 x1+36x2

40x1+36x2 = cte

Por ejemplo Z=0

40x1+36x2=0

10/9

es la ecuación de una recta

x1= 0 Æ x2= 0

x1=1 Æ x2= -40/36 = -

7 - Metodo del Simplex

Z=36

40 x1+36 x2=36

Z= -36

40 x1+36 x2=-36

x1= 0 Æ x2= 1

x2= 0 Æ x1= 36/40 = 9/10

x1= 0 Æ x2= -1

x2= 0 Æ x1= -36/40 = -9/10

8 - Metodo del Simplex

Resumiendo:

Con los tres valores de la cte, Z:

- Constante positiva Æ la recta se mueve a la derecha

- Constante negativa Æ la recta se mueve a la izquierda

· Hemos de probar en qué parte esta ecuación nos da el valor óptimo. Como

estamos minimizando, queremos que nos dé el menor valor posible. Gráficamente

esto supone bajar la recta lo más posible en la región factible:

9 - Metodo del Simplex

A = (x1, x2) = (8, 5/3) minimiza Z ⇒ es la solución óptima y Z=380 es el

valor óptimo para el problema.

Este es un ejemplo de solución óptima única.

10 - Metodo del Simplex

Otro ejemplo:

Max Z = x2

Sujeto a

2x1 - x2= -2

x1 + 2x2= 8

2x1 - x2 ≥ -2

x1 + 2x2 ≤ 8

x1, x2 ≥ 0

x1= 0 Æ x2= 2

x2= 0 Æ x1= -1

x1= 0 Æ x2= 4

x2= 0 Æ x1= 8

Max Z = x2

11 - Metodo del Simplex

Max Z = 3x1 + 2x2

12 - Metodo del Simplex

13 - Metodo del Simplex

Soluciones óptimas múltiples o alternativas

Max

Sujeto a

Z = x1+ 2x2

x1+ 2x2 ≤ 10

x1 + x2 ≥ 1

x2 ≤ 4

x1, x2 ≥ 0

14 - Metodo del Simplex

Todos los puntos de la línea BC son soluciones óptimas.

15 - Metodo del Simplex

Solución no acotada

En una situación real no existe. Ej: construcción pisos

Max

Z = x1 + 2x2

Sujeto a

x 1 + x2 ≥ 1

x2 ≤ 4

x1, x2 ≥0

16 - Metodo del Simplex

17 - Metodo del Simplex

ZOPT

Æ+∞

No existe óptimo finito. El p.p.l. se dice que tiene solución no acotada. En

este caso porque queremos Max Z, si fuese Min Z la solución sería el

punto A

18 - Metodo del Simplex

Problema no factible

Min

Sujeto a

Z = x1 + x 2

x 1 + x2 ≤ 1

4x1 + 2x2 ≥ 6

x1, x2 ≥ 0

x1 + x2 = 1 pasa por los puntos (0,1) y (1,0)

4x1 + 2x2 = 6 pasa por los puntos (0,3) y (1.5,0)

No hay intersección entre los dos planos Æ no hay ninguna solución que

cumpla las restricciones.

R=Ø

19 - Metodo del Simplex

En 3 variables:

20 - Metodo del Simplex

21 - Metodo del Simplex

22 - Metodo del Simplex

23 - Metodo del Simplex

Forma estándar de un PPL con m restricciones y n

variables

Maximizar

(minimizar)

Z = c1x1 + c2x2 + ... + cnxn

a11x1 + a12x2 + ... + a1nxn = b1

a21x1 +a22 x2 + ... + a2nxn = b2

...

am1x1 + am2x2 + ... + amnxn = bm

siendo b1, b2,…, bm ≥ 0

En notación matricial:

Maximizar

(minimizar)

Z = cX

AX = b

X≥0

(b ≥ 0)

siendo:

A=

(m x n)

X=

(n x 1)

x1

x2

...

xn

a11

a21

...

am1

a12

a22

...

am2

...

...

...

...

a1n

a2n

...

amn

b=

(m x 1)

b1

b2

...

bm