Técnicas de Investigación Social Medir la realidad social

Anuncio

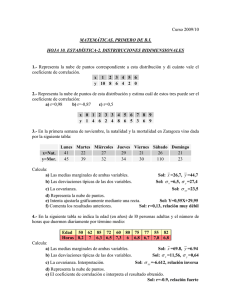

Licenciatura en Sociología – Curso 2006/07 Técnicas de Investigación Social Medir la realidad social (4) La regresión (relación entre variables) El término REGRESIÓN fue introducido por GALTON en su libro “Natural inheritance” (1889) refiriéndose a la “ley de la regresión universal”: “Cada peculiaridad en un hombre es compartida por sus descendientes, pero en media, en un grado menor”. Regresión a la media Regresión a la media Su trabajo se centraba en la descripción de los rasgos físicos de los descendientes (una variable) a partir de los de sus padres (otra variable). PEARSON (un amigo suyo) realizó un estudio con más de 1000 registros de grupos familiares observando una relación del tipo: Altura del hijo = 85cm + 0,5 altura del padre (aprox.) FRANCIS GALTON Conclusión: los padres muy altos tienen tendencia a tener hijos que heredan parte de esta altura, aunque tienen tendencia a acercarse (regresar) a la media. Lo mismo puede decirse de los padres muy bajos. Hoy en día el sentido de regresión es el de predicción de una medida basándonos en el conocimiento de otra. Estadístico y aventurero Fundador (con otros) de la estadística moderna para explicar las teorías de Darwin. Primo de Darwin 1 Estudio conjunto de dos variables A la derecha tenemos una posible manera de recoger los datos obtenido observando dos variables en varios individuos de una muestra. Altura en cm. Peso en Kg. 162 61 154 60 180 78 158 62 171 66 169 60 166 54 176 84 163 68 ... ... En cada fila tenemos los datos de un individuo Cada columna representa los valores que toma una variable sobre los mismos. Las individuos no se muestran en ningún orden particular. Dichas observaciones pueden ser representadas en un diagrama de dispersión (‘scatterplot’). En ellos, cada individuos es un punto cuyas coordenadas son los valores de las variables. Diagramas de dispersión o nube de puntos Tenemos las alturas y los pesos de 30 individuos representados en un diagrama de dispersión. 100 90 Pesa 76 kg. 80 Mide 187 cm. 70 60 Pesa 50 kg. 50 Mide 161 cm. 40 30 140 150 160 170 180 190 200 2 Relación entre variables Tenemos las alturas y los pesos de 30 individuos representados en un diagrama de dispersión. 100 90 80 70 60 re Pa 50 ce eso p l e que c nta e aum on ltu la a ra 40 30 140 150 160 170 180 190 200 Predicción de una variable en función de otra Aparentemente el peso aumenta 10Kg por cada 10 cm de altura... o sea, el peso aumenta en una unidad por cada unidad de altura. 100 90 80 Tenemos las alturas y los pesos de 30 individuos representados en un diagrama de dispersión. 70 60 10 kg. 50 10 cm. 40 30 140 150 160 170 180 190 200 3 Cómo reconocer relación directa e inversa 330 Incorrelación 280 100 230 Fuerte relación directa. 90 180 80 70 130 60 80 50 40 30 140 150 160 170 180 190 200 Para valores de X por encima de la media tenemos valores de Y por encima y por debajo en proporciones similares. Incorrelación. 80 Cierta relación inversa 70 60 50 40 30 20 10 0 140 150 160 170 180 190 200 30 140 150 160 170 180 190 200 Se llama relación directa o creciente entre X e Y cuando: Para los valores de X mayores que la media le corresponden valores de Y mayores también. Para los valores de X menores que la media le corresponden valores de Y menores también. Para los valores de X mayores que la media le corresponden valores de Y menores. Esto es relación inversa o decreciente. Cómo reconocer buena o mala relación 100 330 Poca relación 280 Fuerte relación directa. o 90 80 230 o 70 180 60 o 130 o 50 80 40 30 30 140 150 160 170 180 190 200 80 Cierta relación inversa 60 50 40 30 20 10 0 140 150 160 170 180 190 150 160 170 180 190 200 Conocido X sabemos que Y se mueve por una horquilla estrecha. Buena relación. Dado un valor de X no podemos decir gran cosa sobre Y. Mala relación. Independencia. 70 o 140 200 Lo de “horquilla estrecha” hay que entenderlo con respecto a la dispersión que tiene la variable Y por si sola, cuando no se considera X. 4 Relación entre variables (Definición) Se considera que dos variables cuantitativas están relacionadas entre sí cuando los valores de una de ellas varían de forma sistemática con respecto a los valores homónimos de la otra; en otras palabras, si tenemos dos variables, A y B, existe relación entre ellas si al aumentar los valores de A también lo hacen los de B, o por el contrario si al aumentar los valores de A disminuyen los de B. Relación entre variables (Significado) La relación entre dos variables cuantitativas queda representada mediante la línea de mejor ajuste, que es la que esquematiza las condiciones de la nube de puntos y de la relación. Los componentes elementales de una línea de ajuste y por extensión de una relación entre dos variables son: La fuerza El sentido La forma 5 Relación entre variables (Definición) La fuerza mide el grado en que la línea representa a la nube de puntos. Si la nube es estrecha y alargada una línea recta representará adecuadamente a la nube de puntos y a la relación y por tanto ésta será fuerte. Si por el contrario, la nube de puntos tiene una tendencia elíptica o circular, una línea recta que trate de representar a la misma será consecuencia de una relación débil y poco representativa, con amplios residuos. El sentido de la relación se refiere a cómo varían los valores de B con respecto a A. Si al crecer los valores de la variable A lo hacen los de B, será una relación positiva (a valores bajos de A le corresponden valores bajos de B). Si al aumentar A, disminuye B, será una relación negativa (a valores bajos de A le corresponden valores altos de B y viceversa). La forma establece el tipo de línea a emplear para definir el mejor ajuste. Se pueden emplear tres tipos de líneas: una línea recta, una curva monotónica y una curva no monotónica. Relación entre variables (Definición) En el caso de usar una recta, se admite que existe una proporción entre la diferencia entre dos valores A y la diferencia entre dos valores de B. A ese factor de ajuste entre ambas series se le llama pendiente de la recta, y se asume que es constante a lo largo de toda la recta de ajuste. En el caso de usar una curva monotónica, ese factor de proporción entre las dos variables no es constante a lo largo de toda la recta, y por lo tanto la pendiente de la misma es variable en su recorrido. Se dice entonces que la línea de ajuste es no lineal monotónica, puesto que la línea se ha convertido en curva. Sin embargo, lo que no varía es el sentido de la relación: si la relación es positiva lo será a lo largo de todo el recorrido de la curva y si es negativa, será negativa en toda la curva. Por último, en el caso de usar una curva no monotónica varía tanto la pendiente de la curva como el sentido de la relación, que en unos sectores puede ser positiva (ascendente) y en otros negativa (descendente). 6 Relación entre variables no lineales Covarianza de dos variables X e Y La covarianza entre dos variables, Sxy, nos indica si la posible relación entre dos variables es directa o inversa. S xy = 1 ∑ ( xi − x )( yi − y ) n i Directa: Sxy > 0 Directa: Sxy < 0 Directa: Sxy = 0 El signo de la covarianza nos dice si el aspecto de la nube de puntos es creciente o no, pero no nos dice nada sobre el grado de relación entre las variables. 7 Cálculo de la covarianza La covarianza entre dos variables Var1 y Var2 viene dada por: S xy = Donde xi 1 ( xi − x )( yi − y ) ∑ n i indica el valor de la variable Var1 para el individuo i, yi el valor de la variable Var2 para el individuo i, x la media de Var1 e media de Var2. indica y la Indicadores de correlación La correlación mide la relación lineal entre dos variables y su sentido (si es directo o inverso). Cuando la relación es perfectamente lineal dicho coeficiente vale 1 (ó -1). Cuando el coeficiente tiene un valor próximo a cero, o bien no existe relación entre las variables analizadas o bien dicha relación no es lineal. La correlación habitualmente denotada por r se puede estimar de dos maneras diferentes: El coeficiente de correlación de Pearson denotado por r es utilizado cuando ambas variables son cuantitativas siguiendo una distribución normal El coeficiente de correlación de Spearman denotado por rs se utiliza cuando alguna de las variables es ordinal o incluso dicotómica o para variables cuantitativas con muestras pequeñas. 8 Coeficiente de correlación lineal de Pearson El coeficiente de correlación lineal de Pearson de dos variables, r, nos indica si los puntos tienen una tendencia a disponerse alineadamente (excluyendo rectas horizontales y verticales). Tiene el mismo signo que Sxy por tanto de su signo obtenemos el que la posible relación sea directa o inversa. r es útil para determinar si hay relación lineal entre dos variables, pero no servirá para otro tipo de relaciones (cuadrática, logarítmica,...) r= S xy SxS y Coeficiente de correlación de Pearson El coeficiente de correlación de Pearson se obtiene calculando en primer lugar la covarianza entre las variables, que es una medida de asociación con dependencia de las unidades de medida de las variables. Después se divide por el producto de cada una de las desviaciones típicas de ambas variables, resultando una medida de asociación adimensional. r= S xy SxS y 9 Coeficiente de correlación lineal de Pearson Principio de isomorfía: sólo si la estructura de la hipótesis sustantiva supone una relación lineal, tendrá sentido utilizar el coeficiente de Pearson. Si la relación hipóteticamente se supone no lineal, no deberá utilizarse este coeficiente para contrastar la hipótesis. Si el coeficiente de Pearson calculado para la distribución conjunta informa que no existe relación, deberá tenerse muy presente de que la conclusión es que No hay relación lineal. Propiedades de r Es adimensional Sólo toma valores comprendidos entre [-1,1] Las variables son incorrelada si r = 0 Relación lineal perfecta entre dos variables se produce si r = +1 o r =-1 Excluimos los casos de puntos alineados horizontal o verticalmente. Cuanto más cerca esté r de +1 o -1 mejor será el grado de relación lineal. Siempre que no existan observaciones anómalas.. Relación inversa perfecta -1 Variables incorreladas 0 Relación directa casi perfecta +1 10 Correlación de Sperman El coeficiente de correlación de Spearman es una técnica no paramétrica que se basa en los rangos en vez de en los valores originales de la variable. Cálculo de Rangos Para los datos de las variables Var1 y Var2 se calculan los rangos de los valores de éstas, a los que se denota por: Ri(Var1) y Ri(Var2), siendo Ri(Var1) los rangos de la variable Var1 asociados al individuo i y Ri(Var2) los rangos de la variable Var2 asociados al individuo i. Ejemplo: Var1 Var2 R1(Var1) Ri(Var2) Máximo valor rango mayor Empate rangos 1 y 2 rango 1,5 10 8 1,5 17 6 5 10 7 1,5 15 4 22 6 7 7 3 Correlación de Sperman (valores intermedios) Cálculo de valores intermedios A continuación, se realizan los siguientes cálculos intermedios: 11 Coeficiente de Spearman Cálculo del coeficiente de correlación de Spearman. “A partir de los coeficientes calculados con anterioridad, se calcula el coeficiente de correlación rs de Spearman dado por: 12 13 14 15 Entrenando el ojo: correlaciones positivas 330 280 230 180 130 80 30 140 r=0,1 150 160 170 180 190 200 130 120 110 100 90 80 70 60 50 40 30 140 110 100 100 90 90 80 80 150 160 170 180 190 200 70 70 60 60 50 50 r=0,6 40 30 140 r=0,4 150 160 170 180 190 r=0,8 40 200 30 140 150 160 170 180 190 200 Entrenando el ojo: casi perfectas y positivas 100 100 90 90 80 80 70 70 60 60 50 50 r=0,9 40 30 140 150 160 170 180 190 r=0,99 40 200 30 140 150 160 170 180 190 200 100 90 80 70 60 50 r=1 40 30 140 150 160 170 180 190 200 16 Entrenando el ojo: correlaciones negativas 80 90 80 70 60 50 40 30 20 10 0 70 60 50 40 30 20 r=-0,5 140 150 160 170 180 190 200 0 140 80 80 70 70 60 60 50 50 40 40 30 30 20 10 0 140 r=-0,7 10 150 160 170 180 190 200 160 170 180 190 200 20 r=-0,95 150 10 160 170 180 190 200 r=-0,999 0 140 150 Preguntas más frecuentes ¿Si r = 0 eso quiere decir que no las variables son independientes?. En la práctica, casi siempre sí, pero no tiene por qué ser cierto en todos los casos. Lo contrario si es cierto: Independencia implica incorrelación Me ha salido r =1’2 ¿la relación es “superlineal”? ¿Superqué? Eso es un error de cálculo. Siempre debe tomar un valor entre -1 y +1. ¿A partir de qué valores se considera que hay “buena relación lineal”? Es difícil dar un valor concreto. Podemos decir que si |r|>0,7 hay buena relación lineal y que si |r|>0,4 hay cierta relación. 17 Otros coeficientes de correlación Cuando las variables en vez de ser numéricas son ordinales, se utilizan otro tipo de indicadores. Disponemos para estos casos de dos estadísticos, aunque no los usaremos en clase: Maurice George Kendall ρ (‘ro’) de Spearman τ (‘tau’) de Kendall Charles Edward Spearman 18