LA LEY DE LOS EVENTOS RAROS, LEGADO DE SIMÉON DENIS

Anuncio

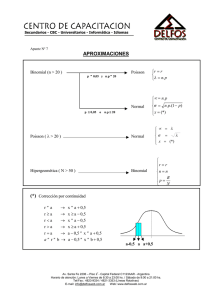

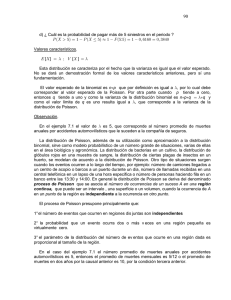

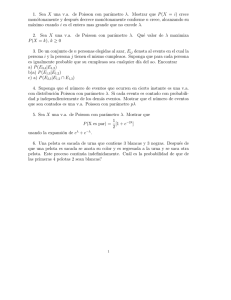

LA LEY DE LOS EVENTOS RAROS, LEGADO DE SIMÉON DENIS POISSON BEGOÑA FERNÁNDEZ FERNÁNDEZ DEPARTAMENTO DE MATEMÁTICAS FACULTAD DE CIENCIAS UNAM CIRCUITO EXTERIOR, CIUDAD UNIV. MÉXICO D.F., C.P. 04510 MÉXICO E-MAIL: [email protected] Resumen. En este artı́culo se presenta una de las tantas formas como podemos acercarnos a la Teorı́a de la Probabilidad. Iniciaremos con el clásico problema de contar y la aproximación de Poisson a la Distribución Binomial para terminar con el Proceso de Cramér-Lundberg y el cálculo de la probabilidad de ruina. La intención es mostrar tres de los problemas que enfrentamos cotidianamente los probabilistas que son aproximar probabilidades pequeñas, lidiar con tiempos aleatorios y obtener ecuaciones integro-diferenciales deterministas de un problema que es estrictamente aleatorio. Abstract. This paper presents an approach to Probability Theory. We begin with the classical problem of counting and the Poisson approximation to the Binomial Distribution to finish with the Cramér-Lundberg process and the computation of the ruin probability. The intention is to show three problems that the probabilists handle frequently: to approximate small probabilities, to work with random times, and to obtain deterministic integro-differential equations that arise from a random problem. 1. Introducción Fue difı́cil elegir el nombre y el contenido de este trabajo. La intención era escribir algo sobre Siméon Denis Poisson, la Distribución y el Proceso Estocástico que llevan su nombre, sus variaciones, su desarrollo en la historia de la Probabilidad. Al revisar mis notas, apuntes, el libro Recherches sur la Probabilités des Jugements en Matière Criminelle et en Matière Civile escrito por él en 2000 Mathematics Subject Classification. Primary 6001, 62E20; Secondary 60G55, 62J75. Palabras Claves. Siméon Denis Poisson, Poisson Distribution, Poisson Process, Risk Process, Ruin Probability. 219 220 BEGOÑA FERNÁNDEZ FERNÁNDEZ 1834 -que en un viaje a Francia con el Prof. Miguel Angel Garcı́a fotocopiamos de la Biblioteca de la Universidad de Estrasburgo, ası́ como algunos artı́culos antiguos- los ejemplos y las aplicaciones que aparecen en los libros modernos sobre la Distribución y el Proceso Poisson, me di cuenta que aún cuando sabı́a estas cosas no era realmente conciente de su extensión, riqueza y profundidad. Escribir sobre Poisson me ha agobiado durante los tres meses que me dieron de plazo para entregar el artı́culo. Mientras más reviso mis anotaciones, más difı́cil es. Después de decir que nació el 21 de junio de 1781 en Pityhiviers, murió el 25 de abril de 1840 en Sceaux (cerca de Paris) , fue alumno de Laplace y Lagrange1, cualquier cosa que pueda decir me parece poco. Poisson fué un gran matemático, merece todos los honores, ¿cómo hacerle justicia? Por otro lado, de la Distribución y el Proceso Poisson, existen y se pueden escribir grandes tratados, ¿cómo convencer a los lectores de su importancia en un artı́culo de unas cuantas páginas? ¿Cómo convencer, en fin, a los estudiantes que se inician en la Probabilidad que no podrı́amos vivir sin el legado de Poisson y su Distribución? En los últimos momentos, en los momentos de desesperación, en los que sentı́ que no tenı́a salida, recordé dos menciones, una sobre Siméon Denis Poisson y otra sobre la Distribución Poisson, dos menciones que en realidad son parte y serán parte de las leyendas, de la tradición, que describen claramente tanto al matemático como a la importancia de su distribución. La primera se refiere a la siguiente frase que según Francois Arago [1] Poisson repetı́a frecuentemente: Life is good for only two things, discovering mathematics and teaching mathematics2 La vida vale la pena por sólo dos cosas, descubrir matemáticas y enseñar matemáticas Esta frase, quizás exagerada, expresa lo que era Poisson, un investigador y un profesor, un creador y educador. Las matemáticas, en toda la extensión de la palabra, le daban sentido a su vida y su obra le ha dado sentido a muchas otras vidas. El trabajo de Poisson en matemáticas es extenso, no sólo en Probabilidad, sino en otras áreas. Numerosos objetos matemáticos llevan su nombre como la integral de Poisson, la ecuación de Poisson en la Teorı́a de Potencial. Tiene aportaciones en ecuaciones diferenciales, elasticidad y electricidad, entre otras. 1 Lagrange fue su asesor de tesis Tenı́a la impresión de que esta frase deberı́a estar en francés, sin embargo, al parecer la referencia de Aragó está en inglés 2 LA LEY DE LOS EVENTOS RAROS 221 En Probabilidad es el primero que utilizó el término de Grandes Números -nombre con el que conocemos a uno de los Teoremas más importantes de la Probabilidad, la Ley de los Grandes Números3- el primero que usó a la función de distribución [17] pag. 246 -que en la actualidad es con la que trabajamos a diario los probabilistas-. En todo este mundo de aportaciones matemáticas en general y probabilistas en particular, ¿qué papel juega la Distribución Poisson?. No puedo expresarlo mejor que como el Prof. Howard Taylor4, lo hace en los cursos de Procesos Estocásticos. Les dice a sus estudiantes5: Si tuviera que irme a una isla desierta, y sólo pudiera llevar conmigo a una distribución, elegirı́a a la Distribución Poisson. ¡¡¡¡¡Ojo!!!!! no se lleva a la Distribuición Gaussiana, como muchos pensarı́an. La distribución Gaussiana es la más conocida por un público amplio, es usada en ocasiones para calificar a los estudiantes, ya que siempre preguntan, ¿va a calificar con campana?6. Se le conoce también como la Distribución Normal que según Sheldon Ross [15] pag. 222 se debe a que en la segunda mitad del siglo XIX muchos de los datos estadı́sticos se comportaban como Gaussianos y fue Pearson quien lidereó el uso de la palabra Normal. En una visita reciente del Prof. Victor Pérez Abreu, estando en mi oficina con la Profra. Ana Meda, los tres coincidimos, en que en la Distribución y el Proceso Poisson está contenida la intuición probabilista. Entenderlos es la mejor manera de entender como juega el azar, enseñarlos, es la mejor manera de formar buenos probabilistas. En este artı́culo se presenta una de las tantas formas como podemos acercarnos a la Probabilidad. Iniciaremos con el clásico problema de contar -que para muchos es lo único que hace la Probabilidad- y veremos que podemos llegar muy lejos. La intención es mostrar esencialmente tres de los problemas que enfrentamos cotidianamente los probabilistas que son aproximar, lidiar con tiempos aleatorios y obtener ecuaciones integro-diferenciales deterministas de un problema que es estrictamente aleatorio. De estos tres problemas los tiempos aleatorios es el que considero más importante, cuando alguien los entiende, puede estar seguro de que es ya un probabilista. Es uno de los conceptos más difı́ciles de entender, más ricos desde el punto de vista matemático y el Proceso Poisson es uno de los ejemplos en que 3 El Capı́tulo III de [14] lleva como tı́tulo Calcul des probabilités qui dependent de très grands nombres y es, según Oscar Sheynin [17] el primero en utilizar esta terminologı́a 4 Entre otras publicaciones, autor junto con Karlin de uno de los libros de Procesos Estocásticos que aparecen en la bibliografı́a de casi todos los cursos en el mundo [11] 5 Comunicación verbal de Beatriz Rodrı́guez, estudiante del Prof. Taylor 6 Hasta la fecha yo no he entendido que quieren decir. 222 BEGOÑA FERNÁNDEZ FERNÁNDEZ aparecen de manera natural, no como un capricho o una curiosidad sino como una necesidad. Las ecuaciones integro-diferenciales las obtendremos por un argumento de renovación -argumento fundamental en Probabilidad- al calcular la probabilidad de ruina en el Modelo Clásico de Ruina o Modelo Cramér-Lundberg. Este modelo -construido a partir del Proceso Poisson- describe la reserva de una compañı́a aseguradora en cada tiempo t. Es la base de un sin-número de artı́culos y problemas que en la actualidad son de gran de importancia tanto desde el punto teórico como práctico. No mencionaré a la Teorı́a de la Medida, cuya relación con la Probabilidad es bien reconocida. Esto es ası́, porque que considero que no es necesario para los problemas que trataremos. El artı́culo está dirigido a estudiantes de licenciatura, los conocimientos de la teorı́a de Probabilidad que se requieren son mı́nimos y están incluidos en los temarios de los cursos básicos de Probabilidad de las carreras de matemáticas, actuarı́a y áreas afines. 2. Aproximar, la Ley de los Eventos Raros La Ley de los Eventos Raros fue demostrada por Poisson en su libro Recherches sur la Probabilités des Jugements en Matière Criminelle et Matière Civile, en la página 205. Surge -como todos los primeros resultados importantes en Probabilidad- del estudio de la probabilidad de obtener k éxitos en n ensayos Bernoulli con parámetro p. El término raro se refiere a que la probabilidad de éxito p > 0 es pequeña. Es difı́cil decir que quiere decir pequeña, pues de hecho p está entre cero y uno, por lo que es en si misma una cantidad pequeña. Como veremos a continuación, en el resultado de Poisson pequeña significa es del orden de 1/n. Denotaremos por Sn al número de éxitos en n ensayos Bernoulli independientes con probabilidad de éxito p. Es bien sabido que para 0 ≤ k ≤ n: (2.1) P [Sn = k] = n! pk (1 − p)n−k (n − k)! k! A primera vista, tenemos resuelto el problema, tenemos una fórmula que nos da esta probabilidad. De hecho, es una de las primeras fórmulas que los estudiantes aprenden, pues son los términos del desarrollo del binomio (p+(1− p))n . La suma sobre k de todos los términos es igual a 1. Aparentemente es el mejor de los escenarios posibles: una fórmula sencilla, conocemos cada uno de sus términos, sólo aparecen productos y potencias. Sin embargo, esta fórmula es engañosa, depende de dos parámetros n y p. El encanto se acaba cuando queremos calcularla para n grande dada, ya que LA LEY DE LOS EVENTOS RAROS 223 para 1 ≤ k ≤ n: n! n(n − 1) · · · (n − k + 1) k pk (1 − p)n−k = p (1 − p)n−k . (n − k)! k! k! Para p fija, tenemos dos términos en el producto del lado derecho, uno que tiende a infinito y otro que tiende a cero cuando n tiende a infinito. Si esto se lo damos a una computadora para calcularlo, tenemos que tener cuidado, pues podrı́a despreciar el término que tiende a cero. De hecho, serı́a interesante que supiéramos que hacen los programas de cómputo que calculan estas probabilidades, pues claramente las aproximan, la pregunta es que tan fina es la aproximación. Tener el cálculo preciso para n grande sabemos que es difı́cil, si no imposible, pero de cualquier manera nos interesa saber de qué orden es. Todos los matemáticos nos enfrentamos constantemente a expresiones como ésta, difı́ciles de entender - aún cuando podamos encontrar sus propiedadesdifı́ciles de saber de qué orden de magnitud son. No puedo encontrar mejor manera de expresar lo que se requiere que con la siguiente cita: Nécessité de recourir aux methodes d’approximation, pour calculer les valeurs des produits d’un très grand nombre de facteurs inégaux....... Necesidad de recurrir a los métodos de aproximación, para calcular los valores de productos de un número grande de factores desiguales.......... Este es el inicio de una frase, evidentemente de Poisson, que aparece en su libro, en el Capı́tulo III, y que sorprendentemente no está en el texto, es el inicio de la descripción de la primera sección del capı́tulo. Poisson, es de la época en la que las matemáticas y la literatura eran una, en la que las palabras en matemáticas eran abundantes, en la que implica, considere, y entonces no eran la base del lenguaje matemático, escribir matemáticas en ese entonces, era expresar nuestro sentir. Esta necesidad lleva a Poisson a encontrar una expresión asintótica para para la ecuación (2.1), cuando p ≈ nλ . Ası́ si denotamos λ = np, obtenemos: P [Sn = k] = = (2.2) = n! pk (1 − p)n−k (n − k)! k! k n−k n! λ λ 1− (n − k)! k! n n −k n n(n − 1) · · · (n − k + 1) λk λ λ 1 − 1 − . nk k! n n 224 BEGOÑA FERNÁNDEZ FERNÁNDEZ Si n es grande (y por lo tanto, p pequeña), tenemos −k n(n − 1) · · · (n − k + 1) λ ≈ 1, 1 − ≈ 1, nk n 1− λ n n ≈ e−λ . De donde, para n grande y p pequeña λk −λ e k! Lo que hemos obtenido no es otra cosa que la densidad Poisson con parámetro λ > 0. Algunos podrı́an decir, aparecen nuevamente los factoriales, pero ya no dependen del número n de ensayos, la expresión (2.3) sólo depende de λ. Si la observamos bien, lo que tenemos para cada k son los términos del desarrollo en serie de Taylor de eλ , multiplicados por el recı́proco de esta función -que es natural, pues deben ser números entre 0 y 1-. La función exponencial es una de nuestras predilectas, pues la entendemos y podemos jugar con ella como queramos. Esta no es la única aproximación, también el Teorema de Lı́mite Central nos da algo similar. Una discusión interesante que compara ambas aproximaciones puede verse en Feller [6] pag. 198. Con esta demostración de Poisson, sabemos como se comporta, pero como siempre, quisiéramos saber ¿dónde se usa?. Poisson no menciona nada en su libro, sin embargo, puede consultarse la historia de las aplicaciones en Haight[9], o en cualquier libro de Probabilidad básica o avanzada. Mencionamos sólo aqui algunas de las más comunes: El número de errores tipográficos en cada página de un libro, el número de personas que llegan a una edad avanzada, digamos 100 años en una ciudad, el número de llamadas equivocadas por dı́a, el número de partı́culas radioactivas emitidas por un material en un perı́odo de tiempo fijo, el número de accidentes por dı́a en una carretera, el número de temblores en una ciudad por año, entre otros. En la siguiente sección estudiaremos el problema dinámico, es decir, estudiaremos el número de eventos que ocurren en intervalos de tiempo [0, t], para cada t > 0. (2.3) P [Sn = k] ≈ 3. Tiempos Aleatorios, el Proceso Poisson y Algunas de sus Variaciones Nuestro objetivo será ahora contar el número de eventos raros que ocurren en cada intervalo de tiempo [0, t]. Es decir, queremos construir una familia de variables aleatorias N = {Nt , t ≥ 0} tales que para cada t: Nt = número de eventos que ocurren en el intervalo [0, t]. Por convención, ponemos el contador en ceros, es decir, N0 = 0. Lo primero que debemos decir de esta familia de variables aleatorias es que si t1 < t2 , LA LEY DE LOS EVENTOS RAROS 225 entonces Nt1 ≤ Nt2 , pues el número de eventos que ocurren en el intervalo [0, t1 ] es menor o igual a los que ocurren en [0, t2 ]. Hay diferentes formas de construir esta familia de variables aleatorias, todas ellas son equivalentes, pero elegimos la que consideramos más apropiada a nuestros intereses. Definición 3.1. Una familia {Nt , t ≥ 0} con valores en IN ∪ {0} se dice que es un Proceso Poisson con intensidad (o tasa ) λ > 0 si satisface las siguientes propiedades: (i): N0 = 0. (ii): Si s < t, entonces Ns ≤ Nt . (iii): Para toda n > 0 y 0 < t1 < t2 · · · < tn , las variables aleatorias Nt1 , Nt2 − Nt1 , · · · Ntn − Ntn−1 , son independientes. (iv): Para toda h > 0 y t ∈ IR+ , Nh y Nt+h − Nt tienen la misma distribución. (v): P [Nh = 1] = λh + o(h)7 (vi): P [Nh ≥ 2] = o(h). A los procesos estocásticos que satisfacen la Condición (iii) se les conoce en la literatura como procesos con incrementos independientes y a los que satisfacen (iv) como estacionarios. La Condición (v) nos dice que la probabilidad de que ocurra un evento en el intervalo [0, h] es proporcional a la longitud del intervalo más una función que tiende a cero más rápido que h. Esta condición junto con (vi) es lo que representa que los eventos que queremos contar son raros, pues tenemos que P [Nh = 0] = 1 − P [Nh = 1] + P [Nh ≥ 2] = 1 − λh + o(h). Ası́, para h pequeña esto es muy cercano a 1, lo que nos dice que en un intervalo pequeño es más probable que no ocurran eventos a que si ocurran. Más precisamente, si denotamos por P0 (t) = P [Nt = 0]. P0 (t + h) = P [Nt+h = 0] = P [Nt = 0, Nt+h − Nt = 0] = P [Nt = 0]P [Nt+h − Nt = 0], (3.1) = P0 (t)[1 − λh + o(h)], por (iii) por (iv)-(v), o(h) 7o(h) es una función tal que lim h→0 h = 0, es decir, es una función que tiende a cero más rapidamente que h. 226 BEGOÑA FERNÁNDEZ FERNÁNDEZ de donde P0 (t + h) − P0 (t) = −P0 (t)λh + o(h). h Tomando el lı́mite cuando h tiende a cero, obtenemos P00 (t) = lim h→0 P0 (t + h) − P0 (t) = −λP0 (t). h Esta ecuación diferencial tiene como solución P0 (t) = Ke−λt , K = P0 (0). De (i), tenemos P0 (0) = P [N0 = 0] = 1, por lo tanto, K = 1, es decir (3.2) P0 (t) = P [Nt = 0] = e−λt . Esta expresión es más clara, pues para t pequeña e−λt ≈ 1. Aún más, de ocurrir eventos en un intervalo pequeño lo más probable es que sólo sea uno pues la probabilidad de que ocurran dos o más es del orden de o(h). Ası́, podemos esperar que como función de t el Proceso Poisson sea una función constante por pedazos con saltos de tamaño 1. En la Figura 1 mostramos dos simulaciones del Proceso Poisson con intensidades λ = 0.5 y λ = 3. Podemos observar que los intervalos en los que el Proceso es constante son de longitud variable, esto se debe a que es una magnitud aleatoria, por lo que nos interesa estudiar los tiempos en los que salta el Proceso, es decir, definimos W0 = 0 y para n ≥ 1 Wn = inf{t ≥ 0 | Nt = n}, es decir, el tiempo en el que ocurre el n-ésimo salto y por Tn = Wn − Wn−1 , los tiempos entre los saltos. Es importante observar que Wn , Tn , n ≥ 1 son funciones de una familia infinita de variables aleatorias. En la Figura 2 se muestra una simulación del Proceso Poisson y los tiempos Wi y Ti . Estudiar a Wi , Ti no es otra cosa que encontrar su función de distribución. La distribución de los tiempos Ti , la podemos obtener directamente de P [Nt = 0] ya que P [T1 > t] = P [Nt = 0] = e−λt . Es decir, T1 tiene distribución exponencial con parámetro λ. Por otro lado, la distribución de T2 la podemos obtener condicionando con respecto a T1 , es LA LEY DE LOS EVENTOS RAROS 227 Figura 1. Proceso Poisson 7 6 5 4 3 2 1 0 1 2 3 4 5 6 7 8 9 10 35 30 25 20 15 10 5 0 1 2 3 4 5 6 7 8 9 10 decir, Z P [T2 > t] t P [T2 > t | T1 = s]e−λs ds = λ 0 Z t = λ (3.3) = e 0 −λt P [Nt+s − Ns = 0]e−λs ds por (iii) 228 BEGOÑA FERNÁNDEZ FERNÁNDEZ Figura 2. El Proceso Poisson y los Tiempos de Salto De esta expresión tenemos varias conclusiones, por un lado tenemos que T1 y T2 son independientes ya que P [T2 > t | T1 = s] no depende s, son idénticamente distribuidas con distribución exponencial con parámetro λ. Por argumentos similares se puede demostrar que (Tn )n≥1 es una sucesión de variables aleatorias independientes e idénticamente distribuidas. Por otro lado, para cada n ≥ 1 tenemos Wn = n X Ti , i=1 lo que implica (ver [15] pag. 269) que Wn es una variables aleatoria Gamma con parámetros n y λ. Finalmente, con esta información podemos calcular la densidad de Nt para cada t > 0 ya que P [Nt = n] (3.4) = P [Nt ≥ n] − P [Nt ≥ n + 1] = P [Wn ≤ t] − P [Wn+1 ≤ t] Z t Z t (λs)n−1 (λs)n = λe−λs ds − λe−λs ds (n − 1)! n! 0 0 (λt)n = e−λt . n! LA LEY DE LOS EVENTOS RAROS 229 En resumen, hemos obtenido que si Nt t ≥ 0 es un Proceso Poisson con intensidad λ > 0 entonces (1) Para cada t > 0, Nt es una variable aleatoria Poisson con parámetro λt. (2) La sucesión (Tn )n≥1 de los tiempos entre los saltos es una sucesión de variables aleatorias independientes, idénticamente distribuidas exponenciales con parámetro λ. (3) Para cada n ≥ 1 el tiempo del n-ésimo salto salto Wn es una variable aleatoria Gamma con parámteros n y λ. Estas propiedades a primera vista podrı́an parecer contradictorias. Por un lado en cada tiempo fijo t la probabilidad de que ocurra un evento en ese instante es igual a cero, ya que P [Wn = t] = 0, para toda n ≥ 1. Por otro lado, para t fija, la probabilidad de que ocurran n eventos en un intervalo de longitud t es positiva para toda n > 0, pues P [Wn ≤ t] > 0. Sin embargo, no sólo no son contradictorias, sino son la descripción matemática más precisa de lo que significan los eventos raros. Estos eventos ocurren, sin embargo, la probabilidad de que ocurran en un tiempo fijo es cero. Ésta es la naturaleza de los tiempos aleatorios. Una de las aplicaciones importantes del Proceso Poisson es en el estudio del número de accidentes que ocurren en cada perı́odo de tiempo y su relación con el capital de una compañı́a aseguradora. Haight [9] pag. 114 refiere a una conversación privada con W. Kruskal, en la que comentan que el primero que recomienda el uso de la distribución Poisson en seguros (de vida) fue Cournot en 1843 [3] y no fue sino hasta 1903 que Filip Lundberg [12] en su tesis doctoral descubre -como dice el Prof. Paul Embrechts [5] pag. 22- que el Proceso Poisson está en el corazón de de los modelos de seguros (no vida). En palabras de Paul Embrechts: This “discovery” is similar to the recognition by Bachelier in 1900 that Brownian Motion is the key building block for financial models. Este “descubrimiento” es similar al reconocimiento por Bachelier en 1900 de que el Movimiento Browniano es la pieza angular para los modelos financieros. Posteriormente, Cramér [4] y su Escuela de Estocolmo desarrollan las ideas de Lundberg, en la teorı́a de Proceos Estocásticos y dan lugar a lo que se conoce como el Proceso de Ruina o Modelo de Cramér-Lundberg. La intención es construir un modelo que describa en cada tiempo t ≥ 0 la reserval de una compañı́a de seguros. En general un modelo que describe en cada tiempo t ≥ 0 la reserva Rtx de una compañı́a aseguradora está constituido por tres elementos, el capital inicial x, los ingresos (acumulados) por concepto de primas Pt y los egresos (acumulados) 230 BEGOÑA FERNÁNDEZ FERNÁNDEZ St por las reclamaciones (acumuladas) de los asegurados, es decir, es de la forma: Rtx = x + Pt − St En el Modelo de Cramér-Lundberg se considera que el proceso Pt es lineal y determinista, es decir, de la forma Rtx = x + ct − St . El monto de las reclamaciones está descrito por variables aleatorias independientes e idénticamente distribuidas y ocurren de acuerdo a un Proceso Poisson con intensidad λ. Nuevamente en el tiempo 0 iniciamos el contador y para cada t > 0 el monto que la aseguradora ha pagado hasta el tiempo t será la suma de todas las reclamaciones hasta el tiempo t, en otras palabras es la suma de variables aleatorias independientes e idénticamente distribuidas y el número de términos de esta suma estará dado por el Proceso Poisson al tiempo t es decir, por Nt . En otras palabras será una suma aleatoria de variables aleatorias. Más precisamente sea (Nt )t≥0 un Proceso Poisson con intensidad λ > 0 y (Yn )≥1 variables aleatorias positivas, independientes, idénticamente distribuidas e independientes del Proceso Poisson, entonces (3.5) St = Nt X Yi i=1 representa las erogaciones de la empresa hasta el tiempo t. Este proceso es llamado Proceso Poisson Compuesto y tiene propiedades similares al Proceso Poisson, lo único que los hace diferentes es el tamaño de los saltos que están descritos por las variables aleatorias Yi En las Figura 3 se muestran simulaciones del Proceso Poisson Compuesto con saltos exponenciales con parámetro 3 y lognormales con parámetros (3, 25). Ası́, el Modelo de Cramér-Lundberg es de la forma (3.6) Rtx = x + ct − St = x + ct − Nt X Yi , i=1 donde c es constante. En la Figura 4 presentamos una simulación del Proceso de Cramér Lundberg. Los tiempos y el tamaño de los saltos son iguales que en el Proceso Poisson Compuesto. Entre los saltos, el proceso es creciente. En la siguiente sección estudiaremos a este proceso con más detalle. 4. La Probabilidad de Ruina en el Modelo LA LEY DE LOS EVENTOS RAROS 231 Figura 3. Proceso Poisson Compuesto 90 80 70 60 50 40 30 20 10 1 2 3 4 5 6 7 8 9 10 4 5 6 7 8 9 10 600 500 400 300 200 100 1 2 3 de Cramér-Lundeberg y Ecuaciones Integro-Diferenciales Uno de los problemas que se estudian es el siguiente: dadas c, λ y la distribución de las variables Yi ¿cuál es la probabilidad de ruina para cada x ≥ 0?, en otras palabras ¿Cuál es la probabilidad de que eventualmente la compañı́a 232 BEGOÑA FERNÁNDEZ FERNÁNDEZ Figura 4. Proceso de Cramér-Lundberg tenga un capital negativo?. Sea τ x el tiempo de ruina, es decir: τ x = inf{t > 0 | Rtx < 0}, donde si inf{t > 0 | Rtx < 0} = ∅, τ x = ∞. Queremos calcular: P [τ x < ∞] Nuevamente, el tiempo τ x es una función de una familia infinita de variables aleatorias, pero ahora con la posibilidad de tomar el valor ∞. En la Figura 5 presentamos dos simulaciones del Proceso de Cramér-Lundberg, en (b) la ruina ocurre en el tiempo t = 5.8. Para tener una idea intuitiva de este proceso, iniciaremos su análisis con el estudio de su esperanza, ası́: E[Rtx ] = x + ct − µλt = x + (c − µλ)t. Observemos que si c − µλ < 0, para t suficientemente grande tendremos que E[Rtx ] < 0, aún más dada M < 0 para t suficientemente grande E[Rtx ] < M . Esto nos hace sospechar que en este caso es muy probable que se eventualmente la empresa se aruine. De hecho, se puede demostrar ver [2] pag.59 que P [τ x < ∞] = 1, si c − λµ ≤ 0. Por lo tanto supondremos que c − µλ > 0. LA LEY DE LOS EVENTOS RAROS 233 Figura 5. Proceso Cramér-Lundberg 25 20 15 10 0 2 4 6 8 10 0 2 4 6 8 10 14 12 10 8 6 4 2 0 Habitualmente se estudia la probabilidad de supervivencia que denotaremos por δ(x), es decir, δ(x) = 1 − P [τ x < ∞] 234 BEGOÑA FERNÁNDEZ FERNÁNDEZ Observemos que la ruina puede ocurrir sólo en los tiempos de salto del Proceso Poisson, pues entre ellos el proceso es creciente, por lo tanto calcular la probabilidad de supervivencia se reduce a calcular: δ(x) P [St − ct ≤ x, para toda t > 0] " n # X P (Yk − cTk ) ≤ x para toda n ≥ 1 , = = i=1 donde las Tk son los tiempos entre los saltos del Proceso Poisson. Condicionando con respecto a Y1 , T1 , obtenemos " n # X P (Yk − cTk ) ≤ x para toda n ≥ 1 | T1 = s, Y1 = y i=1 " n X (Yk − cTk ) ≤ x + cs − y para toda n ≥ 2, y − cs ≤ x P = # i=2 Si las variables aleatorias Yi tienen densidad f , entonces δ(x) Z ∞ Z = 0 0 u+cs " # n X P (Yk − cTk ) ≤ x + cs − y ∀ n ≥ 2 f (y)dyλe−λs ds. i=2 La probabilidad que aparece dentro de la integral es la probabilidad de supervivencia de un Proceso de Cramér-Lundberg con capital inicial igual a x+cs−y, por lo que Z ∞ Z x+cs = λe−λs δ(x + cs − y)f (y)dyds 0 0 Z z Z λ ∞ −λz/c = (4.1) e δ(z − y)f (y)dy dz c x 0 donde la última igualdad se obtiene haciendo el cambio de variable x+cs = z. El argumento que acabamos de utilizar se conoce como argumento de renovación. Si suponemos que la densidad f de las variables Yi es continua, obtenemos que δ(x) es diferenciable y su densidad satisface: Z λ λ x δ(x − y)f (y)dy. (4.2) δ 0 (x) = δ(x) − c c 0 El problema aparentemente está resuelto, tenemos una ecuación integro-diferencial para la probabilidad de supervivencia, sólo hay que resolverla. La solución depende claramente de la función de densidad de las las variables Yi . Uno de los casos para los que existe una solución explı́cita es cuando las variables aleatorias Yi son exponenciales y la solución está dada por: LA LEY DE LOS EVENTOS RAROS 235 1 ρ exp − x , x ≥ 0, 1+ρ µ(1 + ρ) donde ρ = c/(λµ) − 1. Para otros casos, puede consultarse Asmussen [2]. Una discusión sobre esta ecuación puede encontrarse en [5]. En estas dos referencias aparecen también otros métodos para calcular la probabilidad de ruina ver también Grandel [8]. Si Poisson aún viviera y tuviera ante él esta ecuación, quizás tendrı́a una sección en alguno de sus libros que iniciarı́a asi: Necesidad de recurrir a métodos de aproximación para la solución de una ecuación integro-diferencial. Afortunadamente, tanto Lundberg como Cramér tuvieron esta misma inquietud y la resolvieron, al menos cuando las distribuciones de las variables Yi aceptan transformada de Laplace. En este caso, tenemos la llamada desigualdad de Lundberg [13] δ(x) = 1 − (4.3) P [τ x < ∞] ≤ e−γx , donde γ es conocido como el coeficiente de ajuste o coeficiente de Lundberg y es la máxima raiz positiva de la ecuación h(γ) = −cγ + λ(Lf (γ) − 1) = 0, y Lf (γ) es la transformada de Laplace de la densidad f . Por otro lado, se tiene también la llamada Aproximación de Cramér Lundberg, −1 Z ∞ γ ueγu (1 − F (u))du , lim eγx P [τ x < ∞] = C < ∞, C = x→∞ ρµ 0 donde, F es la función de distribución de las variables Yi . Existen resultados similares (las cotas no son de tipo exponencial) cuando las variables aleatorias Yi no aceptan transformada de Laplace pero son de tipo sub-exponencial. Para la demostración de estos resultados, ampliar y profundizar los conocimientos sobre este tema puede consultarse [2, 5, 8]. Hay una gran variedad de extensiones de este modelo, desde encontrar la estrategia óptima de reaseguro (ver por ejemplo [16]) hasta considerar que la compañı́a puede invertir en un activo con riesgo y encontrar la estrategia óptima de inversión (ver por ejemplo [7, 10, 16] y la bibliografı́a contenida en estas referencias) entre otros. Por último quisiera terminar este artı́culo con un comentario de Poisson [14] pag. 36 acerca de de la Probabilidad, descripción que los apasionados de lo aleatorio traemos siempre con nosotros: une des principales branches des mathématiques, soit par le nombre et l’utilité de ses applications, soit par le genre d’analyse auquel il a donné naissance. 236 BEGOÑA FERNÁNDEZ FERNÁNDEZ Aucune autre partie des mathemátiques n’est susceptible d’applications plus nombreuses et plus immédiatement utiles. una de las principales ramas de las matemáticas, sea por el número y la utilidad de sus aplicaciones, sea por el tipo de análisis al que ha dado nacimiento. Ninguna otra rama de las matemáticas es tan susceptible de aplicaciones tan numerosas y tan inmediatamente aplicables. Agradecimientos. Este trabajo fué parcialmente financiado por Proyecto PAPIIT-DGAPA-UNAM IN103606, México. Quisiera agradecer a los organizadores del Congreso Regional de Probabilidad y Estadı́stica de la UJAT por la invitación a escribir un artı́culo de divulgación. A mi entrañable amiga Beatriz Rodrı́guez por su entusiasmo cuando leyó la primera versión de este trabajo, que no es sino el producto de nuestras muy largas conversaciones a lo largo de los años, pues el Proceso Poisson es uno de nuestros temas predilectos. A Ana Meda con quien también he tenido una gran afinidad e hizo algunas correcciones de imprecisiones en la primera versión. A los encuentros con Victor Pérez Abreu que están descritos en los últimos años por un Proceso Poisson, especialmente el último, en el que ocurrieron dos eventos de probabilidad cero, su visita a mi oficina y el hecho de que exactamente en esa ocasión conversáramos sobre el Proceso Poisson. Esto no es sorprendente pues como decimos Beatriz y yo y como hemos visto en este trabajo, los eventos que ocurren son los de probabilidad cero. A Juan Martin Barrios quien no sólo leyó cuidadosamente una parte del artı́culo sino que me apoyó con las simulaciones y las gráficas que aparecen en el texto. Finalmente al revisor anónimo del artı́culo por sus comentarios que ayudaron a mejorarlo. Bibliografı́a [1] F. Arago, Siméon Denis Poisson. Oeuvres complètes de Francois Arago II. Paris, (1984), 591-698. [2] S. Asmussen, Ruin Probabilities. World Scientific, Advances Series on Statistical Science and Applied Probability, 2, (2000). [3] A-A Cournot, Expositions de la théorie ded chances et de probabilités. Paris, (1843). [4] H. Cramér, On the Mathematical Theory of Risk. Skandia Jubilee Volume, Stocholm, (1930). [5] P. Embrechts, C. Kluppelberg, T. Mikosch, Modelling Extremal Events for Insurance and Finance. Applications of Mathematics Stochastic Modelling and Applied Probability, 33, Springer, (1977). [6] W. Feller, Introducción a la Teorı́a de Probabilidades y sus Aplicaciones. Volumen 1, Segunda reimpresión. Limusa, (1980). [7] G. Gaier, P. Grandits, W. Schachermayer, Assymptotic Ruin Probabilities and Optimal Investment. Annals of Appl. Prob. 13, no. 3, (2003), 1054-1076. [8] J. Grandell, Aspects of Risk Theory. Springer, Berlin, (1991). [9] F. A. Haight, Handbook of Poisson Distribution. New York, (1967). LA LEY DE LOS EVENTOS RAROS 237 [10] C. Hipp, M. Plum, Optimal Investment for Insurers. Insurance, Math. and Econom. 27, (2003), 215-228. [11] S. Karlin, H. M. Taylor, A Second Course in Stochastic Processes. Academic Press, Inc. New York, (1986). [12] F. Lundberg, Approximerad främstallning av sannolikhetsfunktionen. Aterförsäkring av kollektivrisker. Akad. Afhandling. Almqvist och Wiksell, Upsala, (1903). [13] F. Lundberg, Forsakringsteknisk Riskutjamming. F. Englunds Boktryckeri AB, Stockholm, (1926). [14] S. D. Poisson, Recherches sur la Probabilité des Jugements en Matière Criminèlle et en Matière Civile. [15] S. Ross, A First Course in Probability. Fourth Edition. Prentice Hall, (1994). [16] H. Schmidli, Optimisation in non life insurance. Stochastic Models. Special issue: Proceedings of the 8 th. Sym. on Prob. and Stoch. Processes. 22, no. 4, (2006). [17] O. B. Sheynin, S. D. Poisson’s work in probability. Arch. History Exact Sci. 18, no. 3, (1977/78), 245-300.