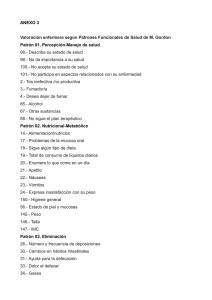

Desarrollo de una aplicación de realidad aumentada para

Anuncio