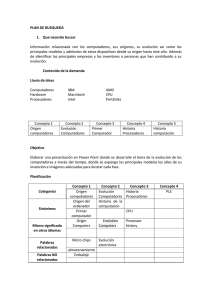

ALGORITMOS Y PROGRAMACIÓN DE COMPUTADORES

Anuncio