b - Universidad Complutense de Madrid

Anuncio

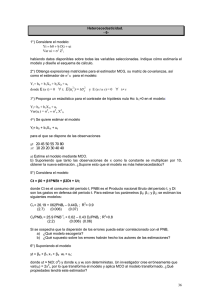

ECONOMETRÍA Facultad de Ciencias Económicas y Empresariales 3 REGRESIÓN LINEAL MÚLTIPLE II José Alberto Mauricio Departamento de Economía Cuantitativa Internet - http://www.ucm.es/info/ecocuan/jam/ectrgr COPYRIGHT 2012-2013 José Alberto Mauricio E-mail: [email protected] Internet: http://www.ucm.es/info/ecocuan/jam Este documento puede utilizarse exclusivamente como instrumento para la docencia de las asignaturas ECONOMETRÍA ECONOMETRÍA APLICADA que se imparte en la Facultad de Ciencias Económicas y Empresariales de la Universidad Complutense de Madrid. No se permite almacenar, reproducir o distribuir por medio alguno, ni tampoco utilizar este documento en cualquier sentido, fuera de los términos mencionados anteriormente. La obtención de este documento (EctrGr-JAM-3.pdf) en la dirección de Internet http://www.ucm.es/info/ecocuan/jam/ectrgr implica la aceptación de que su uso estará limitado a los términos anteriores. Versión 2.0 - 4 de febrero de 2013 II 3 REGRESIÓN LINEAL MÚLTIPLE II BIBLIOGRAFÍA Wooldridge (2003), Capítulos 7, 8. Sección 9.4. Heij, de Boer, Franses, Kloek, van Dijk (2004), Secciones 5.3, 5.4, 5.6. III CONTENIDO 3.1 Variables Explicativas Binarias ............................................................................... Términos Constantes Distintos ................................................................................... Pendientes Distintas .................................................................................................... Extensiones ................................................................................................................. 1 1 4 6 3.2 Diagnosis de Residuos ........................................................................................... 10 Análisis Gráfico ......................................................................................................... 11 Observaciones Influyentes ........................................................................................ 15 3.3 Heteroscedasticidad ............................................................................................... Consecuencias .......................................................................................................... Utilización Adecuada de MCO .................................................................................. Detección ................................................................................................................... Mínimos Cuadrados Ponderados .............................................................................. 24 26 27 28 35 3.4 Recomendaciones Prácticas .................................................................................. 41 IV 3.1 Variables Explicativas Binarias Las variables explicativas binarias se utilizan para clasicar todas las observaciones de una muestra en dos o más categorías (grupos) exhaustivas y excluyentes en función de una característica determinada, como en los dos ejemplos siguientes: Dividir una serie temporal en dos períodos para contrastar la estabilidad de los parámetros de un modelo entre dichos períodos (cambio estructural). Dividir una sección cruzada en dos grupos (por ejemplo hombres y mujeres) para contrastar la homogeneidad de los parámetros de un modelo entre dichos grupos. TÉRMINOS CONSTANTES DISTINTOS [MR.1] Y = b1 + b2 X + U . [MNR.1.1] Y = b1 A DA + b1 B DB + b2 X + V , donde b1A , b1B son términos constantes posiblemente distintos entre sí (Figura 1), y DA , DB son dos variables binarias. ECONOMETRÍA PÁGINA 1 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.1 VARIABLES EXPLICATIVAS BINARIAS Y : VARIABLE DEPENDIENTE FIGURA 1 MNR.1 - Términos Constantes Distintos - Pendientes Iguales E A [ Y|X ] = β1A + β2 X α AB β1A Pendiente = β2 β1B EB [ Y|X ] = β1B + β2 X 0 X : VARIABLE EXPLICATIVA ECONOMETRÍA PÁGINA 2 3 · REGRESIÓN LINEAL MÚLTIPLE II DA 3.1 VARIABLES EXPLICATIVAS BINARIAS ìï 1 para observaciones del grupo A. º ïí ïï 0 para el resto. î DB ìï 1 para observaciones del grupo B . º ïí ïï 0 para el resto. î DA + DB = 1 en cada observación (clasicación exhaustiva y excluyente). DB = 1 - DA (alternativamente, DA = 1 - DB ), por lo que [MNR.1.1] queda: Y = b1 B + ( b1 A - b1 B )DA + b2 X + V , o bien: [MNR.1.2] Y = b1 B + aAB DA + b2 X + V . EA [Y | X = X * ] - EB [Y | X = X * ] = aAB = b1 A - b1 B . El contraste de H 0 : b1 A = b1 B ( aAB = 0) frente a H 1 : b1 A = / b1 B ( aAB = / 0) es un simple contraste de signicación individual en [MNR.1.2]. También valdrían alternativas unilaterales, como H 1 : b1 A > b1 B ( aAB > 0) , o bien como H 1 : b1 A < b1 B ( aAB < 0). ECONOMETRÍA PÁGINA 3 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.1 VARIABLES EXPLICATIVAS BINARIAS La categoría (grupo) cuya variable binaria no aparece explícitamente en el modelo no restringido se denomina la categoría base o de referencia. PENDIENTES DISTINTAS [MR.1] Y = b1 + b2 X + U . [MNR.2.1] Y = b1 + b2 A ( DA X ) + b2 B ( DB X ) + V , donde b2 A , b2 B son dos pendientes posiblemente distintas entre sí (Figura 2). Como DB = 1 - DA (alternativamente, DA = 1 - DB ), [MNR.2.1] queda: Y = b1 + b2 B X + ( b2 A - b2 B )( DA X ) + V o bien: [MNR.2.2] Y = b1 + b2 B X + dAB ( DA X ) + V . EA [Y | X = X * ] - EB [Y | X = X * ] = dAB X * = ( b2 A - b2 B )X * . El contraste de H 0 : b2 A = b2 B ( dAB = 0) frente a H 1 : b2 A = / b2 B ( dAB = / 0) es un simple contraste de signicación individual en [MNR.2.2]. ECONOMETRÍA PÁGINA 4 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.1 VARIABLES EXPLICATIVAS BINARIAS Y : VARIABLE DEPENDIENTE FIGURA 2 MNR.2 - Términos Constantes Iguales - Pendientes Distintas E A [ Y|X ] = β1 + β2A X Pendiente = β2A δ AB X β1 Pendiente = β2B EB [ Y|X ] = β1 + β2B X 0 X : VARIABLE EXPLICATIVA ECONOMETRÍA PÁGINA 5 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.1 VARIABLES EXPLICATIVAS BINARIAS EXTENSIONES Términos constantes y pendientes distintos Y = b1 + b2 X + U . [MR.1] [MNR.3.1] Y = b1 A DA + b1 B DB + b2 A ( DA X ) + b2 B ( DB X ) + V (Figura 3). Como DB = 1 - DA (alternativamente, DA = 1 - DB ), [MNR.3.1] queda: Y = b1 B + ( b1 A - b1 B )DA + b2 B X + ( b2 A - b2 B )( DA X ) + V o bien: [MNR.3.2] Y = b1 B + aAB DA + b2 B X + dAB ( DA X ) + V . EA [Y | X = X * ] - EB [Y | X = X * ] = aAB + dAB X * . El modelo [MNR.3] es el modelo no restringido más general (el menos restringido), que puede compararse con cualquiera de los modelos [MR.1], [MNR.1], [MNR.2], para contrastar una gran variedad de hipótesis sobre la estabilidad (homogeneidad) de los parámetros entre las dos categorías consideradas. ECONOMETRÍA PÁGINA 6 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.1 VARIABLES EXPLICATIVAS BINARIAS Y : VARIABLE DEPENDIENTE FIGURA 3 MNR.3 - Términos Constantes y Pendientes Distintos EB [ Y|X ] = β1B + β2B X α AB + δ AB X β1B β1A Pendiente = β2A Pendiente = β2B E A [ Y|X ] = β1A + β2A X 0 X : VARIABLE EXPLICATIVA ECONOMETRÍA PÁGINA 7 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.1 VARIABLES EXPLICATIVAS BINARIAS / (0, 0)¢ Por ejemplo, el contraste de H 0 : ( aAB , dAB )¢ = (0, 0)¢ frente a H 1 : ( aAB , dAB )¢ = en [MNR.3.2] (contraste de signicación conjunta de aAB y dAB ), es idéntico al Test de Chow de ausencia de cambio estructural en un modelo RLS (que puede llevarse a cabo comparando la SCR de [MNR.1] con la de [MNR.3]). Más de dos grupos por característica Los modelos [MNR.1.2], [MNR.2.2], [MNR.3.2], indican que para clasicar las observaciones de una muestra en G grupos o categorías, es suciente incluir en un modelo G - 1 variables binarias. El grupo cuya variable binaria no se incluye es el grupo base o de referencia. Más de una característica Para clasicar las observaciones de una muestra atendiendo a más de una característica, se emplea un conjunto de variables binarias especíco para cada característica. Cuando en un modelo se incluyen dos o más conjuntos de variables binarias, se puede considerar la existencia de posibles interacciones entre las características correspondientes. ECONOMETRÍA PÁGINA 8 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.1 VARIABLES EXPLICATIVAS BINARIAS Ejemplo I: Estacionalidad - ST10-Ventas2.wf1 ln VENTAS = g1 + g 2 D2 + g 3 D 3 + g 4 D 4 + b1 ln ICAPC + b2 ln ICONF + U . En particular, 100g 2 @ diferencia esperada en % entre las ventas del 2o y el 1er trimestre. Ejemplo II: Interacciones - SC04-Salarios4.wf1 ln SLRPH = g1 + g 2 MUJER + g 3 ECIV + b1 EDUC + b2 EXLP + b3 EXLP 2 + U . En particular, 100g 2 @ diferencia esperada en % entre los salarios de una mujer y de un hombre con el mismo estado civil (independientemente de cuál sea éste). ln SLRPH = g1 + g 2 MUJER + g 3 ECIV + g 4 ( MUJER ´ ECIV ) + b1 EDUC + b2 EXLP + b3 EXLP 2 + U . En particular, 100g 2 @ diferencia esperada en % entre los salarios de una mujer y de un hombre ambos solteros (especícamente). Si g 4 = / 0 , la diferencia porcentual entre los salarios esperados de una mujer y de un hombre depende de su estado civil. ECONOMETRÍA PÁGINA 9 3.2 Diagnosis de Residuos Complicated phenomena, in which several causes concurring, opposing, or quite independent of each other, operate at once, so as to produce a compound effect, may be simplified by subducting the effect of all the known causes, as well as the nature of the case permits, either by deductive reasoning or by appeal to experience, and thus leaving, as it were, a residual phenomenon to be explained. It is by this process, in fact, that science, in its present advanced state, is chiefly promoted. JOHN F.W. HERSCHEL A Preliminary Discourse on the Study of Natural Philosophy 1830 Citado en Cook, R.D.; Weisberg, S. (1982), "Residuals and Influence in Regression", Chapman & Hall Evaluar la abilidad de un modelo RLM estimado ( y = X bˆ + uˆ ) requiere comparar las propiedades muestrales de sus residuos con las pautas teóricas de las perturbaciones impuestas por las hipótesis del modelo especicado ( Y = X b + U ). Cualquier discrepancia signicativa debe resolverse modicando el modelo en la dirección adecuada. ECONOMETRÍA PÁGINA 10 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS ANÁLISIS GRÁFICO Las hipótesis E[U i X ] = 0 (exogeneidad estricta) y E[U i2 X ] = s 2 (homoscedasticidad) sugieren que el nivel medio y la dispersión de los residuos deben ser constantes (en particular, deben ser independientes de los datos sobre todas las variable explicativas). Ambas hipótesis pueden contrastarse (informalmente) examinando grácos de dispersión (nubes de puntos) de los residuos sobre las variables explicativas y/o los valores ajustados. Si el orden de las observaciones es relevante (series temporales), las dos hipótesis anteriores y la hipótesis E[U i1U i2 X] = 0 (ausencia de autocorrelación) también pueden contrastarse examinando un simple gráco ordenado (temporal) de los residuos. Con frecuencia, el incumplimiento de HC3-HC4 se debe a errores de especicación en el conjunto de variables explicativas o en la forma funcional del modelo (Secciones 2.1, 2.5). La hipótesis de Normalidad (HC5) puede contrastarse con el histograma de los residuos. El examen de los grácos mencionados también ayuda a detectar observaciones atípicas que pueden inuir notablemente en los resultados de la estimación de un modelo. ECONOMETRÍA PÁGINA 11 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS FIGURA 4 Análisis Gráfico de Residuos I Variables Omitidas - Forma Funcional 2 2 1 1 RESIDUOS RESIDUOS Sin síntomas de mala especificación 0 0 -1 -1 -2 -2 -2 -1 0 1 VALORES AJUSTADOS ECONOMETRÍA 2 Contrastes de Significación RESET -2 -1 0 1 2 VALORES AJUSTADOS PÁGINA 12 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS FIGURA 5 Análisis Gráfico de Residuos II Autocorrelación 2 2 1 1 RESIDUOS RESIDUOS Heteroscedasticidad 0 -1 -2 -1 Contrastes de Heteroscedasticidad -2 -1 ACF - PACF - Contrastes de Autocorrelación -2 0 1 VALORES AJUSTADOS ECONOMETRÍA 0 2 0 4 8 12 16 20 Nº DE ORDEN (TIEMPO) PÁGINA 13 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS FIGURA 6 Análisis Gráfico de Residuos III Residuos Normales Residuos No Normales 0.6 Estadístico de Jarque-Bera: Chi-Cuadrado(2) = 1.674 (0.4330) Estadístico de Jarque-Bera: Chi-Cuadrado(2) = 190.256 (0.0000) RESIDUOS N(0.0,1.0) RESIDUOS N(1.7,1.9) 0.4 0.5 0.4 0.3 0.3 0.2 0.2 0.1 0.1 0.0 0.0 -3 ECONOMETRÍA -2 -1 0 1 2 3 -4 -2 0 2 4 6 8 10 12 14 PÁGINA 14 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS OBSERVACIONES INFLUYENTES Una observación (punto muestral) es inuyente si los resultados de la estimación de un modelo cambian notablemente al eliminar de la muestra dicha observación [Figuras 7-9]. En la práctica, la presencia de una observación inuyente en una muestra puede deberse a: Un error en los datos que conforman dicha observación. La existencia de un punto muestral (una entidad o un momento) que es muy diferente del resto en algún aspecto relevante. Una observación inuyente del primer tipo debe corregirse (cuando es posible), o bien eliminarse del análisis (cuando no es posible corregirla). Una observación inuyente del segundo tipo no debe eliminarse de manera rutinaria: Siempre debe ser examinada para intentar explicar su carácter especial. Su presencia puede indicar algún error de especicación que debe ser corregido. Sólo debe eliminarse en casos sucientemente justicados (cuando hace referencia a una entidad o a un momento que es especial por determinados motivos que carecen de interés en el análisis, o cuando distorsiona las conclusiones generales del mismo). ECONOMETRÍA PÁGINA 15 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS Caracterización de observaciones influyentes Una observación es atípica (outlier) cuando su dato de la variable dependiente destaca sobre los datos de dicha variable en otras observaciones que son, por el contrario, similares en cuanto a los datos de las variables explicativas. En general, una observación atípica es al mismo tiempo una observación inuyente, que se maniesta a través de un valor grande (atípico o anómalo) en el residuo correspondiente (Figura 7). Una observación es extrema o potencialmente inuyente (high-leverage point) cuando sus datos de las variables explicativas destacan sobre los datos de dichas variables en el resto de la muestra. Una observación extrema es inuyente cuando su dato de la variable dependiente no destaca del resto de la muestra (Figura 8). A diferencia del caso anterior, una observación extrema inuyente no suele tener asociado un residuo atípico. Una observación extrema cuyo dato de la variable dependiente sí destaca del resto de la muestra, puede ser (Figura 9A) o no (Figura 9B) una observación inuyente; cuando sí lo es, tampoco (como en el caso anterior) suele tener asociado un residuo atípico. ECONOMETRÍA PÁGINA 16 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS FIGURA 7 Observaciones Atípicas 14 ˆ Y1 = 5.812 + 0.096 X1 + U (2.211) (0.232) 12 R 2 = 0.021, N = 10. A 14 ˆ Y1 = 4.094 + 0.357 X1 + U (0.691) (0.075) 12 R 2 = 0.762, N = 9. 10 10 8 8 6 6 û10 : residuo atípico 4 4 2 2 0 0 0 2 4 6 8 10 12 14 16 RLS de Y1 sobre X1 con los datos de la Tabla 1 Muestra completa ECONOMETRÍA 18 B 20 0 2 4 6 8 10 12 14 16 18 20 RLS de Y1 sobre X1 con los datos de la Tabla 1 Sin la observación nº 10 PÁGINA 17 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS FIGURA 8 Observaciones Extremas I 14 ˆ Y2 = 5.791 + 0.219X2 + U (1.011) (0.129) 12 R 2 = 0.264, N = 10. A 14 ˆ Y2 = 2.347 + 0.734X2 + U (2.701) (0.397) 12 R 2 = 0.328, N = 9. 10 10 8 8 6 6 4 4 2 2 0 0 0 2 4 6 8 10 12 14 16 RLS de Y2 sobre X2 con los datos de la Tabla 1 Muestra Completa ECONOMETRÍA 18 20 0 2 4 6 8 10 B 12 14 16 18 20 RLS de Y2 sobre X2 con los datos de la Tabla 1 Sin la observación nº 10 PÁGINA 18 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS FIGURA 9 Observaciones Extremas II 14 ˆ Y3 = 12.065 - 0.719X2 + U (1.587) (0.203) 12 R 2 = 0.611, N = 10. A 14 ˆ Y4 = 2.362 + 0.731X2 + U (0.899) (0.115) 12 R 2 = 0.835, N = 10. 10 10 8 8 6 6 4 4 2 2 0 B 0 0 2 ECONOMETRÍA 4 6 8 10 12 14 16 18 20 0 2 4 6 8 10 12 14 16 RLS de Y3 sobre X2 con los datos de la Tabla 1 RLS de Y4 sobre X2 con los datos de la Tabla 1 Muestra Completa Muestra Completa 18 20 PÁGINA 19 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS TABLA 1 Datos utilizados en las Figuras 7 a 9 - Num03-ObsInf.wf1 1 2 3 4 5 6 7 8 9 10 Y1 Y2 Y3 Y4 X1 X2 8.3 6.0 6.7 7.7 8.1 8.5 5.9 5.4 8.3 2.0* 6.6 5.7 7.3 8.5 8.8 7.0 8.0 7.5 6.4 8.5 6.6 5.7 7.3 8.5 8.8 7.0 8.0 7.5 6.4 1.0* 6.6 5.7 7.3 8.5 8.8 7.0 8.0 7.5 6.4 12.6* 10.8 6.6 9.0 9.6 11.3 13.5 5.8 4.0 8.0 12.4 6.0 6.6 7.6 6.5 7.8 7.0 7.5 6.5 5.4 14.0* Observación: Estimar un modelo [M] eliminando una observación [I] es (casi) equivalente a estimar con la muestra completa el modelo [M]¢ que resulta de añadir a [M] una variable binaria [B] denida para la observación [I]. El contraste de signicación de [B] en [M]¢ puede interpretarse como un contraste de inuencia de la observación [I]. Detección de observaciones influyentes Observaciones atípicas - Grácos de residuos. ECONOMETRÍA PÁGINA 20 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS Observaciones extremas - Grado de inuencia potencial (leverage): hii = xi¢ ( X ¢X )-1 xi (i = 1, ..., N ) 0 £ hii £ 1 (i = 1, ..., N ), å iN=1 hii = K . [1] H º X( X ¢X )-1 X ¢ ˆ = Hy ]. En un modelo RLS: [llamada a veces "matriz sombrero" (hat matrix) porque convierte a y en ŷ : y Observación I: hii es el elemento en la i -ésima posición de la diagonal principal de la matriz hii = ( x - x )2 1 + N i (i = 1, ..., N ). 2 N ( x x ) å i =1 i En general, un valor destacado de hii (por ejemplo, hii > 2K ) implica que los datos de las variables explicativas en la N i -ésima observación destacan al compararlos con la media de los datos de dichas variables en la muestra completa. Observaciones inuyentes en general - Estadístico o Distancia de Cook: uˆi 1 é ù 2 é hii ù Di = ´ê ú ´ê ú (i = 1, ..., N ). K ëê sˆ 1 - hii úû h 1 ii û ë [2] uˆi ) y/o extremo (a través del grado de inuencia potencial hii ) de cada observación muestral. La distancia Di es una medida de la diferencia entre las estimaciones de los parámetros de un modelo obtenidas con la muestra completa y las obtenidas sin la i -ésima observación (o, equivalentemente, entre los valores ajustados asociados con ambas estimaciones). Por lo tanto, un valor destacado de Di [por ejemplo, mayor que el valor crítico del 5% de una F (K , N - K ) ] suele implicar que la i -ésima observación muestral es una observación inuyente. Observación II: En Di se combina información sobre el posible carácter atípico (a través del residuo ECONOMETRÍA PÁGINA 21 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS FIGURA 10 Ejemplo - Detección de Observaciones Influyentes I 1.0 70 3 7 60 0.8 2 0 5 -1 0.6 COOK LEVERAGE RESIDUOS 50 1 0.4 4 40 30 20 -2 0.2 19 10 -3 0.0 -3 -2 -1 0 1 2 VALORES AJUSTADOS 3 0 1 5 10 Nº OBSERVACIÓN 15 20 1 5 10 15 20 Nº OBSERVACIÓN Observación I: Los tres grácos de la Figura 10 se han elaborado a partir de la estimación de la RLM (con término constante) de Y sobre X2, X3, X4, X5, con los datos del archivo SC10-NYRivers.wf1 [ver Chatterjee, S.; Hadi, A.S. (2006), Regression Analysis by Example (4th Ed.), Wiley (p. 10)]. El cálculo de los grados de inuencia potencial (LEVERAGE) y de los estadísticos de Cook (COOK) se ha llevado a cabo con el programa del archivo PRG03-OBIN.prg para EViews. Observación II: Para otras medidas de inuencia, ver la Figura 11 y el artículo de Peña, D. y Yohai, V.J. (1995), The Detection of Influential Subsets in Linear Regression by Using an Influence Matrix, J. R. Statist. Soc. B, 57, 145-156. ECONOMETRÍA PÁGINA 22 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.2 DIAGNOSIS DE RESIDUOS FIGURA 11 Ejemplo - Detección de Observaciones Influyentes II 7 2.4 3 .5 2.0 8 1.6 .4 1.6 Y COOK 6 1.2 4 0.8 HADI 2.0 .6 5 .3 .2 0.8 .1 0.4 .0 0.0 0.5 1.0 1.5 2.0 2.5 3.0 1.2 0.0 1 5 X5 10 15 20 1 Nº OBSERVACIÓN 5 10 15 20 Nº OBSERVACIÓN Observación: Los tres grácos de la Figura 11 se han elaborado a partir de la estimación de la RLS de Y sobre X5 con los datos del archivo SC10-NYRivers.wf1. Los estadísticos de Cook (COOK) y las medidas de inuencia de Hadi (HADI) [Chatterjee y Hadi (2006), Sec. 4.8-4.10] se han calculado con el programa del archivo PRG03-OBIN.prg para EViews. La medida de inuencia de Hadi (que puede ayudar a detectar observaciones inuyentes enmascaradas) es é hii Hi = ê ëê 1 - hii ECONOMETRÍA ù ú+ ûú é K ê ë 1 - hii uˆi2 ù éê ú´ û ëê SCR - uˆi2 ù ú (i = 1, ..., N ). ú û PÁGINA 23 3.3 Heteroscedasticidad Denición: Varianza no constante en las perturbaciones de un modelo. FIGURA 12 Gráficos indicativos de Heteroscedasticidad en un modelo RLS 2 200 1 RESIDUOS VARIABLE DEPENDIENTE 240 160 120 -1 80 -2 40 200 400 600 800 VARIABLE EXPLICATIVA ECONOMETRÍA 0 1000 -2 -1 0 1 2 VARIABLE EXPLICATIVA PÁGINA 24 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD Modelo estadístico RLS para los datos de la Fig. 12 con heteroscedasticidad proporcional: Yi = b1 + b2 X i + U i , con E[U i X ] = 0, [3] Var[U i X] = s 2Xi (i = 1, ..., N ). [4] E[Yi X ] = b1 + b2X i , Var[Yi X ] = s 2X i (i = 1, ..., N ) . [5] Una causa frecuente de la heteroscedasticidad es la existencia de alguna relación entre la dispersión de la variable dependiente y los valores de alguna(s) variable(s) explicativa(s). La presencia de perturbaciones heteroscedásticas siempre debe considerarse cuando se pretende elaborar un modelo con datos de sección cruzada. Modelo estadístico RLM con heteroscedasticidad general: Yi = Xi¢ b + U i , con E[U i X ] = 0, [6] Var[U i X ] = s 2 ω(Xi ) (i = 1, ..., N ), [7] donde ω(Xi ) > 0 para todo i = 1, ..., N . ECONOMETRÍA PÁGINA 25 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD CONSECUENCIAS El modelo RLM [6]-[7] puede escribirse como Y = Xb + U , con E[ U | X ] = 0 , [8] Var[ U | X ] ( = E[ UU ¢ | X ]) = s 2 W , [9] donde si ωi º ω(Xi ), entonces W es la matriz diagonal no escalar siguiente: é ω1 ê ê 0 W = êê ê ê 0 ëê 0 ω2 0 0 ù ú 0 ú ú = / I. ú ú ú ωN ú û [10] Remplazando en el modelo RLM clásico HC4 por [9]-[10], puede comprobarse que ˆW ] = b, E[ b ˆ W ] = s 2 ( X ¢X )-1 X ¢WX ( X ¢X )-1 = / s 2 ( X ¢X )-1 . Var[ b ECONOMETRÍA [11] PÁGINA 26 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD ˆ W (Sección 2.4), remplazar [i] en HA4 por la hipótesis Observación: En relación con las propiedades asintóticas de b ˆ W sigue siendo un estimador CAN de que Var[U i | Xi ] ( = E[U i2 | Xi ]) = s 2 ω( Xi ) ( i = 1, 2, ..., N ), implica que b de b , pero ahora con ˆW ] = VarAs[ b Q-1 SQ-1 (donde Q º E[ Xi Xi¢ ] , S º lim { N1 Var[ X ¢U ]} = E[U i2 Xi Xi¢ ] = / s 2 Q ). 2 ˆW ] = ˆ W ] = b , pero VarAs[ b / sN Q-1 . Por lo tanto, plim[ b 1 N Ningún resultado de la RLM basado en la expresión s 2 ( X ¢X )-1 para Var[ b̂ W ] es aplicable ahora (por ejemplo, el Teorema de Gauss-Markov). Además, cualquier cálculo basado en la estimación sˆ2 ( X ¢X )-1 de la matriz de covarianzas (exacta o asintótica) de ˆ W es incorrecto (por ejemplo, los errores estándar habituales de los estimadores MCO). b UTILIZACIÓN ADECUADA DE MCO ˆ W ] frente a El Estimador de White es un estimador robusto (consistente) de VarAs[ b cualquier tipo de heteroscedasticidad (con independencia de la forma de ω(Xi ) en [7]): ˆW ] = ˆ b VarAs[ ˆ º Q ECONOMETRÍA 1 N åiN=1 Xi Xi¢ = 1 N 1 N ˆ -1 S ˆWQ ˆ -1 , Q ˆW º X ¢X, S 1 N -K åiN=1 Uˆi 2 Xi Xi¢ . [12] [13] PÁGINA 27 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD Ejemplo: Con los datos del archivo SC01-Viviendas.wf1, estimar la RLM de PRECIO sobre FINCAM2, SUPM2, NDORM, y comparar los errores estándar calculados de la manera habitual con los calculados utilizando el Estimador de White. DETECCIÓN Además de los grácos de residuos considerados en la Sección 3.2, los contrastes que se mencionan a continuación pueden resultar útiles para detectar heteroscedasticidad. Contraste de Goldfeld-Quandt La heteroscedasticidad implica que las perturbaciones asociadas con algunas observaciones muestrales tienen mayor varianza que las asociadas con otras observaciones. GQ.1 Dividir la muestra en dos partes de N 1 y N 2 observaciones, respectivamente, de manera que [i] N 1 y N 2 sean aproximadamente iguales, y [ii] las observaciones cuya varianza es potencialmente mayor (menor) queden incluidas en la primera (segunda) parte. GQ.2 Calcular las estimaciones ŝ12 y ŝ22 con la primera y con la segunda parte de la muestra, respectivamente. Si las perturbaciones son homoscedásticas (heteroscedásticas), el estadístico de Goldfeld-Quandt FGQ º sˆ12 / sˆ22 tendrá un valor pequeño (grande). ECONOMETRÍA PÁGINA 28 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD GQ.3 Si a * = Pr[ F ( N 1 - K , N 2 - K ) ³ FGQ ] es sucientemente pequeño (grande), rechazar (no rechazar) la hipótesis nula (homoscedasticidad) en favor de la hipótesis alternativa (heteroscedasticidad). Ejemplo - ST06-Trigo.wf1 - Parte I Para prever la producción anual de trigo en una zona determinada de Australia, se plantea la estimación de un modelo de regresión del tipo Qt = b1 + b2 Pt + b3Tt + U t (t = 1, ..., 26), donde Qt es la cantidad de trigo producida durante el año t, Pt es el precio del trigo en el año t, Tt es una tendencia lineal determinista (que se espera sirva para recoger mejoras tecnológicas en la producción de trigo), y U t es una perturbación aleatoria que incluye, entre otros factores, las condiciones climatológicas generales a lo largo del año t (para las cuales no es obvio qué variable observable se podría utilizar). A partir del año t = 14 se empieza a sembrar una nueva variedad de trigo cuyo rendimiento es menos sensible a variaciones en las condiciones climatológicas; el ECONOMETRÍA PÁGINA 29 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD rendimiento medio es similar al de la variedad anterior, pero la variabilidad del rendimiento de la nueva variedad es menor porque depende menos de las condiciones climatológicas. Por lo tanto, en el modelo planteado se supone que E[U t ] = 0 (t = 1, ..., 26) , pero, al mismo tiempo, Var[U t ] = s12 (t = 1, ..., 13) y Var[U t ] = s22 (t = 14, ..., 26) , con s12 > s22 . En la Tabla 2 se muestra el modelo estimado por MCO con la muestra completa. El contraste de Goldfeld-Quandt puede llevarse a cabo con las siguientes instrucciones para EViews: SMPL 1 13 EQUATION M1.LS Q C P T SMPL 14 26 EQUATION M2.LS Q C P T SCALAR FGQ = M1.@SE^2 / M2.@SE^2 SCALAR PV = 1 - @CFDIST( FGQ, 10, 10 ) En este caso, FGQ = 11.10902 ( a* = 0.00036 ), por lo que se rechaza claramente la hipótesis de homoscedasticidad. ECONOMETRÍA PÁGINA 30 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD TABLA 2 Modelo estimado por MCO con los datos del archivo ST06-Trigo.wf1 3 Dependent Variable: Q Method: Least Squares Sample: 1 26 Included observations: 26 Coefficient C P T 139.9009 19.54050 3.639084 R-squared Adjusted R-squared S.E. of regression Sum squared resid Log likelihood Durbin-Watson stat 0.808885 0.792267 19.96687 9169.549 -113.1445 1.454224 Std. Error t-Statistic Prob. 23.21761 6.025639 17.41501 1.122049 1.417651 2.566982 0.0000 0.2734 0.0172 Mean dependent var S.D. dependent var Akaike info criterion Schwarz criterion F-statistic Prob(F-statistic) 233.4231 43.80837 8.934193 9.079358 48.67332 0.000000 RESIDUOS MCO Variable 2 1 0 -1 -2 -3 1 3 6 9 12 15 18 21 24 26 Otro Ejemplo I: Con los datos del archivo SC09-Alimentación.wf1, [i] estimar la RLS de GALIM sobre INGR (gasto medio en alimentación e ingresos medios semanales a lo largo de un año en una muestra de 40 familias), [ii] dibujar los residuos frente a la variable explicativa (ver Figura 12), [iii] llevar a cabo un contraste de Goldfeld-Quandt [los datos ya están ordenados de mayor a menor según la serie INGR; el resultado es FGQ = 3.34958 ( a * = 0.00697 ) ], y [iv] explicar por qué es razonable la presencia de heteroscedasticidad en un modelo para estos datos (ver la segunda parte de [5]). ECONOMETRÍA PÁGINA 31 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD Contraste de Breusch-Pagan Cuando Var[U i X ] = s 2 ω(Xi ) (i = 1, ..., N ) (un caso muy frecuente en la práctica), una forma funcional sencilla para ω(Xi ) es ω(Xi ) = δ1 + δ2X i 2 + ... + δK X iK . BP.1 Estimar la RLM [6] por MCO y guardar los residuos uˆ1 , uˆ2 , ..., uˆN . BP.2 Estimar por MCO la regresión auxiliar (con término constante) de uˆi2 sobre 2 (el coeciente de determinación de esta regresión auxiliar). x i 2 , ..., x iK y guardar el RBP 2 BP.3 Calcular BP = N ´ RBP y a * = Pr[ c 2 ( K - 1) ³ BP ]; alternativamente, calcular el estadístico F para el contraste de signicación global en la regresión auxiliar anterior, FBP = 2 N -K RBP K -1 1-R 2 BP , y a* = Pr[ F ( K - 1, N - K ) ³ FBP ]. En ambos casos, si a* es sucientemente pequeño (grande), rechazar (no rechazar) la hipótesis nula de homoscedasticidad. ECONOMETRÍA PÁGINA 32 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD 2 Observación: El estadístico de Breusch-Pagan ( BP = N ´ RBP ) es un estadístico de los multiplicadores de Lagrange (LM) del tipo que se menciona al nal de la Sección 2.4. En este caso, el estadístico LM se utiliza para contrastar la signicación global en la regresión auxiliar del paso BP.2. El uso de estadísticos LM en relación con determinadas regresiones auxiliares es muy frecuente como instrumento de diagnosis de un modelo estimado. Ejemplo - SC01-Viviendas.wf1 TABLA 3 Modelos estimados por MCO con los datos del archivo SC01-Viviendas.wf1 M2 - Dependent Variable: LOG( PRECIO ) Method: Least Squares Sample: 1 88 Included observations: 88 M1 - Dependent Variable: PRECIO Method: Least Squares Sample: 1 88 Included observations: 88 Variable Coefficient Std. Error C FINCAM2 SUPM2 NDORM -21.77031 0.022257 1.321573 13.85252 R-squared Adjusted R-squared S.E. of regression Sum squared resid Log likelihood Durbin-Watson stat 0.672362 0.660661 59.83348 300723.8 -482.8775 2.109796 ECONOMETRÍA t-Statistic Prob. 29.47504 -0.738601 0.006912 3.220096 0.142486 9.275093 9.010145 1.537436 0.4622 0.0018 0.0000 0.1279 Mean dependent var 293.5460 S.D. dependent var 102.7134 Akaike info criterion 11.06540 Schwarz criterion 11.17800 F-statistic 57.46023 Prob(F-statistic) 0.000000 Variable Coefficient Std. Error t-Statistic Prob. C LOG( FINCAM2 ) LOG( SUPM2 ) NDORM 0.765971 0.167967 0.700232 0.036958 0.440114 0.038281 0.092865 0.027531 1.740395 4.387714 7.540306 1.342415 0.0855 0.0000 0.0000 0.1831 R-squared Adjusted R-squared S.E. of regression Sum squared resid Log likelihood Durbin-Watson stat 0.642965 0.630214 0.184603 2.862563 25.86066 2.088996 Mean dependent var 5.633180 S.D. dependent var 0.303573 Akaike info criterion -0.496833 Schwarz criterion -0.384227 F-statistic 50.42374 Prob(F-statistic) 0.000000 PÁGINA 33 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD Modelo M1 (sin logaritmos) - Estimación y contraste de Breusch-Pagan con EViews: EQUATION M1.LS PRECIO C FINCAM2 SUPM2 NDORM M1.MAKERESID RES1 EQUATION AUXBP1.LS RES1^2 C FINCAM2 SUPM2 NDORM SCALAR BP1 = AUXBP1.@REGOBS * AUXBP1.@R2 SCALAR PV1 = 1 - @CCHISQ( BP1, AUXBP1.@NCOEF – 1 ) En este caso, BP = 14.0924 ( a* = 0.0028), FBP = 5.3389 ( a* = 0.0020), por lo que en M1 se rechaza la hipótesis nula de homoscedasticidad. Modelo M2 (con logaritmos) - Estimación y contraste de Breusch-Pagan con EViews: EQUATION M2.LS LOG( PRECIO ) C LOG( FINCAM2 ) LOG( SUPM2 ) NDORM M2.MAKERESID RES2 EQUATION AUXBP2.LS RES2^2 C LOG( FINCAM2 ) LOG( SUPM2 ) NDORM SCALAR BP2 = AUXBP2.@REGOBS * AUXBP2.@R2 SCALAR PV2 = 1 - @CCHISQ( BP2, AUXBP2.@NCOEF – 1 ) En este caso, BP = 4.2232 ( a* = 0.2383), FBP = 1.4115 ( a* = 0.2451), por lo que en M2 no se rechaza la hipótesis nula de homoscedasticidad El logaritmo neperiano en la variable dependiente de un modelo suele reducir notablemente la heteroscedasticidad. ECONOMETRÍA PÁGINA 34 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD Contraste de White Wooldridge (2003), Sección 8.3. Aplicar a los dos modelos estimados en el ejemplo anterior. MÍNIMOS CUADRADOS PONDERADOS Modelo original con heteroscedasticidad: Yi = b1 + b2 Xi 2 + ... + bK XiK + U i , con E[U i X ] = 0, [14] Var[U i X ] = s 2 ωi (i = 1, ..., N ). [15] Modelo transformado sin heteroscedasticidad: Yi = b1 ωi Xi 2 XiK Ui 1 é Ui ù , con E ê + b2 + ... + bK + X ú = 0, ωi ωi ωi ωi êë ωi úû 1 é U ù Var ê i X ú = ´ Var [ U i X ] = s 2 (i = 1, ..., N ). ωi ë ωi û [16] [17] En el modelo transformado los parámetros son los mismos y se interpretan exactamente de la misma manera que en el modelo original. ECONOMETRÍA PÁGINA 35 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD El estimador MCO de b º [ b1 , b2 , ..., bK ] ¢ en el modelo transformado [16]-[17] se denomina el estimador de Mínimos Cuadrados Ponderados (MCP) de b . Observación I: El estimador MCP debe su nombre a que es el estimador asociado con la estimación de b que resulta de minimizar con respecto a b º [ b1 , b2 , ..., bK ] ¢ la función 2 2 SCRP( b ) º å iN=1 [ pi (yi - b1 - b2 x i 2 - ... - bK x iK ) ] º å iN=1 [ pi (yi - xi¢ b ) ] , donde pi º 1/ ωi (i = 1, ..., N ) . En SCRP(b), cada residuo ordinario (yi - xi¢ b ) recibe una ponderación que es inversamente proporcional a la variabilidad (dispersión) de la distribución de probabilidad condicional de Yi . De esta manera se aprovecha la heteroscedasticidad para obtener un estimador de b más preciso (informativo) que el estimador MCO (que pondera a todas las observaciones por igual). Observación II: El modelo transformado [16]-[17] puede escribirse como ( PY ) = ( PX )b + ( PU ), con E[ PU | X ] = 0, Var[ PU | X ] ( = E[ PUU ¢P ¢ | X ]) = s 2 I, 1 , ..., 1 ù -1 (ver [8]-[10]). ¢ P º Diag[ p1 , ..., pN ] º Diag éê ω ωN ûú PP = W ë 1 Si el modelo original satisface todas las hipótesis clásicas, excepto por la presencia de heteroscedasticidad, entonces el modelo transformado satisface HC1-HC5. Por lo tanto, la manera óptima de hacer inferencia sobre b consiste en aplicar toda la teoría MCO al modelo transformado. En particular, el estimador MCP de b es W = ( X ¢P ¢ PX )-1 X ¢P ¢ PY = ( X ¢W-1 X )-1 X ¢W-1 Y , con b W ] = b , Var[ b W ] = s 2 ( X ¢W-1 X )-1 . E[ b ECONOMETRÍA PÁGINA 36 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD El problema práctico de todo lo anterior reside en que, salvo en casos excepcionales, no es posible conocer exactamente la forma de ωi º ω(Xi ) en todo i = 1, …, N, por lo que aplicar MCP en la práctica requiere utilizar estimaciones de ω1 , ..., ωN . Un estimador MCP de b denido a través de algún estimador de ω º [ ω1 , ..., ωN ] ¢ en vez de a través del verdadero valor de ω (generalmente desconocido), se denomina un estimador de MCP Factibles (MCPF). Un estimador MCPF no es, en general, insesgado (ni, por lo tanto, eciente) porque utiliza un estimador de ω en lugar de su verdadero valor. No obstante, si el estimador utilizado de ω es un estimador adecuado (consistente), entonces el estimador MCPF es consistente y asintóticamente relativamente más eciente que el estimador MCO. Ejemplo - ST06-Trigo.wf1 - Parte II El modelo de la Tabla 2 se puede estimar por MCPF estimando una varianza para cada uno de los dos grupos de observaciones: sˆ12 (t = 1, ..., 13) y sˆ22 (t = 14, ..., 26). Estas estimaciones pueden ser las mismas que las utilizadas en el contraste de Goldfeld-Quandt. ECONOMETRÍA PÁGINA 37 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD ˆ t = sˆ12 (t = 1, ..., 13) , ω ˆ t = sˆ22 (t = 14, ..., 26) . Con EViews: En tal caso, ω SMPL 1 13 GENR OMEGA = M1.@SE^2 SMPL 14 26 GENR OMEGA = M2.@SE^2 SMPL 1 26 Para estimar por MCP(F) con EViews: [i] seleccionar Options en la ventana Equation Specification del modelo que se quiera estimar, [ii] marcar la casilla a la izquierda de Weighted LS/TSLS, y [iii] escribir el nombre de la serie de ponderaciones en la celda a la derecha de Weight: [OMEGA^(–0.5) en este ejemplo]. Ver Tabla 4 y comparar con Tabla 2. Otro Ejemplo II (ver Otro Ejemplo I bajo la Tabla 2): Con los datos del archivo SC09-Alimentación.wf1, estimar por MCPF la RLS de GALIM sobre INGR con la serie de ponderaciones INGR^(–0.5) (de manera que en este ejemplo se estima la serie ω º [ ω1 , ..., ωN ]¢ simplemente como ω̂i = x i (i = 1, ..., N ) ; ver [4]). Comparar con la estimación por MCO. Estimación General por MCPF Wooldridge (2003), Sección 8.4. Observar con atención que diferencias notables entre las estimaciones MCO y MCPF suelen indicar la presencia de algún error de especicación. ECONOMETRÍA PÁGINA 38 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD TABLA 4 Modelo estimado por MCPF con los datos del archivo ST06-Trigo.wf1 Dependent Variable: Q Method: Least Squares Sample: 1 26 Included observations: 26 Weighting series: OMEGA^(-0.5) Variable Coefficient Std. Error t-Statistic Prob. C P T 138.0541 21.71975 3.283438 12.82098 8.923946 0.822638 10.76783 2.433873 3.991354 0.0000 0.0231 0.0006 Weighted Statistics R-squared Adjusted R-squared S.E. of regression Sum squared resid Log likelihood Durbin-Watson stat 0.995003 0.994568 11.84953 3229.460 -99.57806 1.520419 Mean dependent var S.D. dependent var Akaike info criterion Schwarz criterion F-statistic Prob(F-statistic) 249.4558 160.7768 7.890620 8.035785 84.25644 0.000000 Unweighted Statistics R-squared Adjusted R-squared S.E. of regression Durbin-Watson stat 0.806086 0.789224 20.11257 1.425144 Mean dependent var S.D. dependent var Sum squared resid 233.4231 43.80837 9303.857 En la sección Weighted Least Squares del sistema de ayuda de EViews se explica con detalle cómo se calculan y a qué se refieren todas las cantidades que figuran en esta tabla. ECONOMETRÍA PÁGINA 39 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.3 HETEROSCEDASTICIDAD Observación: Si MCPF hace uso de un estimador inadecuado de ω º [ ω1 , ..., ωN ]¢ , entonces MCPF es CAN pero su ˆ º [ω ˆ 1 , ..., ω ˆ N ]¢ es varianza asintótica no es necesariamente menor que la de MCO. En la práctica, para decidir si ω * ˆ i ( i = 1, ..., N ) : si ω̂ es una una estimación adecuada, examinar los residuos "estandarizados" ui º ( y i - x i¢ b )/ ω estimación adecuada de ω , entonces los residuos estandarizados no deben mostrar signos de heteroscedasticidad. TABLA 5 Residuos del Modelo estimado por MCPF de la Tabla 4 3 RESIDUOS ESTANDARIZADOS 3 RESIDUOS MCPF 2 1 0 -1 -2 -3 1 0 -1 -2 -3 1 ECONOMETRÍA 2 3 6 9 12 15 18 21 24 26 1 3 6 9 12 15 18 21 24 26 PÁGINA 40 3.4 Recomendaciones Prácticas A la hora de elaborar un modelo RLM, prestar especial atención al contenido del conjunto de variables explicativas y a la forma funcional de la relación entre la variable dependiente y las variables explicativas. Fundamentar ambos aspectos en (quizás) algún modelo teórico y (sobre todo) en el sentido común y en un análisis detallado de las características muestrales de los datos disponibles. En general, comenzar con un modelo sencillo pero sensato para, en su caso, enriquecerlo paso a paso (bottom-up/specific-to-general approach). Aunque puede presentar ciertos inconvenientes, este enfoque suele ser preferible al opuesto (top-down/general-to-specific approach), que parte de una premisa esencialmente irrealizable (un modelo "correcto"). Recordar que la omisión de variables explicativas relevantes puede llevar a la estimación de relaciones espurias (MCO sesgado e inconsistente), mientras que la inclusión de variables irrelevantes "sólo" puede implicar pérdida de precisión (MCO ineciente). ECONOMETRÍA PÁGINA 41 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.4 RECOMENDACIONES PRÁCTICAS Analizar la posible presencia de multicolinealidad y de observaciones inuyentes en los datos, cuyas consecuencias pueden distorsionar notablemente las conclusiones derivadas de cualquier modelo estimado. En todo caso, recordar que la señal más evidente de una mala especicación o de alguna deciencia en los datos suele ser la obtención de estimaciones con valores y/o signos chocantes. [Más detalles en Kennedy, P. (2002), "Oh, No! I Got the Wrong Sign! What Should I Do?", Simon Fraser University, Dept. of Economics Discussion Papers, 02-3.] Como ayuda para especicar un modelo, pueden ser de utilidad algunos procedimientos formales (contrastes de signicación, coecientes de determinación, criterios de información y de evaluación de previsiones, RESET), pero nunca como criterios únicos y fundamentales. Recordar la diferencia entre signicación estadística y signicación teórica y/o práctica. Evaluar la posible presencia de heteroscedasticidad (o, en su caso, de autocorrelación) sólo a partir de un modelo "razonablemente bien especicado", estimado con unos datos que no presenten deciencias notables. ECONOMETRÍA PÁGINA 42 3 · REGRESIÓN LINEAL MÚLTIPLE II 3.4 RECOMENDACIONES PRÁCTICAS Observación I: En un contraste de heteroscedasticidad, interpretar el rechazo de H 0 (homoscedasticidad) como evidencia de heteroscedasticidad es correcto siempre que las restantes hipótesis del modelo considerado (especialmente las hipótesis de regresores exógenos y ausencia de autocorrelación) sean válidas. En particular, si HA3 no es válida / Xi¢ b debido a algún error de especicación), entonces puede rechazarse H 0 aún cuando (de manera que E[Yi | Xi ] = Var[U i | Xi ] sea constante (en este caso, además, tanto MCO como MCPF son inconsistentes). Por ejemplo, si se omite algún término cuadrático en el lado derecho del modelo, o si se omite el logaritmo en el lado izquierdo cuando debería haberse utilizado, entonces un contraste de heteroscedasticidad puede resultar signicativo. Por lo tanto, es recomendable contrastar primero la especicación del modelo (dado que la inconsistencia se considera más grave que la ineciencia), y después, una vez resuelto cualquier error de especicación (que provoca inconsistencia), considerar la posible heteroscedasticidad (que sólo provoca ineciencia). Observación II: En presencia sólo de heteroscedasticidad, MCO y MCPF son ambos CAN. Por su parte, la eciencia asintótica relativa de MCPF se basa en que: [i] el tamaño muestral sea sucientemente grande, y [ii] la estimación de la heteroscedasticidad sea "adecuada". Si [ii] falla, MCPF aún es CAN, pero su varianza asintótica ya no es necesariamente menor que la de MCO. Además, con muestras cortas, incluso si [ii] es aceptable, la aproximación asintótica puede funcionar peor para MCPF que para MCO, dado que MCPF requiere estimar más parámetros que MCO. En todo caso, MCPF puede ser una alternativa "razonable" a MCO (con muestras "razonablemente" grandes) cuando la heteroscedasticidad puede estimarse "razonablemente" bien. Cuestiones para estudio personal utilizando el manual de la asignatura Contrastes de Heteroscedasticidad de White - Estimación General por MCPF ECONOMETRÍA PÁGINA 43