Cayley-Hamilton - Universidad Nacional de La Plata

Anuncio

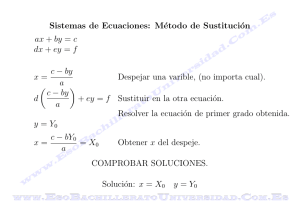

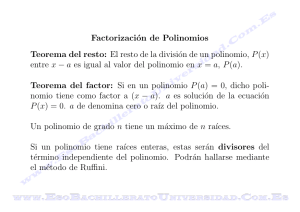

Universidad Nacional de La Plata Facultad de Ingenierı́a Departamento de Electrotecnia Cátedra de Control Moderno Cayley-Hamilton Año 2006 1. Introducción A continuación se presentan unos pocos y simples ejemplos que muestran como puede emplearse el Teorema de Cayley-Hamilton para simplificar algunas deducciones y cálculos algebraicos que son frecuentes en la teorı́a del control moderno. 2. Polinomio de matrices Cualquier polinomio escalar P (x) = c0 + c1 x + c2 x2 + ... + ck xk , (1) puede emplearse para definir un polinomio de matrices P (Mnxn ) P (M ) = c0 + c1 M + c2 M 2 + ... + ck M k . (2) También, puede decirse que todo polinomio de matrices tiene asociado un polinomio escalar. Una propiedad interesante de la correspondencia entre polinomios escalares y matriciales es que toda operación realizada sobre el polinomio escalar también es válida para el polinomio matricial. Ası́, por ejemplo, expresiones alternativas a la ecuación (1) del polinomio escalar P (x) P (x) = K (x − a1 ) (x − a2 ) ... (x − ak ) , ´ ³ P (x) = K x2 − (a1 + a2 ) x + a1 a2 ... (x − ak ) , (3) (4) también son válidas para el polinomio de matrices P (M ): P (M ) = K (M − a1 ) (M − a2 ) ... (M − ak ) , ´ ³ P (M ) = K M 2 − (a1 + a2 ) M + a1 a2 ... (M − ak ) . 1 (5) (6) 3. Teorema de Cayley-Hamilton Este teorema, debido a Arthur Cayley y William Rowan Hamilton, dice que toda matriz verifica su ecuación caracterı́stica. Luego, si Q(λ) = |λI − M | = a0 + a1 λ + a2 λ2 + ... + an λn (7) es la ecuación caracterı́stica de M , entonces: Q(M ) = a0 + a1 M + a2 M 2 + ... + an M n = 0nxn . 4. (8) Ejemplo 1. Inversión de matrices. Calculemos la inversa de la matriz: " A= 3 1 1 2 # . (9) La ecuación caracterı́stica de A es: |λI − A| = (s − 3) (s − 2) − 1 = λ2 − 5λ + 5 (10) Y dado que toda matriz satisface su propia ecuación caracterı́stica (Cayley-Hamilton): A2 − 5A + 5I = 0. (11) Luego, premultiplicando por la inversa de la matriz A, conseguimos que dicha inversa aparezca explı́citamente: A − 5I + 5A−1 = 0, (12) y fácilmente puede despejarse −1 A 5. A =I− = 5 " 2/5 −1/5 −1/5 3/5 # . (13) Ejemplo 2. Reducción del orden de un polinomio de matrices. Demostrar que el orden de un polinomio de matrices P (M ) = a0 I + a1 M + a2 M 2 + a3 M 3 + ... + ak M k , (14) puede ser reducido a n − 1, donde n define la dimensión de la matriz cuadrada Mnxn . Obviamente, nos interesa el caso en que k > n pudiendo tomar un valor infinito. Consideremos el polinomio escalar asociado al polinomio de matrices (14): 2 P (λ) = a0 I + a1 λ + a2 λ2 + a3 λ3 + ... + ak λk (15) y dividámoslo por el polinomio caracterı́stico Q (λ) = |λI − M | (16) de la matriz M. De esta operación resulta R (λ) P (λ) = C (λ) + Q (λ) Q (λ) (17) P (λ) = Q (λ) C (λ) + R (λ) . (18) donde, 1) C (λ) es el polinomio cociente, y 2) R (λ) es el polinomio resto, siendo su orden menor que n, es decir R(λ) es de la forma R (λ) = α0 + α1 λ + ... + αn−1 λn−1 . (19) Considerando (18), podemos retomar el polinomio de matrices P (M ) = Q (M ) C (M ) + R (M ) , (20) expresión que puede simplificarse dado que toda matriz verifica su ecuación caracterı́stica Q (M ) = 0nxn . (21) P (M ) = R (M ) = α0 I + α1 M + ... + αn−1 M n−1 . (22) Luego: Observe que esta expresión, alternativa de P (M ), puede ser mucho más simple que la expresión (14) dado que k puede ser muy grande incluso infinito y n corresponde a la dimensión de la matriz cuadrada M . Para calcular los coeficiente αi de (22) puede evaluarse el polinomio escalar (18) en cada autovalor λi . Dado que la ecuación caracterı́stica se anula en los autovalores, resulta P (λi ) = R (λi ) = α0 + α1 λi + ... + αn−1 λin−1 . (23) Ası́, se dispone de n ecuaciones (una para cada autovalor) que permiten despejar las n incognitas αi . En el caso de existir polos múltiples este procedimiento debe modificarse. Efectivamente, si M posee un autovalor λk de orden m, al reemplazar λk en (18), sólo se obtendrá una ecuación independiente. Para obtener otras m − 1 ecuaciones linealmente independientes puede diferenciarse ambos miembros de la ecuación (18). Dado que 3 ¯ dj Q (λ) ¯¯ ¯ =0 dλj ¯λ=λk j = 0, 1, ..., m − 1, (24) las m − 1 ecuaciones restantes resultan ¯ ¯ dj P (λ) ¯¯ dj R (λ) ¯¯ ¯ = ¯ dλj ¯λ=λk dλj ¯λ=λk 6. j = 0, 1, ..., m − 1. (25) Ejemplo 3. Cálculo de la matriz de transición de estados. Se quiere obtener la matriz de transición de estados del sistema autónomo dx = dt " 0 1 −1 −2 # x. (26) Los autovalores de la matriz A pueden calcularse a partir de: Q (λ) = |λI − A| = (λ + 1)2 = 0. (27) Luego el sistema tiene un autovalor multiple en λ = −1. A partir del ejemplo anterior Φ (t) = P (A) = eAt = R(A), (28) Φ (t) = eAt = α0 I + α1 A. (29) y como la matriz A es de 2x2 Los coeficientes αi (teniendo presente que el autovalor es de orden 2) se calculan a partir de 1) 2) R(λ) = α0 + α1 λ (30) eλ1 t = e−t = α0 + α1 (−1) (31) α0 = e−t − α1 (32) ¯ ¯ dP (λ) ¯¯ dR (λ) ¯¯ ¯ = ¯ dλ ¯λ=−1 dλ ¯λ=−1 α1 = te−t . (33) (34) Ası́, la matriz de transisción de estados resulta: Φ (t) = eAt = ((1 + t) e−t ) I + (te−t ) A , 4 (35) " Φ (t) = e 7. At = # (1 + t) e−t te−t −te−t (1 − t) e−t . (36) Ejemplo 4. Cálculo de la potencia de una matriz. En numerosos problemas tanto de sistemas de tiempo continuo, como de tiempo discreto es necesario elevar una matriz a una dada potencia. Consideremos el caso particular en que nos interesa conocer la matriz de transición de estado para un tiempo t = 100seg " Φ(t=100seg) = Φ100 (t=1seg) = −1 0 3 1 #100 =? (37) a partir de la misma matriz evaluada en t = 1seg " −1 0 3 1 Φ(t=1seg) = # . (38) Luego, P (Φ) = R (Φ) Φ100 = α0 I + α1 Φ (39) Donde los coeficientes α0 y α1 pueden calcularse a partir de P (λi ) = λ100 = R (λi ) = α0 + α1 λi , i 100 (−1) = α0 − α1 , 1100 = α0 + α1 . (40) α0 = 1, α1 = 0. (41) Φ(t=100seg) = I. (42) Resultando 8. Ejemplo 5. Test de controlabilidad. Sabemos que la solución de la ecuación de estados es At x(t) = e x (0) + Z t 0 eA(t−τ ) Bu (τ ) dτ, (43) y que si el sistema es completamente controlable sus estados iniciales pueden transferirse al origen en un tiempo finito T , es decir, x(T ) = 0 = e AT x (0) + e 5 AT Z T 0 e−Aτ Bu (τ ) dτ, (44) 0 = x (0) + Z T 0 e−Aτ Bu (τ ) dτ. (45) Ahora bien, a partir de los dos ejemplos previos puede escribirse e−Aτ = n−1 X αk Ak , (46) k=0 luego, x (0) = − n−1 X Ak B αk k=0 Z T 0 u (τ ) dτ . (47) Donde, llamando αk0 = αk Z T 0 u (τ ) dτ, (48) resulta x (0) = − n−1 X k A B αk0 h = − B AB ... A k=0 n−1 i B α00 α10 .. . . (49) α20 Si el sistema es completamente controlable, esta ecuación debe satisfacerse para cualquier condición inicial, luego la matriz h B AB ... An−1 B i debe de ser de rango completo (test de controlabilidad de Kalman). 6 (50)