Procesos de Bernoulli

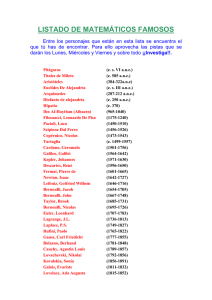

Anuncio

Procesos estocásticos–Silvia Di Marco–2007

1

Procesos de Bernoulli

Consideremos un experimento que consiste en una sucesión infinita de ensayos realizados en idénticas condiciones. Supongamos que esos ensayos son

independientes de los restantes y que sólo pueden tener dos resultados posibles: “éxito” (E) o “fracaso”(F ) y que la probabilidad de estos dos eventos,

digamos P (E) = p, P (F ) = 1 − p, se mantiene constante a lo largo de todo

el proceso. Este experimento puede modelarse como la sucesión de infinitos

ensayos de Bernoulli. El espacio muestral común de este experimento es

Ω = {w : w = (w1 , w2 , ..., wn , ...), wi = E o bien wi = F, i ∈ N}.

A la n-ésima repetición del ensayo podemos asociarle una variable aleatoria Xn que toma dos valores posibles

1, si wn = E,

Xn (w) =

(1)

0, si wn = F.

Es claro que

P (Xn = 1) = p; P (Xn = 0) = 1 − p.

(2)

También es claro que por la descripción del experimento, X1 , X2 , ..., Xn , ...

son independientes.

Llamaremos proceso de Bernoulli a una colección numerable de variables

aleatorias independientes, definidas como en (1) con distribución de probabilidades como en (2).

Ejemplo 1 Al final de la cadena de ensamblaje ciertos productos son sujetos

a inspección. Definimos Xn = 1 si el n-ésimo producto es defectuoso, Xn =

0 si es bueno. Supongamos que el proceso de fabricación bajo inspección

produce artı́culos defectuosos al azar (la aparición de un artı́culo defectuoso

es independiente de la aparición de otros) y la probabilidad de ocurrencia

del defecto es una constante p (el desgaste de la máquina no influye sobre el

defecto analizado). El proceso {Xn : n ∈ N} es un proceso de Bernoulli.

Ejemplo 2 Los alambres que se utilizan en cierta computadora deben tener

una resistencia entre 0.12 y 0.14 ohms. Las resistencias de los alambres

producidos por una empresa tienen una distribución normal con media µ =

0.13 ohms. y desviación estándar σ = 0.005 ohms. Si los alambres no

Procesos estocásticos–Silvia Di Marco–2007

2

cumplen las especificaciones, son rechazados (recordar Ejercicio No 12 de la

Ejercitación No 2). Definimos Xn = 1 si el n−ésimo alambre es aceptado,

Xn = 0 si no. Supongamos que el proceso de fabricación permite suponer que

la aparición de casos fuera de norma es aleatoria, y que no influye sobre la

aparición de otros. El proceso {Xn : n ∈ N} es un proceso de Bernoulli.

Ejemplo 3 En una bifurcación de una ruta, aproximadamente el 62% de los

automóviles toma la rama izquierda. Definimos Xn = 1 si el n−ésimo automóvil toma la rama izquierda, Xn = 0 si toma la rama derecha. Podemos

suponer que los conductores eligen su camino independiemente de lo que hacen los otros, eso quiere decir que podemos considerar X1 , ..., Xn , ... independientes. P (Xn = 1) = 0.62 ∀n. El proceso {Xn : n ∈ N} es un proceso de

Bernoulli.

Ejemplo 4 El acceso a un shopping puede realizarse por dos puertas idénticas. Por motivos desconocidos los clientes prefieren la puerta de la izquierda.

Estudiando la frecuencia relativa del número de clientes que entran por la

puerta de la izquierda se ha llegado a la conclusión de que la probabilidad

de que el cliente que arriba elija la puerta de la izquierda es 23 . También

se ha concluido que la influencia de posibles congestiones frente a una de

las puertas es despreciable pues, debido a las dimensiones de las puertas

y al promedio de clientes que arriban al lugar por unidad de tiempo, dichas

congestiones son muy poco frecuentes. Por todo ello, puede suponerse que los

clientes eligen la puerta de acceso sólo según sus propios gustos. Si definimos

Xn = 1 cuando el n−ésimo cliente elige la puerta izquierda y Xn = 0, cuando

elige la derecha, el proceso {Xn : n ∈ N} es un proceso de Bernoulli.

Número de éxitos

Sea {Xn : n ∈ N} un proceso de Bernoulli con P (E) = p. La variable

aleatoria

Nn = X1 + X2 + ... + Xn

(3)

describe el número de éxitos en los primeros n ensayos de Bernoulli. Si

además definimos N0 = 0, el proceso estocástico {Nn : n ∈ N0 } describe el

número de éxitos en un proceso de Bernoulli y tiene a N0 como espacio de

estados.

Es fácil notar que (3) indica que Nn = k ⇔ X1 + X2 + ... + Xn = k ⇔

exactamente k de los n sumandos es igual a 1 y, por lo tanto, es fácil deducir

Procesos estocásticos–Silvia Di Marco–2007

3

que Nn ∼ Bi(n, p). Por eso

n k

P (Nn = k) =

p (1 − p)n−k , ∀k = 0, ..., n.

k

(4)

Ejemplo 5 En el problema del Ejemplo 1, el proceso {Nn : n ∈ N0 } donde

Nn es definida como en (3) representa el número de artı́culos defectuosos

encontrados hasta el n-ésimo producto salido de la cadena de ensamblaje.

Ejemplo 6 En el problema del Ejemplo 2, el proceso {Nn : n ∈ N0 } donde

Nn es definida como en (3) representa el número de alambres aceptados de

los revisados hasta el n-ésimo instante de observación (el n-ésimo instante

de observación coincide con el de la revisión del n-ésimo alambre).

Ejemplo 7 En el problema del Ejemplo 3, el proceso {Nn : n ∈ N0 } donde

Nn es definida como en (3) representa el número de automóviles que toman el

camino de la izquierda hasta el n-ésimo automóvil que arriba a la bifurcación

del camino.

Ejemplo 8 En el problema del Ejemplo 4 el proceso {Nn : n ∈ N0 } donde

Nn es definida como en (3) representa el número de clientes que entran por

la puerta de la izquierda en la entrada del shopping hasta el n-ésimo instante

de observación que coincide con el instante de arribo del n−ésimo cliente.

Las variables aleatorias Nm+n − Nm representan el número de éxitos entre

el m-ésimo y el (m + n)-ésimo ensayo. Es claro que también

n k

P (Nm+n − Nm = k) =

p (1 − p)n−k , ∀k = 0, ..., n,

(5)

k

lo cual significa que el número de éxitos sólo depende de la cantidad de

ensayos observados y no del instante en que comenzó a observarse el proceso.

Influye la cantidad de éxitos ocurridos en los m primeros ensayos sobre la

cantidad de los que ocurrirán entre la m-ésima y la (m + n)-ésima repetición

del ensayo de Bernoulli? La independencia de las Xi asegura que no. Por

ello

P (Nm+n − Nm = k|N0 , N1 , ..., Nm ) = P (Nm+n − Nm = k), ∀k = 0, ..., n. (6)

Puesto que el valor de (6) es independiente de m, se dice que el proceso

es de incrementos estacionarios. Más aún, si 0 < n1 < n2 < ... < nm ,

Procesos estocásticos–Silvia Di Marco–2007

4

las variables aleatorias Nn1 , Nn2 − Nn1 , ..., Nnm − Nnm−1 son independientes.

Un proceso con esta propiedad se dice de incrementos independientes. La

igualdad (6) indica que

P (Nm+1 = k|N0 , N1 , ..., Nm ) = P (Nm+1 = k|Nm ).

(7)

La igualdad (7) indica que el futuro inmediato del proceso depende sólo

del presente y no del pasado. Esta propiedad que encontraremos en muchos

procesos que estudiaremos en este curso se denomina propiedad markoviana.

Supongamos que conocemos cuántos éxitos hubo hasta el instante nésimo, cuántos éxitos podemos tener al instante siguiente? La misma cantidad o bien uno más. Esto es,

P (Nn+1 = j|Nn = i) = P (Nn + Xn+1 = j|Nn = i) = P (Xn+1 = j − i) (8)

Puesto que

p

1−p

P (Xn+1 = j − i) =

0

p

1−p

P (Nn+1 = j|Nn = i) =

0

si j − i = 1

si j − i = 0

en otro caso,

si j = i + 1

si j = i

en otro caso

(9)

Notar que estas probabilidades son independientes de n. Estas probabilidades, que pueden interpretarse como la probabilidad de transición en un

paso entre dos estados del proceso, pueden representarse a través de un grafo

o de una matriz. En el grafo representamos los estados del proceso con puntos y con flechas entre los estados cuando la transición desde el de partida al

de llegada tenga probabilidad de ocurrencia positiva.

En la matriz P , que llamaremos matriz de transición, la entrada P (i, j) =

P (Nn+1 = j|Nn = i). Estas herramientas las usaremos también en otros

Procesos estocásticos–Silvia Di Marco–2007

procesos estocásticos. En este caso particular P

1−p

p

0

...

0

1

−

p

p

0

.

.

..

..

0

0

.

P = .

...

0

1−p

.

0

0

...

0

..

..

..

..

.

.

.

.

5

resulta:

...

...

0

p

.. ..

.

.

.. ..

.

.

0

...

..

.

Ejercicio 1 En el problema representado por el proceso {Nn : n ∈ N0 } en

el ejemplo 7 donde Nn representa el número de automóviles que toman el

camino de la izquierda hasta el n-ésimo instante de observación,

1. cuál es la probabilidad de que el quinto automóvil sea el primero en

girar a la izquierda?

2. cuál es la probabilidad de que el quinto automóvil sea el segundo en

girar a la izquierda?

3. cuál es la probabilidad de que 12 automóviles hayan tomado hacia la

izquierda hasta el vigésimo instante de observación, sabiendo que hasta

el duodécimo instante lo hicieron 9?

4. cuál es el número promedio de automóviles que girarán a la derecha en

las primeras 100 observaciones?

Ejercicio 2 Encontrar la matriz de transición asociada al proceso “número

de clientes que entran por la puerta derecha” en el shopping del Ejemplo 8.

El promedio de Nn+1 sujeto al conocimiento de Nn queda:

E(Nn+1 |Nn ) = E(Nn + Xn+1 |Nn ) = E(Nn |Nn ) + E(Xn+1 |Nn )

= Nn + p.

Análogamente,

E(Nn+m |Nn ) = E(Nn |Nn ) + E(Nn+m − Nn |Nn ) = Nn + mp.

E(Nn+m |N0 , N1 , ..., Nn ) = E(Nn+m |Nn ).

(10)

(11)

Procesos estocásticos–Silvia Di Marco–2007

6

Instantes de éxito

Sea {Xn : n ∈ N} un proceso de Bernoulli con P (E) = p. Sea la variable

aleatoria Tk : instante en que se produce el k-ésimo éxito. Para dicha variable

aleatoria el espacio de estados es N. Otra forma de describir Tk es como

Tk = min{n ∈ N : Nn = k} donde Nn es el número de éxitos hasta la

n-ésima observación.

El proceso estocástico {Tk : k ∈ N} es el proceso que describe los instantes

en que se producen los éxitos en un proceso de Bernoulli y se conoce como

el proceso de instantes de éxito en un proceso de Bernoulli.

Ejemplo 9 En el problema del Ejemplo 7, el proceso {Nn : n ∈ N0 } donde

Nn representa el número de automóviles que toman el camino de la izquierda

hasta el n-ésimo automóvil que arriba a la bifurcación del camino y el proceso

{Tk : k ∈ N} registra los instantes en que el camino de la izquierda es elegido

por los automóviles que llegan a la bifurcación.

Ejemplo 10 Consideremos el siguiente modelo como una aproximación del

flujo de tránsito a través de un punto fijo de una ruta no congestionada.

El eje del tiempo es dividido en intervalos de un segundo de longitud. Hay

un contador de vehı́culos que se activa en esos segundos. Si en el n−ésimo

segundo un vehı́culo pasa por ese punto, ponemos Xn = 1, de otro modo

Xn = 0. El flujo de tránsito es tal que las cantidades de automóviles que

pasan por el punto fijo en intervalos disjuntos son independientes y además

suponemos que la densidad de tránsito en ese punto es constante. Con estas

consideraciones {Xn : n ∈ N} un proceso de Bernoulli, Nn es el número de

automóviles registrados en [0, n]N y Tk es el segundo en el que el k-ésimo

automóvil cruza el punto donde está puesto el contador.

Lema 1 Si n ≥ k, resulta

Tk = n ⇔ Nn−1 = k − 1, Xn = 1,

(12)

Tk ≤ n ⇔ Nn ≥ k.

(13)

Lema 2 Si n ≥ k,resulta

P (Tk

P (Tk

n−1 k

= n) =

p (1 − p)n−k ,

k−1

n X

n j

≤ n) =

p (1 − p)n−j .

j

j=k

(14)

(15)

Procesos estocásticos–Silvia Di Marco–2007

7

Demostración. De (12),

P (Tk = n) = P (Nn−1 = k − 1, Xn = 1)

= P (Nn−1 = k − 1)P (Xn = 1)

n − 1 k−1

p (1 − p)n−k p.

k−1

De (13),

P (Tk ≤ n) = P (Nn ≥ k) =

n X

n

j=k

j

pj (1 − p)n−j

Nota 1 La igualdad (14) significa que las varibles aleatorias Tk tienen distribución de Pascal lo cual no es sorprendente puesto que Tk se puede ver

como el número de repeticiones hasta que aparece el suceso exitoso por k−ésima

vez.

Supongamos que conocemos los instantes en que se han producido los primeros

k éxitos. Nos ayuda ese conocimiento para determinar la probabilidad de que

el tiempo transcurrido entre el k-ésimo y el (k +1)-ésimo éxito tenga determinada longitud? Nos ayuda ese conocimiento para determinar la probabilidad

de que el (k + 1)-ésimo éxito se produzca en determinado instante?

No es difı́cil probar que

P (Tk+1 − Tk = m | T1 , T2 , ..., Tk ) = P (Tk+1 − Tk = m)

P (Tk+1 − Tk = m) = p(1 − p)m−1

P (Tk+1 = n | T1 , T2 , ..., Tk ) = P (Tk+1 = n | Tk )

Tk ≥ n

0

P (Tk+1 = n | Tk ) =

p(1 − p)n−1−Tk Tk < n

(16)

(17)

(18)

(19)

La igualdad (18) indica que el proceso tiempos de éxito goza de la propiedad

markoviana. Notar que de (19), surge que

i≥j

0

P (Tk+1 = j | Tk = i) =

(20)

j−i−1

p(1 − p)

i<j

lo que indica que las probabilidades de transición en un paso son independientes del número de éxito del que se está estudiando el instante de ocurrencia (independiente de k). La igualdad (16) muestra que este proceso tiene

Procesos estocásticos–Silvia Di Marco–2007

8

incrementos independientes y (17), que los incrementos tienen distribución

geométrica.

En cuanto a esperanzas condicionadas podemos ver que si m > k

E(Tm |T1 , T2 , ..., Tk ) = E(Tm |Tk ) = E((Tm − Tk ) + Tk |Tk )

= E((Tm − Tk )|Tk ) + E(Tk |Tk )

m−k

=

+ Tk .

p

Ejercicio 3 En el problema representado por el proceso {Nn : n ∈ N0 } en

el ejemplo 7 donde Nn representa el número de automóviles que toman el

camino de la izquierda hasta el n-ésimo instante de observación,

1. cuál es la probabilidad de que el quinto automóvil sea el primero en

girar a la izquierda?

2. cuál es la probabilidad de que el quinto automóvil sea el segundo en

girar a la izquierda?

3. Supongamos que el quinto automóvil ha girado a la izquierda, cuál es

la probabilidad de que el próximo automóvil en girar a la izquierda sea

el octavo?

Ejercicio 4 Encontrar la matriz de transición asociada al proceso “instantes

en que es utilizada la puerta de la derecha” en el shopping del Ejemplo 8.

Pista: P (i, j) = P (Tk+1 = j|Tk = i)

Ejercicio 5 Una cierta componente en un gran sistema tiene una duración

aleatoria con una distribución que puede ser aproximada por π(m) = p(1 −

p)m−1 , ∀m ≥ 1. Cuando la componente falla es reemplazada por otra idéntica.

Si T1 , T2 , ... denotan los tiempos de falla, Uk = Tk − Tk−1 es la duración

de la k-ésima componente. Como las componentes son idénticas P (Uk =

m) = p(1 − p)m−1 , ∀m ≥ 1. Supongamos además que las componentes tienen

duraciones independientes. Ası́, el proceso estocástico {Tk : k ∈ N} describe

los instantes en que se producen los éxitos en un proceso de Bernoulli (en el

que el éxito es fallar). Los registros indican que las tres primeras fallas han

ocurrido en los instantes 3, 12 y 14. Con esos datos, estime el tiempo en que

se producirá la quinta falla, cuando p = 0, 6.

Procesos estocásticos–Silvia Di Marco–2007

9

Ejercicio 6 En el problema precedente suponer que el precio de la componente cuando es nueva es c pesos. Supongamos además que la economı́a está

afectada por un ı́ndice inflacionario constante de 0,06, con lo cual 1$ de hoy

1

en el siguiente perı́odo (α es el coeficiente de actualización).

valdrá α = 1+0,06

Luego, si la componente debe ser comprada en el instante n, su valor actual

es cαn . Esto es, si la k-ésima componente debe ser comprada en el instante

Tk , su valor actual es Ck = cαTk . Cuál es el costo total promedio en que se

incurre en este proceso?

Demostración: El costo total es

C=

∞

X

Ck =

∞

X

cαTk

k=1

k=1

El costo total promedio es

E(C) = E

∞

X

!

Ck

k=1

=

∞

X

cE(αTk )

(21)

k=1

Para calcular E(αTk ), notar que Tk = T1 + (T2 − T1 ) + ... + (Tk − Tk−1 ),

ası́ que

E(αTk ) = E(αT1 αT2 −T1 ...αTk −Tk−1 )

= E(αT1 )E(αT2 −T1 )...E(αTk −Tk−1 )

Puesto que cualquiera de las (Tn − Tn−1 ) tiene distribución geométrica

E(α

Tn −Tn−1

) =

∞

X

j

α P (Tn − Tn−1 = j) =

j=1

∞

X

αj p(1 − p)j−1

j=1

αp

=

1 − α(1 − p)

Volviendo a (21),

∞

X

E(C) =

c

k=1

αp

1 − α(1 − p)

k

= pc

α

= 10c.

1−α

Procesos estocásticos–Silvia Di Marco–2007

10

Suma de variales aleatorias independientes

Los procesos antes estudiados tienen ciertas caracterı́sticas en común: las

variables aleatorias que los componen pueden ser presentadas como sumas

de otras variables aleatorias independientes e idénticamente distribuı́das. A

saber:

Nn = N0 + (N1 − N0 ) + (N2 − N1 ) + ... + (Nn − Nn−1 )

= X1 + X2 + ... + Xn ,

Tk = T1 + (T2 − T1 ) + (T3 − T2 ) + ... + (Tk − Tk−1 )

Generalicemos esta propiedad: Consideremos una sucesión de variables

aleatorias {Yn : n ∈ N} independientes e idénticamente distribuı́das y para

cada n ∈ N definamos

n=0

0

Zn =

Y1 + Y2 + ... + Yn n ≥ 1.

El proceso {Zn : n ∈ N} tiene las siguientes propiedades.

Lema 3 El proceso {Zn : n ∈ N} tiene incrementos independientes y estacionarios.

Lema 4 Si W = g(Zn , Zn+1 , ...), entonces E(W |Z0 , Z1 , ..., Zn ) = E(W |Zn )

Procesos estocásticos–Silvia Di Marco–2007

11

Ejercitación general del tema

Ejercicio 7 Considerar el problema del Ejemplo 10 suponiendo que la tasa

de automóviles que atraviesan el punto de la ruta en el que está puesto el

contador es 4 por minuto. Calcular:

p = P (Xn = 1), P (T4 − T3 = 12), E(T4 − T3 )

Ejercicio 8 Una propiedad muy importante!!!

Una variable aleatoria discreta T tiene distribución geométrica si y sólo

si P (T > n + m|T > n) = P (T > m). Probarlo.

Ejercicio 9 Sean k, m n enteros tales que k ≤ m + n. Calcular

P (Nm = j | Nm+n = k).

Ejercicio 10 La probabilidad de que un conductor pare frente a una chica

que “hace dedo” es p = 0, 04. Diferentes conductores toman sus decisiones

de para o no de manera independiente. Formular correctamente el problema

a través de un proceso de Bernoulli y sus procesos asociados y responder:

Dado que la chica ha contado pasar 30 automóviles que no han parado, qué

probabilidad hay de que sea llevada por el número 37 o alguno de los anteriores?

Ejercicio 11 Supongamos que el arribo de vehı́culos es como en el Ejemplo

10 con la p obtenida en el Ejercicio 7, luego el éxito para quien hace dedo

ocurre en el instante n si a la vez ocurre que en ese instante pasa un automóvil

y el automóvil para. Sea T el tiempo en segundos que le lleva obtener que un

automóvil pare para llevarla. Encontrar la distribución de T.

Ejercicio 12 Dos hombres van a batirse a duelo. Ambos tienen un gran

abastecimiento de municiones y en cada intervalo fijo, cada uno dispara una

vez al otro (lo hacen simultáneamente). En cada disparo el hombre i tiene

probabilidad pi de acertar con un disparo (que siempre será de muerte) en

el otro. Las rondas son independientes y las probabilidades permanecen constantes.

1. Encuentre la probabilidad de que el duelo termine en exactamente 13

rondas.

2. Encuentre la probabilidad de que el hombre 1 resulte vivo.

Procesos estocásticos–Silvia Di Marco–2007

12

3. Encuentre la probabilidad de que el duelo termine en exactamente 13

rondas y el hombre 1 resulte vivo.

Ejercicio 13 Suponer que los clientes que arriban en una hora a una estación

de servicio es una variable aleatoria N con distribución

P (N = n) =

e−30 30n

,

n!

n ∈ N0

Calcular el promedio de ventas totales durante una hora, si cada cliente realiza un gasto aleatorio Yi con promedio 25$.

Pista: Zn = Y1 +Y2 +...+Yn es la cantidad total gastada por los primeros

n clientes. Si N es la cantidad de clientes en una hora, el gasto total que

ellos realizan es ZN = Y1 + Y2 + ... + YN . Se pide calcular E(ZN ).