Control Eestadistico de la Calidad y Seis Sigma Humberto Gutierrez Pulido

Anuncio

e

ña

n

de

x

l te

to

do

p

h

a ra

a

la

r

ce

r

ejo

má

s

los

m

do

oe

rir

on

sic

f

b

á

l

u

a

c

c

n:

ión

un ma.

a ra t a c a

s

i

n

p

v

e

s

ig

e

es

ar

ma os d

ido eis S

n

t

e

r

t

l

u

S

l

e ia

e

os

zó

nv

a r i n t re

ali ido.

co a t e g

v

e

a

r

E

h

)

tr

e

n

en

ro n a .

se a es

co

n s co n t

o4

)

).

lia áctic

l

o

ó

o

l

3

r

i

9

p

u

la

r

ic

o

m

u

lo

lib

de

e rd

pít

ed le s

tul

s

y a las p pítu

ca )

c u s co n a s

te d y

í

(

a

s

a

p

n

b

r

E ida

d s má

n

e nsi

e do

5

ro e n

ca

ca

o

ó

c

d

(

(

i

t

a

r

l

o

e

c

r

t e p re

o

na on on

EF

os

ca

os

ad

or

tul

o r p n d a d b i l i d p ro p c a p í o n a d

AM lacio ovar ersi

s t a co m

c

l

e

(

in

a

re

ci

a

de

sv

ba

en

E n ro y

l e s re l a

va ctos Se r n la

, s e d e m p ro r a u n

a

i

a

l

o

t

r

s

ú

c

s

á

de

pe 6). eg

o r m t o co

pa

au

ism

x h o s a s y 1 i co s

u

im dos m ones esis

on

e

s

a

n

A to

t

i

t

n

s

15

,l

os

uc hipó

ció 14) los tadís

es

ato

a

mé trib

c

d

z

u

o

o

l

li

ít

es

de

ra

is

pr

pa

t u a a p í t u ( c a p a re

ba

ra

•D

c

e

a

d

a

w

a

t

(c

ru

a

da

Ap

• P paci

un 008 Sigm e sof ab).

IM

ó

R

z

s

2

a

d

A

i

li

l

nit

• C rtas

ea n de s Se l uso y Mi

r

a

se ció

cto e e

el

•C

i é n e d i ro ye s o b r , E x c

b

s

p

a

m

Ta uart ia y ones phic

c

g

a

i

l a ra t e i c a c a t g r

t

l

t

e s ex p s ( S

e

s

t

la ien

re c

978-607-15-0929-1

Gutiérrez · De la Vara

a

nl

e

ns

d

za

os

el

to

mé

e

sd

do

i

l

rto z Pu

r

e

a

b

e

z

r

m

ala

Hu tiér

S

Gu mán Vara

Ro la

de

ión

c

i

ed

a

er

c

r

Te

Control estadístico

de la calidad

y Seis Sigma

Control estadístico

de la calidad

y Seis Sigma

Tercera edición

Humberto Gutiérrez Pulido

Centro Universitario de Ciencias Exactas e Ingeniería

Universidad de Guadalajara

Román de la Vara Salazar

Centro de Investigación en Matemáticas

Guanajuato, México

MÉXICO • BOGOTÁ • BUENOS AIRES • CARACAS • GUATEMALA

SAO PAULO • MADRID • NUEVA YORK • SAN JUAN • SANTIAGO

AUCKLAND • LONDRES • MILÁN • MONTREAL • NUEVA DELHI

SAN FRANCISCO • SINGAPUR • SAN LUIS • SIDNEY • TORONTO

Director General: Miguel Ángel Toledo

Editor sponsor: Pablo E. Roig

Coordinadora editorial: Marcela I. Rocha

Editora de desarrollo: Ana L. Delgado

Supervisor de producción: Zeferino García

CONTROL ESTADÍSTICO DE LA CALIDAD Y SEIS SIGMA

Tercera edición

Prohibida la reproducción total o parcial de esta obra,

por cualquier medio, sin la autorización escrita del editor.

DERECHOS RESERVADOS © 2013, 2009 y 2004, respecto a la tercera edición por

McGRAW-HILL/INTERAMERICANA EDITORES, S.A. DE C.V.

A Subsidiary of The McGraw-Hill Companies, Inc.

Edificio Punta Santa Fe

Prolongación Paseo de la Reforma 1015, Torre A

Piso 17, Colonia Desarrollo Santa Fe,

Delegación Álvaro Obregón

C.P. 01376, México, D.F.

Miembro de la Cámara Nacional de la Industria Editorial Mexicana, Reg. Núm. 736

ISBN: 978-607-15-0929-1

ISBN (edición anterior): 978-970-10-6912-7

1234567890

2456789013

Impreso en México

Printed in Mexico

A Irma, Arnoldo, Noel y Axel

HGP

A Rosalinda, Armida y Román

RVS

Contenido

Acerca de los autores . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

xiii

Prefacio . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

xv

Agradecimientos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . xvii

Capítulo 1

Conceptos básicos de la calidad y la productividad . . . . . . . . . . . . . . .

2

Calidad y competitividad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Productividad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Medición del desempeño de una empresa . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Variabilidad y pensamiento estadístico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Ciclo de la calidad (ocho pasos en la solución de un problema) . . . . . . . . . . . . . . . . . . . .

4

7

8

10

11

Capítulo 2

Capacidad de procesos I: Estadística descriptiva . . . . . . . . . . . . . . . . .

16

Medidas de tendencia central . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Medidas de dispersión o variabilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

–

Relación entre X y S (interpretación de la desviación estándar) . . . . . . . . . . . . . . . . . . . . .

Histograma y tabla de frecuencias . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Medidas de forma . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Cuantiles (percentiles) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diagrama de caja . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estudio real (integral) de capacidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Uso de sistemas computacionales . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

19

21

22

23

28

29

31

33

33

Capítulo 3

Introducción a la probabilidad. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

42

Conceptos de probabilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Distribuciones discretas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Distribución normal. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Verificación de normalidad (gráficas de probabilidad) . . . . . . . . . . . . . . . . . . . . . . . . . . .

Distribuciones derivadas del muestreo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

44

45

49

51

54

viii

Contenido

Capítulo 4

Elementos de inferencia estadística . . . . . . . . . . . . . . . . . . . . . . . . . . .

60

Conceptos básicos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estimación puntual y por intervalo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Conceptos básicos de prueba de hipótesis . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Prueba para la media . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Prueba para la varianza . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Prueba para una proporción . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Tres criterios de rechazo o aceptación equivalentes. . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Hipótesis para dos parámetros: comparación de dos procesos o poblaciones . . . . . . . . .

Poblaciones pareadas (comparación de dos medias con muestras dependientes) . . . . . .

Uso de software . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

62

64

69

72

74

75

75

77

81

85

Capítulo 5

Índices de capacidad, métricas Seis Sigma

y análisis de tolerancias . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

96

Índices de capacidad para procesos con doble especificación . . . . . . . . . . . . . . . . . . . . . .

Capacidad de largo plazo e índices Pp y Ppk . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Métricas Seis Sigma . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Procesos con sólo una especificación . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estimación por intervalo de los índices de capacidad . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estudio real (integral) de capacidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Capacidad para procesos no normales . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diseño de tolerancias . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estimación de los límites naturales de tolerancia de un proceso . . . . . . . . . . . . . . . . . . . .

Uso de software . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

98

104

106

113

114

116

117

121

121

128

Capítulo 6

Herramientas básicas para Seis Sigma . . . . . . . . . . . . . . . . . . . . . . . . . 134

Diagrama de Pareto . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estratificación . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Hoja de verificación (obtención de datos) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diagrama de Ishikawa (o de causa-efecto). . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Lluvia de ideas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diagrama de dispersión . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diagramas de proceso . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Despliegue de la función de calidad (DFC, QFD). . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Sistemas poka-yoke . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

136

139

143

147

153

154

158

160

164

Contenido

Capítulo 7

Cartas de control para variables . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 172

Causas comunes y especiales de variación . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Cartas de control—. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Carta —

de control X -R . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Carta X -S . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Interpretación de las cartas de control y causas de la inestabilidad . . . . . . . . . . . . . . . . .

Índice de inestabilidad, St . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Carta de individuales . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Cartas de precontrol . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Uso de software estadístico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

174

176

178

185

186

192

193

196

198

Capítulo 8

Cartas de control para atributos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 210

Cartas p y np (para defectuosos) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Cartas c y u (para defectos) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Implantación y operación de una carta de control . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Uso de software estadístico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

212

220

224

230

Capítulo 9

Cartas CUSUM, EWMA y ARIMA . . . . . . . . . . . . . . . . . . . . . . . . . . . . 236

Carta CUSUM . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Carta EWMA . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Carta ARIMA para datos autocorrelacionados . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Modelos ARIMA . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Uso de software estadístico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

239

244

245

247

250

Capítulo 10

Estado de un proceso: capacidad y estabilidad . . . . . . . . . . . . . . . . . . 254

Estado de un proceso . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estrategias de mejora . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

256

258

ix

x

Contenido

Capítulo 11

Calidad de mediciones (repetibilidad y reproducibilidad) . . . . . . . . . . . 264

Conceptos básicos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estudio largo de repetibilidad y reproducibilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estudio R&R corto . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Monitoreo del sistema de medición . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estudios R&R para pruebas destructivas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estudios R&R para atributos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Uso de software estadístico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

266

268

279

280

284

286

292

Capítulo 12

Muestreo de aceptación . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 302

Cuándo aplicar el muestreo de aceptación . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Tipos de planes de muestreo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Formación del lote y selección de la muestra . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Aspectos estadísticos: variabilidad y curva característica

de operación . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diseño de un plan de muestreo simple

con NCA y NCL específicos (método de Cameron) . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Military Standard 105E . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Planes de muestreo Dodge-Roming . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Plan de muestreo PDTL (NCL, LTPD) con c = 0 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Muestreo de aceptación por variables (MIL STD 414) . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Uso de software estadístico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

304

306

307

308

314

317

327

331

334

337

Capítulo 13

Confiabilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 344

Preguntas en un estudio de confiabilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Características de los estudios de confiabilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Tipos de censura en confiabilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Funciones en confiabilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Modelos (distribuciones) para el tiempo de falla . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Especificación de la distribución de vida

y estimación gráfica de sus parámetros . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Estimación por mínimos cuadrados y por máxima verosimilitud . . . . . . . . . . . . . . . . . . . .

Varios modos de falla . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Confiabilidad de sistemas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Uso de software estadístico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

346

347

347

349

354

359

365

368

369

372

Contenido

Capítulo 14

Análisis de modo y efecto de las fallas (AMEF) . . . . . . . . . . . . . . . . . . 380

Actividades para realizar un AMEF (proceso) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Encabezados del formato AMEF (campos A-H) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Cuerpo del formato AMEF (campos a-n) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Mantenimiento de los AMEF de procesos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

382

382

384

393

Capítulo 15

Estrategia Seis Sigma . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 396

Antecedentes y características de Seis Sigma . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Características (principios) de Seis Sigma . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Etapas de un proyecto Seis Sigma . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diseñar para Seis Sigma (DMADV) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diseño para confiabilidad . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Lean Seis Sigma . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Implantación de la estrategia 6σ . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

398

399

404

412

414

414

424

Capítulo 16

Ejemplo de proyecto Seis Sigma . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 430

Definición . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Medición . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Análisis. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Identificación de las pocas X vitales . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Mejora . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Evaluar las soluciones propuestas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Resultados alcanzados. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Control . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

432

432

437

438

440

441

442

443

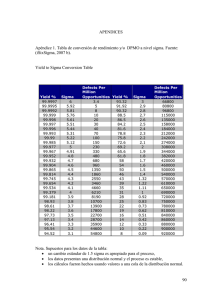

Apéndice . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 449

Bibliografía y referencias . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 459

Índice analítico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 461

xi

Acerca de los autores

Humberto Gutiérrez Pulido es profesor investigador en el Centro Universitario de Ciencias

Exactas e Ingeniería de la Universidad de Guadalajara, además es miembro del Sistema

Nacional de Investigadores. Obtuvo el doctorado en estadística por el Centro de Investigación

en Matemáticas (CIMAT), en Guanajuato, México.

Durante 20 años ha sido profesor de licenciatura y posgrado en las materias de calidad,

control estadístico, estadística y diseño de experimentos. En estos mismos campos ha dado

capacitación y asesoría en más de 100 empresas e instituciones de México y Latinoamérica. A

lo largo de su trayectoria ha escrito más de 50 artículos de investigación y 13 libros, entre ellos

la tercera edición de Calidad total y productividad y Análisis y diseño de experimentos, ambos publicados por McGraw-Hill.

También ha sido conferenciante en México y diferentes países, y ha desempeñado funciones directivas en instituciones públicas.

Román de la Vara Salazar es investigador consultor en el área de Ingeniería de Calidad del

Centro de Investigación en Matemáticas (CIMAT), Guanajuato, México. Es doctor en estadística por el CIMAT.

Entre las empresas e instituciones en las que ha impartido capacitación y/o asesoría en

ingeniería para la calidad y estadística, destacan las siguientes: Pemex, Inegi, Cenam, ANPIC,

Motorola, Kodak, General Motors, Grupo IG, Mabe y Bimbo.

Prefacio

En este libro se abordan los principales conceptos y métodos del control estadístico de calidad

y los aspectos esenciales de la estrategia de mejora conocida como Seis Sigma (6σ). El control

estadístico ha demostrado su utilidad tanto en las empresas de manufactura como de servicio,

ya que con las exigencias de mejora a la que se ven expuestas las organizaciones, debido a la

alta competitividad de los mercados globalizados, se ha hecho más evidente la necesidad de

ampliar la comprensión y utilización del pensamiento estadístico, y aplicar conceptos y técnicas estadísticas para una diversidad de tareas y propósitos, por ejemplo:

•

•

•

•

•

Identificar dónde, cómo, cuándo y con qué frecuencia se presentan los principales problemas en una organización.

Detectar con rapidez, oportunidad y a bajo costo anormalidades en los procesos y sistemas

de medición (monitoreo eficaz).

Analizar en forma efectiva el desempeño de los procesos y la organización misma a través

de indicadores de desempeño.

Ser objetivos en la planeación y toma de decisiones; expresar los hechos en forma de datos

y evaluar objetivamente el impacto de acciones de mejora.

Analizar lógica, sistemática y ordenadamente la búsqueda de mejoras.

En cuanto a Seis Sigma, ésta es una de las principales estrategias que, por más de una década, han utilizado varias de las compañías líderes a nivel mundial, y gracias a su exitosa aplicación ha generado beneficios millonarios. Seis Sigma es una estrategia de mejora continua del

negocio que busca encontrar y eliminar las causas de los errores, defectos y retrasos en los procesos del negocio, enfocándose en aquellos aspectos que son críticos para el cliente. La estrategia 6σ se apoya en una metodología altamente sistemática y cuantitativa orientada a mejorar

los resultados del negocio en tres áreas prioritarias de acción: satisfacción del cliente, reducción

del tiempo de ciclo y disminución de los defectos. La meta de 6σ, que le da el nombre, es lograr

procesos con calidad Seis Sigma, es decir, procesos que como máximo generen 3.4 defectos por

millón de oportunidades de error. Esta meta se alcanza mediante un programa vigoroso de

mejora, diseñado e impulsado por la alta dirección de una organización, en el que se desarrollan proyectos en las diferentes áreas de la empresa con el objetivo de lograr mejoras y remover

defectos y retrasos de productos, procesos y transacciones. La metodología en la que se apoya

Seis Sigma está definida y fundamentada en las herramientas y el pensamiento estadísticos.

Por lo anterior, el objetivo de este libro, además de abordar conceptos y técnicas del control

estadístico, es agregar varios de los métodos que más se utilizan en un proyecto Seis Sigma, así

como describir con detalle las características principales de la estrategia Seis Sigma.

El libro es resultado de más de 20 años de enseñanza, capacitación y asesoría sobre control

estadístico de calidad y estrategias de mejora. Así, además de la contribución de los autores, esta

obra ha sido posible gracias a las ideas, comentarios, dudas, ejemplos, datos, respuestas, discusiones y experiencia de las personas con las que se ha tenido contacto en el terreno profesional;

desde estudiantes universitarios, estudiantes de posgrado, investigadores hasta personal técnico

y directivo de empresas e instituciones. Las respuestas a esas dudas, las experiencias y los diferentes aportes se han vertido en los 16 capítulos del libro, que cuenta con abundante material

gráfico, tablas, alrededor de 70 ejemplos y más de 300 preguntas y ejercicios reales.

Esperamos que esta obra resulte un aporte para enfrentar de mejor manera los tiempos

actuales, ya que la globalización y la alta competencia es una realidad tan contundente que deja

poco lugar a dudas acerca de la necesidad de que las organizaciones enfrenten rápida y eficazmente esta competencia. Se puede afirmar que en buena parte la globalización ha dejado atrás

muchas discusiones sobre la forma de enfrentar los nuevos tiempos. Hoy se sabe casi en todas

las empresas y organizaciones que ya no hay clientes cautivos, y que en cualquier momento los

xvi

Prefacio

clientes pueden encontrar una alternativa mejor. En este contexto la aplicación de la estrategia

Seis Sigma, con sus métodos, representan una excelente opción.

El libro se ha organizado en 16 capítulos. En el primero se hace una revisión de los conceptos básicos de la calidad y la productividad; en los capítulos 2 y 5 se analizan los conceptos y

métodos para hacer un estudio de capacidad de un proceso, incluyendo las métricas de Seis

Sigma y el diseño de tolerancias. Los capítulos 3 y 4 tienen como propósito proporcionar algunos fundamentos teóricos de la probabilidad y estadística, que son necesarios para entender

mejor el resto de los métodos. En los capítulos 7 a 10 se describen las técnicas para evaluar la

estabilidad de un proceso: cartas de control básicas (tipo Shewhart), de precontrol y avanzadas,

y el estado de un proceso en cuanto a capacidad y estabilidad. En el capítulo 11 se detallan los

métodos para evaluar el funcionamiento de un sistema de medición (estudios R&R y otros),

indispensables en un proyecto Seis Sigma. En los capítulos 12 y 13 se estudia, respectivamente,

el tradicional muestreo de aceptación y se da una introducción a la confiabilidad.

En los capítulos 6 y 14 se describen varios métodos de frecuente aplicación en el contexto de

proyectos Seis Sigma, como las herramientas básicas, diferentes tipos de diagramas de proceso,

QFD, Amef, etc. Finalmente, los capítulos 15 y 16 están dedicados a describir las principales

características de la estrategia Seis Sigma: sus antecedentes, metodología para el desarrollo de

proyectos, roles y características de las personas en las que se respalda Seis Sigma (black belts,

green belts, etc.). En cada uno de estos capítulos se presenta un ejemplo real de proyecto Seis

Sigma.

Al final de cada capítulo se han agregado preguntas y ejercicios con la idea de presentar

material adicional complementario. En suma, con el contenido del libro se cubren los temas

tradicionales del programa de control estadístico que se imparte a nivel universitario, así como

otros métodos indispensables para la realización de proyectos Seis Sigma, con lo cual tanto el

profesor como el alumno pueden profundizar en temas adicionales para lograr una visión más

completa sobre la materia.

De hecho, respecto a los métodos de mayor uso en Seis Sigma, además de los que se describen en este libro faltaría agregar lo referente a Diseño y análisis de experimentos. Materia que se

puede consultar en Gutiérrez Pulido y De la Vara Salazar (2011), que es un libro complementario de éste.

Sobre la tercera edición

En esta tercera edición se ha hecho una revisión de la edición anterior, con el propósito de

hacer más fácil y clara la lectura de la obra, eliminar redundancias, ampliar y actualizar algunos temas, y agregar otros junto con nuevos ejercicios. Los mayores cambios resultaron en los

capítulos. En lo que se refiere a nuevos temas destacan: más distribuciones de probabilidad

(capítulo 3), prueba de hipótesis para una proporción (capítulo 4), capacidad para datos nonormales (capítulo 5), cartas ARIMA para procesos autocorrelacionados (capítulo 9), actualización exhaustiva del AMEF de acuerdo con la cuarta edición de ese procedimiento norma del

2008 (capítulo 14) y aspectos relacionados con la estrategia y proyectos Seis Sigma (capítulos

15 y 16). Asimismo se actualizan todas las explicaciones sobre el uso de software estadístico de

acuerdo con las versiones más recientes (Statgraphics, Excel y Minitab).

Esperamos que con estas mejoras y nuevos materiales el libro siga siendo bien recibido por

la comunidad iberoamericana.

Agradecimientos

Un agradecimiento especial a los profesores y especialistas que, a partir de la revisión de la

segunda edición, hicieron observaciones y propuestas para mejorar esta obra en su tercera edición:

Aída Hernández Hernández

Alberto Michaelis Quintana

Angélica Galindo Flores

Eduardo Carranza Torres

Elizabeth González Valenzuela

Gaspar Alberto Pérez Martínez

Gilberto Orrantia Daniel

Gilberto Ortiz Suárez

María Guadalupe Durán Rojas

Guillermo Cuamea Cruz

Ignacio Fonseca Chon

Isidro Ramos Torres

Isidro Rodríguez Montoro

Ismael Lara García

Ivonne Abud Urbiola

Universidad Politécnica de Tlaxcala

Universidad Tec Milenio

Universidad La Salle Cuernavaca

Universidad Nacional Autónoma de México

Instituto Tecnológico de Sonora

Instituto Tecnológico de Campeche.

Instituto Tecnológico de Hermosillo

Universidad de Sonora

Universidad Nacional Autónoma de México

Universidad de Sonora

Universidad de Sonora

Universidad de Sonora

Instituto Tecnológico Superior de Misantla

Universidad Veracruzana

Instituto Tecnológico y de Estudios Superiores

de Monterrey, Campus Estado de México

Laura Emilia Velázquez Lizárraga

Luis Arturo Ochoa Regalado

Marco Antonio Gómez Velez

Myrta Rodríguez Sifuentes

Instituto Tecnológico de Morelia

Universidad de Guadalajara

Instituto Tecnológico de Toluca

Instituto Tecnológico de Estudios Superiores de

Monterrey, Campus Sonora Norte

Nelly del Rosario Chan Perera

Nora Silvia Cardoza Ochoa

Óscar Manuel Munguía

Instituto Tecnológico Superior de Valladolid

Instituto Tecnológico de Tijuana

Instituto Tecnológico y de Estudios Superiores de

Monterrey, Campus Sonora Norte

Patricia Rodríguez Briones

René Daniel Fornés Rivera

Rosa Elia Herrera Deveze

Salomé de Jesús Sánchez Apreza

Susana Xenia Salazar Lizan

Instituto Tecnológico de Durango

Instituto Tecnológico de Sonora

Universidad La Salle, Cuernavaca

Instituto Tecnológico de Nogales

Instituto Tecnológico de Veracruz

Control estadístico

de la calidad

y Seis Sigma

•

•

•

•

•

Calidad y competitividad

Productividad

Medición del desempeño de una empresa

Variabilidad y pensamiento estadístico

Ciclo de calidad (ocho pasos en la solución

de un problema)

Conceptos básicos

de la calidad y la productividad

• Analizar el concepto de calidad y los factores de

la competitividad como elementos centrales de la

existencia de una empresa u organización.

• Profundizar en el entendimiento de la productividad.

• Explicar cómo ha evolucionado la forma de medir

el desempeño de una empresa, destacando la

importancia que ahora tiene considerar la opinión de

los clientes.

• Describir el concepto de variabilidad en los procesos,

así como la importancia del pensamiento estadístico

para lograr que los proyectos Seis Sigma sean exitosos.

• Entender el ciclo de calidad y los ocho pasos en la

solución de un problema.

Calidad del producto

Competitividad

Calidad del servicio

Precio

Eficiencia

Productividad

Eficacia

Calidad

Proceso (6 M)

Variabilidad

Pensamiento estadístico

Acciones correctivas

y preventivas

Mejora

El ciclo de la calidad

(PHVA)

4

CAPÍTULO 1 Conceptos básicos de la calidad y la productividad

Calidad y competitividad

Desde el punto de vista de los clientes, las empresas y/u organizaciones existen para proveer

un producto material o inmaterial, un bien o un servicio, ya que ellos necesitan productos con

características que satisfagan sus necesidades y expectativas. Estos productos son resultado

de un proceso (vea la figura 1.1), que es un conjunto de actividades mutuamente

Variables de entrada del proceso

relacionadas o que interactúan, las cuales transforman elementos de entrada en

Definen las características de los in- resultados. Un proceso está conformado por varias etapas o subprocesos, mientras que las entradas o insumos incluyen sustancias, materiales, productos o

sumos y las variables de operación

equipos. Los resultados o salidas pueden ser un producto en sí o alguna modifiy control de un proceso.

cación de los insumos, que a su vez será un insumo para otro proceso.

Las variables de salida, es decir, las características de calidad o variables de

Variables de salida

respuesta,

las Y, son las variables en las que se reflejan los resultados obtenidos

Son las características de calidad

en

un

proceso.

A través de los valores que toman estas variables se evalúa la efien las que se reflejan los resultados

cacia

del

proceso;

por ello, al analizarlas se estará escuchando la “voz” de éste

obtenidos por un proceso.

(figura 1.1). Algunos ejemplos de estas variables, que son específicas para cada

tipo de producto y proceso son: dimensiones (longitud, espesor, peso, volumen);

propiedades físicas, químicas o biológicas; características superficiales, propiedades eléctricas, sabor, olor, color, textura, resistencia, durabilidad, etcétera.

Una exigencia fundamental de los clientes es que los productos sean de calidad. Sobre el

particular existen varias definiciones; por ejemplo, Juran sostiene que: “Calidad es que un

producto sea adecuado para su uso. Así, la calidad consiste en la ausencia de deficiencias en

aquellas características que satisfacen al cliente” (Juran, 1990); mientras que de acuerdo con

la definición de la American Society for Quality (ASQ), la calidad tiene dos significados:

“características de un producto o servicio que le confieren su aptitud para satisfacer necesida-

Voz cliente

Insumos

Resultados

Transformación

Diseño

Proveedores

Planeación

Productos

Primera

etapa

Segunda

etapa

Etapa n

Clientes

Servicios

Compras

Proceso

Voz proceso

(Realimentación vs.

especificación)

■ FIGURA 1.1 Esquema de un proceso. Sobre los productos se miden las variables de salida.

Calidad y competitividad

5

des explícitas o implícitas”, y “un producto o servicio libre de deficiencias”; en

las Normas ISO-9000:2005 se define calidad como “el grado en el que un con- Calidad

junto de características inherentes cumplen con los requisitos”, entiendiéndose Características de un producto o

por requisito una necesidad o expectativa por lo general implícita u obligatoria. servicio que le confieren su aptitud

Así, la calidad se relaciona ante todo con la satisfacción del cliente, que está ligada para satisfacer necesidades explícia las expectativas que éste tiene con respecto al producto o servicio. Las expec- tas o implícitas.

tativas son generadas de acuerdo con las necesidades, los antecedentes, el precio

del producto, la publicidad, la tecnología, la imagen de la empresa, etc. Se dice

que hay satisfacción cuando el cliente percibe del producto o servicio al menos

lo que esperaba.

De aquí se deriva que en la satisfacción del cliente influyen los siguientes tres

aspectos: la calidad del producto, el precio y la calidad del servicio. Se es más Satisfacción del cliente

competitivo, es decir, se hacen las cosas mejor que otros, cuando se es capaz de Es la percepción de éste acerca del

ofrecer mejor calidad a bajo precio y mediante un buen servicio. En la figura 1.2 grado con el cual sus necesidades o

se muestran los aspectos que de manera usual se incluyen en cada uno de estos expectativas han sido cumplidas.

tres aspectos que son indicadores de la competitividad de una organización.

Como se aprecia, en la columna de calidad se incluye la tecnología del producto,

que implica la necesidad de innovar para ser competitivo, ya que un producto puede estar libre de defectos; no obstante, el cliente está esperando que además tenga nuevos y mejores

atributos. También se ve que uno de los componentes de la calidad en el servicio es tener menores tiempos de la entrega porque en la actualidad se requiere que el producto esté justo

cuando se le necesita (justo a tiempo).

El tiempo de entrega está relacionado con el tiempo de ciclo, que corresponde al

Tiempo de ciclo

tiempo que transcurre desde que el cliente inicia un pedido, el cual se transforma

en requerimientos de materiales, órdenes de producción y de otras tareas, hasta Es el tiempo que transcurre desde

que todo esto se convierte en un producto en las manos del cliente. De esta forma que el cliente inicia un pedido que

el tiempo de ciclo refleja en buena medida el tiempo que tardan las diferentes eta- se transforma en requerimientos de

materiales, órdenes de producción

pas del proceso y la sincronización o fluidez que se le da a las diferentes tareas.

y de otras tareas, hasta que todo

Se pensaba que calidad, precio y tiempo de entrega eran objetivos antagónicos,

se convierte en un producto en las

en el sentido de que se podía mejorar cualquiera de los tres sólo en detrimento de

manos de éste.

los otros dos. De hecho, en algunas organizaciones se sigue creyendo que mejorar

la calidad implica necesariamente un precio más alto y mayor tiempo de elabora-

Satisfacción del cliente:

competitividad de una empresa

Indicadores críticos

Calidad del producto

Calidad en el servicio

Precio

Atributos

Tecnología

Funcionalidad

Durabilidad

Prestigio

Confiabilidad

Tiempo de entrega

Flexibilidad en

capacidad

Disponibilidad

Actitudes y conductas

Respuesta a la falla

Asistencia técnica

Precio directo

Descuentos/ventas

Términos de pago

Valor promedio

Costo servicio posventa

Margen de operación

Costos totales

■ FIGURA 1.2 Indicadores de la competitividad y de la satisfacción del cliente.

6

CAPÍTULO 1 Conceptos básicos de la calidad y la productividad

ción. Sin embargo, cada día hay más organizaciones en las que se sabe que la calidad en todas

las áreas y actividades influye de manera positiva en todos los aspectos. Cuando se tiene mala

calidad en las diferentes actividades hay equivocaciones y fallas de todo tipo, por ejemplo:

•

•

•

•

•

•

•

•

•

•

•

Reprocesos, desperdicios y retrasos en la producción.

Pagar por elaborar productos malos.

Paros y fallas en el proceso.

Una inspección excesiva para tratar que los productos de mala calidad no salgan al mercado.

Reinspección y eliminación de rechazo.

Más capacitación, instrucciones y presión a los trabajadores.

Gastos por fallas en el desempeño del producto y por devoluciones.

Problemas con proveedores.

Más servicios de garantía.

Clientes insatisfechos y pérdidas de ventas.

Problemas, diferencias y conflictos humanos en el interior de la empresa.

La característica común de cada uno de los aspectos anteriores es

que implican más gastos, así como menos producción y ventas. Es

Fallas y deficiencias

necesario cubrir los pagos de la gente que hace la inspección, los reprocesos, de quienes atienden los retrasos y de los que se encargan de

los servicios de garantía; además, usan máquinas, espacios, energía

Reprocesos, desperdicios, retrasos, equivocaciones,

eléctrica y requieren mandos que los coordinen. En este sentido, la

paros, inspección excesiva, desorganización,

mala calidad no sólo trae como consecuencia clientes insatisfechos

problemas con proveedores y clientes, conflictos

sino también mayores costos; por lo tanto, no es posible competir en

humanos en el interior de la empresa

calidad ni en precio, menos en tiempos de entrega. Un proceso de

mala calidad es errático, costoso, inestable y no se puede predecir. La

figura 1.3 sintetiza la relación entre mala calidad y competitividad.

Más gastos

Cabe señalar que los costos de la mala calidad pueden ser muy

altos dependiendo del desempeño de la empresa, e incluso llegan

a representar entre 25 y 40% de las ventas de la empresa (vea el capíMenos competitividad

tulo 15).

Por otra parte, al mejorar la forma en que se realizan todas las

■ FIGURA 1.3 Con fallas y deficiencias no es

actividades se logra una reacción que genera importantes beneficios;

posible competir en calidad ni en precio, menos

por ejemplo, se reducen reprocesos, errores, retrasos, desperdicios y

en tiempos de entrega.

artículos defectuosos; asimismo, disminuye la devolución de productos, las visitas a causa de la garantía y las quejas de los clientes. Al

disminuir las deficiencias se reducen los costos y se liberan recursos materiales y humanos que

se pueden destinar a elaborar más productos, resolver otros problemas de calidad, reducir los

tiempos de entrega o proporcionar un mejor servicio al cliente, lo cual incrementa la productividad y que la gente esté más contenta con su trabajo. Lo anterior se sintetiza en la figura 1.4,

cuyo concepto fue presentado por primera vez en 1950 por Edwards Deming a un grupo de

industriales japoneses.

De acuerdo con lo anterior se ve la importancia del control de calidad, que es el conjunto de

actividades orientadas al cumplimiento de los requisitos de la calidad. Además, es necesario

implementar estrategias de mejora, como Seis Sigma, que al reducir los costos de no calidad e

incrementar la productividad, se vuelven atractivas desde el punto de vista económico.

Competitividad

Así, a manera de resumen, la competitividad se define como la capacidad de

una

empresa para generar valor para el cliente y sus proveedores de mejor maneEs la capacidad de una empresa

ra

que

sus competidores. Esta capacidad se manifiesta por medio de niveles adepara generar valor para el cliente y

cuados

para los diferentes componentes de los indicadores de la competitividad

sus proveedores de mejor manera

(vea la figura 1.2).

que sus competidores.

Productividad

Productividad

7

Se mejora todo

En general, la productividad se entiende como la relación entre lo

producido y los medios utilizados; por lo tanto, se mide mediante el cociente: resultados logrados entre recursos empleados.

Disminuyen los costos porque hay menos reprocesos, fallas

y retrasos; de esta manera se utilizan mejor los materiales,

Los resultados logrados pueden medirse en unidades producidas,

máquinas, espacios y recursos humanos

piezas vendidas, clientes atendidos o en utilidades. Mientras

que los recursos empleados se cuantifican por medio del número

de trabajadores, tiempo total empleado, horas-máquina, costos,

Mejora la productividad

etc. De manera que mejorar la productividad es optimizar el uso

de los recursos y maximizar los resultados. De aquí que la productividad suela dividirse en dos componentes: eficiencia y eficacia. La primera es la relación entre los resultados logrados y los

Se es más competitivo en calidad y precio

recursos empleados, se mejora principalmente optimizando el

uso de los recursos, lo cual implica reducir tiempos desperdiciados, paros de equipo, falta de material, retrasos, etc. Mientras

Hay cada vez más trabajo

que la eficacia es el grado con el cual las actividades previstas

son realizadas y los resultados planeados son logrados. Por lo ■ FIGURA 1.4 Al mejorar la calidad se da una reacción

tanto, ser eficaz es cumplir con objetivos y se atiende mejorando

en cadena.

los resultados de equipos, materiales y en general del proceso.

Por ejemplo, si la productividad se mide a través de las unidades producidas entre el tiempo total empleado (figura 1.5), entonces la eficiencia será la reProductividad

lación entre tiempo útil y tiempo total; mientras que la eficacia será el cociente

entre las unidades producidas y el tiempo útil. De esta manera, la figura 1.5 su- Es la capacidad de generar resultagiere dos programas para incrementar la productividad: mejorar eficiencia, en la dos utilizando ciertos recursos. Se

que se busque reducir los tiempos desperdiciados por paros de equipos, carencia incrementa maximizando resultade materiales, falta de balance en las capacidades, retrasos en los suministros y dos y/u optimizando recursos.

en las órdenes de compra, así como por mantenimiento y reparaciones no programadas. Según una encuesta aplicada en los sectores metalmecánico, de mue- Eficiencia

bles, calzado, textil y de la confección en México (Eroles, et al., 1998), la eficien- Relación entre los resultados locia promedio detectada fue de 50%, es decir, que en estos sectores se desperdicia grados y los recursos empleados.

la mitad del tiempo en promedio por aspectos de logística y organización princi- Se mejora optimizando recursos y

palmente. Por ello, tiene sentido la afirmación de la figura 1.5, cuando se dice reduciendo tiempos desperdiciados

que más que producir rápido es preferible hacerlo mejor, incrementando el flujo por paros de equipo, falta de material, retrasos, etcétera.

del trabajo y reduciendo los tiempos desperdiciados a lo largo de los procesos.

Por otro lado está la mejora de la eficacia, en la cual se busca la disminución de

los productos con defectos, las fallas en arranques y en la operación de procesos. Eficacia

Es decir, se busca disminuir las deficiencias en materiales, diseños y equipos; Grado con el cual las actividades

además de incrementar y mejorar las habilidades del personal y generar progra- planeadas son realizadas y los remas que le ayuden a la gente a realizar mejor su trabajo. Según la encuesta antes sultados previstos son logrados. Se

referida, la eficacia promedio detectada fue de 80%, lo cual significa que si se atiende maximizando resultados.

planean materiales y actividades para producir 100 unidades, al final sólo 80 en

promedio están libres de defectos y las otras 20 se quedaron a lo largo del proceso Acciones preventivas

por algún tipo de defecto. De estas 20 algunas podrán reprocesarse y otras se Son aquellas que se implementan

para eliminar la causa de una no

convertirán en desperdicio.

De esta manera, al multiplicar eficiencia por eficacia se tiene una productivi- conformidad potencial o de aldad promedio de 40% en las ramas industriales referidas, lo cual indica el poten- guna otra situación potencial no

cial y el área de oportunidad que existe en mejorar el actual sistema de trabajo y deseable.

de organización mediante programas de mejora continua.

Así, el reto es buscar la mejora continua, ya sea mediante acciones preventivas o Acciones correctivas

correctivas. Las primeras sirven para eliminar la causa de una no conformidad Se emplean para eliminar la causa

potencial o de alguna otra situación no deseable, o sea que se enfoca a prevenir de una no conformidad detectada.

la ocurrencia. Las segundas acciones son para eliminar la causa de la inconfor- Es decir, están orientadas a prevenir

recurrencias.

midad detectada y se emplean para prevenir la recurrencia.

8

CAPÍTULO 1 Conceptos básicos de la calidad y la productividad

Productividad: mejoramiento continuo del sistema.

Más que producir rápido, producir mejor.

Productividad = eficiencia × eficacia

Unidades producidas

Tiempo útil

Unidades producidas

=

×

Tiempo total

Tiempo total

Tiempo útil

Eficiencia = 50%

Eficacia = 80%

El 50% del tiempo se

desperdicia en:

• Programación

• Paros no programados

• Desbalance de capacidades

• Mantenimiento

y reparaciones

De 100 unidades, 80

están libres de defectos,

20 tuvieron algún defecto

Un concepto relacionado con los anteriores es la efectividad, que se refiere a que los objetivos planteados sean trascendentes y se alcancen. Esto es importante porque una empresa puede plantearse una serie de objetivos y ser eficaz en

su cumplimiento, pero quizá no reflejen de manera clara el

desempeño de los procesos de la empresa.

Medición del desempeño

de una empresa

Un aspecto fundamental en una organización es decidir qué

y cómo se va a medir su salud y desempeño, ya que la elección de lo que un negocio o un área mide y analiza comunica

valor, encauza el pensamiento de los empleados y fija las

prioridades. Las medidas son un medio sistemático para con■ FIGURA 1.5 Resultados de un estudio de productividad

vertir las ideas en acción. Por lo tanto, la medición constituye

en México.

uno de los aspectos esenciales en el control estadístico y en la

estrategia de mejora Seis Sigma.

Es necesario medir lo que es importante y clave en los procesos, así como los resultados que se quieren mejorar. La siguiente frase sintetiza esta idea:

“dime qué mides y cómo lo analizas y te diré qué es importante para tu área y para tu empresa”. O en palabras de H. J. Harrington: “…la peculiaridad que distingue a los seres humanos

de los otros seres vivos es su capacidad de observar, medir, analizar y utilizar la

información para generar cambios” (Harrington, 2003).

Sistema de medición del desempeño

Una tarea esencial del líder y de su equipo es establecer el sistema de medición del

desempeño

de la organización, de modo que se tenga claro cuáles son los signos

Se refiere a cuantificar los signos vivitales de la salud de la organización y los procesos. De esta manera será posible

tales de la organización y con base

en ellos encauzar el pensamiento de encauzar el pensamiento y la acción (mejora) a lo largo del ciclo de negocio en los

diferentes procesos. En este sentido, hoy se sabe que los reportes de los resultados

los empleados y fijar prioridades.

financieros no son suficientes para medir la salud actual y futura de la organización.

En la figura 1.6 se muestra un esquema de cómo ha evolucionado lo que se mide y cómo se

administra una organización. Se aprecia cómo se parte desde el reporte financiero, pasando por

eño

s e mp d e s

e

d

l

ye

r ida

a lu d c e r p r i o

s

a

l

e

a r s t abl

v a lu

e

a r a e s io n e s y

p

s

o

i

i

c

r

e

e

t

d

i

cr oma r

as y

t

é t r ic ma s de

m

s

r

a

o

v

f

Toma más

e

s

u

ev a

nn

p o r a c i ó n. N u

importancia el

r

o

c

S e in r g a ni z a

cliente, la empresa

o

de la

se acerca a él, las

Cumplir con

decisiones están

especificaciones

basadas en sus

Enfoque

a

reducción

Análisis de

necesidades y

de

retrabajo

y

de

ganancias, enfoque a

expectativas

desperdicios

dividendos

Enfoque

al cliente

Estado

2

Estado 1

Estado

3

Conformancia

Reporte financiero

Clientes

La empresa amplía

sus perspectivas

y no sólo analiza la

satisfacción de sus

clientes, sino también

se pone en contacto

con el mercado

y se compara con

sus competidores

Enfoque al cliente

y al mercado

Estado 4

Mercado, papel

crítico de la calidad

■ FIGURA 1.6 Evolución de los criterios para determinar el desempeño de la empresa:

cada nuevo estado incorpora los anteriores criterios y agrega otros más.

Medición del desempeño de una empresa

9

medir la calidad y la no calidad en la empresa, hasta utilizar la calidad como un

Conformancia

factor clave en la administración del valor para el cliente.

La última etapa que refleja la figura 1.6 consiste en enfocar la empresa al Consiste en cumplir con las esmercado. Para ello, además de basarse en el reporte financiero y los criterios de pecificaciones de calidad y enfoconformancia de las diferentes operaciones, es necesario tomar en cuenta la eva- carse a reducir el retrabajo y los

luación de los clientes propios, los clientes de los competidores y, en general, se desperdicios.

requiere preguntar al mercado cómo percibe a la empresa.

En la figura 1.7 se ve que además del reporte financiero para los

Las guías clave del negocio

accionistas, la satisfacción del cliente y el desempeño de las operacioAsociación

nes, es necesario incorporar dos guías clave más: satisfacción y desacon proveedores

rrollo de los empleados, y asociación con proveedores. Así, el éxito de

una organización se debe procurar desde la selección de proveedores y

el seguimiento de lo que sucede en el proceso de éstos (que es la primeValor del

Satisfacción

ra parte del proceso de la empresa), para continuar con lo que pasa con

accionista

de los empleados

los empleados de la empresa (ningún éxito duradero se puede fincar en

estos tiempos en empleados insatisfechos, atemorizados y que no estén

desarrollándose como personas y como empleados). La siguiente guía

es proporcionada por la calidad de los resultados operacionales (evaluaciones de calidad, productividad, etc.). Estas tres guías se reflejan y

Desempeño

Satisfacción

del cliente

operacional

retroalimentan con la cuarta guía: la satisfacción del cliente. Por último, la quinta guía son los resultados para el accionista, que es en gran

■ FIGURA 1.7 Medición del desempeño de una

parte la consecuencia del resto de las guías.

organización.

A partir de la figura 1.7 se observa que el reporte financiero llega

demasiado tarde como para fundamentar la dirección de una organización sólo con esta guía.

Es necesario ir hacia atrás y obtener indicadores que reflejen en forma más preventiva la salud de la empresa.

En la figura 1.8 se muestran algunos de los indicadores específicos que conforman cada

una de las guías clave del negocio. Es importante que los datos de cualquier indicador clave

sean realistas, mensurables, procesables, fiables, de rápida actualización y de fácil acceso a

quienes lo requieren. El sistema de medición del desempeño, que en algunas organizaciones

recibe el nombre de tablero de control (vea Gutiérrez, 2010), debe proporcionar una orientación clara para las diferentes áreas y para los individuos en todos los niveles, de manera que

sepan si su desempeño es satisfactorio y qué aspectos es necesario mejorar. El sistema de

medición con los indicadores que se muestran en la figura 1.8 es balanceado y refleja en bue-

Evaluación del desempeño: guías fundamentales

Proveedores

•

•

•

•

•

•

•

•

•

Resultados de

auditorías

Sus índices de calidad

(por mes)

Selección

Clasificación

Capacidades

De calidad

De volumen

De entrega

De costos y precios

Empleados

•

•

•

•

•

Tendencias de la

producción

Actividad de los equipos

Tendencias de premios

y reconocimientos

Estudios de satisfacción

de los empleados

Crecimiento y desarrollo

Calidad operacional

•

•

•

•

•

•

•

Tiempo de ciclo

Rotación de inventarios

Eficiencia

Horas de retrabajo

Fiabilidad del proceso

industrial

Evaluación de calidad

(defectos, retrabajo,

desperdicios, etc.)

Proyectos de mejora

■ FIGURA 1.8 Algunos indicadores para las guías clave del negocio.

Clientes

•

•

•

•

•

Evaluaciones de calidad

Quejas del cliente

Calidad de la entrega

(servicio)

Análisis del mercado

Análisis de

competitividad

Accionistas

•

•

•

•

•

Retorno sobre activos

Utilidades

Costos operativos

Inversiones comerciales

Costos de servicio

posventa

10

CAPÍTULO 1 Conceptos básicos de la calidad y la productividad

na medida los diferentes intereses en la empresa (gerencia, empleados, accionistas, clientes

externos, proveedores). Una de las características de la estrategia Seis Sigma es promover la

cultura de usar datos para tomar decisiones y para guiar la organización, lo que implica reconocer la variabilidad y fomentar el pensamiento estadístico.

Variabilidad y pensamiento estadístico

La estadística está formada por un conjunto de técnicas y conceptos orientados a la recolección

y análisis de datos tomando en cuenta la variación en los mismos. Por su parte, el control estadístico de la calidad es la aplicación de técnicas estadísticas al control de calidad. Ahora veamos

con detalle el significado e importancia de la variabilidad.

Variabilidad

La variabilidad es parte de nuestra vida diaria; por ejemplo, el tiempo que tardamos en trasladarnos de nuestra casa al trabajo o escuela es diferente de una día a

Se refiere a la diversidad de reotro; la temperatura del ambiente es distinta de una hora a otra; lo dulce de una

sultados de una variable o de un

bebida que es preparada en casa es diferente de un día a otro aunque aparentemenproceso.

te se preparó igual, etc. Esta variación que ocurre en nuestra vida también está

presente en los procesos de las empresas. Por ejemplo, en un banco se lleva un

registro de los minutos que los clientes esperan para ser atendidos; al azar se eligen 40 de estos

tiempos de espera y se obtiene lo siguiente:

Variabilidad

18.1 7.9 14.6 13.6 14.2 13.0 11.0 7.4 8.7 11.3 13.4 7.0 5.4 9.2 8.0 4.8 14.2 13.5 13.9 11.8

11.3 12.9 15.7 13.3 6.7 0.7 13.1 9.6 6.8 9.1 9.3 9.3 9.0 14.2 12.2 12.5 11.4 7.7 6.9 11.4

En el caso de esta muestra el tiempo promedio de espera fue de 11.1. Pero existe variación,

ya que un cliente esperó menos de un minuto (0.7) y otro fue atendido después de 18.1 minutos de espera. De aquí que una de las tareas clave del control estadístico de un proceso será no

sólo conocer su tendencia central (media), sino también su variabilidad.

Un ejemplo rápido que ilustra la importancia de que los procesos tengan poca variación se

ilustra mediante el siguiente caso. Existen dos empresas que proveen el mismo producto. La

empresa A tarda entre 10 y 22 días en surtir los pedidos; mientras que la empresa B requiere

entre 13 y 19 días. Las dos empresas tardan en promedio lo mismo (16 días), pero si se es

cliente de la empresa B se tendrá menos incertidumbre (menos variabilidad) acerca de cuándo

van a surtir su pedido.

Reducir la variación de los procesos es un objetivo clave del control estadístico y de Seis Sigma. Por lo tanto, es necesario entender las causas de la variación,

6M

y para ello se parte de que en un proceso (industrial o administrativo) interacSon los materiales, mano de obra

(gente), mediciones, medio ambien- túan materiales, máquinas, mano de obra (gente), mediciones, medio ambiente y

métodos. Estos seis elementos (las 6 M) determinan de manera global todo prote, máquinas y métodos que conceso y cada uno aporta algo de la variabilidad y de la calidad de la salida del

forman un proceso.

proceso, como se esquematiza en la figura 1.9. El resultado de todo proceso se

debe a la acción conjunta de las 6 M, por lo que si hay un cambio significativo en el desempeño del proceso, sea accidental u ocasionado, su razón se encuentra en una o más de las 6 M.

En un proceso, cada una de las 6 M tiene y aporta su propia variación; por ejemplo, los

materiales no son idénticos, ni toda la gente tiene las mismas habilidades y entrenamiento. Por

ello, será necesario conocer la variación de cada una de las 6 M y buscar reducirla. Pero además

es necesario monitorear de manera constante los procesos, ya que a través del tiempo ocurren

cambios en las 6 M, como la llegada de un lote de material no adecuado o con características

especiales, descuidos u olvidos de la gente, desajustes y desgaste de máquinas y herramientas,

etc.1 Debido a la posibilidad permanente de que ocurran estos cambios y desajustes, es necesa1

La segunda ley de la termodinámica dice que cualquier sistema tiende a aumentar su entropía, es decir, un

proceso que se deja libre, sin intervenirlo, ajustarlo o mejorarlo, tiende a aumentar su desorden.

11

Ciclo de la calidad (ocho pasos en la solución de un problema)

rio monitorear de manera constante y adecuada diferentes variables, que pueden ir desde características clave de los insumos, las

condiciones de operación de los equipos, hasta las variables de

salida de los diferentes procesos (vea capítulos 7 a 9).

Además, en los esfuerzos permanentes que es necesario realizar para mejorar la calidad y la productividad de un proceso,

como lo contempla la estrategia Seis Sigma, resulta indispensable apoyarse en las técnicas y el pensamiento estadístico, ya que

proporcionan metodologías que facilitan la planeación, el análisis y la toma de decisiones a través de:

Mano de obra

Maquinaria

Materiales

Mediciones

Medio ambiente

Métodos

• Identificar dónde, cómo, cuándo y con qué frecuencia se

presentan los problemas (regularidad estadística).

• Analizar los datos procedentes de las guías clave del negocio,

Variable de salida (característica de calidad)

a fin de identificar las fuentes de variabilidad, analizar su

estabilidad y pronosticar su desempeño.

■ FIGURA 1.9 La variabilidad de un proceso. Cada

• Detectar con rapidez, oportunidad y a bajo costo anormaliM aporta una parte, no necesariamente igual, de la

dades en los procesos y sistemas de medición (monitoreo efivariación total observada.

caz).

• Ser objetivos en la planeación y toma de decisiones, y evitar frases como “yo siento”, “yo

creo”, “mi experiencia” y el abuso de poder en la toma de decisiones.

• Expresar los hechos en forma de datos y evaluar de manera objetiva el impacto de acciones de mejora.

• Enfocarse a los hechos vitales; es decir, a los problemas y causas realmente importantes.

• Analizar de manera lógica, sistemática y ordenada la búsqueda de mejoras.

Pensamiento estadístico

Hasta el momento se han explicado los aspectos fundamentales del pensamiento estadístico, que es una filosofía de aprendizaje y acción basada en tres principios: todo Pensamiento estadístico

el trabajo ocurre en un sistema de procesos interconectados; la variación existe en Filosofía de aprendizaje y acción

todos los procesos, y entender y reducir la variación son claves para el éxito. Pensar que establece la necesidad de un

en forma estadística implica tomar información del proceso para conocerlo (apren- análisis adecuado de los datos de

dizaje), y también es actuar de acuerdo con ese aprendizaje (acción).

un proceso, como una acción indisEn el primer principio del pensamiento estadístico se habla de procesos inter- pensable para mejorar su calidad

conectados para enfatizar que los procesos no operan de manera aislada, más (reducir su variabilidad).

bien, interactúan con el resto del sistema. Por lo tanto, si no se toma en cuenta la

manera en que se relaciona un proceso con el resto del sistema, la optimización

de una de las partes puede tener un efecto desastroso para el resto del sistema.

El segundo principio reconoce que los resultados de todos los procesos son variables, y

esto ya lo hemos justificado antes y quedará en evidencia a lo largo del libro. El tercer principio es una de las razones y objetivos principales de esta obra: reducir la variabilidad hasta lograr el nivel de calidad Seis Sigma (vea el capítulo 15). El gran reto es que una empresa logre

profundizar en la filosofía del pensamiento estadístico, ya que eso le ayudará a conocer la

realidad (con variación), pero también le permitirá dirigir más adecuadamente sus esfuerzos

de mejora. En la figura 1.10 se muestra la forma en que el pensamiento estadístico contribuye

en los diferentes niveles de una organización.

Ciclo de la calidad (ocho pasos

en la solución de un problema)

Para mejorar la calidad y, en general para resolver problemas recurrentes y crónicos,

es imprescindible seguir una metodología bien estructurada, para así llegar a las

causas de fondo de los problemas realmente importantes, y no quedarse en atacar

Ciclo de la calidad (ciclo PHVA)

Proceso de cuatro etapas para

desarrollar proyectos de mejora;

consiste en planear, hacer, verificar

y actuar (PHVA).

12

CAPÍTULO 1 Conceptos básicos de la calidad y la productividad

¿A dónde se dirige

la organización?

Estratégico

Procesos

administrativos para

guiar la organización

Directivo

Ambiente en el que se

desarrolla el trabajo

Operacional

• Crea estrategias y las comunica.

• Emplea datos de varias fuentes para dirigir.

• Desarrolla e implementa sistemas de medición para dirigir el progreso.

• Estimula a los empleados a experimentar nuevas formas de hacer su trabajo.

• Desarrolla proyectos estructurados.

• Fija metas (sabe que hay variación).

• Se enfoca en los procesos y no reclama a los empleados por su variación.

• Conoce la variación.

• Grafica datos de los procesos.

• Identifica medidas clave y oportunidades de mejora.

■ FIGURA 1.10 Pensamiento estadístico en los tres niveles de la organización.

efectos y síntomas. En este sentido la mayoría de metodologías de solución de problemas están

inspiradas en el ciclo de la calidad o ciclo PHVA (planear, hacer, verificar y actuar), en el que se

desarrolla de manera objetiva y profunda un plan (planificar); éste se prueba en pequeña escala o

sobre una base de ensayo tal como ha sido planeado (hacer); se analiza si se obtuvieron los efectos

esperados y la magnitud de los mismos (verificar), y de acuerdo con lo anterior se actúa en consecuencia (actuar), ya sea con la generalización del plan si dio resultado, con medidas preventivas

para que la mejora no sea reversible, o bien, se reestructura el plan si los resultados no fueron satisfactorios, con lo que se vuelve a iniciar el ciclo.

Una forma de llevar a la práctica el ciclo PHVA, es dividir a éste en ocho pasos o actividades

para su solución, como se muestra en la tabla 1.1, que se describen a continuación.

1. Seleccionar y caracterizar el problema. En este primer paso se selecciona un problema

importante, se delimita y se define en términos de su magnitud e importancia. Para establecer la magnitud es necesario recurrir a datos estadísticos para que sea clara la frecuencia en

TABLA 1.1 Ocho pasos en la solución de un problema

Etapa

Planear

Paso

Nombre y breve descripción del paso

1

Seleccionar y caracterizar un problema: elegir un problema realmente importante, delimitarlo y describirlo,

estudiar antecedente e importancia, y cuantificar su magnitud actual.

Buscar todas las posibles causas: lluvia de ideas, diagrama de Ishikawa. Participan los involucrados.

Investigar cuáles de las causas son más importantes: recurrir a datos, análisis y conocimiento del problema.

Elaborar un plan de medidas enfocado a remediar las causas más importantes: para cada acción, detallar en

qué consiste, su objetivo y cómo implementarla; responsables, fechas y costos.

2

3

4

Hacer

5

Ejecutar las medidas remedio: seguir el plan y empezar a pequeña escala.

Verificar

6

Revisar los resultados obtenidos: comparar el problema antes y después.

7

Prevenir la recurrencia: si las acciones dieron resultado, éstas deben generalizarse y estandarizar su aplicación.

Establecer medidas para evitar recurrencia.

Conclusión y evaluación de lo hecho: evaluar todo lo hecho anteriormente y documentarlo.

Actuar

8

Ciclo de la calidad (ocho pasos en la solución de un problema)

2.

3.

4.

5.

6.

7.

8.

la que ocurre el problema. Además, es necesario conocer cómo afecta al cliente (interno o

externo) y el costo anual estimado de dicho problema. Con base en lo anterior se establece

el objetivo del proyecto de mejora y se forma el equipo de personas que abordará dicho

problema.

Buscar todas las posibles causas. En esta etapa se trata de buscar todas las posibles causas

del problema, sin discutirlas. Para ello se recomienda aplicar una sesión de “lluvia de ideas”

(vea el capítulo 6), con especial atención en los hechos generales y no en los particulares

(por ejemplo, si el problema es lotes rechazados por mala calidad, no preguntar por qué se

rechazó un lote en particular; mejor preguntar por qué se rechazan los lotes).

Investigar las causas más importantes. El objetivo de este tercer paso es elegir de la lista de

posibles causas detectadas en el punto anterior, las más importantes. Siempre que sea posible, para esta elección se debe recurrir a análisis estadísticos (análisis de Pareto, estratificación, etc.). De lo contrario la elección de las causas más importantes se puede hacer por

consenso o por votación (vea Lluvia de ideas en el capítulo 6). Al final de esta actividad se

deberán tener las causas sobre las que se actuará para resolver el problema.

Considerar las medidas remedio. En este paso se deciden las medidas remedio para cada

una de las causas sobre las que se ha decidido actuar. Se recomienda buscar que estas medidas lleguen al fondo de la causa, que modifiquen la estructura de la problemática; es decir,

no adoptar medidas superficiales que dejen intactas las causas. Para acordar las soluciones

para cada causa, se parte de los análisis hechos en el paso previo y/o de una sesión de lluvia

de ideas (capítulo 6). Para cada causa se debe completar la siguiente información sobre las

soluciones: objetivo, dónde se aplicará, quién, cómo (plan detallado), cuánto costará, cuándo se implantará, cómo se va a verificar si fue efectiva y efectos secundarios esperados.

Implementar las medidas remedio. En este paso se deben ejecutar las medidas remedio,

acordadas antes, iniciando a pequeña escala sobre una base de ensayo. Además, se recomienda seguir al pie de la letra el plan elaborado en el paso anterior e involucrar a los afectados, explicándoles los objetivos que se persiguen. Si hay necesidad de hacer algún cambio

al plan previsto, esto debe ser acordado por el equipo responsable del proyecto.

Revisar los resultados obtenidos. Aquí, es necesario verificar con datos estadísticos si las

medidas remedio dieron resultado. Una forma práctica es comparar estadísticamente la magnitud del problema antes con su magnitud después de las medidas. En caso de encontrar resultados positivos, éstos deben cuantificarse en términos monetarios (si esto es posible).

Prevenir recurrencia del mismo problema. Si las soluciones no dieron resultado se debe

repasar todo lo hecho, aprender de ello, reflexionar, obtener conclusiones y con base en esto

empezar de nuevo. En cambio, si las soluciones dieron resultado, entonces se debe generalizar y estandarizar la aplicación de las medidas remedio, y acordar acciones para prevenir

la recurrencia del problema. Por ejemplo, estandarizar la nueva forma de operar el proceso,

documentar el procedimiento y establecer el sistema de control o monitoreo del proceso.

Conclusión. En este último paso se revisa y documenta todo lo hecho, cuantificando los logros del proyecto (medibles y no medibles). Además se señalan las causas y/o problemas que

persisten y señalar algunas indicaciones de lo que puede hacerse para resolverlos. Finalmente,

elaborar una lista de los beneficios indirectos e intangibles que se logró con el plan de mejora.

Estos ocho pasos, aplicados a problemas recurrentes o a proyectos de mejora, tal vez en un

principio parezcan un trabajo extra y lleno de rodeos, pero a mediano plazo liberan de muchas