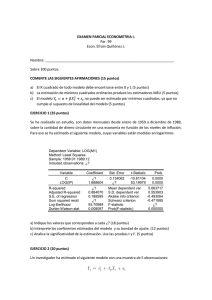

Material de Apoyo para econometría

Anuncio