Probabilidad y Estad´ıstica - Universidad Michoacana de San

Anuncio

Probabilidad y Estadı́stica

por Marı́a Luisa Pérez Seguı́

Introducción

Se presenta aquı́ el material correspondiente a un curso de Probabilidad y Estadı́stica, el

cual se imparte en la Facultad de Ciencias Fı́sico-Matemáticas de la Universidad Michoacana.

Se propone en las notas un curso introductorio a los vastos temas de probabilidad y

estadı́stica. En vista que el curso va dirigido a estudiantes de segundo año de una carrera de

matemáticas, los temas no pueden tratarse de manera muy rı́gida ni abstracta. El enfoque

es mediante numerosos ejemplos para ilustrar los principios del razonamiento teórico en

Probabilidad y las aplicaciones de la Estadı́stica.

Marı́a Luisa Pérez Seguı́

Fac. Cs. Fı́sico-Matemáticas

Universidad Michoacana de San Nicolás de Hidalgo

i

Índice

ii

1.

Qué estudian la Probabilidad y la Estadı́stica

La probabilidad y la estadı́stica estudian el comportamiento de procesos aleatorios. Lo

“aleatorio” de un proceso puede venir de diferentes lados:

Realmente es aleatorio.

Falta de información.

Falta de poder deductivo.

La estadı́stica también, a veces, nos proporciona un resumen de los datos, para que los

podamos entender. Esto, claro, lleva sus problemas también, porque a veces se confunde el

resumen de los datos con los datos. Si sólo tenemos el promedio de las cosas, muchas veces

eso no cuenta “toda la historia”. Incluso el promedio, la media, la media geométrica, la

varianza, el segundo momento, etc, no cuentan toda la historia.

En términos generales

La probabilidad supone que se conoce exactamente cómo funciona determinado proceso

aleatorio y trata de concluir qué se observará.

La estadı́stica comienza de las observaciones y trata de inferir cómo funciona un proceso

aleatorio.

Probabilidad

Va de lo general a lo particular

Perfecta

Independiente

Muy matemática

Estadı́stica

Va de lo particular a lo general

Sujeta a todo tipo de errores, interpretaciones, etc.

Se necesita entender probabilidad primero

Menos matemática

Entender los principios de probabilidad y estadı́stica sirve para tomar decisiones de la

vida cotidiana; para no dejarse engañar por los polı́ticos, las noticias, etc.

La aplicación matemática y técnica de la probabilidad y estadı́stica ha tenido varios

grandes éxitos:

Ciencias Naturales: Fı́sica, Biologı́a, Quı́mica, etc.

Medicina: Revolucionada por la estadı́stica y estudios doblemente a ciegas.

Ciencias Sociales: Polı́tica (elecciones), Psicologı́a, Economı́a, etc.

Finanzas: También ha ocasionado problemas enormes.

Los problemas de mala interpretación de la Estadı́stica son varios. Podemos enunciar

algunos:

1

Confundir causalidad con correlación. Dos cosas están correlacionadas si por lo general

ocurrren juntas; sin embargo no tiene por qué ser cierto que una sea causa de la otra.

Un ejemplo muy burdo de esto serı́a decir que usar zapatos grandes hace que uno

juegue bien basquetbol.

Coincidencia. Los sucesos cotidianos son innumerables. Tratar de explicar uno de ellos

simplemente porque otro ocurrió al mismo tiempo es un error muy común. Ejemplos de esto son las supuestas premoniciones, los milagros curativos, etc. Inclusive,

la cantidad de eventos que pueden analizarse es enorme, ası́ que algunas gráficas se

parecen (es decir, existe corrrelación entre ellas) aunque los eventos son completamente ajenos (ver, por ejemplo, http://www.xatakaciencia.com/psicologia/correlacion-noimplica-causalidad-hay-que-decirlo-mas).

Encuestas sin representatividad. Aquı́ un ejemplo extremo serı́a preguntar en una avenida a los conductores si tienen coche y luego inferir que casi todas las personas tienen

coche.

2

2.

Introducción a la Probabilidad

Empezaremos por dar un “modelo general” de cómo funciona la probabilidad y luego

veremos técnicas para calcularla. Es necesario conocer todas las posibilidades que pudieran

llegar a ocurrir. Esto, en el mundo real, no ocurre siempre, claro.

En determinada situación, al conjunto de todas las posibles situaciones que podrı́an llegar

a ocurrir se le llama espacio muestral. Denotaremos este conjunto por Ω.

2.1 Ejemplo. (a) Si lanzamos una moneda una vez, Ω = {A, S}.

(b) Si lanzamos una moneda dos veces, entonces Ω = {AA, AS, SA, SS}.

El espacio muestral Ω podrı́a ser finito o infinito pero, más importante que eso, Ω podrı́a

ser discreto o continuo.

La probabilidad discreta es cuando no hay noción de “cercanı́a” entre las cosas que pueden

ocurrir (usualmente, cuando es finito), como por ejemplo tiros de monedas, dados, votaciones,

etc. En la probabilidad continua hay toda una gama de posibilidades muy “cercanas” unas

de otras, como temperatura, tiro con arco, etc.

Vamos a empezar a estudiar la probabilidad discreta y luego veremos sus “analogı́as”

con la probabilidad continua. Básicamente, para probabilidad discreta hay que saber contar.

Para probabilidad continua hay que saber cálculo o análidis matemático. Podemos pensar

que la probabilidad continua es el lı́mite de la probabilidad discreta.

En un espacio muestral discreto Ω, cada elemento x ∈ Ω tiene asociada un número entre

0 y 1, que es su probabilidad de ocurrir. Lo denotamos por P (x).

Cualquier subconjunto del espacio muestral se llama suceso o evento.

La suma de todas las probabilidades en un suceso A es la probabilidad del suceso, denotada por P (A).

Si A = Ω se debe tener, por definición, P (Ω) = 1

2.2 Nota. Es importante señalar que el que se puedan sumar las probabilidades individuales de los elementos depende fuertemente del que el espacio sea discreto. Por ejemplo,

si tenemos una región circular del plano, lo natural serı́a que la probabilidad de escoger

un determinado punto en esa región sea 0, pero la suma de 00 s es 0. Para poder estudiar

probabilidad de este tipo se necesita introducir conceptos como de medida. Un estudio ası́

corresponde al Análisis Matemático bastante más complicado que el propósito de este curso.

2.3 Ejemplo. (a) Lanzamos una moneda “justa”. ¿Cuál es el espacio muestral y cuales

son las probabilidades?

Ω = {A, S} y las probabilidades son 1/2 para ambas.

3

(b) Lanzamos una moneda y seguimos lanzándola una y otra vez, hasta que salga águila, y

entonces nos detenemos. El espacio muestral es

Ω = {A, SA, SSA, SSSA, SSSSA, ...}

Las probabilidades son:

1

P (A) = ,

2

1

P (SA) = ,

4

1

P (SSA) = ,

8

...

(c) Supongamos que tiramos dos dados y nos fijamos en su suma. Entonces el espacio muestral

es

Ω = {2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 12}.

Sin embargo, es claro aquı́ que los elementos tienen diferentes probabilidades. ♦

En el ejemplo anterior vimos que en un espacio muestral los elementos pueden tener

diferente probabilidad de ocurrir. Muchas veces conviene modificar el espacio para que todos

los elementos sean equiprobables, es decir, que tengan la misma probabilidad. Esto facilita

el cálculo de probabilidades y la razón es que simplemente se puede tomar la probabilidad

de un suceso A como

P (A) =

# veces que ocurre A

|A|

=

# total de casos

|Ω|

2.4 Ejemplo. Modificar el ejemplo ?? para lograr equiprobabilidad y calcular la probabilidad de que la suma sea 11 y también de que sea 12.

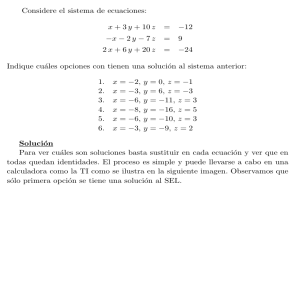

Solución.

Ω = {(1, 1), (1, 2), (1, 3), (2, 1), ...} = {1, 2, . . . , 6}2

Las formas en que se suma 11 son 2: (5, 6) y (6, 5). Sólo hay una forma de lograr 12: (6, 6).

1

2

= 18

y la de

Como el espacio muestral tiene 36 elementos, la probabilidad de lograr 11 es 36

1

lograr 12 es 36 . ♦

Pero entonces se vuelve muy importante poder contar cosas de manera eficiente. Dedicaremos a esto la siguiente sección.

2.5 Ejercicio. Explicar por qué se cuentan por separado las opciones (5, 6) y (6, 5) en

??.

2.1.

Conteo

Esta sección es un repaso de los temas básicos del conteo.

4

2.6 Ejemplo. ¿Cuántos números enteros de tres o menos cifras hay?

Solución. La respuesta a esta pregunta es fácil: Hay 1000 pues son todos los números

enteros del 0 al 999. Esta solución no nos enseña gran cosa. Retomemos ahora el problema

buscando una solución constructiva; esto es, para cualquier n = 1, 2, 3, . . ., la cantidad de

números de hasta n + 1 cifras se puede obtener de la cantidad de números de hasta n cifras:

simplemente se multiplica por 10. Vamos a describir con detalle este procedimiento:

Números de a lo más una cifra hay 10, a saber, 0, 1, 2, 3, 4, 5, 6, 7, 8 y 9. Para contar los

de hasta dos cifras (del 0 al 99) no necesitamos escribirlos todos; basta con observar que la

primera cifra puede ser cualquiera de los 10 dı́gitos 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, y por cada uno de

éstos hay 10 terminaciones distintas; por ejemplo, los números de dos cifras que empiezan con

4 son: 40, 41, 42, 43, 44, 45, 46, 47, 48 y 49, diez en total; lo mismo para cada una de las otras

decenas. Ası́ la cantidad de enteros entre 0 y 99 es 10×10 = 100. El siguiente paso es análogo:

Para contar los números de hasta tres cifras hay que agregar un dı́gito (posiblemente 0) a

cada uno de los 100 números de 2 o menos cifras; como hay diez posibilidades la respuesta

será 10 × 100 = 1000. ♦

Este procedimiento de “construir sobre lo ya construido” que hemos utilizado se llama

procedimiento inductivo . Muchas demostraciones de propiedades y fórmulas de números

naturales se basan en él. Más adelante se estudiará esto con detalle. El principio combinatorio

que manejamos en el ejemplo anterior (y que manejaremos en los siguientes) es:

2.7. Principio Fundamental de Conteo. Si una cierta tarea puede realizarse de m

maneras diferentes y, para cada una de esas formas, una segunda tarea puede realizarse de

n maneras distintas, entonces las dos tareas juntas pueden realizarse (en ese orden) de mn

formas diferentes.

2.8 Ejemplo. ¿Cuántas palabras de tres letras se pueden formar si se dispone de un

alfabeto con dos letras: a y b. (Nota: Son permisibles palabras como bba.)

Solución. Procederemos como en el ejemplo anterior. En este caso conviene ilustrarlo

haciendo un “diagrama árbol”:

5

Resolvamos ahora el ejemplo utilizando nuestro Principio Fundamental de Conteo. Con, la primera para la letra inicial, la segunda para la letra central

sideremos tres casillas:

y la tercera para la letra final. En cada casilla hay dos elecciones posibles: la letra a o la

letra b. La respuesta es entonces 2 × 2 × 2 = 8. El procedimiento inductivo es como sigue:

En la primera casilla hay 2 posibilidades para elegir la letra. Una vez formada una palabra

de una letra: a o b, para agrandarla a una palabra de dos letras hay dos posibilidades, ası́

que palabras de dos letras hay 2 × 2 = 4. Para completar cada una de éstas a una palabra

de tres letras hay dos posibilidades; entonces hay 4 × 2 = 8 palabras de tres letras. ♦

2.9 Ejemplo. ¿Cuántas placas distintas hay con dos letras a la izquierda y tres números

a la derecha? (Nota: Consideraremos el alfabeto de 27 letras castellanas.

Solución. Seguimos el procedimiento de las casillas del ejemplo anterior:

27 × 27 × 10 × 10 × 10 = 729 000. ♦

| {z } |

{z

}

lugares

para letras

lugares

para números

2.10 Ejemplo. ¿Cuántas banderas bicolores se pueden formar si se dispone de 4 lienzos

de tela de colores distintos y un asta? (Nota: Banderas como rojo-rojo no son permisibles;

por otro lado, es importante el color que queda junto al asta, de esta manera banderas como

rojo-azul y azul-rojo se consideran distintas.)

Solución. En este caso consideramos dos casillas. La de la izquierda, digamos, representa

el lienzo junto al asta, el cual tiene 4 elecciones posibles. Una vez elegido éste, el color para

la derecha se puede escoger de 3 formas (pues no se permite la repetición de colores). Ası́

hay 4 × 3 = 12 formas distintas de formar las banderas. ♦

2.11 Ejercicio. Escribir todas las banderas que pueden formarse según el ejemplo anterior si los colores son rojo (R), azul (A), verde (V ) y blanco (B).

6

2.12 Ejemplo. Misma pregunta que en el ejemplo anterior pero ahora suponiendo que

no hay asta. (En este caso no habrá distinción entre las banderas rojo-azul y azul-rojo.)

Solución. Para resolver este ejemplo analicemos la respuesta del ejemplo anterior. En

aquél, en la colección total de las 12 banderas posibles podemos aparear cada bandera con

su opuesta; por ejemplo la bandera azul-verde la apareamos con la bandera verde-azul. Cada

una de las del ejemplo anterior se esta contando dos veces y, por tanto, la respuesta es

12

= 6. ♦

2

2.13 Ejercicio. En el resultado del ejercicio ?? aparear cada una de las banderas con

su opuesta. Dar una lista de 6 banderas que ilustre la respuesta del ejemplo ??.

2.14 Ejemplo. ¿De cuántas formas se pueden sentar 5 personas en 5 sillas numeradas

del 1 al 5?

Solución. En el asiento #1 se puede sentar cualquiera de las 5 personas; para cada elección

de la primera persona, la segunda puede ser cualquiera de las 4 restantes; ası́ en las dos

primeras sillas el número de elecciones posibles es 5 × 4 = 20. Continuamos de manera

análoga. Para simplificar dibujemos 5 casillas simbolizando los 5 asientos. Sobre cada casilla

escribamos el número respectivo de posibilidades y multipliquemos:

5 × 4 × 3 × 2 × 1 = 120. ♦

Si n es un número natural, el producto de todos los números naturales del 1 al n aparece

muy frecuentemente en problemas de combinatoria; se llama n factorial o factorial de n

y se denota por n!. (Ası́ la respuesta del ejemplo ?? es 5! = 120.)

Alejándose de la interpretación de n! como el producto de los naturales de 1 a n, se define

0! = 1;

esto permite incluir el caso n = 0 en algunas fórmulas en las que interviene n!. Entonces

0!

1!

2!

3!

4!

=

=

=

=

=

1

1

1×2=2

1×2×3=6

1 × 2 × 3 × 4 = 24.

Es fácil darse cuenta que el número 5 del ejemplo ?? y el que sean personas y asientos

en lugar de cualquier otra cosa no es relevante; podemos generalizarlo como sigue:

7

El número Pn de distintas formas en que se pueden ordenar n objetos es n!. Cada una de

las listas ordenadas que se forman con los n objetos se llama permutación (de los objetos).

Tenemos entonces que el número de permutaciones de n objetos es Pn = n!.

2.15 Ejemplo. De un grupo de 5 estudiantes quiere elegirse una comisión de 3 para que

cada uno visite un museo de una lista de 3 museos. ¿Cuántas comisiones distintas se pueden

formar?

Solución. Utilizando el esquema de casillas (cada una representando un museo) como

arriba, tenemos que el resultado es

5 × 4 × 3 = 60. ♦

2.16 Ejemplo. De un grupo de 5 estudiantes quiere elegirse una comisión de 3 para que

juntos visiten un museo (el mismo todos). ¿Cuántas comisiones diferentes se pueden formar?

Solución. Hay que observar que la diferencia entre este ejemplo y el anterior es que no

importa el orden en la elección. En el ejemplo anterior habı́a distición entre las casillas pues

cada una representaba un museo en particular distinto a los otros; en éste no hay distinción

entre las casillas pues, por ejemplo, una comisión en que se haya elegido la sucesión de

alumnos Ana-Beto-Carlos se considerará igual a la sucesión Beto-Carlos-Ana y también

igual a la sucesión Ana-Carlos-Beto. Nuestro interés es entonces determinar en la cantidad

5 × 4 × 3, en cuántas sucesiones aparece el mismo conjunto de alumnos. Para responder

esto conviene plantear esta parte del ejemplo al revés: Consideremos un conjunto fijo de 3

personas, por ejemplo el formado por Ana (A), Beto (B) y Carlos (C) y contemos de cuántas

formas se pueden ordenar estos 3. Observemos que el número de formas es precisamente el

número de permutaciones de las 3 personas, o sea, P3 = 3! = 6. Entonces cada grupo de 3

personas se está contando 6 veces en el producto 5 × 4 × 3, ası́ que la respuesta al ejemplo

será

5×4×3

= 10. ♦

3!

2.17 Ejercicio. En los ejemplos ?? y ?? supongamos que el grupo de los 5 alumnos está

formado por Ana (A), Beto (B), Carlos (C), Daniel (D) y Elena (E). Hacer la lista de los

60 arreglos de estos alumnos en los que se elige 3 para visitar museos distintos, agrupando

en esa lista las colecciones que resultan iguales si todos van a un mismo museo.

En el ejemplo anterior aprendimos el siguiente principio:

2.18. El número de colecciones (en las que el orden no importa) con r elementos que se

pueden seleccionar dentro de un conjunto de n elementos (n ≥ r ≥ 1) es

n × (n − 1) × · · · × (n − (r − 1))

.

r!

8

Este número recibe el nombre de combinaciones de n en r y se denota por nr . Dicho

de otra manera, el número de subconjuntos de r elementos que tiene un conjunto con n

elementos es nr . (En el ejemplo ??, n = 5 y r = 3 y la respuesta es 53 .) Nótese que la

fórmula ?? no tiene sentido para n = 0; sin embargo sı́ tiene sentido hablar del número

de subconjuntos con 0 elementos dentro de un conjunto con n elementos; sabemos que este

número es 1 pues sólo hay un conjunto sin elementos que es el llamado conjunto vacı́o.

Definimos entonces

n

= 1.

0

2.19 Ejercicio. Sea X = {a, b, c, d, e}. Escribir todos los subconjuntos de X con

(a) 0 elementos,

(b) 1 elemento,

(c) 2 elementos,

(d) 3 elementos,

(e) 4 elementos y

(f) 5 elementos.

Verificar que en cada caso el número de subconjuntos obtenido sea 5r y que el número

total de subconjuntos sea 25 = 32.

2.20 Ejercicio. Basándose en la interpretación de nr como el número de subconjuntos

de r elementos dentro de un conjunto con n elementos, explicar por qué

n

n

=

.

r

n−r

2.21 Ejercicio. Calcular

7

2

,

7

5

,

5

5

y

9

4

.

Con la intención de simplificar la fórmula ?? sobre las combinaciones de n en r, observemos que, para 1 ≤ r ≤ n − 1, el numerador se puede “completar” a n! multiplicando

por (n − r)!; si lo “completamos” deberemos compensar dividiendo también por (n − r)!.

Tendremos entonces que para r = 1, 2, . . . , n − 1,

2.22.

n

n!

.

=

r!(n − r)!

r

Recordemos que se ha definido 0! = 1 y n0 = 1; notemos entonces que si sustituimos

r = 0 (y, posiblemente también n = 0) en el lado derecho de la fórmula ?? obtendremos

n!

n!

= 1. De la misma manera, al sustituir r = n obtendremos n!0!

= 1. Ası́, también en estos

0!n!

casos extremos vale la fórmula ??.

2.23 Ejercicio. Volver a hacer los ejercicios ?? y ?? utilizando la fórmula ??.

9

2.24 Ejemplo. De un grupo de 10 niños y 15 niñas se quiere formar una colección de 5

jóvenes que tenga exactamente 2 niñas. ¿Cuántas colecciones distintas se pueden formar?

15×14

Solución. La elección de las 2 niñas se puede hacer de 15

= 2! = 105 formas. Como

2

deben ser 5 en total y debe haber 2 niñas exactamente, entonces los niños serán 3; éstos se

= 120 formas. Por tanto el resultado es 105×120 = 12 600. ♦

pueden escoger de 10

= 10×9×8

3!

3

Como hemos visto, al determinar cantidades buscamos simplificar nuestras cuentas utilizando “homogeneidades” en el problema. Con este propósito, en algunas ocasiones es conveniente dividir en casos de manera que en cada uno de ellos haya homogeneidad, y después

sumar las respuestas. Un ejemplo muy simple de esto serı́a el siguiente: Si tenemos 4 paquetes

de 100 hojas de papel y otros 3 paquetes de 200 hojas cada uno, entonces el número total

de hojas que tenemos es

4 × 100 + 3 × 200 = 1000.

Comparemos el siguiente ejemplo con el anterior, tomando en cuenta la búsqueda de

homogeneidades, como acabamos de decir.

2.25 Ejemplo. De un grupo de 10 niños y 15 niñas se quiere formar una colección de 5

jóvenes que tenga a lo más 2 niñas. ¿Cuántas colecciones distintas se pueden formar?

Solución. Vamos a resolver este ejemplo como el anterior pero separando por casos y

después sumando las respuestas de cada uno de los casos.

10

Caso 1: Que la colección tenga 2 niñas exactamente: 15

= 12 600.

2

3

10

Caso 2: Que la colección tenga exactamente 1 niña: 15

= 3 150.

1

4

10

Caso 3: Que la colección no tenga niñas: 15

= 252.

0

5

La respuesta al ejemplo es 12 600 + 3 150 + 252 = 16 002. ♦

2.26 Ejemplo. Un grupo de 15 personas quiere dividirse en 3 equipos de 5 personas

cada uno. Cada uno tendrá una labor especı́fica distinta a las demás. ¿De cuántas formas

distintas es posible hacer la distribución?

Solución.

Escojamos uno por uno los equipos. La elección del primer equipo puede hacerse

15

equipo ya sólo habrá 10 personas de dónde

de 5 = 3 003 formas; para elegir el segundo

10

escoger, por tanto éste se podrá elegir de 5 = 252 formas. El tercer equipo quedará formado

automáticamente con la elección de los otros dos. Entonces el número de formas de hacer la

elección sucesiva es 3 003 × 252 × 1 = 756 756. ♦

2.27 Ejemplo. Un grupo de 15 personas quiere dividirse en 3 equipos de 5 personas

cada uno. Todos los equipos tendrán la misma labor. ¿De cuántas formas es posible hacer la

10

distribución?

Solución. En este caso no hay distinción entre los equipos ası́ que hay que dividir el

resultado del ejemplo anterior entre 3!, que es el número de permutaciones de los equipos.

La respuesta es entonces 126 126. ♦

2.28 Ejemplo. En una bolsa hay 3 pelotas rojas y 2 azules. Se quiere formar una fila

con todas ellas. ¿De cuántas maneras distintas puede quedar la fila?

Solución. Primera forma. Consideremos todas las permutaciones de las 5 pelotas y contemos cuántas de esas permutaciones son indistinguibles entre sı́. Las permutaciones de las

5 pelotas sabemos que son 5! = 120. En cualquiera de las permutaciones fijémonos en la

ubicación de las pelotas rojas; por ejemplo − roja − roja roja. éstas pueden revolverse

entre sı́ (3! veces) formando colecciones indistinguibles, y lo mismo ocurre con las del otro

color. Vamos a explicar lo anterior con más detalle: Denotemos las pelotas rojas por R1 , R2

y R3 , y las azules por A1 y A2 . Entonces las siguientes listas (en las que se han permutado

las rojas pero se han dejado fijas las azules) representan la misma colección:

A1 R1 A2 R2 R3

A1 R1 A2 R3 R2

A1 R2 A2 R1 R3

A1 R2 A2 R3 R1 .

A1 R3 A2 R1 R2

A1 R3 A2 R2 R1

Estas 3! listas deben considerarse como una sola. Además, en cada una de ellas también se

pueden revolver las azules entre sı́ (2! permutaciones). Entonces al considerar las permutaciones de las 5 pelotas, cada arreglo se está contando 3! × 2! = 12 veces en lugar de 1. La

5!

= 10.

respuesta al ejemplo es pues 3!2!

Segunda forma. Primero podemos contar las posibilidades para colocar las pelotas rojas

en los 5 lugares disponibles; esto nos dará la elección de 3 lugares, que puede hacerse de

5

= 10 maneras.

Para colocar las 2 azules ya sólo sobran 2 lugares ası́ que esto se puede

3

2

hacer de 2 = 1 forma. El resultado es 10 × 1 = 10. ♦

2.29 Ejercicio. Escrı́banse las 10 filas distintas que se pueden formar con las pelotas en

el ejemplo ??.

2.30 Ejemplo. En una bolsa hay 3 pelotas rojas y 2 azules. ¿Cuántas filas distintas de

3 pelotas se pueden formar?

Solución. Como son 5 pelotas en total pero sólo se van a considerar filas de 3, hay que dejar

dos pelotas sin colocar. Consideraremos los distintos casos por separado y después sumaremos

3!

= 3 arreglos

las respuestas parciales. Si las dos pelotas que quedan fuera son rojas, hay 1!2!

3!

3!

con las restantes. Análogamente hay 3! = 1 fila que deja las 2 pelotas azules fuera, y 2!1!

=3

11

filas que dejan una azul y una roja fuera. La respuesta al ejemplo es 3 + 1 + 3 = 7. ♦

2.31 Ejercicio. Escribir los 7 arreglos de pelotas del ejemplo ?? .

En algunas ocasiones, para poder hacer bien las cuentas, nuestra búsqueda de homogeneidad nos lleva a que es más fácil contar lo opuesto de lo que queremos y después restar de

un total. Ilustramos esto con el siguiente ejemplo.

2.32 Ejemplo. ¿De cuántas maneras pueden ordenarse en un estante 3 cuadernos rojos,

4 azules y 2 verdes, si los verdes no deben quedar juntos?

Solución. Conviene contar primero todas las ordenaciones posibles y después restar aquéllas

en las que los verdes quedan juntos. El número total de filas (incluyendo aquéllas en que los

9!

= 1260. Para contar las que tienen juntos los cuadernos verdes

verdes quedan juntos es 3!4!2!

pensemos éstos como pegados formando un solo cuaderno; ahora determinemos el número de

8!

= 280. La respuesta al ejemplo

arreglos con 3 cuadernos rojos, 4 azules y 1 verde; éste es 3!4!

es 1260 − 280 = 980. ♦

2.33. Los ejemplos siguientes se refieren a la baraja usual de pókar: Cada carta tiene

un sı́mbolo llamado número que puede ser cualquiera de los 13 sı́mbolos siguientes: A, 2,

3, 4, 5, 6, 7, 8, 9, 10, J, Q o K, y otro sı́mbolo llamado palo que puede ser cualquiera de

los 4 siguientes: ♠ (espada), ♥ (corazón), ♦ (diamante) o ♣ (trébol). Todos los palos

se combinan con todos los números para formar la baraja completa con 13 × 4 = 52 cartas

como se ilustra a continuación:

A♥

2♥

3♥

4♥

5♥

6♥

7♥

8♥

9♥

10♥

J♥

Q♥

K♥

A♦

2♦

3♦

4♦

5♦

6♦

7♦

8♦

9♦

10♦

J♦

Q♦

K♦

A♠

2♠

3♠

4♠

5♠

6♠

7♠

8♠

9♠

10♠

J♠

Q♠

K♠

A♣

2♣

3♣

4♣

5♣

6♣

7♣

8♣

9♣

10♣

J♣

Q♣

K♣

Se llama mano de pókar cualquier colección de 5 cartas de la baraja. La siguiente

nomenclatura es usual:

par: dos cartas del mismo número.

tercia: tres cartas del mismo número.

pókar: cuatro cartas del mismo número.

full: una tercia y un par.

flor: cinco cartas del mismo palo.

corrida: cinco cartas con numeración consecutiva (según el orden en que se escribieron

arriba, pero permitiendo A también como número final, en seguida de K).

Observemos que el número total de manos de pókar es 52

= 2 598 960.

5

12

2.34 Ejemplo. ¿Cuántas manos de pókar tienen tercia exactamente (es decir, que no

sea full ni pókar).

Solución. Primera forma. Ponemos 5 casillas: las tres primeras para la tercia y las otras

dos para las otras cartas. La primera carta se puede escoger arbitrariamente; la segunda sólo

tiene 3 posibilidades pues debe tener el mismo número que la primera; la tercera ya sólo

puede ser elegida de 2 maneras distintas; como no importa el orden de estas 3 cartas, este

número deberá dividirse entre 3!. La cuarta carta se debe escoger dentro de las 48 que son de

número distinto al de la tercia. Para la quinta carta ya sólo sobran 44 cartas pues el número

debe ser también distinto. La cuarta y quinta pueden haberse escogido en cualquier orden

por lo que se deberá dividir entre 2!.

48 × 44

52 × 3 × 2

×

= 54 912.

3! }

2! }

| {z

| {z

tercia

cartas distintas

Segunda forma. También formamos primero la tercia pero eligiendo antes el número que le

corresponderá: Tenemos 13 números para escoger y, una vez escogido el número, las 3 cartas

que forman

la tercia deben escogerse dentro de 4 posibles; entonces el número de tercias

4

es 13 3 . Para escoger las otras dos cartas utilizando este mismo método razonamos como

sigue: Hay que escoger 2 números (pues queremos que las otras 2 cartas sean de números

distintos) dentro de los 12 que sobran; esta elección se puede hacer entonces de 12

formas.

2

En cada uno de estos números que se hayan elegido hay que escoger 1 carta, cosa que puede

hacerse de 41 formas. El resultado escrito en esta forma es

2

4

12 4

,

13

×

3

2

1

que, desde luego, también es igual a 54 912. ♦

2.35 Ejemplo. ¿Cuántas manos de pókar tienen dos pares (distintos) exactamente?

Solución. Procedemos como en el ejemplo ??.

Primera forma.

1er par

2o par

z }| { z }| {

52 × 3 48 × 3

2!

2! × 44 = 123 552.

2!

(Nota: Hay que dividir entre 2! porque no importa el orden entre los dos pares.)

Segunda forma.

2

13 4

× 44 = 123 552. ♦

2

2

13

2.36 Ejemplo. ¿Cuántas manos de pókar tienen corrida?

Solución. El número más bajo de la corrida puede ser cualquiera de los siguientes: A,

2, 3, 4, 5, 6, 7, 8, 9 o 10, que son 10 posibilidades. Pongamos 5 casillas; la primera casilla

será para la carta de número menor, la siguiente casilla será para el siguiente número, y ası́

sucesivamente hasta la quinta casilla que será para la carta con el número mayor. Una vez

escogido el número menor para la corrida, todos los demás números quedan determinados y

lo único que falta escoger es el palo. Entonces la cantidad de corridas es 10×4×4×4×4×4 =

10 240. ♦

Los métodos de conteo nos permiten a veces probar ciertas fórmulas. Un ejemplo muy

sencillo de esto es la prueba de la conmutatividad del producto de naturales, la cual estamos

acostumbrados a tomarla como verdadera; sin embargo, si lo pensamos con cuidado, para

m, n ∈ N, la expresión m × n significa, por definición, la suma de n consigo mismo m veces,

mientras que n × m representa la suma de m consigo mismo n veces. Ası́ expresados no

es claro por qué es válida la igualdad m × n = n × m. Sin embargo es claro que ambas

expresiones cuentan cuántos puntos hay en una configuración rectangular de puntos con

m renglones y n columnas y, como cuentan lo mismo, entonces son iguales. Veremos otros

ejemplos más complicados en los que se prueban fórmulas combinatorias.

2.37 Ejemplo. Probar la fórmula de Gauss

1 + 2 + 3 + ··· + n =

n(n + 1)

.

2

Solución. Contaremos las colecciones de 2 elementos que pueden escogerse dentro de

un conjunto de n + 1 elementos de dos maneras diferentes. La comparación de los dos resultados nos demostrará la veracidad de la fórmula. Consideremos ası́ el conjunto X =

{x1 , x2 , . . . , xn+1 }. Pongamos los subconjuntos de X que tienen dos elementos en una lista,

como sigue:

{x1 , x2 }, {x1 , x3 }, {x1 , x4 }, · · ·

{x2 , x3 }, {x2 , x4 }, · · ·

{x3 , x4 }, · · ·

{x1 , xn+1 },

{x2 , xn+1 },

{x3 , xn+1 },

..

.

{xn−1 , xn+1 }.

De esta lista es fácil observar que el número de subconjuntos de X con 2 elementos es

precisamente lo que aparece del lado izquierdo en la igualdad que queremos probar. Por otro

lado, sabemos que el número de subconjuntos de 2 elementos que tiene un conjunto con n + 1

elementos es n+1

, que es precisamente lo que aparece en el miembro derecho de la igualdad,

2

y ası́ queda completa la demostración. ♦

14

2.38 Ejemplo. Probar que si m, n y r son naturales con 0 ≤ r ≤ m, n, entonces

m n

m+n

m n

m

n

m

n

=

+

+

+ ··· +

.

r

0

r

1

r−1

2

r−2

r

0

Solución. Ambas expresiones cuentan la cantidad de subconjuntos de r elementos dentro

de de un conjunto de m + n elementos: La de la izquierda lo hace directamente; en la de

la derecha se piensa al conjunto de m + n elementos partido en dos conjuntos, uno de m

elementos y otro de n elementos; para tomar un subconjunto de r elementos se consideran

las distintas posibilidades de cuántos elementos se escogen dentro del primer conjunt (y el

resto dentro del otro). ♦

2.39 Teorema. Teorema del Binomio de Newton. Sean a y b números arbitrarios

y sea n un número natural. Entonces

n n

n n−1

n n−r r

n n

n

(a + b) =

a +

a b + ··· +

a b + ··· +

b .

0

1

r

n

Demostración. La expresión (a + b)n significa que tenemos que multiplicar a + b consigo

mismo n veces. Entonces, al desarrollar todo el producto, los términos que obtenemos están

dados por todas las posibles elecciones de los números a o b en cada uno de los n factores

(por ejemplo, (a + b)3 = (a + b)(a + b)(a + b) = aaa + aab + aba + abb + baa + bab + bba + bbb =

a3 + 3a2 b + 3ab2 + b3 ). Observemos entonces que los términos obtenidos son de la forma as br ,

con 0 ≤ s, r ≤ n y s + r = n, es decir, s = n − r. Ahora notemos que an−r br aparece cada

vez que se eligió b en r de los factores y a en el resto, ası́ que el número de veces que aparece

este término es nr . Al agrupar términos semejantes tenemos la fórmula deseada. ♦

2.40 Ejercicio. Utilizar el Teorema del Binomio para probar la fórmula

n

n

n

n

n

n

+

+

+ ··· =

+

+

··· .

0

2

4

1

3

5

¿Qué interpretación se puede dar a esta fórmula en términos de subconjuntos de un conjunto?

2.41 Ejemplo. ¿Cuántos números menores que 10 000 no son divisibles ni por 2, ni por

3, ni por 5?

Solución. A 10 000 habrá que restarle la cantidad de números divisibles por alguno de 2,

3 o 5. Sin embargo esto hay que hacerlo con cuidado para evitar repeticiones; por ejemplo,

los números que son divisibles tanto por 2 como por 3 se consideran dos veces: al contar los

divisibles por 2 y al contar los divisibles por 3. Vamos a determinar primero, por separado,

cuántos múltiplos hay de cada una de las distintas combinaciones entre 2, 3 y 5.

15

Hay 5 000 números divisibles por 2,

3 333 divisibles por 3,

2 000 divisibles por 5,

1 666 divisibles por 6,

1 000 divisibles por 10,

666 divisibles por 15 y

333 divisibles por 30.

Al restarle a 10 000 la cantidad de números divisibles por 2 y luego los divisibles por 3 y

a continuación los divisibles por 5:

10 000 − (5 000 + 3 333 + 2 000),

los que son divisibles por 6, por 10 o por 15 pero no por 30 se habrán quitado dos veces

cada uno, y los que son múltiplos de 30 se habrán quitado tres veces. Entonces al agregar a

la cuenta los que son múltiplos de 6, de 10 o de 15, los que son divisibles por 30 se habrán

quitado primero tres veces al restar los múltiplos de 2, de 3, y de 5, y después se habrán

vuelto a sumar tres veces al sumar los múltiplos de 6 y los de 10 y los de 15, ası́ que tendremos

que restarlos. La respuesta al ejemplo es pues:

10 000 − (5 000 + 3 333 + 2 000) + (1 666 + 1 000 + 666) − 333 = 2 666. ♦

El método que se utilizó en ejemplo anterior se llama método de inclusión y exclusión y

en general es como sigue:

2.42 Proposición. Principio de Inclusión y Exclusión. Supongamos que tenemos n

conjuntos A1 , A2 , . . . , An (posiblemente con elementos en común). Entonces el número total

k de elementos que tienen entre todos es igual a k1 − k2 + k3 − k4 + − · · · kn , donde k1 es la

suma de los elementos que pertenecen a (por lo menos) uno de los conjuntos, k2 es la suma

de los elementos que pertenecen a (por lo menos) dos de los conjuntos, y ası́ sucesivamente

hasta kn , que es el número de elementos en común a todos los conjuntos. (Utilizando el

lenguaje usual de teorı́a de conjuntos donde |X| denota el número de elementos de un

conjunto X, ∪ es el sı́mbolo usual de unión y ∩ es el sı́mbolo usual de intersección, tenemos:

k = |A1 ∪ A2 ∪ · · · ∪ An |, k1 = |A1 | + |A2 | + · · · + |An |, k2 = |A1 ∩ A2 | + |A1 ∩ A3 | + · · · + |A1 ∩

An | + |A2 ∩ A3 | + · · · + |An−1 ∩ An |, y ası́ sucesivamente hasta kn = |A1 ∩ A2 ∩ · · · ∩ An |.)

Demostración. Tomemos un elemento cualquiera y supongamos, por ejemplo, que el elemento pertenece a los conjuntos Ai1 , Ai2 , . . . , Air para cierta r, y sólo a éstos. Entonces el

número de veces que dicho elemento se considera en la suma k1 − k2 + k3 − k4 + − · · · kn es

r

r

r

r

r

−

+

−

+ −···

,

1

2

3

4

r

16

que, por el ejercicio ??, es igual a 0r = 1. Entonces la suma k1 − k2 + k3 − k4 + − · · · kn

cuenta cada elemento exactamente una vez, que es lo que querı́amos demostrar. ♦

2.43 Ejercicio. En cierta escuela hay 100 alumnos. De ellos 50 saben inglés, 30 saben

alemán y 30 saben francés. Además 10 saben inglés y francés, 14 saben francés y alemán,

11 saben inglés y alemán, y 6 saben los tres idiomas. Determinar cuántos alumnos no saben

ninguno de los tres idiomas.

2.44 Ejercicio. ¿De cuántas maneras diferentes se pueden ordenar 8 personas alrededor

de una mesa redonda? (Nota: Dos distribuciones se considerarán iguales si una se puede

obtener de la otra mediante un giro.)

2.45 Ejercicio. ¿De cuántas maneras distintas se pueden sentar 5 personas en una fila

de 8 asientos numerados del 1 al 8?

2.46 Ejercicio. ¿Cuántas diagonales tiene un polı́gono regular de n lados?

2.47 Ejercicio. Probar la Fórmula de Pascal:

n+1

n

n

=

+

,

r+1

r

r+1

para r y n números enteros con 0 ≤ r < n.

2.48 Ejercicio. El Triángulo de Pascal está definido como el triángulo de números

en el que el renglón número n aparecen los n + 1 números

n

n

n

n

n

,

,

,··· ,

,

.

0

1

2

n−1

n

Se muestran a continuación los primeros 4 renglones del Triángulo de Pascal. Utilizar la

fórmula del ejercicio anterior para construir los 10 primeros renglones.

1

1

1

1

1

2

3

4

1

3

6

1

4

1

2.49 Ejercicio. Probar de dos maneras distintas (una, viendo que ambos lados de la

igualdad cuentan lo mismo, y la otra, usando el teorema del binomio) la siguiente fórmula

para n ∈ N:

n

n

n

n

+

+

+ ··· +

= 2n .

0

1

2

n

17

2.50 Ejercicio. De un grupo de 24 personas se quiere elegir 5 representantes de la

siguiente forma: Pedro y Luis deben estar en el grupo elegido. Hay 8 mujeres en total pero a

lo más deben figurar 2 en el grupo. ¿De cuántas maneras distintas puede hacerse la elección?

2.51 Ejercicio. De un grupo de 30 socios de un club se quiere elegir una mesa directiva con un presidente, un secretario y 3 equipos de 2 personas cada uno. ¿Cuántas mesas

directivas distintas se pueden formar?

2.52 Ejercicio. De un conjunto de 10 botes de distintos colores se quiere escoger 5 de

tal manera que 3 sean para dulces y 2 sean para chocolates. ¿De cuántas formas distintas es

posible hacer la elección?

2.53 Ejercicio. Se dispone de una colección de 30 pelotas divididas en 5 tamaños distintos y 6 colores diferentes de tal manera que en cada tamaño hay los 6 colores. ¿Cuántas

colecciones de 4 pelotas tienen exactamente 2 pares de pelotas del mismo tamaño (que no

sean las 4 del mismo tamaño)?

18

3.

Probabilidad Combinatoria

Intuitivamente, la probabilidad calcula la proporción de casos en los que cierto experimento ocurre en relación con el total de resultados posibles.

El conjunto de todos los resultados posibles de un experimento se llama espacio muestral.

A los subconjuntos del espacio muestral a los que les calculamos la probabilidad se les llama

sucesos o eventos.

3.1.

Probabilidad Combinatoria

Analicemos algunos ejemplos en los que el espacio muestral Ω es finito y, en ese caso,

definamos la probabilidad de que ocurra un suceso A, en sı́mbolos P (A), como

P (A) =

|A|

.

|Ω|

Aquı́ se está suponiendo que todos los resultados del experimento tienen la misma probabilidad de ocurrir; más adelante se verán ejemplos de distinta ı́ndole.

Se piensa entonces que la probabilidad es una función que va del conjunto de sucesos al

conjunto de los números racionales. El valor de un suceso es 0 cuando no puede ocurrir y es

1 cuando es seguro que ocurre.

En muchos de nuestros problemas aparece el conunto de los números naturales del 1 al

n. Para simplificar, denotaremos a este conjunto por [n], es decir,

[n] = {1, 2, . . . , n}.

3.1 Ejemplo. El experimento consiste en lanzar un dado y observar el número que

queda arriba. Calcular la probabilidad de que el número que quede arriba sea el 1 y también

calcular la probabilidad de que el número que quede arriba sea par.

Solución. Aquı́ Ω = [6]. En el primer caso el suceso es A = {1} y P (A) = 61 . En el segundo

caso el suceso es B = {2, 4, 6} y P (B) = 63 = 12 . ♦

3.2 Ejemplo. El experimento es lanzar una moneda 2 veces y observar la sucesión de

águilas a y soles s que se obtiene. Determinar la probabilidad de que se observen dos águilas.

Solución. El espacio muestral puede ser

Ω = {aa, as, sa, ss}

19

y entonces el suceso es A = {aa} y P (A) = 41 . ♦

3.3 Ejemplo. Calcular la probabilidad de que al lanzar una moneda 3 veces se muestren

al menos dos águilas.

Solución. Aquı́ podemos definir

Ω = {aaa, aas, asa, saa, ass, sas, ssa, sss}.

El suceso es A = {aas, asa, saa, aaa} y entonces la probabilidad buscada es P (A) =

4

8

= 12 . ♦

3.4 Ejemplo. Determinar la probabilidad de que al lanzar dos dados lo que sumen las

caras que se ven arriba sea 6.

Solución. Conviene definir Ω = [6] × [6] y entonces

A = {(1, 5), (2, 4), (3, 3), (4, 2), (5, 1)},

de donde la probabilidad es

5

36

∼ 0.14. ♦

Veamos algunas propiedades que ya hemos podido observar en los ejemplos y hagamos

algunos comentarios sobre ellas.

De aquı́ en adelante Ω denota al espacio muestral en cuestión.

3.5. Propiedad (1). La probabilidad de que algo ocurra es un número entre 0 y 1. (Esto

es obvio pues, como el suceso A es subconjunto del espacio muestral Ω, entonces |A| ≤ |Ω|.)

Es 0 cuando es imposible que ocurra (es decir, P (∅) = 0), y es 1 cuando es seguro que debe

ocurrir (o sea, P (Ω) = 1). En el caso en que Ω es conjunto finito y todos los elementos son

equiprobables, entonces para todo A ⊂ Ω se tiene que P (A) ∈ Q.

Propiedad (2). Si dos cosas no pueden ocurrir simultáneamente, la probabilidad de que

ocurra una o la otra (es decir, cualquiera de las dos) es la suma de las probabilidades. En otras

palabras, si A y B son sucesos ajenos (es decir, A∩B = ∅, entonces P (A∪B) = P (A)+P (B).

(Esto es claro pues |A ∪ B| = |A| + |B|.)

Retomemos aquı́ el ejemplo ?? en el que se pide calcular la probabilidad de que al lanzar

tres monedas al aire salgan al menos dos águilas. Arriba calculamos la probabilidad de A ∪ B

donde A = {ass, sas, ssa, } y B = {aaa}, pero podrı́amos haber calculado por separado las

probabilidades P (A) = 83 y P (B) = 18 .

Observemos que la propiedad (2) no serı́a válida si no pidiéramos que los sucesos fueran

mutuamente excluyentes, es decir, si hubiera la posibilidad de que ocurrieran simultáneamente; por ejemplo, la probabilidad de que al lanzar un dado lo que salga sea un número

20

mayor que 3 o que sea un número par es 46 (el suceso es {2, 4, 5, 6}) y no 63 + 36 = 1, que serı́a

la suma de las probabilidades de los sucesos A = {4, 5, 6} y B = {2, 4, 6} (los casos 4 y 6

son comunes a los dos y se estarı́an contando dos veces al sumar las probabilidades).

Propiedad (3). La probabilidad de que ocurran dos cosas en un orden determinado es

el producto de las probabilidades. En este caso estamos diciendo que si A1 es un suceso en

un espacio muestral Ω1 y A2 es un suceso en un espacio muestral Ω2 , entonces P (A1 × A2 ) =

P (A1 )P (A2 ), lo cual es claro pues dados dos conjuntos A y B, el número de elementos del

producto cartesiano A × B es |A||B|.

Retomemos el ejemplo ?? en el que querı́amos calcular la probabilidad de que al lanzar

dos monedas al aire el resultado en ambas sea águila. En lugar de lo hecho arriba, podrı́amos

haber definido Ω = {a, s} y A = {a} y calcular P (A)P (A) = 21 12 = 14 . ♦

Dado A ⊂ Ω denotamos por ¬A al complemento de A, es decir, al conjunto Ω \ A = {x ∈

Ω:x∈

/ A}

3.6 Corolario. Si la probabilidad de que algo ocurra es p, entonces la probabilidad de

que no ocurra es 1 − p.

Demostración. Esto es claro por la propiedad (2) pues para A ⊂ Ω, A y ¬A son conjuntos

ajenos cuya unión es Ω, ası́ que 1 = P (Ω) = P (A) + P (¬A). ♦

Veamos más ejemplos en los que podremos observar que hay que escoger con cuidado el

espacio muestral para que represente verdaderamente el problema que se quiere resolver.

3.7 Ejemplo. El experimento es sacar 2 pelotas de una caja en la que hay 2 pelotas

rojas y 3 azules. Se quiere calcular la probabilidad de que las dos pelotas escogidas tengan

distinto color y compararla con la probabilidad de que tengan el mismo color.

Solución. Para definir el espacio muestral conviene numerar las pelotas y pensar que las

rojas son la 1 y la 2, y que de la 3 a la 5 son azules; entonces el espacio muestral es

Ω = {{1, 2}, {1, 3}, {1, 4}, {1, 5}, {2, 3}, {2, 4}, {2, 5}, {3, 4}, {3, 5}, {4, 5}}

y A = {{1, 3}, {1, 4}, {1, 5}, {2, 3}, {2, 4}, {2, 5}},

6

ası́ que P (A) = 10

= 35 = 0.6. La probabilidad de que las dos pelotas tengan el mismo color

4

se calcula considerando el suceso B = {{1, 2}, {3, 4}, {3, 5}, {4, 5}}, y aquı́ P (B) = 10

=

3

2

0.4 < P (A) (o, de otra manera, como B = ¬A, P (B) = 1 − P (A) = 1 − 5 = 5 = 0.4). ♦

3.8 Ejemplo. Como en ??, se tiene una caja en la que hay 2 pelotas rojas y 3 azules,

pero ahora el experimento consiste en sacar una pelota, observar su color, volverla a meter,

y sacar otra vez una pelota. Calcular la probabilidad de que las dos pelotas escogidas tengan

distinto color. Comparar con los resultados de ??.

21

Solución. Numeremos las pelotas como en el ejemplo anterior. En este caso

Ω = [5] × [5] y

A = {(1, 3), (3, 1), (1, 4), (4, 1), (1, 5), (5, 1), (2, 3), (3, 2), (2, 4), (4, 2), (2, 5), (5, 2)},

por lo que P (A) = 12

= 0.48, que es menor que el resultado del ejemplo anterior, lo cual

25

resultaba intuitivamente obvio. ♦

3.9 Ejemplo. Dentro de cierto grupo de 4 caballos numerados del #1 al #4 se ha

observado que la frecuencia con que el caballo #1 gana es el doble que con la que gana el

#2; que éste a su vez gana el doble de veces que el #3, y que el #3 gana el doble de veces

que el #4. Encontrar la probabilidad de que en la próxima carrera el caballo ganador sea el

#3.

Solución. Tenemos que representar en el espacio muestral las condiciones de que unos

ganan el doble de veces que otros. Podemos entonces asignar al caballo 4 el número 1, al

caballo 3 los números 2 y 3, al caballo 2 los números 4, 5, 6 y 7, y al caballo 1 los números

2

∼ 0.13. ♦

del 8 al 15. De esta manera Ω = [15], A = {2, 3} y la probabilidad es 15

Para eliminar complicaciones técnicas, en los dos ejemplos siguientes consideraremos

el año con 365 dı́as (sin contar en ningún caso el 29 de febrero) y supondremos que la

distribución de los cumpleaños es pareja a lo largo del año.

3.10 Ejemplo. Encontrar la probabilidad de que una persona determinada haya nacido

en enero o febrero.

Solución. Ω = [365], A = [59] y P (A) =

59

365

∼ 61 . ♦

3.11 Ejemplo. Encontrar la probabilidad de que en un grupo de 59 personas al menos

2 tengan el mismo cumpleaños.

Solución. Notemos que este ejemplo difiere del anterior en que las fechas de cumpleaños

no se comparan con fechas fijas sino entre sı́. Veremos que los resultados son muy distintos.

Para resolver el ejemplo resulta más fácil contar la probabilidad opuesta: que no haya ningún

cumpleaños repetido, y después usar ??. Utilizaremos repetidamente la propiedad (3). Consideremos un orden fijo para las personas. La probabilidad de que el segundo cumpleaños sea

364

distinto del primero es 365

. La probabilidad de que el tercero sea distinto de los dos anteriores

363

es 365 , y ası́ sucesivamente. El resultado es

1−

364 × 363 × · · · × 307

,

36558

que es aproximadamente igual a 0.995. Esto quiere decir que de 1000 grupos de 59 personas

cada uno, se espera que en sólo 5 de los grupos no haya cumpleaños comunes. (Compárese

22

este resultado con el del ejemplo anterior. Resulta que basta con 23 personas para que la

probabilidad de que haya cumpleaños repetidos entre ellas sea mayor que 12 .) ♦

3.12 Ejemplo. Encontrar la probabilidad de que al lanzar una moneda al aire 10 veces

caigan exactamente 5 águilas.

Solución. Como antes, escribamos a por águila y s por sol. El espacio muestral Ω consta

de todas las sucesiones de longitud 10 formadas por a y s, de manera que |Ω| = 210 = 1024.

El suceso consta de los elementos de Ω que tienen exactamente 5 a0 s, ası́ que |A| es el número

de formas en que se pueden escoger 5 posiciones (donde aparezcan las a0 s) dentro de un total

252

∼ 0.25. ♦

de 10, es decir, 10

= 252. Entonces P (A) = 1024

5

En forma análoga a la resolución del ejemplo anterior tenemos que la probabilidad

de

1 20

que de un total de 20 lanzamientos de la moneda 10 salgan águila es 220 10 , que es aproximadamente igual a 0.176. Se puede demostrar que mientras más lanzamientos se hagan,

la probabilidad de que la mitad de las veces salga águila es menor. Esto no contradice la

afirmación de que si una moneda se lanza al aire un número grande de veces se espera que

un número cercano a la mitad de las ocasiones caiga águila; la explicación para esto es que la

idea de “cercanı́a” debe manejarse en forma relativa al tamaño del número; por ejemplo, en

el caso de 10 lanzamientos podrı́amos decir que los casos en que salieran entre 3 y 7 águilas

son todos “cercanos” a la mitad, y en el caso de 20 lanzamientos dirı́amos que los casos

“cercanos” a la mitad son entre 5 y 15.

3.13 Ejercicio. Encontrar la probabilidad de que al lanzar una moneda al aire 10 veces

salga águila entre 3 y 7 veces.

Como ya hemos visto, se pueden considerar distintos espacios muestrales para resolver un

determinado problema y, en cada caso, el suceso del cual se quiere calcular la probabilidad

es diferente, ası́ que los cálculos también lo son, aunque, claro, el resultado final debe ser el

mismo. En el siguiente ejemplo presentamos varias formas de resolver el problema según el

espacio muestral que se escoja.

3.14 Ejemplo. ¿Cuál es la probabilidad de que al escoger dos subconjuntos de 4 elementos dentro de un conjunto de 10 elementos, los subconjuntos tengan al menos un elemento

en común?

Solución. Es más fácil contar la probabilidad contraria, es decir, la probabilidad de que los

dos subconjuntos escogidos no tengan elementos en común. Consideremos distintos espacios

muestrales Ω y los respectivos sucesos A con complemento ¬A:

Primera forma. Sea P4 = {A ⊂ [10] : |A| = 4}, es decir, P4 tiene por elementos a

los subconjuntos de [10] que tienen 4 elementos. Tomemos Ω = P4 × P4 . En este caso

23

|¬A| =

10

4

6

, ası́ que

4

10 6

4

4

10 2

4

P (A) = 1 − P (¬A) = 1 −

6

4

10

4

=1−

=1−

6·5·4·3

4·3·2·1

10·9·8·7

4·3·2·1

=1−

13

6·5·4·3

= .

10 · 9 · 8 · 7

14

Segunda forma. Sea P4 como arriba. Supongamos que un conjunto de 4 elementos ya está

escogido; entonces queremos calcular la probabilidad de que al escoger otro conjunto,

éste

6

10

sea ajeno con el primero. En este caso tomemos Ω = P4 . Aquı́ |¬A| = 4 , |Ω| = 4 y

6

4

10

4

P (A) = 1 − P (¬A) = 1 −

6·5·4·3

13

6·5·4·3

=1− 4·3·2·1 =1−

= .

10 · 9 · 8 · 7

10 · 9 · 8 · 7

14

4·3·2·1

Tercera forma. Como en la segunda forma, supongamos que un conjunto de 4 elementos ya

está escogido; entonces queremos calcular la probabilidad de que al escoger otro conjunto,

éste sea ajeno con el primero. Sea Ω = {(c1 , c2 , c3 , c4 ) ∈ [10] : ci 6= cj para i 6= j} y

supongamos que el conjunto ya escogido tiene elementos a1 , a2 , a3 , a4 ; en este caso ¬A =

{(c1 , c2 , c3 , c4 ) ∈ Ω : para cada i, j ci 6= aj }, |¬A| = 6 · 5 · 4 · 3 y |Ω| = 10 · 9 · 8 · 7 y, entonces,

P (A) = 1 − P (¬A) = 1 −

6·5·4·3

13

= .♦

10 · 9 · 8 · 7

14

3.15 Ejercicio. Cuatro equipos A, B, C, D entran a un torneo de basquetbol. Al principio juegan A contra B, y C contra D; en cada juego se elimina al perdedor. Los dos ganadores

se enfrentan y el que gane ese juego se determina como ganador del torneo. Escribir un espacio muestral apropiado y el suceso correspondiente para determinar la probabilidad de que

B sea el ganador.

3.16 Ejercicio. Un grupo de 3 mujeres y 3 hombres se dividirá en dos equipos con 3

miembros cada uno. Definir un espacio muestral y el suceso correspondiente que sirvan para

encontrar la probabilidad de que en uno de los equipos queden todos los hombres y en el

otro todas las mujeres.

Los siguientes problemas se refieren al conjunto usual de 28 fichas de dominó en que cada

ficha muestra dos números de la colección 0, 1, 2, 3, 4, 5 y 6 (posiblemente repetidos), como

esquematizamos a continuación:

6|6 6|5 6|4 6|3

5|5 5|4 5|3

4|4 4|3

3|3

24

6|2

5|2

4|2

3|2

2|2

6|1

5|1

4|1

3|1

2|1

1|1

6|0

5|0

4|0

3|0

2|0

1|0

0|0

Se llaman fichas dobles aquéllas en que los dos números mostrados son iguales. Se llama

mano de dominó cualquier

colección de 7 de las 28 fichas. Nótese que el número total de

28

manos de dominó es 7 = 1 184 040.

3.17 Ejercicio. ¿Cuál es la probabilidad de que una mano de dominó tenga por lo menos

2 fichas dobles?

3.18 Ejercicio. Se dice que una mano de dominó tiene falla si alguno de los números

entre el 0 y el 6 no aparece en la mano (cada número faltante es una falla); por ejemplo

la mano {2|1, 5|5, 3|1, 0|0, 1|0, 5|6, 0|2} tiene falla a 40 s. ¿Cuál es la probabilidad de que una

mano de dominó no tenga falla?

3.19 Ejercicio. Una persona quiere apostar que la suma de lo que muestren dos dados

es cierto número. ¿A qué número le conviene apostar?

3.20 Ejercicio. Se eligen al azar n cartas de la baraja. ¿Cómo debe ser n para que la

probabilidad de que entre las cartas elegidas haya (al menos) dos del mismo número sea

mayor que 21 ? ¿Cuál es la probabilidad si n = 14?

3.21 Ejercicio. En el experimento de escoger un número entre el 1 y el 60 al azar, sea

A el evento de escoger un número múltiplo de 5, y sea B el evento de escoger un número

múltiplo de 3. ¿Cuál es la probabilidad de escoger un número que sea múltiplo de 3 o múltiplo

de 5?

3.22 Ejercicio. Calcular la probabilidad de que al lanzar tres veces dos dados, las tres

veces los números que salgan sean iguales entre sı́.

3.23 Ejercicio. Se escogen al azar en sucesión tres números (posiblemente iguales) entre

el 1 y el 100. ¿Cuál es la probabilidad de que se hayan escogido en orden creciente estricto?

3.24 Ejercicio. Lanzamos una moneda al aire 5 veces. Si sabemos que 3 de ellas fueron

águila, ¿cuál es la probabilidad de que la primera haya caı́do águila?

3.25 Ejercicio. Un dado se lanza al aire 6 veces. ¿Cuál es la probabilidad de que aparezca

cada uno de los seis números una vez?

3.26 Ejercicio. Supongamos que de un grupo de 10 enfermedades cada una tiene pro1

de atacar a un animal determinado a lo largo de su vida. ¿Qué probabilidad

babilidad 10

tiene ese animal de enfermarse de al menos una de esas enfermedades?

3.27 Ejercicio. Isabel escoge 4 puntos de los marcados. ¿Cuál es la probabilidad de que

los puntos escogidos sean los vértices de un rectángulo (con lados horizontales y verticales?

25

3.2.

•

•

•

•

•

•

•

•

•

•

•

•

Funciones de probabilidad

Hasta aquı́ hemos trabajado con problemas de probabilidad basados en conteo dentro de

conjuntos finitos. Sin embargo, es claro que pueden interesarnos casos en los que los conjuntos

no sean finitos. Por ejemplo, podrı́amos preguntar cuál es la probabilidad de escoger un punto

dentro de una región dibujada en un papel al escoger un punto cualquiera del papel. Si el

área total del papel es s y el área de la región es r, entonces la respuesta deberı́a ser el

número real (no necesariamente racional) rs ; para lograr esto deberemos tener una concepto

de medida clara en nuestros conjuntos y también una idea de convergencia en el caso infinito.

En muchos casos, nuestros espacios muestrales pueden ser conjuntos de números reales

o de Rn para algún natural n. Decimos que un espacio muestral Ω ⊂ Rn es discreto si para

cualquier producto de intervalos reales I = [a1 , b1 ] × · · · × [an , bn ] la intersección de I con Ω

es finita. Por ejemplo, cualquier espacio muestral finito es discreto y también lo es Z × Z. El

intervalo real (0, 1), Q, { n1 : n ∈ N} y el cı́rculo S 1 = {z ∈ C : ||z|| = 1} no son discretos.

Para extender nuestro estudio de probabilidad abstraeremos las condiciones intuitivas de

probabilidad que hemos visto como explicamos a continuación.

Dado un conjunto arbitrario X, recordemos que el conjunto potencia de X es el conjunto

P(X) cuyos elementos son todos los subconjuntos de X, es decir

P(X) = {A : A ⊂ X}.

Dado un conjunto Ω, llamado espacio muestral, se considera un subconjunto A ⊂ P(Ω) cuyos

elementos se llaman sucesos o eventos (es decir, los elementos de A son subconjuntos A de

Ω). Dicho conjunto A debe satisfacer algunas propiedades técnicas (que no mencionaremos

aquı́) de manera que tengan sentido los axiomas que pediremos que satisfaga una función de

probabilidad, definida a continuación). Dados Ω y A ⊂ P(Ω), una función de probabilidad

en Ω es una función P : A → R que satisface:

(P1) P (Ω) = 1.

(P2) P (A) ≥ 0 para todo A ∈ A.

(P3) Para cualquier familia finita o numerable {Ai : i} de sucesos ajenos por parejas se

26

S

P

tiene que P ( i Ai ) = i P (Ai ).

A (P1), (P2) y (P3) les llamamos axiomas de probabilidad.

Es claro que el concepto intuitivo de probabilidad que vimos en los ejemplos finitos al

para A ⊂ Ω satisface los axiomas de probabilidad. También observemos

definir P (A) = |A|

|Ω|

que para resolver problemas como ??, escogimos un espacio muestral especial que tomaba

en cuenta una “medida” para cada caballo; nuestro espacio muestral podrı́a haber sido el

conjunto {1, 2, 3, 4} de los caballos y podrı́amos haber calculado la función de probabilidad

tomando P {4} = p y entonces P {3} = 2p, P {2} = 4p y P {1} = 8p. Como 1 = P {1, 2, 3, 4} =

1

y la respuesta es

P {1} + P {2} + P {3} + P {4} = 8p + 4p + 2p + p = 15p, entonces p = 15

2

P {3} = 15

.

Dada una función de probabilidad, usando sólo los axiomas se pueden probar las siguientes

propiedades:

3.28 Proposición. Sea P una función de probabilidad en Ω y sea A el conjunto de

sucesos de Ω. Se satisfacen entonces la siguientes propiedades.

(a) P (∅) = 0.

(b) Si A ∈ A y ¬A es el complemento de A entonces P (¬A) = 1 − P (A).

(c) Si A ⊂ B entonces P (A) ≤ P (B).

(d) Para todo A ∈ A se tiene que P (A) ≤ 1.

Demostración. (a) Se deduce de inmediato a partir de (P3) tomando A1 = A2 = ∅:

P (∅) = P (∅ ∪ ∅) = P (∅) + P (∅), de donde, cancelando, P (∅) = 0.

(b) También es claro a partir de (P3) pues A y ¬A son sucesos ajenos cuya unión es Ω.

Se dejan las demostraciones de (c) y (d) como ejercicio. ♦

3.29 Nota. Se puso (P3) como axioma, sin considerar un problema de convergencia

en el caso numerable; sin embargo, una serie como la descrita siempre

pues de la

Pn converge

proposición anterior se deduce que la sucesión de sumas parciales

P

(A

)

k n es creciente

i=1

y acotada por 1 = P (Ω).

De aquı́ en adelante, P es una función de probabilidad en un espacio muestral Ω (no

necesariamente finito) y A denota el conjunto de sucesos.

Para el siguiente ejemplo debemos recordar que para cualquier número x 6= 1, si n es

n+1

natural, entonces 1 + x + x2 + · · · + xn = 1−x

(lo cual se comprueba fácilmente haciendo

1−x

la multiplicación (1 + x + x2 + · · · + xn )(1 − x)). Además, las reglas de convergencia en R

1

nos dicen que si x es un real tal que |x| < 1 entonces 1 + x + x2 + · · · = 1−x

.

27

3.30 Ejemplo. Se lanza una moneda al aire hasta que salga águila por primera vez.

(a) ¿Cuál es la probabilidad de que se lance menos de 4 veces?

(b) ¿Cuál es la probabilidad de que la primera vez que salga águila sea en un lanzamiento

par (es decir en el segundo o en el cuarto, etc.)?

(c) ¿Cuál es la probabilidad de que la primera vez que salga águila sea en un lanzamiento

impar (es decir en el segundo o en el cuarto, etc.)?

Solución. Conviene tomar Ω = N en donde cada n ∈ Ω representa el primer lugar en el

que apareció águila. Entonces P {1} = 21 , P {2} = 12 12 = 14 y, en general, P {n} = 21n ; si A

es un suceso con más de un elemento, se define P (A) usando

Entonces es claro que

P (P3).

1

=

1.

también se satisface (P2). El axioma (P1) se satisface pues ∞

i=1 2n

(a) Aquı́ el suceso que debemos considerar A = {1, 2, 3, 4}, ası́ que la solución del ejemplo

es

P (A) = P {1} + P {2} + P {3} + P {4} =

1 1 1

1

15

+ + +

= .

2 4 8 16

16

(b) En este caso el suceso es B = {2, 4, 6, · · · } y

P (B) = P {2} + P {4} + P {6} + · · · =

∞

X

1

1

=

n

4

1−

i=1

1

4

−1=

4

1

−1= .

3

3

(c) Usando ??(b) tenemos que la probabilidad es 23 . ♦

3.31 Nota. Para espacios numerables, si se conoce la probabilidad en los conjuntos de un

solo elemento entonces, usando (P3), también se conoce la probabilidad de cualquier suceso.

Sin embargo, al tratar de definir la probabilidad en los conjuntos de un solo elemento hay que

tomar en cuenta que la probabilidad del conjunto total debe ser 1. En muchos casos, sobre

todo en espacios muestrales continuos, esto no es útil (incluso resulta que la probabilidad de

los conjuntos de un solo elemento es casi siempre 0).

Trabajar con conjuntos en donde no se tiene bien definida una noción de medida puede

llevar a contradicciones, como veremos en el siguiente ejemplo.

3.32 Ejemplo. ¿Cuál es la probabilidad de que al escoger un natural al azar el resultado

sea un número par?

Solución. Uno tiende a decir que el resultado es 12 , pero vamos a ver que esto no tiene

sentido pues, también parecerı́a natural tener que P {n} = P {m} para todos los enteros

m, n, y esto no es posible ya que, usando (P3), se tendrı́a que P (N) = ∞, por más pequeño

que escogiéramos el valor de los P {n}.

Nuestra idea de que el resultado deberı́a ser 21 viene de que estamos acostumbrados a

pensar en los números naturales en orden y nos gustarı́a interpretar el problema a partir de

los casos finitos, es decir, considerando N = lim [n] y determinando, para cada n ∈ N, la

n→∞

28

probabilidad de escoger un número par dentro de [n], la cual, en vista de nuestro concepto

natural de probabilidad en los casos finitos, deberı́a de ser n/2

= 12 si n es par, y (n−1)/2

= 12 n−1

n

n

n

si n es impar. Entonces, interpretando ası́ y pensando en una idea como de una “probabilidad

continua” la respuesta a nuestro problema deberı́a ser el lı́mite, cuando n tiende a infinito,

de la sucesión (0, 21 , 12 23 , 12 , 12 34 , . . .), que es 21 .

Sin embargo, lo que acabamos de hacer es erróneo. Notemos que la elección de los conjuntos [n] que se aproximan a N es arbitraria; ¿por qué no tomar otra sucesión creciente de

conjuntos cuya unión fuera N? Por ejemplo, en lugar de agregar uno a uno los elementos

en orden, uno podrı́a agregar de tres en tres los elementos de manera que se agregaran dos

impares y un par, en orden:

X1

X2

X3

X4

=

=

=

=

..

.

{1, 3, 2}

{1, 3, 2, 5, 7, 4}

{1, 3, 2, 5, 7, 4, 9, 11, 6}

{1, 3, 2, 5, 7, 4, 9, 11, 6, 13, 15, 8}

En este caso, la unión también serı́a N, pero en cada conjunto la probabilidad de escoger un

número par serı́a 31 ası́ que procediendo de esta manera concluirı́amos que la probabilidad

total es también 13 .

Modificando los conjuntos es posible lograr que cualquier número entre 0 y 1 sea el lı́mite

de las probabilidades de una sucesión creciente de conjuntos cuya unión es N. ♦

El absurdo de obtener cualquier probabilidad como respuesta en el ejemplo anterior es

porque no tenemos bien definida la idea de medida en N: ¿Por qué algún conjunto infinito

serı́a más grande que otro? Entonces, el cálculo de probabilidades depende siempre de la

definición de nuestra función de probabilidad.

En los casos finitos, nuestro sentido común nos ayuda mucho a definir la función de probabilidad, pero en los casos infinitos debemos basarnos en alguna abstracción que convenga

al problema que queremos resolver o, simplemente, puede trabajarse en abstracto. Estudios

de este tipo corresponden a un nivel mucho más avanzado que el propósito de este curso.

Los espacios muestrales continuos son infinitos e, inclusive, pueden no ser numerables.

En ellos debe definirse una medida (y, a través de ella, una probabilidad) de alguna manera

apropiada cuidando que se satisfagan los axiomas (P1), (P2) y (P3). Para empezar, como

vimos en ??, si el espacio muestral es infinito, no es posible que todos los sucesos que constan

de un solo elemento tengan la misma probabilidad; también resulta, como dijimos arriba,

que en muchos casos no es posible asignar una probabilidad a cada subconjunto del espacio

muestral.

El siguiente ejemplo nos describe una forma de definir una función de probabilidad en

un espacio muestral continuo.

29

3.33 Ejemplo. Definir una función de probabilidad en el intervalo real [a, b] (con a < b

reales) que tome en cuenta la proporción de medidas.

Solución. Consideremos que los sucesos son intervalos contenidos en [a, b] o uniones finitas

o numerables de éstos. Recordemos que se quiere que el espacio total tenga probabilidad 1.

c−d

. Se extiende la

Entonces, dado un intervalo [c, d] ⊂ [a, b], es natural definir P [c, d] = b−a

definición a otros sucesos usando (P3). (Observamos que la probabilidad de los conjuntos de

un solo elemento es 0.) ♦

3.34 Nota. En el ejemplo anterior, el mismo resultado lo podrı́amos haber obtenido

usando integrales (que son la generalización natural de suma) definiendo la función f : R → R

por

1

, si x ∈ [a, b],

b−a

f (x) =

0, si no

y para [c, d] ⊂ [a, b],

Z

P [c, d] =

d

f (x)dx =

c

d−c

.

b−a

En este caso la función escogida f es constante pues se quiere que la probabilidad sea

homogénea de acuerdo a la medida. Sin embargo, como vimos en los casos finitos, en otros

problemas puede interesarnos que la distribución de probabilidad no sea homogénea; en esos

casos usaremos la integral de una función f no constante que tome en cuenta la distribución

de la probabilidad que requiere el problema.

3.35 Ejercicio. Probar las afirmaciones de ??(c) y (d).

3.36 Ejercicio. Sea Ω = {a, b, c}. ¿Es posible definir una función de probabilidad en Ω

que cumpla P {a, b} = 32 , P {a, c} = 13 y P {b, c} = 13 ?

3.37 Ejercicio. Se sabe que hay dos enfermedades que pueden atacar a una población

de animales en el verano. También se sabe que la probabilidad de que un determinado animal

adquiera a lo más una de las enfermedades es 0.9 y de que adquiera al menos una de las

enfermedades es 0.2. Determinar las siguientes probabilidades para un determinado animal:

que no adquiera ninguna de las enfermedades, que adquiera una de ellas y que adquiera las

2.

3.38 Ejercicio. Se lanza un dado hasta que aparezca 1 por primera vez. Calcular las

siguientes probabilidades.

(a) Que se necesite lanzarlo 10 veces.

(b) Que se necesite echarlo menos de 5 veces.

(c) Que se necesite lanzarlo un número par de veces.

30

3.39 Ejercicio. Se escoge un número real r al azar entre 0 y 1 y se traza un cı́rculo en

el plano con radio r. ¿Cuál es la probabilidad que el cı́rculo tenga área menor que π2 ?

3.40 Ejercicio. Se rompe una regla de 30 cm en dos pedazos a lo largo. ¿Cuál es la

probabilidad de que un pedazo tenga al menos el doble de tamaño que el otro?

3.41 Ejercicio. En cada turno de un juego, cada una de tres personas lanza una moneda

al aire hasta que uno de los resultados sea distinto de los otros dos, y entonces el dueño de

la moneda distinta pierde.

(a) ¿Cuál es la probabilidad de que en el primer turno haya un perdedor?

(b) ¿Cuál es la probabilidad de que se necesite un número par de lanzamientos para

determinar un perdedor?

3.3.

Probabilidad Condicional

Empezaremos esta sección con tres ejemplos en los que nuestra intuición falla si no se

toman en cuenta condiciones que limitan al conjunto que tratamos. La conclusión es que hay

que tener mucho cuidado con el universo en el que se trabaja.

3.42 Ejemplo. En un programa de concurso hay tres puertas cerradas. Sólo una de

ellas tiene detrás un premio. Un determinado concursante escoge una puerta A, sin abrirla;

el animador (que sabe cuál de las puertas es la buena), abre una de las otras dos puertas,

B, mostrando que no hay premio detrás, y le dice al jugador que abra una de las otras: A o

C. Según las probabilidades, ¿qué puerta le conviene abrir al concursante (o es igual)?

Solución. Tenemos el espacio muestral Ω = {A, B, C}. En un principio se tiene que la

probabilidad es homogénea, ası́ que P {A} = 13 y, por tanto, P {B, C} = 23 . Sin embargo luego

se nos dice que no es B, ası́ que P {B} = 0; la probabilidad de A sigue siendo 13 pero la de

{C} ahora tenemos que es 23 , ası́ que le conviene cambiar de opinión y escoger la puerta C

(con el doble de oportunidad de ganar). ♦

3.43 Ejemplo. En una población se sabe que la probabilidad de tener una cierta enfer1

medad es de 10000

. Una prueba de sangre es confiable en un 90 %. Raúl se hizo la prueba y

resultó positiva. Está muy asustado. ¿Tiene razón?

Solución. No tiene razón. La probabilidad de que tenga la enfermedad es muy remota

como veremos a continuación:

Supongamos que en la población hay 100 000 personas. Hay 10 enfermas y 99 990 sanas.

De las 10 enfermas, a 9 les sale positivo y a 1 le sale negativo. De las 99 990 sanas, a 9 999

31

(la décima parte) les sale positivo y al resto 89 991 les sale negativo.

La probabilidad de que esté enfermo es ¡menos de

1

!:

1000

9

= 0.0009. ♦

9 + 9 999

3.44 Ejemplo. Paradoja de Simpson. En la admisión a una Facultad de Fı́sicoMatemáticas resultó que, tanto en el departamento de Matemáticas como en el de Fı́sica, la

proporción de mujeres aceptadas con respecto al de solicitantes fue mayor que la de hombres.

El director publicó que, con respecto al número de solicitantes, la proporción total de mujeres

aceptadas fue mayor que la de hombres. ¿Tiene razón?

Solución. No necesariamente. Es posible que en el departamento de Fı́sica sea mucho

mayor la cantidad de hombres solicitantes que la de mujeres y que eso no ocurra en el

departamento de Matemáticas, y las probabilidades relativas no compensan esa diferencia.

Por ejemplo, supongamos que en Matemáticas hubo 40 hombres solicitantes de los cuales

se aceptó a 10, y que hubo 20 mujeres solicitantes de las cuales se aceptó a 10. Por otro

lado supongamos que hubo 100 hombres solicitantes en Fı́sica de los cuales se aceptó a 90,

mientras que hubo 10 solicitantes mujeres en Fı́sica y que todas fueron aceptadas.

Tenemos que el total de hombres solicitantes fue de 40 + 100 = 140 y de ellos se aceptó a

10 + 90 = 100 y eso da una proporción de 57 . Por otro lado, del total de 20 + 10 = 30 mujeres

32

solicitantes se aceptó a 10 + 10 = 20, lo cual hace una proporción total de mujeres aceptadas

de 23 . ♦

La razón detrás del ejemplo anterior es que en el departamento de Fı́sica es mucho mayor

la cantidad de hombres solicitantes que la de mujeres, lo cual no ocurre en el departamento

de Matemáticas, y las probabilidades relativas no compensan esa diferencia.

Dados dos eventos A y B tales que P (B) 6= 0, la probabilidad condicional P (A|B) de A

dado B es la probabilidad que ocurra A cuando ya ocurrió B. Se calcula ası́:

P (A|B) =

P (A ∩ B)

.

P (B)

3.45 Observación. Sea A un suceso distinto del vacı́o y de Ω. Entonces

(a) P (A|A) = 1.

(b) P (A|¬A) = 0.

(c) Si A y B son ajenos y P (B) 6= 0, entonces P (A|B) = 0.

3.46 Proposición. Sean A y B dos eventos. Entonces:

P (A) = P (A|B)P (B) + P (A|¬B)P (¬B)

3.47 Ejemplo. Supongamos que el Chicharito va a tirar un penalty. Si tira a la izquierda,

su probabilidad de meter gol es de 70 %. Si tira a la derecha, su probabilidad de meter gol

es de 60 %. Sabemos que tira a la izquierda el 80 % de las veces. ¿Cuál es su probabilidad de

meter gol?

Solución. Llamemos G al suceso de que meta gol, I al de que tire hacia la izquierda y D

33

al de que tire a la derecha. Entonces

P (G) = P (G|I)P (I) + P (G|D)P (D)

7 8

6 2

=

+

10 10 10 10

= 0.68

(1)

(2)

(3)

Podemos generalizar lo que vimos en el ejemplo en el siguiente teorema.

3.48 Teorema. Teorema de Bayes, primera versión. Sea Ω = A1 ∪ A2 ∪ · · · ∪ An

con los Ai sucesos ajenos por parejas y sea B un suceso. Entonces:

P (B) = P (B|A1 )P (A1 ) + P (B|A2 )P (A2 ) + · · · + P (B|An )P (An ). ♦

3.49 Ejemplo. En una competencia de futbol se usan 3 estadios. Al equipo Kimo le

conviene jugar en su estadio pues en él tiene probabilidad de 60 % de ganar mientras que en

los otros sólo tiene un 40 %. Se sorteará el estadio donde le va a tocar jugar mañana. ¿Qué

probabilidad tiene de ganar?

Solución. Aplicamos el Teorema de Bayes ??. Sea A1 el suceso de que el equipo Kimo

juegue en su propio estadio y sea A2 el suceso de que juegue en otro. Entonces P (A1 ) = 31 y

P (A2 ) = 23 . Sea B el suceso de que gane. Entonces

P (B) = P (B|A1 )P (A1 ) + P (B|A2 )P (A2 ) =

60 1

40 2

7

· +

· = .♦

100 3 100 3

15

3.50 Ejercicio. Todas las tardes, Carmen va a la panaderı́a. El 80 % de las ocasiones

encuentra su pan favorito. Se ha observado que si va entre 5 y 6, la probabilidad de que

encuentre su pan favorito es de 90 %, pero si va entre 6 y 7 su probabilidad baja a 40 %.

¿Qué porcentaje de los dı́as va a la panaderı́a entre 6 y 7?

3.51 Ejercicio. Supongamos que cierta enfermedad X le da a 1 de cada 1,000 pacientes.