capitulo 4 regresion ponderada y falta de ajuste

Anuncio

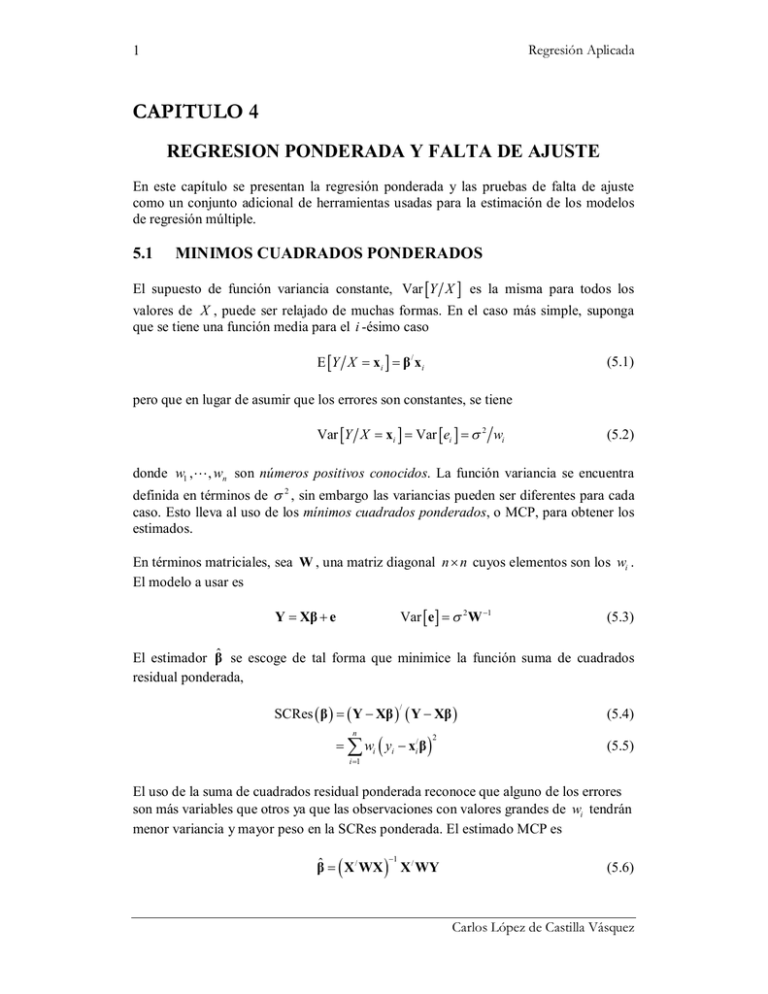

Regresión Aplicada 1 CAPITULO 4 REGRESION PONDERADA Y FALTA DE AJUSTE En este capítulo se presentan la regresión ponderada y las pruebas de falta de ajuste como un conjunto adicional de herramientas usadas para la estimación de los modelos de regresión múltiple. 5.1 MINIMOS CUADRADOS PONDERADOS El supuesto de función variancia constante, Var Y X es la misma para todos los valores de X , puede ser relajado de muchas formas. En el caso más simple, suponga que se tiene una función media para el i -ésimo caso E Y X x i β / x i (5.1) pero que en lugar de asumir que los errores son constantes, se tiene Var Y X xi Var ei 2 wi (5.2) donde w1 , , wn son números positivos conocidos. La función variancia se encuentra definida en términos de 2 , sin embargo las variancias pueden ser diferentes para cada caso. Esto lleva al uso de los mínimos cuadrados ponderados, o MCP, para obtener los estimados. En términos matriciales, sea W , una matriz diagonal n n cuyos elementos son los wi . El modelo a usar es Var e 2 W 1 Y Xβ e (5.3) El estimador β̂ se escoge de tal forma que minimice la función suma de cuadrados residual ponderada, / SCRes β Y Xβ Y Xβ n wi yi xi/ β 2 (5.4) (5.5) i 1 El uso de la suma de cuadrados residual ponderada reconoce que alguno de los errores son más variables que otros ya que las observaciones con valores grandes de wi tendrán menor variancia y mayor peso en la SCRes ponderada. El estimado MCP es 1 βˆ X / WX X / WY (5.6) Carlos López de Castilla Vásquez Regresión Aplicada 2 Para poder obtener la ecuación anterior de manera directa, es conveniente transformar el problema (5.3) en uno que pueda ser resuelto por MCO. Sea W1 2 una matriz diagonal n n cuyos elementos son los también una matriz diagonal con elementos 1 wi , entonces W 1 2 es wi tal que W1 2 W 1 2 I . La matriz de variancia covariancia de W1 2e es Var W1 2e W1 2 Var e W1 2 W1 2 2 W 1 W1 2 Var W1 2e W1 2 2 W 1 2 W 1 2 W1 2 2 W1 2 W 1 2 W 1 2 W1 2 Var W1 2e 2 I (5.7) Es decir que W1 2e es un vector aleatorio con matriz de variancia covariancia igual a 2 veces la matriz identidad. Multiplicando ambos lados de la ecuación (5.3) por W1 2 se obtiene W1 2 Y W1 2 Xβ W1 2e (5.8) Sean Z W1 2 Y , M W1 2 X y d W1 2e , entonces (5.8) se convierte en Z Mβ d (5.9) De (5.7), Var d 2 I . Luego (5.9) puede resolverse usando MCO, βˆ X / W1 2 W1 2 1 W X W X W X W Y X X W W Y X WX X WY 1 βˆ M / M M / Z 1 12 / / 12 12 12 12 / / 1 12 / que es el estimador dado en (5.6). Resumiendo, la regresión por MCP de Y sobre X con pesos dados e la matriz diagonal W es la misma que la regresión por MCO Z sobre M , donde M w1 w1 x11 w2 w2 x21 wn wn xn1 w1 x1 p w2 x2 p wn xnp Inclusive la columna de unos es multiplicada por los w1 y1 w2 y2 Z w y n n wi . El problema de regresión se resuelve usando M y Z en lugar de X y Y . Carlos López de Castilla Vásquez Regresión Aplicada 3 5.1.1 Aplicaciones de los mínimos cuadrados ponderados Los pesos pueden determinarse de varias formas. Si la i -ésima respuesta es un promedio de ni observaciones, entonces Var yi 2 ni es decir wi ni . Si yi es un total de ni observaciones, entonces Var yi ni 2 , es decir wi 1 ni . Si la variancia es proporcional a algún predictor xi , entonces Var yi xi 2 , es decir wi 1 xi . Capullos de manzana Suponga que cierta especie de árboles producen dos tipos morfológicos de capullos. Algunas ramas permanecen vegetativas año tras año contribuyendo considerablemente al tamaño del árbol. Los capullos grandes o líderes pueden crecer de 15 a 20 cm en una estación de crecimiento. Los capullos pequeños rara vez exceden 1 cm en longitud produciendo frutos. Ocasionalmente los capullos grandes se vuelven pequeños en una nueva estación de crecimiento y viceversa. El mecanismo que usa el árbol para controlar el tamaño de los capullos no es muy entendido. Bland (1978) realizó un estudio descriptivo de las diferencias entre los capullos grandes y pequeños en árboles de manzana McIntosh. Usando árboles saludables de un stock clonado que fueron plantados entre 1933 y 1934, Bland tomo muestras de capullos grandes y pequeños de estos árboles durante la temporada de crecimiento de 1971, que duro aproximadamente 106 días. Los capullos muestreados fueron removidos del árbol, marcados y llevados al laboratorio para el análisis. Bland contó el número de tallos en cada capullo. El tamaño de los capullos podría presentar diferencias dependiendo del número de tallos, el tamaño promedio de estos tallos o ambos. La data Bland contiene información para los capullos grandes y pequeños. Solo se considera la información correspondiente a los capullos grandes. El objetivo es encontrar una ecuación que permita describir adecuadamente la relación entre los días de inactividad, Dias, y el número de tallos. Al no tener una relación teórica para esta ecuación, se examina la Figura 5.2, un gráfico de dispersión del número promedio de tallos versus Dias. La aparente linealidad de este gráfico sugiere utilizar una función media lineal, E Y | Dias 0 1Dias (5.14) Si esta función media es adecuada, se observaría un resultado interesante: la razón de cambio de la producción de tallos por día es constante durante la estación de crecimiento. Para cada día muestreado, la Tabla 5.6 muestra n = número de capullos muestreados, y = número promedio de capullos en ese día y SD = desviación estándar dentro de cada día. Como Var y | Dia 2 n se puede calcular la regresión por MCP de y sobre Dia con pesos dados por los valores de n , tal como se muestra en la Tabla 5.7. Carlos López de Castilla Vásquez Regresión Aplicada 4 Bland <- read.table(file="F://Bland.txt",header=T) CapGrande=subset(Bland,Tipo==1) a1=lm(ybar~Dia,weights=n,data=CapGrande) print(summary(a1),signif.stars=FALSE) options(digits=7) anova(a1) Tabla 5.6 Capullos pequeños Dia n 1 0 5 2 6 5 3 9 5 4 19 11 5 27 7 6 30 8 7 32 8 8 34 5 9 36 6 10 38 7 11 40 4 12 42 3 13 44 8 14 48 22 15 50 7 16 55 24 17 58 15 18 61 12 19 64 15 20 67 10 21 75 14 22 79 12 23 82 19 24 85 5 25 88 27 26 91 5 27 94 16 28 97 12 29 100 10 30 106 15 Tabla 5.7 ybar SD Tipo 10.00 0.00 0 11.00 0.72 0 10.00 0.72 0 13.36 1.03 0 14.29 0.95 0 14.50 1.19 0 15.38 0.51 0 16.60 0.89 0 15.50 0.54 0 16.86 1.35 0 17.50 0.58 0 17.33 1.52 0 18.00 0.76 0 18.46 0.75 0 17.71 0.95 0 19.42 0.78 0 20.60 0.62 0 21.00 0.73 0 22.33 0.89 0 22.20 0.79 0 23.86 1.09 0 24.42 1.00 0 24.79 0.52 0 25.00 1.01 0 26.04 0.99 0 26.60 0.54 0 27.12 1.16 0 26.83 0.59 0 28.70 0.47 0 29.13 1.74 0 Data Bland Capullos grandes Dia 31 0 32 3 33 7 34 13 35 18 36 24 37 25 38 32 39 38 40 42 41 44 42 49 43 52 44 55 45 58 46 61 47 69 48 73 49 76 50 88 51 100 52 106 n 5 5 5 6 5 4 6 5 7 9 10 19 14 11 9 14 10 12 9 7 10 7 ybar SD Tipo 10.20 0.83 1 10.40 0.54 1 10.60 0.54 1 12.50 0.83 1 12.00 1.41 1 15.00 0.82 1 15.17 0.76 1 17.00 0.72 1 18.71 0.74 1 19.22 0.84 1 20.00 1.26 1 20.32 1.00 1 22.07 1.20 1 22.64 1.76 1 22.78 0.84 1 23.93 1.16 1 25.50 0.98 1 25.08 1.94 1 26.67 1.23 1 28.00 1.01 1 31.67 1.42 1 32.14 2.28 1 Regresión por MCP para la data Bland Estimate Std. Error t value Pr(>|t|) (Intercept) 9.973754 0.314272 31.74 <2e-16 Dia 0.217330 0.005339 40.71 <2e-16 Residual standard error: 1.929 on 20 degrees of freedom Multiple R-Squared: 0.9881, Adjusted R-squared: 0.9875 F-statistic: 1657 on 1 and 20 DF, p-value: < 2.2e-16 Analysis of Variance Table Response: ybar Df Sum Sq Mean Sq F value Pr(>F) Dia 1 6164.3 6164.3 1657.2 < 2.2e-16 *** Residuals 20 74.4 3.7 Carlos López de Castilla Vásquez Regresión Aplicada 5 attach(CapGrande) plot(Dia,ybar,xlab="Dias de inactividad",ylab="Numero de ramas") abline(a1,lty=2) Figura 5.2 Diagrama de dispersión para los capullos grandes Interacción fuerte El propósito del experimento es estudiar la interacción de partículas inestables en colisión con protones objetivos (Weisberg et al,. 1978). Estas partículas interactúan a través de una fuerza de interacción fuerte. Aunque la fuerza electromagnética es muy conocida no sucede lo mismo con la interacción fuerte. Este experimento fue diseñado para probar ciertas teorías con respecto a la naturaleza de esta fuerza. El experimento fue llevado a cabo considerando varios valores para s , el cuadrado de la energía total en el centro de masa del sistema de referencia. Para cada valor de s , se observo la sección cruzada de dispersión y , medida en millibarns b . Un modelo teórico para la fuerza de interacción fuerte es E y s 0 1 s 1 2 términos relativamente pequeños (5.10) Se desea (1) estimar 0 y 1 , y (2) verificar si (5.10) proporciona una adecuada descripción de la data observada. Carlos López de Castilla Vásquez Regresión Aplicada 6 La data se muestra en la Tabla 5.1 y en el archivo Fisico se resumen los resultados del experimento. Para cada valor de s , se contó un número bastante grande de partículas, y como resultado es posible calcular de forma muy aproximada los valores de Var y s si 2 wi cuya raíz cuadrada en la tercera columna de la Tabla 5.1, llamada SDi . Tabla 5.1 1 2 3 4 5 6 7 8 9 10 La data Fisico x 0.345 0.287 0.251 0.225 0.207 0.186 0.161 0.132 0.084 0.060 y SD 367 17 311 9 295 9 268 7 253 7 239 6 220 6 213 6 193 5 192 5 Ignorando los términos pequeños, la función media (5.10) corresponde a una regresión lineal simple con intercepto y x s 1 2 . Es necesario utilizar MCP, ya que las variancias no son constantes para cada valor de s . En este problema se tiene la situación inusual en la que se conocen los valores aproximados de 2 / wi . Además existen 11 cantidades w1 , , w10 y 2 que describen los valores de estas 10 variancias, es decir se tienen demasiados parámetros. Lo más sencillo es considerar 2 1 , es decir, los pesos están determinados por la inversa del cuadrado de la última columna en la Tabla 5.1. La estimación del modelo vía MCP se resume en la Tabla 5.2, El coeficiente de determinación es alto y los coeficientes significativos. La siguiente pregunta es si (5.10) presenta falta de ajuste a pesar de los resultados obtenidos. Esta pregunta sobre la falta de ajuste de un modelo es el tema central de la siguiente sección. Fisico <- read.table(file = "http://tarwi.lamolina.edu.pe/~clopez/Regresion/Fisico.txt", header = T) Modelo1=lm(y~x,weights=1/SD^2,data=Fisico) s1=summary(Modelo1) print(s1,signif.stars=FALSE) print(anova(Modelo1)) Tabla 5.2 Estimados por MCP para la data Fisico Coefficients: Estimate Std. Error t value Pr(>|t|) (Intercept) 148.473 8.079 18.38 7.91e-08 x 530.835 47.550 11.16 3.71e-06 Residual standard error: 1.657 on 8 degrees of freedom Multiple R-Squared: 0.9397, Adjusted R-squared: 0.9321 F-statistic: 124.6 on 1 and 8 DF, p-value: 3.710e-06 Carlos López de Castilla Vásquez Regresión Aplicada 7 Analysis of Variance Table Response: y Df Sum Sq Mean Sq F value Pr(>F) x 1 341.99 341.99 124.63 3.710e-06 *** Residuals 8 21.95 2.74 --Signif. codes: 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1 5.2 FALTA DE AJUSTE CON VARIANCIA CONOCIDA Cuando la función media usada en la estimación es correcta, entonces el cuadrado medio residual ˆ 2 proporciona un estimado insesgado de 2 . Si la función media es incorrecta, entonces ˆ 2 será mayor que 2 ya que su valor depende de los errores y el sesgo del modelo. Si 2 es conocido puede obtenerse una prueba de falta de ajuste del modelo comparando ˆ 2 con el modelo de valor libre. Si ˆ 2 es grande, se podría tener evidencia que la función media es incorrecta. En la data Fisico, se desea saber si la función media (5.10) es correcta. Tal como se vio en la Sección 5.1, las inversas de los cuadrados de los valores en la columna 3 de la Tabla 5.1 se usaron como pesos tomando 2 1 . De la Tabla 5.2 se obtiene ˆ 2 2.744 . Existe evidencia en contra del modelo de regresión simple si se considera que el valor estimado de la variancia es mayor que 2 1 . Para asignar un p -valor a esta comparación, se usa el siguiente resultado. Suponga que ei ~ N 0, 2 wi , i 1, 2, , n , wi y 2 conocidos, la función media es correcta y los parámetros son estimados usando MCP, entonces SCRes n ( p 1) ˆ ´ 2 2 2 X2 (5.11) Es una variable aleatoria con distribución chi-cuadrado con n ( p 1) gl. Por ejemplo, de la Tabla 5.4, X2 21.953 21.953 1 El p -valor asociado es 0.005 que sugiere que la línea recta no es adecuada. > pchisq(21.953,8,lower.tail=F) [1] 0.005003683 Cuando esta prueba indica falta de ajuste, es usual estimar una función media alternativa, transformando algunos de los términos o adicionando términos polinomiales en los predictores. La teoría física disponible sugiere que usar la función media cuadrática Carlos López de Castilla Vásquez Regresión Aplicada 8 2 E y s 0 1s 1 2 2 s 1 2 + términos relativamente pequeños E y s 0 1 x 2 x 2 (5.12) Si se estima la función media (5.12) usando MCP y considerando los mismos pesos se muestran en la Tabla 5.3. La curva estimada para la función media cuadrática se muestra en la Figura 5.1. La prueba de falta de ajuste para este modelo X2 3.226 3.226 1 Comparando este valor con el porcentaje de puntos de 27 da un p -valor aproximado de 0.86, lo cual indica que no existe evidencia de falta de ajuste para la función media (5.12). > pchisq(3.226,7,lower.tail=F) [1] 0.8633381 Modelo2=update(Modelo1, ~.+I(x^2)) s2=summary(Modelo2) print(s2,signif.stars=FALSE) print(anova(Modelo2),digits=6) Tabla 5.3 Estimados por MCP para la función media cuadrática Coefficients: Estimate Std. Error t value Pr(>|t|) (Intercept) 183.8305 6.4591 28.461 1.7e-08 x 0.9709 85.3688 0.011 0.991243 I(x^2) 1597.5047 250.5869 6.375 0.000376 Residual standard error: 0.6788 on 7 degrees of freedom Multiple R-Squared: 0.9911, Adjusted R-squared: 0.9886 F-statistic: 391.4 on 2 and 7 DF, p-value: 6.554e-08 Analysis of Variance Table Response: y Df Sum Sq Mean Sq F value Pr(>F) x 1 341.991 341.991 742.1846 2.3030e-08 *** I(x^2) 1 18.727 18.727 40.6413 0.00037612 *** Residuals 7 3.226 0.461 En base al análisis anterior, Weisberg et al. (1978) concluyeron que el modelo (5.12) es consistente con la data observada. Carlos López de Castilla Vásquez Regresión Aplicada 9 Figura 5.1 Diagrama de dispersión para la data Fisico. Línea sólida: función media para regresión simple. Línea punteada: función media cuadrática. attach(Fisico) plot(x,y,xlab=expression(paste("x=",s^(-1/2))),ylab="Seccion cruzada, y") abline(Modelo1) a=seq(0.05,0.35,length=50) lines(a,predict(Modelo2,data.frame(x=a)),lty=2) 5.3 FALTA DE AJUSTE CON VARIANCIA DESCONOCIDA Si 2 es desconocida la prueba de falta de ajuste requiere un modelo libre que estime la variancia. El más común de estos modelos libres usa la dispersión que existe entre casos que tienen los mismos valores para todos los predictores. Por ejemplo, considere la data artificial con n 10 en la Tabla 5.4. Si se consideran los valores de yi correspondientes a x 1 se puede calcular la respuesta promedio y y la desviación estándar con 3 1 2 gl, tal como se muestra en la Tabla 5.4. Si se asume que la variancia es la misma para todos los valores de x , se debe calcular una variancia común ponderando las desviaciones estándar en un solo estimado. Si n es el número de casos para un valor x y SD es la desviación estándar para ese valor de x , entonces la suma de cuadrados del error puro, denotado por SCEp, es SCEp n -1 SD 2 (5.13) Carlos López de Castilla Vásquez Regresión Aplicada 10 donde la suma se realiza sobre todos los grupos. Por ejemplo, SCEp es la suma de los valores en la cuarta columna de la Tabla 5.4, SCEp = 0.0243 + 0.0000 + 0.1301 + 2.2041 = 2.3585 Tabla 5.4 X Y 1 1 1 2 3 3 4 4 4 4 2.55 2.75 2.57 2.40 4.19 4.70 3.81 4.87 2.93 4.52 Una ilustración del calculo del error puro SD n 1 SD2 gl y 2.6233 0.1102 0.0243 2 2.4 0.0000 0.0000 0 4.445 0.3606 0.1301 1 4.0325 0.8571 2.2041 3 2.3585 6 Asociados con la SCEp están sus gl, glEp = n 1 2 0 1 3 6 . El estimado del error puro de la variancia ponderada es ˆ Ep SCEp glEp 0.3931 y no hace referencia a la función media de regresión lineal. Solo usa el supuesto que la variancia residual es la misma para cada x . Suponga ahora que se estima una función media de regresión lineal para la data. El ANVA se muestra en la Tabla 5.5, proporcionando un estimado de 2 , pero depende de la función media. Luego, se tienen dos estimados de 2 , y si el segundo es mucho mayor que el primero el modelo es inadecuado. Se puede obtener una prueba F si la suma de cuadrados residual en la Tabla 5.5 se divide en dos partes, la suma de cuadrados del error puro, dado en la Tabla 5.4, y el residuo, llamado la suma de cuadrados de falta de ajuste, o SCFaj = SCRes – SCEp = 4.2166 – 2.3585 = 1.8581 con gl = n ( p 1) glEp . La prueba F es la razón entre el cuadrado medio para la falta de ajuste y el cuadrado medio del error puro. El valor obtenido F 2.36 es considerablemente menor que F 0.05, 2, 6 5.14 lo que sugiere que no existe falta de ajuste para esta data. A pesar que los ejemplos en esta sección solo consideran un predictor, las ideas usadas para obtener un modelo libre de estimación para 2 se pueden generalizar sin problemas. El estimado del error puro de la variancia esta basado en la suma de cuadrados entre los valores de la variable respuesta de los casos que tiene los mismos valores en todos los predictores. Carlos López de Castilla Vásquez Regresión Aplicada 11 x1 <- c(1,1,1,2,3,3,4,4,4,4) y1 <- c(2.55,2.75,2.57,2.40,4.19,4.70,3.81,4.87,2.93,4.52) Modelo <- lm(y1 ~ x1) Tabla 5.5 Análisis de variancia de la data en la Tabla 5.4 library(alr3) pureErrorAnova(Modelo) Response: y1 Df x1 1 Residuals 8 Lack of fit 2 Pure Error 6 --Signif. codes: 5.4 Sum Sq Mean Sq F value Pr(>F) 4.5693 4.5693 11.6247 0.01433 * 4.2166 0.5271 1.8582 0.9291 2.3638 0.17496 2.3584 0.3931 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1 PRUEBA F GENERAL En muchas situaciones se requiere calcular un estadístico de prueba que tiene distribución F cuando la H 0 es verdadera y bajo el supuesto de normalidad. La teoría para las pruebas F es mucho más general. En su estructura básica, se compara la función media más sencilla con una función media general en la H1 . La función media más sencilla se puede obtener a partir de la función media general cuando algunos de sus parámetros son cero, iguales a otros, o cuando toman valores específicos. Un ejemplo previamente mencionado es aquel que permite probar si los últimos q términos en una función media son necesarios luego de estimar los primeros p / q donde p / p 1 donde p es el número de variables predictoras en el modelo más general. En notación matricial, la partición X X1 , X2 , donde X1 es de dimensión n p / q , X2 es de dimensión n q , β / β1/ , β 2/ , donde β1 es de dimensión p / q 1 , β 2 es q 1 . Luego las hipótesis en términos matriciales son H 0 : Y X1β1 e (5.15) H1 : Y X1β1 X 2β 2 e El modelo más pequeño se obtiene cuando, en el modelo general, β 2 0 . El procedimiento para calcular la prueba F consiste en estimar dos regresiones. Luego de estimar la función media en H 0 , encontrar la suma de cuadrados residual y sus gl, SCRes0 y gl0. Similarmente, bajo la función media alternante se calcula SCRes1 y gl1, con SCRes 0 SCRes1 0 , ya que el estimado de H1 debería ser al menos tan bueno como el estimado de H 0 . La prueba F muestra evidencia contra H 0 si F SCRes0 SCRes1 gl0 gl1 SCRes1 gl1 (5.16) Carlos López de Castilla Vásquez Regresión Aplicada 12 es grande comparada con la distribución F gl0 gl1 , gl1 . 5.4.1 Comentarios adicionales La prueba F generalmente es robusta a la violación del supuesto de normalidad, es decir que los estimados y pruebas se ven ligeramente afectados frente a una leve violación de este supuesto. En cualquier caso, si la normalidad esta en duda, puede usarse la técnica bootstrap para obtener el p -valor en (5.16). Grasa El archivo Grasa contiene información que sirve para estimar el porcentaje de grasa en el cuerpo humano en función de X 1 Edad (en años), X 2 Peso (en libras), X 3 Altura (en pulgadas), X 4 Longitud del cuello (en cm), X 5 Longitud del pecho (en cm), X 6 Longitud del abdomen (en cm), X 7 Longitud de la cadera (en cm), X 8 Longitud del muslo (en cm), X 9 Longitud de la rodilla, X 10 Longitud del tobillo (en cm), X 11 Longitud del bíceps (en cm), X 12 Longitud del antebrazo (en cm) y X 13 Longitud de la muñeca (en cm). Se tomaron las mediciones anteriores en una muestra de 252 sujetos. El primer paso es estimar el modelo de regresión lineal múltiple que considera todas las variables predictoras. Las pruebas de significación sugieren que las variables Abdomen, Muñeca, Cuello y Antebrazo son importantes. Sin embargo el valor-p para la variable Edad supera ligeramente el 5%. > Grasa <- read.table(file="http://tarwi.lamolina.edu.pe/~clopez/Regresion/Grasa.txt", header=T) > m1 <- lm(Grasa ~ ., data=Grasa) > summary(m1) Coefficients: Estimate Std. Error t value Pr(>|t|) (Intercept) -18.18849 17.34857 -1.048 0.29551 Edad 0.06208 0.03235 1.919 0.05618 . Peso -0.08844 0.05353 -1.652 0.09978 . Altura -0.06959 0.09601 -0.725 0.46925 Cuello -0.47060 0.23247 -2.024 0.04405 * Pecho -0.02386 0.09915 -0.241 0.81000 Abdomen 0.95477 0.08645 11.044 < 2e-16 *** Cadera -0.20754 0.14591 -1.422 0.15622 Muslo 0.23610 0.14436 1.636 0.10326 Rodilla 0.01528 0.24198 0.063 0.94970 Tobillo 0.17400 0.22147 0.786 0.43285 Biceps 0.18160 0.17113 1.061 0.28966 Antebrazo 0.45202 0.19913 2.270 0.02410 * Muñeca -1.62064 0.53495 -3.030 0.00272 ** Residual standard error: 4.305 on 238 degrees of freedom Multiple R-squared: 0.749, Adjusted R-squared: 0.7353 F-statistic: 54.65 on 13 and 238 DF, p-value: < 2.2e-16 Carlos López de Castilla Vásquez Regresión Aplicada 13 El siguiente paso será comparar el modelo de regresión que incluye las variables predictoras significativas al 5% de nivel de significación con el modelo de regresión que además incluye la variable Edad. > m2 <- lm(Grasa ~ Abdomen + Muñeca + Antebrazo + Cuello + Edad, data=Grasa) > m3 <- lm(Grasa ~ Abdomen + Muñeca + Antebrazo + Cuello, data=Grasa) > anova(m3,m2) Analysis of Variance Table Model 1: Grasa ~ Abdomen + Muñeca + Antebrazo + Cuello Model 2: Grasa ~ Abdomen + Muñeca + Antebrazo + Cuello + Edad Res.Df RSS Df Sum of Sq F Pr(>F) 1 247 5029.6 2 246 4724.9 1 304.66 15.862 8.976e-05 *** --Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’ 0.1 ‘ ’ 1 Usando la prueba F se llega a determinar que el modelo que incluye la variable predictora Edad es mejor. 5.5 REGIONES CONJUNTAS DE CONFIANZA Así como el intervalo de confianza para un solo parámetro esta basado en la distribución t , las regiones de confianza para un conjunto de parámetros requieren el uso de la distribución F . Estas regiones de confianza son elípticas. La región de 1 100% de confianza para β es el conjunto de vectores tales que / β βˆ X X β βˆ F , p 1, n p 1 / (5.20) p 1 ˆ 2 La región de confianza para β* , el vector de parámetros excluyendo 0 , es β * βˆ * / β / pˆ 2 * βˆ * F , p , n p (5.21) La región (5.20) es un elipsoide p 1 -dimensional centrado en β , mientras que (5.21) es un elipsoide p -dimensional centrado en β* . Por ejemplo, la región de confianza del 95% para 1 , 2 en la regresión de log(Fertilidad) sobre logPBIpc y Purban en la data UN2 se muestra en la Figura 5.3. La elipse esta centrada en 0.13, 0.0035 . La orientación de la elipse dada por la dirección del eje mayor es negativa reflejando la correlación negativa que existe entre los estimados de estos coeficientes. Carlos López de Castilla Vásquez Regresión Aplicada 14 La línea horizontal y vertical en el gráfico determinado por la intersección del eje mayor de la elipse corresponde a los intervalos de confianza al 95% para cada parámetro por separado. A partir del gráfico, se puede observar que algunos valores de los coeficientes que se encuentran dentro de la región de confianza del 95% podrían ser considerados como impensables si solo se examinan los intervalos marginales. > UN <- read.table(file = "http://tarwi.lamolina.edu.pe/~clopez/Regresion/UN.txt", header = T) > attach(UN) > m1=lm(log(Fertilidad) ~ log2(PBIpp) + Purban) > s1=summary(m1) > library(car) > confidence.ellipse(m1,Scheffe=TRUE) > confint(m1,level=0.95) 2.5 % 97.5 % (Intercept) 2.303302995 2.8826888443 log2(PBIpp) -0.163140103 -0.0878101520 Purban -0.007239249 0.0001948123 Figura 5.3 Región de confianza del 95% para la data UN2 Carlos López de Castilla Vásquez Regresión Aplicada 15 Se necesita una ligera modificación para obtener un elipsoide de confianza de un subconjunto arbitrario de β . Suponga que β1 es un subvector de β con q elementos. X X / Sea S la submatriz q q de 1 correspondiente a los q elementos de β1 . Entonces, la región de 1 100% de confianza es el conjunto de puntos β1 tales que / β βˆ S β βˆ F , q , n ( p 1) 1 1 1 1 qˆ 2 1 (5.22) El método bootstrap puede usarse para obtener regiones conjuntas de confianza generalizando el método desarrollado para intervalos de confianza de la Sección 4.6, sin embargo el número de repeticiones bootstrap B se requiere que sea mucho mayor que el número necesario para los intervalos. Las regiones de confianza bootstrap podrían ser conjuntos más pequeños que incluyen el 1 100% de las repeticiones bootstrap. Carlos López de Castilla Vásquez