- Ninguna Categoria

HETEROCEDASTICIDAD [Modo de compatibilidad]

Anuncio

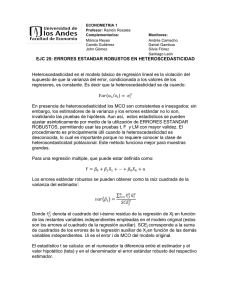

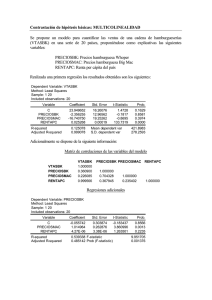

12/10/2010 Varianza del error no constante: heteroscedasticidad Fortino Vela Peón Universidad Autónoma Metropolitana [email protected] 12/10/2010 Octubre, 2010 México, D. F. 1 Introducción Con bastante regularidad los datos no se ajustan a las condiciones idealizadas del modelo de regresión lineal clásico. Así, por ejemplo, es frecuente encontrar errores heteroscedasticos, particularmente en datos de corte transversal. Una razón de ello radica en que la varianza en la variable dependiente raramente se mantiene constante cuando el nivel de una (o más) variable(s) explicativa(s) aumenta o disminuye. Por ejemplo, no sólo el nivel de consumo de los “ricos” es mucho mayor al de los “pobres”, sino que también es más variable. Los pobres tienen pocas opciones para dedicar sus ingresos a bienes distintos a los de la canasta básica; los ricos por su parte disfrutan del privilegio de considerar más opciones. 12/10/2010 2 Una implicación para el análisis estadístico es que no se podrá aplicar el modelo de regresión lineal clásico a los datos de manera inmediata. Una transformación matemática bien elegida puede ayudar a corregir a la heteroscedasticidad dado que menudo es debida a la asimetría en la distribución de Y (transformaciones Box-Cox, por ejemplo). Desafortunadamente, no siempre es posible hacer esto. 12/10/2010 3 1 12/10/2010 Si el resto de los supuestos del modelo de regresión resultan validos, es decir, la existencia de una relación lineal, independencia y esperanza cero del término del error, se puede demostrar que los errores heteroscedásticos no afectan la propiedad de insesgamiento de los coeficientes estimados mediante MCO. No obstante, la precisión en los valores de los coeficientes no es la mejor. Es decir, los estimadores de MCO dejan de ser los mejores estimadores linealmente insesgados (MELI) aspirando a ser solamente estimadores lineales e insesgados. Así, los errores estándar no serán los correctos, puesto que se basan en el supuesto de homoscedasticidad. 12/10/2010 4 El modelo bajo errores heteroscedasticos y = Xβ + u donde E (u ) = 0 E (uu' ) = σ 2 I Sea …(1) Bajo heteroscedasticidad se tiene …(2) βˆ = (X' X)−1 X' Y −1 = (X' X) X' ( Xβ + u) …(3) = β + (X' X)−1 X' u E (βˆ ) = β insesgado 12/10/2010 5 Ahora su varianza [ Var[βˆ ] = E (X'X)−1 X'uu' X(X'X)−1 ] bajo “homo” E (uu' ) = σ 2 I pero bajo “hetero” E (uu' ) ≠ σ 2 I = σ 2 Ω Por lo tanto, bajo heteroscedasticidad se tiene Var[βˆ ] = (X'X)−1 (X'ΩX)(X'X)−1 donde Ω es E (uu' ) = σ 2 Ω = Σ u matriz de varianzas-covarianzas 12/10/2010 6 2 12/10/2010 Tipos de Σu σ 12 0 Σu = . 0 Heteroscedasticidad 0 ... σ ... . . ... 2 2 . 0 ρ1 1 ρ 1 1 Σu = . . ρn−1 ρ2n−3 Autocorrelación 12/10/2010 0 0 . σ n2 ρn−1 ... ρ2n−a ... . . ... 7 . 1 Autocorrelación y heteroscedasticidad (modelos ARCH, GARCH,..) σ 12 ρ1 Σu = . ρ n −1 ρ1 σ 22 ... . . ρ n −1 ρ 2 n −3 ... . σ n2 . ρ 2 n −3 ... 12/10/2010 8 Identificación de heteroscedasticidad: métodos gráficos Si no existe información a priori sobre la naturaleza de la heteroscedasticidad, es común llevar a cabo la estimación del modelo de regresión para luego hacer un análisis de los residuos que se generan. La forma inicial del análisis de residuos es mediante gráficos. Los residuales se definen como ui = yi − yˆ i . Entre las propiedades importantes de los residuales se encuentran que tienen media cero y su varianza se aproxima por: ∑ ( uˆ − u ) ∑ uˆ SCE n n 2 2 12/10/2010 σˆ 2 = i =1 i n−k = i =1 i n−k = n−k 9 3 12/10/2010 Tipos de residuales En ocasiones resulta mejor considerar a los residuales escalados. Son útiles además para identificar puntos atípicos o valores extremos. Residuales estandarizados que se definen como uˆ dˆi = i 2 σ Residuales estudentizados que se definen como rˆi = 12/10/2010 uˆ i σ ⋅ (1 − hii ) 2 10 Patrones hipóteticos de los residuos para la identificación de heteroscedasticidad Los gráficos siguientes muestran un diagrama de dispersión entre û 2 y Yˆ . Fuente: Tomado de Gujarati y Porter (2010, 377) 12/10/2010 11 Los gráficos siguientes muestran un diagrama de dispersión entre û 2 y X . Fuente: Tomado de Gujarati y Porter (2010, 378) 12/10/2010 12 4 12/10/2010 Pruebas gráficas en Stata Stata tiene implementado dentro de sus rutinas ambos tipos de gráficas para la identificación de heteroscedasticidad en los residuales. Despues de estimar el modelo de regresión la sintaxis a utilizar es: rvfplot y rvpplot. rvfplot muestra el diagrama de dispersión entre residuales y valores ajustados. Por su parte, rvpplot elabora el diagrama de dispersión entre residuales y cualquiera de las variables predictoras (X’s), razón por la requiere que se señale cual es la variable a considerar, esto es, por ejemplo: rvpplot x2 12/10/2010 13 Calculo de residuales en Stata Stata permite el calculo de estandarizados y estudentizados. los residuales Una vez estimado una ecuación de regresión, la sintaxis es la siguiente: predict residual, resid (residuales simples) predict rstand, rstand (residuales estandarizados) predict rstud, rstuden (residuales estudentizados) 12/10/2010 14 Métodos formales: pruebas de Park, Glesjer y Breusch-Pagan-Godfrey Las tres pruebas son en esencia muy similares. Cada una de ellas es una prueba del Multiplicador de Lagrange (LM), por lo que siguen el mismo procedimiento general. Dado el modelo de regresión: yi = β1 + β 2 x2i + β 3 x3i + ... + β k xki + ui se realizan los pasos siguientes: 1.- Se estima el modelo de regresión y se obtienen los residuales: uˆ = y − yˆ i i i 2.- Se estiman las regresiones auxiliares siguientes y obtienen sus R2. 12/10/2010 15 5 12/10/2010 a) Para la prueba de Park la regresión auxiliar es ln uˆi2 = α1 + α 2 ln Z 2i + ... + α p ln Z pi + ε i b) Para la prueba de Glesjer la regresión auxiliar es uˆi2 = α1 + α 2 Z 2i + ... + α p Z pi + ε i c) Para la prueba de Breusch-Pagan-Godfrey la regresión auxiliar es u~i2 = α1 + α 2 Z 2i + ... + α p Z pi + ε i donde n u~i2 = uˆi2 / ∑ uˆi2 / n i =1 12/10/2010 16 En cada regresión auxiliar, las Zi's pueden ser algunos o todos los regresores 3.- A continuación se calcula el estadístico de prueba LM. Bajo Ho: homoscedasticidad, se puede demostrar que el producto del tamaño de la muestra “n” por la R2 obtenida de las regresiones auxiliares sigue asintoticamente una distribución Ji-cuadrada con un número de grados de libertad igual al número de regresores. Esto es: nR 2 = χ p2 Es importante observar que los estadísticos de prueba propuestos originalmente por Park y Glesjer son estadísticos de prueba de Wald. Sin embargo, según lo precisado por Engle (1984), puesto que todas estas pruebas son diseñadas para muestras grandes, operacionalmente son equivalentes a la prueba LM. 12/10/2010 17 4.- Una vez que se encuentra el estadístico de prueba se compara a nR2 con el valor crítico de Ji-cuadrada. Así, 2 2 si nR > χ p , la conclusión es que hay heteroscedasticidad; 2 2 por el contrario, si nR < χ p hay homoscedasticidad. Las pruebas Park, Glesjer, y de Breusch-PaganGodfrey requieren el conocimiento sobre la fuente de heteroscedasticidad, es decir, la(s) variable(s) Z que puede ser causa del problema. En la prueba de Park, el término de error en la regresión auxiliar puede no satisfacer los supuestos del modelo de regresión lineal clásico y puede ser heteroscedástico en sí mismo. 12/10/2010 18 6 12/10/2010 En la prueba de Glejser, el término del error ui es diferente a cero, puede tener autocorrelación y es, irónicamente, heteroscedástico. En la prueba de Breusch-Pagan-Godfrey el término de error es absolutamente sensible al supuesto de normalidad (principalmente en pequeñas muestras). La hipótesis nula de la prueba Breusch-Pagan/CookWeisberg es que la varianza del error es la misma versus la alternativa de que la varianza del error es una función multiplicativa de una o más variables independientes. 12/10/2010 19 Prueba Breusch-Pagan-Godfrey en Stata La prueba Breusch-Pagan-Godfrey implementada en Stata. La sintaxis es estat hettest Las opciones posibles son: ha sido estat hettest varlist especifica las variables explicativas consideradas en la prueba (en caso de omisión se realiza con los valores ajustados de la dependiente, yhat). estat hettest,normal calcula la prueba suponiendo que los residuales de la regresión se distribuyen normalmente (es la opción por defecto). estat hettest,iid provoca que se calcule la versión N*R2 versión del estadístico de prueba, el cuál elimina el supuesto de normalidad. 12/10/2010 estat hettest,fstat provoca que se calcule la versión basada en el estadístico F. 20 Ejemplo Verificamos la prueba hettest de forma manual. Para ello se considera la influencia que se sobre el ingreso (income) presentan las variables: escolaridad (educ), la experiencia laboral (jobexp) y la raza (race) en una muestra de 20 individuos, información que se encuentra en el archivo labora1 ubicado en: http://www.nd.edu/~rwilliam/stats2/statafile Una vez recuperado el archivo de datos se calculan algunas estadísticas descriptivas de la variables en análisis. 12/10/2010 21 7 12/10/2010 use http://www.nd.edu/~rwilliam/stats2/statafiles/reg01.dta, clear sum reg income educ jobexp Variable | Obs Mean Std. Dev. Min Max -------------+-------------------------------------------------------income | 20 24.415 9.788354 5 48.3 educ | 20 12.05 4.477723 2 21 jobexp | 20 12.65 5.460625 1 21 race | 20 .5 .5129892 0 1 Del listado se puede señalar que el ingreso promedio de los individuos en la muestra alcanzo los 24.42 dólares; su nivel escolaridad promedio fue de 12 años al igual que los años de experiencia laboral. 12/10/2010 22 graph matrix income educ jobexp race 0 10 20 0 .5 1 50 income 0 20 educ 10 0 20 jobexp 10 0 1 race .5 0 0 50 0 10 20 12/10/2010 23 reg income educ jobexp Source | SS df MS -------------+-----------------------------Model | 1538.22521 2 769.112605 Residual | 282.200265 17 16.6000156 -------------+-----------------------------Total | 1820.42548 19 95.8118671 Number of obs F( 2, 17) Prob > F R-squared Adj R-squared Root MSE = = = = = = 20 46.33 0.0000 0.8450 0.8267 4.0743 -----------------------------------------------------------------------------income | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------educ | 1.933393 .2099494 9.21 0.000 1.490438 2.376347 jobexp | .6493654 .1721589 3.77 0.002 .2861417 1.012589 _cons | -7.096855 3.626412 -1.96 0.067 -14.74792 .5542052 ------------------------------------------------------------------------------ estat hettest Breusch-Pagan / Cook-Weisberg test for heteroskedasticity Ho: Constant variance Variables: fitted values of income chi2(1) 12/10/2010 Prob > chi2 = = 0.12 0.7238 24 8 12/10/2010 -10 -5 Residuals 0 5 10 rvfplot, yline(0) 0 10 20 30 Fitted values 40 12/10/2010 50 25 rvpplot educ, yline(0) -1 0 -1 0 -5 -5 R e s id u a ls 0 R e s id u a ls 0 5 5 10 10 rvpplot jobexp, yline(0) 0 5 10 educ 15 20 12/10/2010 0 5 10 jobexp 15 20 26 predict yhat predict e, resid gen e2= e^2 / (e(rss)/e(N)) reg e2 yhat Source | SS df MS -------------+-----------------------------Model | .249695098 1 .249695098 Residual | 24.8679862 18 1.38155479 -------------+-----------------------------Total | 25.1176813 19 1.32198323 Number of obs F( 1, 18) Prob > F R-squared Adj R-squared Root MSE = = = = = = 20 0.18 0.6758 0.0099 -0.0451 1.1754 -----------------------------------------------------------------------------e2 | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------yhat | .0127408 .0299691 0.43 0.676 -.050222 .0757036 _cons | .6889345 .7774684 0.89 0.387 -.944466 2.322335 ------------------------------------------------------------------------------ display "Chi Square (1) = " e(mss) / 2 Chi Square (1) = .12484755 display "Prob > chi2 = " chi2tail(1, e(mss)/ 2) Prob > chi2 = .72383527 12/10/2010 27 9 12/10/2010 Prueba Goldfeld-Quandt Idea: “Si los errores son homoscedásticos entonces tienen la misma varianza en toda la muestra, razón por la que la varianza de los residuales de una parte de las observaciones de la muestra debe tener igual varianza a la de cualquier otra parte de las observaciones en la muestra”. El acercamiento consiste en probar la presencia de heteroscedasticidad mediante una prueba de igualdad de varianzas de los residuales mediante la estadística F. Se parte del modelo de regresión siguiente: yi = β1 + β 2 x2i + β 3 x3i + ... + β k xki + ui 12/10/2010 28 Procedimiento H 0 : ui homoscedasticos 1. Identificar una variable con la que la varianza de los errores este relacionada. Con propósito ilustrativo, suponga que es con X1 positivamente. 2. Ordenar en forma ascendente a las observaciones según los valores de X1. 3. Omitir C observaciones centrales donde C es especificada a priori, dividiendo a las restantes n-C observaciones en dos grupos cada uno con un total de (n-C)/2 observaciones La determinación de C es arbitraria. Sin embargo, suele considerarse como criterios el omitir entre un 20 y un 25% de las observaciones totales. 12/10/2010 4. 29 Estimar dos regresiones separadas correspondientes a los dos grupos; la primera considerando las (n-C)/2 observaciones y la segunda con las (n-C)/2 observaciones. De estas se obtienen la suma de cuadrados de los errores respectivas: SCE1 que corresponde a los valores más pequeños de X1 y SCE2 a la de los valores más grandes de X1 (el grupo grande de la variación), y se calcula el estadístico de prueba F. F= SCE2 / υ 2 SCE1 / υ1 donde los grados de libertad son υ1 = υ 2 = 12/10/2010 n−C 2 30 10 12/10/2010 5. Si ui se distribuye normalmente, la regla de decisión es: Rechazar Ho ssi Fc>Ft donde Ft= F(n-C)/2 , (n-C)/2 Comentarios - Esta prueba depende fuertemente tanto de la identificación de la variable X que genera la heteroscedasticidad como del valor de C. - Adicionalmente la prueba no puede considerar situaciones donde la fuente de heteroscedasticidad es por la combinación de varias variables. En este caso, debido a que no existe una sola variable que cause del problema, la prueba de Goldfeld-Quandt concluirá probablemente que no existe heteroscedasticidad cuando de hecho si la hay. 12/10/2010 31 Prueba de White (1980) Establece como hipótesis nula que la varianza de los errores es constante (homoscedasticidad). Para probar esto se estima una regresión auxiliar donde se regresa a los residuales al cuadrado sobre sus regresores (originales), el cuadrado de los regresores y los productos cruzados de los regresores. La prueba no requiere ningún conocimiento previo sobre la fuente de heteroscedasticidad. La prueba no depende del supuesto de normalidad de los errores. Sea yi = β1 + β 2 x2i + β 3 x3i + ui 12/10/2010 32 Procedimiento 1. 2. Estimar el modelo de regresión y obtener sus residuales. Estimar la regresión auxiliar siguiente y obtener su R2 asociada: uˆi2 = γ 1 + γ 2 x2i + γ 3 x3i + γ 4 x22i + γ 5 x32i + γ 4 x22i x32i + ε i 3. Calcular la estadística de prueba dado por el producto de n y R2 obtenido de la regresión auxiliar, el cual sigue de manera asintótica una distribución Ji-cuadrada con grados de libertad igual al número de regresores (sin incluir al término constante) en la regresión auxiliar. Esto es, nR 2 = χ 52 4. Si nR2>χ2 la conclusión heteroscedasticidad. 12/10/2010 es que existe 33 11 12/10/2010 Prueba de White en Stata La prueba de White se puede estimar vía la sintaxis estat imtest, white o simplemente imtest, white, o bien whitetst. Stata computa la prueba extendida de White considerando en la regresión auxiliar a los residuales al cuadrado contra todos los regresores, los productos cruzados y los cuadrados de los distintos regresores. 12/10/2010 34 Ejemplo 2 Se desea establecer la influencia que se sobre el número de hijos nacidos vivos (ceb) por mujer presentan las variables: edad de la madre (age), edad al primer nacimiento (agefbrth) y la escolaridad (educ). Para ello se considera la información de 4361 mujeres en los Estados Unidos misma que se encuentra en el archivo fertil2 ubicado en: http://www.stata-press.com/data/imeus/fertil2 Una vez recuperado el archivo de datos, lo primero a resolver es determinar qué variables presentan valores perdidos (missing values). 12/10/2010 35 use http://www.stata-press.com/data/imeus/fertil2, clear keep age educ ceb agefbrth Para ello se puede recurrir al archivo mdesc el cual realiza un conteo del número de valores perdidos para cada una de las variables numéricas (findit mdesc). mdesc Variable Missing Total Missing/Total ------------------------------------------------age 0 4361 0 educ 0 4361 0 ceb 0 4361 0 agefbrth 1088 4361 .249484 dis 4361- 1088 =3273 drop if missing(agefbrth) 12/10/2010 36 12 12/10/2010 sum ceb educ age agefbrth Variable | Obs Mean Std. Dev. Min Max -------------+-------------------------------------------------------age | 3273 30.04277 7.984743 15 49 educ | 3273 5.406355 4.067566 0 20 ceb | 3273 3.253284 2.253429 1 13 agefbrth | 3273 19.0113 3.092333 10 38 La edad promedio de las mujeres captadas en la muestra (con registros validos) fue de 30 años con una edad al primer nacimiento de 19 años. No obstante, hubo quienes tuvieron a su primer hijo a los 10 años. En promedio el número de hijos nacidos vivos por mujer es de 3.2. La escolaridad promedio fue de 5.4 años. 12/10/2010 37 Se espera que el número de hijos nacidos vivos (ceb): - aumente con la edad actual de la madre (age); - disminuya con la edad al primer nacimiento (agefbrth); - disminuya con mayores niveles de escolaridad (esc) 12/10/2010 38 graph matrix ceb age agefbrth educ 0 50 0 10 20 15 10 ceb 5 0 50 a ge 0 40 30 agefbrth 20 10 20 e duc 10 0 0 12/10/2010 5 10 15 10 20 30 40 39 13 12/10/2010 regress ceb age agefbrth educ estimates store original Source | SS df MS -------------+-----------------------------Model | 9805.3274 3 3268.44247 Residual | 6809.6998 3269 2.08311404 -------------+-----------------------------Total | 16615.0272 3272 5.0779423 Number of obs = F( 3, 3269) Prob > F R-squared Adj R-squared Root MSE 3273 = 1569.02 = 0.0000 = 0.5901 = 0.5898 = 1.4433 -----------------------------------------------------------------------------ceb | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------age | .2108335 .0035151 59.98 0.000 .2039414 .2177255 agefbrth | -.2372357 .0088494 -26.81 0.000 -.2545867 -.2198847 educ | -.0729918 .0066071 -11.05 0.000 -.0859462 -.0600374 _cons | 1.824042 .1671298 10.91 0.000 1.496352 2.151732 ------------------------------------------------------------------------------ 12/10/2010 40 -10 -5 Residuals 0 5 rvfplot 0 2 4 6 8 10 Fitted values 12/10/2010 41 rvpplot agefbrth -10 -10 -5 -5 Residuals Residuals 0 0 5 5 rvpplot age 10 12/10/2010 20 30 age 40 50 10 20 30 40 agefbrth 42 14 12/10/2010 predict resid, resid gen resid2= resid^2 sc resid2 agefbrth 0 0 10 10 20 20 r e s id 2 resid2 30 30 40 40 50 50 sc resid2 age 10 20 30 age 40 50 12/10/2010 10 20 30 40 agefbrth 43 Prueba Goldfeld-Quandt sort agefbrth gen m=. replace m=1 in 1/1452 replace m=2 in 1820/3273 regress ceb age agefbrth educ if m==1 scalar scrm1=e(rss) scalar df1=e(df_r) Source | SS df MS -------------+-----------------------------Model | 4611.97745 3 1537.32582 Residual | 3098.72434 1448 2.140003 -------------+-----------------------------Total | 7710.70179 1451 5.3140605 Number of obs F( 3, 1448) Prob > F R-squared Adj R-squared Root MSE = = = = = = 1452 718.38 0.0000 0.5981 0.5973 1.4629 -----------------------------------------------------------------------------ceb | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------age | .2123868 .0053677 39.57 0.000 .2018575 .2229161 agefbrth | -.1071605 .0297124 -3.61 0.000 -.1654445 -.0488765 educ | -.0940836 .0113811 -8.27 0.000 -.1164087 -.0717585 _cons | -.3348579 .5045349 -0.66 0.507 -1.324555 .6548397 12/10/2010 44 ------------------------------------------------------------------------------ Prueba Goldfeld-Quandt regress ceb age agefbrth educ if m==2 scalar scrm2=e(rss) scalar df2=e(df_r) scalar F= ((scrm2/df2)/(scrm1/df1)) display F Source | SS df MS -------------+-----------------------------Model | 3939.75191 3 1313.25064 Residual | 2814.2646 1450 1.94087214 -------------+-----------------------------Total | 6754.01651 1453 4.64832519 Number of obs F( 3, 1450) Prob > F R-squared Adj R-squared Root MSE = = = = = = 1454 676.63 0.0000 0.5833 0.5825 1.3932 -----------------------------------------------------------------------------ceb | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------age | .2060849 .0051318 40.16 0.000 .1960182 .2161515 agefbrth | -.2807764 .0141002 -19.91 0.000 -.3084354 -.2531173 educ | -.0602906 .0085651 -7.04 0.000 -.0770919 -.0434892 _cons | 2.851509 .3012148 9.47 0.000 2.260645 3.442372 ------------------------------------------------------------------------------ 12/10/2010 45 15 12/10/2010 Prueba Goldfeld-Quandt describe sort agefbrth dis dis dis dis dis dis dis 3273*.25 3273*.25 =368.25 367/2 =183.5 (3273+1)/2 =1637 1637-184 =1453 1637+184 =1821 1821-1453 =368 drop in 1452/1820 12/10/2010 46 hettest age agefbrth Breusch-Pagan / Cook-Weisberg test for heteroskedasticity Ho: Constant variance Variables: age agefbrth chi2(2) = 1613.76 Prob > chi2 = 0.0000 hettest Breusch-Pagan / Cook-Weisberg test for heteroskedasticity Ho: Constant variance Variables: fitted values of ceb chi2(1) = 1633.15 Prob > chi2 = 0.0000 12/10/2010 47 imtest, white White's test for Ho: homoskedasticity against Ha: unrestricted heteroskedasticity chi2(9) Prob > chi2 = = 850.98 0.0000 Cameron & Trivedi's decomposition of IM-test --------------------------------------------------Source | chi2 df p ---------------------+----------------------------Heteroskedasticity | 850.98 9 0.0000 Skewness | 56.38 3 0.0000 Kurtosis | 69.03 1 0.0000 ---------------------+----------------------------Total | 976.38 13 0.0000 --------------------------------------------------- 12/10/2010 48 16 12/10/2010 regress ceb age agefbrth educ,robust estimates store robustos Linear regression Number of obs F( 3, 3269) Prob > F R-squared Root MSE = = = = = 3273 837.36 0.0000 0.5901 1.4433 -----------------------------------------------------------------------------| Robust ceb | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------age | .2108335 .0046423 45.42 0.000 .2017314 .2199355 agefbrth | -.2372357 .00958 -24.76 0.000 -.2560191 -.2184523 educ | -.0729918 .006377 -11.45 0.000 -.0854952 -.0604885 _cons | 1.824042 .1615009 11.29 0.000 1.507389 2.140695 ------------------------------------------------------------------------------ 12/10/2010 49 estimates table original b(%9.4f) se(%5.3f) t(%5.2f) robustos, -------------------------------------Variable | original robustos -------------+-----------------------age | 0.2108 0.2108 | 0.004 0.005 | 59.98 45.42 agefbrth | -0.2372 -0.2372 | 0.009 0.010 | -26.81 -24.76 educ | -0.0730 -0.0730 | 0.007 0.006 | -11.05 -11.45 _cons | 1.8240 1.8240 | 0.167 0.162 | 10.91 11.29 -------------------------------------12/10/2010 50 Soluciones al problema de heteroscedasticidad Cuando de presenta una estructura de errores heteroscedastica se puede proceder por alguna de las siguientes rutas: a) Emplear una transformación de Y del tipo Box-Cox; b) Aplicar mínimos cuadrados ponderados; c) Corregir los errores estándar por heteroscedasticidad. 12/10/2010 51 17 12/10/2010 Transformaciones Box-Cox Box y Cox (1964) propusieron realizar la transformación paramétrica Yλ sobre la variable de respuesta Y de manera tal que Yλ cumpliera con los supuestos del modelo de regresión lineal (corrige asimetría, no linealidad y heteroscedasticidad). Las transformaciones consideradas por los autores forman parte de la familia de las transformaciones potencia y raíz. Su propuesta original fue y λ −1 12/10/2010 y (λ ) = λ , ln y , si λ≠0 si λ=0 52 El valor de λ se estima a partir de los datos. Kutner et. al. (2005) señalan que puede emplearse simplemente la transformación y iλ = β 1 + β 2 x i + u i La forma de determinar el valor de λ considera: i. el método de máxima verosimilitud, el cual además de estimar a λ también estima β1, β2 y σ2; ii. un proceso de búsqueda numérica mediante el cual se minimice a la SCE. 12/10/2010 53 Respecto al procedimiento de busca numérica, Kutner et. al (2005: 135) apuntan que cada valor de λ las observaciones yiλ deben ser estandarizadas a fin de que la SCE no dependa del valor de λ, donde wi = K 1 ( y1λ − 1), K 2 (ln y i ), si λ≠0 …(A) si λ=0 donde n K 2 = ∏ y i i =1 K1 = 12/10/2010 1 λ K 2λ −1 1/ n 54 18 12/10/2010 Ejemplo Considerando los datos de la tabla 3.9 de Kutner et.al. (2005) en la cual se presentan los datos de 25 niños sanos respecto a su edad (X) y su nivel de plasma poliamina (Y), moléculas que afectan los aspectos del desarrollo, crecimiento, senescencia y respuesta al estrés, se pide encontrar el valor de λ más adecuado para transformar a la variable Y. Empleando (A) se obtienen para los valores λ= 1, .9, .7, .5, .3, .1, 0, -.1, -.3, -.4, .5. -.6, -.7, -.9 y 1.0 siguientes: 12/10/2010 55 k1 1.0000 1.3765 2.7163 5.8365 14.9298 68.7428 --105.5061 -53.9767 -50.1526 -49.7059 -51.3159 -54.4917 -65.0484 -72.5278 lambda 1.0 0.9 0.7 0.5 0.3 0.1 0.0 -0.1 -0.3 -0.4 -0.5 -0.6 -0.7 -0.9 -1.0 k2 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 8.5163 12/10/2010 56 child age y 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 0 0 0 0 0 1 1 1 1 1 2 2 2 2 2 3 3 3 3 3 4 4 4 4 4 13.44 12.84 11.91 20.09 15.60 10.11 11.38 10.28 8.96 8.59 9.83 9.00 8.65 7.85 8.88 7.94 6.01 5.14 6.90 6.77 4.86 5.10 5.67 5.75 6.23 SCE 12/10/2010 1 w1 12.4400 11.8400 10.9100 19.0900 14.6000 9.1100 10.3800 9.2800 7.9600 7.5900 8.8300 8.0000 7.6500 6.8500 7.8800 6.9400 5.0100 4.1400 5.9000 5.7700 3.8600 4.1000 4.6700 4.7500 5.2300 77.9831 0.9 w2 12.8908 12.3162 11.4203 19.1098 14.9388 9.6658 10.9067 9.8327 8.5286 8.1597 9.3901 8.5684 8.2196 7.4171 8.4490 7.5077 5.5381 4.6304 6.4532 6.3203 4.3350 4.5883 5.1850 5.2683 5.7655 70.3505 0.7 w3 14.0276 13.5008 12.6694 19.4689 15.8688 11.0021 12.1868 11.1632 9.8902 9.5235 10.7350 9.9295 9.5832 8.7755 9.8113 8.8675 6.8158 5.8275 7.7833 7.6444 5.4990 5.7809 6.4351 6.5253 7.0588 57.8369 Valor de λ 0.5 w4 15.5606 15.0775 14.3059 20.3240 17.2160 12.7215 13.8526 12.8768 11.6341 11.2696 12.4627 11.6731 11.3293 10.5162 11.5560 10.6097 8.4719 7.3958 9.4948 9.3497 7.0304 7.3442 8.0613 8.1590 8.7315 48.3707 0.3 w5 17.6220 17.1790 16.4629 21.7941 19.1104 14.9570 16.0371 15.1069 13.8937 13.5314 14.7063 13.9323 13.5909 12.7725 13.8163 12.8674 10.6394 9.4676 11.7209 11.5693 9.0610 9.4105 10.1966 10.3024 10.9167 41.3634 0.1 w6 20.3961 19.9899 19.3252 24.0523 21.7345 17.8940 18.9253 18.0386 16.8541 16.4939 17.6510 16.8922 16.5532 15.7295 16.7774 15.8258 13.5032 12.2271 14.6468 14.4884 11.7748 12.1638 13.0256 13.1402 13.7994 36.3689 0 w7 22.1274138 21.7384729 21.0981568 25.5508639 23.396649 19.7027286 20.7104856 19.8447402 18.6743416 18.3151955 19.4635383 18.7122762 18.3744741 17.5480007 18.5979615 17.6450846 15.2733861 13.9416743 16.449462 16.2874788 13.4646355 13.8751402 14.7774326 14.8967526 15.5795614 34.5195 57 19 12/10/2010 reg w1 age Source | SS df MS -------------+-----------------------------Model | 238.0562 1 238.0562 Residual | 77.9830686 23 3.3905682 -------------+-----------------------------Total | 316.039268 24 13.1683028 reg Number of obs F( 1, 23) Prob > F R-squared Adj R-squared Root MSE = = = = = = 25 70.21 0.0000 0.7532 0.7425 1.8413 Number of obs F( 1, 23) Prob > F R-squared Adj R-squared = = = = = 25 75.86 0.0000 0.7673 0.7572 Number of obs F( 1, 23) Prob > F R-squared Adj R-squared Root MSE = = = = = = 25 88.19 0.0000 0.7931 0.7841 1.5858 Number of obs F( 1, 23) Prob > F R-squared Adj R-squared Root MSE = = = = = = 25 101.57 0.0000 0.8154 0.8073 1.4502 w2 age Source | SS df MS -------------+-----------------------------Model | 232.034312 1 232.034312 Residual | 70.3505047 23 3.0587176 -------------+-----------------------------reg w3 age Source | SS df MS -------------+-----------------------------Model | 221.762335 1 221.762335 Residual | 57.8368633 23 2.51464623 -------------+-----------------------------Total | 279.599198 24 11.6499666 reg w4 age Source | SS df MS -------------+-----------------------------Model | 213.615737 1 213.615737 Residual | 48.3707214 23 2.10307484 -------------+-----------------------------Total | 261.986458 24 10.9161024 12/10/2010 58 -0.1 w8 24.1411 23.7686 23.1518 27.3470 25.3447 21.7913 22.7760 21.9307 20.7742 20.4161 21.5558 20.8120 20.4754 19.6461 20.6982 19.7440 17.3220 15.9322 18.5314 18.3659 15.4291 15.8622 16.8070 16.9312 17.6385 33.0559 -0.3 w9 29.2204 28.8788 28.3063 32.0329 30.3029 27.0129 27.9533 27.1475 26.0182 25.6622 26.7848 26.0555 25.7213 24.8866 25.9429 24.9859 22.4598 20.9460 23.7388 23.5658 20.3863 20.8685 21.9043 22.0388 22.7979 31.1768 -0.4 w10 32.4134 32.0863 31.5348 35.0482 33.4400 30.2736 31.1926 30.4058 29.2899 28.9350 30.0491 29.3270 28.9940 28.1565 29.2149 28.2566 25.6764 24.0966 26.9918 26.8149 23.5062 24.0150 25.0995 25.2396 26.0259 30.7182 Valor de l -0.5 -0.6 w11 w12 36.1475 35.8344 35.3030 38.6163 37.1211 34.0733 34.9714 34.2031 33.1003 32.7465 33.8522 33.1373 32.8054 31.9651 33.0257 32.0660 29.4305 27.7816 30.7832 30.6024 27.1589 27.6958 28.8314 28.9771 29.7917 30.5595 40.5212 40.2213 39.7093 42.8346 41.4446 38.5103 39.3880 38.6378 37.5480 37.1952 38.2927 37.5848 37.2541 36.4110 37.4738 36.5126 33.8204 32.0994 35.2116 35.0268 31.4426 32.0091 33.1983 33.3499 34.1937 30.6875 -0.7 w13 45.6518 45.3646 44.8714 47.8199 46.5275 43.7021 44.5599 43.8274 42.7505 42.3987 43.4879 42.7870 42.4575 41.6116 42.6765 41.7139 38.9636 37.1674 40.3944 40.2055 36.4746 37.0724 38.3175 38.4754 39.3495 31.0902 -0.9 w14 -1 w15 58.7725 67.1314 58.5091 66.8792 58.0513 66.4381 60.6777 68.9176 59.5603 67.8786 56.9395 65.3539 57.7587 66.1545 57.0603 65.4725 56.0086 64.4332 55.6589 64.0845 56.7319 65.1496 56.0448 64.4691 55.7175 64.1431 54.8659 63.2886 55.9353 64.3602 54.9698 63.3933 52.0990 60.4599 50.1421 58.4173 53.6124 62.0165 53.4150 61.8147 49.3714 57.6044 50.0369 58.3066 51.4022 59.7363 51.5732 59.9142 52.5113 60.8861 32.7042 33.9088872 59 30 40 50 SCE 60 70 80 12/10/2010 -1 12/10/2010 -.5 0 lambda .5 1 60 20 12/10/2010 Transformaciones Box-Cox en Stata λ yi Stata tiene incluida la rutina para encontrar el valor de y utilizando el método de máxima versosimitud. boxcox y age Number of obs LR chi2(1) Prob > chi2 Log likelihood = -37.983365 = = = 25 50.33 0.000 -----------------------------------------------------------------------------y | Coef. Std. Err. z P>|z| [95% Conf. Interval] -------------+---------------------------------------------------------------/theta | -.5049226 .2926884 -1.73 0.085 -1.078581 .068736 -----------------------------------------------------------------------------Estimates of scale-variant parameters ---------------------------| Coef. -------------+-------------Notrans | age | -.0792865 _cons | 1.456585 -------------+-------------/sigma | .0440194 -----------------------------------------------------------------------------------Test Restricted LR statistic P-value H0: log likelihood chi2 Prob > chi2 --------------------------------------------------------theta = -1 -39.283475 2.60 0.107 theta = 0 -39.506554 3.05 0.081 theta = 1 -49.693662 23.42 0.000 --------------------------------------------------------- 12/10/2010 61 Transformación de las variables del modelo Con el fin de encontrar un estimador con mayor precisión que el ofrecido por MCO bajo heteroscedasticidad, la idea es encontrar una transformación adecuada para ui, de manera tal que cumpla con el supuesto de homocedasticidad. Una posibilidad es multiplicar a ui por xi-1/2, para entonces u Var 1i/ 2 x i 1 = Var (ui ) = 1 σ 2 xi = σ 2 x xi i el cual es homoscedastico. 12/10/2010 62 Mínimos Cuadrados Generalizados (MCG) Si el supuesto de homoscedasticidad no se cumple entonces se tiene E (uu' ) = σ 2 Ω donde Ω es una matriz simétrica nxn que depende de X pero es diferente de I. Bajo heteroscedasticidad se tiene ω1 0 2 σ Ω = Σu = . 0 12/10/2010 0 ... ω2 ... . . 0 ... . 0 0 . ω n 63 21 12/10/2010 Dado que la varianzas dependen de los valores de X (heteroscedastidad condicional), se puede reescribir a Σu como: σ2x1 0 2 0 σ x2 E(uu') = Σu = . . 0 0 0 x1 0 ... 0 0 x ... 0 ... 0 2 2 2 . . =σ . . . . =σ V . . . . 2 0 0 ... xn ... σ xn ... Se puede encontrar a una matriz P, llamada matriz de transformación, tal que al modificar al vector u de forma u * = Pu 12/10/2010 64 ofrezca una matriz de var-cov del vector de errores transformado homoscedastica Var (u* ) = E (u*u * ' ) = σ 2 I La matriz de transformación P es de dimensión nxn. La forma precisa que toma P depende de los elementos de la matriz Σu. Es posible considerar multiplicar todo el modelo por la matriz P 12/10/2010 65 El modelo bajo MCG Sea Py = PXβ + Pu y * = X*β + u* βˆ = (X* ' X* ) −1 X* ' Y* son MELI ¿Cómo encontrar a P? Si σi2 fueran conocidas la corrección sería directa, ya que se puede considerar para encontrar a P Lo más realista es que σi2 sean desconocidas. Afortunadamente existen algunos supuestos razonables para establecer el patrón de heteroscedasticidad los cuales pueden surgir del examen gráfico. 12/10/2010 66 22 12/10/2010 Patrones de heteroscedasticidad Uno de los patrones más comunes es que la varianza del error sea proporcional a Xi2, esto es E (u 2i ) = σ 2 X i La transformación a considerar es dividir a todas las observaciones sobre X i1 / 2 . Así, x1−1/ 2 0 −1/ 2 0 x2 P= . . 0 0 12/10/2010 ... ... . . ... 0 0 . . xn−1/ 2 67 Bajo este patrón, las variables transformadas serán x1−1/ 2 0 −1/ 2 0 x2 y* = . . 0 0 x1−1/2 0 −1/2 0 x2 X* = . . 0 0 0 0 0 0 . . ... 1 1 . . ⋅. . . . ... xn−1/2 1 ... ... y1 y1 / x11/ 2 1/ 2 y2 y2 / x1 ⋅ . = . . . −1/ 2 1/ 2 y xn n yn / x1 ... ... . . x11 ... xk1 x1−1/2 x111/2 x12 ... xk2 x−21/2 x112/2 . . . = . . . . . . . x1n ... xkn xn−1/2 x11n/2 12/10/2010 ... xk1 / x111/2 ... x2 / x112/2 . . . . 1/2 ... xkn / x1n 68 El vector de errores transformados u1 / x11/ 2 1/ 2 u2 / x1 * u = . . u / x1/ 2 n 1 P esta dado por x1−1/2 0 −1/ 2 0 x2 P= . . 0 0 12/10/2010 ... 0 ... 0 . . ⋅ . . ... xn−1/2 69 23 12/10/2010 Así, Py = PXβ + Pu y * = X*β + u* βˆ = (X* ' X* ) −1 X* ' Y* βˆ = (X' P' PX) −1 X' P' PY donde x1−1 0 −1 0 x2 P'P = . . 0 0 ... ... . . ... 0 x1 0 0 . = . . xn−1 0 0 x2 . 0 12/10/2010 −1 0 0 −1 . . =V . . ... xn ... ... 70 Míminos cuadrados ponderados en Stata Considerando los datos que se muestran a continuación sobre los gastos en comida e ingreso de 40 hogares así como el modelo: comidai = β1 + β 2ingresoi + ui a. Presente el diagrama de dispersión correspondiente; b. Estime el modelo señalado; c. Identifique si el modelo cumple con el supuesto de homoscedasticidad; d. De no cumplir con lo apuntado en (c) corrija mediante MCP: 12/10/2010 71 Datos sobre gastos en comida e ingreso de 40 hogares. ID 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 12/10/2010 COMIDA 9.46 10.56 14.81 21.71 22.79 18.19 22.00 18.12 23.13 19.00 19.46 17.83 32.81 22.13 23.46 16.81 21.35 14.87 33.00 25.19 INGRESO 25.83 34.31 42.50 46.75 48.29 48.77 49.65 51.94 54.33 54.87 56.46 58.83 59.13 60.73 61.12 63.10 65.96 66.40 70.42 70.48 ID 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 COMIDA 17.77 22.44 22.87 26.52 21.00 37.52 21.69 27.40 30.69 19.56 30.58 41.12 15.38 17.87 25.54 39.00 20.44 30.10 20.90 48.71 INGRESO 71.98 72.00 72.23 72.23 73.44 74.25 74.77 76.33 81.02 81.85 82.56 83.33 83.40 91.81 91.81 92.96 95.17 101.40 114.13 115.46 72 24 12/10/2010 10 20 COMIDA 30 40 50 Diagrama de dispersión entre los gastos en comida e ingreso 20 40 60 80 100 120 INGRESO 12/10/2010 73 regress comida ingreso Source | SS df MS -------------+-----------------------------Model | 826.635228 1 826.635228 Residual | 1780.4125 38 46.8529606 -------------+-----------------------------Total | 2607.04773 39 66.8473777 Number of obs F( 1, 38) Prob > F R-squared Adj R-squared Root MSE = = = = = = 40 17.64 0.0002 0.3171 0.2991 6.8449 -----------------------------------------------------------------------------comida | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------ingreso | .2322533 .0552934 4.20 0.000 .1203176 .344189 _cons | 7.383217 4.008356 1.84 0.073 -.7312761 15.49771 -----------------------------------------------------------------------------12/10/2010 74 -20 -10 Residuals 0 10 20 rvfplot 15 12/10/2010 20 25 F itted values 30 35 75 25 12/10/2010 -20 -10 Residuals 0 10 20 rvpplot ingreso 20 40 60 80 100 120 INGRESO 12/10/2010 76 whitetst White's general test statistic : 14.58151 Chi-sq( 2) P-value = 6.8e-04 hettest Breusch-Pagan / Cook-Weisberg test for heteroskedasticity Ho: Constant variance Variables: fitted values of comida chi2(1) = Prob > chi2 = 11.28 0.0008 12/10/2010 regress 77 comida ingreso [aweight=1/ ingreso] Source | SS df MS -------------+-----------------------------Model | 1027.51018 1 1027.51018 Residual | 1432.39609 38 37.6946339 -------------+-----------------------------Total | 2459.90627 39 63.0745196 Number of obs = F( 1, 38) Prob > F R-squared Adj R-squared Root MSE = = = = = 40 27.26 0.0000 0.4177 0.4024 6.1396 -----------------------------------------------------------------------------comida | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------ingreso | .2551922 .0488781 5.22 0.000 .1562437 .3541407 _cons | 5.782084 3.256587 1.78 0.084 -.8105315 12.3747 ------------------------------------------------------------------------------ 12/10/2010 78 26 12/10/2010 Errores estándar corregidos por heteroscedasticidad Si los errores son heteroscedasticos condicionalmente, es psoible aplicar un enfoque robusto. Hubber (1967) y White (1980) propusieron el estimador “sandwich” de la varianza de los errores, el cual corrige la hetersoscedasticidad. Se ha señalado que bajo heteroscedasticidad [ Var[βˆ ] = E (X'X)−1 X' E(uu')X(X'X)−1 [ Var[βˆ ] = E (X'X)−1 X'Σu X(X'X)−1 12/10/2010 79 ] ] Ejemplo Para los datos de gastos en comida e ingreso se obtienen los errores estándar corregidos de acuerdo al estimador de Hubber y White. En Stata se tiene regress comida ingreso, robust Linear regression Number of obs = F( 1, 38) = Prob > F = R-squared = Root MSE = 40 10.73 0.0023 0.3171 6.8449 -----------------------------------------------------------------------------| Robust comida | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------ingreso | .2322533 .0709056 3.28 0.002 .0887125 .3757942 _cons | 7.383217 4.403557 1.68 0.102 -1.531318 16.29775 ------------------------------------------------------------------------------ 12/10/2010 80 0 .1 Density .2 .3 .4 histogram resid, normal -10 -5 0 5 Residuals 12/10/2010 81 27 12/10/2010 Prueba Jarque_Bera sum resid, detail scalar nobs=r(N) scalar s=r(skewness) scalar k=r(kurtosis) scalar JB=(nobs/6)*(s^2+((k-3)^2)/4) scalar chi2_95=invchi2(2,.95) scalar pval=1-chi2(2,JB) di JB di chi2_95 di pval JB= 657.94501 chi2_95= 5.9914645 pvalue=0 12/10/2010 82 Prueba SK sktest resid Skewness/Kurtosis tests for Normality ------- joint -----Variable | Obs Pr(Skewness) Pr(Kurtosis) adj chi2(2) Prob>chi2 -------------+--------------------------------------------------------------resid | 3.3e+03 0.0000 0.0000 . 0.0000 12/10/2010 83 28

Anuncio

Descargar

Anuncio

Añadir este documento a la recogida (s)

Puede agregar este documento a su colección de estudio (s)

Iniciar sesión Disponible sólo para usuarios autorizadosAñadir a este documento guardado

Puede agregar este documento a su lista guardada

Iniciar sesión Disponible sólo para usuarios autorizados