PROBABILIDAD Y ESTADÍSTICA Sesión 3 3 MODELOS

Anuncio

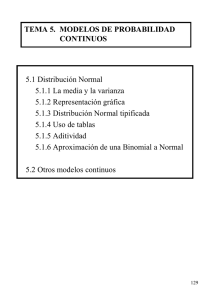

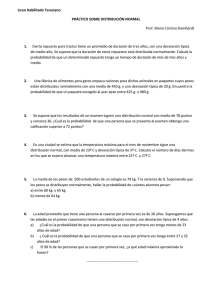

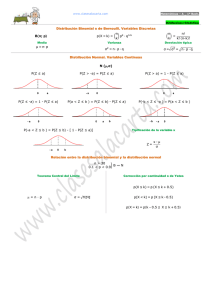

PROBABILIDAD Y ESTADÍSTICA Sesión 3 3 MODELOS ANALÍTICOS DE FENÓMENOS ALEATORIOS CONTINUOS 3.1 Definición de variable aleatoria continua 3.2 Función de densidad y acumulatíva 3.3 Valor esperado, varianza y desviación estándar 3.4 Distribución uniforme y exponencial 3.5 Distribución normal 3.6 Aproximación de la binomial a la normal 3.7 Teorema de Chebyshev Objetivo: Comprender la diferencia entre valor esperado, varianza y desviación estándar. Poner en práctica el teorema de Chebyshev 3 MODELOS ANALÍTICOS DE FENÓMENOS ALEATORIOS CONTINUOS 3.1 Definición de variable aleatoria continua Frecuentemente el resultado de un experimento aleatorio se denota con un número: el resultado de lanzar un dado, el número de unidades defectuosas entre 10 unidades seleccionadas, el tiempo que hay que esperar para que se presente una falla en un circuito, el número de estaciones de una red de computadoras que requieren la atención del servidor de la red en un momento dado, el número de personas en una comunidad que requieren atención médica en un día especificado, el peso sumado de las personas que están en un elevador en un momento determinado del día, la cantidad en dinero de lo transportado en un camión antes de que sufra una descompostura, etc. A un número tal, le llamamos variable aleatoria. Ponga atención al hecho de que una variable aleatoria no es una variable en el sentido usual. Las variables que estamos acostumbrados a manejar son, por ejemplo: el peso de un cohete que va quemando el combustible que lo impulsa, la distancia del piso a un objeto que cae hacia él, la concentración de una solución dentro de un tanque conforme pasa el tiempo, etc. En los ejemplos anteriores el valor de la variable puede cambiar con el tiempo, pero es predecible a partir de las leyes de la mecánica, la química, la hidráulica o alguna otra ciencia. Con una variable aleatoria la situación es enteramente diferente. El valor de una variable aleatoria no se puede conocer con exactitud de antemano a la realización del experimento. ¿Qué otros ejemplos de variables aleatorias se le ocurren además de los mencionados arriba? Al contestar esta pregunta tenga en cuenta que el azar debe jugar algún papel en la medición de la variable y que su valor no debe ser predecible. Una variable aleatoria presenta dos características importantes: 1. Una colección (conjunto) de valores posibles al que llamamos imagen de la variable aleatoria (antes lo llamábamos espacio muestral). 2. Una probabilidad asociada a los posibles resultados la cual queda expresada mediante una función de probabilidad. Las variables aleatorias cuyos valores posibles se encuentran en cualquier parte de un intervalo, se llaman CONTINUAS. Estas variables son el resultado de medir. Variable aleatoria continua. Es aquella que puede tomar infinitos valores dentro de un intervalo de la recta real. Por ejemplo, la duración de las bombillas de una determinada marca y modelo. En el caso de variables aleatorias continuas no tiene sentido plantearse probabilidades de resultados aislados, por ejemplo, probabilidad de que una bombilla dure 100 horas, 22 minutos y 16 segundos. La probabilidad sería 0. El interés de estas probabilidades está en conocer la probabilidad correspondiente a un intervalo. Dicha probabilidad se conoce mediante una curva llamada función de densidad y suponiendo que bajo dicha curva hay un área de una unidad. Conociendo esta curva, basta calcular el área correspondiente para conocer la probabilidad de un intervalo cualquiera. La función de densidad de una v.a. continua cumple las siguientes condiciones: Sólo puede tomar valores comprendidos entre 0 y 1: 0 f ( x) 1 El área encerrada bajo la curva es igual a la unidad: f ( x).dx 1 . Ejercicio: Sea f ( x) x con x 0,6. Comprueba que es una función de densidad y calcula p(2 x 5) 18 Solución: Para que sea función de densidad x dx tiene que valer 1. Veamos: 0 18 6 6 x 1 x2 1 36 dx 0 18 18 2 18 2 0 1 0 6 5 x 1 x2 1 25 4 21 7 p(2 x 5) dx 2 18 18 2 2 18 2 2 36 12 5 3.2 Función de densidad y acumulatíva Como en el caso de la v.a. discreta, la función de distribución proporciona la probabilidad acumulada hasta un determinado valor de la variable, es decir, F(x) = p(X £ x) . Cumple las siguientes condiciones: Su valor es cero para todos los puntos situados a la izquierda del menor valor de la variable. Su valor es 1 para todos los puntos situados a la derecha del mayor valor de la variable. 3.3 Valor esperado, varianza y desviación estándar Existe cierta correspondencia entre la variable aleatoria discreta y la continua: Variable aleatoria discreta Variable aleatoria continua xi . p i x. f ( x).dx 2 xi2 pi 2 2 x 2 f ( x)dx 2 Lo que es Ejercicio 1. b a pasa a ser b a y lo que es p i pasa a ser f (x) La función de densidad de una v.a. continua viene definida por : 2 x si 0 x 1 f ( x) 0 en el resto a) Halla la función de distribución. b) Calcula la media y la varianza. Solución: a) La función de distribución se obtiene integrando la función de densidad, es decir, A la izquierda de 0, su valor 0. A la derecha de 1, su valor es 1 Entre 0 y 1: F ( x) p( X x) x 0 2 xdx x 2 x 0 x2 0 si x 0 es decir, F ( x) x 2 si 0 x 1 1 para x 1 b) Cálculo de la media: b a 1 x. f ( x).dx x.2 x.dx 0 Cálculo de la varianza: 2 b a 2 3 1 x 2 f ( x)dx 2 x 2 .2 x.dx 0 4 1 9 18 Ejercicio 2. Calcula la media, la varianza y la desviación típica de una v.a. que tiene como función de densidad: f ( x) x3 con x 1,5 24 Solución: 5 Media: b a x. f ( x).dx Varianza: 2 b a x3 1 5 2 1 x 3 3x 2 29 x. dx ( x 3x)dx 1 24 24 24 3 2 1 9 x f ( x)dx 2 2 5 1 x3 1 5 29 29 x dx ( x 3 3x 2 )dx 1 24 24 9 9 2 2 2 5 1 x4 104 29 3 1,28 . x 24 4 81 1 9 2 Desviación típica: 1,28 1,13 Ejercicio 3. x2 1 Sea f ( x) con x 2,5 , una función de densidad. 36 a) Calcula su función de distribución. b) Calcula p(3 x 4) . Solución: a) F ( x) p( X x) x 2 x2 1 1 x 2 1 x3 x 3 3x 2 dx ( x 1 ) dx ( x ) 3 36 36 2 36 108 2 x Su valor es cero para todos los puntos situados a la izquierda de 2 Su valor es 1 para todos los puntos situados a la derecha de 5 4 b) p(3 x 4) 4 3 x2 1 1 4 2 1 x3 1 x 3 3x 17 dx ( x 1 ) dx x 36 36 3 36 3 3 3 54 3 36 4 3.4 Distribución uniforme y exponencial Es un caso particular de la distribución gamma cuando α = 1. Su función de densidad es: Su parámetro es β. La media y la varianza de la distribución exponencial son: 3.5 Distribución normal La distribución normal fue definida por De Moivre en 1733 y es la distribución de mayor importancia en el campo de la estadística. Una variable es normal cuando se ajusta a la ley de los grandes números, es decir, cuando sus valores son el resultado de medir reiteradamente una magnitud sobre la que influyen infinitas causas de efecto infinitesimal. Las variables normales tienen una función de densidad con forma de campana a la que se llama campana de Gauss. Su función de densidad es la siguiente: Los parámetros de la distribución son la media y la desviación típica, μ y σ, respectivamente. Como consecuencia, en una variable normal, media y desviación típica no deben estar correlacionadas en ningún caso (como desgraciadamente ocurre en la inmensa mayoría de las variables aleatorias reales que se asemejan a la normal. La curva normal cumple las siguientes propiedades: 1) El máximo de la curva coincide con la media. 2) Es perfectamente simétrica respecto a la media (g1 = 0). 3) La curva tiene dos puntos de inflexión situados a una desviación típica de la media. Es convexa entre ambos puntos de inflexión y cóncava en ambas colas. 4) Sus colas son asintóticas al eje X. Para calcular probabilidades en intervalos de valores de la variable, habría que integrar la función de densidad entre los extremos del intervalo. por desgracia (o por suerte), la función de densidad normal no tiene primitiva, es decir, no se puede integrar. Por ello la única solución es referirse a tablas de la función de distribución de la variable (calculadas por integración numérica) Estas tablas tendrían que ser de triple entrada (μ, σ, valor) y el asunto tendría una complejidad enorme. Afortunadamente, cualquier que sea la variable normal, X, se puede establecer una correspondencia de sus valores con los de otra variable con distribución normal, media 0 y varianza 1, a la que se llama variable normal tipificada o Z. La equivalencia entre ambas variables se obtiene mediante la ecuación: La función de distribución de la variable normal tipificada está tabulada y, simplemente, consultando en las tablas se pueden calcular probabilidades en cualquier intervalo que nos interese. De forma análoga a lo pasaba con las variables Poisson, la suma de variables normales independientes es otra normal. Histograma de una normal idealizada Histograma de una muestra de una variable normal 3.6 Aproximación de la binomial a la normal Cuando “n” es grande, la distribución binomial resulta laboriosa y complicada, afortunadamente el matemático Abraham de Moivre (1667 – 1754) demostró que cuando se dan ciertas condiciones, una distribución binomial se puede aproximar a una distribución Normal de media μ = n.p Cuya desviación típica será dada como se muestra a continuación Estudiando las graficas que a continuación presentamos puede verse que a medida que aumenta el valor del parámetro “n” que representa al tamaño muestral, su gráfica se asemeja cada vez más a la gráfica de una distribución normal. Obsérvese la diferencia entre los gráficos de la normal y de la binomial. La distribución Binomial se va desplazando hacia la derecha a medida que aumenta el tamaño muestral. Para evitar esta desviación se realiza el ajuste entre ambas distribuciones restando a la variable la medida y dividiendo por la desviación típica de la distribución Binomial con la que se trabaja. 3.7 Teorema de Chebyshev Recopilado de http://fcasua.contad.unam.mx/apuntes/interiores/docs/2005/informatica/3/1368.pdf http://fcasua.contad.unam.mx/apuntes/interiores/docs/2005/informatica/3/1368.pdf