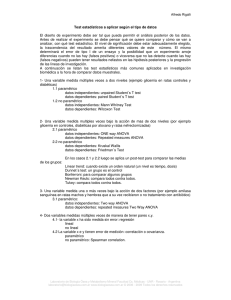

Análisis no paramétrico: el procedimiento Pruebas no paramétricas

Anuncio