Bits y Bytes La arquitectura de una computadora prevé, además de

Anuncio

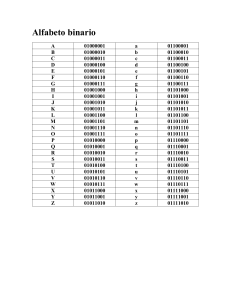

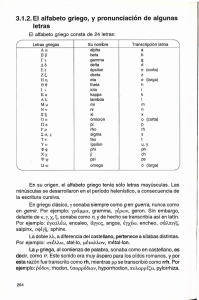

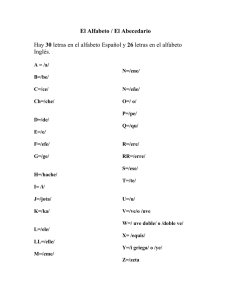

Bits y Bytes La arquitectura de una computadora prevé, además de una CPU y la o las unidades de memoria, una unidad de entrada/salida. A grandes rasgos, ésta se encarga de "traducir" la realidad del "universo exterior", el del usuario, al "universo interior", el de la CPU. El 1ro. está ricamente plagado de variables, eventos, magnitudes, objetos y representaciones que los humanos podemos entender (imágenes visuales, sonidos, movimientos, en fin, lo que nuestra mente reconoce como algo con información). El 2do., el "universo interior", es un gigantezco y aburrido compendio de unos y ceros, uno detrás del otro, capaz de representar con relativa fidelidad aquello que acontece en el "universo exterior" y que es útil a los fines de la ejecución de una aplicación. Cómo puede darse tal "equivalencia" ? Veamos lo siguiente... Nuestras ideas, desde las más exóticas y complejas hasta la más simples; los números, desde el más pequeño al más inmenso; nuestra fórmulas matemáticas, desde las más intrincadas hasta las más triviales; nuestra música, desde la más avanzada hasta la más sencilla, toda esta información, puede representarse mediante símbolos. Cada codificación (que es lo que una escritura en símbolos significa) importa la existencia de un "alfabeto" del que tomar los símbolos para codificar un mensaje. Cada alfabeto y la interpretación que de diferentes agrupamientos de símbolos hemos ido conviniendo y aprendiendo a interpretar a lo largo de nuestra historia son sin duda uno de las manifestaciones más resonantes de nuestra inteligencia, que nos ha permitido crear y transmitir formas culturales de generación en generación. Pero volviendo a los alfabetos, tomemos por ejemplo nuestras ideas. Para ser transmitidas, éstas se plasman, por ejemplo, en oraciones, formadas por palabras, formadas cada una a su vez, por letras, dígitos y símbolos de puntuación tomados todos de un conjunto de unos 200 caracteres. Otro tanto ocurre con los números, formados todos por colecciones de caracteres tomados de entre un alfabeto de 10 dígitos decimales (0 a 9), más algún carácter significativo del punto decimal. Suponga que una cultura dispone de un alfabeto de, digamos, solo 100 símbolos. Cree Ud. que aun así podrá crear y transmitir ideas tal como nosotros lo hacemos con nuestros cerca de 200 símbolos ? Realmente no hay razón para que no pueda hacerlo. La única restricción, posiblemente, vaya a ser que para tener la misma cantidad de palabras que las nuestras, algunas de ellas deban ser más largas, compensando la menor cantidad de símbolos a los efectos de tener la misma variedad de términos. Y si otra cultura dispusiera de un alfabeto de solo 50 símbolos ? Podría igualmente ser creativa y alcanzar la pomposa denominación de "cultura" o de civilización inteligente ? El mismo criterio anterior se aplica. La respuesta es sí pero, sus palabras, posiblemente deban ser aún más largas que las de la 2da. cultura. Y cuál es el límite ? Esto es, podrá llegarse haber "cultura" si el alfabeto tiene un solo símbolo ? Parece más dudoso. En efecto, un solo símbolo no es capaz de conllevar información (si no, haga el intento...). En el fondo, hay posibilidad de contenido de información solo si puede haber alguna variación de símbolos, aunque fuera mínima. Y como la cantidad de símbolos de un alfabeto es necesariamente un número entero, la mínima cantidad de símbolos posibles con capacidad de transmitir información es dos (2). Y es este alfabeto tan económico el que utilizan los sistemas de cómputo tradicionales, el sistema así denominado binario. En la mayor parte de las computadoras físicas estos dos símbolos están representados por dos valores posibles de una magnitud eléctrica. En computadoras aun de laboratorio, por dos valores posibles de una magnitud lumínica y, así, podría pensarse en computadores que utilizaran dos valores posibles de cualquier otro tipo de magnitud física, por ejemplo, computadoras hidráulicas o neumáticas. Las computadoras populares son electrónicas porque los procesos eléctricos son los que hasta ahora han probado tener la mejor relación entre potencia de trabajo (velocidad y volumen) contra costo de fabricación. Haciendo abstracción del evento físico subyacente para representar ambos valores, se caracteriza al alfabeto binario con los símbolos "uno" (1) y "cero" (0). Observe que, como abstracción que son, bien podrían haber sido dos colores, dos sonidos o dos letras. Claro, restringidos a solo dos símbolos, expresar algo mínimamente sencillo en nuestro "universo exterior" demanda del "universo interior" largas cadenas de 1s y 0s. Pero, como los actores de este "universo interior" (CPU + memoria + E/S) son muy, muy rápidos para procesar estas tiras de símbolos, pareciera a nuestros sentidos como si tal "traducción a binario" no existiera. Con 1s. y 0s. se puede representar todo lo que se puede codificar con el rico conjunto de símbolos de nuestra cultura y, cabe anticipar, el de cualquier otra cultura pasada, presente, futura, real o imaginaria. Por ejemplo, tomemos como base nuestro sistema numérico basado en 10 dígitos (0 a 9). En este, con un solo carácter se pueden representar 10 situaciones diferentes (0, 1, 2...9). Si el alfabeto es de solo dos símbolos (por ejemplo, 0 y 1), solo dos situaciones diferentes se pueden concebir para un solo carácter: 0 o 1. Si se desearan representa más de dos situaciones diferentes, digamos, 8, sería entonces necesario utilizar una cadena de tres caracteres binarios. Esto es: 000 - 001 - 010 - 011 - 100 - 101 - 110 - 111 (son 8 formaciones. Solo 8.) Claramente, agrupando de a tres caracteres binarios es inmediata la posibilidad de representar 8 y solo 8 situaciones diferentes. Recuerde que usando el "alfabeto" decimal, bastaría con uno. Y si se requirieran representar 16 ? Pues habría que aumentar la cantidad de caracteres binarios a 4 0000 - 0001 - 0010 - 0011 - 0100 - 0101 - 0110 - 0111 1000 - 1001 - 1010 - 1011 - 1100 - 1101 - 1110 - 1111 En base decimal ahora hubieran sido solo necesarios dos caracteres para las 16 situaciones. En general, una palabra de M caracteres tomados de un alfabeto de N símbolos tiene una capacidad de representación de N^M términos -situaciones- diferentes, y no más. Y los Bytes ? El agrupamiento de bits en tiras de a 8 ha probado tener una significación particular en el terreno informático. Tanto que ha recibido nombre propio: Byte. Un Byte es una cadena de 8 bits, y la significación particular aludida viene a cuento del hecho que, en los idiomas humanos -del "universo exterior"-, en general, basta un alfabeto de alrededor de 200 caracteres para representar a las letras mayúsculas y minúsculas, a los 10 dígitos decimales y a todos los signos de puntuación. Pero tal alfabeto de alrededor de 200 caracteres requiere, en el binario "universo interior" de 8 bits (2^8 = 256). Esta es una de las razones principales de la magia de este valor 8.