- Ninguna Categoria

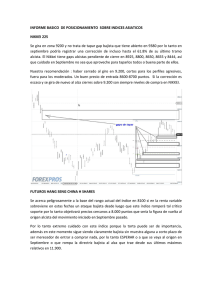

Sistemas de representación de mapas de posicionamiento

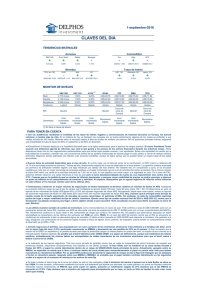

Anuncio