Estadística

Anuncio

08/04/11

Estadística

Análisis de la varianza de un factor

(ANOVA)

Tests a posteriori

Prof, Dr. Jose Jacobo Zubcoff

Departamento de Ciencias del Mar y Biología Aplicada

Estadística

ANOVA

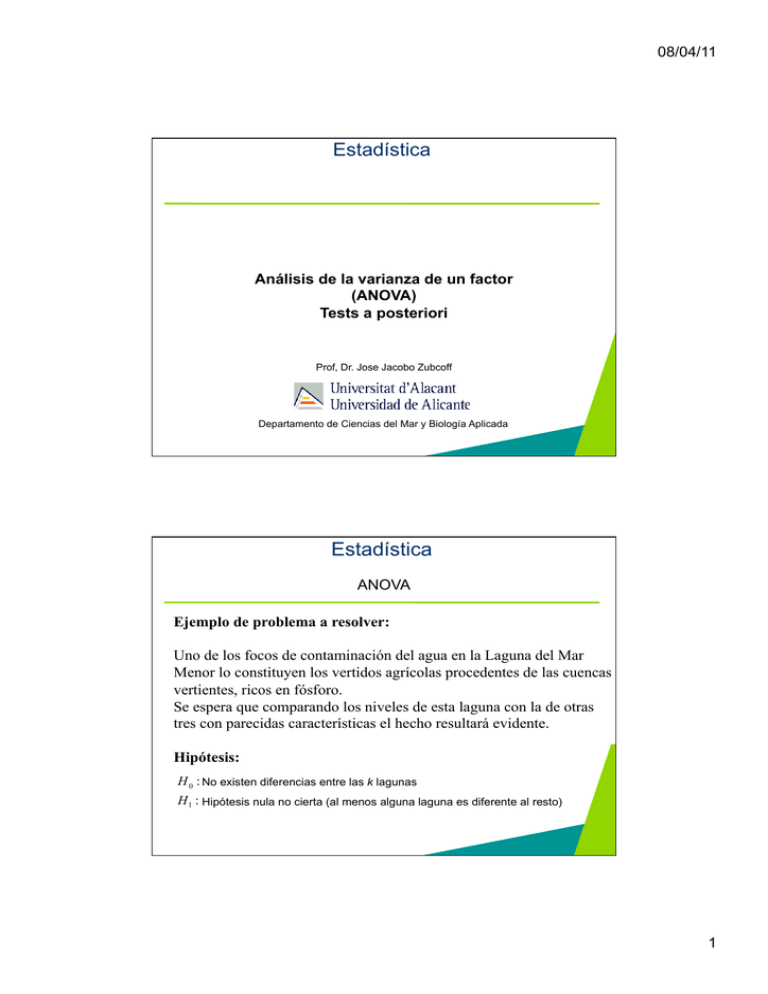

Ejemplo de problema a resolver:

Uno de los focos de contaminación del agua en la Laguna del Mar

Menor lo constituyen los vertidos agrícolas procedentes de las cuencas

vertientes, ricos en fósforo.

Se espera que comparando los niveles de esta laguna con la de otras

tres con parecidas características el hecho resultará evidente.

Hipótesis:

H 0 : No existen diferencias entre las k lagunas

H 1 : Hipótesis nula no cierta (al menos alguna laguna es diferente al resto)

1

08/04/11

Estadística

ANOVA

¿Qué es y para que sirve?

Compara la distribución de una variable continua

normal en dos o más poblaciones

(niveles o categorías)

Pruebas de contraste para dos o más grupos

independientes (ANOVA entre sujetos): un factor

completamente aleatorizado.

Estadística

ANOVA

• En el tema anterior vimos el empleo de la prueba t para

efectuar pruebas de contraste de medias para dos grupos, ya

fueran tales grupos relacionados o no relacionados.

• El problema es que la prueba t se puede emplear únicamente

para el caso de comparar las medias dos grupos. Sin

embargo, en muchos casos queremos comparar

simultáneamente dos o más grupos.

• La solución es el empleo del Análisis de Varianza (ANOVA:

ANalysis Of VAriance). El ANOVA sirve para el caso de dos,

tres, cuatro,..., grupos, ya sean éstos grupos relacionados o

grupos no relacionados.

2

08/04/11

Estadística

ANOVA

H0: No existen diferencias entre los k niveles

H1: La hipótesis nula no es cierta

Hipótesis nula: (todas las medias poblacionales de los “k" grupos son

iguales)

H0: µ1=µ2=µ3...=µa=µ

Hipótesis alternativa: (al menos una media poblacional difiere)

H1: No es cierto H0

• Parte de un conjunto de observaciones muestrales

• K niveles o categorías

Estadística

ANOVA

Supongamos un universo de notas de 9 alumnos

de 3 grupos distintos

Grupo 1 Grupo 2 Grupo 3

No hay diferencia ENTRE grupos

Ni DENTRO de los grupos

5

5

5

5

5

5

5

5

5

Xi,j = µ

3

08/04/11

Estadística

ANOVA

Supongamos que aplicamos un método de enseñanza

(factor) que afecta:

Grupo 1 Grupo 2 Grupo 3

5+1=6

5+2=7

5+0=5

5+1=6

5+2=7

5+0=5

5+1=6

5+2=7 5+0=5

Xi,j = µ + αi

Donde αi = {1,2,0} efecto del factor

El factor influye en establecer diferencias ENTRE grupos

Pero NO DENTRO

Estadística

ANOVA

• Por razones ALEATORIAS algunos alumnos rinden mas

que otros

Grupo 1

Grupo 2

Grupo 3

5+1-1 = 5 5+2+2 = 9 5+0+3 = 8

5+1-2 = 4 5+2+0 = 7 5+0+4 = 9

5+1+0 = 6 5+2+1 = 8 5+0+0 = 5

Xi,j = µ + αi + εi,j

Donde εi,j= {-1,-2,0,2,0,1,3,4,0} efecto aleatoriedad

La ALEATORIEDAD influye en la variabilidad DENTRO de los

grupos

4

08/04/11

ANOVA

Grupo 1

5+1-1 = 5

5+1-2 = 4

5+1+0 = 6

X1.= 5

Grupo 2

5+2+2 = 9

5+2+0 = 7

5+2+1 = 8

X2. = 8

Grupo 3

5+0+3 = 8

5+0+4 = 9

5+0+0 = 5

X3. = 7.33

X = 6.78

..

Calculamos las medias por grupo y la media global

ANOVA

Grupo 1

5

4

6

X1.= 5

Grupo 2

9

7

8

X2. = 8

Grupo 3

8

9

5

X3. = 7.33

X = 6.78

..

Para calcular el efecto aleatorio: diferencias DENTRO

"" (

)

2

k

ni

(

)

2

k

(

)

X ij # X.. = " " X ij # X i. + " n i X i. # X..

i=1 j=1

i=1

2

!

5

08/04/11

ANOVA

Grupo 1

5

4

6

X1.= 5

Grupo 2

9

7

8

X2. = 8

Grupo 3

8

9

5

X3. = 7.33

X = 6.78

..

Para calcular el efecto del factor: diferencias ENTRE

"" ( X

)

2

k

ni

(

)

2

k

(

)

+ " n i X i. # X..

ij # X.. = " " X ij # X i.

i=1 j=1

i=1

2

!

Estadística

ANOVA

Tenemos dos tipos de variabilidad:

– ENTRE grupos (debida al factor)

– DENTRO grupos (debida a la aleatoriedad)

Para poder afirmar que el factor produce efectos:

La variabilidad ENTRE grupos debe ser significativamente

grande respecto a la DENTRO grupos

6

08/04/11

Estadística

ANOVA

µ

ε

Xi,j =

+ αi + i,j

Asumiendo las hipótesis previas:

H0: α1= α2= … = αk

O bien si consideramos

H 0: µ 1= µ 2= … = µ k

Xi,j = µ + αi

Se quiere comprobar la NO INFLUENCIA del factor α

v Todas las muestras proceden de la misma población

Estadística

ANOVA: Análisis de la varianza de un factor:

Modelo lineal:

Xij = µi + eij

eij es función de la varianza de la población:

f(X)

µ

Xij

0

eij

X

f(e)

e = X - µi

7

08/04/11

Estadística

ANOVA

f(X1j)

f(X1j)

µ1

X1j

X1j

µ1 A

1

f(X2j)

f(X2j)

µ2

X2j

f(Xaj)

A2 µ2

X2j

f(Xaj)

µa

Xaj

Xaj

µa Aa

µ

µ

Estadística

Análisis de la varianza de un factor:

Si H0 es falsa è las medias de cada población difieren en un valor Ai

Modelo lineal:

Xij = µ + Ai + eij

La H0 es entonces la siguiente:

H0 = A1 = A2 = … = Ai = … = Aa = 0

H0 = ∑ Ai2 = 0

Se quiere comprobar la INFLUENCIA del factor A

**Todas las muestras proceden de la misma

población

8

08/04/11

Estadística

ANOVA

SCTotal

Q

= SCDentro + SCEntre

=

QD

+

QE

Estimación insesgada de σi2

= Q/(n-1)

Estimación de la variabilidad ENTRE = QE/(k-1)

Estimación de la variabilidad DENTRO = QD/(n-k)

Estimación de la variabilidad TOTAL

Por simplicidad usamos:

Suma de cuadrados DENTRO QD =

Estadística

ANOVA

H0: µ1=

µ2= … = µ

k

H1: Al menos una igualdad no es cierta

• Según la Hipótesis fijada =>

modelo probabilístico

NO se rechaza H0 si:

9

08/04/11

Estadística

Análisis de la varianza de un factor:

Construcción del estadístico de contraste:

MCENTRE / MCDENTRO sigue una distribución F

Solo hay un valor crítico. La variable F es

una t al cuadrado, de ahí que sólo haya

una cola.

Probabilidad p

1

Si el Fcalc > Fcrit para (a-1) y a(n-1) g.l., se rechaza H0:

al menos una de las medias Xi es significativamente diferente de las demás

Estadística

ANOVA

Fuentes de Sumas de cuadrados

variación

QE = ∑ ni ( X i. − X .. )

k–1

i =1

ni

k

F

i =1 j =1

k

∑ (n − 1)S

QE / k − 1 = S

2

E

QE

F=

2

QD = ∑∑ (X ij − X i. ) =

DENTRO

Cuadrados

Medios

2

k

ENTRE

G.L.

n–k

QD / n − k = S D2

n–1

Q / n −1 = S 2

2

i

QD

Signif.

P-valor

k −1

n−k

i =1

k

TOTAL

ni

Q = ∑∑ (X ij − X .. )

i =1 j =1

Si H0 es falsa, MCENTRE > MCDENTRO

è MCENTRE / MCDENTRO > 1

10

08/04/11

Estadística

ANOVA

Hipótesis necesarias para realizar un ANOVA

a) Normalidad de la respuesta en cada nivel

b) Homogeneidad de las varianzas

c) Independencia de los valores obtenidos

Asumiendo los requisitos previos,

hacemos el contraste para ANOVA:

H 0: µ 1= µ 2= … = µ k

H1: Al menos una igualdad no es cierta

Estadística

ANOVA

REQUISITOS DE ANOVA: Homogeneidad de varianzas:

f(x1)

f(x2)

f(x1)

µ

f(x2)

µ

f(x3)

µ

µ

f(x3)

µ

µ

Cuando varianzas ≠, se incrementa el error Tipo I

11

08/04/11

Estadística

ANOVA

REQUISITOS DE ANOVA: Homogeneidad de varianzas:

Test de heterogeneidad de varianzas:

Bartlett -> high alfa, sensible a NO normalidad

Levene -> es una ANOVA para VAR. Asume var iguales!!

Scheffe -> insensible a NO normalidad, pero no lo recomnieda …

Hartley -> problema cuando 1 var es pequeña….

… etc.

Test de Cochran

Gexpt =

mayor si2

∑ si 2

• Condición: Tamaños muestrales iguales (balanceado)

• La distribución G para (n-1) g.l. y k (tratamientos) ha sido tabulada

• No rechazamos H0 (homogeneidad de varianzas) si Gexp t < Gn −1, k ,α

Estadística

ANOVA

REQUISITOS DE ANOVA: Homogeneidad de varianzas:

Test de Bartlett:

• Pros: Tamaños de n desiguales (no balanceado)

• Contas: high alfa, sensible a NO normalidad

• Test basado en Chi-cuadrado

• Calcula una ponderación de las varianzas estimadas:

• El estadístico sería:

Siendo

C = 1+

M exp t =

1 ⎡⎛ k 1 ⎞

1 ⎤

⎟ −

⎢⎜ ∑

⎥

3(k − 1) ⎣⎜⎝ i =1 ni − 1 ⎟⎠ n − k ⎦

k

S D2 =

∑ (n − 1)S

i

2

i

i =1

n−k

k

1 ⎡

(n − k )Ln S D2 − ∑ (ni − 1)Ln Si2 ⎤⎥

⎢

C ⎣

i =1

⎦

( )

No rechazamos H0 si

( )

M exp t < χ k2−1,α

12

08/04/11

Estadística

ANOVA

REQUISITOS DE ANOVA: Homogeneidad de varianzas:

Test de

homogeneidad

Varianzas

homogéneas

Varianzas no

homogéneas

ANOVA

Transformación

de datos

Conteos (o datos que siguen una dist. de Poisson) è √ (X + 1)

Ratios, tasas, concentraciones, etc. è log (X) o log (X + 1)

Porcentajes y proporciones è sen-1 √ X (= arcsen X)

Estadística

ANOVA

REQUISITOS DE ANOVA: Homogeneidad de varianzas:

Si la transformación de datos no soluciona el problema,

y estamos ante alguna de las siguientes situaciones:

• Situaciones biológicas que presentan varianzas

heterogéneas: gran agrupación de organismos.

• Cuando son experimentos bien replicados: el análisis de la

varianza es suficientemente robusto.

• Experimentos grandes y balanceados.

• La validez del test y probabilidades asociadas con la

distribución de la F ratio no se ven muy afectadas.

13

08/04/11

Estadística

ANOVA

REQUISITOS DE ANOVA: Homogeneidad de varianzas:

Test de

homogeneidad

Varianzas

homogéneas

Varianzas no

homogéneas

ANOVA

Transformación

de datos

Si se acepta H0 (p > 0,05), no hay problema

Si se rechaza H0, considerar αc = 0,01

Utilizar un test no paramétrico (p.ej. Kruskal-Wallis) no soluciona el problema

Estadística

ANOVA

REQUISITOS DE ANOVA: Normalidad de los datos

El análisis de la varianza es bastante robusto a las desviaciones de la

normalidad, sobre todo cuando:

• hay un gran número de tratamientos y / o réplicas;

• los datos están equilibrados.

Las transformaciones a menudo corrigen el apuntamiento, pero solo deben

hacerse cuando NO hay homogeneidad de varianzas. NUNCA ante la falta

de NORMALIDAD.

14

08/04/11

Estadística

ANOVA

Ejemplo 1: Uno de los focos de contaminación del agua en la

Laguna del Mar Menor lo constituyen los vertidos agrícolas

procedentes de las cuencas vertientes, ricos en fósforo. Para

tratar de verificar esta sospecha, se han medido los niveles

diversos puntos de la laguna y en el de resto de lagunas.

Lago 1

Lago 2

Lago 3

Lago 4

7.1

7.2

5.6

7.2

8.5

6.5

7.1

6.6

6.2

5.9

6.3

6.3

7.3

7.8

6.7

7.4

7.9

6.4

6.5

6.5

¿Es suficientemente importante esta diferencia como para concluir

que el nivel de fósforo en el Mar Menor es diferente al de los

demás?

Estadística

ANOVA

1. Hipótesis del contraste:

H 0 : No existen diferencias entre las k lagunas

H 1 : Hipótesis nula no cierta (al menos alguna laguna es diferente al resto)

(alfa:0.05)

H 0 : µ1 = µ 2 = µ3 = µ 4

H1 : Al menos una igualdad no es cierta

2. Verificar hipótesis del modelo (…)

• Independencia de los valores observados (comprobar)

• Normalidad (para cada grupo test –ej. KS-)

• Homogeneidad de las Varianzas (Test de Cochran):

0.75

Gexpt =

= 0.408

Max(si2)

1.84

Como Gexpt < Punto Crítico

Gexpt =

∑ si 2

No se puede

mostrar la

No se puede mostrar la

imagen. Puede que su

VARIANZAS IGUALES

15

08/04/11

Estadística

ANOVA

3. Desarrolla el contraste

a) Estadísticos:

n

̅X

S²

S

No se puede mostrar la imagen. Puede que su equipo no tenga suficiente memoria para abrir la imagen o que ésta esté dañada. Reinicie el

i de nuevo. Si sigue apareciendo

i

i

equipo y, a continuación, abra el archivo

la x roja, puede que tengai que borrar la imagen e insertarla

de

nuevo.

Lago 1

Lago 2

Lago 3

Lago 4

No se puede mostrar la imagen. Puede que su equipo no tenga suficiente memoria para abrir

la imagen o que ésta esté dañada. Reinicie el equipo y, a continuación, abra el archivo de

nuevo. Si sigue apareciendo la x roja, puede que tenga que borrar la imagen e insertarla de

nuevo.

k =4

n = n1 + n2 + n3 + n4 = 20

No se puede mostrar la imagen. Puede que su equipo no tenga

suficiente memoria para abrir la imagen o que ésta esté dañada.

Reinicie el equipo y, a continuación, abra el archivo de nuevo. Si

sigue apareciendo la x roja, puede que tenga que borrar la

imagen e insertarla de nuevo.

Estadística

ANOVA

b) Tabla ANOVA:

Fuentes de Sumas de

variación cuadrados

ENTRE

2.41

DENTRO

7.34

TOTAL

9.75

4

2

QE = ∑ ni ( X i. − X .. )

i =1

4

QD = ∑ (ni − 1)Si2

Grados de

Libertad

Cuadrados

Medios

F

Signif.

QE = 5 ⋅ (7.40 − 6.85) 2 + ..... + 5 ⋅ (6.80 − 6.85) 2 = 2.41

QD = (5 −1) ⋅ 0.75 + ..... + (5 −1) ⋅ 0.23 = 7.34

i =1

4

5

Q = ∑∑ (X ij − X .. )

Q = QE + QD = 2.41 + 7.34 = 9.75

i =1 j =1

16

08/04/11

Estadística

ANOVA

b) Tabla ANOVA:

Fuentes de Sumas de

variación cuadrados

Grados de

Libertad

Cuadrados

Medios

ENTRE

2.41

3

0.802

DENTRO

7.34

16

0.459

TOTAL

9.75

19

0.513

GLE = k −1 = 4 −1 = 3

S E2 =

F

Signif.

GL = n − 1 = 20 − 1 = 19

GLD = n − k = 20 − 4 = 16

QE

2.41

Q

7.34

=

= 0.802 S D2 = D =

= 0.459

k −1

3

n−k

16

S2 =

Q

n −1

=

9.75

= 0.513

19

Estadística

ANOVA

b) Tabla ANOVA:

Fuentes de Sumas de

variación cuadrados

Grados de

Libertad

Cuadrados

Medios

ENTRE

2.41

3

0.802

DENTRO

7.34

16

0.459

TOTAL

9.75

19

0.513

QE

Fexp t =

QD

k − 1 = 0.802 = 1.747

0.459

n−k

Fc ⇒ Fk −1,n − k ,α = F3,16, 0.05

F

Signif.

1.747

0.198

NO RECHAZO

Fexp t = 1.747 < 3.24 = F3,16,0.05

p − valor = P( F3,16 > Fexp t ) = 0.1977

(Obtenido con R)

17

08/04/11

Estadística

Tema 9

Test a posteriori

(para ANOVA)

Estadística

Test a posteriori

Comparaciones múltiples

• NOTA (ANOVA): en caso de rechazar la hipótesis nula se hace

necesario efectuar hipótesis específicas.

• Hemos de efectuar contrastes entre medias. Estos pueden ser :

• Contrastes Simples (cuando involucran únicamente dos medias)

• Contrastes Complejos (cuando involucran tres o más medias).

• Empleando otro criterio, los contrastes pueden ser:

• "a priori" (cuando se plantean antes de analizar los datos)

• "a posteriori" (cuando se plantean una vez vistos los datos)

18

08/04/11

Estadística

Test a posteriori

Comparaciones múltiples

Al hacer varias comparaciones estamos aumentando la probabilidad de

error de tipo I.

Es decir, si hacemos un ANOVA, la probabilidad de rechazar la hipótesis

nula siendo cierta es 0'05.

Pero si en cada una de los contrastes empleamos un α = 0'05, ello

quiere decir que al hacer los 3 contrastes de arriba, la probabilidad de

cometer algún error de tipo I en el experimento es mayor de 0'05. (De

manera análoga que comprar muchos billetes de lotería aumenta

nuestras posibilidades de tener premio.)

Por tanto, se precisa controlar la probabilidad de error tipo I en cada

contraste, que será menor que 0'05.

Estadística

Test a posteriori

Comparaciones múltiples

Existen varias pruebas que permiten controlar el error tipo I en el

experimento. Tales pruebas dependen de si los contrastes son "a priori" o

"a posteriori", y de si los contrastes son simples o complejos.

• Cuando todos los contrastes son simples y queremos efectuar todas las

comparaciones "a priori" (o bien algunas -o todas las- comparaciones "a

posteriori"), la prueba más popular es la prueba de Tukey, que R calcula

fácilmente.

Cuando tenemos unos pocos contrastes "a priori" (i.e., k-1 contrastes o

menos), la prueba recomendada es la de Bonferroni.

-Cuando tenemos contrastes "a posteriori" y alguno de ellos es complejo,

hemos de efectuar la prueba de Scheffé.

Hay muchas otras pruebas de comparaciones múltiples, como podéis ver en el R.

19

08/04/11

Estadística

Test a posteriori

a priori (antes de realizar el experimento)

Dos tipos de definición de HA

a posteriori (no propongo alternativas hasta

haber realizado el experimento)

Ejemplo de comparación a priori:

H 0: µ 1 = µ 2 = µ 3 = µ 4

HA: µ3 > µ1; µ3 > µ2; µ3 > µ4

Los tests a priori son más potentes, pero están sometidos a mayor riesgo de error

Ej: Dunn Sidak

Estadística

Test a posteriori

Tests a posteriori

Comparan todos los posibles pares de medias entre sí, de tal modo

que definen la alternativa a la H0

Subconjuntos Homogéneos

•

Únicamente podrá definirse una HA sin ambigüedad en el caso de

que se los distintos tratamientos se reúnan en grupos tales que:

1. no haya diferencias entre las medias dentro de un grupo, y

2. cada media en un grupo difiere de todas las medias del

otro grupo

• Uno de los tests más utilizados es el de Student-Newman-Keuls (SNK)

• Otros tests utilizables:

Scheffe

Tukey

LSD

Bonferroni

… etc.

20

08/04/11

Estadística

Test a posteriori

Bonferroni

Test que realiza comparaciones dos a dos basado en el contraste de diferencias de

medias, σ2 desconocidas pero iguales:

Xi − X j

Sd

1 1

+

ni n j

< tn−k ,α / K ⇒ No Re chazo

2

Siendo: S D =

QD

n−k

Como interesa mantener Alfa por debajo del nivel predeterminado, se corrige

utilizando para cada nivel K, (constante de penalización):

⎛ k ⎞

k!

K = ⎜⎜ ⎟⎟ =

2

(

k

−

2)!2!

⎝ ⎠

Nº de posibles comparaciones

OJO: Test conservador que detecta menos diferencias de las reales. No se

recomienda cuando existen muchos niveles

Estadística

Test a posteriori

Otros test:

Existen otros test basados también en comparaciones de diferencias de

medias tomadas dos a dos. Entre otros:

Fisher LSD (diferencia mínima significativa): Test aplicado cuando no es

necesario el incremento del error Tipo I (aplicación directa del test tStudent): No se aplica penalización (no conservador). Usado para pocas

comparaciones.

Tukey HSD (diferencia significativa honesta): Aplica penalización

(conservador). Utiliza el llamado estadístico de rango studerizado qk , glerror ,α

21

08/04/11

Estadística

Test a posteriori

Estadística

Test a posteriori

Tukey: Ejemplo con R

Si aplicamos Tukey con R con los datos del E.1 del T. 8 (rechazaba H1)

Lago3-Lago2

Lago3-Lago1

95% family-wise confidence level

Lago4-Lago3

OJO: ERAN MEDIAS IGUALES

-2

-1

0

1

Differences in mean levels of grupo

22

08/04/11

Estadística

Test a posteriori

H0 no se rechaza

(Test no significativo)

Se rechaza H0

(Test significativo)

95% family-wise confidence level

-2

-1

0

Lago4-Lago3

Lago4-Lago3

Lago3-Lago2

Lago3-Lago2

Lago3-Lago1

Lago3-Lago1

95% family-wise confidence level

1

-3

-2

-1

0

1

Differences in mean levels of grupo

Differences in mean levels of grupo

Estadística

ANOVA y Test a posteriori

Ejemplo 2: Si se parte del mismo supuesto del ejemplo 1, pero

con los datos que se adjuntan a continuación:

Lago 1

Lago 2

Lago 3

Lago 4

7.8

7.2

5.6

7.2

9.2

6.5

7.1

6.6

6.9

5.9

6.3

6.3

8

7.8

6.7

7.4

8.6

6.4

6.5

6.5

¿Es suficientemente importante esta diferencia como para concluir

que el nivel de fósforo en el Mar Menor (Lago1) es diferente al

de los demás?

23

08/04/11

Estadística

ANOVA y Test a posteriori

1. Hipótesis del contraste:

H 0 : No existen diferencias entre las k lagunas

H 1 : Hipótesis nula no cierta (alguna laguna es diferente al resto)

(alfa:0.05)

H 0 : µ1 = µ 2 = µ3 = µ 4

H1 : Al menos una igualdad no es cierta

2. Verificar hipótesis del modelo (…)

• Independencia de los valores observados (comprobar)

• Normalidad (para cada grupo test –ej. KS-)

• Homogeneidad de las Varianzas (Test de Cochran):

0.75

Gexpt =

= 0.408

Max(si2)

1.84

Como Gexpt < Punto Crítico

Gexpt =

∑ si 2

No se puede

mostrar la

No se puede mostrar la

imagen. Puede que su

VARIANZAS IGUALES

Estadística

ANOVA y Test a posteriori

3. Desarrolla el contraste

a) Estadísticos:

Lago 1

Lago 2

Lago 3

Lago 4

5

5

5

5

k =4

n = n1 + n2 + n3 + n4 = 20

1 k ni

X .. = ∑∑ X ij = 7.03

n i =1 j =1

̅Xi

8.10

6.76

6.44

6.80

S²i

0.75

0.55

0.31

0.23

Si

0.87

0.74

0.55

0.47

5.5 6.0 6.5 7.0 7.5 8.0 8.5 9.0

ni

lago1

lago2

lago3

lago4

24

08/04/11

Estadística

ANOVA y Test a posteriori

b) Tabla ANOVA:

Fuentes de Sumas de

variación cuadrados

ENTRE

8.09

DENTRO

7.34

TOTAL

15.43

4

2

QE = ∑ ni ( X i. − X .. )

Grados de

Libertad

Cuadrados

Medios

F

Signif.

QE = 5 ⋅ (8.10 − 7.03) 2 + ..... + 5 ⋅ (6.80 − 7.03) 2 = 8.09

i =1

4

QD = (5 −1) ⋅ 0.75 + ..... + (5 −1) ⋅ 0.23 = 7.34

QD = ∑ (ni − 1)Si2

i =1

4

5

Q = ∑∑ (X ij − X .. )

Q = QE + QD = 8.09 + 7.34 = 15.43

i =1 j =1

Estadística

ANOVA y Test a posteriori

b) Tabla ANOVA:

Fuentes de Sumas de

variación cuadrados

Grados de

Libertad

Cuadrados

Medios

ENTRE

8.09

3

DENTRO

7.34

16

0.459

TOTAL

15.43

19

0.812

GLE = k −1 = 4 −1 = 3

S E2 =

QE 8.09

=

= 2.70

k −1

3

Signif.

2.70

GLD = n − k = 20 − 4 = 16

S D2 =

F

QD

7.34

=

= 0.459

n−k

16

GL = n − 1 = 20 − 1 = 19

S2 =

Q

n −1

=

15.43

= 0.812

19

25

08/04/11

Estadística

ANOVA y Test a posteriori

b) Tabla ANOVA:

Fuentes de Sumas de

variación cuadrados

Grados de

Libertad

Cuadrados

Medios

F

Signif.

2.70

5.878

p<0.01

ENTRE

8.09

3

DENTRO

7.34

16

0.459

TOTAL

15.43

19

0.812

QE

Fexp t =

QD

k − 1 = 2.70 = 5.878

0.459

n−k

Fc ⇒ Fk −1,n − k ,α = F3,16, 0.05

RECHAZO

Fexp t = 5.878 > 3.24 = F3,16,0.05

p − valor = P( F3,16 > Fexp t ) = 0.006648

(Obtenido con R)

Estadística

ANOVA y Test a posteriori

c) Test a posteriori (aplicación Bonferroni):

QD

SD =

= 0.459 = 0.677

n−k

⎛ k ⎞ ⎛ 4 ⎞

4!

K = ⎜⎜ ⎟⎟ = ⎜⎜ ⎟⎟ =

=6

⎝ 2 ⎠ ⎝ 2 ⎠ (4 − 2)!2!

tij =

Xi − X j

SD

1 1

+

ni n j

⇒ t12 =

8.10 − 6.76

= 4.945

1 1

0.677 +

5 5

(Obtenido con R: pt(t,n-k,lower.tail=false)

Muestras

1

1

1

2

2

3

y2

y3

y4

y3

y4

y4

Dif.med.

1.34

1.66

1.30

0.32

-0.04

-0.36

tij

t16, 0. 05/6

4.945

6.126

4.797

1.181

0.148

1.328

Signif.

Signif.

Signif.

No signif.

No signif.

No signif.

p-valorij

aprox.

p<0.005

p<0.005

p<0.005

0.1<p<0.25

p>0.25

0.1<p<0.25

p-valorij

0.000073

0.000007

0.000099

0.127

0.442

0.101

Recuerda: Tanto tc como p-valor se pueden

aproximar a partir de la tabla de t.

............................................................

tc = t n − k ,α / K = t16, 0.0083 = 2.673228

(Obtenido con R: qt(1-0.00833,16)

26

08/04/11

Estadística

ANOVA y Test a posteriori

c) Test a posteriori (aplicación Tukey con R):

Lago4-Lago3

Lago3-Lago2

Lago3-Lago1

95% family-wise confidence level

-3

-2

-1

0

1

Differences in mean levels of grupo

Estadística

ANOVA y Test a posteriori

Comandos de R:

1. Contraste de bondad de ajuste a una normal:

ks.test(nivel,“pnorm”, mean=mean(nivel), sd=sd(nivel))

2. Homogeneidad de varianzas

Test de Cochran:

#Construimos una tabla con las varianzas de los grupos:

varianzas<-tapply(variable,factor,var)

gexpt <- max(varianzas)/sum(varianzas) #Estadísticio experimental

qcochran(0.95,6,4) #Punto crítico

Test Cochran alternativo: (cargar previamente librería con “library(outliers)”)

cochran.test(variable~factor,data=datos)

Test Bartlett:

bartlett.test(variable~factor)

27

08/04/11

Estadística

ANOVA y Test a posteriori

Comandos de R:

3. ANOVA:

Test ANOVA:

aov(variable~(factor))

4. Compariones múltiples:

Test de Bonferroni:

pairwise.t.test(variable, factor, p.adj="bonferroni")

Test de Tukey:

TukeyHSD(aov(variable~factor))

28