4. Modelo de Regresión Lineal Simple: Inferencia Estadística

Anuncio

Econometria

4. Modelo de Regresión Lineal Simple: Inferencia

Prof. Ma. Isabel Santana

MRLS: Inferencia

• Hasta ahora nos hemos ocupado solamente de la

estimación de los parámetros del modelo de regresión

lineal simple.

• Pero los estimadores MICO son variables aleatorias,

que cambiarán según la muestra. Nuestro objetivo no

es solamente estimar la FRM, sino poder hacer

inferencia respecto de la FRP.

• Para poder hacer inferencia sobre los estimadores, es

necesario conocer sus distribuciones de probabilidad,

algo que no hemos estudiado hasta ahora.

MRLS: Inferencia

• La inferencia estadística nos sirve para

saber:

– Que tan cerca están los β estimados de los

parámetros poblacionales.

– Que tan cerca está Yˆi del verdadero E (Y / X )

MRLS: Inferencia

Distribución de probabilidad de µi

ki =

β̂ 2 = ∑ kiYi

xi

∑ x i2

βˆ2 = ∑ ki (β1 + β 2 X i + µi )

• Dado que las X son fijas, β̂ 2 es una función lineal de Yi.

• A su vez, ki, las betas y las Xi son fijas, por lo que β̂ 2 es una

función lineal de µi.

• La distribución de probabilidad de β̂ 2 dependerá de la

suposición que se hizo de la distribución de probabilidad de

µi.

MLRS: Inferencia

Supuestos de Normalidad

• Para obtener los estimadores de β1 y β2 que sean MELI, no

hicimos ningún supuesto sobre la distribución de

probabilidades de u.

• Ahora, para tener intervalos de confianza para los parámetros

y probar cualquier hipótesis requerimos el supuesto:

Media

Varianza

Covarianza

E (µi ) = 0

( )

E{[µ − E (µ )][µ − E (µ )]} = E (µ µ ) = 0

µ ~ N (0, σ )

E [µi − E (µi )] = E µi2 = σ 2

2

i

i

j

2

i

j

i

j

Razones para suponer distribución

normal

1.

2.

3.

4.

5.

El argumento más común es que como u es la suma de

muchos factores distintos no observados que influyen en

Y, por el teorema del limite central, llegamos a la

conclusión de que u tiene una distribución normal.

Una variante del teorema del límite central, establece

que aunque el número de variables no sea muy grande

o no sea estrictamente independiente, su suma puede

ser aún normal.

La distribución de probabilidad de los estimadores MICO

puede derivarse fácilmente.

La distribución normal es una distribución sencilla, con

tan sólo dos parámetros: media y varianza.

Podemos hacer pruebas de hipótesis (t, F, X 2) sobre los

verdaderos parámetros

Críticas al Supuesto

1.

2.

3.

Los factores que afecta u pueden tener distribuciones

poblacionales muy distintas. Aunque puede sostenerse el

teorema central del límite, los resultados van a depender de

cuantos factores afecten a u y que tan diferentes sean sus

distribuciones.

Supone además que todos los factores afectan a u en forma

lineal y aditiva

La normalidad es un problema empírico (no teórico). Por

ejemplo, como el salario siempre es mayor que cero,

estrictamente hablando no tiene una distribución normal;

además hay leyes de salario mínimo que hacen que una

parte de la población gane exactamente el mínimo. Una

solución es transformar la variable, por ejemplo utilizando

logaritmos [log(salario)], lo cual puede generar una

distribución que se acerque más a la normal

Propiedades de los estimadores MCO

bajo Normalidad

1.

2.

3.

Son insesgados

Tienen varianza mínima. Combinado con (1), son

estimadores con varianza mínima, o eficientes.

Son consistentes. A medida que el tamaño de la

muestra aumenta indefinidamente, los estimadores

convergen

hacia

sus

verdaderos

valores

poblacionales.

Propiedades de los estimadores MCO

bajo Normalidad

4.

β̂1

y β̂ 2 (al ser función lineal de µi) están

normalmente distribuidos con:

β̂1

( )

( )

E βˆ2 = β 2

E βˆ1 = β1

Media:

Varianza:

β̂ 2

σ

2

βˆ

1

∑X

=

n∑ X

2

i

2

i

(

σ

βˆ1 ~ N β1 , σ β2ˆ

Distribución normal

estandarizada:

1

βˆ1 − β1

Z=

σ β2ˆ

1

2

)

σ

2

βˆ

=

2

σ2

∑X

(

βˆ2 ~ N β 2 , σ β2ˆ

βˆ2 − β 2

Z=

σ β2ˆ

2

Donde

Z ~ N (0,1)

2

i

2

)

Propiedades de los estimadores MCO

bajo Normalidad

5.

(n − 2)(σˆ 2 / σ 2 ) está distribuida como la distribución

(ji-cuadrada), con (n-2) grados de libertad.

6. (βˆ1 , βˆ2 ) se distribuyen de manera independiente

con respecto a σ̂ 2 .

7. β̂1 y β̂ 2 tienen varianza mínima entre todas las

clases de estimadores insesgados, lineales o

no lineales.

E (Yi ) = β1 + β 2 X i

Si se supone

var(Yi ) = σ 2

Podemos decir

(

Yi ~ N β1 + β 2 X i , σ 2

)

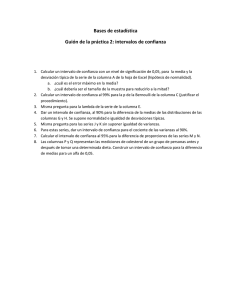

Intervalos de confianza

• La estimación de un intervalo de confianza consiste en

construir un intervalo alrededor del estimador puntual (ej.

Dentro de dos o tres errores estándar a cada lado del

estimador puntual), tal que el intervalo tenga un 95% de

probabilidad de incluir el verdadero valor del parámetro.

• Ej. Suponga que deseamos encontrar que tan cerca está

β̂ 2 de β 2 . Con este fin se trata de encontrar dos números

positivos, δ y α (este último entre 0 y 1), tal que la

probabilidad de que el intervalo aleatorio ( β̂ 2 - δ, β̂ 2 + δ)

ˆ

contenga el verdadero β2 sea

1 – α.

Intervalo de confianza

Coeficiente de confianza

Nivel de Significancia

Limite de confianza inferior

Limite de confianza superior

(

)

Pr βˆ2 − δ ≤ β 2 ≤ βˆ2 + δ = 1 − α

1−α

α

βˆ2 − δ

βˆ2 + δ

Intervalos de confianza

• Antes es preciso recordar que:

ˆ

– El intervalo no dice la probabilidad de que β2 esté en el

intervalo con una probabilidad de (1-α); sino que la probabilidad

de construir un intervalo que contenga β2 es de (1-α).

– El intervalo es aleatorio; va a depender de la muestra, ya que β2

es aleatorio.

– Si se construyen intervalos de confianza, en promedio tales

intervalos contendrán, en (1-α) de los casos, el valor verdadero

del parámetro.

ˆ

ˆ

– Una vez obtenido un valor numérico específico de β2 (en base a

una muestra específica), no puedo decir que el intervalo contiene

al verdadero parámetro con probabilidad (1-α), sino que la

probabilidad es 1ó 0.

Intervalos de confianza β1 y β2

Se puede utilizar la distribución normal para hacer

afirmaciones probabilísticas sobre β1 y β2 siempre

que se conozca la varianza poblacional

Sin embargo, σ 2no se conoce, y en la práctica se

estima con σ̂ 2. En lugar de utilizar la distribución

normal se usa la distribución t.

El intervalo de confianza se construye entonces con:

Para β2

Pr (− tα / 2 ≤ t ≤ tα / 2 ) = 1 − α

βˆ − β 2

Pr − tα / 2 ≤ 2

≤ tα / 2 = 1 − α

ee βˆ2

(

Pr (βˆ − t

( )

( )

ee(βˆ ) ≤ β

1

α /2

1

1

≤ βˆ1 + tα / 2

(

βˆ

t=

2

2

− β2

) ∑x

2

i

σ

− β2

) ∑x

2

i

Con n-2 g de l

σˆ

Intervalos de confianza

Para β1 y β2 al 100(1-α)%:

( )

ee(βˆ )

βˆ1 ± tα / 2 ee βˆ1

( ))

ee(βˆ )) = 1 − α

Pr βˆ2 − tα / 2 ee βˆ2 ≤ β 2 ≤ βˆ2 + tα / 2ee βˆ2 = 1 − α

Para β1

(

βˆ

Z=

βˆ2 ± tα / 2

2

1

tα / 2 ,o valor crítico t, es el valor de la variable t obtenida de la distribución t para un nivel de significancia

de α/2 y n – 2 g de l.

Entre más grande el error estándar, más amplio el intervalo de confianza, y mayor la incertidumbre de

estimar el verdadero valor del parámetro.

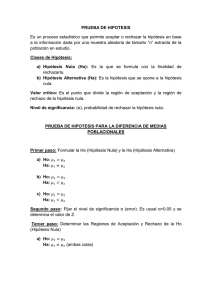

Prueba de Hipótesis

•

•

•

•

Se utiliza para mostrar si una observación dada es

compatible o no con alguna hipótesis planteada, es

decir, si la observación está lo suficientemente cerca al

valor hipotético de manera que no se rechaza la

hipótesis planteada.

Hipótesis Planteada: hipótesis nula (H0).

Hipótesis contra la cual se prueba la hipótesis nula:

Hipótesis alternativa (H1).

2 métodos para decidir si se rechaza o no la hipótesis

nula:

1.

2.

Intervalo de confianza

Prueba de significancia

1. Intervalo de confianza

• Ej. de modelo de consumo. Supongamos que se postula:

H0: β2=0.3

H1: β2≠0.3

• Hipótesis nula: La PMC=0.3

• Hipótesis alterna: La PMC es menor o mayor a 0.3

• H0 es una hipótesis simple y H1 compleja, dado que puede ser

mayor o menor al valor de H0. Se conoce también como hipótesis

de dos colas.

• Para probar si es compatible con H0 se utiliza la estimación de

intervalos.

Regla de decisión: Constrúyase un intervalo de confianza para β2 al 100(1 – α)%.

Si β2 bajo H0 se encuentra dentro de este intervalo de confianza, no se rechace H0,

pero si está por fuera del intervalo, rechace H0.

1. Intervalo de confianza

0.4268

0.5914

• En el ej. de consumo-ingreso estimamos que el intervalo de

confianza para β2 era de (0.4268,0.5914). Siguiendo la regla

planteada, es claro que H0: β2=0.3 está fuera del intervalo de

confianza al 95%.

• Se rechaza la hipótesis nula de que la verdadera PMC sea 0.3 con

95% de confianza.

Cuando se rechaza H0, se dice que el hallazgo es estadísticamente significativo.

Cuando no se rechaza H0, el hallazgo no es estadísticamente significativo.

2. Prueba de Significancia

•

El procedimiento se basa en utilizar un estadístico de prueba

(estimador) y su distribución muestral bajo la hipótesis nula.

(

βˆ

t=

Bajo el supuesto de normalidad:

Bajo la hipótesis nula:

(

2

− β2

( )

) ∑x

2

i

σˆ

Con n-2 g de l

( ))

Pr β 2* − tα / 2ee βˆ2 ≤ βˆ2 ≤ β 2* + tα / 2 ee βˆ2 = 1 − α ; β 2* = Valor de β2

bajo H0.

( )

β 2* ± tα / 2 ee βˆ2

Región de aceptación de H0:

Región de rechazo: Región por fuera del intervalo de aceptación de H0.

Bajo H0:

(βˆ

)

− β2

~ t n -2

σˆ βˆ

2

2

Rechazamos H0:

t > tc

Rechazo H0 si

t < -tc

|t| > tc

Como

t=

(βˆ

)

− β2

,

σˆ βˆ

2

2

Rechazo H0:

βˆ2 < β 2* − tα / 2ee βˆ2

(

( ))

No rechazo H0

Rechazo H0 si

Rechazo H0:

(

( ))

βˆ2 > β 2* + tα / 2ee βˆ2

(βˆ

)

− β2

> tc

σˆ βˆ

2

2

2. Prueba de Significancia

• Test de una cola

H 0 : β 2 = β 2*

H1 : β 2 > β 2*

2. Prueba de Significancia

• Test de dos colas

H 0 : β 2 = β 2*

H1 : β 2 ≠ β 2*

Rechazo H0 si | t | > tc

2. Prueba de Significancia

Reglas de decisión

Tipo de

Hipótesis

H0: Hipótesis

nula

H1: Hipótesis

alterna

Dos colas

β 2 = β 2*

Cola derecha

β 2 ≤ β 2*

β 2 ≥ β 2*

β 2 ≠ β 2*

β 2 > β 2*

β 2 < β 2*

Cola izquierda

Regla de

decisión:

rechazar H0 si

t > tα / 2, g .de.l

t > tα , g .de.l

t < −tα , g .de.l

Notas:

-Es el valor numérico de β2 hipotético.

-|t| significa valor absoluto de t.

-tα o tα/2 significa el valor crítico de t al nivel de significancia α o α/2.

-g de l: grados de libertad, (n – 2) para el modelo de dos variables, (n – 3) para el modelo de 3 variables, y

así sucesivamente.

-Para probar hipótesis sobre β1 se sigue un procedimiento similar.

“Aceptar” o Rechazar la H0

• Al momento de emitirse un dictamen sobre la

hipótesis nula, este debe de emitirse como

“Rechazar H0” o “No Rechazar H0”.

• No se puede “aceptar” una hipótesis nula,

puesto que no conocemos el verdadero valor,

sino que hacemos una inferencia del mismo.

• Las hipótesis nulas “aceptadas” pueden ser

muchas dependiendo de cuáles hipótesis esté

planteando.

Hipótesis nula o “cero” y regla práctica

“2-t”

• La hipótesis nula H0:β2=0 es usada frecuentemente

en el trabajo empírico, e implica que el coeficiente

de la pendiente es cero.

• Esta H0 es un mecanismo para establecer si Y tiene

relación con la variable X.

• Estas pruebas pueden abreviarse adoptando la

regla de significancia “2-t”:

Regla práctica “2-t”: Si el número de grados de libertad es 20 y si α, el

nivel de significancia, se fija en 0.05, entonces la hipótesis nula β2=0

puede ser rechazada si el valor t = (βˆ2 − β 2 ) calculado excede a 2 en valor

σˆ βˆ

absoluto.

2

Error tipo I y tipo II

H0 es cierto

Rechazo H0

No Rechazo H0

•

H0 es falso

Error tipo I

Error tipo II

Si β̂ 2 cae en alguna de las colas de la distribución (Rechazo H0),

puede ser por dos razones.

– La hipótesis nula es cierta, pero se ha elegido una muestra equivocada

– La hipótesis nula es efectivamente falsa

•

•

La probabilidad de cometer un error de tipo I está dada por α, el nivel

de significancia.

La probabilidad de cometer un error tipo II esta dada por β, en tanto

que la probabilidad de no cometer este error (1- β) se denomina

potencia de la prueba.

El problema relacionado con la selección del valor apropiado de α puede ser

evitado si se utiliza el valor p o “P-value” que veremos a continuación.

Error tipo I y tipo II

• Lo deseable sería minimizar simultáneamente tanto los errores tipo

I como tipo II, pero como se puede apreciar en los gráficos esto no

es posible. En la práctica por lo general el error tipo I es más grave,

por lo que se trata de minimizar primero este error y luego el error

tipo II.

Valor p o “P-value”

• Nivel observado o exacto de significancia

o la probabilidad exacta de cometer un

error tipo I.

• Se define como el nivel de significancia

más bajo al cual puede rechazarse una

hipótesis nula.

Análisis de Varianza (ANOVA)

• Test de significancia global del modelo. Intenta medir el

ajuste de la recta de regresión con el conjunto de datos

provenientes de la muestra.

• Este test, para el caso del modelo de regresión lineal

simple, tiene como hipótesis nula:

Sabemos que

Elevando al cuadrado

(1)

(2)

• También sabemos que

(3)

• Se puede demostrar que (2) y (3) son independientes, por lo que:

(4)

• Simplificando tenemos que:

(5)

• Si sustituimos la hipótesis nula en (5)

(6)

•

Recordando, cuando descompusimos la suma de cuadrados

teníamos:

• Asociado a cada suma de cuadrados existen sus respectivos grados

de libertad:

– SCT: tiene n-1 grados de libertad, pues se pierde un grado de libertad al

calcular la media de Y.

– SCE: un sólo grado de libertad de calcular ˆβ2

– SCR: tiene n-2 grados de libertad, pues se pierden dos grados de libertad

en las ecuaciones normales.

El numerador de (6) es la SCE y el denominador es la SCR divida

por sus grados de libertad.

(7)

Entonces, rechazo H0 si el valor calculado del estadístico F, es

mayor que Fα1, n-2

Otra forma alternativa de expresar (7):

(8)

Pruebas de Normalidad

• Las pruebas de hipótesis e intervalos de confianza

estudiados, tienen como punto de partida el supuesto de

normalidad del residuo, por lo que si u no es normal,

estas pruebas no son válidas.

• Existen diferentes test que permiten verificar si los

residuos calculados para una muestra en particular (ei)

provienen de una distribución normal. Uno de ellos es el

test de Jarque-Bera.

Test de Jarque Bera

• Esta es una prueba asintótica que se basa en el tercer y cuarto

momento de la distribución (asimetría y curtosis respectivamente).

• Recordando:

• Coeficiente de simetría:

• En el caso de una distribución normal, el coeficiente de simetría es

cero (S=0) y el de curtosis 3 (C=3).

Test de Jarque-Bera

• Bajo la hipótesis nula de que los residuos están normalmente

distribuidos, Jarque y Bera demostraron que asintóticamente el

estadístico JB sigue una distribución chicuadrado con dos grados

de libertad.

• Es decir, si JB es mayor que una chi-cuadrado con 2 g.l, rechazo la

hipótesis nula, o sea, rechazo normalidad.

¿Qué pasa si los errores no se

distribuyen normal?

• La normalidad exacta de los estimadores MICO depende

crucialmente de la distribución del error en la población (u).

• Si los errores u1, u2, ...., un son elecciones aleatorias de alguna

distribución que no es la normal, las βj no estarán distribuidas en

forma normal, lo que significa que los estadísticos t y F no tendrán

distribuciones t y F, respectivamente.

• Este es un problema potencialmente grave porque nuestra

inferencia depende de que seamos capaces de obtener valores

críticos o valores p de las distribuciones t o F.

• La inferencia basada en los estadísticos t y F exige el supuesto de

normalidad. En caso contrario ¿quiere decir que no debemos utilizar

el estadístico t para determinar qué variables son significativas

estadísticamente?

– La respuesta es no.

¿Qué pasa si los errores no se

distribuyen normal?

• En resumen, si el tamaño de la muestra

no es muy grande y u no se distribuye

normal, debemos de tener mucho cuidado

al momento de hacer inferencia sobre los

estimadores.