Introducción al álgebra lineal

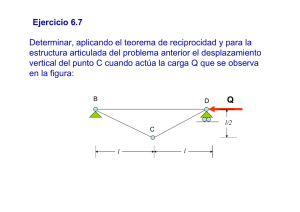

Anuncio