biOps: un paquete de procesamiento de imágenes en R

Anuncio

biOps: un paquete de procesamiento de

imágenes en R

Matı́as Bordese

Walter Daniel Alini

Director: Dr. Oscar Humberto Bustos

30 de noviembre de 2007

Facultad de Matemática, Astronomı́a y Fı́sica

Universidad Nacional de Córdoba

“No se qué hace, pero está muy bueno.”

Nicolás Wolovick

Clasificación:

I.4 Image Processing and Computer Vision

Palabras clave:

R, procesamiento de imágenes, detección de bordes, clasificación, FFT

UNIVERSIDAD NACIONAL DE CÓRDOBA

Facultad de Matemática, Astronomı́a y Fı́sica

Licenciatura en Ciencias de la Computación

biOps: un paquete de procesamiento de imágenes en R

por

Matı́as Bordese

Walter Daniel Alini

Resumen

El presente trabajo describe un paquete de procesamiento de imágenes realizado en R, un lenguaje y entorno computacional libres, enfocado en estadı́stica y gráficos estadı́sticos. Las distintas

funciones del paquete, denominado biOps, fueron especificadas utilizando la notación Z -un lenguaje formal de especificaciones usado para describir y modelar sistemas de computación- e

implementadas usando R mediante la codificación e integración de código C.

El paquete se compone de operaciones geométricas, morfológicas, aritméticas, lógicas, de tablas

de reemplazo, de detección de bordes y de convolución. Incluye también filtros en el espacio

de frecuencias a partir de la Transformada Rápida de Fourier y métodos no supervisados de

clasificación de imágenes. Se describen y detallan las implementaciones, sus fundamentos teóricos

y aplicaciones más frecuentes.

biOps fue liberado bajo licencia libre GPL y aceptado por la comunidad de R para formar parte

de su repositorio oficial de paquetes.

Agradecimientos

Al Dr. Oscar H. Bustos, por la dirección del trabajo.

Al Dr. Pedro R. D’Argenio, por su apoyo, consejos y opiniones.

A la Dra. Laura Alonso y al MSc. Maximiliano Cristiá, por su desinteresada colaboración.

A Kurt Hornik y Uwe Ligges, del R Development Core Team, nuestros R-gurús.

A nuestros familiares y grupo de amigos.

iii

Índice general

Resumen

II

Agradecimientos

III

Listado de Figuras

VII

1. Introducción

2. R

2.1.

2.2.

2.3.

2.4.

2.5.

1

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

4

4

5

7

8

10

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

12

12

13

14

14

15

15

15

16

16

17

17

20

4. Imagen digital

4.1. Representación . . . . . . . . . . . .

4.2. Resolución espacial y de profundidad

4.3. Modelos de color . . . . . . . . . . .

4.3.1. RGB . . . . . . . . . . . . . .

4.3.2. CYM . . . . . . . . . . . . .

4.3.3. HSI . . . . . . . . . . . . . .

4.4. Nuestra implementación . . . . . . .

4.4.1. Especificación . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

21

21

22

23

23

24

24

25

26

5. El procesamiento digital de imágenes

5.1. Orı́genes . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

27

27

Antecedente: El lenguaje S . . . . .

R como implementación de S . . . .

Interfaz contra lenguajes compilados

R puro vs. interfaz C . . . . . . . .

Colaboración a CRAN . . . . . . . .

3. Z

3.1. Las especificaciones formales . . .

3.2. El lenguaje de especificación Z . .

3.3. Definiciones en Z . . . . . . . . . .

3.3.1. Declaraciones . . . . . . . .

3.3.2. Abreviaciones . . . . . . . .

3.3.3. Definiciones axiomáticas . .

3.3.4. Definiciones genéricas . . .

3.3.5. Esquemas . . . . . . . . . .

3.4. f uzz . . . . . . . . . . . . . . . . .

3.5. Especificación en Z . . . . . . . . .

3.5.1. Especificación de reales . .

3.5.2. Resto de las especificaciones

iv

Índice general

v

5.2. Aplicaciones . . . . . . . . . . . . . . . . . . . . . . . .

5.2.1. Astronomı́a y exploración del espacio . . . . . .

5.2.2. Inteligencia y aplicación militar . . . . . . . . .

5.2.3. Ciencias de la tierra . . . . . . . . . . . . . . .

5.2.4. Gobierno . . . . . . . . . . . . . . . . . . . . .

5.2.5. Visualización de datos . . . . . . . . . . . . . .

5.2.6. Entretenimiento . . . . . . . . . . . . . . . . .

5.2.7. Medicina . . . . . . . . . . . . . . . . . . . . .

5.2.8. Procesamiento de documentos . . . . . . . . . .

5.2.9. Aplicaciones industriales y visión de máquinas

5.2.10. Aplicaciones hogareñas . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

29

29

29

29

30

30

30

30

31

31

31

6. biOps: un paquete de procesamiento de imágenes para R

6.1. Otros paquetes R de manejo de imágenes . . . . . . . . . .

6.2. Estructura del paquete . . . . . . . . . . . . . . . . . . . . .

6.3. Testing . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6.4. biOpsGUI: el principio de una interfaz gráfica de usuario . .

6.5. Próximos capı́tulos . . . . . . . . . . . . . . . . . . . . . . .

6.6. Formato Digital . . . . . . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

32

32

33

34

36

36

37

7. Operaciones por pixel

7.1. Look-up tables . . . . . . . . . . .

7.1.1. Modificación de contraste .

7.1.2. Modificación de intensidad

7.1.3. Otras modificaciones . . . .

7.2. Operaciones aritméticas y lógicas .

7.3. Histogramas . . . . . . . . . . . . .

7.4. Generación de ruido . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

38

39

40

41

41

43

45

46

8. Operaciones geométricas

8.1. Mapeo de valores: “hacia adelante” vs. “hacia atrás”

8.2. Interpolación . . . . . . . . . . . . . . . . . . . . . .

8.2.1. Interpolación por el vecino más cercano . . .

8.2.2. Interpolación bilineal . . . . . . . . . . . . . .

8.2.3. Interpolación por B-Spline . . . . . . . . . . .

8.2.4. Interpolación convolucional cúbica . . . . . .

8.3. Operaciones implementadas . . . . . . . . . . . . . .

8.3.1. Escalar . . . . . . . . . . . . . . . . . . . . .

8.3.2. Encoger . . . . . . . . . . . . . . . . . . . . .

8.3.3. Rotar . . . . . . . . . . . . . . . . . . . . . .

8.3.4. Espejar . . . . . . . . . . . . . . . . . . . . .

8.3.5. Trasladar . . . . . . . . . . . . . . . . . . . .

8.3.6. Recortar . . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

48

48

49

49

50

50

51

51

51

52

54

55

55

56

9. Operaciones por vecino

9.1. Convolución . . . . . . . . .

9.1.1. Blurring . . . . . . .

9.1.2. Sharpening . . . . .

9.2. Filtro por mediana . . . . .

9.3. Filtro por mı́nimo/máximo

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

58

58

60

61

62

63

10.Algoritmos de detección de bordes

10.1. Generalidades . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

10.2. Técnicas sencillas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

64

64

65

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

Índice general

10.3. Técnicas por convolución . . .

10.3.1. Detección de bordes por

10.3.2. Detección de bordes por

10.4. Técnicas avanzadas . . . . . . .

10.4.1. Marr Hildreth . . . . . .

10.4.2. Canny . . . . . . . . . .

10.4.3. Shen Castan . . . . . .

10.5. Detección de bordes en color .

vi

. . . . . . . . . . . . . . . . . . . . .

gradiente (Gradient Edge Detection)

compás (Compass Edge Detection) .

. . . . . . . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . . . . . . .

11.Filtros en el espacio de frecuencias

11.1. Espacio de frecuencias . . . . . . .

11.2. Transformada de Fourier . . . . . .

11.3. Convolución . . . . . . . . . . . . .

11.4. Filtros por frecuencia . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

12.Operaciones morfológicas

12.1. Operaciones sobre imágenes binarias . .

12.1.1. Dilatación binaria . . . . . . . .

12.1.2. Erosión binaria . . . . . . . . . .

12.1.3. Apertura y clausura binarias . .

12.2. Operaciones sobre imágenes en escala de

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

. . . .

. . . .

. . . .

. . . .

grises

13.Clasificación de imágenes

13.1. Conceptos . . . . . . . . . . . . . . . . . .

13.2. Clasificación supervisada y no supervisada

13.3. Métodos de clasificación no supervisados .

13.3.1. K-means . . . . . . . . . . . . . . .

13.3.1.1. Complejidad . . . . . . .

13.3.2. Isodata . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

66

67

68

69

70

70

72

73

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

74

74

75

78

80

.

.

.

.

.

82

82

83

85

86

88

.

.

.

.

.

.

90

90

91

92

93

96

97

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

14.Conclusiones

99

14.1. Trabajo futuro . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 100

14.2. Estadı́sticas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 101

A. Profiling

103

Bibliografı́a

110

Índice de figuras

4.1. Matriz imagen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4.2. Modelos de color RGB y CYM . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4.3. Modelo de color HSI . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

22

23

25

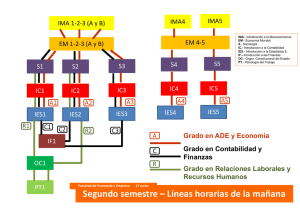

6.1. Estructura biOps . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

35

7.1. Look-up tables . . . . . . .

7.2. Decrementar contraste . . .

7.3. Incrementar contraste . . .

7.4. Decrementar intensidad . .

7.5. Incrementar intensidad . . .

7.6. Negativo . . . . . . . . . . .

7.7. Thresholding . . . . . . . .

7.8. Transformación Gamma . .

7.9. Aplicación de imgDiffer . .

7.10. Histograma de una imagen

7.11. Ruido “sal y pimienta” . . .

.

.

.

.

.

.

.

.

.

.

.

39

40

41

42

42

42

43

43

45

45

47

8.1. Rotación de imagen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

8.2. Operación de espejado . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

8.3. Operación de traslación . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

54

55

56

9.1. Convolución . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

9.2. Aplicación de sharpening . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

9.3. Aplicación de filtro por mediana . . . . . . . . . . . . . . . . . . . . . . . . . . .

59

61

62

10.1. Operador de homogeneidad . . . . . . . . . . .

10.2. Operador por diferencia . . . . . . . . . . . . .

10.3. Aplicación de operador por diferencia . . . . .

10.4. Borde y derivadas en una dimensión . . . . . .

10.5. Aplicación de Sobel (threshold = 40, negativo)

10.6. Aplicación de Canny . . . . . . . . . . . . . . .

.

.

.

.

.

.

65

65

66

66

68

72

11.1. Transformada de Fourier . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

11.2. Filtros FFT . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

11.3. Filtro por frecuencia . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

78

79

81

12.1. Representación gráfica de una

12.2. Dilatación binaria . . . . . .

12.3. Dilatación binaria . . . . . .

12.4. Erosión binaria . . . . . . . .

12.5. Erosión binaria . . . . . . . .

12.6. Apertura y clausura . . . . .

83

84

85

86

86

87

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

imagen binaria

. . . . . . . . .

. . . . . . . . .

. . . . . . . . .

. . . . . . . . .

. . . . . . . . .

vii

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

List of Figures

13.1. Clasificación por k-means . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

13.2. Kd-tree . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

13.3. Nearest Neighbor Search . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

viii

94

95

95

Capı́tulo 1

Introducción

El procesamiento digital es el conjunto de técnicas computacionales que se aplican sobre las

imágenes con el objetivo de mejorar la calidad, alterar su morfologı́a, facilitar su interpretación o

proporcionar herramientas para la búsqueda de información. Aparece tardı́amente en la historia

de la computación, debido a los requisitos de hardware y los sistemas gráficos que permitieran

desarrollarla. El abaratamiento de los costos y la evolución de los equipos le dio un fuerte impulso

en los últimos tiempos.

En la actualidad existen muchas aplicaciones de software que permiten el procesamiento digital

de imágenes, ası́ como librerı́as para los diferentes lenguajes de programación. R, un lenguaje

libre destinado principalmente al análisis estadı́stico de datos, es quizá una excepción a la regla.

Las alternativas que se presentan para el manejo multipropósito de imágenes son escasas.

La posibilidad de integrar funcionalidad para el procesamiento de imágenes en un entorno estadı́stico, libre y con una comunidad muy bien organizada y en constante crecimiento, sumado

a las ventajas que suponen las utilidades estadı́sticas (cálculo de medias, desviaciones, histogramas), nos impulsaron a la realización de este proyecto. El objetivo fue, entonces, el de investigar,

estudiar, especificar e implementar un conjunto de algoritmos para R, que provea un entorno

funcional, útil y general para el procesamiento de imágenes, colaborando con la comunidad de

Software Libre, es decir, permitiendo de esta forma su libre uso y modificación.

Presentamos en este escrito el resumen de varios meses de trabajo. Intentamos ser precisos al

introducir los conceptos manejados, para que el lector tenga una buena lectura preparatoria, y

analizar en detalle las especificaciones, utilidades e implementaciones de los algoritmos elegidos

para formar parte del paquete.

Se realizó el estudio, análisis, especificación, implementación y testeo de técnicas para el manejo

de imágenes, que concluyeron con la creación y publicación de un paquete R, denominado biOps,

liberado bajo la licencia GPL y que se encuentra disponible en el repositorio oficial de paquetes

del lenguaje R. Además se comenzó con el trabajo de una interfaz gráfica de usuario, biOpsGUI,

para brindar una mejor experiencia de usuario.

1

Capı́tulo 1. Introducción

2

Creemos que el paquete obtenido es una importante colaboración con la comunidad R, que no

contaba con paquetes multipropósito de importancia en el procesamiento de imágenes. biOps, en

este sentido, resulta de gran utilidad, fácilmente extensible y con una amplia gama de algoritmos.

Consideramos que los trabajos futuros para la mejora del paquete debieran considerar la extensión de la interfaz gráfica, diversificar los formatos de imagen soportados, reconsiderar el manejo

en memoria de la representación de imágenes y añadir algoritmos para ampliar su utilidad (algoritmos supervisados de clasificación de imágenes, filtros, reconocimiento de patrones, machine

vision, etc.).

Estructura de este trabajo

Este texto se compone de dos partes principales: los capı́tulos 2 al 5 introducen conceptos relacionados a las etapas previas a la codificación. Se presentan la notación Z, lenguaje utilizado

para las especificaciones formales en este trabajo, y el lenguaje R, sobre el cual se implementaron

los algoritmos estudiados. Se desarrollan además, los conceptos relacionados con imágenes, sus

representaciones, modelos de color y los usos en las diversas áreas de aplicación. El capı́tulo 6

presenta una descripción de las secciones posteriores (capı́tulos 7 al 13), en los cuales se profundizan los conceptos, utilidades, especificación e implementación correspondientes a cada una de

las divisiones del paquete.

Para una visión global de este trabajo, recomendamos la lectura de los capı́tulos 1 (esta Introducción), 6 (descripción del paquete, contenidos del trabajo y capı́tulos posteriores) y 14

(recapitulación, evaluación, conclusiones y desafı́os para el trabajo futuro). Quien desee profundizar acerca de los lenguajes y notaciones utilizados, puede concentrarse en los capı́tulos 2 (el

lenguaje R, y sus interfaz con el lenguaje C) y 3 (la notación Z, de especificación de modelos

de sistemas computacionales). A los interesados en conceptos o implementaciones en una determinada rama del procesamiento digital de imágenes que hayan sido tratados en este trabajo,

sugerimos la lectura del capı́tulo correspondiente.

A continuación se presenta un breve resumen del contenido de los capı́tulos de este trabajo:

R [Cap. 2]: R es un lenguaje interpretado, de scripting, y un conjunto de librerı́as destinadas

principalmente al análisis estadı́stico de datos. El “Comprehensive R Archive Network” es

una red de sitios con las librerı́as que están disponibles para el uso en R. Se realiza una

breve descripción del lenguaje, sus procedimientos para colaborar con su comunidad, su

red de archivos y las interfaces para comunicarlo con otros lenguajes de programación. Se

comparan además algoritmos codificados en R y en C (mediante interfaz en R).

Z [Cap. 3]: Z es el nombre de la notación que utilizamos para la especificación de nuestro trabajo. Se presentan los conceptos básicos, definiciones de objetos necesarios para comprender

esta notación e implementación de los algoritmos del paquete y de una representación de los

números reales, basado esto último en la publicación de R. D. Arthan [Art96]. Se menciona

también a f uzz, con el cual realizamos la verificación de tipos de estas especificaciones.

Capı́tulo 1. Introducción

3

Imagen digital [Cap. 4]: Se presentan los conceptos necesarios para comprender la representación computacional de imágenes: la resolución espacial y de profundidad (detalles en una

imagen) y los modelos de color más conocidos (RGB, CYM y HSI). Se detalla además la

representación elegida para este trabajo e implementación para la obtención de imágenes

mediante R.

Procesamiento digital de imágenes [Cap. 5]: El procesamiento de imágenes es una rama

que data de principios de siglo pasado. Se relata su origen y las principales aplicaciones en

las diversas áreas donde es utilizado.

biOps: un paquete de procesamiento de imágenes en R [Cap. 6]: biOps es el nombre

del paquete que desarrollamos y que se encuentra publicado en el repositorio oficial de

paquetes R. Se detallan estructura, componentes y el comienzo de la implementación de su

interfaz gráfica: biOpsGUI. También se presenta una comparación contra otros paquetes R

de manejo de imágenes y una visión global de los capı́tulos posteriores:

Operaciones por pixel [Cap. 7]: Algoritmos de “tabla de reemplazos”, operaciones

aritméticas, lógicas, de representación gráfica (histogramas) y generación de ruidos.

Operaciones geométricas [Cap. 8]: Operaciones de rotación, escalado, espejado,

crop, shrink y traslación. Además, diversas formas de interpolación (vecino más cercano, bilineal, cúbica y por spline).

Operaciones por vecino [Cap. 9]: Concepto de convolución y aplicación de filtros

lineales y no lineales.

Algoritmos de detección de bordes [Cap. 10]: Algoritmos sencillos y rápidos

(homogeneidad y diferencia), métodos basados en convolución (Sobel, Prewitt, Roberts,

etc.) y algunas técnicas avanzadas (Shen Castan, Marr Hildreth, etc.).

Filtros en el espacio de frecuencias [Cap. 11]: Filtros mediante la transformada

rápida de Fourier.

Operaciones morfológicas [Cap. 12]: Operaciones para imágenes binarias y de

escala de grises, de erosión, dilatación y sus combinaciones: apertura y clausura.

Clasificación de imágenes [Cap. 13]: Se dividen en algoritmos supervisados y no

supervisados. Se detallan Isodata y K-Means (no supervisados).

Conclusiones [Cap. 14]: Una recapitulación, evaluación de herramientas y breve comentario de lo realizado. Se incluyen algunas estadı́sticas y los trabajos futuros que a nuestro

entender deberı́an ser prioritarios para mejorar el paquete.

Capı́tulo 2

R

R es un lenguaje interpretado, de scripting, y un conjunto de librerı́as destinadas principalmente

al análisis estadı́stico de datos. Es una implementación libre del lenguaje estadı́stico S , creado

a mediados de la década del ’70 por los Laboratorios Bell, aunque se ve influenciado también

por el lenguaje Scheme. Se distribuye sin costo y bajo la licencia GPL, y es el lenguaje sobre el

cual se ha llevado a cabo la implementación de los diversos algoritmos que forman parte de este

trabajo. R está construido principalmente sobre el lenguaje de programación C , aunque mucha

funcionalidad está escrita en R mismo. Además puede integrarse con otros lenguajes mediante

el uso de funciones especı́ficas, lo que nos permite una diversidad de opciones a la hora de tomar

decisiones de implementación. Se codificaron algunos algoritmos, objeto de este trabajo, tanto

con acceso a código realizado en C como a uso explı́cito de este lenguaje, y se compararon los

datos de eficiencia mediante algunas herramientas de profiling. La gran diferencia encontrada a

favor de las implementaciones con llamadas a código C , cuyas causas se mencionan, influenció en

su mayor uso en el resto de los algoritmos.

El “Comprehensive R Archive Network” es una red de sitios con las librerı́as que están disponibles

para el uso en R. Para colaborar con CRAN es necesario cumplir con una serie de requisitos que

hacen que los paquetes puedan funcionar correctamente y estar documentados de una manera

homogénea.

La comunidad R, en constante crecimiento, ha realizado diversas herramientas y comandos para

aliviar la tarea de los programadores que deseen colaborar con el proyecto. Entre ellas están los

comandos check y build , que se explican brevemente.

2.1.

Antecedente: El lenguaje S

Desde la segunda parte del siglo XX, y gracias al incremento del poder de cálculo de la computación, la estadı́stica se ha visto sustancialmente impactada. Este impacto ha traı́do dos consecuencias fundamentales: por un lado, la automatización del cálculo para los viejos métodos

estadı́sticos; y por el otro, el resurgimiento del interés en métodos menos estudiados, como los

4

Capı́tulo 2. R

5

no lineales, encabezados por las redes neuronales y los árboles de decisión. La abundancia en

recursos ha causado también el renacer de nuevos modelos lineales descartados con anterioridad.

Alrededor del año 1980 comienzan a surgir los lenguajes de programación especializados en

análisis estadı́sticos. Hoy en dı́a hay tantos como programadores emprendedores hubo en las

últimas décadas.

Entre los lenguajes que más popularidad han logrado, se encuentra S . La historia de este lenguaje

se remonta a mediados de los ’70, en los Laboratorios Bell. Hasta ese entonces, mucho de los

investigadores se valı́an de librerı́as del lenguaje Fortran (acrónimo de For mula Translator) para

realizar sus cálculos, sobre todo la librerı́a SCS (Statistical Computing Subroutines), rutinas

que se extendı́an según las necesidades. El impulso a realizar cálculos más simplistas que los que

proponı́a esta librerı́a, sumado a la paulatina disminución de código Fortran necesario para los

cálculos, hacen que Rick Becker, Allan Wilks y John Chambers comiencen el desarrollo de S

como una unidad independente.

S no fue el primer lenguaje con funcionalidad estadı́stica realizado por los Laboratorios Bell, pero

sı́ el primero en ser implementado. La primera implementación data del 1976 y funcionaba sobre

el sistema operativo GCOS (General Comprehensive Operating System). El nombre ’S’ (escrito

en un principio ası́, con comillas simples) fue elegido por ser esta letra comúnmente usada en

computación estadı́stica, siendo consistente con otros lenguajes de programación desarrollados

en la misma institución (léase el lenguaje de programación C , de uso frecuente en nuestros dı́as).

Tras una mutación no demasiado importante que hizo que pudiera empezar a utilizarse en el sistema operativo UNIX , por el año 1988, S sufre una serie de cambios de peso (en implementación

y, sobre todo, en sintaxis) y en 1991 se introduce el concepto de notación de fórmulas.

Este “nuevo” lenguaje es bastante parecido a las implementaciones actuales: S − Plus (versión

comercial de S , también conocida como S +), desarrollado por la empresa Insightful , y R (versión

libre), objeto de nuestro estudio, y en el cual centraremos toda la atención.

R también fue influenciado, sobre todo en lo que se refiere a implementación subyacente y

semántica, por el lenguaje Scheme 1 , desarrollado por Guy L. Steele y Gerald Jay Sussman en

los años ’70.

Actualmente, además de S − Plus 2 existen otras alternativas comerciales, que si bien no son

objeto de estudio en este trabajo, vale la pena mencionarlas: SAS 3 , Minitab 4 y SPSS 5 .

2.2.

R como implementación de S

La primera implementación de S como proyecto de software libre fue diseñada por Ross Ihaka

y Robert Gentleman en el Departamento de Estadı́sticas de la Universidad de Aukland, Nueva

1 http://www.schemers.org

2 http://www.insightful.com/products/splus

3 http://www.sas.com

4 http://www.minitab.com

5 http://www.spss.com

Capı́tulo 2. R

6

Zelanda. Le llamaron R, que surge por un juego con S , principal antecesor, y el primer nombre

de ambos autores.

Un gran grupo de personas han contribuido con el desarrollo de R mediante el aporte de código y

reportes de bugs desde su creación. Hacia mediados de 1997 se creó un grupo de desarrolladores

con permisos de modificación de las fuentes de R, el “R Core Team”, que se compone actualmente

de 17 personas, entre ellas sus primeros programadores Ihaka y Gentleman.

R es, en pocas palabras, la suma de un lenguaje de scripting, un intérprete y un conjunto muy

completo de módulos built-in para el manejo de datos y trabajos estadı́sticos. Consta de dos

componentes principales: el lenguaje propiamente dicho y el intérprete, con los cuales se puede

manejar gráficos, efectuar tareas de depuración y debugging, ası́ como también acceder a algunas

funciones del sistema y correr scripts desde código guardado en archivos.

R integra programas para la manipulación de datos, cálculo y gráficos. Dispone de una gran

cantidad de librerı́as, con un fuerte hincapié en el manejo de datos y funcionalidades estadı́sticas.

Cuenta además con:

Almacenamiento y manipulación eficaz de datos

Operadores para variables indexadas, en particular matrices (y arreglos, es decir, matrices

unidimensionales)

Una amplia colección integrada de herramientas para el análisis de datos

Funcionalidad de impresión gráfica en pantalla o impresora

El lenguaje de programación incluye condicionales, ciclos, funciones recursivas y de entrada/salida. Muchas de las funcionalidades que provee están escritas en R mismo, si bien gran parte de

las librerı́as básicas están escritas en C .

R puede integrarse con distintas bases de datos y existen librerı́as que facilitan su utilización

desde lenguajes de programación interpretados (como Perl y Python) o desde lenguajes de código

compilado (como C , C + + y Fortran), como veremos más adelante para el caso particular que

nos interesa. La lista de los lenguajes en los cuales pueden agregarse funcionalidad está creciendo

con el correr del tiempo, a medida que éstos aumentan en eficiencia o popularidad, y a medida

que R crece como utilidad para el usuario.

Una amplia colección de librerı́as se encuentran en CRAN 6 (Comprehensive R Archive Network),

una red de sitios que cuentan con idéntico contenido (mirrors), tanto de código como de documentación y de archivos binarios, y que mantienen la información que rodea a R actualizada

y a disposición de toda la comunidad. En CRAN se mantienen, también, una lista de correo

electrónico y un sistema de seguimientos de bugs.

R se utiliza mucho en la investigación biomédica, la bioinformática y la matemática financiera.

Los proyectos más conocidos basados en R son Bioconductor 7 , destinado al análisis de datos en

6 http://cran.r-project.org

7 http://www.bioconductor.org

Capı́tulo 2. R

7

genética y biologı́a molecular, y Rmetrics 8 , dedicado al análisis de técnicas de mercadotecnia y

evaluación de instrumentos financieros.

R se distribuye bajo la licencia GNU GPL y está disponible para la mayorı́a de los sistemas

operativos existentes (incluidas excentricidades como adaptaciones para funcionar en la consola

PlayStation2 y otras)

R tiene su propio formato de documentación, similar al reconocido LATEX. Esta documentación

es obligatoria para la aceptación de paquetes en CRAN , lo que hace que los agregados tengan

la chance de ofrecer documentación comprensible en varios formatos.

La distribución de R cuenta con muchos procedimientos con fines estadı́sticos, entre los que se encuentran: modelos lineales y generalizados, modelos de regresión no lineales y análisis de tiempos

de series, asi como también funcionalidad de gráficos y representaciones de datos. Es relativamente sencillo agregar nuevas utilidades, mediante lo que se denominan “add-on”s, módulos de

propósitos especı́ficos.

2.3.

Interfaz contra lenguajes compilados

R nos ofrece la posibilidad de acceder a código compilado que haya sido linkeado previamente.

Este link se puede realizar en tiempo de creación del módulo o bien dinámicamente mediante

la función dyn.load . A través de la función .C se genera una interfaz a código compilado en C

o C + +. Los argumentos que se le pasan a esta función son generalmente copiados antes de la

ejecución del código, y también son copiados a una lista de argumentos en R cuando la función a

la cual accedemos ha retornado su valor. Los argumentos pueden pasarse con nombre, de forma

tal de tener un fácil acceso a ellos en su posterior manejo. R tiene un mecanismo de pasajes de

parámetros por defecto que transforma cada tipo del código en un tipo del código C . La lista de

tipos para los cuales R conoce mecanismos de transformación es acotada, pero puede extenderse,

en caso de requerirse, de una manera sencilla. Para este último caso, es preferible el uso de otras

funciones de ejecución de código compilado. La función .Call es la que se utiliza generalmente,

y que da un mecanismo para pasar directamente a C algunos tipos más complejos de R como

las listas. En el caso del lenguaje C , de interés para este trabajo, podemos ver en la siguiente

tabla la tranformación que sufren los principales modos de almacenamiento:

Mapeo de tipos

R

C

logical

int∗

integer

int∗

double

double∗

complex

Rcomplex ∗

character

char ∗ ∗

raw

char ∗

8 http://www.itp.phys.ethz.ch/econophysics/R

Capı́tulo 2. R

8

Con type∗ se denota al puntero a type, es decir, la dirección de memoria de una variable de tipo

type. Rcomplex se refiere a una estructura en C incluida en los archivos de cabecera que provee

el lenguaje R.

2.4.

R puro vs. interfaz C

La facilidad que presenta R de escribir add − ons en otros lenguajes (nombrados de forma breve

anteriormente) se enfrenta con las ventajas que encuentran algunos desarrolladores de basar sus

módulos sin la intervención explı́cita de otros lenguajes. La mayor parte de las librerı́as de R

están escritas en C , por la indiscutible eficiencia de este lenguaje.

Existe una forma de generar un análisis estadı́stico de un script en R que muestre el uso de

procesador y el porcentaje de tiempo de ejecución que cada parte del script ha utilizado. Lo

anterior es mucho más fácil de decir en inglés, para lo cual tenemos una palabra que lo expresa:

profiling.

Para hacer profiling en R puede llamarse a la función Rprof , entre cuyos argumentos se encuentran el tiempo (medido en segundos) a esperar para hacer un muestreo del stack del proceso (en

general, este número debe ser cercano a 15/20 milisegundos, ya que un número menor harı́a que

el tiempo necesario para recolectar la información se vea superpuesto con la siguiente consulta al

stack, y un número mayor perjudicarı́a la precisión del análisis), y el nombre del archivo en el cual

(sobre)escribir la información recolectada. De esta manera, si bien el script que se está corriendo

baja un poco su performance, es posible identificar las partes en que la ejecución ha invertido

más o menos tiempo. Los mecanismos que se usan para el profiling son los mismos que usa el

lenguaje C, con lo que estas herramientas no pueden usarse conjuntamente.

Los test para Windows y sistemas operativos UNIX puede que arrojen resultados distintos,

puesto que el intervalo fijo que se establece para el muestreo del stack corresponde a uso del

tiempo del CPU en UNIX , y simplemente tiempo nominal en Windows. Sin embargo, ante igual

carga de CPU, los resultados no deberı́an variar para los distintos sistemas operativos.

La función Rprof consulta el estado de la ejecución periódicamente y escribe en el archivo

indicado el estado encontrado. El archivo generado puede tratarse de varias formas. Entre las

que nos ofrece la distribución de R se encuentran:

Mediante un script en Perl (comando de R) llamado también Rprof .

Una función del lenguaje llamada summaryRprof que devuelve un objeto en R que puede

ser analizado.

Este tipo de análisis se utilizan para identificar “cuellos de botella” o partes de código en R que

pueda ser beneficioso reemplazar por código compilado. Para que los resultados sean provechosos,

es necesario que las corridas sean lo suficientemente grandes como para que el tiempo en que el

lenguaje realiza garbage collections sean depreciables; caso contrario es posible que encontremos

resultados que no sean demostrativos para la experiencia que realizamos.

Capı́tulo 2. R

9

La bibliografı́a consultada es redundante en cuanto a la mayor eficiencia de las implementaciones

en código compilado en C contra las implementaciones puras en el lenguaje R. Sin embargo,

parte de nuestro interés era comparar cuantitativamente estas diferencias para algunos casos de

nuestro proyecto, de forma tal de tomar una decisión al respecto basada en la aplicación directa

de nuestras implementaciones.

Para ello, codificamos una selección de algoritmos tanto con acceso a código C como sin él

(y aquı́ hablamos de “sin acceso explı́cito”), para realizar luego un análisis con la herramienta

anteriormente mencionada.

A continuación se muestran los resultados obtenidos para un algoritmo de Look-up tables (decrementar contraste, función imgDecreaseContrast), que se detallan en 7.1.1, y, para uno de

operaciones aritméticas (diferencia de imágenes, función imgDiffer ), detallados en 7.2. El resto

de los resultados pueden encontrarse en el Apéndice A:

r_ de c_ con tr as t vs . i m g D e c r e a s e C o n t r a s t

Each sample represents 0.15 seconds .

Total run time : 1 9 7 7 . 9 0 0 0 0 0 0 0 0 4 7 seconds .

Total seconds : time spent in function and callees .

Self seconds : time spent in function alone .

%

total

99.79

99.78

...

0.21

0.21

...

0.06

...

total

seconds

1973.70

1973.55

%

self

48.40

...

0.06

0.05

...

self

seconds

957.30

%

self

0.00

48.40

self

seconds

0.00

957.30

name

" r_ de c_c on tr as t "

" r _ l o o k _u p _ t a b l e "

4.20

4.20

0.00

0.00

0.00

0.00

" imgDecreaseContrast "

" . imgContrast "

1.20

0.06

1.20

".C"

1.20

0.90

%

total

99.78

0.06

0.05

total

seconds

1973.55

1.20

0.90

name

" r _ l o o k _u p _ t a b l e "

".C"

" as . vector "

r_imgDiffer vs . imgDiffer

Each sample represents 0.15 seconds .

Total run time : 3 5 9 2 . 5 0 0 0 0 0 0 0 1 4 5 seconds .

Total seconds : time spent in function and callees .

Self seconds : time spent in function alone .

%

total

99.61

...

0.39

0.39

0.29

...

total

seconds

3578.40

%

self

self

seconds

14.10

14.10

10.35

%

self

53.47

0.00

0.00

0.29

%

total

self

seconds

1920.90

0.00

0.00

10.35

total

seconds

name

" r_imgDiffer "

". imgArithmeticOperator "

" imgDiffer "

".C"

name

Capı́tulo 2. R

53.47

...

0.29

0.25

...

10

1920.90

10.35

9.00

99.61

0.29

0.25

3578.40

10.35

9.00

" r_imgDiffer "

".C"

":"

En el primero de los listados de estos resultados se encuentran las funciones llamadas en la

ejecución, ordenadas por el porcentaje de tiempo ocupado dentro de cada una (y de aquellas a

las cuales ha llamado). El segundo listado corresponde al orden según el porcentaje del tiempo

ocupado sólo por la función (y no por las llamadas anidadas).

Notamos para el caso de la función de decrementar contraste (r dec contrast vs. imgDecreaseContrast)

que la relación de uso de CPU fue de aproximadamente 475 a 1 (475.1904) y para la función de

diferencia de imágenes (r imgDiffer vs. imgDiffer ) fue de 255 (255.4102) a 1, en ambos casos a

favor de las implementaciones con acceso a código C.

No resta demasiado análisis por hacer. Lo que valdrı́a preguntarse es el por qué de semejante

diferencia. La respuesta puede buscarse de entre las siguientes justificaciones:

Lo principal es recordar que C es un lenguaje compilado y R uno interpretado, con lo

que hay una capa de abstracción (al menos) de diferencia. Además, muchas de las optimizaciones a código fuente que hacen los códigos compilados se pierden para el caso de los

interpretados.

Las funciones de acceso a algunas estructuras de datos en R verifican ciertas condiciones

(como la validez del lugar de memoria a acceder), lo cual hace que las estructuras de R

subyacentes (implementadas en C ) sean más complejas y tengan chequeos que no nos eran

necesarios realizar en nuestro código C (esto hace a R un lenguaje más robusto que C ,

pagando el precio de la eficiencia).

El uso, en algunos casos, de funciones no del todo adecuadas pero que se pegaban más a

las especificaciones de los algoritmos. Por caso, en las look-up tables, se usa una estructura

de memoria contigua (tal como lo describen los algoritmos). Sin embargo, esta razón no es

del todo válida: una evaluación para estos casos (cambiando es uso de memoria contigua

por las funciones mapply y el uso de funciones en los parámetros) arrojó, para el caso de

decrementar contraste, una relación de 433.78 a 1. Es decir, del mismo orden de magnitud

que las pruebas anteriores.

2.5.

Colaboración a CRAN

La colaboración con la comunidad R puede hacerse de diversas formas. Existen sistemas de bugtracking, para el reporte y discusión de bugs, manejo de versiones, utilidades diversas como de

testeo de nuevos paquetes, interfaz de intérprete por web y un largo etcétera. La comunidad

R crece a un ritmo sorprendente, y es uno de los mejores ejemplos de cómo la colaboración de

anónimos puede hacer crecer el software libre muy por encima de los programas de software

privativo.

Capı́tulo 2. R

11

CRAN (explicado brevemente en la sección anterior) recibe las colaboraciones de paquetes. Antes

de subir un paquete nuevo, es necesario seguir ciertos pasos que garanticen su funcionabilidad y

documentación, entre otras cosas. El grupo de desarrollo de R ha creado un comando a tal fin:

check . Este comando verifica que el paquete pueda instalarse, que los ejemplos corran y que la

documentación con la cual debe liberarse exista, esté completa y pueda ser procesada por los

formateadores (la documentación de un paquete se crea en los formatos de texto plano, HTML

y TEX). Si es necesario compilar código, también chequea que esto pueda hacerse correctamente.

Se verifica además que la estructura de archivos y directorios sea la adecuada: es necesario que

existan ciertos archivos de configuración y de ayuda, los cuales usualmente contienen scripts de

verificación de librerı́as requeridas e información acerca de las licencias y caracterı́sticas generales.

Este comando debe finalizar su ejecución sin errores ni advertencias para que el paquete sea

aceptado en el repositorio. Con el comando build puede generarse un archivo comprimido listo

para liberar una versión de nuestro paquete. La “entrega” se realiza mediante la carga del

archivo a un repositorio temporario (FTP ) de paquetes y el envı́o de un correo electrónico a los

mantenedores de CRAN .

Capı́tulo 3

Z

Las especificaciones pueden ser provechosas en muchos sentidos: describen propiedades sin inmiscuirse en implementaciones, son referencia constante para todos los individuos involucrados

de una u otra forma en el proceso de creación de software (investigadores, codificadores, testers,

documentadores, clientes, etc.) y forman la estructura básica para la etapa de codificación. La

matemática ha ayudado a formalizar estos conceptos a través del concepto de tipos.

Z es el nombre de la notación que utilizamos para la especificación de nuestro trabajo. En este

capı́tulo se presentan las notaciones básicas y definiciones de objetos necesarios para comprenderla. Ellos son: definiciones, abreviaciones, definiciones axiomáticas, definiciones genéricas y

esquemas.

Z es un lenguaje tipado, lo que permite la creación de algoritmos para la verificación automática

de tipos y ámbito de variables. Entre todas las herramientas disponibles a tal fin, elegimos f uzz

para este trabajo, por tener una notación simple y adaptaciones para su impresión en formatos

como LATEX.

Al disponer sólo del tipo de los números enteros (caracterı́stica de Z ), vimos la necesidad de

definir el tipo que represente los números reales (y varios de sus subconjuntos), de modo de

clarificar notaciones y hacer nuestras especificaciones de lectura natural e intuitiva. Para ello nos

basamos en una publicación de R. D. Arthan que axiomatiza este conjunto de forma precisa.

Con esta extensión fue posible definir nuestro esquema de representación de una imagen y a

partir de allı́ modelar los algoritmos que componen este trabajo, y que serán tratados en los

sucesivos capı́tulos.

3.1.

Las especificaciones formales

Las especificaciones formales usan la notación matemática para describir de una forma precisa las

propiedades que debe tener un sistema de información, sin restringir excesivamente la forma en

que estas propiedades son alcanzadas. Describen qué debe hacer el sistema sin decir cómo debe

12

Capı́tulo 3. Z

13

hacerlo. Esta abstracción hace de la especificación formal una herramienta útil en el proceso de

desarrollo de sistemas de computación, porque permiten que las preguntas acerca de lo que hace

el sistema puedan ser respondidas de una manera confiable, sin la necesidad de desenmarañar la

información de una masa de código detallada, o especular acerca del significado de frases en una

descripción en prosa imprecisa.

Una especificación formal puede servir como un punto de referencia simple y confiable para

quienes investiguen las necesidades de los clientes, para quienes implementen los programas para

satisfacer esas necesidades, para aquellos que testeen los resultados y para aquellos que escriban

la documentación del sistema. En definitiva, es una herramienta que puede ser útil para todos

los integrantes del proceso de desarrollo.

Al ser independiente del código del programa, la especificación formal de un sistema puede ser

realizada en las primeras etapas del proceso de desarrollo. Aún cuando cambie a medida que se

gane en comprensión del problema y percepción de la evolución de las necesidades del cliente,

puede ser una media apreciable para promover un entendimiento común entre todos los roles

involucrados en el sistema.

Una forma en que la notación matemática puede ayudar a alcanzar estos objetivos es a través

del modelo de tipos de datos matemáticos del sistema. Estos tipos de datos no están orientados a

la representación computacional, pero responden a un conjunto de leyes que hacen posible sacar

conclusiones efectivas acerca del comportamiento que tendrá un sistema especificado.

3.2.

El lenguaje de especificación Z

Z es un lenguaje de especificación que trabaja a altos niveles de abstracción. Esto permite que

aún comportamientos complejos puedan ser descriptos precisa y consisamente. Originalmente

propuesto por Jean-Raymond Abrial en 1977 con la ayuda de Steve Schuman y Bertrand Meyer,

fue desarrollado por el grupo de Investigación de Programación de la Universidad de Oxford.

Ha sido sometido en los últimos años a estandarización de la Organizacion Internacional de

Estandarización (ISO).

La semántica de Z es matemática; de esta manera las fórmulas pueden ser manipuladas algebraica

y lógicamente.

En Z usamos la notación de predicados lógicos para describir abstractamente el efecto de cada

operación del sistema, de una forma que permite sacar conclusiones y hacer análisis acerca de

su comportamiento.

La notación está basada en teorı́a de conjuntos y lógica matemática. La teorı́a de conjuntos

usada incluye operadores de conjunto básicos y por comprensión, productos cartesianos y partes

de conjuntos. La lógica matemática es un cálculo de predicados de primer orden. Juntos, forman

un lenguaje matemático que es fácil de entender y, sobre todo, de llevar a la práctica.

Otro aspecto es cómo se puede estructurar este lenguaje. En Z esto se responde con el concepto de

esquemas: una declaración de patrones y restricciones. El lenguaje de esquemas puede ser usado

Capı́tulo 3. Z

14

para describir el estado del sistema, y las formas en que este estado puede cambiar. También

puede describir propiedades del sistema y ayudar a pensar acerca de posibles refinamientos del

diseño.

Los esquemas se utilizan para describir aspectos dinámicos y estáticos. Estos últimos incluyen:

los estados que ocupa; y

las relaciones invariantes que son mantenidas en el movimiento de estado a estado en el

sistema

Los aspectos dinámicos incluyen:

las operaciones posibles;

la relación entre las entradas y las salidas; y

los cambios de estados que pueden ocurrir

Una de las caracterı́sticas principales de Z es el uso de tipos. Además de ser esto un enlace de

extrema utilidad para el momento de la codificación, puede ser sujeto de chequeos automáticos.

Existen varias herramientas a tal fin, entre las que se encuentra f uzz, la cual describiremos

brevemente más adelante (sección 3.4).

Otro aspecto es el uso del lenguaje natural: usamos el lenguaje matemático para determinar el

problema y eventualmente encontrar soluciones, e incluso para probar que los diseños cumplen

con la especificación. El uso del lenguaje natural relaciona la matemática con los objetos de la

vida real, y es esencial para hacer que las especificaciones sean realmente obvias para el lector.

3.3.

Definiciones en Z

A modo introductivo presentamos algunos de los conceptos sobre los cuales se basa el lenguaje

de especificación Z , que serán de utilidad para la comprensión de las especificaciones del trabajo.

3.3.1.

Declaraciones

Es la forma más simple de declarar un objeto en Z . Se utiliza en especial para tipos básicos o

conjuntos dados. Se denotan por una declaración del nombre entre corchetes:

[A]

Este tipo de declaraciones introduce un nuevo tipo, con lo que podremos declarar variables con

ese tipo en el futuro:

Capı́tulo 3. Z

15

0:A

3.3.2.

Abreviaciones

Es la manera en que se puede definir un objeto a partir de otros existentes, cuando sus objetos

y estados son iguales:

VALUE == MinValue . . MaxValue

3.3.3.

Definiciones axiomáticas

Se pueden introducir objetos con restricciones, como las que deben asumirse cuando un sı́mbolo

es usado. Estas restricciones se interpretan como axiomas del objeto:

declaracion

predicado

donde predicado simboliza las restricciones del objeto u objetos declarados en declaracion.

Por ejemplo:

TopValue : N

TopValue = MaxValue + 1

Introduce un nuevo sı́mbolo, TopValue, que satisface el predicado que se menciona. Como en

este ejemplo, las declaraciones pueden restringirse hasta el punto que se denote sólo un objeto.

3.3.4.

Definiciones genéricas

Se utilizan para definir una familia de constantes globales, parametrizadas por algún conjunto:

[Y ]

y :Y

predicado

Capı́tulo 3. Z

16

introduce una constante genérica de tipo Y, satisfaciendo el predicado predicado. Notar que Y

es, en este caso, un parámetro formal: puede considerarse como un tipo básico con visibilidad en

esta definición genérica.

A modo de ejemplo, tenemos la definición utilizada en el trabajo para obtener el largo de una

secuencia:

[X ]

# : seq X

"N

#hi = 0

∀ i : seq X | i 6= hi • # i = 1 + # (tail i)

3.3.5.

Esquemas

Además del lenguaje matemático, en Z tenemos el lenguaje de esquemas, usado principalmente

para rejuntar partes de información, encapsularlas y nombrarlas para su futura reutilización. Este

último aspecto es de vital importancia para las técnicas formales: con ello podemos mantener

nuestras descripciones flexibles y manejables.

La forma general de los esquemas es esta:

NombreDeEsquema

declaraciones

predicados

A modo de ejemplo, nuestro esquema para representar una imagen:

Image

v : VALUES

width, height : N

dom v = {a : N × N | 0 ≤ first a < width ∧ 0 ≤ second a < height}

3.4.

f uzz

f uzz es un conjunto de herramientas de formateo e impresión de especificaciones en Z , y algoritmos para verificaciones de alcance y reglas de tipos conforme a la especificación de este

lenguaje.

Entre las herramientas de formateo se incluyen archivos de estilo para LATEX, y la definición

de un conjunto con sı́mbolos especiales propios de estas especificaciones. Para su uso f uzz provee, entre otros, de los siguientes entornos, los cuales fueron mencionados en la sección 3.3: zed ,

Capı́tulo 3. Z

17

axdef , gendef y schema, respectivamente para texto en prosa y fuera de estructuras, definiciones axiomáticas, definiciones genéricas y esquemas. Existen otros entornos disponibles que no

mencionaremos en este breve resumen.

Para este trabajo hicimos uso de sus dos funcionalidades principales. En la impresión actual se

utilizaron las herramientas que permiten que los diagramas y sı́mbolos especiales puedan verse

correctamente y mezclarse con texto en prosa, como es caracterı́stico en muchos formatos de

especificación. Y para la diagramación del código Z para los algoritmos implementados, hicimos

uso del chequeador de tipos y alcance de variables, lo cual es mı́nimamente necesario en cualquier

chequeo de especificaciones.

El comando f uzz puede configurarse para tener dos tipos de salida: con la opción −v obtenemos

un reporte en código ASCII de una representación de cada párrafo en Z ; y con la opción −t se

listan el tipo de cada nombre definido globalmente, en una representación fácil de leer. Además,

los esquemas son expandidos, para que resulte claro ver qué componente tiene cada uno. La

salida de esta última opción se incluye en formato digital con este trabajo (tal como se describe

en la sección 6.6).

3.5.

3.5.1.

Especificación en Z

Especificación de reales

En la especificación de software generalmente vienen incluidas ciertas nociones de tipos. En Z ,

esta noción es muy acotada: un tipo es un conjunto maximal, al menos para los lı́mites de la

especificación en cuestión. Esto trae como consecuencia que cada valor x en una especificación

esté asociado exactamente a un tipo: el conjunto más grande s para el cual x ∈ s.

La notación Z tiene un solo tipo built − in (esto es, propio de la notación): el conjunto de todos

los enteros Z . Cualquier otro tipo puede construirse a base de éste, o de valores de tipos básicos

(sobre los cuales no pueden asumirse ninguna propiedad).

Muchos de los algoritmos que presentamos en nuestra implementación requieren de una precisión

que los enteros no nos brindan de forma natural. Es fácil determinar una biyección entre los

números enteros y los reales de precisión acotada, pero el manejo de los mismos se torna tedioso

y la representación no obedece a las costumbres sobre el manejo de valores que arrastramos

en la educación que recibimos. Por esta razón, y por la estructura de imágenes que creimos

conveniente utilizar (aunque esta estructura y la representación de valores están ı́ntimamente

relacionadas) y que mencionaremos en esta sección, es que necesitamos la especificación de un

tipo que represente más fidelignamente a los reales.

Para tal fin nos basamos en la publicación de [Art96], “Arithmetics for Z”, la cual está fuertemente inspirada en el estándar [Dep95]. La especificación que realizamos incluye la axiomatización

necesaria para definir el conjunto de los números reales y sus operaciones básicas (de acuerdo a

lo que nos resultaba excluyente disponer).

La axiomatización se caracteriza por tres propiedades de los números reales:

Capı́tulo 3. Z

18

1. Los reales forman un campo

2. El campo de los reales puede ordenarse linealmente de forma que este orden sea compatible

con la suma y la multiplicación. Para definir dicho orden es suficiente con encontrar un

conjunto R, cerrado por multiplicación y suma, tales que Rp , Rn y {0} conformen una

partición del campo.

3. Cualquier subconjunto no vacı́o de los reales, acotado inferiormente con respecto al orden

establecido en el punto anterior, tiene una cota inferior maximal.

Estas propiedades caracterizan a los reales (o cualquier isomorfismo) y una consecuencia de ello

es la existencia de un anillo incluido en este conjunto, que es isomorfo a los enteros.

Esta axiomatización es similar a las vistas en los libros de cálculo. Comenzamos con un conjunto

maximal, que llamamos A

[A]

A partir de él, definimos el conjunto Z (el cual “redefinimos”),

Z : A

y dos de sus elementos:

0:A

1:A

El resto de operaciones y axiomas se detallan a continuación:

+ :A×AA

∼

:AA

N : Z

(Z × Z ) ( + ) ∈ Z × Z

Z

(

∼

)∈Z

"Z

"Z

{0, 1} ⊆ Z

∀ i , j , k : Z • (i + j ) + k = i + (j + k )

∧i +j =j +i

∧ i + ∼i = 0

∧i +0=i

∀ h : Z • 1 ∈ h ∧ (∀ i, j : h • i + j ∈ h ∧ ∼ i ∈ h) ⇒ h = Z

T

N = {s : Z | 0 ∈ s ∧ {i : s • i + 1} ⊆ s}

∼

1∈

/N

Capı́tulo 3. Z

19

− :A×AA

(Z × Z ) ( − ) ∈ Z × Z

"Z

∼

∀ i, j : Z • i − j = i + ( j )

≤ , < , ≥ , > :A#A

∀ i , j : Z • (i ≤ j ⇔ j − i ∈ N )

∧ (i < j ⇔ i + 1 ≤ j)

∧ (i ≥ j ⇔ j ≤ i )

∧ (i > j ⇔ j < i )

∗ :A×AA

(Z × Z ) ( ∗ ) ∈ Z × Z

"Z

∀ i , j , k : Z • (i ∗ j ) ∗ k = i ∗ (j ∗ k )

∧i ∗j =j ∗i