Inferencia estadística

Anuncio

Inferencia estadística - Estimación puntual

La estadística provee técnicas que permiten obtener conclusiones generales a partir de un

conjunto limitado – pero representativo – de datos. Cuando inferimos no tenemos

garantía de que la conclusión que obtenemos sea exactamente correcta. Sin embargo, la

estadística permite cuantificar el error asociado a la estimación.

La mayoría de las distribuciones de probabilidad dependen de cierto número de

parámetros. Por ejemplo: P (λ ), N ( µ , σ 2 ), Bi (n, p ), etc. Salvo que estos parámetros se

conozcan, deben estimarse a partir de los datos.

El objetivo de la estimación puntual es usar una muestra para obtener números que, en

algún sentido, sean los que mejor representan a los verdaderos valores de los parámetros

de interés.

Supongamos que se selecciona una muestra de tamaño n de una población. Antes de

obtener la muestra no sabemos cuál será el valor de cada observación. Así, la primera

observación puede ser considerada una v.a. X1, la segunda una v.a. X2, etc. Por lo tanto,

antes de obtener la muestra denotaremos X1, X2,...., Xn a las observaciones y, una vez

obtenida la muestra los valores observados los denotaremos x1, x2,...., xn.

Del mismo modo, antes de obtener una muestra, cualquier función de ella será una v.a.,

~

por ejemplo: X , X , S 2 , max ( X 1 ,..., X n ), etc. Una vez obtenida la muestra los valores

calculados serán denotados x , ~

x , s 2 , max( x1 ,..., x n ), etc.

Definición: Un estimador puntual de un parámetro θ es un valor que puede ser

considerado representativo de θ y se indicará θˆ . Se obtiene a partir de alguna función de

la muestra.

Ejemplo: Con el fin de estudiar si un dado es o no equilibrado, se arroja el dado 100 veces

en forma independiente, obteniéndose 21 ases. ¿Qué valor podría utilizarse, en base a

esa información, como estimación de la probabilidad de as? Parece razonable utilizar la

frecuencia relativa de ases.

En este caso, si llamamos p a la probabilidad que queremos estimar, pˆ =

21

= 0.21

100

Métodos de estimación puntual

¿Cómo obtener estimadores para un problema dado? Estudiaremos dos métodos que

proporcionan estimadores puntuales: el método de momentos y el método de máxima

verosimilitud.

Método de momentos: La idea básica consiste en igualar ciertas características

muestrales con las correspondientes características poblacionales. Recordemos la

siguiente definición.

158

Definición: Sea X una v.a. con función de probabilidad puntual p X (x) en el caso discreto

o función de densidad f X (x) en el caso continuo. Se denomina momento de orden k

(k ∈ N) o momento poblacional de orden k a E(Xk), es decir

∑ x k p X ( x)

x

E( X k ) = ∞

k

∫ x f X ( x) dx

- ∞

en el caso discreto

en el caso continuo

si esas esperanzas existen.

Como ya hemos visto cuando estudiamos función generadora de momentos de una

variable aleatoria, los momentos están relacionados con los parámetros de la distribución

asociada.

Dada una muestra aleatoria X 1 , X 2 ,..., X n , el momento muestral de orden k es

n

k

∑ Xi

i =1

n

Definición: Sea X 1 , X 2 ,..., X n una m.a. de una distribución con función de probabilidad

puntual o función de densidad que depende de m parámetros θ 1 , θ 2 ,...., θ m . Los

estimadores de momentos de θ 1 , θ 2 ,...., θ m son los valores θˆ1 , θˆ2 ,...., θˆm que se obtienen

igualando m momentos poblacionales con los correspondientes momentos muestrales. En

general, se obtienen resolviendo el siguiente sistema de ecuaciones

n

∑X

i =1

k

i

( )

=E Xk

n

k = 1,2,..., m

Ejemplos: 1) Sea X 1 , X 2 ,..., X n una m.a. de una distribución exponencial de parámetro λ.

Como hay un solo parámetro a estimar, basta plantear una ecuación basada en el primer

momento.

n

∑ Xi

i =1

n

n

= E(X ) ⇒

∑X

i =1

n

i

=

1

λ

⇒

λˆ =

n

⇒

n

∑X

i =1

1

λˆ =

X

i

159

2) Sea X 1 , X 2 ,..., X n una m.a. de una distribución Γ(α, λ). Como hay dos parámetros a

estimar, planteamos un sistema de ecuaciones basadas en el primer y en el segundo

momento.

Usando

que

si

X

Γ(α,

~

E( X ) =

λ),

V ( X ) = E ( X 2 ) − (E ( X ) ) ,

α

λ

V (X ) =

y

α

λ2

y

la

relación:

2

n

∑ Xi

i =1

= E( X )

n

n

∑ X i2

i =1

2

n = E ( X )

Reemplazando

n

∑ Xi α

i =1

=

n

λ

n

2

∑ X i

2

α α

i =1

n = λ 2 + λ

⇒

α

= X , en la segunda ecuación, se obtiene:

λ

n

∑X

i =1

2

i

n

=

X

λ

+X2

y, despejando λ :

n

X

λ

=

∑X

i =1

n

2

i

−X2

λˆ =

⇒

X

n

∑X

i =1

n

2

i

−X2

Finalmente, reemplazando el estimador de λ en la primera ecuación, obtenemos el

estimador de α :

αˆ =

X2

n

∑X

i =1

n

2

i

−X2

3) Sea X 1 , X 2 ,..., X n una m.a. de una distribución U(0,θ). Como hay un único parámetro

a estimar, planteamos una ecuación basada en el primer momento.

160

n

∑X

i =1

n

i

= E( X ) =

θ

2

⇒

θˆ = 2 X

4) Veamos por último un ejemplo que nos muestra que no siempre podemos utilizar los

momentos en el orden natural. Sea X 1 , X 2 ,..., X n una m.a. de una distribución U(-θ,θ).

Como hay un único parámetro a estimar, parece natural plantear una ecuación basada en

el primer momento. Sin embargo, si lo hacemos,

n

∑X

i =1

i

n

= E( X ) = 0

Observamos que el primer momento poblacional no depende de θ y por lo tanto no

podemos despejar a partir de esta ecuación el estimador del parámetro. En este caso, es

necesario plantear una ecuación basada en el segundo momento:

n

∑ X i2

i =1

n

n

= E( X 2 ) =

(2θ )2

12

=

θ2

3

⇒

θˆ =

3 ∑ X i2

i =1

n

Método de máxima verosimilitud: Este método fue introducido por Fisher en la década

de 1920. Se basa en la idea de, dada una muestra, hallar los valores de los parámetros

que hacen que la probabilidad de obtener dicha muestra sea máxima.

Ejemplo: Se realiza una encuesta de opinión a una m.a. de 20 personas. Se les formula

una única pregunta que será respondida por Si o por NO. Sean X 1 , X 2 ,..., X 20 las v.a.

correspondientes a la respuesta, tales que

1

Xi =

0

si la persona i responde SI

si la persona i responde NO

para i =1, 2, ..., 20 y sea p = P( X i = 1) .

Observemos que las v.a. X i son independientes y cada una de ellas tiene distribución

Bi(1,p). Entonces, la función de probabilidad conjunta del vector ( X 1 , X 2 ,..., X 20 ) es

x

1− x20

x

1− x x

1− x2

p ( x1 , x 2 ,..., x 20 ) = p 1 (1 − p ) 1 p 2 (1 − p )

... p 20 (1 − p )

161

Si en la muestra obtenida se observan 7 NO’s (0) y 13 SI’s (1), sería

p ( x1 , x 2 ,..., x 20 ) = p

13

(1 − p )

7

La pregunta es: ¿qué valor de p hace que los valores muestrales obtenidos sean los más

probables?

Es decir, buscamos el valor de p que hace máxima p ( x1 , x 2 ,..., x 20 ) o equivalentemente

ln p ( x1 , x 2 ,..., x 20 ) ya que ln es una función monótona creciente. Debemos maximizar la

siguiente función de p

g ( p ) = ln p ( x1 , x 2 ,..., x 20 ) = 13 ln( p ) + 7 ln(1 − p )

Para ello, como esta función es derivable respecto de p, buscamos los posibles puntos

críticos, igualando a 0 la derivada primera.

0=

∂g ( p ) 13

13(1 − p ) − 7 p 13 − 20 p

7

=

= −

=

p 1− p

p(1 − p)

p(1 − p)

∂p

⇔

13-20 p = 0

⇔ pˆ =

13

20

Este valor es en efecto el que maximiza g(p) pues

∂ 2 g ( p)

∂p 2

Definición:

Sean

=−

p =13 / 20

X 1 , X 2 ,..., X n

13

7

−

2

p

(1 − p ) 2

v.a.

con

<0

p =13 / 20

función

de

probabilidad

conjunta

p Xr ( x1 , x 2 ,..., x n ) o función de densidad conjunta f Xr ( x1 , x 2 ,..., x n ) que depende de k

parámetros θ 1 , θ 2 ,..., θ m . Cuando ( x1 , x 2 ,..., x n ) son los valores observados y la función

de probabilidad o de densidad conjunta se considera función de los parámetros

θ 1 ,θ 2 ,...,θ m , se denomina función de verosimilitud y se denota L(θ 1 ,θ 2 ,...,θ m ) .

Los estimadores de máxima verosimilitud (EMV) de θ 1 , θ 2 ,..., θ m son los valores

θˆ1 ,θˆ2 ,...,θˆm que maximizan la función de verosimilitud, o sea los valores tales que

~ ~

~

L(θˆ1 ,θˆ2 ,...,θˆm ) ≥ L(θ 1 ,θ 2 ,...,θ m )

~ ~

~

∀ θ 1 ,θ 2 ,...,θ m

La forma general de los EMV se obtiene reemplazando los valores observados xi por las

v.a. Xi.

Ejemplos: 1) Sea X 1 , X 2 ,..., X n una m.a. de una distribución exponencial de parámetro λ.

162

n

n

i =1

i =1

f ( x1 , x 2 ,..., x n ) = ∏ f X i ( x i ) = ∏ λ e

− λxi

=λ e

n

−λ

n

∑ xi

i =1

por lo tanto, la función de verosimilitud es

L (λ ) = λ n e

−λ

n

∑ xi

i =1

Observemos que no incluimos los indicadores porque, dado que el rango de la v.a. no

depende del parámetro a estimar, podemos suponer que todas las observaciones son no

negativas.

n

ln L(λ ) = n ln(λ ) − λ ∑ x i

i =1

n

∂ ln L(λ ) n

= − ∑ xi = 0

∂λ

λ i =1

λˆ =

⇔

n

=

n

∑X

i =1

1

X

i

Verificar que el punto crítico obtenido es en efecto un máximo.

Observemos que en este caso el EMV coincide con el de momentos.

2) Sea X 1 , X 2 ,..., X n una m.a. de una distribución N(µ,σ2).

n

n

1

f ( x1 , x 2 ,..., x n ) = ∏ f X i ( xi ) = ∏

i =1

−

1

n

1 1 − 2 σ 2 i∑=1( xi − µ )

=

e

n

2π σ

n

2σ 2

e

2π σ

i =1

(xi − µ )2

2

Por lo tanto la función de verosimilitud es

1

n

1 1 − 2 σ 2 i∑=1( xi − µ )

L( µ , σ ) =

e

n

2π σ

n

2

y maximizarla equivale a maximizar su logaritmo

(

)

ln L( µ , σ ) = − n ln 2π − n ln(σ ) −

1

2σ 2

n

∑ (x

i =1

i

− µ)2

163

∂ ln L( µ , σ ) 1 n

= 2 ∑ (xi − µ ) = 0

∂µ

σ i =1

∂ ln L( µ , σ )

n

1 n

2

= − + 3 ∑ (xi − µ ) = 0

∂σ

σ σ i =1

⇔

n

∑ ( x i − µ ) = 0

i =1

n

− nσ 2 + ∑ ( xi − µ )2 = 0

i =1

⇔

n

xi

∑

i =1

µ =

n

n

( x i − µ )2

∑

i =1

σ =

n

y, reemplazando el valor estimado de µ en la segunda ecuación, se obtienen los EMV de

los parámetros

∑ (X

n

µˆ = X

σˆ =

i =1

− X)

2

i

n

3) Sea X 1 , X 2 ,..., X n una m.a. de una distribución U(0,θ).

n

n

i =1

i =1

f ( x1 , x 2 ,..., x n ) = ∏ f ( x i ) = ∏

1

θ

I ( 0,θ ) ( x i ) =

1

θn

n

∏ I (0,θ ) ( x )

i

i =1

y la función de verosimilitud es

L(θ ) =

1

θn

n

∏ I (0,θ ) ( x )

i

i =1

Observemos que, en este caso, no es posible tomar logaritmo ni derivar porque el

parámetro (argumento de la función de verosimilitud) determina el soporte de la densidad.

Analicemos cómo es esta función a fin hallar su máximo

1

L(θ ) = θ n

0

1

= θ n

0

en caso contrario

si 0 < x i < θ ∀ i

si max( x i ) < θ

1≤ i ≤ n

en caso contrario

164

1

= θ n

0

si θ > max ( xi )

1≤ i ≤ n

si θ ≤ max( x i )

1≤ i ≤ n

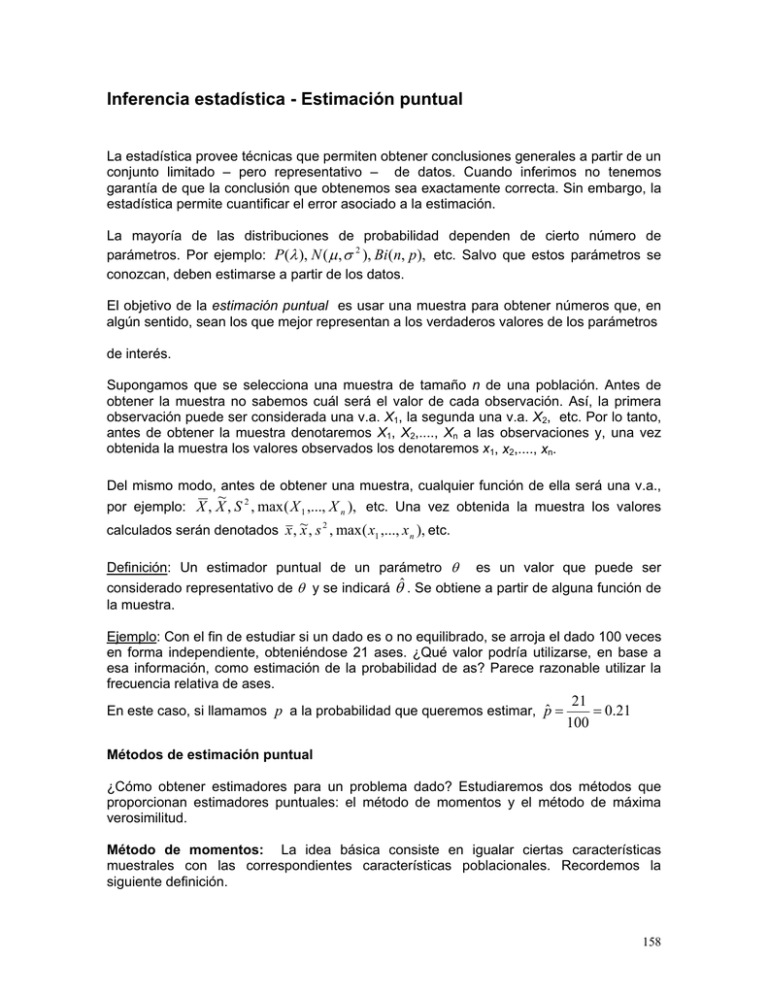

Grafiquemos L(θ ) como función de θ .

Como se puede observar, el máximo de la función de verosimilitud se alcanza en

θ = max ( xi ) y por lo tanto el EMV del parámetro es

1≤ 2≤ n

θˆ = max( X i )

1≤ i≤ n

Propiedad de Invarianza de los EMV: Sea θˆ el EMV de θ y sea h una función

inyectiva con dominio en el rango de valores posibles de θ, entonces el EMV de h(θ ) es

h(θˆ) . Por ejemplo, en el caso de una m.a. de una distribución N(µ, σ2) hemos visto que el

EMV de σ es

∑ (X

− X)

n

σ̂ =

i =1

2

i

n

entonces el EMV de σ2 es

n

σ̂ 2 =

∑(X

i =1

i

− X )2

n

pues la función h(x)=x2 es inyectiva si su dominio se restringe a los reales positivos, es

decir si h :ℜ ≥0 → ℜ.

165

En general, sean θˆ1 ,..., θˆm los EMV de θ 1 ,..., θ m y sea una función h : ℜ k → ℜ , ¿bajo qué

condiciones el EMV de h(θ 1 ,..., θ m ) es h(θˆ1 ,..., θˆm ) ? Esta propiedad, denominada

propiedad de invarianza de los EMV, se cumple si la función h puede ser completada a

una función inyectiva.

Propiedades de los estimadores y criterios de selección

Observemos que, dada una muestra X i , X 2 ,..., X n , un estimador puntual del parámetro

θ , obtenido en base a ella, es una v.a. θˆ . La diferencia

θˆ − θ

es el error de estimación y una estimación será más precisa cuanto menor sea este error.

Este error es también una v.a. dado que depende de la muestra obtenida. Para algunas

muestra será positivo, para otras negativo. Una propiedad deseable es que la esperanza

del error sea 0, es decir que “en promedio” el error obtenido al estimar a partir de

diferentes muestras sea cero.

Definición: Un estimador puntual θˆ del parámetro θ es insesgado si

E (θˆ) = θ

∀θ

Si θˆ no es insesgado, se denomina sesgo de θˆ a b(θˆ) = E (θˆ) − θ .

Por lo tanto, un estimador es insesgado si su distribución tiene como valor esperado al

parámetro que se desea estimar.

Definición: Un estimador puntual θˆ del parámetro θ basado en una muestra X 1 ,..., X n ,es

asintóticamente insesgado si

E (θˆ) n

→θ

→∞

∀θ

Ejemplos: 1) Sea X: número de éxitos en n repeticiones de un experimento binomial con

probabilidad de éxito igual a p. Entonces X ~ Bi(n,p) y hemos visto que el EMV de p es

pˆ = X / n , o sea la frecuencia relativa de éxitos. Verifiquemos que este estimador es

insesgado.

X E ( X ) np

=

=p

E ( pˆ ) = E =

n

n

n

∀p

y, por lo tanto, es insesgado.

2) Sea X 1 , X 2 ,..., X n una m.a. de una distribución N(µ,σ2). Los EMV de µ y σ2 son

166

∑ (X

n

µˆ = X

σˆ 2 =

i =1

− X)

2

i

n

Como E ( µˆ ) = µ ∀ µ , este estimador es insesgado.

Verifiquemos que el estimador de la varianza no lo es.

n

2

∑ (X i − X )

E (σˆ 2 ) = E i =1

n

n

= 1 E

X i2 − 2 X i X + X 2

∑

n i =1

(

)

=

n

1 n 2

1 n

E ∑ X i − 2 X ∑ X i + nX 2 = E ∑ X i2 − 2nX 2 + nX 2

n i =1

i =1

n i =1

=

n

1 n 2

1 n

E ∑ X i − nX 2 = E ∑ X i2 − E ( X 2 ) = E ( X 12 ) − E ( X 2 )

n i =1

n

n i =1

[

] [

]

= V ( X 1 ) + (E ( X 1 ) ) − V ( X ) + (E ( X ) ) = σ 2 + µ 2 −

2

2

σ2

n −1 2

− µ2 =

σ

n

n

Por lo tanto el EMV de la varianza no es insesgado, pero es asintóticamente insesgado ya

que su esperanza tiende a σ 2 cuando el tamaño de la muestra tiende a infinito.

∑ (X

n

Ejercicio: Verificar que la varianza muestral S 2 =

i =1

− X)

2

i

n −1

es un estimador

insesgado de la varianza poblacional cualquiera sea la distribución.

3) Sea X 1 , X 2 ,..., X n una m.a. de una distribución U(0,θ). El estimador de momentos de

θ es θˆ = 2 X y el EMV es θˆ = max ( X i ) .

1≤i≤ n

El estimador de momentos es insesgado. En efecto,

θ

E (θˆ) = 2 E ( X ) = 2 = θ

2

∀θ

Verificaremos que el EMV no lo es. Para ello, necesitamos obtener la densidad de la v.a.

U = max( X i ) .

1≤i≤ n

167

Recordemos que, si

X 1 , X 2 ,..., X n es una m.a. de una distribución U(0,θ), entonces

FU (u ) = (FX (u ) )

n

0

u n

=

θ

1

si u ≤ 0

si 0 < u < θ

si u ≥ θ

entonces

u

f U (u ) = n

θ

n −1

1

θ

I (0,θ ) (u ) .

Calculemos la esperanza del EMV.

θ

u

E (max ( X i ) ) = E (U ) = ∫ u n

θ

0

n −1

θ

θ

n u n +1

n

du = n ∫ u du = n

=

θ

θ

θ 0

θ n +1 0 n +1

1

n

n

Entonces, el EMV no es insesgado pero es asintóticamente insesgado.

Cuando hay más de un estimador insesgado para un mismo parámetro, ¿cómo decidimos

cuál conviene usar? Por ejemplo, sea X 1 , X 2 ,..., X n una m.a. de una distribución N(µ,σ2).

Es inmediato verificar que los siguientes son todos estimadores insesgados de µ:

µˆ 1 = X

X + X2

µˆ 2 = 1

2

µˆ 3 = X 1

Sin embargo, las varianzas de estos estimadores son

σ2

n

σ2

ˆ

V (µ 2 ) =

2

V ( µˆ 3 ) = σ 2

V ( µˆ 1 ) =

y parece natural elegir el estimador más preciso, es decir el de menor varianza.

Principio de estimación insesgada de mínima varianza: Entre todos los estimadores

insesgados de θ , elegir el de menor varianza. El estimador resultante se denomina IMVU

168

(insesgado de mínima varianza uniformemente). Existe una metodología que permite

hallar estimadores IMVU en muchas situaciones.

Teorema: Sea X 1 , X 2 ,..., X n una m.a. de una distribución

N(µ,σ2). Entonces X es

estimador IMVU de µ.

A partir de este resultado deducimos que, si se tiene evidencia de que la m.a. proviene de

una distribución Normal, parece conveniente usar X como estimador de µ. Sin embargo,

si los datos no son Normales este estimador podría llegar a ser una pésima elección.

Ejemplo: Sean las siguientes distribuciones simétricas alrededor del parámetro µ

a) N(µ,σ2) : f ( x) =

1

2π σ

e

b) Cauchy de parámetro µ :

c) U(µ -1, µ +1) : f ( x) =

1 x−µ

−

2 σ

2

f ( x) =

1

π 1 + (x − µ)2

(

)

1

I ( µ −1, µ +1) ( x)

2

La distribución de Cauchy tiene forma de campana como la distribución Normal, pero

tiene colas más pesadas que ésta. La distribución Uniforme no tiene colas, por lo tanto

podríamos decir que tiene colas más livianas que la Normal.

Consideremos los siguientes estimadores de µ:

µˆ 1 = X

~

µˆ 2 = X

µˆ 3 =

max ( X i ) + min ( X i )

2

En el caso a), µ̂ 1 es IMVU y por lo tanto, es la elección correcta.

En el caso b), µ̂ 1 y µ̂ 3 son malos porque ambos son muy sensibles a la presencia de

observaciones atípicas y la distribución Cauchy produce una importante proporción de

ellas. Por lo tanto la mejor elección entre estos tres estimadores sería µ̂ 2 . También

podríamos utilizar una media podada.

En el caso c) el mejor estimador es µ̂ 3 porque la distribución no tiene colas.

Error standard de un estimador: Al informar el resultado de una estimación puntual es

necesario brindar información sobre la precisión de la estimación.

Definición: El error standard de un estimador θˆ es su desviación standard, es decir

169

σ θˆ = V (θˆ)

Si el error standard depende de parámetros desconocidos, éstos se reemplazan por un

estimador y se obtiene el error standard estimado.

Ejemplo: Sea X 1 , X 2 ,..., X n una m.a. de una distribución N(µ,σ2). Entonces X es el

EMV de µ y su error standard es

σ2

n

σ X = V (X ) =

Como depende del parámetro σ , podemos reemplazarlo por la varianza muestral y

obtenemos el error standard estimado

∑ (X

− X)

n

2

X

S

=

n

σˆ X =

i =1

2

i

n(n − 1)

Definición: Sea θˆ un estimador de θ , su error cuadrático medio es

(

)

2

ECM (θˆ) = E θˆ − θ

Si el estimador θˆ es insesgado el error cuadrático medio es igual a la varianza del

estimador.

[ ]

2

Proposición: ECM (θˆ) = V (θˆ) + b(θˆ) , siendo b(θˆ) = E (θˆ) − θ el sesgo del estimador.

Dem:

(

)

(

)

2

2

ECM (θˆ) = E θˆ − θ = E θˆ − E (θˆ) + E (θˆ) − θ

(

) (

(

)

2

= E θˆ − E (θˆ) + E (θˆ) − θ

(

)

2

(

)(

)

+ 2 θˆ − E (θˆ) E (θˆ) − θ

)

[(

)(

2

2

= E θˆ − E (θˆ) + E E (θˆ) − θ + 2 E θˆ − E (θˆ) E (θˆ) − θ

)]

Usando que la esperanza de una v.a. es una constante y la esperanza de una constante

es igual a ésta, se obtiene

170

(

)

(

)

(

)(

)

2

2

ECM (θˆ) = E θˆ − E (θˆ) + E (θˆ) − θ + 2 E (θˆ) − θ E (θˆ) − E (θˆ)

14

4244

3

14243

1442443

2

0

(b (θˆ ) )

V (θˆ )

[ ]

2

y, por lo tanto, ECM (θˆ) = V (θˆ) + b(θˆ) , como queríamos demostrar.

Principio de estimación de menor error cuadrático medio: Dados dos o más estimadores

del parámetro θ, elegir el de menor ECM.

Este principio se reduce, en el caso de estimadores insesgados, al de mínima varianza

entre los insesgados mencionado más arriba, ya que el error cuadrático medio se reduce

a la varianza cuando un estimador es insesgado. Sin embargo, nos permite además

seleccionar, por ejemplo, entre un estimador insesgado y otro que no lo es, en base a la

varianza y al sesgo. Si el estimador sesgado tiene una varianza mucho menor que el

insesgado, podría ser preferible su uso.

Definición: Sea X 1 , X 2 ,..., X n una m.a de una distribución que depende de un parámetro

{ }

θ y sea θˆn un estimador puntual de θ basado en esa muestra. Diremos que θˆn es una

sucesión consistente (o más brevemente que θˆ es un estimador consistente de θ ) si

n

p

θˆn →

θ

(

)

→ 0 .

es decir, si ∀ ε > 0, P θˆn − θ > ε n

→∞

Ejemplo: Sea

X 1 , X 2 ,..., X n

una m.a de una distribución con

E( X i ) = µ

y

V ( X i ) = σ < ∞ , entonces X es un estimador consistente de µ . En efecto, aplicando la

2

desigualdad de Chebyshev,

(

)

P X − µ >ε ≤

V (X )

ε2

σ2

= 2 n

→

∞→ 0

nε

Ejercicio: Verificar que, en este ejemplo, µˆ =

∀ε > 0

X1 + X 2

no es consistente de µ .

2

Proposición: Sea X 1 , X 2 ,..., X n una m.a de una distribución que depende de un

parámetro θ y sea θˆn un estimador de θ basado en la muestra de tamaño n. Si

→θ (o sea, si el estimador es asintóticamente insesgado)

a) E (θˆn )

n →∞

→ 0

b) V (θˆn ) n

→∞

171

entonces, θˆn es consistente de θ .

Dem: La demostración es inmediata, a partir de la desigualdad de Chebyshev, si el

estimador es insesgado. No daremos la demostración en el caso general.

Ejemplos: 1) Sea X 1 , X 2 ,..., X n una m.a de una distribución con E ( X i ) = µ

y

V ( X i ) = σ < ∞ , entonces X es un estimador consistente de µ . En efecto, E ( X ) = µ y

2

V (X ) =

σ2

. Por lo tanto, se satisfacen las dos condiciones de la Proposición.

n

2) Sea X 1 , X 2 ,..., X n una m.a. de una distribución U(0,θ). Hemos demostrado antes que

el EMV de θ , θˆ = max( X i ) es asintóticamente insesgado pues E (θˆ) =

1≤ i≤ n

n

θ . Para

n +1

probar que es consistente, verificaremos que su varianza tiende a cero cuando el tamaño

de la muestra tiende a infinito. Pero

[ ]

2

n

V (θˆ) = E (θˆ 2 ) − E (θˆ) = E (θˆ 2 ) −

θ

n +1

2

entonces, debemos calcular la esperanza del cuadrado de la v.a. U = max( X i ) ,

1≤i≤ n

recordando que su densidad está dada por

θ

u

E (U ) = ∫ u n

θ

0

2

2

u

f U (u ) = n

θ

n −1

n −1

θ

1

θ

du =

n

θ

n

1

θ

∫u

0

I ( 0,θ ) (u )

n +1

n u n+2

du = n

θ n+2

θ

=

0

n

θ2

n+2

Entonces,

V (θˆ) =

2

n

n2

n 2 n

2

θ −

−

θ =

2

n+2

n + 1

n + 2 (n + 1)

2

n

θ =

θ 2 n

→

∞→ 0

2

(n + 2)(n + 1)

Por lo tanto, el EMV es consistente.

3) Este último ejemplo ilustra como demostrar la consistencia de un estimador a partir de

la Ley de los Grandes Números y de las propiedades de la convergencia en probabilidad.

En primer lugar recordemos que si X 1 , X 2 ,..., X n ,.... e Y1 , Y2 ,..., Yn ,... son sucesiones de

p

p

v.a. tales que X n

→

a e Yn

→

b , entonces:

a)

p

X n ± Yn

→

a±b

172

p

X n Yn

→

ab

Xn p a

→

si b ≠ 0

c)

Yn

b

b)

p

→

g (a)

d) g ( X n )

si g es una función continua en a .

p

→ c , entonces c n X n

→

ca ¿??

e) si c n es una sucesión numérica tal que c n

Sea X 1 , X 2 ,..., X n una m.a de una distribución con E ( X i ) = µ

y V (X i ) = σ 2 < ∞ ,

demostraremos que la varianza muestral S X2 es un estimador consistente de la varianza

poblacional.

∑ (X

n

S X2 =

i =1

− X)

2

i

n −1

n 2

∑ Xi

n

1

n i =1

2

2

2

=

−X

∑ X i − nX =

n − 1 i =1

n −1 n

p

→

µ , entonces por la propiedad d)

Por la Ley de los Grandes Números X

p

X2

→

µ2.

Por otra parte, aplicando nuevamente la Ley de los Grandes Números

n

∑X

i =1

n

Como además

2

i

p

→

E ( X 2 ) = V ( X ) + [E ( X )] = σ 2 + µ 2

2

n

→ 1 , se obtiene

n −1

n 2

∑ Xi

n i =1

p

2

2

−X

→

σ 2 + µ2 − µ2 =σ 2

SX =

n −1 n

y por lo tanto la varianza muestral es un estimador consistente de σ 2 .

173