Teoría de la detención

Anuncio

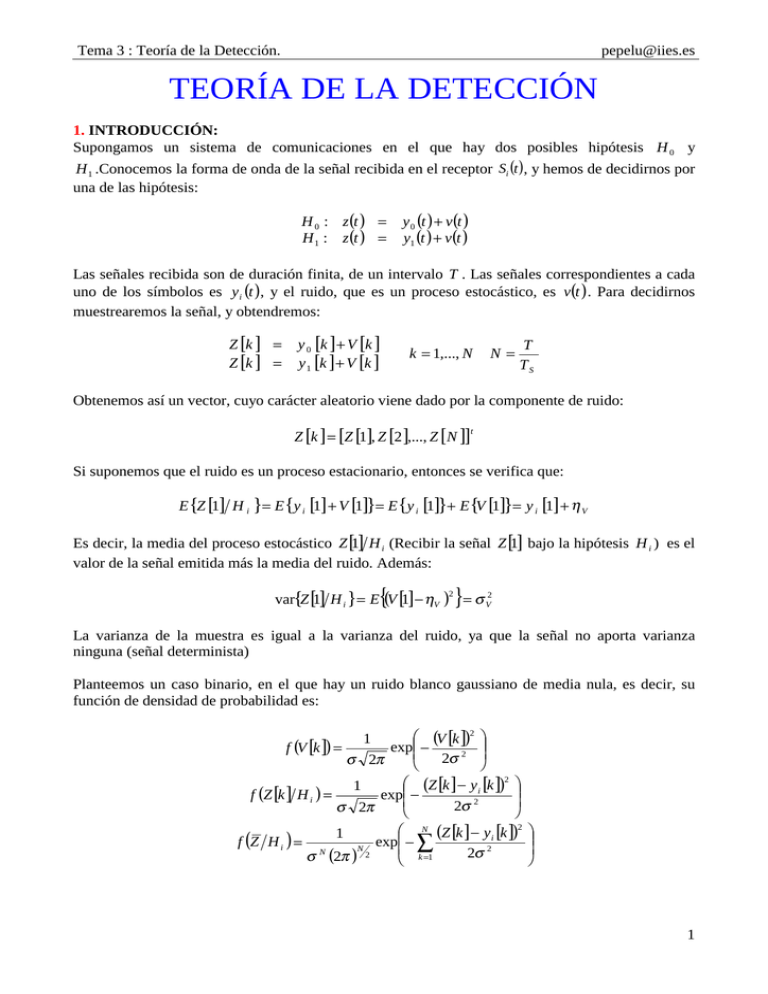

Tema 3 : Teoría de la Detección. [email protected] TEORÍA DE LA DETECCIÓN 1. INTRODUCCIÓN: Supongamos un sistema de comunicaciones en el que hay dos posibles hipótesis H 0 y H 1 .Conocemos la forma de onda de la señal recibida en el receptor Si (t ), y hemos de decidirnos por una de las hipótesis: H 0 : z (t ) = H 1 : z (t ) = y 0 (t ) + v(t ) y1 (t ) + v(t ) Las señales recibida son de duración finita, de un intervalo T . Las señales correspondientes a cada uno de los símbolos es y i (t ), y el ruido, que es un proceso estocástico, es v(t ) . Para decidirnos muestrearemos la señal, y obtendremos: Z [k ] = Z [k ] = y 0 [k ] + V [k ] y 1 [k ] + V [k ] k = 1,..., N N= T TS Obtenemos así un vector, cuyo carácter aleatorio viene dado por la componente de ruido: Z [k ] = [Z [1], Z [2 ],..., Z [ N ]] t Si suponemos que el ruido es un proceso estacionario, entonces se verifica que: E {Z [1] H i } = E {y i [1] + V [1]} = E {y i [1]} + E {V [1]} = y i [1] + η V Es decir, la media del proceso estocástico Z [1] H i (Recibir la señal Z [1] bajo la hipótesis H i ) es el valor de la señal emitida más la media del ruido. Además: { } var{Z [1] H i } = E (V [1] − ηV ) = σ V2 2 La varianza de la muestra es igual a la varianza del ruido, ya que la señal no aporta varianza ninguna (señal determinista) Planteemos un caso binario, en el que hay un ruido blanco gaussiano de media nula, es decir, su función de densidad de probabilidad es: (V [k ])2 1 exp − f (V [k ]) = 2 σ 2π 2σ (Z [k ] − y i [k ])2 1 f (Z [k ] H i ) = exp − 2 σ 2 σ 2π N (Z [k ] − y i [k ])2 1 f (Z H i ) = exp − ∑ N k =1 N 2σ 2 2 σ (2π ) 1 Tema 3 : Teoría de la Detección. [email protected] Si aplicamos un criterio bayesiano: f (Z H 1 ) f (Z H 0 ) H1 > <η H0 N (Z [k ] − y1 [k ])2 − ∑ H1 exp N k =1 2σ 2 σ N (2π ) 2 η 2 N (Z [k ] − y 0 [k ]) 1 H0 exp − ∑ 2 N N σ 2 2 σ (2π ) k =1 H1 N (Z [k ] − y 0 [k ])2 N (Z [k ] − y1 [k ])2 η exp ∑ −∑ 2σ 2 2σ 2 k =1 k =1 H 1 > < > < 0 Aplicando logaritmos: H1 > 2σ ∑ (Z [k ] − y [k ]) − ∑ (Z [k ]− y [k ]) < N N 2 2 0 1 k =1 k =1 2 ln (η ) H0 H1 > 2σ ∑ (Z [k ]+ y [k ]− 2Z [k ]y [k ])− ∑ (Z [k ] + y [k ] − 2Z [k ]y [k ]) < N N 2 2 0 2 2 1 0 k =1 1 k =1 H1 N 2 0 2 1 0 k =1 1 k =1 N 2∑ Z [k ]( y1 [k ] − y 0 [k ]) k =1 ln (η ) H0 > 2σ ∑ (y [k ] − 2Z [k ]y [k ])− ∑ (y [k ]− 2Z [k ]y [k ]) < N 2 2 ln (η ) H0 H1 > < 2σ N 2 ( ) ln(η ) − ∑ y 02 [k ] − y12 [k ] k =1 H0 Y eso podemos expresarlo como: 2Z ⋅ ( y1 − y 0 ) H1 > < 2σ H0 N 2 ( ) ln (η ) + ∑ y12 [k ] − y 02 [k ] k =1 N Ahora bien, sabemos que ∑ y [k ] es la potencia de la señal muestreada. Es evidente que el umbral k =1 2 i crece con la potencia de la señal. Por tanto, nuestro receptor pondera inversamente la potencia, es decir, a mayor potencia, menor es la región de aceptación. Si aumentamos la frecuencia de muestreo hasta obtener un conjunto denso, la formula se transforma y queda: 2 Tema 3 : Teoría de la Detección. [email protected] H1 2 ∫ z (t )( y1 (t ) − y 0 (t ))dt T 0 > 2σ < 2 ( ) ln (η ) + ∫ y12 (t ) − y 02 (t ) dt T 0 H0 Si diseñamos el sistema de bloques correspondiente a dicha ecuación: γ = σ 2 ln (η ) + ( ) 1 T 2 y1 (t ) − y 02 (t ) dt ∫ 0 2 El receptor hace la correlación entre z (t ) e y i (t ), y se decide por la que tenga la correlación más alta, es decir, la que más se parezca será la elegida por el receptor. Este tipo de receptor se llama receptor de correladores. Sin embargo, este receptor no es el más eficaz, ya que el sistema de comunicaciones depende de la potencia de la señal, lo cual puede ocasionar problemas. Por ello diseñamos el siguiente sistema de comunicaciones. Donde cada componente ejerce su función respectiva: a) Fuente de mensajes: Emite N posibles mensajes, con carácter aleatorio. b) Transmisor vectorial: Asigna un vector a cada uno de los posibles mensajes. c) Modulador: Crea una señal formada como combinación lineal de unas ciertas señales básicas, cuyos coeficientes son las componentes del vector. d) Canal: Transporta y altera la señal transmitida, dando una señal z (t ) , llamada señal de observación, distinta de S i (t ) . e) Detector: Descompone la observación en los coeficientes que forman la combinación lineal. Por causa de la alteración de la señal respecto de la observación dichas componentes son distintas a las componentes del vector original. Dicho vector es Z . f) Receptor vectorial: Deduce a partir de las componentes del vector Z el posible mensaje ~ emitido. m i Para trabajar con las señales y vectores antes comentados, hemos de ver su construcción: S i = [S i1 , S i 2 ,..., S iN ] t N S i (t ) = ∑ S ij g j (t ) j =1 3 Tema 3 : Teoría de la Detección. [email protected] S (t ), g (t ) = ∫ S (t )g ∗ (t )dt Longitud o norma de la señal T 0 2 S (t ) = S (t ), S (t ) Energía de la señal La idea es generar un espacio vectorial de dimensión yi (t), de tal manera que en él se representen las señales como vectores. La base de dicho espacio vectorial serán las señales básicas de las que antes hablamos. A dichas señales les vamos a imponer dos condiciones, que más adelante nos van a facilitar el diseño del receptor. Dichas condiciones serán la ortogonalidad y la normalidad, es decir, debe ser una base ortogonal. Matemáticamente hablando: g i (t ), g j (t ) = ∫ g i (t )g ∗j (t )dt = 0 i ≠ j Y 0 H 0 : z (t ) = y 0 (t ) + v (t ) H 1 : z (t ) = y 1 (t ) + v (t ) Si se dan estas circunstancias, la reconstrucción de la señal original es muy sencilla, ya que : S i (t ), g j (t ) = ∫ S i (t ) g ∗j (t )dt = ∫ Y 0 Y N 0 = S ij ∫ Y 0 ∑ (S l =1 N il g l (t ))g ∗j (t )dt = ∑ S il l =1 g j (t )g ∗j (t )dt = S ij g j (t ) 2 ∫ Y 0 g l (t )g ∗j (t )dt = = S ij Es decir, la obtención de las componentes del vector de señal a partir de la señal consiste en una correlación con la señal básica correspondiente. Aplicando un diagrama de bloques: Y para generar la señal a partir de sus componentes basta con hacer: 4 Tema 3 : Teoría de la Detección. [email protected] Una cuestión importante será la distancia entre dos señales, con vistas a establecer criterios de decisión. Para ello: 2 Si − S j = ∑ (S il − S jl ) N 2 l =1 Pero también ocurre que: S il = S i (t ), g l (t ) = ∫ S i (t )g l∗ (t )dt Y 0 S jl = S j (t ), g l (t ) = ∫ S j (t )g l∗ (t )dt Y 0 ∫ (S (t ) − S (t )) dt = ∫ (S (t ) − S (t ))(S (t ) − S (t )) dt = )g (t ) ∑ (S − S )g (t ) dt = ∫ ∑ ∑ (S − S )(S Y 0 Y N = ∫ ∑ (S il − S jl 0 l =1 j N l m =1 N ( l =1 m =1 ∗ jm ∗ i 0 ∗ im ∗ = ∑∑ (S il − S jl ) S im − S ∗jm N Y 2 i ∗ m j i Y N Y 0 l l =1 jl ∗ im l =1 m =1 N ∗ m N il 0 )∫ g (t )g (t )dt = ∑ (S j il ( ) ) − S ∗jm g l (t )g m∗ (t )dt = ∗ − S jl ) S im − S ∗jm = ∑ (S il − S jl ) N 2 l =1 Y por tanto: Si − S j 2 = ∑ (S il − S jl ) = ∫ (S i (t ) − S j (t )) dt N l =1 2 Y 2 0 2. DETECCIÓN DE SEÑALES A PARTIR DE LA REPRESENTACIÓN VECTORIAL: Nuestro objetivo es recuperar un cierto mensaje transmitido a partir de una cierta observación z (t ) compuesta por la suma del mensaje transmitido S i (t ) más un cierto ruido W (t ). Para ello lo que haremos es proyectar la observación sobre la base del espacio en el que trabajamos, dada por g i (t ) i = 1,..., N , obteniendo así sus coordenadas, que no coincidirán con las originales debido al ruido, que modificara las proyecciones. En esencia, lo que pasa es que el vector obtenido no coincidirá con el original debido al ruido. Por provenir del mismo espacio vectorial siempre podremos identificar S i en el receptor, pero no es así con el ruido, ya que no procede de dichas señales, y además, por ser una señal de ancho de banda infinito, no podremos representarla en un espacio vectorial finito. Los vectores de la base se habrán de elegir con ancho de banda finito por dicha circunstancia, así como para evitar la distorsión del canal, de ancho de banda finito. En otras palabras, podemos decir que a partir de las componentes que obtengamos del ruido no podremos reconstruir el ruido, ya que este tiene dimensión infinita por su carácter aleatorio. Veíamos antes que la construcción del receptor cuando no hay ruido era muy sencilla. Sin embargo., en el momento que hay ruido, la respuesta del receptor ya no es tan buena: 5 Tema 3 : Teoría de la Detección. [email protected] z (t ) = y i (t ) + w(t ) Z ij = ∫ ( y i (t ) + w(t ))g j (t )dt = y ij (t ) + w j (t ) T 0 Como ya hemos dicho, no es posible reconstruir el ruido a partir de las componentes que obtengamos de él, con lo que: N w(t ) = ∑ w j g j (t ) + w′(t ) j =1 Donde w′(t ) es el error ya comentado. Por otro lado Z ij es la suma del coeficiente determinista de la señal básica g j (t ) en la combinación lineal original más la proyección del ruido sobre dicha señal de la base. Por tanto Z ij es una variable aleatoria, que se debe caracterizar por sus estadísticos. Vamos a calcularlos: E {Z j H i } = E {y ij + w j } = E{y ij }+ E {w j } = y ij 1 Si suponemos un ruido de media nula, que es lo habitual. { } { } { } var{Z j H i } = E (Z j − E {Z j H i }) = E (Z j − y ij ) = E (w j ) = 2 { 2 2 } T T T T = E ∫ w(t )g j (t )dt ∫ w(u )g j (u )du = E ∫ ∫ w(t )w(u )g j (t )g j (u )dt = 0 0 0 0 =∫ T 0 ∫ E{w(t )w(u )}g (t )g (u )dtdu = ∫ ∫ T j 0 j T T 0 0 RW (t , u )g j (t )g j (u )dtdu 2 Lo habitual es que haya ruido blanco(de media nula, como hemos supuesto antes). Ello implica que la autocorrelación del ruido es: RW (t , u ) = N0 δ (t − u ) 2 Donde N 0 2 es la varianza del ruido. Aplicando al cálculo de la varianza: var{Z j H i } = ∫ =∫ T 0 ∫ T 0 N0 δ (t − u )g j (t )g j (u )dtdu = {δ (t − u )g j (t ) = δ (t − u )g j (u )}= 0 0 2 T N0 N T N T N δ (t − u )g 2j (u )dtdu = 0 ∫ g 2j (u ) ∫ δ (t − u )dt du = 0 ∫ g 2j (u )du = 0 0 2 2 0 2 0 2 T ∫ T Con esto hemos demostrado que: a) Si la media del ruido es nula: 1 E {Z j H i } = y ij Donde Z j es la componente j del vector de observación. Por tanto Z j H i es la componente j recibida condicionada a que se emitió el mensaje dado por H i . Por otro lado: { } E{w j }= E ∫ w(t )g ∗j (t )dt = ∫ E{w(t )}g ∗j (t )dt = 0 2 T 0 E {w(t )w(u )}= RW (t , u ) T 0 6 Tema 3 : Teoría de la Detección. [email protected] b) Si el ruido es blanco: var{Z j H i } = N0 2 En caso de que el ruido no fuera blanco, habría que hacer las integrales con la función de autocorrelación correspondiente. En general son necesarios infinitos estadísticos para tener caracterizado un proceso estocástico cualquiera. Pero en el caso de un proceso gausiano, como suele ser el ruido, basta con conocer su media y su varianza. Si además el ruido es blanco, algo que ocurre muy a menudo, la función de verosimilitud de un variable Z j H i se reduce a: f (Z j (Z j − y ij )2 Hi )= exp − N0 πN 0 1 Hasta el momento hemos estudiado el caso de una sola muestra del vector de observación. Sin embargo, lo que identifica por completo al mensaje es el vector completo. Nos interesa pues, la función de verosimilitud del vector de observación, que será las función de densidad conjunta de todas las componentes del vector. En el caso de ruido blanco podemos suponer que las componentes del vector son independientes, ya que al ser su autocorrelación una delta de Dirac, y ser gausianas, son independientes. Por tanto: f (Z H i ) = ∏ f (Z j H i ) N j =1 Pero como estamos tomando todas las muestras Z j en el mismo instante de tiempo, no podemos asegurar que sean independientes. Debemos asegurarlo estudiando su covarianza dos a dos, para saber si están incorreladas, y en tal caso, al ser gausianas, está asegurada su independencia. Debemos pedir que la covarianza sea nula: { } E{(Z j − y ij )(Z l − y il )}= E{(w j )(wl )}= E ∫ w(t )g j (t )dt ∫ w(u )g l (u )du = ∫ =∫ T 0 ∫ T 0 T T 0 0 T 0 ∫ g (u )g (t )E{w(t )w(u )}dtdu = T 0 l j g l (u )g j (t )RW (t , u )dtdu = ∫ g j (t ) ∫ g l (u )RW (t , u )du dt = 0 0 0 T T Para que se cumple dicha condición ha de suceder que g j (t ) y ∫ g (u )R (t , u )du sean ortogonales, T 0 l W es decir, se ha de cumplir que: φ (t ) = ∫ g l (u )RW (t , u )du T 0 ∫ T 0 g j (t )φ (t )dt = 0 Además se puede demostrar que si g l (u ) es una autofunción de la función de autocorrelación del proceso de ruido, es decir, se verifica que: φ (t ) = ∫ g l (u )RW (t , u )du = λg l (t ) T 0 7 Tema 3 : Teoría de la Detección. [email protected] Entonces se verifica la condición anterior. De ello se deduce que g j (t ) y g l (t ) han de ser ortogonales. Por lo tanto queda establecida la condición de que la base del espacio vectorial sean funciones ortogonales. En el caso habitual de que el ruido sea blanco: φ (t ) = ∫ g l (u )RW (t , u )du = T 0 N0 2 ∫ T 0 T N0 N g l (t )∫ δ (t − u )du = 0 g l (t ) 0 2 2 g l (u )δ (t − u )du = No perdamos de vista que lo que nos interesa es que la covarianza sea nula para así, con la gausianidad, poder afirmar la independencia de las muestras, y estudiar la función de densidad conjunta como producto de las marginales. 2.1. DESARROLLO EN SERIE DE KARHUNEN-LOEVE: Vamos a estudiar una representación especialmente útil en forma de serie de los procesos estocásticos. Dicho desarrollo nos permitirá afirmar que cualquier conjunto de funciones ortonormales puede ser base en caso de ruido blanco, pero esta posibilidad se restringe cuando el ruido es coloreado. Todo proceso estocástico se puede representar como: ∞ X (t ) = ∑ x n g n (t ) o ≤ t ≤ T n =1 ∫ g (u )R (t , u )du = λ T n X n g n (t ) Evidentemente no siempre conoceremos la autocorrelación del proceso, lo cual hace inviable el cálculo de las autofunciones. Veamos tres propiedades de las series de Karhunen-Loeve: a) ∫ g (t )g (t )dt = δ T n m nm = δ (n − m ) Ortogonalidad determinista. b) E{x n x m } = λ n δ nm Ortogonalidad estadística. ∞ c) RX (t − u ) = ∑ λn g n (t )gu∗ (u ) Teorema de Mercer n =1 Es claro que x n debe ser una variable aleatoria (ya que g n (t ) es determinista). El desarrollo en series de Karhunen-Loeve se caracteriza por conseguir que la varianza de las x n sea inversamente proporcional a n , de tal manera que con los primeros términos del desarrollo tenemos la mayor parte de la varianza, y con ello la mayor parte de la información y de la potencia del proceso estocástico. Esto hace muy efectivo al desarrollo, ya que me basta con recibir solo los primeros términos para conocer la información. Vimos antes que en el caso de ruido blanco: φ (t ) = ∫ g l (u )RW (t , u )du = T 0 N0 2 ∫ T 0 g l (u )δ (t − u )du = T N0 N g l (t )∫ δ (t − u )du = 0 g l (t ) 0 2 2 Lo cual implica que las funciones de cualquier base son autofunciones de la ecuación integral, y por ello, si son ortonormales, se verifica que la covarianza es nula, y por tanto se garantiza la 8 Tema 3 : Teoría de la Detección. [email protected] incorrelación. Evidentemente esto no sucede si el ruido es coloreado, ya que la autocorrelación del ruido ya no es una delta de Dirac. Ejemplo: Supongamos una comunicación binaria basada en el código Manchester, en la que hay AWGN3. La probabilidad de que se emita u 1 o un 0 es la misma. ¿Cuál es la expresión para la probabilidad media de error a la salida del receptor? Evidentemente la dimensión del espacio vectorial es 1, ya que S1 (t ) = − S 0 (t ) Por ello elegiremos S 0 (t ) como la función de la base. Nos interesa normalizarla en energía: E= ∫ T S 0 (t ) dt = S 0 (t ) = 2 ∫ a2 a2 dt = T 4 4 T 0 ⇒ a T a T g (t ) S 1 (t ) = − g (t ) 2 2 g (t ) = S 0 (t ) S 0 (t ) E a T a T a T S0 = S1 = − 2 2 2 = Como hay AWGN: { } { } { } { = E {S ∫ g (t )dt }+ 0 = S } E{Z } = E ∫ (S i (t ) + w(t ))g (t )dt = E ∫ S i (t )g (t )dt + E ∫ w(t )g (t )dt = E ∫ S i g 2 (t )dt + ∫ E{w(t )}g (t )dt = T T T T T 2 i i T { } var{Z } = E (Z − E{Z }) = 2 N0 2 Por tanto: (Z − S i )2 1 f (Z H i ) = exp − N 0 πN 0 Aplicando la razón de verosimilitud: (Z − S1 )2 exp − H N 0 1 P(H 0 ) πN 0 =1 P(H 1 ) (Z − S 0 )2 1 exp − H0 N πN 0 0 1 > < (Z − S 0 )2 (Z − S1 )2 exp − N 0 N 0 H1 > <1 H0 Aplicando logaritmos: 3 AWGN: Aditive White Gaussian Noise 9 Tema 3 : Teoría de la Detección. (Z − S 0 )2 (Z − S1 )2 N0 − N0 [email protected] H1 > <0 H1 ⇒ Z 2 + S 02 − 2ZS 0 − Z 2 − S12 + 2ZS1 H0 H1 > < H0 a t S 02 − 2 ZS 0 − S12 + 2 ZS1 0 ⇒ 2 H0 a t − 2 Z 2 > <0 2 a t − 2Z 2 a t − 2Z 2 a t − − 2 2 a t + 2Z − 2 H1 0 H > < 0 H1 > < H1 > < 0 ⇒ Z 0 H H0 0 Ya tenemos definidas las regiones crítica y de aceptación. La probabilidad media de error será la suma de las probabilidades de decidirse por un símbolo habiéndose emitido el otro: 1 [P(D1 H 0 ) + P(D0 H 1 )] = 2 1 f (Z H 0 )dz + ∫ f (Z H 1 )dz = Z0 2 ∫Z1 2 2 1 1 a t 1 0 1 a t Z − dz + ∫ Z + dz exp − N 0 2 2 − ∞ πN 0 2 N 0 Pe = P(D1 H 0 )P(H 0 ) + P(D0 H 1 )P(H 1 ) = = 1 ∞ 1 − exp 2 ∫01 πN 0 Ejemplo: Sea un sistema de comunicaciones con modulación PSK, cuya señal de referencia es: S i (t ) = 2E 2π 0 ≤ i ≤ N − 1 sen ω 0 t + i T N 0 ≤ t ≤ T Si hay AWGN de media nula y densidad espectral de potencia N 0 2 4, siendo N = 2 γ ; hallar la dimensión del espacio vectorial y una base. Para el caso particular de N = 4 , y suponiendo todos los símbolos equiprobables obtener en función de N 0 la probabilidad de error si se usa un criterio de mínima probabilidad de error. Veamos la primera de las preguntas: 2E 2π sen ω 0 t + i = T N S i (t ) = 2E 2π 2π sen (ω 0 t )cos i + cos(ω 0 t )sen i T N N Evidentemente los coeficientes son los términos que dependen de i . Por tanto la dimensión del espacio será como máximo dos, siempre y cuando las señales formen una base ortogonal. Debemos estudiar por tanto si sen (ω 0 t ) y cos(ω 0 t ) forman una base ortogonal. Veamoslo: ∫ T 0 4 sen (ω 0 t )cos(ω 0 t )dt = 1 [− cos(2ω 0 )]T0 = 1 [1 − cos(2ω 0T )] 4ω 0 4ω 0 La varianza de un proceso estocástico de ruido blanco es su densidad espectral de potencia. 10 Tema 3 : Teoría de la Detección. [email protected] Son ortogonales si: cos(2ω 0T ) = 1 ⇒ T = kπ ω0 De lo que se deduce que T ha de ser múltiplo del doble del periodo. Si se da esa circunstancia, sen (ω 0 t ) y cos(ω 0 t ) son ortogonales y forman una base ortogonal. Por tanto la dimensión será dos. Forman. Para conseguir una base ortonormal deberemos normalizarlas: E = ∫ sen (ω 0 t )dt = ∫ T T 2 0 0 t 1 − cos(2ω 0 t ) T 1 dt = − sen (2ω 0 t ) = 2 2 4ω 0 0 2 T Para que la energía de la señal sea la unidad, debemos normalizar las señales entre la raíz cuadrada de la energía(La energía de cos(ω 0 t ) es la misma que la de sen (ω 0 t ) ): g1 (t ) = 2 2 sen (ω 0 t ) g 2 (t ) = cos(ω 0 t ) T T Ya tenemos una base ortonormal. El vector de señal será: 2π 2π S i = E cos i , E sen i N N Veamos la segunda pregunta. Nos planteamos un problema de detección en el que tenemos múltiples hipótesis(4) y dos muestras (espacio bidimensional). Debemos hallar la función de densidad conjunta: 2 1 (Z − S i1 )2 1 2π f (Z 1 H i ) = exp − exp − i Z 1 − E cos = N0 πN 0 πN 0 N N 0 2 1 (Z − S i 2 )2 1 1 2π f (Z 2 H i ) = exp − exp − i Z 2 − E sen = N0 πN 0 πN 0 N N 0 1 Por haber ruido blanco están incorreladas, y como además son gausianas, son independientes. Podemos poner la función de densidad conjunta como producto de las marginales: 1 1 2π f (Z H i ) = exp − Z 1 − E cos πN 0 N 0 N 2 2π i + Z 2 − E sen N i 2 Usando el criterio de mínima probabilidad de error, que es análogo al de máxima verosimilitud, usando logaritmos y simplificando: 11 Tema 3 : Teoría de la Detección. f (Z H i [email protected] Hi > f (Z )< Hj ) ⇒ Hj 2 f (Z H i f (Z H j 2 Hi ) >1 )< Hj 2 2π 2π 2π 2π j + Z 2 − E sen j − Z 1 − E cos i − Z 2 − E sen i Z 1 − E cos N N N N 2 2π 2π Z 1 − E cos j + Z 2 − E sen j N N 2 Hi > Z < Hj 2 1 2π 2π − E cos i + Z 2 − E sen i N N 2 Hi > <0 Hj 2 El criterio se ha convertido en una comparación de distancias. Este tipo de problemas se llaman de constelación, ya que si disponemos un plano en el que la posición de cada punto viene dado por Z1 y Z 2 , hay cuatro vectores posibles (Uno por cada símbolo). Por tanto el criterio de decisión consiste en hallar cual de los posibles vectores emitidos es el más cercano al vector observado. Las regiones críticas y de aceptación de las hipótesis son ahora las regiones delimitadas por las bisectrices de los cuadrantes. La probabilidad de error será la suma de las probabilidades de decidirse por una hipótesis siendo cierta otra: Pe = ∑ P(H i )1 − ∫∫ f (Z H i )dZ = Zi i =0 3 ∞ Z1 1 = ∑ 1 − ∫ ∫ f (Z H i )dZ 2 dZ 1 0 − Z1 i =0 4 3 Hemos representado las cuatro funciones de verosimilitud en la imagen. Los cuatro máximos son evidentemente los vectores originales. Ejemplo: Sea un sistema de comunicaciones M -ario, con M = 2 N , tal que los M vectores caen en un hipercubo centrado en el origen. Si M = 3 y E es la energía por símbolo. ¿Cuales son los valores de los coeficientes x n ?. Suponiendo AWGN de media nula y varianza N 0 2 ¿Cuál es la probabilidad media de error? Para responder a la primera de las preguntas hemos de darnos cuenta de que trabajamos con una base ortonormal. Como los vectores caen en un hipercubo, todos tiene la misma energía, y los coeficientes tienen todos el mismo módulo. Además las funciones de la base son ortogonales, la integral en el periodo del producto de dos de ellas es nulo. Y por son normales, su energía es la unidad. Luego: 12 Tema 3 : Teoría de la Detección. [email protected] 3 S i (t ) = ∑ S ij g j (t ) j =1 g j (t ) = 1 2 g i (t ), g j (t ) = δ ij E = ∫ (S i (t )) dt = 2 T ( ) = ∫ S i21 g 12 (t ) + S i22 g 22 (t ) + S i23 g 32 (t ) + 2S i1 S i 2 g 1 (t )g 2 (t ) + 2S i1 S i 3 g 1 (t )g 3 (t ) + 2S i 2 S i 3 g 2 (t )g 3 (t ) dt = T = S i21 ∫ g 12 (t )dt + S i22 ∫ g 22 (t )dt + S i23 ∫ g 32 (t )dt + T T T + 2 S i1 S i 2 ∫ g 1 (t )g 2 (t )dt + 2 S i1 S i 3 ∫ g 1 (t )g 3 (t )dt + 2 S i 2 S i 3 ∫ g 2 (t )g 3 (t )dt = T T T =S +S +S =E 2 i1 2 i2 2 i3 E 3 S ij = Para el cálculo de la probabilidad media de error, partimos del mismo estudio que en el ejemplo anterior, solo que en este caso las regiones son los octantes. Por simetría las funciones de densidad de probabilidad de Z ij son iguales, y por ser el ruido blanco y gausiano, son independientes: M −1 ∑ P(H )1 − ∫∫∫ Pe = i i =0 Zi 3 2 1 ∞ 1 1 E z − dz f (Z H i )dZ = ∑ 1 − ∫ exp − i =0 8 0 πN N 3 0 0 7 erfc(u ) = ∫ ∞ 0 2 π ∫ ∞ u ( ) exp − z 2 dz 2 1 E 1 ∞ 1 E 2 z − dz = exp − ∫ E exp − x dx = erfc − 3 2 3N 0 N0 πN 0 π − 3N 0 7 1 1 E Pe = ∑ 1 − erfc 3 − 8 3 N i =0 8 0 1 ( ) Ejemplo: Se pretende diseñar un sistema que distinga voz natural de voz sintética, siendo la hipótesis nula que sea voz natural, y la hipótesis alternativa que sea voz sintética. El receptor usará una única muestra de la señal observada. Hay un procesado previo de tal manera que la varianza es la unidad. Se supone que la voz natural es, en tramos cortos, una señal aleatoria laplaciana de media nula. La voz sintética se genera mediante un sistema CELP, consistente en excitar un filtro lineal con una excitación gausiana aleatoria de media nula. ¿Cuál es la razón de verosimilitud?. Encontrar las regiones críticas y de aceptación para cada hipótesis, siendo estas equiprobables, aplicando el criterio de mínima probabilidad de error. El sistema que tenemos es: Vamos a hallar los parámetros de la función de densidad laplaciana: ~ z ~ f (z H 0 ) = A exp− B z H 0 ) una función Para ello partimos del hecho de que conocemos la varianza, y de que por ser f (~ de densidad de probabilidad, su integral en toda la recta real será la unidad: 13 Tema 3 : Teoría de la Detección. [email protected] t = z z = Bt z ∞ ∞ ∞ z B = var{z H 0 } = ∫ z 2 f (z H 0 )dz = ∫ z 2 A exp− dz = 2 A∫ z 2 exp− dz = −∞ −∞ 0 1 dz dz = Bdt B B = dt B = 2 A∫ B 2 t 2 exp[− t ]Bdt = 2 AB3 ∫ t 2 exp[− t ]dt = 2 AB3 Γ(3) = 4 AB3 = 1 ∫ ∞ −∞ ∞ ∞ 0 0 t = z z = Bt z ∞ z B f (z H 0 )dz = ∫ A exp− dz = 2 A∫ exp− dz = = −∞ 0 B dt = 1 B dz dz = Bdt B ∞ = 2 A∫ exp[− t ]Bdt = 2 AB∫ exp[− t ]dt = 2 ABΓ(1) = 2 AB = 1 ∞ ∞ 0 0 A= 1 2 B= 1 2 La razón de verosimilitud será: z2 exp− 2 f (z H1 ) 2π 2 = 1 exp 2 z − z = 1 2 f (z H 0 ) π exp − 2 z 2 1 [ ] Aplicamos el criterio de mínima probabilidad de error, que hace el umbral la unidad: f (z H1 ) = f (z H 0 ) H1 > <1 H0 z2 exp 2 z − 2 π 1 z2 2z − 2 H1 > <1 H0 H1 > < ln( π ) H0 H1 >0 ( )< z2 2 z − − ln π 2 H0 Las regiones críticas y de aceptación son las marcadas en la figura, siendo sus límites los dados por: ( ) z = ± = 2 1 ± 1 − ln π Aquí hemos usado una sola muestra. Si usáramos más muestras habría problemas, ya que tanto la voz sintética como la voz natural están fuertemente correladas, la primera por haber sido pasada por un filtro, que colorea al ruido blanco, y la segundo por las características naturales de la voz. No sería posible hallar la función de densidad conjunta de forma elemental. 14 Tema 3 : Teoría de la Detección. [email protected] Ejemplo: Sea un sistema de modulación QPSK, cuya señal de referencia es: S i (t ) = π 0 ≤ i ≤ 3 2E cos 2πf c t + (2 i − 1) T 4 0 ≤ t ≤ T Se ha elegido f c tal que en la duración de la señal T quepan un número entero de ciclos de la señal. Si el canal es AWGN de media nula y varianza N 0 2 , ¿Cuál es la dimensión del espacio vectorial?. Hallar una base ortonormal. Usando un criterio bayesiano con coste nulo para los aciertos y unidad para los fallos, y suponiendo hipótesis equiprobables, hallar las regiones críticas y de aceptación. Proporcionar una expresión para el cálculo de P(D1 H 1 ) S i (t ) = 2E T π π cos(2πf c t )cos (2i − 1) 4 − sen (2πf c t )sen (2i − 1) 4 Tenemos dos señales, lo cual índica que la dimensión será como máximo dos. Para asegurarnos de ello hay que comprobar la independencia de las señales. Basta comprobar que son ortogonales: sen 2 (2πf c t ) cos(2πf c t )sen (2πf c t )dt = =0 4πf c t =0 t =T ∫ T 0 Son ortogonales, luego son independientes, y la dimensión del espacio vectorial es dos. Buscamos la base ortonormal: E = ∫ cos 2 (2πf c t )dt = T 0 g 1 (t ) = cos (2πf c t ) T 2 = T 2 2 2 cos (2πf c t ) g 2 (t ) = sen (2πf c t ) T T Y el vector de señal vendrá dado por: π π S i = E cos (2i − 1) ,− E sen (2i − 1) 4 4 Las regiones de aceptación y críticas para este sistema son los cuadrantes del plano. Para el cálculo de P ( D 1 H 1 ) deberemos integrar la función de verosimilitud de f (Z H 1 ) en la región de aceptación, que será el cuarto cuadrante. Por tanto: f (Z H 1 ) = f (Z 1 H 1 ) f (Z 2 H 1 ) f (Z 1 H 1 ) = 1 πN 0 ( Z 1 − S 11 ) 2 exp − N0 15 Tema 3 : Teoría de la Detección. [email protected] f (Z 2 H 1 ) = P ( D1 1 H1 )= πN 0 ∫ ∞ 0 1 πN 0 ( Z − S 12 exp − 2 N0 ( Z 1 − S 11 ) 2 exp − N0 )2 ( Z 2 − S 12 0 dZ 1 exp ∫−∞ − N 0 )2 dZ 2 2.2 IMPEMENTACIÓN DE RECEPTORES CON FILTRO ADAPTADO: La implementación de este receptor en tiempo continuo es imposible, por la dificultad que conlleva su diseño. Por ello hay que planteárselo de otra manera: Z i = ∫ z (t )g i (t )dt = ∫ z (τ )g i (τ − t )dτ T T 0 0 t =0 = z (t ) ∗ g i (− t ) t = 0 Este resultado podemos interpretarlo como el muestreo en t=0 del resultado de hacer pasar la señal z (t ) por un sistema con respuesta al impulso g i (− t ) Para que dicho sistema sea físicamente realizable, ha de suceder que g i (− t ) sea causal, ya que la estabilidad está garantizada por ser g i (− t ) de duración finita. Sin embargo, no se da la causalidad, ya que la señal dura entre − T y 0 . Habrá que desplazarla. Tendremos un desfase en la recepción, pero el sistema ya es realizable. Este tipo de receptor, que es el que se usa en la práctica, se llaman receptores de filtro adaptado. 2.3 CRITERIO DE MÁXIMA SNR: Dada una observación vamos a procesarla mediante un LTI que nos proporcione una señal que al muestrearla nos dé la máxima SNR. Usaremos para ello un receptor de filtro adaptado, del que debemos encontrar su respuesta al impulso. Supondremos ruido blanco de media nula y varianza N0 2 z 0 (t ) = y 0 (t ) + V 0 (t ) y 0 (T ) = ∫ y (τ )h (T − τ )dτ T 0 T V 0 (T ) = ∫ v (τ )h (T − τ )dτ 0 Vamos a pedir una SNR máxima, que viene dada por: 16 Tema 3 : Teoría de la Detección. [email protected] SNR = { } E V 02 (T ) = E y 02 (T ) { } E V 02 (T ) {∫ h (T − τ )v (τ )dτ ∫ h (T − α )v (α )dα }= T T T T 0 T 0 T 0 0 0 0 ∫ ∫ h (T − τ )h (T − α )E {v (τ )v (α )}dαdτ = ∫ ∫ h (T − τ )h (T − α )R (τ − α )dαdτ v { } Asumiremos que y 02 (T ) es una constante, y entonces debemos pedir que E V 02 (T ) sea mínima condicionado a que y 2 0 (T ) sea una constante. Usaremos los multiplicadores de Lagrange: { } J = E V 2 (T ) − 2 µy 0 (T ) J =∫ T 0 ∫ T 0 h (T − τ )h (T − α )R v (τ − α )dα dτ − 2 µ ∫ y (τ )h (T − τ )dτ T 0 Resolviendo dicha ecuación, llegamos a la conclusión de que h (t ) debe cumplir: ∫ h (T − α )R (τ − α )dα = µy (τ ) T 0 v 0 ≤τ ≤T La resolución de dicha condición depende de la autocorrelación del ruido. Tenemos básicamente dos casos: a) Ruido blanco: En tal caso la autocorrelación del ruido es conocida, y muy sencilla, con lo que es fácil calcular h (t ): N R v (τ − α ) = 0 δ (τ − α ) 2 T N0 N0 T N0 ∫0 h (T − α ) 2 δ (τ − α )dα = h (T − τ ) 2 ∫0 δ (τ − α )dα = h (T − τ ) 2 = µy (τ ) 2µ h (T − τ ) = y (τ ) N0 Podemos prescindir de la constante 2 µ N 0 , por usar un sistema LTI. De esta forma se podría garantizar la máxima SNR para un sistema en el que h (t ) coincida con la señal enviada, es decir, solo la podemos garantizar cuando trabajamos en una sola dimensión, ya que es el único caso en que h (T − τ ) = y (τ ). Si la dimensión es mayor que uno, la señal y (τ ) es suma de varias señales, distintas para cada mensaje enviado, y no podríamos garantizar la máxima SNR. b) Ruido coloreado: En este caso es extremadamente difícil la búsqueda de h (t ). La manera de hacerlo es pensar en el ruido coloreado como ruido blanco que ha pasado por un sistema LTI que lo ha coloreado. Podemos encontrar el sistema inverso que nos permita blanquearlo. Sin embargo, este es un proceso extremadamente complejo, y no entra en los objetivos de este tema 17