04 Ajuste de Distribuciones de Probabilidad Continuas

Anuncio

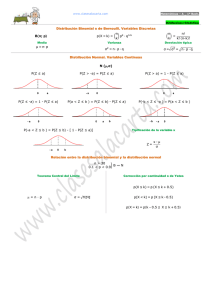

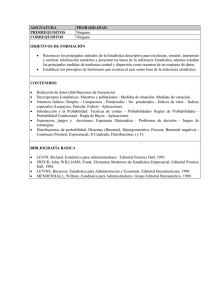

AJUSTE DE DISTRIBUCIONES DE PROBABILIDAD CONTINUAS ESPECIALIZACIÓN EN INGENIERÍA HIDRÁULICA Y AMBIENTAL CONVENIO UNILLANOS Universidad Nacional de Colombia Sede Manizales-Universidad de los Llanos. Por: Blanca Adriana Botero Hernández. [email protected] Distribuciones de probabilidad Son modelos estadísticos de conjuntos de datos…modelos analíticos que representan la distribución de la frecuencia de variables aleatorias (1) . Variables aleatorias discretas: Representan datos por conteo: # de días con lluvia # de deslizamientos en una zona # de accidentes en una vía # de días con falla en el servicio de acueducto Distribuciones de probabilidad discretas Variables aleatorias continuas: Puede tomar valores en una escala continua, representan datos medidos, o datos producto de un modelo Temperaturas Conductivad hidráulica, Presiones Densidades… Distribuciones de probabilidad continuas (1) de Smith M J (2018) STATSREF: Statistical Analysis Handbook - a web-based statistics resource Modelos de distribuciones de probabilidad continuas Distribuciones de probabilidad continuas Distribución Normal 𝑓 𝑥 = 1 𝜎 2𝜋 𝑎 F a =න 1 𝑥−𝜇 2 −2 𝜎 𝑒 1 −∞ 𝜎 2𝜋 𝑝𝑎𝑟𝑎 − ∞ < 𝑥 < ∞ 1 𝑥−𝜇 2 −2 𝜎 𝑒 𝑑𝑥 𝑝𝑎𝑟𝑎 − ∞ < 𝑎 < ∞ Esta distribución se simboliza como N(µ,σ2). µ = media, σ 2= varianza Tomada de (Dekking et al 2005) La distribución normal es un modelo para la distribución de frecuencias observadas de muchos eventos que ocurren naturalmente como la distribución de alturas o pesos de individuos de la misma espacie. O muchas variables naturales. F.M. Dekking, C. Kraaikamp, H.P. Lopuhaa y L.E. Meester. 2005.A Modern Introduction to Probability and Statistics. Understanding Why and How Distribuciones de probabilidad continuas Distribución normal estandar 1 𝑓 𝑧 = 2𝜋 𝑎 F a =න −∞ 1 −2𝑧 2 𝑒 1 2𝜋 𝑒 1 −2𝑧 2 𝑝𝑎𝑟𝑎 − ∞ < 𝑧 < ∞ 𝑑𝑧 𝑝𝑎𝑟𝑎 − ∞ < 𝑎 < ∞ Z es una variable que tiene μ=0 y σ=1 Una variable se puede estandarizar (x transformar en z) así 𝑧 = 𝑥−𝜇 𝜎 Distribuciones de probabilidad continuas Distribución Lognormal 𝑦 = ln(𝑥) 1 𝑓 𝑦 = 𝑥𝜎𝑦 2𝜋 𝑎 F a =න 0 1 𝑦−𝜇𝑦 2 − 𝑒 2 𝜎𝑦 1 𝑥𝜎𝑦 2𝜋 𝑝𝑎𝑟𝑎 0 < 𝑥 < ∞ 1 𝑦−𝜇 2 −2 𝜎 𝑦 𝑒 𝑑𝑥 𝑦 𝑝𝑎𝑟𝑎 0 < 𝑎 < ∞ 1 𝜇+2𝜎 2 𝜇 =𝑒 2 2 2 2𝜇+𝜎 𝜎 𝜎 =𝑒 (𝑒 − 1) Tomado de https://en.wikipedia.org/wiki/Log-normal_distribution Una variable se puede ajustar a una distribución Lognormal si se considera como un producto de pequeños factores independientes. F.M. Dekking, C. Kraaikamp, H.P. Lopuhaa y L.E. Meester. 2005.A Modern Introduction to Probability and Statistics. Understanding Why and How Distribuciones de probabilidad continuas Distribución Pareto 𝑥 − 𝑥0 𝐹 𝑥 =1− 1−𝑘 𝛼 f 𝑥 = 1 𝛼 1−𝑘 𝑥−𝑥0 𝛼 1 𝑘 α es el parámetro de escala, k es el parámetro de forma y 𝑥0 puede ser un parámetro de localización. 1 −1 𝑘 𝑠𝑖 𝑘 > 0 𝑒𝑛𝑡𝑜𝑛𝑐𝑒𝑠 𝑥0 < 𝑥 < ∞ 𝛼 𝑠𝑖 𝑘 < 0 𝑒𝑛𝑡𝑜𝑛𝑐𝑒𝑠 𝑥0 < 𝑥 < 𝑥0 + 𝑘 Distribuciones de probabilidad continuas Familia de distribuciones de Valor Extremo Generalizado (GEV) La teoría del valor extremo indica que la distribución de probabilidad de los valores extremos (máximo o mínimos) seleccionados de conjuntos de datos, independiente de como se distribuyan estos, convergen a una de las tres formas de distribuciones de valor extremo, llamadas tipo I, II y III, cuando el número de valores extremos seleccionados es grande. Estas tres formas (I, II y III) son casos especiales de una distribución llamada GEV F x =𝑒 − 𝑥−𝜇 1/𝑘 1−𝑘 𝛼 𝑥−𝜇 f x = 𝐹(𝑥) 1 − 𝑘 𝛼 1 𝑘 −1 𝑘 es el parámetro de forma, 𝜇 es el parámetro de localización y 𝛼 el parámetro de escala 𝛼 𝛼 Las tres formas I, II y III aparecen cuando k=0, k<0 entonces x>(𝜇+ 𝑘 ) y si k>0 entonces x<(𝜇 − 𝑘 ) Distribuciones de probabilidad continuas EV I ó Distribución Gumbel 1 − f x = 𝑒 𝛼 F x = 𝑒 −𝑒 − 𝑥−𝜇 𝛼 𝑒 −𝑒 𝑥−𝜇 𝛼 − 𝑥−𝜇 𝛼 𝑐𝑜𝑛 𝑝𝑎𝑟𝑎 − ∞ < 𝑥 < ∞ 𝛼>0 Media = 𝜇 + 0.5772 𝛼 𝛼𝜋 2 Varianza= 6 En algunos textos la ecuación puede variar y los parámetros pueden ser simbolizados de forma diferente Distribuciones de probabilidad continuas EV II ó Distribución Frechet F x = 𝑥−𝜇 1/𝑘 − 1−𝑘 𝛼 𝑒 𝛼 𝜇+ ≤𝑥≤∞ 𝑘 𝑐𝑜𝑛 𝑘 < 0, 𝑝𝑎𝑟𝑎 𝑐𝑜𝑛 𝑘 > 0, 𝛼 𝑝𝑎𝑟𝑎 − ∞ ≤ 𝑥 ≤ 𝜇 + 𝑘 EV III ó Distribución Weibull F x = 𝑥−𝜇 1/𝑘 − 1−𝑘 𝛼 𝑒 Distribuciones de probabilidad continuas TCEV (Two Components Extreme Value) 𝜆1 y 𝜆2 𝑃𝑎𝑟á𝑚𝑒𝑡𝑟𝑜𝑠 𝑑𝑒 𝑓𝑜𝑟𝑚𝑎 población 1 y 2 respectivamente F x = −𝜃1 𝑥 −𝜆 𝑒 −𝜃2 𝑥 −𝜆 𝑒 1 2 𝑒 f x = 𝑒 −𝜆1 𝑒 −𝜃1 𝑥 −𝜆2 𝑒 −𝜃2 𝑥 𝜃1 y 𝜃2 𝑃𝑎𝑟á𝑚𝑒𝑡𝑟𝑜𝑠 𝑑𝑒 𝑒𝑠𝑐𝑎𝑙𝑎 población 1 y 2 respectivamente (𝜆1 𝜃1 𝑒 −𝜃1 𝑥 + 𝜆2 𝜃2 𝑒 −𝜃2 𝑥 ) Cuando los datos provienen de dos poblaciones o de dos procesos diferentes….por ejemplo crecidas ordinarias y extraordinarias que responden a dos fenómenos diferentes Distribuciones de probabilidad continuas Pearson tipo III 𝛽 𝑓 𝑥 = 𝛽−1 −𝜆(𝑥−𝜖) 𝜆 (𝑥 − 𝜖) 𝑒 Γ(𝛽) 𝑝𝑎𝑟𝑎 𝑥 ≥ 𝜖 𝑥 𝜆𝛽 (𝑥−𝜖)𝛽−1 𝑒 −𝜆(𝑥−𝜖) 𝑑𝑥 Γ(𝛽) F x = 𝜖 Es un sistema de siete distribuciones planteadas por Pearson. Donde se encuentra incluso la Normal como un caso especial. Una de las formas mas comunes es el tipo III. El cual es utilizado para representar la distribución de probabilidad de valores extremos con asimetría positiva LogPearson tipo III Si x sigue una distribución Pearson tipo III, entonces y=log(x) sigue una distribución logPearson 𝜆𝛽 (log 𝑥 − 𝜖)𝛽−1 𝑒 −𝜆(log 𝑥−𝜖) 𝑓 𝑥 = 𝑥Γ(𝛽) F x = log 𝑥 𝜆𝛽 (log 𝑥−𝜖)𝛽−1 𝑒 −𝜆(log 𝑥−𝜖) 𝑑𝑥 𝜖 𝑥Γ(𝛽) 𝑝𝑎𝑟𝑎 log 𝑥 ≥ 𝜖 Cuando la asimetría es muy positiva, se puede representar mejor por una LogPearson tipo III Ajuste de distribuciones… Método de los momentos para estimar los parámetros Método desarrollado por Pearson en 1902. Unos buenos estimativos de los parámetros de una función de distribución de probabilidad son aquellos para los cuales los momentos de la función de densidad de probabilidad son iguales a los momentos de la muestra ∞ 𝑥ҧ = 𝜇 = 𝐸 𝑥 = න 𝑥𝑓 𝑥 𝑑𝑥 −∞ 𝑠 2 = 𝜎 2 = 𝐸 (𝑥 − 𝜇)2 = 𝐸 𝑥 2 − 𝜇2 ∞ con 𝐸 𝑥 2 = −∞ 𝑥 2 𝑓 𝑥 𝑑𝑥 𝐶𝑠 = 𝛾 = 𝐸 (𝑥−𝜇)3 (𝜎 2 )3/2 = 𝐸 𝑥 3 −3𝜇𝐸 𝑥 2 +2𝜇3 (𝜎 2 )3/2 ∞ con 𝐸[𝑥 3 ] = −∞ 𝑥 3 𝑓 𝑥 𝑑𝑥 Fuente: Ven te Chow. Hidrología Aplicada Método de los momentos para estimar los parámetros Realizando este procedimiento para la f(x) de la distribución de interés se obtienen los parámetros. En la literatura se encuentran para muchas distribuciones estos momentos ya calculados, para otras la solución de la integral que define los momentos requiere de métodos numéricos y no se expresa de manera analítica Tomada de Ven Te Chow. Hidrología Aplicada. MAcGrawHil. Método de los momentos para estimar los parámetros Tomada de Ven Te Chow. Hidrología Aplicada. MAcGrawHil. Método de los momentos para estimar los parámetros PARETO 𝑥 − 𝑥0 𝐹 𝑥 =1− 1−𝑘 𝛼 f 𝑥 = 1 𝛼 1−𝑘 𝑥−𝑥0 𝛼 1 −1 𝑘 1 𝑘 𝜇 − 𝑥0 𝜎 𝑘= 2 2 −1 𝛼 = 𝜇 − 𝑥0 1 + 𝑘 𝑥0 =Umbral inferior conocido o cero 𝜃1 = TCEV F x =𝑒 𝜆1 = 𝑒 𝜇𝜃1−0.5772 −𝜆1 𝑒 −𝜃1 𝑥 −𝜆2 𝑒 −𝜃2 𝑥 f x = 𝑒 −𝜆1𝑒 −𝜃1 𝑥 −𝜆 𝑒 −𝜃2 𝑥 2 𝜋 6𝜎 (𝜆1 𝜃1 𝑒 −𝜃1𝑥 + 𝜆2 𝜃2 𝑒 −𝜃2𝑥 ) 𝜃2 𝜃 = 𝜃1 𝜆 = 𝜆2 𝜆1 𝜃 Aproximación de los parámetros Ajuste de distribuciones de probabilidad continuas Método de la máxima verosimilitud (MLE) La verosimilitud de una muestra de datos es la probabilidad de obtener ese conjunto particular de datos dado el modelo de probabilidad escogido Se basa en la teoría estadística que afirma que los mejores estimadores de los parámetros de una fdp son lo que maximizan la probabilidad conjunta de ocurrencia de una muestra observada (Chow, 194). La función de Verosimiltud (Likelihood) es una función proporcional a la función de densidad de probabilidad conjunta, que si se maximiza se pueden encontrar los parámetros mas adecuados para la fdp de la muestra 𝐿(𝑥1 , 𝑥2 , 𝑥3 ,… 𝑥𝑛 , Θ) = ς𝑛𝑖=1 𝑓(𝑥𝑖 , Θ), MLE consiste en encontrar Θ que maximiza 𝐿(𝑥1 , 𝑥2 , 𝑥3 ,… 𝑥𝑛 , Θ) o el logaritmo de la función LL. 𝐿𝐿(𝑥1 , 𝑥2 , 𝑥3 ,… 𝑥𝑛 , Θ) = σ𝑛𝑖=1 𝐿𝑛𝑓(𝑥𝑖 , Θ) Derivar la función LL, y maximizar, que operativamente será igual a encontrar el mínimo de la función (-LL). También se puede con un método de optimización ya programado, resolver el problema. (AFINS, R…) etc Ejemplos 1. Suponga que la temperatura promedio anual dada en el archivo, se distribuye según una normal. Obtenga -La función de distribución empírica y el ajuste de la función de distribución normal a sus datos. -La probabilidad de que la temperatura promedio anual en este sitio esté por debajo de 16°C. -La probabilidad de que la temperatura promedio anual en este sitio exceda los 20°C Pruebas de bondad de ajustes • Las pruebas de bondad de ajuste indican cuando es o no razonable asumir que un variable aleatoria se distribuye según una distribución específica • Buscan probar una hipótesis basados en un estadístico • Ho= Hipotesis nula: las muestra se distribuye según la distribución especificada Pruebas de bondad de ajustes TEST Chi-Cuadrado Especial para distribuciones discretas. Aunque se puede usar con distribuciones continuas Calcula el estadístico X2 de la muestra 𝑘 𝑜𝑖 − 𝑒𝑖 𝑥2 = 𝑒𝑖 2 𝑖 Donde 𝑜𝑖 es la frecuencia de observaciones en el i esimo intervalo de clase, 𝑒𝑖 es la frecuencia de observaciones en el i esimo intervalo de clase obtenida de la función de densidad a evaluar. 𝑒𝑖 = f(xi)n Si la variable es continua f(xi) (probabilidad de caer en el intervalo i) se calcula como: F(xsupi)-F(xinfi) 2 La Ho se rechaza si 𝑥 2 >= 𝑥1−𝑎 con v=k-p-1 grados de libertad, para un nivel de significancia 0.05. Se espera que por cada clase haya 5 valores para que esta prueba sea significante Ejemplo: Efectuar el Chi-cuadrado para los ajustes realizados a la distribución de Temperaturas. Pruebas de bondad de ajustes TEST Kolmogorv-Smirnov Prueba No paramétrica. Utiliza la F.D.A y es para distribuciones continuas Calcula el estadístico D de la muestra 𝐷 = 𝑚𝑎𝑥 𝐹. 𝐷. 𝐴 𝑒𝑚𝑝𝑖𝑟𝑐𝑎 𝑥 − 𝐹(𝑥) Ho se rechaza si D > Dα Ho no se rechaza si D <= Dα Donde α es el nivel de significancia, que es la probabilidad de equivocarse…(se verá mas adelante) P(rechazar H0 / H0 es cierta)= α El valor crítico Dα se ha tabulado para varios niveles de significancia y diferentes valores de n (ver anexos) Ejemplo: Efectuar el test de Kolmogorv Estimación de cuantiles Dada la probabilidad acumulada F(x), obtener el valor de la variable que tiene esa probabilidad (Cuantil ) Métodos para obtener los cuantiles: • Si la F(x) permite despejar la x, o presenta una ecuación para obtener x, dada F, se despeja el valor del cuantil. • Si la F(x) no tiene expresión analítica (Normal, Gamma, etc…) se utilizan métodos numéricos para obtener el cuantil, dada F(x). Para algunas funciones existen tablas o software que las incorporan (Excel, R) • Por el factor de frecuencia Estimación de cuantiles- Factor de Frecuencia La magnitud de una variable aleatoria puede representarse como: 𝑥𝑇 = 𝜇 + Δ𝑥𝑇 Δ𝑥𝑇 = 𝐾𝑇 𝜎 = 𝐾𝑇 𝑠 𝑥𝑇 = 𝜇 + 𝐾𝑇 𝑠 𝑇= 1 1−𝐹 𝑥 La media 𝜇 mas una desviación de la variable con respecto a la media Δ𝑥𝑇 La desviación de la variable con respecto a la media Δ𝑥𝑇 se puede aproximar al producto de la desviación estándar y un factor de frecuencia 𝐾𝑇 Ecuación para el cálculo de los cuantiles en función del factor de frecuencia 𝐾𝑇 , de la media y de la desviación de la variable. Para una distribución dada, se puede determinar una relacón entre 𝐾𝑇 y T (el período de retorno) en términos de una expresión matemática o una tabla. Ver documento pdf para explicación de Kt, para normal, Gumbel y Logpearson III Estimación de cuantiles- Resumen métodos Función de distribución Invertible (despejar cuantil dada F(x)) Programada Factor de Frecuencia Normal No Excel, R Si Lognormal No Excel, R Si Gamma No Excel, R Si Exponencial Si Excel, R No Pareto Si No No GEV Si No No Gumbel (GEV tipo I) Si No Si Frechet (GEV tipo II) Si No No Weibull (GEV tipo III) Si No No TCEV Si No No Pearson tipo III No No Si Log Pearson tipo III No No Si Pruebas de bondad de ajustes Q-Q plot Grafica los cuantiles obtenidos de la muestra y obtenidos de la distribución ajustada Ejemplos 2. Para la temperatura promedio anual dada en el archivo, ajuste también una función Gumbel. Aplique la prueba de bondad de ajuste de chi cuadrado y kolmogorov para determinar cual función se ajusta mejor a sus datos 3.Ajuste a los caudales del archivo una función lognormal. Calcule el caudal que tiene una probabilidad de excedencia del 2%., obtenga el ca • de Smith M J (2018) STATSREF: Statistical Analysis Handbook - a web-based statistics resource https://www.statsref.com/HTML/index.html. Sección 4.2 • R. E. Walpole, R. Myers, S. L. Myers Y K. Ye. Probabilidad y estadística para ingeniería y ciencias. Novena edición Pearson Educación, México, 2012. Capítulos 5 y 6 • Probabilidad y Estadística. Aplicaciones y Métodos. G, Canavos, 1988 • Fitting distributions with R. V, Ricci. Febrero 2005