PROFESOR: LUIS E. NIETO BARAJAS

6. Teoría de decisión

6.1 Fundamentos y Axiomas de coherencia

¾ El

OBJETIVO

de la estadística, y en particular de la estadística

Bayesiana, es proporcionar una metodología para analizar

adecuadamente la información con la que se cuenta (análisis de

datos) y decidir de manera razonable sobre la mejor forma de

actuar (teoría de decisión).

¾ DIAGRAMA de la Estadística:

Toma de decisiones

Población

Inferencia

Muestreo

Muestra

Análisis de datos

¾ Tipos de INFERENCIA:

Clásica Bayesiana

Paramétrica

√√√

√√

No paramétrica

√√

√

Especialización en Evaluación de Proyectos

193

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ La estadística esta basada en la TEORÍA

DE PROBABILIDADES.

Formalmente la probabilidad es una función que cumple con ciertas

condiciones (axiomas de la probabilidad), pero en general puede

entenderse como una medida o cuantificación de la incertidumbre.

¾ Aunque la definición de función de probabilidad es una, existen

varias interpretaciones dela probabilidad: clásica, frecuentista y

subjetiva.

La

METODOLOGÍA

BAYESIANA

está

basada

en

la

interpretación subjetiva de la probabilidad y tiene como punto

central el Teorema de Bayes.

Reverendo Thomas Bayes (1702-1761).

¾ La inferencia estadística es una forma de tomar decisiones. Los

métodos clásicos de inferencia ignoran los aspectos relativos a la

toma de decisiones, en cambio los métodos Bayesianos sí los

toman en cuenta.

¾ ¿Qué es un problema de decisión?. Nos enfrentamos a un

problema de decisión cuando debemos elegir entre dos o más

formas de actuar.

Especialización en Evaluación de Proyectos

194

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ La

TOMA DE DECISIONES

es un aspecto primordial en la vida de un

profesionista, por ejemplo, un administrador debe de tomar

decisiones constantemente en un ambiente de incertidumbre;

decisiones sobre el proyecto más verosímil o la oportunidad de

realizar una inversión.

¾ La

TEORÍA DE DECISIÓN

propone un método de tomar decisiones

basado en unos principios básicos sobre la elección coherente

entre opciones alternativas.

¾ ELEMENTOS

DE

UN

PROBLEMA

DE

DECISIÓN

en ambiente de

incertidumbre:

Un problema de decisión se define por la cuarteta (D, E, C, ≤),

donde:

D : Espacio de opciones. Es el conjunto de posibles alternativas,

debe de construirse de manera que sea exhaustivo (que agote

todas las posibilidades que en principio parezcan razonables) y

excluyente (que la elección de uno de los elementos de D excluya

la elección de cualquier otro).

D = {d1,d2,...,dk}.

E : Espacio de eventos inciertos. Contiene los eventos inciertos

relevantes al problema de decisión.

Ei = {Ei1,Ei2,...,Eimi}., i=1,2,…,k.

Especialización en Evaluación de Proyectos

195

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

C : Espacio de consecuencias. Es el conjunto de consecuencias

posibles y describe las consecuencias de elegir una decisión.

C = {c1,c2,...,ck}.

≤ : Relación de preferencia entre las distintas opciones. Se define

de manera que d1≤d2 si d2 es preferido sobre d1.

¾ ÁRBOL DE DECISIÓN (en ambiente de incertidumbre):

No se tiene información completa sobre las

consecuencias de tomar cierta decisión.

E11

E12

d1

di

dk

Nodo de decisión

E1m1

c11

c12

c1m1

Ei1

ci1

Ei2

ci2

Eimi

cimi

Ek1

ck1

Ek2

ck2

Ekmk

ckmk

Nodo aleatorio

¾ EJEMPLO 1: Un gerente tiene $B pesos y debe decidir si invertir en

un proyecto o guardar el dinero en el banco. Si guarda su dinero en

Especialización en Evaluación de Proyectos

196

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

el banco y si la tasa de interés se mantiene constante, al final del

año tendría el doble, pero si la tasa sube tendría 3 veces más. Si

invierte en el proyecto, puede ocurrir que el proyecto sea exitoso o

que fracase. Si el proyecto es exitoso y la tasa de interés se

mantiene constante, al final de un año tendría 10 veces la inversión

inicial, pero si la tasa sube tendría únicamente 4 veces más de su

inversión inicial. En caso de que el proyecto fracasara al final de un

año habrá perdido su inversión inicial.

D = {d1, d2}, donde d1 = proyecto, d2 = banco

E = {E11, E12, E13, E21, E22}, donde E11 = éxito / tasa constante, E12 =

éxito / tasa sube, E13 = fracaso, E21 = tasa constante, E22 =

tasa sube

C = {c11, c12, c13, c21, c22}, donde c11=$10B, c12=$5B, c13=-$B,

c21=$2B, c22=$4B

T. cte.

$10B

T. sube

$5B

Éxito

Proyecto

Fracaso

-$B

Banco

T. cte.

T. sube

Especialización en Evaluación de Proyectos

197

$2B

$4B

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ En la práctica, la mayoría de los problemas de decisión tienen una

estructura más compleja. Por ejemplo, decidir si realizar o no un

proyecto, y en caso afirmativo tratar de decidir la acción más

adecuada según el resultado del proyecto. (Problemas de decisión

secuenciales).

¾ Frecuentemente, el conjunto de eventos inciertos es el mismo para

cualquier decisión que se tome, es decir, Ei = {Ei1,Ei2,...,Eimi} =

{E1,E2,...,Em} = E, para todo i. En este caso, el problema se puede

representar como:

E1

¾ El

OBJETIVO

... Ej

... Em

d1

c11 ... c1j ... c1m

M

M

di

ci1

M

M

dk

ck1 ... ckj ... ckm

M

... cij

M

M

... cim

M

de un problema de decisión en ambiente de

incertidumbre consiste entonces en elegir ¡la mejor! decisión di del

conjunto D sin saber cuál de los eventos Eij de Ei ocurrirá.

¾ Aunque los sucesos que componen cada Ei son inciertos, en el

sentido de que no sabemos cuál de ellos tendrá lugar, en general

se tiene una idea sobre la probabilidad de cada uno de ellos. Por

ejemplo,

Especialización en Evaluación de Proyectos

198

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¿Cuál es más probable?

40 años

¿viva 10 más?

¿muera en 1 mes?

¿llegue a los 100?

¾ Algunas veces resulta difícil ordenar nuestras preferencias sobre

las distintas consecuencias posibles. Tal vez resulta más fácil

asignar una utilidad a cada una de las consecuencias y ordenar

posteriormente de acuerdo a la utilidad.

Ganar mucho dinero y

tener poco tiempo

disponible

Consecuencias

Ganar poco dinero y

tener mucho tiempo

disponible

Ganar regular de

dinero y tener regular

de tiempo disponible

¾ CUANTIFICACIÓN de los sucesos inciertos y de las consecuencias.

La información que el decisor tiene sobre la posible ocurrencia de

los eventos inciertos puede ser cuantificada a través de una función

de probabilidad sobre el espacio E.

Especialización en Evaluación de Proyectos

199

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

De la misma manera, es posible cuantificar las preferencias del

decisor entre las distintas consecuencias a través de una función de

utilidad de manera que c ij ≤ c i' j' ⇔ u(c ij ) ≤ u(c i' j' ) .

¾ Alternativamente, es posible representar el árbol de decisión de la

siguiente manera:

d1

di

P(E11|d1)

u(c11)

P(E12|d1)

u(c12)

P(E1m1|d1)

u(c1m1)

P(Ei1|di)

u(ci1)

P(Ei2|di)

P(Eimi|di)

u(ci2)

u(cimi)

dk

P(Ek1|dk)

u(ck1)

P(Ek2|dk)

u(ck2)

P(Ekmk|dk)

u(ckmk)

¾ ¿CÓMO tomar ¡la mejor! decisión?

Si de alguna manera fuéramos capaces de deshacernos de la

incertidumbre podríamos ordenar nuestras preferencias de acuerdo

con las utilidades de cada decisión. La mejor decisión sería la que

tenga la utilidad máxima.

Decisor

¡Fuera¡

Especialización en Evaluación de Proyectos

Incertidumbre

200

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ ESTRATEGIAS: En un principio estudiaremos cuatro estrategias o

criterios propuestos en la literatura para tomar una decisión.

1) Optimista : Dar por “segura” a la mejor consecuencia de cada

opción.

2) Pesimista (o minimax): Dar por “segura” a la peor consecuencia

de cada opción.

3) Consecuencia más probable (o condicional): Dar por “segura” a

la consecuencia más probable de cada opción.

4) Utilidad esperada: Dar por “segura” una consecuencia promedio

para cada opción.

Cualquiera que sea la estrategia tomada, la mejor opción es aquella

que maximice la utilidad del árbol “sin incertidumbre”.

¾ EJEMPLO 2: En unas elecciones parlamentarias en la Gran Bretaña

competían los partidos Conservador y Laboral. Una casa de

apuestas ofrecía las siguientes posibilidades:

a) A quien apostara a favor del partido Conservador, la casa estaba

dispuesta a pagar 7 libras por cada 4 que apostase si el

resultado favorecía a los conservadores, en caso contrario el

apostador perdía su apuesta.

b) A quien apostase a favor del partido Laboral, la casa estaba

dispuesta a pagar 5 libras por cada 4 que apostasen si ganaban

los laboristas, en caso contrario el apostador perdía su apuesta.

Especialización en Evaluación de Proyectos

201

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¿A qué partido apostar?

Laboral

Conservador

o D = {d1,d2}

donde, d1 = Apostar al partido Conservador

d2 = Apostar al partido Laboral

o E = {E1, E2}

donde, E1 = Que gane el partido Conservador

E2 = Que gane el partido Laboral

o C = {c11, c12, c21, c22}. Si la apuesta es de k libras

entonces,

7

3

c11 = − k + k = k

4

4

c12 = −k

c 21 = −k

5

1

c 22 = −k + k = k

4

4

Supongamos que la utilidad es proporcional al dinero, i.e.,

u(cij) = cij y sea π = P(E1), y 1 − π = P(E2).

P(E)

π

1− π

u(d,E)

E1

E2

d1

(3/4)k

-k

d2

-k

(1/4)k

Especialización en Evaluación de Proyectos

202

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

1) Optimista: d1 (apostar al partido Conservador)

2) Pesimista: d1 ó d2 (da igual cualquiera de las dos)

3) Consecuencia más probable: d1 ó d2 (dependiendo)

Si π > 1 / 2 se toma a E1 como “seguro” ⇒ d1

Si π ≤ 1 / 2 se toma a E2 como “seguro” ⇒ d2

4) Utilidad esperada: d1 ó d2 (dependiendo)

Las utilidades esperadas son:

u(d1 ) = π(3 / 4)k + (1 − π)( −k ) = {(7 / 4)π − 1}k

u(d2 ) = π( −k ) + (1 − π)(1 / 4)k = {(1 / 4) − (5 / 4)π}k

Entonces, la mejor decisión sería:

Si u(d1 ) > u(d2 ) ⇔ π > 5 / 12 ⇒ d1

Si u(d1 ) < u(d2 ) ⇔ π < 5 / 12 ⇒ d2

Si u(d1 ) = u(d2 ) ⇔ π = 5 / 12 ⇒ d1 ó d2

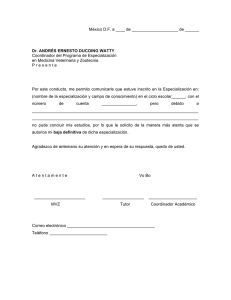

Gráficamente, si definimos las funciones

7

g1 (π) = k π − k = u(d1 ) , y

4

k

5

g2 (π) = − k π + = u(d2 )

4

4

Especialización en Evaluación de Proyectos

203

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

1.0

entonces, si k = 1,

0.5

g1(π)

0.0

5/12

4/7

-0.5

1/5

-1.0

g2(π)

0.0

0.2

0.4

0.6

0.8

1.0

La línea gruesa representa la mejor solución al problema de

decisión dada por el criterio de la utilidad esperada.

Observación: Si π ∈ [1 / 5,4 / 7], la utilidad esperada de la mejor

decisión es negativa!.

Pregunta 1: ¿Tu apostarías si π ∈ [1 / 5,4 / 7]?

Pregunta 2: ¿Cuál es el valor que la casa esperaría tuviera π?.

Intuitivamente, la casa esperaría que π ∈ [1 / 5,4 / 7].

¾ INADMISIBILIDAD de una opción: Una opción d1 es inadmisible si

existe otra opción d2 tal que d2 es al menos tan preferible como d1

pase lo que pase (para cualquier suceso incierto) y existe un caso

(suceso incierto) para el que d2 es más preferida que d1.

Especialización en Evaluación de Proyectos

204

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ AXIOMAS DE COHERENCIA. Son una serie de principios que establecen

las condiciones para tomar decisiones coherentemente y para

aclarar las posibles ambigüedades en el proceso de toma de

decisión. Los axiomas de coherencia son 4:

1. COMPARABILIDAD. Este axioma establece que al menos debemos

ser capaces de expresar preferencias entre dos posibles opciones y

por lo tanto entre dos posibles consecuencias. Es decir, no todas

las opciones ni todas las consecuencias son iguales.

Para todo par de opciones d1 y d2 en D, es cierta una y sólo una

de las siguientes condiciones:

d2 es más preferible que d1 ⇔ d1 < d2

d1 es más preferible que d2 ⇔ d2 < d1

d1 y d2 son igualmente preferibles ⇔ d1 ∼ d2

2. TRANSITIVIDAD. Este axioma establece que las preferencias deben

de ser transitivas para no caer en contradicciones.

Si d1, d2 y d3 son tres opciones cualesquiera y ocurre que d1<d2 y

d2<d3

entonces,

necesariamente

sucede

que

d1<d3.

Análogamente, si d1∼d2 y d2∼d3, entonces d1∼d3.

3. SUSTITUCIÓN

Y DOMINANCIA.

Este axioma establece que si se

tienen dos situaciones tales que para cualquier resultado que se

tenga de la primera, existe un resultado preferible en la segunda,

Especialización en Evaluación de Proyectos

205

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

entonces la segunda situación es preferible para todos los

resultados.

Si d1 y d2 son dos opciones cualesquiera y E es un evento

incierto y sucede que d1<d2 cuando ocurre E y d1<d2 cuando no

ocurre E, entonces d1<d2 (sin importar los eventos inciertos).

Análogamente, si d1∼d2 cuando ocurre E y d1∼d2 cuando no

ocurre E, entonces d1∼d2.

4. EVENTOS

DE REFERENCIA.

Este axioma establece que para poder

tomar decisiones de forma razonable, es necesario medir la

información y las preferencias del decisor expresándolas en forma

cuantitativa. Es necesario una medida (P) basada en sucesos o

eventos de referencia.

El decisor puede imaginar un procedimiento para generar puntos

en el cuadrado unitario de dos dimensiones, de manera tal que

para cualesquiera dos regiones R1 y R2 en ese cuadrado , el

evento {z ∈ R 1 } es más creíble que el evento {z ∈ R 2 } únicamente

si el área de R1 es mayor que el área de R2.

Especialización en Evaluación de Proyectos

206

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

6.2 Principio de utilidad esperada máxima

¾ IMPLICACIONES de los axiomas de coherencia:

En general, toda opción di se puede escribir como todas sus

posibles consecuencias dados los sucesos inciertos, es decir,

{

}

di = c ij Eij , j = 1,K, mi .

1) Las consecuencias pueden verse como casos particulares de

opciones:

c ~ dc = {c Ω},

donde Ω es el evento seguro.

De esta forma podemos comparar las consecuencias:

c1 ≤ c2 ⇔ {c1|Ω} ≤ {c2|Ω}.

Por lo tanto, es posible encontrar dos consecuencias c∗ (la peor)

y c∗ (la mejor) tales que para cualquier otra consecuencia c, c∗ ≤

c ≤ c∗.

2) Los eventos inciertos también pueden verse como casos

particulares de opciones:

{

}

E ~ dE = c * E, c ∗ E c ,

donde c∗ y c* son la peor y la mejor consecuencias.

De esta forma podemos comparar los eventos inciertos:

E ≤ F ⇔ {c*|E, c∗|Ec} ≤ {c*|F, c∗|Fc},

en este caso diremos que E no es más verosímil (probable) que

F.

Especialización en Evaluación de Proyectos

207

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ CUANTIFICACIÓN

DE LAS CONSECUENCIAS:

La cuantificación de la

consecuencia c será un número u(c) medido en la escala [0,1]. Esta

cuantificación estará basada en eventos de referencia.

o Definición: Utilidad.

La utilidad u(c) de una consecuencia c es la probabilidad q que

debe asignarse a la mejor consecuencia c* para que la

consecuencia c sea igualmente deseable que la opción

{c*|Rq, c∗|Rqc}

(que también se puede escribir como {c*|q, c∗|1−q}), donde Rq es un

evento de referencia en el cuadrado unitario de área q. De esta

forma, para toda consecuencia c existe una opción basada en

eventos de referencia tal que

c ∼ {c*|u(c), c∗|1−u(c)}.

En virtud de los axiomas de coherencia 1, 2 y 3 siempre existe un

número u(c)∈[0,1] que cumpla con la condición anterior, puesto que

c* ~ {c*|R0, c∗|R0c} ⇒ u(c∗) = 0

c* ~ {c*|R1, c∗|R1c} ⇒ u(c∗) = 1

Por lo tanto, para toda c tal que c∗ ≤ c ≤ c∗ ⇒ 0 ≤ u(c) ≤ 1.

EJEMPLO 3: Utilidad del dinero. Supongamos que la peor y la mejor

consecuencias al jugar un juego de azar son:

c* = $0 (la peor) y c* = $1,000 (la mejor)

La idea es determinar una función de utilidad para cualquier

consecuencia c tal que c* ≤ c ≤ c*. Pensemos en una lotería:

{c*|q, c∗|1−q}

Especialización en Evaluación de Proyectos

208

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¿Cuál prefieres?

{c|1}

Ganar c* con

probabilidad q

o

Ganar c* con

probabilidad 1-q

Ganar

seguro

c

Si el número de consecuencias es muy grande o incluso infinito la

función de utilidad se puede aproximar por un modelo obteniéndose

una de las siguientes formas:

u(c)

Indiferente al riesgo

Aversión al riesgo

1

Amante al riesgo

c

0

0

1,000

Para no caer en paradojas, es conveniente que la

función de utilidad sea “aversa al riesgo”.

NOTA: En algunos casos es más conveniente definir la función de

utilidad en una escala distinta al intervalo [0,1], como por ejemplo:

en tiempo, en números negativos, productos vendidos, empleos

generados, etc. Es posible demostrar que una función de utilidad

definida en otra escala es una transformación lineal de la utilidad

original definida en [0,1].

Especialización en Evaluación de Proyectos

209

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ CUANTIFICACIÓN

DE LOS EVENTOS INCIERTOS:

La cuantificación de los

eventos inciertos E estará también basada en eventos de

referencia.

o Definición: Probabilidad.

La probabilidad P(E) de un evento incierto E es igual al área de una

región R del cuadrado unitario elegida de tal forma que las opciones

{c*|E,

c∗|Ec}

y

{c*|R,

c∗|Rc}

sean

igualmente

deseables

(equivalentes).

o En otras palabras, si dE = {c∗|E, c∗|Ec} y dR = {c∗|Rq, c∗|Rqc} son tales

que

dE ∼ dRq ⇒ P(E) = q.

EJEMPLO 4: Asignación de la probabilidad de un evento E.

Supongamos que nos enfrentamos al problema de decidir en qué

proyecto invertir y que la peor y la mejor consecuencias son:

c∗ = −$1000 (la peor) y c* = $5,000 (la mejor)

Sea E = sube la tasa de interés. Para determinar la probabilidad de

E consideramos las siguientes loterías:

{c*|E, c∗|Ec}

¿Cuál prefieres?

Ganar c* con

probabilidad q

o

Ganar c∗ con

probabilidad 1-q

Ganar c*

si ocurre E

o

Ganar c∗ si

no ocurre E

Especialización en Evaluación de Proyectos

{c*|q, c∗|1−q}

210

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

Finalmente, se aplica este mismo procedimiento a cada una de los

eventos inciertos, digamos, E1,E2,...,Ek. Si el número de eventos

inciertos es muy grande o incluso infinito la función de probabilidad

se puede aproximar por un modelo (discreto o continuo)

obteniéndose la siguiente forma,

P(θ)

Modelo continuo

Si Eθ ={θ} ⇒

E = {θ | θ∈[a,b]}

θ

a

b

NOTA: La probabilidad asignada a un evento, es siempre

condicional a la información que se posee en el momento de la

asignación, i.e., no existen probabilidades absolutas.

¾ DERIVACIÓN DE LA UTILIDAD ESPERADA:

Hasta ahora, hemos cuantificado a las consecuencias y a los

eventos inciertos. Finalmente queremos asignar un número a las

opciones, del tal forma que la mejor opción es aquella a la que se le

asigna la cuantificación más alta.

o Teorema: Criterio de decisión Bayesiano.

Considérese el problema de decisión definido por D = {d1,d2,...,dk},

{

}

donde di = c ij E j , j = 1,K, mi , i=1,...,k. Sea P(Eij|di) la probabilidad de

que suceda Eij si se elige la opción di, y sea u(cij) la utilidad de la

Especialización en Evaluación de Proyectos

211

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

consecuencia cij. Entonces, la cuantificación de la opción di es su

utilidad esperada, i.e.,

mi

u(di ) = ∑ u(c ij )P(Eij di ).

j =1

( )

La decisión óptima es aquella d∗ tal que u d* = max u(di ) .

DEM.

} {

{

i

di = c ij Eij , j = 1,K, mi = c i1 Ei1,c i2 Ei2 ,K, c imi Eimi

Por otro lado sabemos que,

{

}

} {

}

c ij ∼ c * R ij , c ∗ R ijc = c * u(c ij ), c ∗ 1 − u(c ij ) ,

donde u(c ij ) = Area(R ij ) , y

{

} {

} {

}

dE = c * E, c ∗ E c ∼ c * RE , c ∗ REc = c * P(E j ), c ∗ 1 − P(E j ) ,

donde P(E ) = Area(RE ) .

Entonces, combinando ambas expresiones, tenemos

{{

} {

} }

= {c R ∩ E , c R ∩ E ,K, c R ∩ E , c R ∩ E }

= {c (R ∩ E ) ∪ L ∪ (R ∩ E ), c (R ∩ E ) ∪ L ∪ (R

c

di = c ∗ Ri1, c ∗ Ric1 Ei1,K, c ∗ Rimi , c ∗ Rim

Eim1

i

∗

i1

∗

i1

i1

i1

∗

c

i1

∗

i1

imi

imi

imi

imi

∗

c

i1

c

imi

∗

i1

imi

c

imi

∩ Eimi

)}

Finalmente,

{

(

u(di ) = Area (R i1 ∩ Ei1 ) ∪ L ∪ R imi ∩ Eimi

mi

mi

j =1

j =1

)}

= ∑ Area(R ij )Area(Eij ) = ∑ u(c ij )P(Eij )

Especialización en Evaluación de Proyectos

212

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ RESUMIENDO:

Si

se

aceptan

los

axiomas

de

coherencia,

necesariamente se debe proceder de la siguiente manera:

1) Asignar una utilidad u(c) para toda c en C.

2) Asignar una probabilidad P(E) para toda E en E.

3) Elegir la opción (óptima) que maximiza la utilidad esperada.

6.3 Proceso de aprendizaje y distribución predictiva

¾ La reacción natural de cualquiera que tenga que tomar una decisión

cuyas consecuencias dependen de la ocurrencia de eventos

inciertos E, es intentar reducir su incertidumbre obteniendo más

información sobre E.

¾ ¿Cómo reducir la incertidumbre sobre un evento E?.

Adquirir información adicional (Z) sobre E.

¾ LA

IDEA

es entonces recolectar información que reduzca la

incertidumbre de los eventos inciertos, o equivalentemente, que

mejore el conocimiento que se tiene sobre E.

¾ ¿De dónde obtengo información adicional?.

Encuestas, estudios previos, experimentos, etc.

¾ El problema central de la inferencia estadística es el de

proporcionar una metodología que permita asimilar la información

accesible con el objeto de mejorar nuestro conocimiento inicial.

Especialización en Evaluación de Proyectos

213

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ ¿Cómo utilizar Z para mejorar el conocimiento sobre E?.

¿?

P(E )

P(E Z )

Mediante el Teorema de Bayes.

o TEOREMA DE BAYES: Sean {E j , j ∈ J} una partición finita de Ω (E), i.e.,

Ej∩Ek=∅ ∀j≠k y

U E j = Ω . Sea Z ≠ ∅ un evento. Entonces,

j∈J

P(Ei Z ) =

P(Z Ei )P(Ei )

∑ P(Z Ei )P(Ei )

, i =1,2,...,k.

j∈J

DEM.

P(Ei Z ) =

P(Ei ∩ Z ) P(Z Ei )P(Ei )

=

P(Z )

P(Z )

como Z = Z ∩ Ω = Z ∩ U E j = U (Z ∩ E j ) tal que

j∈J j∈J

(Z ∩ E j ) ∩ (Z ∩ Ek ) = ∅

∀j≠k

⇒ P(Z ) = PU (Z ∩ E j ) = ∑ P(Z ∩ E j ) = ∑ P Z E j P(E j ).

j∈J

j∈J

j∈J

( )

¾ Comentarios:

2) Una forma alternativa de escribir el Teorema de Bayes es:

P(Ei Z ) ∝ P(Z Ei )P(Ei )

P(Z) es llamada constante de proporcionalidad.

Especialización en Evaluación de Proyectos

214

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

3) A las P(Ej) se les llama probabilidades iniciales o a-priori y a las

P(Ej|Z) se les llama probabilidades finales o a-posteriori.

Además, P(Z|Ej) es llamada verosimilitud y P(Z) es llamada

probabilidad marginal de la información adicional.

¾ Recordemos que todo esto de la cuantificación inicial y final de los

eventos inciertos es para reducir la incertidumbre en un problema

de decisión.

Supongamos que para un problema particular se cuenta con lo

siguiente:

P(Eij ) : cuantificación inicial de los eventos inciertos

u(c ij ) : cuantificación de las consecuencias

Z: información adicional sobre los eventos inciertos

Teo. Bayes

P(E Z )

P(E )

En este caso se tienen dos situaciones:

1) Situación inicial (a-priori):

P(Eij ) ,

u(c ij ),

∑ u(c ij )P(Eij )

j

2) Situación final (a-posteriori):

P(Eij Z ) ,

u(c ij ) ,

∑ u(c ij )P(Eij Z )

j

Especialización en Evaluación de Proyectos

215

Utilidad

esperada

inicial

Utilidad

esperada

final

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ ¿Qué pasa si de alguna manera se obtiene aún más información

adicional acerca de E?. Suponga que primero se tiene acceso a Z1

(información adicional acerca de E) y posteriormente se obtiene Z2

(más información adicional acerca de E). Existen dos formas para

actualizar la información que se tiene sobre E:

1) Actualización secuencial:

P(E Z1, Z 2 )

P(E Z1 )

P(E )

Z1

Z2

Los pasos son:

Paso 1: P(E Z1 ) =

P(Z1 E )P(E )

Paso 2: P(E Z1, Z 2 ) =

P(Z1 )

,

P(Z 2 Z1, E )P(E Z1 )

P(Z 2 Z1 )

.

2) Actualización simultánea:

P(E )

Z1,Z2

P(E Z1, Z 2 )

¿Cómo se hace?

Paso único: P(E Z1, Z 2 ) =

P(Z1, Z 2 E )P(E )

P(Z1, Z 2 )

.

¿Serán equivalentes ambas formas de actualización?

Especialización en Evaluación de Proyectos

216

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

P(Z1, Z 2 , E )P(Z1, E )

P(Z 2 Z1, E )P(E Z1 ) P(Z1, E ) P(Z1 )

=

P(E Z1, Z 2 ) =

P(Z 2 Z1 )

P(Z1, Z 2 )

P(Z1 )

=

P(Z1, Z 2 , E ) P(Z1, Z 2 E )P(E )

=

P(Z1, Z 2 )

P(Z1, Z 2 )

¾ EJEMPLO 5: Un paciente va al médico con algún padecimiento y

quiere que el médico le de un diagnóstico. Supongamos que la

enfermedad del paciente cae en alguna de las siguientes tres

categorías:

E1 = enfermedad muy frecuente (resfriado)

E2 = enfermedad relativamente frecuente (gripa)

E3 = enfermedad poco frecuente (pulmonía)

El médico sabe por experiencia que

P(E1)=0.6, P(E2)=0.3, P(E3)=0.1 (probabilidades iniciales)

El médico observa y obtiene información adicional (Z = síntomas)

acerca de la posible enfermedad del paciente. De acuerdo con los

síntomas el doctor dictamina que

P(Z | E1)=0.2, P(Z | E2)=0.6, P(Z | E3)=0.6 (verosimilitud)

¿Qué enfermedad es más probable que tenga el paciente?.

Usando el Teorema de Bayes, obtenemos:

( )

P(Z ) = ∑ P Z E j P(E j ) = (0.2)(0.6) + (0.6)(0.3) + (0.6)(0.1) = 0.36

3

j=1

P(E1 Z ) =

Especialización en Evaluación de Proyectos

(0.2)(0.6) 1

=

0.36

3

217

(probabilidades

finales)

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

P(E 2 Z ) =

(0.6)(0.3) 1

=

0.36

2

P(E 3 Z ) =

(0.6)(0.1) 1

=

0.36

6

Por lo tanto, es más probable que el paciente tenga una

enfermedad relativamente frecuente (E2).

Problema de Inferencia.

¾ PROBLEMA

DE

INFERENCIA.

Sea F

= {f (x θ), θ ∈ Θ} una familia

paramétrica indexada por el parámetro θ∈Θ. Sea X1,...,Xn una m.a.

de observaciones de f(x|θ) ∈F.

El problema de inferencia

paramétrico consiste en aproximar el verdadero valor del parámetro

θ.

El problema de inferencia estadístico se puede ver como un

problema de decisión con los siguientes elementos:

D = espacio de decisiones de acuerdo al problema específico

E = Θ (espacio parametral)

C = {(d, θ) : d ∈ D, θ ∈ Θ}

≤ : Será representado por una función de utilidad o pérdida.

¾ La muestra proporciona información adicional sobre los eventos

inciertos θ∈Θ. El problema consiste en cómo actualizar la

información.

Especialización en Evaluación de Proyectos

218

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ Por lo visto con los axiomas de coherencia, el decisor es capaz de

cuantificar su conocimiento acerca de los eventos inciertos

mediante una función de probabilidades. Definamos,

f (θ)

la

distribución

inicial

a-priori).

(ó

Cuantifica

el

conocimiento inicial sobre θ.

f (x θ)

proceso

generador

de

información

muestral.

Proporciona información adicional acerca de θ.

f (x θ)

la función de verosimilitud. Contiene toda la información

sobre θ proporcionada por la muestra X = (X1,K Xn ) .

Toda esta información acerca de θ se combina para obtener un

conocimiento final o a-posteriori después de haber observado la

muestra. La forma de hacerlo es mediante el Teorema de Bayes:

f (θ x ) =

donde f (x ) = ∫ f (x θ)f (θ)dθ ó

Θ

f (x θ)f (θ)

f (x )

,

∑ f (x θ)f (θ).

θ

Como f (θ x ) es función de θ, entonces podemos escribir

f (θ x ) ∝ f (x θ)f (θ)

Finalmente,

f (θ x )

la distribución final (ó a-posteriori). Proporciona todo el

conocimiento que se tiene sobre θ (inicial y muestral).

¾ NOTA: Al tomar θ el carácter de aleatorio, debido a que el

conocimiento que tenemos sobre el verdadero valor θ es incierto,

Especialización en Evaluación de Proyectos

219

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

entonces la función de densidad que genera observaciones con

información relevante para θ es realmente una función de densidad

condicional.

o Definición: Llamaremos una muestra aleatoria (m.a.) de tamaño n

de una población f(x|θ), que depende de θ, a un conjunto X1,...,Xn

de variables aleatorias condicionalmente independientes dado θ,

i.e.,

f (x1,K x n θ) = f (x1 θ)L f (x n θ).

En este caso, la función de verosimilitud es la función de densidad

(condicional) conjunta de la m.a. vista como función del parámetro,

i.e.,

n

f (x θ) = ∏ f (x i θ).

i =1

¾ DISTRIBUCIÓN

PREDICTIVA:

La distribución predictiva es la función de

densidad (marginal) f(x) que me permite determinar qué valores de

la v.a. X resultan más probables.

Lo que conocemos acerca de X esta condicionado al valor del

parámetro θ, i.e., f(x|θ) (su función de densidad condicional). Como

θ es un valor desconocido, f(x|θ) no puede utilizarse para describir

el comportamiento de la v.a. X.

Distribución predictiva inicial. Aunque el verdadero valor de θ sea

desconocido, siempre se dispone de cierta información sobre θ

Especialización en Evaluación de Proyectos

220

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

(mediante su distribución inicial f(θ)). Esta información puede

combinarse para poder dar información sobre los valores de X. La

forma de hacerlo es:

f (x ) = ∫ f (x θ)f (θ)dθ

f (x ) = ∑ f (x θ)f (θ)

ó

θ

Supongamos que se cuenta con información adicional (información

muestral) X1,X2,..,Xn de la densidad f(x|θ), por lo tanto es posible

tener un conocimiento final sobre θ mediante su distribución final

f (θ x ).

Distribución predictiva final. Supongamos que se quiere obtener

información sobre los posibles valores que puede tomar una nueva

v.a. XF de la misma población f(x|θ). Si XF es independiente de la

muestra X1,X2,..,Xn, entonces

f (x F x ) = ∫ f (x F θ)f (θ x )dθ

f (x F x ) = ∑ f (x F θ)f (θ x )

ó

θ

¾ EJEMPLO 6: Lanzar una moneda. Se tiene un experimento aleatorio

que consiste en lanzar una moneda. Sea X la v.a. que toma el valor

de 1 si la moneda cae sol y 0 si cae águila, i.e., X∼Ber(θ). En

realidad se tiene que X|θ ∼Ber(θ), donde θ es la probabilidad de que

la moneda caiga sol.

f (x θ) = θ x (1 − θ)

1− x

I{0,1} ( x ) .

El conocimiento inicial que se tiene acerca de la moneda es que

puede ser una moneda deshonesta (dos soles).

Especialización en Evaluación de Proyectos

221

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

P(honesta) = 0.95 y P(deshonesta) = 0.05

¿Cómo cuantificar este conocimiento sobre θ?

moneda honesta ⇔ θ = 1/2

}

θ ∈ {1/2, 1}

moneda deshonesta ⇔ θ = 1

por lo tanto,

P(θ = 1 / 2) = 0.95 y P(θ = 1) = 0.05

es decir,

0.95, si θ = 1 / 2

f (θ) =

0.05, si θ = 1

Supongamos que al lanzar la moneda una sola vez se obtuvo un

sol, i.e, X1=1. Entonces la verosimilitud es

P(X1 = 1θ) = θ1 (1 − θ) = θ .

0

Combinando la información inicial con la verosimilitud obtenemos,

P(X1 = 1) = P(X1 = 1θ = 1 / 2)P(θ = 1 / 2) + P(X1 = 1θ = 1)P(θ = 1)

= (0.5 )(0.95 ) + (1)(0.05 ) = 0.525

P(θ = 1 / 2 X1 = 1) =

P(θ = 1 X1 = 1) =

P(X1 = 1θ = 1 / 2)P(θ = 1 / 2)

P(X1 = 1)

P(X1 = 1θ = 1)P(θ = 1)

P(X1 = 1)

=

=

(0.5)(0.95 ) = 0.9047

0.525

(1)(0.05 ) = 0.0953

0.525

es decir,

0.9047, si θ = 1 / 2

f (θ x 1 = 1) =

0.0953, si θ = 1

La distribución predictiva inicial es

P(X = 1) = P(X = 1θ = 1 / 2)P(θ = 1 / 2) + P(X = 1θ = 1)P(θ = 1)

Especialización en Evaluación de Proyectos

222

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

= (0.5 )(0.95 ) + (1)(0.05 ) = 0.525

P(X = 0 ) = P(X = 0 θ = 1 / 2)P(θ = 1 / 2) + P(X = 0 θ = 1)P(θ = 1)

= (0.5 )(0.95 ) + (0 )(0.05 ) = 0.475

es decir,

0.525, si x = 1

f (x ) =

0.475, si x = 0

La distribución predictiva final es

P(XF = 1x1 = 1) = P(XF = 1θ = 1 / 2)P(θ = 1 / 2 x1 = 1) + P(XF = 1θ = 1)P(θ = 1 x1 = 1)

= (0.5 )(0.9047 ) + (1)(0.0953 ) = 0.54755

P(XF = 0 x1 = 1) = P(XF = 0 θ = 1 / 2)P(θ = 1 / 2 x1 = 1) + P(XF = 0 θ = 1)P(θ = 1 x1 = 1)

= (0.5 )(0.9047 ) + (0 )(0.0953 ) = 0.45235

es decir,

0.548, si x F = 1

f (x F x1 = 1) =

.

0.452, si x F = 0

¾ EJEMPLO 7: Proyectos de inversión. Las utilidades de un

determinado proyecto pueden determinarse a partir de la demanda

(θ) que tendrá el producto terminal. La información inicial que se

tiene sobre la demanda es que se encuentra alrededor de $39

millones de pesos y que el porcentaje de veces que excede los $49

millones de pesos es de 25%.

De acuerdo con la información proporcionada, se puede concluir

que

una

distribución

normal

comportamiento inicial, entonces

(

modela

“adecuadamente”

el

)

θ ∼ N µ, σ 2 ,

donde µ=E(θ)=media y σ2=Var(θ)=varianza. Además

Especialización en Evaluación de Proyectos

223

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

Demanda (θ) alrededor de 39

µ=39

σ=14.81

P(θ > 49) = 0.25

¿Cómo?

49 − 39

49 − 39

P(θ > 49 ) = P Z >

,

= 0.25 ⇒ Z 0.25 =

σ

σ

como Z0.25 = 0.675 (valor de tablas) ⇒ σ =

10

0.675

Por lo tanto, θ ∼ N(39, 219.47).

Para adquirir información adicional sobre la demanda, se

considerarán 3 proyectos similares cuyas utilidades dependen de la

misma demanda. Supongamos que la utilidad es una variable

aleatoria con distribución Normal centrada en θ y con una

desviación estándar de σ=2.

X|θ ∼ N(θ, 4)

y θ ∼ N(39, 219.47)

Se puede demostrar que la distribución predictiva inicial toma la

forma

X ∼ N(39, 223.47)

¿Qué se puede derivar de esta distribución predictiva?

60 − 39

P(X > 60 ) = P Z >

= P(Z > 1.4047 ) = 0.0808 ,

223.47

lo cual indica que es muy poco probable tener una utilidad mayor a

60.

Suponga que las utilidades de los 3 proyectos son: x1=40.62,

x2=41.8, x3=40.44.

Especialización en Evaluación de Proyectos

224

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

Se puede demostrar que si

X|θ ∼ N(θ, σ2) y θ ∼ N(θ0, σ02) ⇒ θ x ∼N(θ1, σ12)

n

1

x + 2 θ0

2

σ

σ0

1

donde, θ1 =

y σ12 =

.

n

1

n

1

+

+

σ 2 σ 02

σ 2 σ 02

Por lo tanto,

x =40.9533, θ0 = 39, σ2 = 4, σ02 = 219.47, n=3

θ1 = 40.9415, σ12 = 1.3252 ∴ θ x ∼ N(40.9415, 1.3252)

6.4 Distribuciones iniciales informativas, no informativas y

conjugadas

¾ Existen diversas clasificaciones de las distribuciones iniciales. En

términos de la cantidad de información que proporcionan se

clasifican en informativas y no informativas.

¾ DISTRIBUCIONES

INICIALES INFORMATIVAS:

Son aquellas distribuciones

iniciales que proporcionan información relevante e importante sobre

la ocurrencia de los eventos inciertos θ.

Especialización en Evaluación de Proyectos

225

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ EJEMPLO 8: La distribución inicial para θ del Ejemplo 7 es un

ejemplo de distribución inicial informativa. En el mismo contexto del

Ejemplo 7, supongamos ahora que existen únicamente 3 posibles

estados de la demanda: θ1 = demanda baja, θ2 = demanda media y

θ3 = demanda alta. Suponga además que la demanda media se

cree tres veces tan probable que la demanda baja y la demanda

alta dos veces tan probable que la demanda baja. Especifica la

distribución inicial para la demanda.

Sea pi=P(θi), i =1,2,3. Entonces,

p2=3p1 y p3=2p1. Además, p1 + p 2 + p 3 = 1

⇒ p1+ 3p1+ 2p1=1 ⇔ 6p1=1 ∴ p1=1/6, p2=1/2 y p3=1/3

¾ DISTRIBUCIONES

INICIALES

NO

INFORMATIVAS:

Son

aquellas

distribuciones iniciales que no proporcionan información relevante o

importante sobre la ocurrencia de los eventos inciertos θ.

¾ Existen varios criterios para definir u obtener una distribución inicial

no informativa:

1) Principio de la razón insuficiente: Bayes (1763) y Laplace (1814,

1952). De acuerdo con este principio, en ausencia de evidencia en

contra, todas las posibilidades deberían tenerla misma probabilidad

inicial.

o En particular, si θ puede tomar un número finito de valores,

digamos m, la distribución inicial no informativa, de acuerdo con

este principio es:

Especialización en Evaluación de Proyectos

226

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

f (θ) =

1

I{θ , θ ,K,θ }(θ)

m 1 2 m

o ¿Qué pasa cuando el número de valores (m) que puede tomar θ

tiende a infinito?

f (θ) ∝ cte.

En este caso se dice que f(θ) es una distribución inicial impropia,

porque no cumple con todas las propiedades para ser una

distribución inicial propia.

2) Distribución

distribución

inicial

inicial

invariante:

Jeffreys

no

informativa

(1946)

propuso

invariante

una

ante

reparametrizaciones, es decir, si πθ(θ) es la distribución inicial no

informativa para θ entonces, π ϕ (ϕ) = π θ (θ(ϕ)) Jθ (ϕ) es la distribución

inicial no informativa de ϕ = ϕ(θ). Esta distribución es generalmente

impropia.

o La regla de Reffreys consiste en lo siguiente: Sea F

= {f (x θ) : θ ∈ Θ}, Θ⊂ℜd un modelo paramétrico para la variable

aleatoria X. La distribución inicial no informativa de Jeffreys para

el parámetro θ con respecto al modelo F es

π(θ) ∝ det{I(θ)}

1/ 2

, θ∈Θ,

∂ 2 log f (X θ)

donde I(θ) = −E X| θ

es la matriz de información de

∂θ ∂θ'

Fisher

Especialización en Evaluación de Proyectos

227

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

o EJEMPLO 9: Sea X una v.a. con distribución condicional dado θ,

Ber(θ), i.e., f (x θ) = θ x (1 − θ)

1− x

I{0,1} ( x ) , θ∈(0,1).

log f (x θ) = x log( θ) + (1 − x ) log(1 − θ) + log I{0,1} ( x )

∂

x 1− x

log f (x θ) = −

∂θ

θ 1− θ

∂2

x

1− x

log f (x θ) = − 2 −

2

∂θ

θ

(1 − θ)2

X

1 − X E(X θ) 1 − E(X θ)

1

I(θ) = −E X|θ − 2 −

=

+

=

=

L

θ(1 − θ)

θ2

(1 − θ)2

(1 − θ)2

θ

1/ 2

1

π(θ) ∝

θ(1 − θ)

= θ −1 / 2 (1 − θ)

−1 / 2

I( 0,1) (θ)

∴ π(θ) = Beta(θ 1 / 2,1 / 2).

3) Criterio de referencia:

metodología

para

Bernardo (1986) propuso una nueva

obtener

distribuciones

iniciales

mínimo

informativas o de referencia, basándose en la idea de que los datos

contienen toda la información relevante en un problema de

inferencia.

o La distribución inicial de referencia es aquella distribución inicial

que maximiza la distancia esperada que hay entre la distribución

inicial y la final cuando se tiene un tamaño de muestra infinito.

o Ejemplos de distribuciones iniciales de referencia se encuentran

en el formulario.

Especialización en Evaluación de Proyectos

228

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

¾ DISTRIBUCIONES

CONJUGADAS:

Las distribuciones conjugadas surgen

de la búsqueda de cuantificar el conocimiento inicial de tal forma

que la distribución final sea fácil de obtener de “manera analítica”.

Debido a los avances tecnológicos, esta justificación no es válida

en la actualidad.

o Definición: Familia conjugada. Se dice que una familia de

distribuciones de θ es conjugada con respecto a un determinado

modelo probabilístico f(x|θ) si para cualquier distribución inicial

perteneciente a tal familia, se obtiene una distribución final que

también pertenece a ella.

o EJEMPLO 10: Sea X1,X2,...,Xn una m.a. de Ber(θ). Sea θ∼Beta(a,b)

la distribución inicial de θ. Entonces,

n

x

n− x

f (x θ) = θ ∑ i (1 − θ) ∑ i ∏ I{0,1} (x i )

i =1

f (θ) =

Γ(a + b) a −1

b −1

θ (1 − θ) I( 0,1) (θ)

Γ(a)Γ(b)

a + x −1

b + n − ∑ xi −1

⇒ f (θ x ) ∝ θ ∑ i (1 − θ)

I( 0,1) (θ)

∴ f (θ x ) =

donde

Γ(a1 + b1 ) a1 −1

b −1

θ (1 − θ) 1 I( 0,1) (θ) ,

Γ(a1 )Γ(b1 )

a1 = a + ∑ x i

y

b1 = b + n − ∑ x i .

Es

decir,

θ x ∼ Beta(a1, b1 ) .

o Más ejemplos de familias conjugadas se encuentran en el

formulario.

Especialización en Evaluación de Proyectos

229

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

6.5 Problemas de inferencia paramétrica

¾ Los problemas típicos de inferencia son: estimación puntual,

estimación por intervalos y prueba o contraste de hipótesis.

¾ ESTIMACIÓN PUNTUAL. El problema de estimación puntual visto como

problema de decisión se describe de la siguiente manera:

o D = E = Θ.

~

~

o v θ, θ la pérdida de estimar mediante θ el verdadero valor del

( )

parámetro de interés θ. Considérense tres funciones de pérdida:

1) Función de pérdida cuadrática:

( ) (

)

2

~

~

v θ, θ = a θ − θ , donde a > 0

En este caso, la decisión óptima que minimiza la pérdida esperada

es

~

θ = E(θ).

La mejor estimación de θ con pérdida cuadrática es la media

de la distribución de θ al momento de producirse la

estimación.

2) Función de pérdida absoluta:

~

~

v θ, θ = a θ − θ , donde a > 0

( )

En este caso, la decisión óptima que minimiza la pérdida esperada

es

Especialización en Evaluación de Proyectos

230

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

~

θ = Med(θ) .

La mejor estimación de θ con pérdida absoluta es la mediana

de la distribución de θ al momento de producirse la

estimación.

3) Función de pérdida vecindad:

~

v θ, θ = 1 − IB

( )

~

ε(θ)

( θ) ,

()

~

~

donde B ε θ denota una vecindad (bola) de radio ε con centro en θ .

En este caso, la decisión óptima que minimiza la pérdida esperada

cuando ε → 0 es

~

θ = Moda(θ) .

La mejor estimación de θ con pérdida vecindad es la moda de

la distribución de θ al momento de producirse la estimación.

¾ EJEMPLO 11: Sean X1,X2,...,Xn una m.a. de una población Ber(θ).

Supongamos que la información inicial que se tiene se puede

describir mediante una distribución Beta, i.e., θ ∼ Beta(a,b). Como

demostramos en el ejemplo pasado, la distribución final para θ es

también una distribución Beta, i.e.,

n

n

θ|x ∼ Beta a + ∑ Xi , b + n − ∑ Xi .

i =1

i =1

La idea es estimar puntualmente a θ,

Especialización en Evaluación de Proyectos

231

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

1) Si se usa una función de pérdida cuadrática:

a + ∑ xi

~

θ = E(θ x ) =

,

a+b+n

2) Si se usa una función de pérdida vecindad:

a + ∑ xi − 1

~

θ = Moda(θ x ) =

.

a+b+n−2

¾ ESTIMACIÓN POR INTERVALO. El problema de estimación por intervalo

visto como problema de decisión se describe de la siguiente

manera:

o D = {D : D ⊂ Θ},

donde,

D

es

un

intervalo

de

probabilidad

al

(1-α)

si

∫ f (θ)dθ = 1 − α .

D

Nota: para un α∈(0,1) fijo no existe un único intervalo de

probabilidad.

o E = Θ.

o v (D, θ) = D − ID (θ) la pérdida de estimar mediante D el verdadero

valor del parámetro de interés θ.

Esta función de pérdida refleja la idea intuitiva que para un α

dado es preferible reportar un intervalo de probabilidad D* cuyo

tamaño sea mínimo. Por lo tanto,

La mejor estimación por intervalo de θ

es el intervalo D* cuya longitud es mínima.

Especialización en Evaluación de Proyectos

232

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

El intervalo D* de longitud mínima satisface la propiedad de ser un

intervalo de máxima densidad, es decir

si θ1∈D* y θ2∉D* ⇒ f(θ1) ≥ f(θ2)

¿Cómo se obtiene el intervalo de mínima longitud (máxima

densidad)?

Los pasos a seguir son:

o Localizar el punto más alto de la función de densidad (posterior)

de θ.

o A partir de ese punto trazar líneas rectas horizontales en forma

descendiente hasta que se acumule (1-α) de probabilidad.

Gamma Distribution

Shape,Scale

2,1

0.4

density

0.3

0.2

1-α

0.1

0

¾ CONTRASTE

|

|0

|

|

|

4

|

2

DE HIPÓTESIS.

6

8

10

θx

El problema de contraste de hipótesis es

un problema de decisión sencillo y consiste en elegir entre dos

modelos o hipótesis alternativas H0 y H1. En este caso,

o D = E = {H0, H1}

o v (d, θ) la función de pérdida que toma la forma,

Especialización en Evaluación de Proyectos

233

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

v(d,θ) H0

H1

H0

v00 v01

H1

v10 v11

donde, v00 y v11 son la pérdida de tomar una decisión correcta

(generalmente v00 = v11 = 0),

v10 es la pérdida de rechazar H0 (aceptar H1) cuando H0 es

cierta y

v01 es la pérdida de no rechazar H0 (aceptar H0) cuando H0

es falsa.

Sea p0 = P(H0) = probabilidad asociada a la hipótesis H0 al

momento de tomar la decisión (inicial o final). Entonces, la pérdida

esperada para cada hipótesis es:

E{v (H0 )} = v 00p 0 + v 01 (1 − p 0 ) = v 01 − (v 01 − v 00 )p 0

E{v (H1 )} = v 10p 0 + v 11 (1 − p 0 ) = v 11 − (v 11 − v 10 )p 0

cuya representación gráfica es de la forma:

E{v (H0 )}

v01

E{v (H1 )}

v10

v11

v00

0

H1

Especialización en Evaluación de Proyectos

p*

234

H0

p0

1

Estadística y Probabilidad

PROFESOR: LUIS E. NIETO BARAJAS

donde, p * =

v 10

v 01 − v 11

.

− v 11 + v 01 − v 00

Finalmente, la solución óptima es aquella que minimiza la pérdida

esperada:

si E{v (H0 )} < E{v (H1 )} ⇔

p0

v − v 11

> 01

⇔ p0 > p* ⇒ H 0

1 - p 0 v 10 − v 00

H0 si p0 es suficientemente grande comparada con 1-p0.

si E{v (H0 )} > E{v (H1 )} ⇔

p0

v − v 11

< 01

⇔ p 0 < p * ⇒ H1

1 - p 0 v 10 − v 00

H1 si p0 es suficientemente pequeña comparada con 1-p0.

si p 0 = p* ⇒ H 0 ó H

1

Indiferente entre H0 y H1 si p0 no es ni suficientemente grande ni

suficientemente pequeña comparada con 1-p0.

Especialización en Evaluación de Proyectos

235

Estadística y Probabilidad