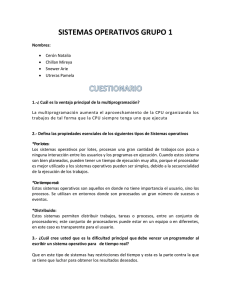

View/Open - Tesis Institucionales

Anuncio