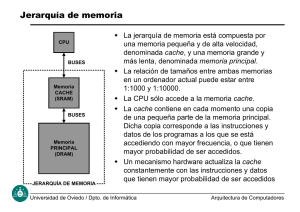

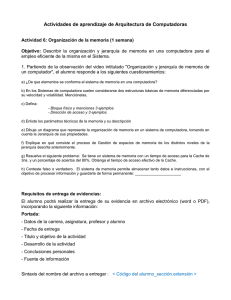

arquitectura para

Anuncio