Icon - DSpace en ESPOL

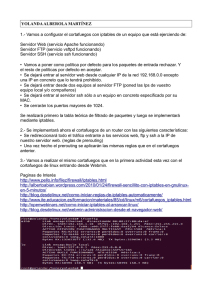

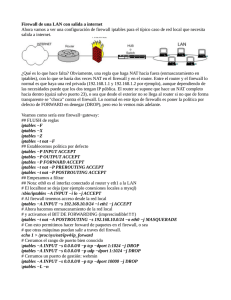

Anuncio