Análisis Factorial General y Análisis de Componentes Principales.

Anuncio

Capı́tulo 4

Análisis Factorial General y Análisis

de Componentes Principales.

4.1.

Análisis Factorial General (AFG). Introducción.

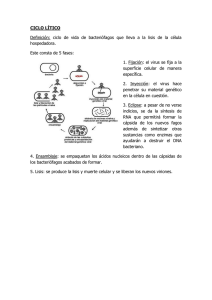

Sea una tabla rectangular de valores numéricos, representados por una matriz Xn×p , con términos xij .

Nos planteamos la siguiente cuestión: ¿Es posible reconstruir los np valores xij , a partir de un número menor

de valores numéricos? Por ejemplo: Supongamos que existieran dos vectores un×1 y vp×1 tales que X = uv ′ .

Se habrı́a reconstruido X, con un total de (n + p) valores numéricos. Observese que en este caso, X es de

rango 1.

No es esperable encontrar una situación tan sencilla. En general, la reconstrucción habrá que hacerla en

términos de una aproximación de rango q de la forma

X = u1 v1′ + · · · + uq vq′ + E

(4.1)

en donde En×p es una matriz con términos suficientemente pequeños para que los vectores uα , vα , α = 1, . . . , q,

es decir, un total de q(n + p) valores numéricos, reconstruyan satisfactoriamente la matriz X inicial.

La cuestión práctica que inmediatamente se plantea es esta: ¿Cómo buscar la representación de rango q

para X? Vamos a adoptar aquı́ una vı́a geométrica, tı́pica de los métodos factoriales del Análisis de Datos.

En capı́tulos posteriores la búsqueda de una descomposición de X en la forma dada por 4.1 se analizará desde

un punto de vista más general utilizando la d escomposición de valores singulares de X.

En realidad, la tabla X va a dar a lugar a dos representaciones: Por un lado las n filas se pueden

considerar como las coordenadas de n puntos en el espacio p-dimensional Rp y las p columnas, se pueden

considerar como las coordenadas de p puntos en Rn . Se habla de las nubes de puntos–fila y puntos–columna,

respectivamente.

Procederemos a considerar el problema de la aproximación de rango q para X en dos aspectos complementarios:

1. A partir de los n puntos–fila, consideramos el ajuste de un subespacio vectorial a dicha nube de

puntos–fila, en el espacio de las columnas.

2. A partir de los p puntos–columnas, consideramos el ajuste de un subespacio vectorial a dicha nube de

puntos–columna en el espacio de las filas.

4.2.

Ajuste, por un subespacio vectorial en Rp , de la nube de

puntos–fila.

El punto de partida es la nube de los n puntos–fila, en un subespacio p–dimensional (columnas de X).

Tratamos de representar dicha nube en un subespacio q–dimensional (q < p). Esto será posible si, al menos

aproximadamente, dicha nube está contenida en un subespacio vectorial q–dimensional del espacio vectorial

2

Análisis Factorial General y Análisis de Componentes Principales.

p–dimensional. De tal forma que existirán q nuevos ejes y por tanto nq números, por un lado, y pq números

por otro (las coordenadas de los nuevos ejes respecto de los p iniciales), de tal forma que sustituiremos np

números, por nq + pq = (n + p)q nuevos valores numéricos.

En resumen vamos a ajustar, con un criterio que después especificaremos, la nube de los n puntos–fila

por un subespacio vectorial en Rp , q–dimensional (q < p), suponiendo que Rp está dotado con la distancia

euclı́dea habitual.

4.2.1.

Cálculo del ajuste del subespacio vectorial en Rp .

El caso más sencillo es el de buscar una recta F1 , que pase por el origen y que se ajuste lo mejor posible

p

∑

a la nube. Sea u un vector unitario en la dirección de F1 . Por tanto u′ u = 1 y

u2j = 1. Por otra parte las

i=1

n filas de Xn×p up×1 , son los n productos escalares de cada fila (punto de Rp ) por u, es decir, las longitudes

de las proyecciones de los n puntos sobre la recta F1 .

Además, la distancia OP al cuadrado es la suma del cuadrado de su proyección sobre F1 más la distancia

al cuadrado de P a F1 . Es evidente que en la igualdad

2

d2 (O; P ) = (proyección sobre F1 ) + d2 (P ; F1 )

(4.2)

es equivalente, al estar fijado el primer miembro, minimizar d2 (P ; F1 ) que maximizar la proyección sobre

F1 al cuadrado. También es claro que hemos de considerar todos los puntos. Este último cuadrado será:

′

(Xu) (Xu) = u′ X ′ Xu, de modo que si el criterio para encontrar la recta ajustada F1 (que pasa por el

origen) es el de maximizar la suma de los cuadrados de todas las proyecciones de los n puntos–fila, habrá que

encontrar un u tal que

máx{u′ X ′ Xu}

(4.3)

con la restricción u′ u = 1. Supongamos que la solución es el subespacio u = u1 . Se demostrará después que

el subespacio de dos dimensiones, óptimo, contiene a u1 y se calculará buscando un u2 unitario y ortogonal

a u1 de tal manera que u2 sea la solución de

máx {u′ X ′ Xu} ; u′2 u1 = 0; u′2 u2 = 1.

(4.4)

Ası́ sucesivamente se obtienen u1 , u2 , . . . , uq ; q < p, en donde cada ui es ortogonal a u1 , . . . , ui−1 y además

u′i ui = 1.

Resolución técnica del problema de Máximo.

Técnicamente, la cuestión se resuelve mediante el método de los multiplicadores de Lagrange. Ası́:

máx {u′ X ′ Xu} ; u′ u = 1 → ϕ(λ) = u′ X ′ Xu − λ (u′ u − 1)

∂ϕ(λ)

= 2X ′ Xu − 2λu = 0; X ′ Xu = λu;

∂u

de modo que el vector buscado, u, es un vector propio de X ′ X. Por otra parte, el máximo alcanzado será λ

ya que

X ′ Xu = λu → u′ X ′ Xu = λu′ u = λ

(4.5)

Es decir que el máximo alcanzado es un valor propio de X ′ X. Por tanto el vector buscado será el vector

u = u1 correspondiente al mayor autovalor λ = λ1 .

Busquemos ahora el subespacio bidimensional que se ajusta lo mejor posible a la nube de los n puntos–fila.

Sea t otro vector unitario pasando por el origen, que maximiza

t′ X ′ Xt

(4.6)

4.2 Ajuste, por un subespacio vectorial en Rp , de la nube de puntos–fila.

3

y que cumple las restricciones t′ t = 1 y t′ u1 = 0 (ortogonal a u1 ). La función de Lagrange (Lagrangiano)

correspondiente a este problema es

ϕ(λ; µ) = t′ X ′ Xt − λ(t′ t − 1) − µt′ u1

∂ϕ(λ; µ)

= 0 ⇔ 2X ′ Xt − 2λt − µu1 = 0

∂t

2u′1 X ′ Xt − 2λu′1 t − µu′1 u1 = 0

Es decir:

2 [u′1 X ′ X − λu′1 ] t − µu′1 u1 = 0

Pero u′1 X ′ X = λu′1 . Por tanto µ = 0 y el problema se reduce de nuevo a X ′ Xt = λt que puede escribirse

como (X ′ X − λ) t = 0, luego t será el autovector asociado al segundo autovalor de X ′ X en orden decreciente.

Este resultado se extiende a todos los autovalores λ1 , λ2 , λ3 , . . . , λr donde r = rg (X ′ X).

Definición 4.1 Llamamos subespacio óptimo q–dimensional ajustado, en Rp , a la nube de puntos, al subespacio engendrado por los autovectores asociados a los q primeros autovalores de (X ′ X).

Ası́ pues a la nube de puntos–fila, de n elementos, en Rp , se le puede ajustar un subespacio vectorial

de dimensión q (q < p), óptimo en el sentido de mı́nimos cuadrados (mı́nima suma de distancias desde

los puntos–fila al subespacio ajustado), de tal manera que dicho subespacio está engendrado por vectores

unitarios u1 , . . . , uq , tales que uα es ortogonal a u1 , . . . , uα−1 , para α = 2, . . . , q; los uα son unitarios y

maximizan u′α X ′ Xuα .

4.2.2.

Ajuste a la nube de puntos–columna de un subespacio en Rn .

Si ahora consideramos los puntos–columna, es decir que consideramos la matriz de datos X interpretada

como una nube de p puntos–columna en un espacio n–dimensional Rn . La situación es totalmente análoga

a la vista antes en Rp , salvo que técnicamente, ahora, las proyecciones de los puntos de la nube sobre el

subespacio de ajuste son las p filas del vector de productos escalares

(

′

Xp×n

vn×1

)

(4.7)

p×1

en donde con v se denota al vector n–dimensional, en Rn , de los cosenos directores del subespacio ajustado

(que en la primera etapa es una recta que pasa por el origen, equivalente a la F1 en el caso anterior, que

designamos G1 .

Por tanto, la suma de proyecciones al cuadrado de todos los puntos de la nube de p puntos, sobre la recta

G1 , se escribirá:

′

(X ′ v) (X ′ v) = v ′ XX ′ v

(

)

(4.8)

′

Xn×p Xp×n

,

n×n

que habrá que maximizar. Obsérvese que en este caso se tiene la matriz

mientras que antes

′

tenı́amos la matriz X Xp×p .

La solución a este problema es análoga a la del anterior, generándose una base v1 , . . . , vq del subespacio

óptimo ajustado a la nube, subespacio de dimensión q, que se obtiene en los términos siguientes:

1. v1 , . . . , vq son tales que vi′ vi = 1; i = 1, . . . , q.

2. vi es el autovector correspondiente al autovalor µi de la matriz XX ′ , siendo µi el mayor autovalor

quitando los µ1 , . . . , µi−1 mayores anteriores.

3. vi es ortogonal a v1 , . . . , vi−1 ; i = 2, . . . , q.

4. vi′ XX ′ vi es máximo en cada etapa y su valor es µi .

4

Análisis Factorial General y Análisis de Componentes Principales.

4.3.

Relación entre los subespacios ajustados en Rp y en Rn .

Hasta ahora, a la nube de n puntos–fila p–dimensionales, por un lado, y a la nube de p puntos–columna n–

dimensionales por otro, se han ajustado dos subespacios óptimos, generados, respectivamente, por los vectores

{u1 , . . . , uq } y {v1 , . . . , vq }, considerando que los subespacios sean de la misma dimensión, q, en ambos casos.

Fijémonos en el autovector α-ésimo de XX ′ , vα , es decir, el asociado al α–ésimo mayor autovalor de XX ′ ,

es decir, que vα verı́fica

XX ′ vα = µα vα

Si rg(X) = r, entonces, rg(XX ′ ) = r, y es claro que r ≤ mı́n(p, n). Por tanto, a lo sumo, hay r autovalores

de XX ′ , no nulos. Efectuemos algunos cálculos. De la expresión XX ′ vα = µα vα se obtiene:

X ′ (XX ′ ) vα = µα X ′ vα

es decir:

X ′ X (X ′ vα ) = µα (X ′ vα )

Por tanto, a cada vector propio vα de (XX ′ ) le corresponde un autovector uα = X ′ vα de (X ′ X), y ello

respecto del mismo autovalor µα . Es decir que todo autovalor de XX ′ , no nulo, lo es también de X ′ X. Y

los autovectores correspondientes al mismo autovalor µα , en X ′ X y en XX ′ están relacionados en la forma:

uα = kα (X ′ vα ) ; kα constante.

P or tanto el conjunto de autovalores µα : α = 1, . . . , r es un subconjunto del de autovalores λα .

Haciéndolo ahora al revés, tenemos,

(X ′ X) uα = λα uα

X (X ′ X) uα = λα Xuα

(XX ′ ) (Xuα ) = λα (Xuα )

y se concluye, análogamente, que todo autovalor de X ′ X lo es también de XX ′ , y vα = kα′ Xuα ; kα′ constante.

Por tanto λα = µα ; α = 1, . . . , r.

Imponiendo que u′α uα = vα′ vα = 1, se concluye que:

1

kα = kα′ = √

λα

Por tanto:

uα

=

vα

=

1

√ X ′ vα

λα

1

√ Xuα

λα

(4.9)

Definición 4.2 El eje Fα , soporte de uα , se llama α–ésimo eje factorial de Rp . El eje Gα , soporte de vα ,

se llama α–ésimo eje factorial de Rn . Las coordenadas de los puntos de la nube sobre el eje α–ésimo en Rp

(resp. Rn ) son las componentes del vector Xuα (resp. X ′ vα ).

4.4 Reconstrucción de la matriz de datos X.

4.4.

5

Reconstrucción de la matriz de datos X.

Hasta ahora se han reconstruido aproximadamente las posiciones de los puntos de la nube de Rp (resp.Rn )

a partir de las coordenadas de esos puntos sobre la base del subespacio vectorial ajustado (mı́nimos cuadrados).

Tratamos ahora de reconstruir la matriz de datos inicial (es decir, las coordenadas de los puntos en Rp )

a partir de los q ejes obtenidos. Se tiene que:

√

1

vα = √ Xuα ; Xuα = λα vα

λα

( p

)

p

∑

∑

√

√

′

′

′

uα uα =

λα vα u′α

Xuα uα = λα vα uα ; X

α=1

α=1

Pero obsérvese que

u′1

uα u′α = [u1 |u2 | · · · |up ] ... = U U ′ = U U −1 = I

α=1

u′p

p

∑

Por tanto,

p

∑

√

X=

λα vα(n×1) u′α(1×p)

(4.10)

α=1

aproximada será la que se limite a los q primeros ejes, válida en la medida en que

√ Una reconstrucción

√

λq+1 , . . . , λp sean pequeños.

q

∑

√

En tal caso, X ≈ X ∗ =

λα vα u′α . Si en Rp , por ejemplo, el eje factorial u1 es por sı́ solo capaz de

α=1

localizar satisfactoriamente las posiciones de los puntos, es porque el valor propio λ1 debe ser mucho más

importante que los demás puesto que

λ1 = u′1 X ′ Xu1

mide la suma de los cuadrados de las proyecciones de los puntos sobre u1 (es decir las distancias al cuadrado

de los puntos proyectados, al origen).

En general, una referencia formada por los q primeros ejes factoriales, permitirá reconstruir las posiciones

de los puntos con buena precisión en caso que λ1 +λ2 +· · ·+λq sea una proporción importante de λ1 +· · ·+λp .

Técnicamente, por otra parte,

λ1 + · · · + λp =

p

∑

λα = tr [X ′ X] =

∑∑

α=1

i

x2ij

(4.11)

j

Esta reconstrucción aproximada,

X ∗ , de X es en efecto conseguida por sólo q × (n + p) números: Los que

√

determinan los q vectores λα vα y los q vectores uα , es decir, qn + qp, de modo que los np números que

constituyen la matriz inicial X, son sustituidos por q(n + p). Una medida de la calidad de la reconstrucción

es el porcentaje de inercia, τq , dado por:

q

∑

τq =

α=1

p

∑

λα

(4.12)

λα

α=1

Por otra parte, en virtud de 4.11, τq se puede expresar también ası́:

6

Análisis Factorial General y Análisis de Componentes Principales.

∑

x∗ij

2

i,j

τq = ∑

x2ij

(4.13)

i,j

donde con x∗ij se designan los elementos de X ∗ .

4.5.

Algunas conclusiones sobre el Análisis Factorial General.

1. Dada una tabla de datos, se pueden obtener representaciones de nubes de puntos en dos espacios, de

tal manera que los ajustes en dichos espacios están relacionados.

2. Se ha dotado a la tabla numérica inicial de una estructura vectorial euclı́dea, con dos espacios: El de

las columnas, en donde tenemos la nube de puntos–fila, Rp , y el de las filas, Rn , en el que se tiene la

nube de puntos–columna.

4.6.

Análisis en Componentes Principales (ACP).

Como antes se ha dicho, el Análisis en Componentes Principales, ACP, considera una matriz R de datos

iniciales de carácter no simétrico: Sus componentes, rij , son valores numéricos que, de manera continua,

miden la variable j–ésima (columnas) en el i–ésimo individuo (filas).

Veamos a continuación cómo el Análisis Factorial General se adapta a esta situación, de manera que

tengamos en cuenta que se trata de una tabla estadı́stica y no de una mera matriz numérica R que hubiera

que reducir o explicar en base a un conjunto menor de números.

Queda pues concretada la situación inicial en estos términos:

1. El espacio de las filas está constituido por n individuos.

2. El espacio de las columnas está constituido por p variables.

Ası́ pues, disponemos de una tabla de datos R = (rij ); i = 1, . . . , n; j = 1, . . . , p; sobre la que vamos a

efectuar en primer lugar el Análisis en Rp , previa concreción de la matriz X.

4.7.

Análisis en el espacio de las variables Rp .

Según el AFG, consideraremos en una primera fase los n puntos–fila en el espacio vectorial Rp de las

columnas (variables). En primer lugar, y dada la naturaleza estadı́stica de la tabla inicial R, vamos a definir

sobre qué matriz, X, transformada de la tabla R, vamos a realizar el AFG.

En realidad, cuando se tiene una situación práctica del tipo que estamos considerando (variables–

individuos), l as variables pueden ser muy heterogéneas en cuanto a sus valores medios. También desde

luego lo pueden ser respecto a su d ispersión, provocada por escalas de medida a veces muy diferentes, pero

esta otra fuente de heterogeneidad no la consideramos en una primera fase. Ası́ pues, ¿como eliminar el

efecto de la heterogeneidad de medidas?

Hagamos una interpretación geométrica de la situación. No olvidemos que hemos de realizar (Análisis

en Rp ) el ajuste en Rp (espacio de columnas–variables) de un subespacio que describa aproximadamente la

nube de puntos–fila (los individuos), con los criterios definidos en el AFG.

Este subespacio, como tal, contiene siempre al origen en el planteamiento básico del AFG, en donde no

se considera la naturaleza estadı́stica de la tabla sino meramente su caracter numérico. Ahora, sin embargo,

tenemos una información adicional sobre los valores numéricos, información estadı́stica, que permite tratar

la heterogeneidad de las medidas de las variables como un factor tanto a considerar como a eliminar, en su

posible efecto no deseado, a la hora de describir la proximidad de los puntos fila.

Gráficamente lo que ocurre es que la posición de la nube de puntos–fila (individuos) cambia, respecto del

origen, frente a la adoptada en el AFG en donde no se considera el efecto de las medias en cada variable.

4.7 Análisis en el espacio de las variables Rp .

7

En lenguaje geométrico, es claro que el espacio afı́n H1 es presumiblemente más apropiado para describir

la nube de puntos–fila que el espacio vectorial H0 (subespacio del Rp ). Considerar este subespacio afı́n, no

altera la filosofı́a general del AFG, ya que lo que estadı́sticamente interesa es la forma de la nube, no la

posición de ésta respecto del origen.

Técnicamente hablando, interesa pasar el origen al centro de gravedad (punto medio, cuyas coordenadas

son las dadas por las p medias, rj , en las p variables), porque ası́, la búsqueda de la recta H1 (subespacio

afı́n, cuando el origen está en 0) puede reducirse a la búsqueda de un H0 tal como se ha realizado en el AFG,

pero respecto de un origen colocado en el centro de gravedad.

Analı́ticamente, estas consideraciones geométricas equivalen a lo siguiente: Sean h∑

i y hj las proyecciones

2

de dos puntos sobre una recta H1 . Consideremos el criterio de maximizar la suma

(hi − hj ) , es decir

i,j

maximizar la suma de todas las diferencias de proyecciones de todos los pares al cuadrado. Si esta suma se

desarrolla, se puede ver que vale:

2n

n

∑

(

)2

hi − h

(4.14)

i=1

en donde h denota la proyección media, es decir la media aritmética de las proyecciones de todos los puntos

sobre la recta H1 . En efecto

n

∑

n

∑

[

]2

hi − h − hj + h =

2

(hi − hj ) =

i,j=1

i,j=1

=

n

∑

[(

) (

)]2

hi − h − hj − h

=

i,j=1

=

n

∑

(

n

n

∑

∑

)2

(

)2

(

)(

)

hi − h +

hj − h − 2

hi − h hj − h =

i,j=1

= 2n

n

∑

i,j=1

(

)2

hi − h − 2

i=1

i,j=1

n

∑

(

n

∑

)(

)

(

)2

hi − h hj − h = 2n

hi − h

i,j=1

i=1

El último paso, se ha dado en virtud de que:

n

∑

(

n

n

n

n

∑

∑

∑

∑

)(

)

2

hi − h hj − h =

hi hj − h

hi − h

hj +

h =

i,j=1

i,j=1

=

n

∑

hi hj − 2h

i,j=1

=n

n

∑

( ∑n

j=1

hi

i,j=1

hj

= n2 h

i=1

n

2

i,j=1

i,j=1

2

hi + n2 h =

i,j=1

)

n

( ∑n

i=1

n

∑

− 2nh

hi

n

∑

∑n

j=1

n

i

)

hj

2

2

+ n2 h =

2

− 2n2 h + n2 h =

2

2

= n2 h − 2n2 h + n2 h = 0

c.q.d.

Es claro entonces, que si hicieramos h = 0, el problema de maximización planteado, que conducirá a la

recta H1 , serı́a un caso particular del problema de maximización planteado en el AFG (maximizar la suma

de cuadrados de todas las proyecciones). Pero ¿qué es hacer h = 0? La respuesta es evidente: E s trasladar

el origen de coordenadas al centro de gravedad de la nube. Es decir, considerar los valores

x∗ij = rij − rj

8

Análisis Factorial General y Análisis de Componentes Principales.

La matriz final X, no obstante, se define ası́:

rij − rj

√

n

xij =

(4.15)

1

transformación pues que pasa de la matriz inicial R = (rij ) a la X = (xij ). El factor √ se añade para que,

n

al aplicar el AFG, y tener que considerar X ′ X, aparezca la matriz de covarianzas muestrales. En efecto,

(

)′

(

)

rij − rj

rij − rj

′

√

√

XX=

= Cp×p

(4.16)

n

n

p×n

n×p

es la matriz de covarianzas muestrales. Es decir,

r −r

X = (xij )n×p =

11

√

r12

√−r 2

n

1

n

..

.

..

.

rn1

√−r 1

n

rn2

√−r 2

n

···

..

.

···

r1p −r p

√

n

..

.

rnp −r p

√

n

n×p

de modo que:

′

Xp×n

Xn×p =

r11

√−r 1

n

..

.

r1p −r p

√

n

rn1

√−r 1

n

···

..

.

···

..

.

rnp −r p

√

n

n

∑

(ri1 − r1 )2

n

n i=1

∑ (ri2 − r2 )(ri1 − r1 )

=

n

i=1

..

.

···

n

∑

i=1

p×n

r11

√−r 1

n

..

.

rn1

√−r 1

n

···

..

.

···

(ri1 − r1 )(ri2 − r2 )

n

···

..

.

···

r1p −r p

√

n

..

.

rnp −r p

√

n

=

n×p

···

···

..

.

· · · p×p

En una segunda fase, como antes decı́amos, también debe tenerse en cuenta la heterogeneidad de las

escalas de medida, que produce en muchos casos una dispersión muy heterogénea en las variables. La forma

tı́pica de reducir el efecto de la heterogeneidad en las dispersiones de las variables, a la hora de medir la

proximidad de los i ndividuos, es efectuar el paso a una matriz X dada en la forma:

(

X = (xij ) =

)

n

1∑

rij − rj

2

√

; s2j =

(rij − rj )

n i=1

sj n

(4.17)

Dados dos individuos (i–ésimo e i′ –ésimo), la distancia al cuadrado entre ellos será (en sentido euclı́deo

clásico):

d2 (i, i′ ) =

=

)2

p (

∑

r′ −r

rij − rj

√ − i j√ j

=

sj n

sj n

j=1

p

p

∑

1 ∑ (rij − ri′ j )2

(rij − ri′ j )2

=

s2j · n

n j=1

s2j

j=1

y es evidente que, al dividir cada término por la varianza muestral s2j correspondiente de cada variable

(j = 1, . . . , p), se reduce el efecto de la heterogeneidad de las mismas, de modo que cada variable aporta

una contribución análoga a la distancia o proximidad entre individuos. En este caso, además, es claro que

l a matriz X ′ X no es otra cosa que la matriz de correlaciones muestrales. En efecto, obsérvese que, a partir

de la matriz C dada en la expresión 4.16, la expresión 4.17 puede escribirse matricialmente en la forma

1

1

1

1

V − 2 CV − 2 , en donde V = diag(s21 , s22 , . . . , s2p ). Pero V − 2 CV − 2 = X ′ X = R en donde Rp×p es la matriz de

coeficientes de correlación tipo Pearson.

4.8 Ajuste en Rn de la nube de puntos–columna.

9

Resumen.

El ajuste a la nube de puntos–fila (individuos) en Rp (espacio de las variables), en el Análisis de Componentes Principales, se efectúa a dos niveles:

(

)

rij − rj

√

1. Sobre la matriz transformada: X =

(Análisis en Componentes Principales), de modo

n

n×p

( ′

)

que se aplica el AFG a Xp×n Xn×p p×p para ajustar la nube en Rp .

)

rij − rj

√

(Análisis en Componentes Principales Normalizado)

2. Sobre la matriz transformada: X =

sj n

′

de modo que se aplica el AFG a (X X) que es la matriz de correlaciones muestrales.

(

Las coordenadas de los puntos–fila sobre los ejes factoriales soportes de los autovectores uα de X ′ X son

globalmente expresadas como Xuα , y este vector columna n × 1 tiene en cada componente

√ la coordenada de

un punto–fila respecto del α–ésimo eje. Por otra parte, según vimos en AFG, Xuα = λα vα , en donde vα

es el autovector α–ésimo en el otro espacio Rn ; es decir, autovector de XX ′ .

4.8.

Ajuste en Rn de la nube de puntos–columna.

Como en los planteamientos generales del AFG, también en el ACP cabe ajustar a los p puntos–columna

(variables), en Rn , un subespacio vectorial o afı́n. Lo que ocurre en ACP es que la matriz inicial R, o sus

transformadas X, no son simétricas en i, j. Es más, la transformación que lleva de R a X (en los dos casos

antes definidos) no es simétrica en los ı́ndices i, j, y ha de interpretarse en un sentido muy diferente.

La transformación xij = rij − rj implica trasladar el origen en Rp , al punto centro de gravedad de la

nube de los n puntos–fila. En cambio, interpretada en Rn (es decir en j), la transformación xij = rij − rj

equivale a efectuar la operación matricial X = P · R, en donde

1− 1

i=j

n

P = (pij ); pij =

1

−

i ̸= j

n

Comprobemos que, en efecto, es X = P · R.

P ·R=

1 − n1

− n1

..

.

− n1

1 − n1

..

.

···

···

..

.

− n1

− n1

···

− n1

− n1

..

.

1−

r11 − rn11 − rn21 − · · · − rnn1

r21 − r21 − r22 − · · · − r2n

n

n

n

=

..

.

rn1 − rnn1 − rnn2 − · · · − rnn

n

r11 − r1

r21 − r1

=

..

.

rn1 − r1

1

n

n×n

r12 −

r12 − r2

···

r22 − r2

..

.

···

..

.

···

rn2 − r2

r12

n

r11

r21

..

.

r12

r22

..

.

···

···

..

.

r1p

r2p

..

.

rn1

rn2

···

rnp

−

r22

n

···

..

.

···

− ··· −

r1p − rp

..

.

..

.

rnp − rp

rn2

n

···

···

..

.

=

n×p

=

···

=X

Esta transformación —que también aparece, como es sabido, en el estudio de los Modelos Lineales—

significa geométricamente algo bien distinto de una traslación del origen en Rp : Equivale a una proyección

paralela a la primera bisectriz en Rn .

10

Análisis Factorial General y Análisis de Componentes Principales.

rij − rj

√ en Rp , dividiendo

En el caso del ACP normalizado, cuando se efectúa además el cambio de escala

s

n

j

√

cada coordenada de un punto–fila por sj n, se realiza una deformación de la nube de puntos–columna (p

en total) de tal manera que se llevan los p puntos a una distancia unidad del origen. En efecto:

d2 (j, 0) =

)2

n (

n

2

∑

rij − rj

1 ∑ (rij − rj )

√ −0 =

=

n i=1

s2j

sj n

i=1

1

= 2

sj

(

1∑

(rij − rj

n i=1

n

)2

= 1.

Y la distancia entre dos puntos–columna, j y j ′ , será:

)2

n (

∑

rij − rj

rij ′ − rj ′

√ −

√

d (j, j ) =

=

sj n

sj ′ n

i=1

′

2

1 ∑ (rij ′ − rj ′ )

2 ∑ (rij − rj )(rij ′ − rj ′ )

1 ∑ (rij − rj )

+

−

=

2

2

n i=1

sj

n i=1

sj ′

n i=1

sj sj ′

n

=

n

2

=

n

2

s2j ′

s2j

+

− 2ρjj ′ = 2 (1 − ρjj ′ )

s2j

s2j ′

en donde ρjj ′ es el coeficiente de correlación empı́rico entre las variables j y j ′ . Si este coeficiente es muy

alto, aproximadamente 1, los puntos columnas están próximos. Si ρjj ′ es mucho menor que 1, entonces están

alejados.

En virtud de lo visto en AFG, las coordenadas

de los puntos–columnas en el eje factorial α, son las

√

componentes de X ′ vα que son iguales a uα λα , en donde, en el caso de ACP normalizado, λα , son los

autovalores de X ′ X, la matriz de correlaciones C. Recuérdese también que uα son los autovalores de X ′ X.

Finalmente cabe observar que en el caso de la matriz considerada en ACP normalizado, la matriz de

correlación X ′ X, es claro que:

′

tr(X X) =

p

∑

α=1

4.9.

λα =

∑

x2ij = p

(4.18)

i,j

Variables e individuos suplementarios en ACP.

Suele ocurrir en la práctica que, una vez realizado un ACP con una determinada matriz R de datos

iniciales, se conozcan los datos en las p–variables correspondientes a nuevos individuos (Nuevos individuos

que se incorporan al estudio, un grupo de individuos–control, etc.) Un caso frecuente en las aplicaciones se

produce cuando el número de individuos es muy grande —en encuestas, por ejemplo— y entonces se clasifican

en grupos con arreglo a alguna o algunas caracterı́sticas de los mismos (intervalos de ingresos familiares, por

ejemplo) que sean de interés.

Incluso, a veces, interesan más estas caracterı́sticas de los individuos que ellos mismos. En este caso,

se consideran los centros de gravedad de las clases de individuos consideradas y estos centros se consideran

individuos nuevos (o suplementarios) y se incorporan y presentan gráficamente como si fueran unos individuos

más.

También puede darse el caso de incorporar nuevas variables cuyos valores son conocidos para los individuos

estudiados, pero que en una primera etapa no se han considerado. Posiblemente, en muchos casos es ası́,

porque no constituyen un conjunto homogéneo de caracterı́sticas junto a las que se han seleccionado para

realizar el ACP en una primera etapa.

El problema, por tanto, es cómo incorporar estos nuevos puntos–individuos (filas) y puntos–columna

(variables) al ACP.

4.9 Variables e individuos suplementarios en ACP.

11

1. Consideremos los individuos suplementarios, en primer lugar. Estos constituyen un borde o caja matricial R+ de la matriz R, constituida por las filas correspondientes a los individuos añadidos.

Es claro que al incrementar el número de filas de R en la forma

[

]

Rn×p

Rn×p −→

R+n′ ×p

′

(n+n )×p

estas filas–individuos de R+ han de ser comparables con las analizadas en el ACP. Es decir, hay que

efectuar sobre las filas de R+ las transformaciones que se han efectuado para realizar el ACP sobre las

filas de R. Si denotamos por r+i las filas suplementarias de R+ , serı́a:

x+ij =

r+ij − rj

√

sj n

de modo que tendrı́amos ası́ definida la matriz transformada X+ . En tal situación, entonces, las coordenadas de los individuos suplementarios sobre los α–ejes factoriales ya calculados sobre X se toman

como las dadas por X+ uα .

2. Análogamente procederemos con las variables suplementarias introducidas. En este caso, R se incrementa con una caja matricial R+ de la forma

[

]

+

Rn×p −→ Rn×p | Rn×p

′

n×(p+p′ )

y en este caso, para hacer comparables las nuevas columnas (variables) en Rn , con las previamente

consideradas, hay que llevarlas a la esfera unidad de Rn , lo que se consigue definiendo para R+ , la

matriz X + = (x+

ij ), definida por

x+

ij =

+

rij

− r+

j

+√

sj n

+

+

en donde r+

j son las medidas de las columnas añadidas de R , y sj las desviaciones tı́picas correspondientes.

Una vez definida X + , las coordenadas de estos nuevos puntos–columna, respecto del α–eje previamente

′

calculado con X, vendrán dadas por (X + ) vα .

′

Comentario 4.9.1 Nótese la filosofı́a que se ha empleado para calcular las coordenadas X+ uα y (X + ) vα

de los puntos–fila y puntos–columna suplementarios respectivamente: Se mantiene la estructura factorial

obtenida a partir de la matriz inicial R sin orlar; por tanto se mantienen los vectores unitarios uα y vα

cuyos soportes son los respectivos ejes factoriales Fα y Gα en Rp y Rn y, respecto de estos ejes ya obtenidos,

se ubican los nuevos puntos–fila y puntos–columna. Esta metodologı́a o filosofı́a de actuación respecto de los

individuos suplementarios, se repetirá en otras técnicas, por ejemplo en Análisis de Correspondencias, como

se verá posteriormente.