la nanotecnología como meta

Anuncio

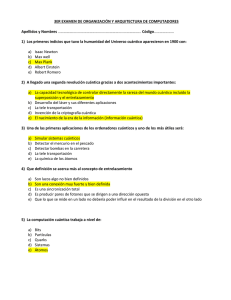

LA NANOTECNOLOGÍA COMO META-TÉCNICA * Alberto Castillo Vicci Introducción Con sus investigaciones filosóficas sobre la meta-técnica, el doctor Ernesto Mayz Vallenilla avanzó fundamentos epistemológicos, metafísicos y ontológicos para la nanotecnología o tecnología de escala cuántica, treinta años antes de que comenzara a pensarse en construir computadores cuánticos y otros artefactos tan minúsculos que se rigen por las reglas de la mecánica cuántica y no de la llamada física clásica que gobierna el comportamiento de máquinas y artefactos de escala corriente, como los actuales computadores que se ofrecen en el mercado mundial. La revolución que se espera de tal tecnología de lo nanométrico, en este siglo XXI que apenas termina su primera década, en opinión experta [2] y [7], tendrá mayores efectos sociales, económicos y culturales sobre la humanidad que la que tuvo la revolución industrial del siglo XIX. En el presente trabajo examinamos la nanotecnología desde la perspectiva metatécnica, partiendo de las investigaciones realizadas por el doctor Mayz Vallenilla en Los Fundamentos de la Meta-técnica [1], a la Técnica y meta-técnica de la computación de los profesores Alfredo Vallota, Douglas Jiménez y Alberto Castillo Vicci [4], como también a varias publicaciones sobre la nanotecnología [7] y a conversaciones entre el doctor Ernesto Mayz Vallenilla y el autor de estas páginas. Alcance En esta monografía sólo se hace referencia a los conceptos extraídos de las formalizaciones de la computación cuántica, motor de la nanotecnología, según textos y monografías clásicos y actuales [7], pero no a las formalizaciones en sí, con el fin de limitar su extensión a pocas páginas. * Artículo publicado en la Separata 5 de Principia, Revista de Cultura de la Universidad Centro Occidental Lisandro Alvarado de Venezuela, julio de 2010, en homenaje a Ernesto Mayz Vallenilla. Fuente: http://www.ucla.edu.ve/separata5.pdf Objetivo Argumentar que la nanotecnología es meta-técnica en su etapa más desarrollada y sus fundamentos se ajustan a las interpretaciones filosóficas elaboradas por el doctor Ernesto Mayz Vallenilla para la meta-técnica. La nanotecnología La nanotecnología es la comprensión y control de la materia en dimensiones entre 1 a 100 nanómetros (billonésimas de un metro) donde fenómenos únicos de propiedades cuánticas permiten nuevas aplicaciones en la construcción de artefactos y maquinarias (motores, robots, servomecanismos, computadores…) tan diminutos que sus partes o elementos son moléculas o átomos u otras partículas elementales a escala atómica (no en millones de millones de átomos como son las partes de la maquinaria a escala normal, sino de uno, dos o tres átomos o partículas atómicas controlados individualmente); de tal manera que su comportamiento se explica y controla por las leyes de la mecánica cuántica y no de la física clásica de las dimensiones intermedias. De aquí viene su nombre: “nano” o pequeño; valga decir, nanotecnología o tecnología de lo pequeño; como su medida: nanómetros (millardésimas de metro). Por lo tanto, envuelve la generación de imágenes (escanners, tomógrafos, ecosonógrafos...), la toma de medidas (contadores geigers, computadores cuánticos), el modelaje y la manipulación de la materia en tal escala (ciclotrones, nanorobots, nanomotores...); con resultados imposibles de lograr por medio de las tecnologías tradicionales, y enfrentar así problemas cuyas soluciones no parecían al alcance de la capacidad de la técnica y la tecnología anterior. Aunque existen muy diversas y múltiples propuestas de artefactos y máquinas nanotecnológicas en vías de construcción, en 40 centros de investigación en nanotecnología alrededor del mundo, particularmente en países desarrollados, que se aplicarán en dominios tales como: la computación, la informática, la medicina, la biología, el medio ambiente, la construcción, la ingeniería genética, la manufactura molecular... vamos a concentrar nuestro análisis en el más general de todos ellos, el de la computación, conocido como computación cuántica; pues, como toda nanotecnología, la computación cuántica opera con partículas elementales y lo que se argumente acerca de ellas como nanotecnología, en tal contexto, es válido para todas las demás disciplinas de carácter nanotecnológico. La computación cuántica es el resultado de la evolución de la tecnología para construir computadores que, al reducirlos en tamaño continuamente, alcanzan dimensiones tales que ya se miden en nanómetros, realizando computaciones que controlan individualmente átomos y otras partículas elementales. Esta evolución podrá medirse en el número de electrones necesarios para almacenar un bit o dígito binario (0 ó 1, también “on” u “off”) base de la computación y de la información, así: Año Electrones 1950 1012 1970 108 1990 104 2010 1 Y se alcanza la nanotenología o tecnología a escala cuántica. El ganador del Premio Nobel de Física (1965), Richard Feynman, fue el primero en hacer referencia a las posibilidades de la nanociencia y la nanotecnología en una célebre conferencia que dio en el Instituto Tecnológico de California, el 29 de diciembre de 1959, titulado En el fondo hay espacio de sobra (“There’s plenty of room at the bottom”); y acertadamente predijo que para la primera década del siglo XXI aparecerían los primeros computadores cuánticos; es decir, en el presente. La computación cuántica consiste, de manera general, en controlar la evolución de los estados cuánticos por los que pasan un conjunto de partículas elementales sujetas a tal control. El estado inicial de las partículas que pueden tomar uno de dos posibles estados (aunque también tienen la particularidad de poder estar en ambos a la vez, en superposición de estados) para formar un sistema binario, puede ser evaluado como los datos de entrada al computador cuántico y su estado final como la salida. El proceso de evolución del estado inicial al final es la computación realizada. De esta manera memoria y procesador son uno mismo en un computador cuántico. La evolución se llama unitaria porque debe realizarse como un proceso elemental único, como unidad sola, sin ninguna interferencia externa al sistema. La computación cuántica tiene características que la diferencian radicalmente de la computación clásica o tradicional, como consecuencia de obedecer a las leyes de la mecánica cuántica, tales como (además de la evolución unitaria) el operar con amplitudes de probabilidades, la interferencia cuántica, el paralelismo cuántico y el enramado cuántico. Estas características pueden resumirse diciendo que un computador cuántico es un sistema físico que acepta estados de entradas (inputs states) que representan una superposición coherente de muchos posibles argumentos (inputs). La palabra coherente significa que el sistema aunque aislado del ambiente se acopla con él en grado tal que la evolución unitaria procede: la decoherencia es el grado en que tal acoplamiento es aceptable. Y es la causa de que el mundo de nuestra vida diaria, del sentido común, sea aparentemente clásico, determinista y no aleatorio como el de la verdadera naturaleza cuántica. La computación cuántica ofrece un enorme paralelismo y la amplitud del espacio computacional está exponencialmente relacionada con el tamaño del sistema (por ejemplo: un computador cuántico de 3 bits, por superposición es el equivalente a 23 = 8 clásicos operando en paralelo; si se llegaran a construir computadores cuánticos con la capacidad en gigabits, como los clásicos de hoy, entonces el potencial de computación se incrementaría en cantidades inimaginables); pero, además, el enramado cuántico permite codificar información en partes de un sistema físico mutuamente correlacionada... aunque pudieran estar separadas entre sí ilimitadamente. Sin embargo, es elemental (pero fundamentalmente importante) el hecho que la evolución cuántica es ultra sensible a interacciones con el medio ambiente; la enorme fragilidad de los estados cuánticos usados para procesar información hace que su construcción sea en extremo difícil y supone superar varias barreras técnicas, entre las que sobresale la reversibilidad de sus componentes para que el proceso de evolución sea unitaria. Es decir, que pueda ser aislada del ambiente que le rodea. Una operación es reversible si se pueden reconstruir sus entradas (inputs) de sus salidas (outputs). Richard Feynman, en 1985, mostró como un computador cuántico podía partir del diseño de un circuito booleano (la lógica de la computación, pues la computación es lógica más control) que realizara la computación deseada en que cada conmutador o gate booleano del circuito realiza una operación unitaria en uno o más bits cuánticos para lo que usaba unos gates reversibles diseñados por Fredkin y Toffoli [4] y [7]; de aquí Feynman pasaba a construir un operador de evolución o hamiltoniano, que es el verdadero computador cuántico, partiendo de tal circuito. Era evidente, como lo mostraron quienes mejoraron el diseño de Feymann a partir de su trabajo de los años ochenta, que no se puede construir un computador cuántico de los circuitos clásicos. Sabemos que toda la lógica puede hacerse con sólo las combinaciones del NOT con el AND o el OR; y hasta con una sola clase operador o gate como el juntor NO Y (o NAND en inglés) pero sólo el NO es reversible; de los demás no se pueden construir las entradas de la salida, pues borran información en el proceso, disipando calor en el medio ambiente y la evolución unitaria de un circuito que se diseñe tomándolos como modelos, colapsa. Mucho del trabajo en el diseño de computación cuántica, en nuestros días, consiste en tratar de impedir que computación y ambiente interactúen (o se controle, hasta cierto grado su interrelación y se mantenga la coherencia de la evolución cuántica). Hasta ahora, esto se ha logrado sólo con la reversibilidad (esto es que el proceso vaya en un doble sentido y la computación pueda invertirse y se ha logrado el diseño y construcción de gates reversibles). De tal manera que, recapitulando, programar un computador cuántico consiste en simular, con un operador de evolución cuántica o hamiltoniano, el comportamiento de un circuito booleano o máquinas de Turing clásicos, que realizan la computación deseada. Puesto que tanto los circuitos booleanos como las máquinas de Turing clásicos son irreversibles y de tales no es posible simular la evolución cuántica que obedece leyes físicas reversibles, el primer paso consiste en convertir los circuitos o máquina irreversibles en reversibles; el segundo, a partir de allí, construir el hamiltoniano. Existen procedimientos generales para efectuar el primer paso. Es decir, para convertir un circuito o máquina irreversibles en reversibles; pero no existe un procedimiento formal y sistemático que no sea otro que el ingenio particular del programador para el segundo: crear de los sistemas reversibles un hamiltoniano. Sin embargo, desde hace un par de años, los centros de investigación que se dedican a la nanotecnología han construido computadores cuánticos de dos y tres bits (llamados quatum bits o qbits) con tecnologías diferentes; pero, en junio del 2009, la Escuela de Ingeniería de la Universidad de Yale reportó la construcción de un computador cuántico de dos bits usando ingeniería de estado sólido en una base de aluminio que se asemeja mucho a las técnicas actuales de producción de computadores clásicos, pero con las características del computador cuántico de superposición de estados, enramado, evolución unitaria…. Es decir, anunciando el umbral de la industria de la nanotecnología. Y, según piensan los expertos, problemas de computación de complejidad tal que no son ni siquiera concebible en los computadores actuales encontrarán su solución en la computación cuántica. La meta-técnica La meta-técnica, según la descubre y desarrolla el doctor Ernesto Mayz Vallenilla en su original obra Fundamentos de la meta-técnica [1], es la ruptura revolucionaria o discontinuidad de cánones inteligibilizadores con sintaxis de logos distintos a los de la técnica evolucionada históricamente hasta el siglo XX; identificada por la trans-racionalidad i que abandona un logos de carácter óptico-lumínico de lo sensorio antropomórfico, antropocéntrico y geocéntrico de raigambre humana, propio de la técnica anterior, y mediante la cual una serie de nuevos productos y artefactos no sólo extienden el potencial sensorial del hombre sino que incursionan en otros dominios epistemológicos no directamente accesibles al conocimiento humano por medios naturales (diferente en grado al menos en unos casos, pero la mayoría diferentes en clase); sensibles a mensajes de moléculas en el aire o a ondas sonoras o de calor imperceptibles a los humanos... desarrollados por la evolución natural en el aparato sensorial de algunos animales pero no en los mamíferos primates del grupo homínido, y más allá en algunos artefactos resultantes de la técnica y la evolución cultural que ningún producto de la evolución biológica ostenta, como son los instrumentos y dispositivos sensores de espectros de luz, del sonido, del gusto o el tacto en menor grado, y que operan en escala microscópica y más profunda de radiaciones y energía. Representados como ejemplos paradigmáticos en escáneres, tomógrafos, ecosonógrafos, sensores Geiger, ciclotrones y aceleradores de partículas, rayos láser, misiles guiados por el calor,... para mencionar algunos; pero que avanza a su clímax a principios del siglo XXI, con la nanotecnología, como mostraremos en adelante, por medio de la cual se espera no sólo construir computadores cuánticos sino también una serie de robots y servomecanismos que pudieran, a escala de nanómetros, ser capaces de participar de otra alteridad; por ejemplo, ser enviados en el flujo sanguíneo para extirpar un tumor maligno en un sitio específico del cuerpo humano, autónomamente, sin contacto con la alteridad humana; o teleportar información a los confines del universo de manera instantánea, no local, violando el principio de que nada se mueve a mayor velocidad que la de la luz; pero, sobre todo, la más profunda e inimaginable alteridad: la de contactos entre multi-universos como lo avizora David Deutsch [5]. Como la nanotecnología, la meta-técnica es el resultado de la evolución de la técnica. Diferencias entre técnica y meta-técnica En este punto debemos aclarar qué significa para Mayz ratio y logos. Ambas palabras se refieren a la facultad de razonar. Una tiene origen latino y la otra el griego. En general, es la habilidad de pensar correctamente, formar conceptos, explicar y justificar las cosas e inferir conclusiones correctas de ciertas premisas o postulados: en síntesis, usar eficientemente el conocimiento. Mayz reserva el término ratio para la razón técnica tradicional, pero que está a punto de transmutarse en una nueva razón que denomina logos. La primera, la ratio, esencialmente humana, caracteriza al ser humano; la segunda, el logos, es post-humana, autónoma y autárquica, independiente del ser humano. Hasta el presente, la razón técnica o ratio technica como la llama Mayz, consubstanciada con la subjetividad del hombre, depende de lo sensorio humano, pues tiene su eje y base en la naturaleza humana y sus limitaciones somato-psíquicas, que Mayz caracteriza como antropomórficas, antropocéntricas y geocéntricas. Valga decir que: 1. La técnica, en tanto antropomórfica, tiene su eje en las características somatopsíquicas naturales del hombre y su potenciación. 2. En tanto antropocéntrica, la técnica se mide en términos de eficiencia para lograr las metas que la voluntad de poder del hombre impone sobre la alteridad (lo que acaece). En tal sentido, está concebida para dotar al hombre de un dominio cuyo centro y agente es el propio hombre. En consecuencia, predomina en ella una ratio humana con carácter de exclusividad y privilegio. 3. En tanto geocéntrica, el ámbito en el que se origina y primero de su aplicación es la Tierra y sus peculiares características dentro del cosmos, en la que el hombre natural ha habitado hasta el actual siglo. Puesto que lo sensorio somato-psíquico humano es primordialmente visual, la ratio technica está dominada por una sintaxis ordenadora óptico-lumínica como llama a lo visual, unión del ver y la luz, y que se expresa primordialmente en el lenguaje. Un lenguaje óptico-lumínico. Los Fundamentos de la meta-técnica de Mayz Vallenilla son un completo, complejo y riguroso recorrido por descubrir en todo el filosofar del pensamiento occidental la influencia y dependencia ordenadora fundamental de todo el conocimiento acumulado por siglos bajo el logos óptico-lumínico según se expresa en el lenguaje común, filosófico o científico; es decir, de lo visual y la luz como ordenadores del conocimiento humano. Dice Mayz: Asimismo, a partir de semejante hecho [la erección de lo óptico-lumínico como fundamento exclusivo de la razón humana] idéntica y complementaria jerarquía se le ha otorgado a la luz −así como, derivadamente, a todo el universo de lo luminoso− convirtiendo a sus estímulos y manifestaciones en agentes o exponentes de aquella fulgurosa ratio. Testimonios de ello se encuentran −reiterados desde diversas perspectivas− a lo largo de la historia de la filosofía occidental… el binomio de lo óptico-lumínico −sea en forma metafórica o real− actúa como raíz o fundamento, primario o primigenio, de lo racional [3]. Es precisamente la ruptura con el logos óptico-lumínico lo que abre paso en el pensar a la meta-técnica. Frente a esta modalidad de la técnica tradicional, tal como afirma Mayz, se avizora una modalidad del logos (pensar, discurso, razonamiento, proto-fundamento, principio ordenador) diferente. Pues el logos que sustenta la técnica tradicional (con límites dados por la dotación somato-psíquica humana y caracterizado por una naturaleza antropomórfica, antropocéntrica y geocéntrica, con preponderancia óptico-lumínica, eje del sistema sinestésico y de sinergia de la técnica tradicional) se suplanta, se transmuta en un logos trans-humano que trasciende los límites ingénitos de lo tradicional, al abandonar los ejes exclusivamente óptico-lumínicos de ese logos antropocéntrico, antropomórfico y geocéntrico connatural al hombre. Este paso se da gracias al mismo desarrollo tecnológico y por ello Mayz denomina a este nuevo logos meta-técnico, ya que constituye una nueva racionalidad, que no es i-rracional ni a-rracional sino la expresión de la misma racionalidad humana en conjunción con los resultados de su hacer, la técnica. Según Mayz, esta ruptura procede en varias fases. Una fase puramente antropomórfica, antropocéntrica y geocéntrica en la que potencia lo sensorio humano como son los casos de los telescopios y microscopios y otros artefactos. Otra en que se amplía su dominio por mimetismo con otros seres vivos, y se elimina lo antropomórfico. Por ejemplo artefactos como el radar o los resonadores magnéticos que imitan algún sensorio animal, como la captación de ondas electromagnéticas como lo hacen las amebas o los ultrasonidos como sucede con los delfines y los murciélagos. Que ya no es una técnica antropomórfica, aunque sí geocéntrica y antropocéntrica. Y finalmente, la fase de la propia meta-técnica, como es el caso de la nanotecnología en la que no hay nada que pueda calificarse de antropomórfico ni antropocéntrico ni geocéntrico: sus dominios son universales y no corresponden a algún sensorio humano y resultan autárquicos y autónomos con relación a la voluntad humana. El logos de esta última fase es en consecuencia trans-racional, con naturaleza distinta a la racionalidad humana. En consecuencia, la meta-técnica es un nuevo pensar: un pensar trans-racional i . Dominios de la meta-técnica Mayz establece tres vertientes [10] de nuevos instrumentos, artefactos y aparatos de carácter meta-técnico: 1. Instrumento y aparatos que al modo de sentidos artificiales alteran y transmutan lo sensorio humano ingénito; y se nos ocurren como paradigmas de tales los ecosonogramas que extienden los sentidos con imágenes tridimensionales obtenidas por el empleo de ultrasonidos a través de cuerpos orgánicos opacos; los visores nocturnos que se valen de luz infrarroja y otro artefactos e instrumentos que emiten y captan emisiones de energía de luz, calor, radiaciones no detectables por lo sensorio humano pero que le dan acceso a una alteridad no antropomórfica, ni antropocéntrica ni geocéntrica de la técnica tradicional ii . 2. Una segunda vertiente meta-técnica se halla representada por instrumentos o aparatos que alteran lo congénito o connatural de la estructura psico-somática del hombre alterando el grado y códigos para darle acceso a otra alteridad. En esta vertiente estaría incluida toda la nanotecnología como computadores cuánticos, robots moleculares, computadores ADN… i Ver “Modelo de trans-racionalidad en el contexto de la meta-técnica y desde la perspectiva del pensamiento complejo” de Ennodio Torres en esta misma separata de Principia en homenaje al doctor Ernesto Mayz Vallenilla. ii Esta vertiente ha sido cuestionada como meta-técnica como lo reporta Vallota [11]. 3. Y la más reciente y compleja la constituyen instrumentos y aparatos que transustancian ilimitadamente la energía y la materia trans-formando y transmutando el perfil de los entes y del universo en total. Su final designio es convertir progresivamente la alteridad en general en un sistema u holo energético trans-finito y en constante devenir transmutatorio. Creemos que el mejor ejemplo de tal meta-técnica lo forman los aceleradores de partículas, por ejemplo el LHC (Large Hadron Collider en el CERN donde se espera recrear en escala cuántica el Big Bang iii ). Mayz dedica gran parte de sus fundamentos de la meta-técnica a mostrar cómo toda la epistemología y la ontología que evoluciona con la tecnociencia hasta la aparición de los artefactos e instrumentos de la meta-técnica, tiene una limitación de la raigambre ópticolumínica por su carácter antropomórfico, antropocéntrico y geocéntrico; y que la metatécnica al darnos acceso a una alteridad impone variaciones tanto en la eventual objetivación e inteligibilización epistemológica como en el campo de la ontología; y necesita de un nuevo logos que se desprenda de principios y sintaxis óptico-lumínica que permita expresar la trans-racionalidad de la alteridad de la supranaturaleza dominio de la metatécnica; aunque como la racionalidad humana óptico-lumínica o ratio technica seguirá siendo como tal, necesita de un lenguaje traductor o nootecnia que pase de la transracionalidad meta-técnica de la alteridad de la supranaturaleza alcanzada con la meta-técnica a la racionalidad técnica de naturaleza humana. No toda la técnica avanzada es meta-técnica. Por ejemplo, la computación tradicional no cuántica no lo es; pues su paradigma central es el Principio de Turing, según el cual para toda computación existe una máquina de Turing, y el logos de ésta es óptico-lumínico; a saber: los principios de identidad, el tercero excluso, el de no-contradicción y la función de transición sobre los que se fundamenta [9]; en consecuencia es técnica. La inteligencia artificial y la realidad virtual, tampoco lo son. La inteligencia artificial y la realidad virtual son mimesis de la inteligencia y realidad que ejerce y conoce el hombre por sus medios sensorios y son, en consecuencia, óptico-lumínicas y de logos antropomórfico, antropocéntrico y geocéntrico [12]. En cambio, los instrumentos y artefactos fundamentados en la mecánica cuántica como la computación cuántica y la nanotecnología en general, lo son. En efecto, nada es más extraño a los sentidos humanos, menos antropocéntrico, antropomórfico y egocéntrico, que la mecánica cuántica: que las cosas no existen cuando no las percibimos o medimos; iii año. El experimento no pudo llevarse a cabo en el año 2009 pero se espera hacer de nuevo en el presente que la materia se concentre en partículas y se disperse en ondas a la vez para coexistir en este doble comportamiento; que el tiempo pueda moverse hacia atrás o quedarse estático detenido para siempre en partículas sin masa como los fotones desde el principio del gran estallido con que comenzó el Universo unos 13.500 millones de años atrás; que todas las partículas de una misma especie son idénticas y la energía se transmite en cantidades discretas llamadas cuántos; como, por ejemplo, cuando un electrón pasa de una órbita a otra sin haber estado en estados intermedios y que hay partículas que están en posiciones distintas simultáneamente, al mismo tiempo; que hay transmisión instantánea de información entre partículas de un mismo origen separadas a distancias tan grandes como los extremos de una galaxia; y que en el mundo sub-atómico rige el principio de incertidumbre que nos impide conocer la posición y el momento a la vez de una partícula, es decir de complementaridad, y prevalece como ley estadística inexorable de los hechos que hacen del mundo cuántico un mundo de probabilidades en el que la tecnología habitual tradicional no tiene cabida pues todos los estados del sistema están superpuestos mientras no se midan... Una de las consecuencias de este Principio es que el observador científico, en el estudio de los fenómenos del microcosmos, no puede realizar observaciones objetivas: su participación altera la realidad. El acto voluntario de su conciencia (escoger entre medir la posición, el momento...) influye sobre la medición. Y esto, que la conciencia aprehenda directamente la realidad y por sí sola, la modifica; es decir, que al medir creamos la realidad que sólo existe potencialmente, no actualmente, como conjetura de una de las interpretaciones de la mecánica cuántica. Y, en los últimos años, la posibilidad de que existan universos paralelos al nuestro o multiverso, como los llama David Deutsch [5], dentro de otra interpretación, que se detectan por interferencias cuánticas, y que creamos cada momento con observaciones, mantiene perplejos tanto a científicos como a filósofos. De manera que el logos, razón, inteligibilización o explicación que nos proporciona esta teoría como lenguaje, discurso o pensamiento acerca de tal realidad física, por ahora sólo refleja lo que hemos alcanzado del conocimiento y no es toda la realidad; y deberá ser ajustado en posteriores avances. Esto es así porque hasta el momento lo que la teoría nos presenta es totalmente anti-intuitivo a lo que el mundo de la vida diaria es para nosotros. En particular, las leyes de las probabilidades. Y aunque los físicos suelen recurrir a transformaciones de imágenes con que pudieran compararse los fenómenos cuánticos con los de la vida diaria, estas comparaciones sólo sirven para comunicar en lo posible al hombre común lo que ocurre a nivel sub-atómico. Y hasta algunas veces para presentar experimentos imaginarios. Pero, los expertos entre sí, sólo pueden entenderse en un logos matemático sin imágenes. En consecuencia, no conocemos cómo es la realidad en sí, sólo la deducimos matemáticamente. Lo que las teorías nos dicen es algo sobre lo que nosotros sabemos, no cómo son las cosas en sí. Por lo tanto, caben interpretaciones o especulaciones científicas de cómo es la realidad del mundo en que participamos y cómo deberíamos interpretar la teoría cuántica. Interpretación meta-técnica de la nanotecnología En tal sentido, encontramos un paralelismo aunque diferentes lenguajes, uno filosófico y el otro científico, entre lo que dice el filósofo Ernesto Mayz Vallenilla sobre la trans-racionalidad de la alteridad que alcanzamos por medio de la meta-técnica y los científicos que interpretan la mecánica cuántica. Según Mayz “la trans-racionalidad del logos meta-técnico, a pesar de su disimilitud con la racionalidad humana, posibilita e inaugura una dimensión y/o proyección de la misma (trans-óptica, trans-finita, trans-humana) que en lugar de aniquilarla, propicia no sólo su enriquecimiento intrínseco, sino paralelamente la transformación y trans-mutación de la alteridad total” [11]. Ahora, la formalización de la mecánica cuántica por medio de la matemática de los espacios de Hilbert se hizo con la lógica clásica (racionalidad); es decir, basada en los principios de identidad, tercero excluso y consistencia; pero, la lógica cuántica, que pretende inteligibizar la formalización de Hilbert y otras más, es no-clásica, valga decir, no se sostiene en los anteriores principios o ratio, como los califica Mayz; como por ejemplo, el de la ley distributiva clásica que no es válida en la lógica cuántica [13] y [15]. 1. Transracionalidad Toda teoría científica se espera alcance dos objetivos: (a) prediga los resultados de los procesos en su dominio; (b) explique los fenómenos bajo estudio para que aumente nuestra comprensión humana de la naturaleza. La mecánica cuántica es la teoría más exitosa de la física actual en cuanto a precisión de cálculos y predicciones: no existen conflictos entre los experimentos en la mecánica cuántica y lo que la teoría predice. No es así en cuanto a la explicación que ofrece sobre estos fenómenos, pues no concuerdan de ninguna manera con nuestras intuiciones y sentido común de la percepción humana del universo. Algunas interpretaciones buscan acomodar los resultados de la mecánica cuántica con el sentido común, valga decir, a las dimensiones intermedias de la mecánica de Newton o hamiltoniana; otras intentan aceptar que vivimos en un mundo no-clásico, es decir no hamiltoniano, y que la visión que hasta ahora hemos tenido del mundo, esto es, de la metafísica y la epistemología pre-cuántica, son limitadas, circunscritas al dominio de la dimensiones intermedias; valga decir, en las que nos desenvolvemos los seres humanos en el quehacer diario; pero esto es lo mismo que decir, a las limitaciones óptico-lumínicas de raigambre humana, tal como lo expone Mayz en sus Fundamentos... [1]. Pero, Mayz abre una posibilidad dentro de la interpretación, no limitada de la mecánica cuántica pero que la incluiría, y ésta es la de la trans-racionalidad de una realidad más allá del alcance de lo sensorio humano; es decir, de la alteridad trans-óptica y trans-lumínica que nos genera la meta-técnica, pero a la que tendríamos sólo acceso a través de un lenguaje traductor que nos permitiría su interpretación y que él llama nootecnia. Dentro de su esquema filosófico, tal nootecnia pudiera ser un formalismo como el que se inicia con los trabajos de John von Neumann en 1932 en lógica cuántica, que es no clásica en cuanto que al derivar de redes no distributivas, no se cumple la tautología distributiva como en la clásica; y continúa hoy en día desarrollándose sin alguna interpretación generalmente aceptada y persigue unos principios más fundamentales que los de la física para la mecánica cuántica, otro logos… como lo llamaría Mayz. La interpretación meta-técnica de la alteridad que gobierna la mecánica cuántica y, en consecuencia, de la nanotecnología, incluiría un lenguaje traductor o nootécnico con las características prefiguradas por Mayz en sus fundamentos de la meta-técnica; en el caso de la lógica cuántica, desprendida de sus principios clásicos en su totalidad: una verdadera nueva lógica traductora entre la trans-racionalidad y la racionalidad: es decir entre el mundo no-clásico y el clásico o entre las dimensiones nanométricas y las métricas. En consecuencia, en el dominio de la alteridad física, la interpretación meta-técnica sería una opción a estudiarse entre las siguientes interpretaciones de la mecánica cuántica dentro de otras más: La de Copenhague que es pragmática. La teoría sirve para calcular no para explicar y se le debe a Bohr. La teoría cuántica tiene como fin relacionar observaciones no realidades. No intenta decirnos cuál es la realidad física, sólo lo que observamos y nuestra observación la cambia. La física se reduce a tratar lo que pasa en nuestras mentes conscientes. La de Bohn, según el cual hay dos mundos, el clásico y el cuántico, y todo se fijó al principio del universo. Nuestra conciencia tiene sólo acceso al clásico. Como esperaba Einstein, hay variables ocultas que una mejor teoría revelará. La de Everett. El universo se separa constantemente en nuevos universos para cada observación. Sólo conocemos uno. Y lo que conocemos es una superposición de muchos mundos, la realidad última no es un universo sino un multiverso. La de Heisenberg y Popper: afirma que hay dos realidades, una potencial y otra de actualidades. En la cuántica todas son posibles, en la observada una se hizo actual. La de Wigner extendiendo la anterior que dice que lo que caracteriza a un dispositivo detector es la experiencia en relación con la medida. En tal sentido el dispositivo de medida en última instancia es la dinámica cerebral de la conciencia. Es decir, nuestras vivencias. Más otras conocidas por variables ocultas, probabilidades extendidas, modelos transaccionales, modelos lineales... Y la de la meta-técnica que se expondría así: La mecánica cuántica pertenece al dominio de una alteridad no óptica-lumínica sólo accesible por instrumentos y artefactos meta-técnicos inventados por el ser humano pero que se han desprendido de la raigambre óptico-lumínica de carácter antropomórfico, antropocéntrico y geocéntrico de la naturaleza humana, propios de una técnica anterior, que podríamos llamar clásica pues se fundamenta en una físico-matemática clásica, previa al desarrollo tecno-científico del siglo XIX en el caso de la matemática y de la física en el XX. Estos artefactos operan bajo principios meta-técnicos de la trans-racionalidad que no obedecen a la lógica clásica, sino que sólo pueden ser interpretados mediante una nueva lógica no sostenida en tales principios; una lógica no clásica en que estos se han trans-mutados, pero que pueden traducir a nuestro mundo clásico mediante un formalismo, una sintaxis, denominada nootecnia. Esto es que entre la lógica no clásica de la meta-técnica y la clásica debe existir una correspondencia, proyección o nootecnia para que su interpretación nos permita acceder con nuestro entendimiento a la alteridad trans-racional: es decir, sea el puente entre la trans-racionalidad cuántica y la racionalidad clásica indispensable para continuar con el avance del conocimiento humano. 2. Nootecnia Si el argumento anterior es válido, podríamos encontrar algunos paradigmas en las matemáticas actuales que sirvan de modelos a la nootecnia. Puesto que los artefactos metatécnicos se fundamentan y fundamentarán en la mecánica-cuántica como la teoría noclásica 1 más acabada de la física actual, su formalización matemática sería un buen dominio para explorar la nootecnia como lenguaje traductor de la trans-racionalidad meta-técnica a nuestra racionalidad humana. A manera de una introducción a la sintaxis matemática de la nootecnia, consideremos los principios o ratio de la lógica tradicional que es técnica por sus características antropomórficas, antropocéntricas y geocéntricas evidentes en los principios de identidad, tercero excluso y de consistencia o no contradicción y su equivalente nootécnico de la lógica cuántica que se libera en parte de tal ratio. La más usada formalización y axiomatización de la mecánica cuántica se hace en términos de estructura de espacios lineales, en particular de espacios de Hilbert; esto es: todos los objetos de la física cuántica deben ser expresados en términos de la teoría de los espacios de Hilbert: productos escalares, suma lineal, sub-espacios, operadores, medida y así… [14]. 1 La Teoría de la relatividad es considerada clásica. La lógica cuántica se deriva de los espacios de Hilbert de la mecánica cuántica, entonces todos los primitivos lógicos, valga decir, proposiciones y operadores deben ser definidos por entidades de espacios de Hilbert. Esto es, que la operación con proposiciones que afirman o niegan estados observables de objetos físicos son verdaderas o falsas según sea la proyección del espacio de Hilbert en tales proposiciones. De tal manera, la realidad del sistema físico asociado a las estructuras especificadas por el espacio de Hilbert, al que no tenemos acceso sino cuando tomamos medidas del sistema, se hace accesible a nuestro entendimiento. En consecuencia, la lógica cuántica es el traductor en términos de la racionalidad humana, de la trans-racionalidad cuántica. Lo que en términos meta-técnicos es un intento de nooctecnia. ¿Qué le faltaría? [15]. En primer lugar, por lo que se espera de la trans-racionalidad, los principios de la racionalidad del ratio óptico-lumínico de identidad, tercero-excluso y consistencia o no contradicción deberían ser trans-mutados en la transracionalidad, en otros principios no óptico-lumínicos como lo son aquellos; valga decir, en una nueva ratio que Mayz llama logos. Pero las lógicas no clásicas, tales como la modal, probabilística, difusa, no-monotónicas y muchas otras especiales, sólo trans-mutan uno o dos de estos principios, no todos a la vez; el más comúnmente no transmutado es el del tercero-excluso. En el caso de lógica cuántica, sólo el principio de ley distributiva deducido de los anteriores, no es transmutado a la lógica cuántica desarrollada hasta ahora, pues no se sostiene. La razón es que, en su fundamento, la mecánica cuántica es considerada un cálculo de probabilidades no-clásico que descansa sobre una lógica proposicional no clásica. Más específicamente, en la mecánica cuántica cada proposición del tipo “El valor de la cantidad física A cae dentro de un rango B” [14] está representada por un operador del espacio de Hilbert H. Esto forma una estructura matemática de red (latice) no distributiva [14] y [16]. Por lo que un estado cuántico corresponde a la medida probabilística definida en esta red. En consecuencia, la lógica asociada o derivada de la formalización de la mecánica clásica, es decir la lógica cuántica es no clásica o en términos más precisos no-boleana [15]. Lo más importante al respecto que debemos hacer notar es que no hay una interpretación generalmente aceptada y satisfactoria de tal lógica cuántica; valga decir, un modelo explicativo de la realidad física que representa. El caso es que no lo hay tampoco para la mecánica cuántica. En síntesis, nuestra tesis es que: en el dominio de la mecánica cuántica, la lógica cuántica se perfila como nootecnia traductora entre la trans-racionalidad meta-técnica y la racionalidad técnica y su expresión meta-técnica más pura es la nanotecnología. Esperamos que el futuro desarrollo de tal formalismo confirme la tesis propuesta; ya avizorada por el doctor Ernesto Mayz Vallenilla en Fundamentos de la meta-técnica. Al respecto, sólo bastaría añadir que, hasta el presente, apenas hemos abordado la frontera en que termina la técnica de la computación clásica y comienza la de la computación cuántica, en primer lugar, y posteriormente hacia la nanotecnología. Y avizoramos un puente de comunicación formal entre ambas con la lógica cuántica; y con tal puente de comunicación, un perfil de nootecnia. Pero, no sabemos si los lenguajes lógicomatemáticos, con sus teoremas de limitación, serán los más apropiados para una nootecnia universal, como aspira Mayz, a fin de que ésta abarque toda la epistemología del logos meta-técnico, y para todo tipo de meta-técnica y correspondiente técnica, en todos los dominios de la tecno-ciencia. Efectivamente, Mayz avizora la sintaxis inteligibilizadora de la transracionalidad sin imágenes ni símbolos para suprimir toda influencia óptico-lumínica como ya discutimos. La matemática misma debería ser refundada, según nos lo ha dicho el Dr. Mayz, para que no use necesariamente términos optico-lumínicos... originados en los caracteres antropocéntricos, antropomórficos y geocéntricos de su evolución. Y aunque la búsqueda de un lenguaje universal para toda la ciencia que desde Leibniz ha sido el sueño de muchos pensadores dista hoy de ser una posibilidad por el carácter cada vez más especializado del conocimiento tecno-científico, algunos científicos piensan que la computación pudiera ser la ciencia integradora de todas las ciencias... dado el carácter universal que como instrumento tiene [8]. Y, aún más, si se la ve de una manera más profunda, tratando a las leyes de la Naturaleza como programas que se están ejecutando en el contenido material del universo: es decir, expuesto meta-teóricamente, como si las leyes de la Naturaleza fuesen el software que se ejecuta en el hardware de la materia cósmica. Un resultado fructífero de una visión computacional de la naturaleza es que nos revela los motivos profundos del porqué la Naturaleza es inteligible para la mente humana; por qué la ciencia es posible y por qué las matemáticas son tan efectivas para la descripción de la alteridad [8]. De ser así, la investigación en la computación cuántica desde una perspectiva lógico-matemática con visión meta-técnica, como la concebida por Mayz Vallenilla en la búsqueda de la nootecnia correspondiente, es de fundamental importancia para la comprensión del desarrollo de la filosofía de la ciencia y la tecnología en el futuro, como de la epistemología misma; y, según Alfredo Vallota, de una nueva meta-física [4]. Nuestros trabajos, de tal manera, no pueden ser más que apenas el inicio de otros proyectos por venir, necesariamente más complejos y de mayor envergadura. Al respecto, no podemos menos que ser fieles seguidores del pensamiento universal de este distinguido y perspicaz filósofo contemporáneo y, con orgullo decirlo, latinoamericano, que es el Dr. Ernesto Mayz Vallenilla, quien ha dedicado su vida, con sus lecciones, sus libros y sus desvelos a favor de una educación para el hombre técnico en América Latina consciente de su identidad y sus virtualidades; como sus propias palabras lo anuncian, cuando sobre la Meta-técnica nos dice: Ello significa desde ahora tal como se verá en los tiempos por venir una lenta pero inexorable implantación de nuevas modalidades, horizontes y límites, en el despliegue de la racionalidad humana y transhumana... y, por supuesto, en la sintaxis de sus proyectos y gestas instituyentes. En algo tan aparentemente simple como esto según pensamos reposan los gérmenes del próximo futuro [1]. Referencias [1] Mayz Vallenilla Ernesto. Fundamentos de la meta-técnica. Monte Ávila Editores, 1990. [2] K. Eric Drexler. La nanotecnología. Gedisa editorial. Barcelona, España. 1993. [3] Mayz Vallenilla Ernesto. Fundamentos de la meta-técnica. Monte Ávila Editores, 1990. Página 11. [4] Castillo, Alberto; Jiménez, Douglas; Alfredo Vallota. Técnica y meta-técnica de la computación. UCLA-IDEA. Capítulo II de Alfredo Vallota. [5] Deutsch, David. The Fabric of Reality. Penguin Books. 1997. Página 50. [6] Ibidem. Página 134. [7] Feynman, Richard. Quatum mechanical computers. Optic News. Vol. 11. Deutsch, D. Quantum theory, the Church-turing Principle and the Universal Quantum Computer. Proceeding Royal Society London, volume A400, 1985, pp. 97-117. Según esta monografía, todo proceso físico puede ser simulado en un computador cuántico universal; valga decir, todo artefacto nanotecnológico corresponde a por lo menos una computación cuántica. Benett, C.H. Logical reversibility computations. IBM Journal of Research and Development. 1979. Pp. 525-532. Williams P y Scott H. Explorations in Quantum Computing. Telos, California USA 1997, Vol. 54. Pp. 147-157. Milburn, G. Feynman Processor: Perseus Book, 1998, Mass, USA. Nanotechnology white papers. Diciembre del 2009. http://www.nanotechnow.com/white-papers-abstracts.htm Nanotechweb.org monografías para la divulgación en inglés. [8] Chaitin, Gregory J. Conversations with a mathematician, Math, Art, science and the limits of reasons. Springer Verlag. 2002. Página 125. [9] Castillo, Alberto; Jiménez, Douglas; Alfredo Vallota. Técnica y meta-técnica de la computación. UCLA-IDEA. Capítulo II de Alfredo Vallota. Capítulo IV. [10] Mayz Vallenilla Ernesto. Fundamentos de la meta-técnica. Monte Ávila Editores, 1990. Páginas 22 y 23. [11] Castillo, Alberto; Jiménez, Douglas; Alfredo Vallota. Técnica y meta-técnica de la computación. UCLA-IDEA. Capítulo II de Alfredo Vallota. Páginas 45-47. [12] Mayz Vallenilla Ernesto. Fundamentos de la meta-técnica. Monte Ávila Editores, 1990. Página 47. [13] Putnam, H. “Is logic empirical?” in R. Cohen and M.P. Wartofski (eds.), Boston Studies in the Philosophy of Science 5 (Dordrecht, Holland: D. Reidel, 1968). Reprinted as “The logic of quantum mechanics” in H. Putnam, Mathematics, Matter and Method, Cambridge University Press (1976). [14] Svozil, Karl. Quantum Logic. Springer Verlag. 1998. Páginas 3-6. [15] Quantunm Logic and Probability Theory. Stanford Encyclopedia of Philosophy. http://plato.stanford.edu/entries/qt-quantlog/#2. [16] Quantum Logic is alive. Michael Dickson. History and Philosophy of Science. Indiana University.