Desarrollo de un sistema de Realidad Aumentada en

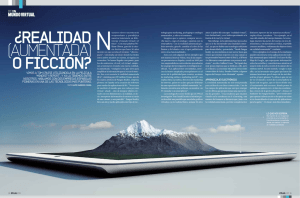

Anuncio