Nº E3 - Revista Ibérica de Sistemas e Tecnologias de Informação

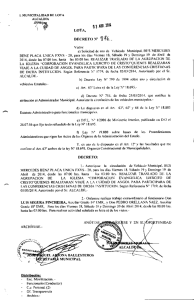

Anuncio