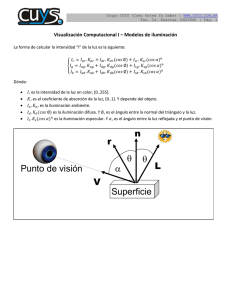

Cálculo de la iluminación global en aglomeraciones

Anuncio