Isaac Asimov NUEVA GUÍA DE LA CIENCIA

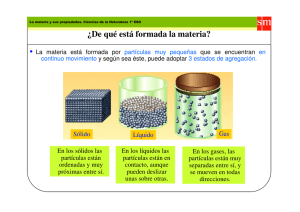

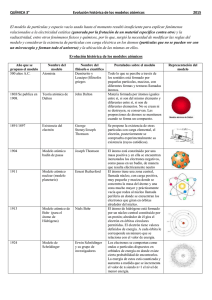

Anuncio