DiseÃ넀漀 攀 椀洀瀀氀攀洀攀渀琀愀挀椀쎳n de

Anuncio

Grado en Ingeniería en Tecnologías

de Telecomunicación

Telekomunikazio Teknologien

Ingeniaritzako Gradua

Proyecto n de grado

Gradu amaierako proiektua

Diseño e implementación de laboratorio remoto

para la experimentación con el principio de

Arquímedes mediante arquitectura asíncrona

distribuida.

Gustavo Martín Vela

Director: Ignacio Angulo Martínez

Bilbao, Julio de 2013

Resumen

Como parte de la educación, también en la física, existen una serie de principios que es

fundamental que los estudiantes entiendan para poder progresar hacia un conocimiento

avanzado y, cuya asimilación se facilita mediante la demostración. A menudo, esto puede

implicar que los profesores realicen una serie de experimentos. Sin embargo, a veces puede

resultar interesante para los estudiantes el hecho de descubrir los conceptos de primera

mano, en base a su propia experiencia. Este es el caso del principio de Arquímedes. El

objeto de este Proyecto Fin de Grado es el diseño e implementación de un laboratorio

remoto basado en el Principio de Arquímedes, que permita a los estudiantes descubrir los

efectos que las diferentes densidades y materiales tienen sobre la flotabilidad de los objetos.

A tal efecto, se ha desarrollado un acuario equipado con una serie de poleas controladas

por una Raspberry PI. Estas poleas controlan el izado y el arriado de una serie de objetos

sumergibles esféricos rellenados con diferentes líquidos. Gracias al uso de un sistema de

visión artificial gestionado desde una PandaBoard ES, los estudiantes pueden encontrar

el nivel del agua y determinar el porcentaje que los objetos sumergibles están por encima

o por debajo de ella. Estos datos pueden ser utilizados para calcular varios parámetros y

determinar con qué líquido está lleno cada objeto sumergible.

Descriptores

Laboratorios remotos, WebLab-Deusto, visión artificial, principio de Arquímedes,

educación online

iii

Índice

1 Objetivos y alcance

1

1.1 Objetivos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.1.1 Objetivos Socio Económicos. . . . . . . . . . . . . . . . . . . . . . . . . . .

1.1.2 Objetivos Tecnológicos . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.2 Alcance del Proyecto . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.2.1 Subsistema de manipulación y gestión remota del laboratorio . . . . . . . . . .

1.2.2 Implementación de RLMS en plataforma embebida de bajo coste . . . . . . . .

1.2.3 Implementación de una interfaz sencilla para el manejo del laboratorio remoto .

1.2.4 Implementación de visión artificial para el laboratorio remoto . . . . . . . . .

2 Estado del arte

2.1 RLMS . . . . . . . . . . . . . . . . . . . . . . . . .

2.1.1 MIT iLabs . . . . . . . . . . . . . . . . . . .

2.1.2 LabShare Sahara . . . . . . . . . . . . . . . .

2.1.3 WebLab Deusto . . . . . . . . . . . . . . . .

2.1.4 Otros sistemas . . . . . . . . . . . . . . . . .

2.1.5 Comparación entre los RLMS más relevantes .

2.2 Tipos de Arquitecturas de Red . . . . . . . . . . . . .

2.2.1 Arquitectura Centralizada . . . . . . . . . . .

2.2.2 Arquitectura Distribuida . . . . . . . . . . . .

2.2.3 Arquitectura Mixta. . . . . . . . . . . . . . .

2.2.4 Comparación entre las arquitecturas propuestas

2.3 Visión Artificial . . . . . . . . . . . . . . . . . . . .

2.3.1 Librerías para Visión Artificial. . . . . . . . .

2.3.2 Formatos de archivo de imagen . . . . . . . .

2.4 Hardware . . . . . . . . . . . . . . . . . . . . . . .

2.4.1 Mecatrónica . . . . . . . . . . . . . . . . . .

2.4.2 Plataformas embebidas. . . . . . . . . . . . .

2.4.3 Cámaras e iluminación . . . . . . . . . . . . .

1

3

5

5

6

6

7

7

9

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

3 Justificación de las tecnologías utilizadas

3.1 Subsistema de manipulación y gestión remota del laboratorio . . .

3.1.1 Arquitectura del subsistema . . . . . . . . . . . . . . . .

3.1.2 Dispositivo embebido y sistema operativo asociado . . . .

3.1.3 Mecatrónica . . . . . . . . . . . . . . . . . . . . . . . .

3.1.4 Servicios web . . . . . . . . . . . . . . . . . . . . . . .

3.1.5 Lenguajes de programación . . . . . . . . . . . . . . . .

3.2 Implementación de RLMS en plataforma embebida de bajo coste.

3.2.1 RLMS . . . . . . . . . . . . . . . . . . . . . . . . . . .

3.2.2 Dispositivo embebido y sistema operativo asociado . . . .

9

10

13

14

17

18

19

19

20

21

22

23

23

27

30

30

38

43

51

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

51

52

52

53

55

55

56

56

57

v

3.3 Implementación de una interfaz sencilla para el manejo del laboratorio remoto .

3.3.1 Interfaz web para laboratorios gestionados. . . . . . . . . . . . . . . .

3.3.2 Interfaz web para laboratorios no gestionados . . . . . . . . . . . . . .

3.4 Implementación de visión artificial para el laboratorio remoto . . . . . . . . .

3.4.1 Dispositivos de captura de imágenes. . . . . . . . . . . . . . . . . . .

3.4.2 Dispositivo embebido y sistema operativo asociado . . . . . . . . . . .

3.4.3 Software de procesado de imágenes . . . . . . . . . . . . . . . . . . .

3.4.4 Tipos de formatos de imagen . . . . . . . . . . . . . . . . . . . . . .

3.4.5 Iluminación . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

4 Diseño e Implementación

65

4.1 Subsistema de manipulación y gestión remota del laboratorio . . . . . . . . . .

4.1.1 Dispositivo embebido y mecatrónica. . . . . . . . . . . . . . . . . . .

4.1.2 Servicios web . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4.2 Implementación de RLMS en plataforma embebida de bajo coste. . . . . . . .

4.3 Implementación de una interfaz sencilla para el manejo del laboratorio remoto .

4.3.1 Interfaz web para laboratorio gestionado. . . . . . . . . . . . . . . . .

4.3.2 Interfaz web para laboratorio no gestionado . . . . . . . . . . . . . . .

4.4 Implementación de visión artificial para el laboratorio remoto . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

5 Planificación

5.1 Planificación económica . . . . . . . . .

5.1.1 Planificación de costes y recursos

5.1.2 Ingresos y mercado . . . . . . .

5.2 Planificación de tiempos . . . . . . . . .

58

58

59

59

60

61

61

63

63

65

65

72

79

83

83

85

86

105

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

6 Conclusiones y trabajo futuro

6.1 Resultados del proyecto . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6.2 Trabajo futuro . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6.2.1 Integración completa del laboratorio en el entorno Graasp. . . . . . . .

6.2.2 Integración completa del laboratorio no gestionado en WebLab-Deusto .

6.2.3 Mejoras en la interfaz gráfica de usuario. . . . . . . . . . . . . . . . .

6.2.4 Mejoras en el sistema de izado y arriado de elementos sumergibles . . .

6.2.5 Diseño de una nueva versión del laboratorio . . . . . . . . . . . . . . .

105

105

109

111

113

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

113

114

114

114

116

116

117

Agradecimientos

119

Referencias

124

Anexos

125

A

B

vi

Tareas y Diagramas de Gantt . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 125

Mockups del proyecto GO-Lab . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 133

Índice de Figuras

1.1

1.2

1.3

Interfaz del laboratorio remoto para física WebLab-Deusto Visir.. . .

Modelo de federación de WebLab-Deusto. . . . . . . . . . . . . . . . .

Arquitectura planteada para el laboratorio. . . . . . . . . . . . . . . .

2.1

2.2

2.3

2.4

2.5

2.6

2.7

2.8

2.9

2.10

2.11

2.12

2.13

2.14

2.15

2.16

2.17

2.18

2.19

2.20

2.21

2.22

2.23

2.24

2.25

2.26

2.27

2.28

2.29

2.30

2.31

Arquitectura de iLabs para experimentos por lotes. . . . . . .

Gestión interna de colas en el servidor de laboratorio. . . . . .

Arquitectura de iLabs para experimentos interactivos. . . . . .

Arquitectura de Labshare Sahara. . . . . . . . . . . . . . . . . .

Arquitectura local de WebLab-Deusto. . . . . . . . . . . . . . .

Diagrama de componentes de VLCAP. . . . . . . . . . . . . . . .

Ejemplo de arquitectura centralizada. . . . . . . . . . . . . . . .

Ejemplo de arquitectura distribuida.. . . . . . . . . . . . . . . .

Ejemplo de arquitectura mixta. . . . . . . . . . . . . . . . . . . .

Proceso de segmentación de una imagen con LTI. . . . . . . . .

Imagen obtenida con VXL aplicando un ltro de contornos. .

OpenCV diferenciando colores dentro de una Raspberry PI. . .

Diferencia de tamaño de los formatos principales en la web. .

Imagen de un motor paso a paso de una impresora. . . . . . .

Imagen de un servomotor.. . . . . . . . . . . . . . . . . . . . . .

Motor DC extraído de un juguete. . . . . . . . . . . . . . . . . .

Representación básica de una polea. . . . . . . . . . . . . . . .

Diseño de la polea a medida en CAD. . . . . . . . . . . . . . . .

Kit de piezas de MakerBeam. . . . . . . . . . . . . . . . . . . . .

Propaganda de Erector de los años 70. . . . . . . . . . . . . . .

Piezas sueltas de Lego Mindstorm.. . . . . . . . . . . . . . . . .

Infografía de una Raspberry PI modelo B. . . . . . . . . . . . .

Imagen de la PandaBoard ES. . . . . . . . . . . . . . . . . . . . .

Imagen de la Arduino Mega 2560. . . . . . . . . . . . . . . . . .

Imagen del Fit-PC2. . . . . . . . . . . . . . . . . . . . . . . . . . .

Imagen de la Beagleboard. . . . . . . . . . . . . . . . . . . . . .

Camara D-Link DCS-5220. . . . . . . . . . . . . . . . . . . . . . .

Camara D-Link DCS-930L. . . . . . . . . . . . . . . . . . . . . . .

Iluminacion posterior difusa y direccional. . . . . . . . . . . . .

Iluminacion frontal oblicua y direccional. . . . . . . . . . . . . .

Iluminacion de campo oscuro. . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

11

12

12

14

16

18

20

21

22

24

25

26

28

32

32

33

34

35

36

37

38

39

40

40

41

42

44

45

46

47

47

3.1

3.2

3.3

Polea diseñada. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Comparación de rendimiento de librerías de Visión Arti cial . . . . .

Imagen de el acuario con la iluminación seleccionada. . . . . . . . . .

54

62

64

4.1

4.2

Diagrama de pines de la Raspberry PI usando la librería WiringPI. . .

Esquemático de la PCB diseñada.. . . . . . . . . . . . . . . . . . . . . .

66

68

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

2

4

8

vii

viii

4.3

4.4

4.5

4.6

4.7

4.8

4.9

4.10

4.11

4.12

4.13

4.14

4.15

4.16

4.17

4.18

4.19

4.20

4.21

4.22

4.23

4.24

4.25

4.26

4.27

4.28

4.29

4.30

Parte delantera de la PCB diseñada. . . . . . . . . . . . . . . . . . . .

Parte trasera de la PCB diseñada.. . . . . . . . . . . . . . . . . . . . .

PCB montada sobre la Raspberry PI. . . . . . . . . . . . . . . . . . . .

Poleas y estructura montadas sobre el acuario. . . . . . . . . . . . .

Poleas y estructura montadas sobre el acuario. . . . . . . . . . . . .

Interfaz web de WebIOPI. . . . . . . . . . . . . . . . . . . . . . . . . .

Página principal de WebLab-Deusto. . . . . . . . . . . . . . . . . . .

Proceso de creación de un usuario para la federación. . . . . . . . .

Proceso de creación de un experimento. . . . . . . . . . . . . . . . .

Interfaz web del laboratorio gestionado. . . . . . . . . . . . . . . . .

Interfaz web del laboratorio no gestionado. . . . . . . . . . . . . . .

Disposición de las cámaras en el acuario. . . . . . . . . . . . . . . . .

Captura de imagen de la cámaras de la derecha. . . . . . . . . . . .

Aplicacion de la funcion boundingRect(). . . . . . . . . . . . . . . . .

Captura de imágenes cambiando el contraste. . . . . . . . . . . . . .

Captura de imágenes cambiando el brillo. . . . . . . . . . . . . . . .

Aplicacion del desenfoque gaussiano.. . . . . . . . . . . . . . . . . .

Diferencia entre los diferentes valores para la función de Canny()..

Aplicacion del ltro Canny sobre la imagen en escala de grises. . .

Aplicacion de diferentes transformadas de Hough. . . . . . . . . . .

Tiempos de procesado en segundos. . . . . . . . . . . . . . . . . . .

Capturas con diferentes umbrales del acumulador. . . . . . . . . . .

Proceso hasta llegar a aplicar un umbral a la imagen. . . . . . . . .

Aplicación de algoritmos para la búsqueda de guras. . . . . . . . .

Circunferencia corregida. . . . . . . . . . . . . . . . . . . . . . . . . .

Imagen con texto sobre la posición de los elementos sumergibles.

Comparación de tiempos (en segundos) con y sin paralelización.. .

Interfaz web de Supervisor. . . . . . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

69

69

70

71

72

76

81

82

82

85

86

87

89

90

91

91

92

93

94

96

97

98

100

100

101

102

102

104

5.1

5.2

5.3

5.4

5.5

5.6

5.7

5.8

5.9

5.10

5.11

Costes asociados a los Recursos humanos. . . . . . . . . . . . . . . . .

Costes asociados a los Recursos hardware. . . . . . . . . . . . . . . . .

Costes asociados a los Recursos Software. . . . . . . . . . . . . . . . .

Costes asociados al material fungible.. . . . . . . . . . . . . . . . . . .

Costes jos. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Costes jos mensuales. . . . . . . . . . . . . . . . . . . . . . . . . . . .

Porcentaje de penetración. . . . . . . . . . . . . . . . . . . . . . . . . .

Estimación de penetración en el mercado. . . . . . . . . . . . . . . . .

Estimación de ingresos anuales. . . . . . . . . . . . . . . . . . . . . . .

Diagrama de ujos. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Diagrama de tareas primarias para la consecucion de este proyecto.

106

107

108

108

108

109

110

110

110

111

111

6.1

Interfaz de usuario del laboratorio en Graasp. . . . . . . . . . . . . . . 115

Índice de Tablas

2.1

2.2

2.3

2.4

2.5

Comparación de algunas características de los RLMS más relevantes

Comparativa entre los principales formatos de imagen en web. . . .

Comparativa entre los tipos de motores propuestos. . . . . . . . . . .

Comparación de CPU y GPU de las plataformas embebidas. . . . . . .

Comparación de las comunicaciones de las plataformas embebidas..

18

30

34

43

43

3.1

Comparativa entre los motores seleccionados.. . . . . . . . . . . . . .

54

ix

Índice de Bloques de Código fuente

4.1

4.2

4.3

4.4

4.5

4.6

4.7

4.8

4.9

4.10

4.11

4.12

4.13

4.14

4.15

4.16

4.17

4.18

4.19

4.20

4.21

4.22

4.23

4.24

4.25

4.26

Comando para la grabacion de Raspbian en la tarjeta SD. . . . . . . .

De nicion de la struct motor. . . . . . . . . . . . . . . . . . . . . . . . .

Main de programa del motor. . . . . . . . . . . . . . . . . . . . . . . .

Funcion turnMotor. . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Funcion setMotor. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Servicio web para devolver el estado de los elementos sumergibles.

Servicio web para mover los elementos sumergibles. . . . . . . . . .

URL /get_status/ con parametro ALL. . . . . . . . . . . . . . . . . . . .

URL /get_status/ con parametro numerico. . . . . . . . . . . . . . . . .

URL /calibrate_elements/. . . . . . . . . . . . . . . . . . . . . . . . . . .

URL /show_element/. . . . . . . . . . . . . . . . . . . . . . . . . . . . .

URL /move_ball/. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Comandos para bajarse el codigo fuente de WebLab-Deusto. . . . . .

Instalacion de Java y Python. . . . . . . . . . . . . . . . . . . . . . . . .

Instalacion de WebLab-Deusto. . . . . . . . . . . . . . . . . . . . . . .

Creacion de instancias en WebLab-Deusto. . . . . . . . . . . . . . . . .

Codigo para la creacion de un experimento en Java. . . . . . . . . . .

Codigo para recortar la imagen necesario para la vision arti cial. . .

Codigo para ajustar el contraste y el brillo en la imagen. . . . . . . .

Codigo para cambiar de espacio de color. . . . . . . . . . . . . . . . .

Codigo para aplicar el ltro canny a la imagen. . . . . . . . . . . . . .

Codigo para aplicar la busqueda de lineas. . . . . . . . . . . . . . . . .

Codigo para aplicar la busqueda de circulos. . . . . . . . . . . . . . . .

Otro codigo para aplicar la busqueda de circulos. . . . . . . . . . . . .

Codigo para generar nuevas imagenes. . . . . . . . . . . . . . . . . . .

URL /image_medium_processed/. . . . . . . . . . . . . . . . . . . . . .

66

73

74

74

75

76

77

78

78

78

79

79

80

80

80

80

84

89

90

92

93

95

98

99

101

103

xi

PROYECTO FIN DE GRADO

1. OBJETIVOS Y ALCANCE

La participación del autor en este proyecto se limita simplemente al desarrollo técnico

de un laboratorio remoto basado en una arquitectura asíncrona distribuida que permita

el aprendizaje de conceptos educativos asociados al Principio de Arquímedes. En este

sentido, la parte pedagógica del proyecto no es obra del autor, pero sigue siendo una parte

del análisis, con el fin de contextualizar adecuadamente el trabajo realizado en el proyecto.

La siguiente lista de objetivos y requisitos presentará una visión general de los objetivos

del proyecto. De acuerdo a lo especificado en el párrafo anterior, el autor se limitará a

desarrollar los objetivos técnicos, así como supervisar los demás objetivos que tienen que

ver más con la parte social y pedagógica. Estos últimos son parte de un esfuerzo continuo

en el proyecto europeo GO-Lab. De hecho, una vez que el autor ha completado el desarrollo

del laboratorio remoto para la experimentación, es decir, el aspecto técnico, el proyecto

ha entrado en la fase de investigación pedagógica, donde toda la parte de interacción con

el usuario del experimento será mejorada y, finalmente, se probará en situaciones reales.

1.1 OBJETIVOS

Un laboratorio remoto es una combinación de hardware y software que permite a un

estudiante controlar desde la distancia los dispositivos que están físicamente en un laboratorio. Este control, normalmente, se hace a través de una interfaz web. La experimentación mediante laboratorios remotos es una tendencia creciente en la educación. De

hecho, y a modo de anécdota, la UOC (en catalán Universitat Oberta de Catalunya) imparte Másteres oficiales no presenciales aprobados por los diferentes colegios de ingenieros

basados en laboratorios remotos. Estos laboratorios tratan de proporcionar una alternativa a los experimentos que se llevan a cabo en los laboratorios presenciales, permitiendo

a los estudiantes realizar experimentos reales a través de Internet. Además, el acceso a

estos recursos puede realizarse desde cualquier parte del mundo y en cualquier momento.

A diferencia de los laboratorios virtuales y las simulaciones, los laboratorios remotos proporcionan a los usuarios experimentación real (Ma & Nickerson 2006). De esta forma, el

alumno puede estar visualizando los resultados de su experimentación en tiempo real sin

tener que estar físicamente en el lugar en el que se desarrolla del experimento. Además,

estos laboratorios suponen un importante ahorro de costes, ya que el mismo laboratorio se

puede llegar a compartir entre millones de personas. Es posible que todas estas personas

pueden llegar a interactuar unas con otras durante el desarrollo del experimento.

1

1 OBJETIVOS Y ALCANCE

Figura 1.1: Interfaz del laboratorio remoto para física WebLab-Deusto Visir.

Una de las principales barreras históricas que ha frenado la evolución y expansión de

los laboratorios remotos es la falta de definición entre los diferentes roles que intervienen

tanto en el desarrollo, como en el consumo de laboratorios remotos. A menudo, en las

universidades los equipos que investigan en experimentación remota han implementado

laboratorios. Sin embargo, estos laboratorios remotos han estado enfocados al desarrollo

de experimentos propios de las asignaturas que imparten estas universidades desde su

particular perspectiva educativa. Podemos pensar entonces que tradicionalmente los laboratorios remotos se han desarrollado para consumo propio, dificultando su consumo desde

otros centros educativos. Además, al vincular los laboratorios remotos con asignaturas

específicas no se ha favorecido con carácter general, su reutilización en otras asignaturas

ni cursos, y aún menos, su extensión a otros centros. Por tanto, se puede decir que nunca

se ha pensado en los laboratorios remotos como un contenido educativo universal que se

pueda compartir. Es precisamente esta polivalencia, una de las metas que persigue este

proyecto.

2

PROYECTO FIN DE GRADO

En este proyecto se pretende implementar un laboratorio remoto que permita la experimentación con un contenido educativo universal en áreas científico-tecnológicas (en

inglés STEM, que viene de Science, Technology, Engineering and Mathematics). Este

laboratorio tratará de proporcionar una píldora educativa que pueda ser consumida por

multitud de usuarios con independencia de su localización, curso o asignatura. En este

sentido se ha elegido el Principio de Arquímedes por ser un principio físico fácilmente

demostrable visualmente y con una gran variedad de aplicaciones a lo largo de toda la

carrera educativa de un niño o adolescente. Este Principio afirma que “un cuerpo total

o parcialmente sumergido en un fluido en reposo, recibe un empuje de abajo hacia arriba

igual al peso del volumen del fluido que desaloja”. Esto es exactamente lo que intenta

plasmar este proyecto a través de diferentes herramientas que provee el laboratorio web.

La idea de este experimento es que se pueda ser usado tanto por alumnos de primaria

como por alumnos de secundaria, e incluso de ciertas carreras, cambiando únicamente las

conclusiones a las que se pretende llegar.

Hay que recalcar que este laboratorio remoto será ofrecido a más de 200 centros educativos europeos dentro del proyecto GO-Lab (Global Online Science Labs for Inquiry

Learning at School) subvencionado por la Comisión Europeo dentro del Séptimo Programa

Marco (FP7). GO-Lab proporciona laboratorios remotos en el ámbito de las ciencias para

su consumo en gran escala en la educación.

En este contexto el objetivo es implementar un laboratorio remoto que permita la experimentación con los conceptos educativos propios del Principio de

Arquímedes a través de Internet. Para ello se utiliza una arquitectura asíncrona distribuida, basada en dispositivos de bajo coste, escalable y fácilmente

accesible gracias al sistema de federación.

1.1.1 Objetivos Socio Económicos

En disciplinas técnicas y científicas, así como en colegios de secundaria, la realización de

experimentos en entornos reales es fundamental para consolidar los conceptos adquiridos

en las aulas teóricas. Sin embargo, a causa de distintos motivos, los laboratorios reales no

siempre están disponibles, lo cual sin duda, supone restricciones en el aprendizaje. Afortunadamente, las nuevas tecnologías basadas en Internet, pueden ser utilizadas para mejorar

la accesibilidad a los experimentos. WebLab-Deusto, a través de estos experimentos tiene

la intención de que los alumnos sean capaces de arraigar conocimientos en campos como

la física, la química, el control, etc., e incluso que estas prácticas puedan irse extendiendo

a otras áreas del conocimiento.

Por otro lado, el gasto requerido para la adquisición y mantenimiento de un laboratorio

dentro de un centro educativo para su utilización puntual es habitualmente difícilmente

amortizable. Gracias a los laboratorios remotos, este coste puede ser compartido entre

varias instituciones y siempre se gozará de una disponibilidad total del laboratorio.

El modelo de gestión a través de federación del sistema WebLab-Deusto, no solo permite

que cada instalación rentabilice su potencial, sino que además, es capaz de escalar el

número de usuarios de los laboratorios gracias a que distribuye la carga de accesos entre

los diferentes centros educativos que comparten recursos. Es decir, podría haber más de

3

1 OBJETIVOS Y ALCANCE

una copia de cada laboratorio en diferentes centros, para mejorar la disponibilidad del

experimento. Así, podría darse el caso de que, más de 600 estudiantes usaran un mismo

laboratorio, a través del balanceo de carga de todos ellos en copias del laboratorio presentes

en los diferentes centros educativos repartidos en todos los continentes.

Figura 1.2: Modelo de federación de WebLab-Deusto.

Además, este modelo permite crear una dinámica de intercambio de recursos que propicia

que el sistema sea económicamente sostenible. Aquellos centros educativos dispuestos a

compartir sus laboratorios pueden fijar unas directivas de uso determinando prioridades

de acceso, marcando el tiempo de las sesiones e incluso limitando el acceso en base al

número de sesiones o a restricciones basadas en el calendario. Este sistema de federación

permite vender o intercambiar accesos a laboratorios, creando por tanto un mercado.

Este proyecto persigue el diseño de una arquitectura que facilite la publicación a través de internet de los laboratorios presenciales instalados en centros

educativos sin necesidad de que estos investiguen directamente en esta línea

de investigación y, sin requerir grandes inversiones, mediante el empleo de

dispositivos de bajo coste.

4

PROYECTO FIN DE GRADO

1.1.2 Objetivos Tecnológicos

El principal objetivo tecnológico del presente proyecto es la implementación de un laboratorio remoto para la experimentación con el principio de Arquímedes mediante una

arquitectura asíncrona distribuida. Una herramienta de estas características implica unos

importantes retos tecnológicos y científicos que se pueden dividir en cuatro áreas:

OT1. Implementación de una plataforma de gestión para el despliegue de laboratorios remotos mediante hardware de bajo coste.

Desplegar un RLMS (Remote Laboratory Management System) en una plataforma

embebida de bajo coste, proporcionando todas las herramientas que permitan la

administración y configuración del mismo, así como la instalación para adaptarse a

un entorno federado.

OT2. Desarrollo de las comunicaciones mediante una arquitectura asíncrona

distribuida.

Desarrollo de todo el sistema de comunicaciones que permita la interacción entre

los diferentes subsistemas necesarios para el desarrollo de un laboratorio remoto

basado, sí es posible, en hardware y software libre.

OT3. Desarrollo de la interfaz de usuario.

Desarrollo de un interfaz de usuario mediante tecnologías RIA (Rich Internet Applications) que permita la experimentación conjunta y simultánea de profesores y

estudiantes en una misma sesión.

OT4. Procesamiento de imagen aplicado a acuario para el reconocimiento de

objetos.

Desarrollo de todo el software necesario para el procesamiento y reconocimiento

de los diferentes objetos que se irán vertiendo al acuario para posibilitar la experimentación con el Principio de Arquímedes.

1.2 ALCANCE DEL PROYECTO

El alcance de este proyecto comprende la realización de la implementación íntegra de

un laboratorio remoto mediante el desarrollo de componentes reutilizables. Este proyecto

tiene como finalidad la de facilitar el despliegue de laboratorios remotos por entidades no

especializadas, como pueden ser centros educativos o instituciones sociales. Este sistma,

que permitirá la experimentación con el principio de Arquímedes, servirá de prueba de

concepto para una arquitectura asíncrona distribuida que establece los mecanismos de

comunicación entre los subsistemas encargados de llevar a cabo las acciones propias de

control de la experimentación y aquellos que administran el acceso remoto. Esta arquitectura estará basada en hardware de bajo coste, ya que la idea es que cualquier centro

educativo o institución social tenga acceso a este tipo de laboratorio remoto independientemente de la capacidad de los recursos económicos de los que puedan disponer. Además,

y gracias a la federación, estas entidades podrán compartir estos inputs con otras.

5

1 OBJETIVOS Y ALCANCE

La arquitectura estará basado en los submódulos que se explican a continuación. Así, el

desarrollo de una estructura compleja como esta puede ser dividida en varios subproblemas más simples, y éstos a su vez, en otros subproblemas más simples. Básicamente se ha

separado el desarrollo de la estructura global en submódulos hasta obtener subproblemas

lo suficientemente simples como para resolverlos fácilmente. Ésta técnica se llama refinamiento sucesivo, divide y vencerás o análisis descendente (en inglés, Top-Down). Cada

uno de estos submódulos tiene una tarea bien definida y algunos necesitan de otros para

poder operar. En el caso de los submódulos que necesitan de otros para poder funcionar,

se comunican con éstos mediante una interfaz de comunicación bien definida. Podemos

ver la arquitectura dividida en lo submódulos más abajo, en la figura 1.3

1.2.1 Subsistema de manipulación y gestión remota del laboratorio

Este subsistema mecánico permitirá la experimentación y gestión del laboratorio, así,

por ejemplo, algunas de sus tareas que realizará son el izado y arriado de elementos

sumergibles, la medición de la temperatura del acuario, la alimentación de los peces del

acuario, el encendido y apagado de luces en función de diferentes parámetros, etc. Este

subsistema debe realizar estas tareas como procesos ligeros o hilos (del inglés threads),

repartiéndose en el procesador de forma dinámica. Este subsistema contara con un núcleo

de tiempo real que gestionará el reparto del tiempo del procesador. Además, todo esto debe

ser realizado en plataformas hardware de bajo coste como la platarforma Raspberry PI,

que tengan por lo menos un número mínimo de GPIOs (General Purpose Input Output)

para llevar a cabo la gestión de los sensores. Además, este subsistema utilizará servicios

web para sus comunicaciones. Así, todas las comunicaciones serán asíncronas, basadas en

REST (Representational State Transfer), y a través de peticiones POST y GET.

1.2.2 Implementación de RLMS en plataforma embebida de bajo coste

Uno de los principales propósitos de este proyecto se basa en la instalación del sistema de

gestión de laboratorios remotos WebLab-Deusto en una plataforma embebida con núcleo

ARM. Los procesadores ARM son, en la actualidad, procesadores de gran popularidad, incluso se podría decir que se encuentran en el interior de los gadgets más vendidos en el mercado. Dispositivos como teléfonos o tablets son algunos de los aparatos con procesadores

ARM incorporado. Los procesadores ARM están enfocados a dar altas prestaciones, con

un consumo reducido gracias a la arquitectura RISC. Los ARM son procesadores ágiles,

sencillos de implementar y programar, de muy bajo consumo y a un coste muy reducido.

De este modo, se consigue alcanzar uno de los principales objetivos del proyecto que es

que los centros educativos puedan desplegar de forma sencilla y barata WebLab-Deusto y

alguno de sus laboratorios de su elección, proporcionando todas las herramientas que permitan la administración y configuración del mismo. Además, tal y como se ha especificado

anteriormente, gracias a la federación, podrían compartir sus laboratorios.

6

PROYECTO FIN DE GRADO

1.2.3 Implementación de una interfaz sencilla para el manejo del laboratorio remoto

El sistema debe tener una aplicación web simple que permita desde el exterior hacer uso

del sistema. Esta aplicación web estará diseñada como una RIA, y debera ser ejecutada

sin problemas bajo navegadores web estandarizados, como puede ser Mozilla Firefox o

Google Chrome. Este tipo de aplicaciones buscan mejorar la experiencia y productividad

del usuario, así como visualizar la aplicación en cualquier tipo de dispositivo conectado a

Internet. Además, la aplicación web estará dividida en módulos para poder implementar

futuras mejoras, como hacer widgets con cada módulo sin apenas esfuerzo. Como ejemplos

de módulos podrían señalarse el módulo de imagen procesada, el módulo de vídeo, el

módulo de dar de comer a los peces, etc.

1.2.4 Implementación de visión artificial para el laboratorio remoto

Este subsistema es específico de este laboratorio, ya que es difícilmente aplicable a

otros, sin embargo, se estudiará la forma de aplicarlo a otros. En él, se llevara a cabo

la detección, localización y reconocimiento de ciertos objetos en imágenes, en este caso

objetos de diferentes colores y formas. También se evaluarán los resultados obtenidos para

posteriormente pasarlos a la aplicación web que se creara. Se pretende también crear

un registro de diferentes imágenes de una misma escena con sus objetos asociados para

intentar hacer concordar un mismo objeto en diversas imágenes. Por último, se pretende

hacer un seguimiento de los diferentes objetos en una secuencia de imágenes. Además,

para que el subsistema de visión artificial funcione requiere de una cuidadosa elección del

mejor tipo de luz adaptada al entorno que se plantea.

7

1 OBJETIVOS Y ALCANCE

Figura 1.3: Arquitectura planteada para el laboratorio.

8

PROYECTO FIN DE GRADO

2. ESTADO DEL ARTE

El presente proyecto tratará de implementar una arquitectura asíncrona distribuida

basada en hardware de bajo coste en el contexto de un laboratorio remoto para experimentación con el principio de Arquímedes. En este sentido, el estado de la arte abarca

varias áreas clave que necesitan ser identificados y analizadas por separado. En primer

lugar, se intenta proporcionar una visión general de los RLMS (Remote Laboratory Management System) que poseen los laboratorios remotos actuales y más populares, así como

los sistemas federación y autenticación que usan, y el diseño de la interfaz gráfica de

usuario. En segundo lugar, el documento intenta recoger las principales arquitecturas de

red presentes en los laboratorios remotos, así como las tendencias que han aparecido en

los últimos años. En tercer lugar, se repasan las diferentes aplicaciones que existen para

visión artificial enfocadas en laboratorios remotos y procesado de imagenes en movimiento,

y por último, se hace un breve resumen del hardware de control que existe para este tipo

de desarrollos, basicamente dispositivos embebidos adaptados. A pesar de que en estas

areas clave no aparece explicitamente señalada la parte del software, si que se hace un

pequeño estudio de las necesidades software en los puntos necesarios. Este capítulo queda

por tanto dividido de la siguiente forma:

• RLMS

• Tipos de Arquitecturas de Red

• Visión Artificial

• Hardware

2.1 RLMS

Judson Harward director del CECI (Center for Educational Computing Initiatives), y

presidente del GOLC (Global Online Laboratories Consortium), donde se acuñó el término

RLMS, subrayó durante la keynote de la conferencia GOLC’2011 “en el mundo existen tres

grandes RLMS capaces de ofrecer autenticación, autorización, planificación, seguimiento

de los usuarios, y además, ser reusables de un laboratorio a otro: MIT iLabs, Labshare

Sahara, y WebLab-Deusto”. Existen algunos más que cumplen, en parte, los requisitos

expuestos en las líneas anteriores y que resulta preciso mencionar.

9

2 ESTADO DEL ARTE

A continuación se describen las principales características de cada una de estas plataformas comentadas anteriormente:

• MIT iLabs

• Labshare Sahara

• WebLab-Deusto

• Otros sistemas

Por ultimo se hara una pequeña comparación entre las características que mas interesan

en este proyecto de los RLMS más relevantes

2.1.1 MIT iLabs

El CECI, perteneciente al MIT (Massachusetts Institute of Technology), ha desarrollado

un sistema de gestión de laboratorios remotos llamado ISA (iLab Shared Architecture).

Este sistema de gestión de laboratorios remotos es, actualmente, el más extendido en todo

el mundo, con diferentes iniciativas para compartir laboratorios de Europa, Australia,

Asia y Estados Unidos. Es también el primer RLMS que incluyó la federación como una

característica nativa (Harward, Del Alamo, Lerman, Bailey, Carpenter, DeLong, Felknor,

Hardison, Harrison, Jabbour et al. 2008).

En 2001 ILabs desplegó una nueva arquitectura basada en servicios web, que posteriormente se convirtió en una infraestructura común para todos los laboratorios. Su desarrollo

fue liderado completamente por el CECI. Esta arquitectura, denominada ISA permite

compartir de forma nativa los laboratorios entre diferentes universidades. Como simple

curiosidad, WebLab-Deusto pasó en 2004 a formar parte de la ISA. Esta arquitectura en

sus comienzos solo soportaba el concepto de laboratorios por lotes, donde las tareas propuestas por los estudiantes se ejecutaban y los resultados eran devueltos posteriormente.

Los estudiantes no eran capaces de interactuar con el laboratorio durante el tiempo asignado. Sin embargo, en 2007 la ISA comenzó a desarrollar laboratorios interactivos, que

permitían a los estudiantes interactuar en tiempo real con ciertos elementos hardware, y

verlo al mismo tiempo.

El sistema de iLabs divide los experimentos en dos categorías principales:

• Laboratorios por lotes (gestionados mediante colas)

• Laboratorios interactivos (gestionados a través de reservas)

La arquitectura de los laboratorios por lotes se representa en la Figura 2.1. En la

figura, hay dos campus que podrían ser dos universidades diferentes. Cada campus tiene

un servidor de laboratorio (en inglés Lab Service) que es el sistema de software sujeto al

equipo final que será utilizado por los estudiantes, y contiene la lógica de la que depende

directamente el laboratorio. Además, cada campus tiene un proveedor de servicios (en

10

PROYECTO FIN DE GRADO

inglés Service Broker), que es el servidor que realiza el logueo de usuarios, la gestión de

permisos y la gestión de accesos.

Figura 2.1: Arquitectura de iLabs para experimentos por lotes.

Los estudiantes inician sesión en el proveedor de servicios de su campus, donde tienen un

conjunto de credenciales y permisos para acceder a sus cuentas. Una vez iniciada la sesión,

los alumnos son capaces de utilizar esos experimentos con independencia del lugar dónde

se encuentren. De esta manera, si un estudiante de la Universidad “A” quiere utilizar un

laboratorio ubicado en la Universidad “B”, el estudiante inicia la sesión en el proveedor

de servicios de la Universidad “A” y transfiere las peticiones a este proveedor de servicios.

El proveedor de servicios de la Universidad “A” las reenvía al servidor de laboratorio de

la Universidad de “B” directamente, y le devuelve al estudiante la respuesta generada por

este servidor de laboratorio. Todas estas comunicaciones están implementadas con SOAP.

La cola está gestionada por el servidor de laboratorio, en la medida en que puede ser

contactado por los estudiantes de diferentes proveedores de servicios al mismo tiempo. El

servidor de laboratorio ofrece una interfaz Web para su gestión. Este servicio de gestión de

las colas podría aplicarse de diferentes maneras por diferentes servidores de laboratorios,

siempre y cuando mantengan la misma interfaz. La cola se gestiona a través una base de

datos intermedia. Como se ve en la figura 2.2, el servidor valida los experimentos antes

de agregarlos a la cola. De esta manera, la cola solo se llena con experimentos válidos,

por lo que los estudiantes que no presentan experimentos válidos no tienen que esperar

para conseguir una ranura de tiempo. Internamente otro proceso recogerá y procesará los

experimentos desde la base de datos.

11

2 ESTADO DEL ARTE

Figura 2.2: Gestión interna de colas en el servidor de laboratorio.

La arquitectura de los laboratorios interactivos se representa en la figura 2.3. El objetivo de esta arquitectura es optimizar la comunicación entre el cliente y el servidor de

laboratorio. En la arquitectura por lotes esto es irrelevante, ya que no existe comunicación entre ellos. Para optimizar esta comunicación se usa una conexión directa entre

nodos, utilizando un protocolo elegido por el desarrollador del servidor de laboratorio. La

comunicación entre los diferentes servidores implicados a nivel ISA se basa en SOAP.

Figura 2.3: Arquitectura de iLabs para experimentos interactivos.

12

PROYECTO FIN DE GRADO

Dado que los experimentos interactivos en iLab duran alrededor de 20 minutos, se ha

desarrollado un sistema de reservas. Además, dado que estos laboratorios son federados,

hay diferentes actores que pueden influir en las reservas de distintas formas. Por ejemplo,

es posible que los administradores del lado de los estudiantes tengan que cambiar las

reservas en algún momento. También es posible que los administradores del lado del

laboratorio tengan que realizar este proceso (por ejemplo, por un cambio en la planificación

del laboratorio planificada o no).

2.1.2 LabShare Sahara

Labshare Sahara es un sistema de gestión de laboratorios remotos desarrollado por la

UTS (University of Technology Sydney) como parte del proyecto Labshare. En mayo de

2010 varios laboratorios remotos migraron para proporcionar una administración centralizada común, entendiéndose este como un RLMS (Lowe, Murray, Weber, de la Villefromoy,

Johnston, Lindsay, Nageswaran & Nafalski 2009). En enero de 2011, se incorporaron varios cambios, como el desarrollo de reservas basadas en el calendario, y algunas más. En

esta sección, se discutira sólo la última versión, ya que es la que se usa actualmente. La

arquitectura del Labshare Sahara está compuesta por tres componentes principales. Las

interacciones entre estos componentes se pueden ver descritas en la Figura 2.4:

• La Interfaz Web (WI, en inglés web interface), desarrollado en PHP, gestiona la

interfaz de usuario básica para la aplicación de autenticación, las tareas de administración, se muestran los permisos, etc.

• El servidor de programación, desarrollado en Java utilizando la infraestructura OSGi

(Open Services Gateway initiative) y gestiona la asignación de los recursos, los contactos de los laboratorios para comprobar si están rotos los sistemas, y lleva a cabo

todo el proceso de planificación.

• El cliente Rig, escrito en Java, que es el componente de software que se ejecuta en

el equipo final.

Labshare Sahara posee una de los más complejos, avanzados y potentes sistemas de

programación en los laboratorios remotos. Es compatible con el balanceo de carga local,

por lo que el sistema puede gestionar más de una copia de cada laboratorio. En efecto,

en la UTS hay desplegadas varias copias de los laboratorios y los estudiantes van siendo

balanceados entre ellos automáticamente por el sistema según van entrando. Además, el

planificador divide los recursos desde los laboratorios solicitados, para que los estudiantes

hacer una petición a un laboratorio llamado, por ejemplo, medida de fuerzas. Mientras

que unos estudiantes están haciendo solicitudes a medida de fuerzas otros pueden hacer

solicitudes a medida de fuerzas vertical y otros a medida de fuerzas horizontal. De esta

manera, un recurso puede servir a más de un tipo de laboratorio. Por ejemplo, el laboratorio de medida de fuerzas vertical puede servir a los estudiantes que solicitan medida de

fuerzas vertical y medida de fuerzas.

13

2 ESTADO DEL ARTE

Además, Labshare Sahara posee un sistema de reservas en el que los estudiantes eligen

si así lo desean usar el sistema de colas (es decir, ”quiero usar el laboratorio tan pronto

como sea posible”) o a través de las reservas (es decir, ”prefiero usarlo mañana a una hora

concreta”).

Figura 2.4: Arquitectura de Labshare Sahara.

2.1.3 WebLab Deusto

WebLab-Deusto es un RLMS de código abierto que se utiliza con los estudiantes de la

Universidad de Deusto desde febrero de 2005 como una herramienta esencial para sus prácticas de laboratorio en diferentes materias relacionados con la ingeniería. Desde WebLabDeusto se ofrecen experimentos reales como FPGAs, CPLDs, microcontroladores PICs,

etc. a un cierto grupo de usuarios a través de Internet. La experiencia de la utilización de

los experimentos que tienen los estudiantes es exactamente la misma a la que obtendrían

si estuvieran delante de un laboratorio tradicional.

WebLab-Deusto ofrece una arquitectura de software distribuida, abierta y escalable que

facilita la integración de nuevos experimentos (WebLab-Deusto 2005 onwards). Existen

dos tipos de experimentos:

• Experimentos gestionados, en los que WebLab-Deusto permite que el desarrollador

del experimento utilice cualquiera de las tecnologías web comunes para el lado del

cliente como JavaScript, Flash, applets de Java, etc. y exige que use la tecnología

para el lado del servidor que WebLab-Deusto provee. WebLab-Deusto cuenta con

bibliotecas para C, C++, NET, LabVIEW, Java. y Python.

• Experimentos no gestionados, donde el desarrollador del experimento coloca una

aplicación en una máquina virtual y WebLab-Deusto gestiona el control de acceso a

la máquina virtual.

14

PROYECTO FIN DE GRADO

Los dos tipos de experimento tienen las ventajas de todas las características comunes

aplicadas para el RLMS WebLab-Deusto, que son:

• Autenticación: WebLab-Deusto ofrece un sistema de autenticación extensible que

soporta nombre de usuario y contraseña almacenadas en una base de datos MySQL,

servidores LDAP remotos, comprobación de credenciales de OpenID para el acceso

desde otras universidades o Facebook, y autenticación basada en la dirección IP del

cliente.

• Gestión de colas: WebLab-Deusto gestiona diferentes colas de reserva para las diferentes plataformas experimentales disponibles, así como balanceo de carga en los

diferentes tipos de experimentos disponibles.

• Escalabilidad: La arquitectura de WebLab-Deusto escala horizontalmente y tiene

herramientas de prueba disponibles para probar diferentes implementaciones.

• Seguridad: La arquitectura distribuida WebLab-Deusto mantiene en forma aislada

el hardware dependiente de la experimentación, y el software, por lo que cualquier

problema relacionado con un mal uso del experimento nunca puede poner todo el

laboratorio remoto en riesgo.

• Implementación: El sistema de implementación WebLab-Deusto hace fácil y flexible configurar la red distribuida en la que están implicados todos los servidores y

experimentos.

• Seguimiento del usuario: Los usos del laboratorio remoto se guardan automáticamente. En el caso de los experimentos gestionados, se almacenan incluso los comandos intercambiados entre el servidor y el cliente. La cantidad de eventos a registrar

depende de lo que decida el administrador.

• Administración: WebLab-Deusto ofrece herramientas de administración que permiten llevar a cabo fácilmente tareas de administración como la monitorización

de usuarios en tiempo real, comprobación de accesos, añadir o quitar permisos a

usuarios y grupos, etc.

• Facebook: WebLab-Deusto se integra con Facebook, por lo que los usuarios pueden

vincular sus cuentas y utilizarlo con herramientas que proporciona Facebook como

el chat.

• Dispositivos móviles: La interfaz de usuario de WebLab-Deusto también está adaptado para dispositivos móviles, y los experimentos gestionados están adaptados para

proporcionar una versión más rápida y fácil de usar.

• Extensible: Cualquier experimento existente se puede adaptar a WebLab-Deusto.

Por poner un ejemplo, el Proyecto VISIR se adaptó a WebLab-Deusto.

WebLab-Deusto utiliza una arquitectura de capas. Los usuarios proporcionan sus credenciales a un servidor aislado llamado servidor de entrada. Este servidor valida las

credenciales, y si son válidas se pone en contacto con el servidor central para solicitar una

nueva sesión.

15

2 ESTADO DEL ARTE

Desde este punto de vista, los usuarios interactuan con el servidor central. El servidor central realiza todas las operaciones de la lógica de negocio como comprobar si los

usuarios están autorizados a usar un laboratorio y en concreto, extraer la información personal del usuario, comunicarse con otros entornos federados, seguimiento de los usuarios,

etc. Además, la mayoría de las interacciones con los experimentos pasan por este servidor, y será él el que las transmitirá al servidor adecuado para acceder a los laboratorios

solicitados.

Figura 2.5: Arquitectura local de WebLab-Deusto.

WebLab-Deusto está construido sobre los siguientes cuatro supuestos relacionados:

• Todas las peticiones que hacen los usuarios se envían al servidor central, el cual los

envía con seguridad a el servidor de cada laboratorio, y éste los envía al servidor

final del experimento. De esta manera, ni el servidor de laboratorios ni el servidor

de experimento necesita tener una dirección IP pública.

• Incluso si el servidor de experimento se encuentra en una red no fiable, el servidor de

laboratorios garantiza que los mensajes se envían de forma segura desde el servidor

central al lugar donde se encuentra.

• Dado que toda la interacción se gestiona a través del servidor central, el es el que

registra todas las interacciones. Si un usuario quiere llevar a cabo una acción malintencionada, puede acceder al servidor de experimento, puede romperlo, pero no

hay forma de que modifique o acceda a la información enviada por otros usuarios.

Tampoco es posible que un servidor de experimento quede mal programado o se

manipule un equipo para detener el logueo de interacciones en el servidor central.

16

PROYECTO FIN DE GRADO

• Las capas de seguridad requeridas pueden ser adoptadas por el servidor de laboratorios, e interactuar con el servidor de experimento. Este servidor de experimento

se puede desarrollar en cualquier lenguaje de programación.

Estas interacciones se muestran en la Figura 2.5, que resume la arquitectura local de

WebLab-Deusto. En esta figura, se puede ver cómo los estudiantes conectan al servidor

central, que envía las peticiones al servidor de laboratorios de la habitación 2, que envía

las peticiones a los servidores particulares de cada experimento. Sin embargo, la adición

de más capas añade dos inconvenientes:

• Latencia: si se añaden más capas, más tiempo se necesitará para que un mensaje

sea enviado al hardware final.

• Flexibilidad: algunos protocolos (como RDP, VNC o SSH) simplemente no pueden

ser reenviados como un conjunto de mensajes de comando.

2.1.4 Otros sistemas

Existen otros sistemas que se diferencian de los anteriores RLMS en que no cumplen

con todas las características citadas anteriormente, pero que sin embargo ofrecen características muy similares.

VLCAP es una plataforma que tiene como objetivo el desarrollo rápido de laboratorios

remotos dentro de instituciones académicas con unas nociones básicas de programación.

Permite también la compartición de todos los laboratorios entre las diferentes instituciones implicadas en el proyecto. Además, y como característica principal tiene un sistema

que permite que cada laboratorio pueda ser compartido hasta por mil personas a la vez

para poder trabajar juntos. VLCAP tiene implementados repositorios de laboratorios,

un sistema de gestión de laboratorios con autenticación basada en diferentes estándares y

reservas, y sistemas para el despliegue rápido de nuevos laboratorios.

Lab2go es un repositorio semántico de laboratorios remotos, sobre la base de ontowiki.

El proyecto podría parecerse en algunas de las características a los sistemas de gestión

de laboratorios remotos, ya que muestra una lista de los laboratorios disponibles en diferentes universidades. Sin embargo, garantizar acceso o gestionar la planificación de los

laboratorios está fuera del alcance de Lab2go, ya que su única finalidad es la de mantener

una lista actualizada de los laboratorios existentes, con la documentación, los lugares,

y semánticamente clasificado. Lab2go es una gran herramienta para buscar laboratorios

remotos.

Con la misma idea de Lab2go, pero con el apoyo del GOLC y la Comunidad Europea,

existe otro repositorio, no semántico, de los laboratorios remotos llamado LiLa (Library of

Labs). LiLa es un portal de acceso a laboratorios remotos. Incluye servicios como sistemas

de planificación, conexión a los recursos de las bibliotecas, sistema de tutorías, entornos

3D para la colaboración en línea, etc. Asimismo, LiLa crea un marco organizativo para

el intercambio de experiencias entre las instituciones y para el acceso a los laboratorios

remotos y ofrece ayuda didáctica para el profesorado en la integración de experimentos

remotos y virtuales en los programas educacionales.

17

2 ESTADO DEL ARTE

Figura 2.6: Diagrama de componentes de VLCAP.

Existen dos proyectos que se ajustan a la definición de los sistemas de gestión de laboratorios remotos (RLMS) y se han desarrollado con la colaboración de estudiantes reales,

pero por limitaciones técnicas no les ha sido posible desarrollar más de un laboratorio.

El primero de estos proyectos, es el proyecto NETLab. Este proyecto constituye un laboratorio de electrónica remota desarrollado por la UniSA (University of South Australia),

basado en una una profunda investigación sobre la programación de sistemas. El segundo

de los referidos proyectos hace referencia a RVLab, proyecto que se ha desplegado como

un laboratorio de domótica, pero que ha sido diseñado para soportar cualquier tipo laboratorio a través de XML-RPC API (Muros-Cobos & Holgado-Terriza 2012).

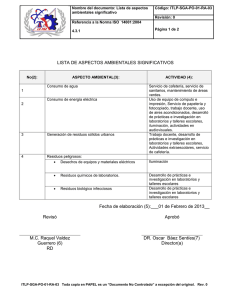

2.1.5 Comparación entre los RLMS más relevantes

Laboratorios por lotes

Laboratorios Interactivos

Gestión de colas

Balanceo de carga local

Federación

Labshare sahara

7

3

3

3

3

MIT iLabs

3

3

3

7

3

WebLab-Deusto

3

3

3

3

3

Tabla 2.1: Comparación de algunas características de los RLMS más relevantes

18

PROYECTO FIN DE GRADO

2.2 TIPOS DE ARQUITECTURAS DE RED

La arquitectura de red es el medio más efectivo en cuanto a costos para desarrollar

e implementar un conjunto coordinado de productos que se puedan interconectar. La

arquitectura es el “plan” con el que se conectan los dispositivos de hardware, software y

los protocolos. Esto redunda en benéficio tanto para los usuarios de la red como para los

proveedores de hardware y software. Básicamente se puede señalar la existencia de tres

tipos diferentes de arquitecturas de red, aunque realmente el tercer tipo, la arquitectura

mixta, resulta de una combinación de las dos primeras. Estas arquitecturas de red son las

siguientes:

• Arquitectura Centralizada

• Arquitectura Distribuida

• Arquitectura Mixta

Además, se ha desarrollado una pequeña comparativa de las características más interesantes de las mismas.

2.2.1 Arquitectura Centralizada

La arquitectura centralizada se refiere a la arquitectura en la que el control, monitoreo y

supervisión de los diferentes dispositivos y componentes se deben conectar directamente,

bien por cables o de forma inalámbrica, hasta un sistema de control central, como puede

ser un servidor central. Este sistema es el principal centro de control de la red, ya que

recibe y reúne la información de todos los sensores que posee cada uno de los diferentes

dispositivos físicos de la red, toma las decisiones y se las envía a los elementos actuadores

para que ejecuten la tarea asignada, o bien lo envía a otra red que lo solicite por medio

de Internet. El mayor inconveniente de este tipo de arquitectura radica en que cualquier

fallo en el servidor central deja fuera de servicio el sistema en su totalidad. Esto significa

una reducción en las posibilidades de desarrollo en cuanto a la robustez e implementación

en grandes instalaciones y apunta a unas reconfiguraciones muy costosas.

El bajo costo que representa este tipo de arquitectura, que permite tener un solo dispositivo central del que dependan otros dispositivos o directamente sensores, es su principal

ventaja frente a otras, puesto que los elementos que la componen muchas veces no necesitan

ni siquiera módulos adicionales para el direccionamiento, ni interfaces de comunicaciones

para distintos buses. También es importante destacar la sencillez en la instalación y la

compatibilidad entre la gran variedad de elementos y dispositivos que ofrece el mercado.

19

2 ESTADO DEL ARTE

Figura 2.7: Ejemplo de arquitectura centralizada.

2.2.2 Arquitectura Distribuida

La arquitectura distribuida se define como una colección de dispositivos separados físicamente y conectados entre sí por una red de comunicaciones distribuida; cada dispositivo

posee sus propios componentes hardware y software, pero el usuario lo percibe como un

solo sistema (no necesita saber qué cosas están en cada dispositivo). Así, el usuario puede

acceder a los recursos remotos de la misma manera en que accedería a recursos locales

(Garcia-Zubia, Orduña, Angulo, Irurzun & Hernández 2008).

Estos sistemas se caracterizan por ser una topología de red ausente de un centro individual o colectivo. Los nodos se vinculan unos a otros de modo que ninguno de ellos tiene

poder de filtro sobre la información que se transmite en la red. Desaparecen por tanto

los nodos centrales característicos de las redes centralizadas. Se entiende que estas redes

deben de tener ciertas características comunes a todos ellos como son:

• Tolerancia a fallos: Los sistemas distribuidos deben ser muy confiables, es decir,

que si un componente del sistema se estropea, otro componente debe ser capaz de

reemplazarlo.

• Escalabilidad: Los tamaños de los sistemas distribuidos puede ser muy variados,

pueden ser decenas de dispositivos dentro de una red LAN (Local Área Network),

centenas de dispositivos dentro de una WAN (Wide Area Network), o millones de

dispositivos, como es el caso de Internet.

20

PROYECTO FIN DE GRADO

• Transparencia: La transparencia se define como la ocultación, al usuario y al programador de aplicaciones, de la separación de los componentes de un sistema distribuido,

de manera que el sistema se percibe como un todo, en vez de una colección de componentes independientes. La transparencia ejerce una gran influencia en el diseño

del software de sistema.

Además, se puede definir otra característica adicional, importante en los laboratorios

remotos, que resulta interesante en esta línea, que es la apertura del sistema.

• Apertura: Un sistema informático es abierto si el sistema puede ser extendido de

diversas maneras. Un sistema puede ser abierto o cerrado con respecto a extensiones hardware (añadir periféricos, memoria o interfaces de comunicación, etc.) o

con respecto a las extensiones software (añadir características al sistema operativo,

protocolos de comunicación y servicios de compartición de recursos, etc.). La apertura de los sistemas distribuidos se determina primariamente por el grado hacia el

que nuevos servicios de compartición de recursos se pueden añadir sin perjudicar ni

duplicar a los ya existentes.

Figura 2.8: Ejemplo de arquitectura distribuida.

2.2.3 Arquitectura Mixta

La arquitectura mixta se basa en una arquitecturas descentralizada donde todos los sistemas son totalmente independientes en su funcionamiento, pero deben estar comunicados

entre sí por medio de una conexión física (cables) o inalámbrica. Normalmente, estos sistemas están basados en una o varias unidades de control de gestión y uno o varios módulos

21

2 ESTADO DEL ARTE

receptores o actuadores. Este tipo de arquitectura resulta de una combinación entre los

sistemas con arquitectura centralizada y distribuida, aprovechando las ventajas que brindan, entre ellas se puede mencionar la flexibilidad, ya que permite que el sistema se pueda

configurar con múltiples opciones de acceso al usuario final. Como resultado no existe un

único dispositivo central sino un centro colectivo de conectores. La caída de uno de los

dispositivos centralizadores, conlleva la desconexión de uno o más dispositivos del conjunto de la red mientras que la caída del cluster centralizador produciría necesariamente

la ruptura o desaparición de la red. La red se rige por principios como la “adhesión” o la

“participación”. El nacimiento del telégrafo marcó el inicio de las redes descentralizadas.

La Wikipedia es un ejemplo perfecto de lo que son las redes descentralizadas.

Figura 2.9: Ejemplo de arquitectura mixta.

2.2.4 Comparación entre las arquitecturas propuestas

Una vez repasados como es cada una de las opciones de arquitecturas disponibles es

necesario hacer un pequeño resumen que aúne las ventajas y desventajas de cada uno de

ellas.

En el caso de la arquitectura centralizada existe una ventaja clara respecto al resto de

arquitecturas que radica en la gran potencia e inteligencia de los procesadores alojados en

el servidor, ideal para integraciones de gran complejidad y donde tenemos que convivir con

diferentes sistemas. Resulta de especial interés en el caso de que el sistema deba procesar

una gran cantidad de información a gran velocidad. Sin embargo, presenta una desventaja

importante que es que toda la responsabilidad del sistema recae en el servidor central, y

en caso de fallo todo deja de funcionar.

22

PROYECTO FIN DE GRADO

En la arquitectura distribuida existe la ventaja de que cada dispositivo tiene una autonomía propia, lo cual le proporciona una gran seguridad al sistema. Debido a que se hace

un reparto de responsabilidad entre los diferentes nodos del sistema pueden caerse partes

del mismo y seguir funcionando otras. Otra gran ventaja de estos sistemas es que son

fácilmente escalables, ya que por su tipo de arquitectura podemos distribuir tareas entre

los diferentes, y cuando tengamos problemas, incluir nuevos nodos. Como desventaja es

necesario destacar el hecho de que al tener la inteligencia repartida por pequeños dispositivos en pequeños procesadores que sólo acometen sus pequeñas funciones en su programa

de aplicación, no se puede, en principio, obtener gran potencia del sistema. Además al

estar los nodos preprogramados para funciones específicas no suelen ser demasiado flexible

a la hora de volver a programarlos.

Por último, en lo que se refiere a la arquitectura mixta, tal y como se ha indicado

anteriormente, ésta aúna las ventajas de las dos arquitecturas anteriormente citadas, consiguiendo minimizar las desventajas aportando además una importante descentralización

que derive en el aumento de la flexibilidad del sistema.

2.3 VISIÓN ARTIFICIAL

La visión artificial, también conocida como visión por computador (computer vision), es

un subcampo de la inteligencia artificial. El propósito de la visión artificial es programar

un dispositivo para que ”entienda” una escena o las características de una imagen. La

visión artificial incluye métodos para adquirir, procesar, analizar y la comprensión de las

imágenes. Algunos de los objetivos más hábituales de la visión artificial son la detección,

segmentación, localización y reconocimiento de ciertos objetos en imágenes (por ejemplo,

caras humanas), el seguimiento de objetos en una secuencia de imágenes, etc. Las aplicaciones van desde tareas tales como por ejemplo la inspección de botellas. Como disciplina

científica, la visión por ordenador se refiere a la teoría de los sistemas artificiales que extraer información de imágenes. Los datos de imagen se pueden tomar muchas formas,

tales como secuencias de vídeo, vistas desde múltiples cámaras o datos multidimensionales

desde un escáner.

En este proyecto hay dos partes importantes asociadas a la visión artificial, que son:

• Librerías para Visión Artificial

• Formatos de archivos de imagen

2.3.1 Librerías para Visión Artificial

Existen muchas alternativas para utilizar algoritmos de visión artificial desde diferentes

dispositivos como ordenadores o sistemas embebidos, y que son libres, pero las más utilizadas, y por tanto las que más documentación tienen detrás, son las que se estudiaran en

detalle en esta sección para ser integradass en el proyecto. En este caso la función principal

de la visión artificial es la de reconocimiento de ciertos objetos simples (Torralba, Murphy,

Freeman & Rubin 2003).

23

2 ESTADO DEL ARTE

Entre las diferentes opciones de librerias se han seleccionado las siguientes:

• LTI

• VXL

• OpenCV + IPP

2.3.1.1 LTI

LTI es una biblioteca orientada a objetos con los algoritmos y estructuras de datos utilizadas en el procesamiento de imágenes y visión por ordenador. Ha sido desarrollada

en la Universidad de Tecnología de Aachen, en el marco de muchos proyectos de investigación en visión por computador que tratan sobre robótica, reconocimiento de objetos y

reconocimiento de gestos, etc. El objetivo principal de la LTI es proporcionar una librería

orientada a objetos en C++ que proporcione algoritmos rápidos que se puedan utilizar

en aplicaciones reales. Ha sido desarrollado utilizando GCC en Linux, y Visual C++ en

Windows, es decir, puede funcionar sobre estas dos plataformas sin problemas.

Muchas de las clases de la API encapsulan las funcionalidades de Windows y Linux con

el fin de simplificar el hecho de tratar con el código específico de cada sistema o de cada

hardware asociado. Un ejemplo es que existen clases para gestionar el “multi-threading”

y la sincronización, las medidas del tiempo, y el acceso al puerto serie).

Las funciones de LTI principalmente sirven para operaciones con Álgebra lineal como

matrices, vectores, ecuaciones lineales, estadísticas, etc. Aplicaciones de procesamiento

de imágenes para filtros lineales, filtros orientables, etc. Además, posee una serie de

herramientas para la visualización y herramientas de dibujo que nos sirven para dibujar

algo de información extra en la imagen (un poco de texto, elipses, cuadros, líneas o puntos).

Esto nos puede ayudar a ahorrar mucho tiempo de procesamiento.

Figura 2.10: Proceso de segmentación de una imagen con LTI.

24

PROYECTO FIN DE GRADO

2.3.1.2 VXL

VXL (Vision-something-Library) es una colección de bibliotecas de C++ diseñadas para

la investigación de la visión artificial por ordenador y su aplicación en productos finales.

Fue creado a partir TargetJr con el objetivo de hacer un sistema ligero, rápido y consistente.

VXL está escrito en ANSI / ISO C++ y está diseñado para ser multiplataforma. En el

núcleo de VXL hay varias bibliotecas que son:

• VNL (Números): Se encarga de la gestión de los contenedores y algoritmos numéricos. Por ejemplo matrices, vectores, descomposiciones, optimizadores.

• VIL (Imágenes): Librería para cargar, guardar y manipular imágenes en muchos

formatos de archivo, incluyendo imágenes muy grandes.

• VGL (Geometría): Aplica los principios de la geometría a los puntos, curvas y otros

objetos elementales en 1, 2 y 3 dimensiones.

• VSL (Streaming de Entradas y Salidas), VBL (Plantillas básicas), VUL (Utilidades):

Librerías de miscelánea independientes de cada plataforma.

Figura 2.11: Imagen obtenida con VXL aplicando un ltro de contornos.

Además de las bibliotecas del núcleo, existen librerías que cubren algoritmos numéricos,

procesamiento de imágenes, sistemas de coordenadas, la geometría de la cámara, gestión

del sonido, manipulación de vídeo, recuperación de la estructura del movimiento, modelos

de probabilidad, diseño de interfaces gráficas de usuario, la clasificación, estimación de

sistemas robustos, seguimiento de funciones, topología, manipulación de estructuras, imágenes en 3D, y mucho más. Cada librería del núcleo de la biblioteca es ligera, y se puede

utilizar sin referencia a las otras bibliotecas del núcleo. Del mismo modo, las bibliotecas

no estratégicas no dependen más que de lo absolutamente necesario, para poder compilar