3. Variables aleatorias y Probabilidad

Anuncio

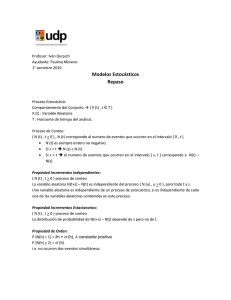

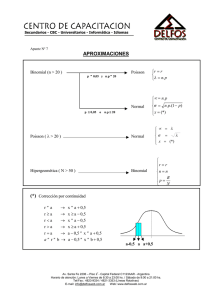

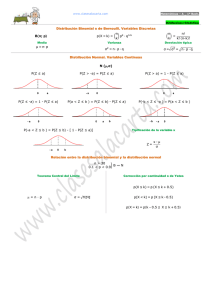

Diplomado en Salud Pública 2. Metodología en Salud Pública VARIABLES ALEATORIAS Y DISCTRIBUCIÓN DE PROBABILIDAD Autor: Clara Laguna 3.1 INTRODUCCIÓN En el tema de estadística descriptiva se revisaron las técnicas necesarias para la realización de un análisis descriptivo de las variables recogidas en una muestra. En el presente tema nos centramos en describir algunos modelos teóricos de probabilidad que permiten caracterizar la distribución poblacional de determinadas variables y que, a su vez, son aplicables a múltiples situaciones prácticas. Vamos a desarrollar los siguientes aspectos sobre los modelos de probabilidad: Qué son las variables aleatorias, distinguiendo entre las discretas y las continuas. Cómo se caracterizan los modelos de probabilidad para las variables aleatorias discretas y las variables aleatorias continuas mediante la función de probabilidad, la función de densidad y la función de distribución. Algunos modelos de probabilidad para variables aleatorias discretas: Bernoulli, Binomial, de Poisson. Cómo, en determinadas condiciones, se pueden aproximar modelos de probabilidad discretos por otros más sencillos e incluso por modelos de probabilidad continuos, como por ejemplo por la distribución normal. Cuando se realiza un estudio o un experimento aleatorio, es frecuente asignar a los resultados del mismo una cantidad numérica. A la función que asocia un número real a cada resultado de un experimento se le denomina variable aleatoria. Aunque el concepto de variable se ha introducido con anterioridad, una definición más formal de variable aleatoria (v.a.) es, por tanto, la de una función definida sobre el espacio muestral E (conjunto de todos los resultados posibles) que asigna a cada posible resultado de un experimento un valor numérico. Las variables aleatorias suelen denotarse por letras mayúsculas del final del alfabeto, tales como X, Y o Z, mientras que los valores que pueden tomar se representan por sus correspondientes letras minúsculas, x, y o z. “Una variable aleatoria es una asignación numérica a los resultados de un experimento” Ejemplo 3.1 En el experimento consistente en observar la supervivencia a los 6 meses de 4 pacientes con cáncer sometidos a tratamiento, una variable aleatoria X podría ser el “número de supervivientes”, que tomaría los valores x = 0, 1, 2, 3 ó 4 en función del número de pacientes que hayan sobrevivido a los 6 meses. 03. Variables aleatorias y distribución de probabilidad 1 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Alternativamente, podría definirse otra variable aleatoria Y como el “número de muertes”, cuyos valores serían y = 0, 1, 2, 3 ó 4 en función del número de muertes observadas. Ejemplo 3.2 Para el experimento de medir el colesterol HDL de una persona, la variable aleatoria X más natural sería “el nivel de colesterol HDL en mmol/l “, que podría tomar cualquier valor positivo. Si el interés se centra en saber si los niveles de colesterol HDL son superiores o inferiores al umbral de 0,90 mmol/l, otra variable aleatoria Y podría definirse como “0 si el nivel observado es inferior a 0,90 mmol/l y 1 en caso contrario”. La elección de los valores 0 y 1 es arbitraria, bastaría con asignar dos valores distintos para diferenciar ambos tipos de resultados. Cuando en la reiterada observación de un fenómeno, los resultados que vamos obteniendo no siguen ninguna norma sino que dependen del azar, diremos que corresponden a una variable aleatoria. Para explicar el comportamiento de estas variables, utilizamos los modelos de probabilidad. Como las variables aleatorias son funciones definidas sobre el espacio muestral E, sus posibles valores tendrán asociada una probabilidad, que corresponderá a la probabilidad del suceso constituido por aquellos resultados del experimento que toman dichos valores. Los diferentes valores de una variable aleatoria y las probabilidades asociadas constituyen la distribución de probabilidad de la variable. La estadística es l Ejemplo 3.3 En el primer experimento del ejemplo 3.1, el número de supervivientes es una variable aleatoria X que toma los valores x = 0, 1, 2, 3 ó 4. La probabilidad asociada al valor 0 P(X = 0) sería la probabilidad del suceso “ninguno de los 4 pacientes sobrevive a los 6 meses”. La probabilidad asociada al valor 1 P(X = 1) sería la probabilidad del suceso “sólo 1 de los 4 pacientes sobrevive a los 6 meses”, y así sucesivamente. En general, se distinguen dos grandes grupos de variables aleatorias: Variables aleatorias discretas son aquellas que presentan un número finito de valores (resultado de un dado) o que pueden tomar un número ilimitado de valores, por lo cual constituyen una sucesión numerable (cantidad de monedas que hay que lanzar hasta conseguir cara como resultado). Se describen indicando los valores que puede tomar y las probabilidades de cada uno de ellos (Función de probabilidad). Variables aleatorias continuas son aquellas que pueden tomar un número infinito de valores en un intervalo determinado. 03. Variables aleatorias y distribución de probabilidad 2 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Se describe mediante una función continua que representa cómo se distribuye la probabilidad (Función de densidad). Ejemplo 3.4 Variables aleatorias discretas: Número de accidentes laborales en una empresa (0, 1, 2,3,…, n) Número de células con cariotipo normal en una muestra (0, 1, 2,3,…) Variables aleatorias continuas: Concentración de mercurio en una muestra de tejido (mmol/l: (0, valormáx)) Peso (Kg.: (0, pesomáx)) Antes de adentrarnos en el mundo de las distribuciones de probabilidad vamos a recordar dos conceptos fundamentales en estadística, como son los términos estimador y parámetro. Como vimos en el primer tema, casi nunca se tiene acceso directo al estudio de toda la población y utilizamos sólo una muestra que procede de esta teórica población. En la muestra sólo se pueden calcular estimadores. Un estimador es una función de los valores de la muestra que poseemos, que permite obtener un valor aproximado (parámetro) de alguna característica de dicha población. Para los parámetros se suelen utilizar letras griegas1. MUESTRA POBLACIÓN Estimador Parámetro μ , σ2, σ x , s2,s Como ya vimos, la distribución de frecuencias de una variable venía dada por la frecuencia con que se observan realmente en la muestra estudiada cada uno de los posibles valores que podía tomar esa variable (representada en un histograma o en un diagrama de barras). En cambio, la distribución de probabilidad nos presenta el conjunto de todos los valores que teóricamente puede tomar una variable, junto con sus correspondientes probabilidades calculadas. La mayoría de las distribuciones de probabilidad son descritas por uno o más parámetros (media, varianza…). A veces en estadística, se asume que una muestra procede de una población que sigue una determinada distribución teórica de probabilidad. Cuando el método que usamos requiere que asumamos que los datos de una muestra pertenecen a una población con una distribución teórica conocida, suele decirse que dicho método es paramétrico. Es decir, se basa en los parámetros que definen esa distribución teórica. En el caso de no presuponer nada acerca de la distribución de la población, se utilizan los métodos no paramétricos. 1 Las letras griegas μ y σ, se leen mu y sigma, respectivamente. 03. Variables aleatorias y distribución de probabilidad 3 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública En general, se utilizan más los paramétricos, pero hay ocasiones en que si no queremos correr el riesgo de utilizar supuestos erróneos, es mejor recurrir a los no paramétricos. Volviendo al tema que nos ocupa, los tipos de distribución más utilizados y que vamos a ir desarrollando son: la distribución Binomial o la distribución de Poisson para variables discretas, y la distribución normal o de Gauss para variables continuas. 3.2 DISTRIBUCIONES DE PROBABILIDAD DISCRETAS Las variables aleatorias discretas toman un número discreto de valores con probabilidad no nula y, en consecuencia, estarán completamente caracterizadas si se conoce la probabilidad asociada a cada uno de estos valores. La función que asigna a cada posible valor xi, i = 1, 2,..., de la variable discreta X su probabilidad P(X = xi) se conoce como función de probabilidad f(xi). Esta función debe cumplir las siguientes propiedades: la probabilidad de cada valor ha de estar entre 0 y 1: 0 < P(X = xi) ≤ 1 la suma de las probabilidades para todos los valores debe ser igual a 1 La representación gráfica de la función de probabilidad se realiza mediante un diagrama de barras análogo al de distribución de frecuencias relativas para variables discretas. 40% 35% 30% 25% 20% 15% 10% 5% 0% 0 1 2 3 Figura 3.1. Número de caras al lanzar 3 monedas Otro concepto importante es el de función de distribución F(xi) de una v.a. discreta, se define como la probabilidad de que X tome un valor inferior o igual a xi: La función de distribución de una v.a. discreta será una función escalonada creciente con saltos en los valores xi con probabilidad no nula. 03. Variables aleatorias y distribución de probabilidad 4 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Ejemplo 3.5 Supongamos que por estudios previos se estima que, después de 6 meses de tratamiento en 4 pacientes con cáncer, la probabilidad de que sobrevivan 0, 1, 2, 3 ó 4 pacientes viene determinada por la segunda columna de la Tabla 3.1. Estos valores y sus probabilidades constituyen la función de probabilidad de la variable número de supervivientes, que se muestra en la Figura 3.2 (a). Los valores de la función de distribución en 0, 1, 2, 3 y 4 aparecen en la tercera columna de la Tabla 3.1: La función de distribución en 1 es F(1) = P(X ≤ 1) = P(X = 0) + P(X = 1) = 0,1296 + 0,3456 = 0,4752. La función de distribución de esta variable se representa en la Figura 3.2 (b). Notar que F(x) está definida sobre cualquier número real, aun cuando la variable tome sólo los valores 0, 1, 2, 3 y 4 con probabilidad no nula. Tabla 3.1. Función de probabilidad y función de distribución del nº de supervivientes a los 6 meses de 4 pacientes con cáncer sometidos a tratamiento Figura 3.2. Función de probabilidad (a) y función de distribución (b) del número de supervivientes a los 6 meses de 4 pacientes con cáncer sometidos a tratamiento. 03. Variables aleatorias y distribución de probabilidad 5 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Medidas de tendencia central y dispersión de v.a. En el tema de estadística descriptiva, se definieron la media y la varianza muestral como medidas de tendencia central y dispersión de una variable en una muestra. A continuación, se definen medidas análogas para la distribución poblacional de una variable aleatoria. La esperanza o media poblacional de una v.a. discreta X, denotada por μ o E(X), se define como la suma de los productos de cada valor xi por su probabilidad P(X = xi): La varianza poblacional de una v.a. discreta X, σ2 o var(X), se define como la esperanza del cuadrado de la desviación de la variable respecto de su media: Como podéis imaginar la raíz cuadrada de la varianza es la desviación típica poblacional σ, que representa la dispersión de la variable aleatoria respecto de su media poblacional. Ejemplo 3.6 A partir de los datos del ejemplo anterior, el valor esperado del número de supervivientes a los 6 meses de 4 pacientes con cáncer sometidos a tratamiento sería: y la varianza, Es decir, el número esperado de supervivientes a los 6 meses es 1,60 y la desviación típica σ = 0,98. 3.2.1 Distribución de Bernoulli Consiste en realizar un experimento aleatorio una sola vez y observar si cierto suceso ocurre o no, teniendo dos posibles resultados: X=1 (éxito, con probabilidad p) X=0 (fracaso, con probabilidad q=1-p) 03. Variables aleatorias y distribución de probabilidad 6 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Podríamos por tanto definir este experimento mediante una v.a. discreta X que toma los valores X = 0 si el suceso no ocurre, y X = 1 en caso contrario, y que se denota X≈Ber (p). Un ejemplo típico de este tipo de variables aleatorias consiste en lanzar una moneda al aire y considerar la v.a. X=”número de caras obtenidas” con probabilidad de éxito p=1/2 y q=1/2. Para una v.a. de Bernoulli, tenemos que su función de probabilidad es: En experimentos donde el resultado es dicotómico, la variable queda perfectamente determinada conociendo el parámetro p. Su valor esperado y su varianza poblacional quedan definidas por: E[X] = p y VAR[X] = p·(1-p) Ejemplo 3.7 Se ha observado estudiando 2000 accidentes de tráfico con impacto frontal y cuyos conductores no utilizaron cinturón de seguridad, que 300 individuos quedaron con secuelas. Por tanto la probabilidad de tener secuelas es 300/2000=0,15=15% y podríamos describir la siguiente v.a. de Bernoulli: X=“tener secuelas tras accidente sin usar cinturón” X=1 tiene probabilidad p ≈ 0,15 X=0 tiene probabilidad q ≈ 0,85 Se ha observado estudiando 2000 accidentes de tráfico con impacto frontal y cuyos conductores sí usaron cinturón de seguridad, que 10 individuos quedaron con secuelas. Por tanto la probabilidad de de quedar con secuelas 10/2000=0,005=0,5% y podríamos describir la siguiente v.a. de Bernoulli: X=“tener secuelas tras accidente usando cinturón” X=1 tiene probabilidad p ≈ 0,005 X=0 tiene probabilidad q ≈ 0,995 3.2.2 Distribución Binomial La distribución binomial es un modelo teórico de distribución de probabilidad discreta aplicable a aquellos experimentos en los que se realizan n pruebas independientes, cada una de ellas con sólo dos resultados posibles (éxito o fracaso) y la misma probabilidad de éxito p. Se dice que una v.a. X sigue una ley binomial de parámetros n y p, X≈B(n, p), si es la suma de n v.a. independientes de Bernoulli con el mismo parámetro, p: 03. Variables aleatorias y distribución de probabilidad 7 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Para una v.a. de Binomial, tenemos que su función de probabilidad 2 es: n f (k ) P[ X k ] p k q nk , 0 k n k El valor esperado y la varianza de esta variable son: E[X] = np , Var [X] = np(1-p) Ejemplos de este tipo variable son: Lanzar una moneda 10 veces y contar las caras: Bin(n=10,p=1/2) Lanzar una moneda 100 veces y contar las caras: Bin(n=100,p=1/2) Como con estos parámetros es difícil hacer cálculos, el modelo Normal será más adecuado. El número de personas que enfermará (en una población de 500.000 personas) de una enfermedad que desarrolla una de cada 2000 personas. Bin(n=500.000, p=1/2000) Como con estos parámetros es difícil hacer cálculo, el modelo de Poisson será más adecuado. Ejemplo 3.8 Retomamos el experimento consistente en observar la supervivencia en pacientes con un determinado cáncer sometidos al mismo tratamiento. Si por estudios previos se sabe que la supervivencia a los 6 meses en dichos pacientes es del 40%, el número de supervivientes a los 6 meses en una muestra de 4 pacientes seguirá una distribución binomial X de parámetros n = 4 y p = 0,4. Por ejemplo, podemos calcular la probabilidad de que sobrevivan 2 pacientes utilizando la función de probabilidad o utilizando las tablas de probabilidad (tabla 3.2) para la distribución Binomial. 2 En la práctica, resulta tedioso calcular las probabilidades de una distribución binomial mediante su función de probabilidad, los valores f (k) los podemos encontrar tabulados para ciertos valores pequeños de n, y ciertos valores usuales de p. 03. Variables aleatorias y distribución de probabilidad 8 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Tabla 3.2. Probabilidades para la distribución Binomial En consecuencia la probabilidad de que sobrevivan 2 pacientes es del 34,5% que corresponde a la distribución Binomial de parámetros n=4 y p=0.4, para k=2. 3.2.3 Distribución de Poisson o de los sucesos raros Una v.a. X posee una ley de distribución de probabilidades del tipo Poisson cuando: P[ X k ] e k k! , k 0,1,2,... Este tipo de leyes se aplican a sucesos con probabilidad muy baja de ocurrir. En general utilizaremos la distribución de Poisson como aproximación de experimentos binomiales donde el número de pruebas es muy alto, pero la probabilidad de éxito muy baja. Se suele utilizar como criterio de aproximación: Esta distribución queda caracterizada por un único parámetro (es a su vez su media y varianza): E [X] = VAR [X] = = n ·p Ejemplo 3.9 Cierta enfermedad tiene una probabilidad muy baja de ocurrir, p=1/100.000. Calcular la probabilidad de que en una ciudad con 500.000 habitantes haya más de 3 personas con dicha enfermedad. Calcular el nº esperado de habitantes que la padecen. Si consideramos la v.a. X=”número de personas que padecen la enfermedad”, vemos que sigue un modelo Binomial que puede ser muy bien aproximado por un modelo de Poisson: Bin (n=500.000, p=1/100.000) ≈ Poisson (=np=5) Así el número esperado de personas que padecen la enfermedad es E [X] = 5. 03. Variables aleatorias y distribución de probabilidad 9 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública La probabilidad de que haya más de tres personas enfermas es3: P[X>3] = 1 - P[X<3] = 1 - P[X=0] - P[X=1] - P[X=2] - P[X=3] = -5·0 =1–e -5·1 /0! - e -5·2 /1! - e -5·3 /2! - e /3! = 0.735 ≈ 73% La distribución de Poisson es otro modelo teórico de distribución discreta particularmente útil para el estudio epidemiológico de la ocurrencia de determinadas enfermedades. Se dice que la variable aleatoria X “número de casos de una determinada enfermedad a lo largo de un periodo de tiempo t”, donde t es un intervalo de tiempo arbitrariamente largo, sigue una distribución de Poisson. Ejemplo 3.10 Por término medio, en una determinada comunidad se producen 10 urgencias médicas por hora. ¿Qué probabilidad hay de que se produzcan 10 urgencias en una hora determinada? Podemos asumir que la variable X= “número de urgencias por hora” sigue una Poisson de parámetro 10, ya que la esperanza (promedio de muchas observaciones) coincide con el parámetro de la distribución. El dato de que se producen, por término medio, 10 urgencias en una hora puede utilizarse como argumento para escoger = 10. Por tanto: P X 10 e 10 1010 0,125 10! Luego existe un 12% de probabilidad de que se produzcan 10 urgencias en una hora determinada. 3.3 DISTRIBUCIONES DE PROBABILIDAD CONTINUAS Las variables aleatorias continuas son aquellas que pueden tomar cualquier valor dentro de un intervalo. La probabilidad de que estas variables tomen exactamente un valor determinado es 0, por tanto, para las variables aleatorias continuas, las probabilidades se asignan a intervalos de valores mediante una función de densidad de probabilidad, denotada por f(x). Esta función ha de ser no negativa para cualquier valor x, f(x) ≥ 0, y el área total bajo la curva definida por esta función de densidad debe ser igual a 1, Cuando la variable es continua, no tiene sentido hacer una suma de las probabilidades. Lo que generaliza de modo natural el concepto de suma es el de integral. 3 Al igual que en la distribución Binomial podemos utilizar las tablas de probabilidad existentes para la distribución de Poisson que podéis encontrar en muchos libros de estadística. 03. Variables aleatorias y distribución de probabilidad 10 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública A partir de la función de densidad, la probabilidad de que una variable aleatoria continua X tome valores dentro de cualquier intervalo (a, b) puede calcularse como el área bajo la función de densidad entre los puntos a y b: Figura 3.3. La probabilidad de un intervalo, es el área que existe entre la función y el eje de abscisas. La función de distribución F(x) corresponde a la probabilidad de que la variable tome un valor igual o inferior a x y, en el caso de una variable aleatoria continua, se calcula como el área bajo de la curva de la función de densidad a la izquierda de x. De forma más sencilla, la función de distribución F(x) es la función que asocia a cada valor de una variable, la probabilidad acumulada de los valores inferiores o iguales. Figura 3.4. Función de distribución F, calculada a partir de la función de densidad f(x). Como podemos ver en la figura 3.4, a los valores extremadamente bajos les corresponden valores de la función de distribución cercanos a 0, mientras que a los valores extremadamente altos les corresponden valores de la función de distribución cercanos a 1. Por tanto, es una función que, partiendo de 0, crece de forma continua hasta alcanzar el valor 1. 03. Variables aleatorias y distribución de probabilidad 11 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Aunque os pueda parecer complicado, el concepto de función de distribución lo encontraremos en artículos en forma de “p-valor”, significación,… y si lo pensáis con detenimiento está muy relacionada con la idea de cuantil que vimos en tema anterior. Por ejemplo si contrastamos lo anómalo de una observación concreta: Sé que una persona de altura 210 cm es “anómala” porque la función de distribución en 210 es muy alta. Sé que una persona adulta que mida menos de 140 cm es “anómala” porque la función de distribución es muy baja para 140 cm. Sé que una persona que mida 170 cm no posee una altura nada extraña pues su función de distribución es aproximadamente 0,5. Ejemplo 3.11 La función de densidad para el colesterol HDL en hombres adultos se representa en la Figura 3.5(a). Notar que, aunque el área bajo la curva ha de ser igual a 1, la función de densidad puede tomar valores superiores a 1. Los niveles de colesterol HDL próximos a 1 mmol/l son los que tienen mayor probabilidad de ocurrir, mientras que para niveles inferiores y superiores esta probabilidad decrece. Así, por ejemplo, la probabilidad de que un hombre adulto tenga un nivel de colesterol HDL inferior a 0,90 mmol/l (niveles bajos según las recomendaciones del “National Cholesterol Education Program”) corresponde al área sombreada bajo la curva a la izquierda de 0,90 mmol/l y es igual a P(X ≤ 0,90) = 0,3274. Esta probabilidad también puede obtenerse a partir de la función de distribución del colesterol HDL, que se representa en la Figura 3.5 (b). Esta función presenta el aspecto característico de las funciones de distribución para variables continuas aproximadamente simétricas. Figura 3.5. Función de densidad (a) y función de distribución (b) del colesterol HDL en hombres adultos La esperanza o media poblacional de una v.a. continua se define a partir de su función de densidad f(x) como sigue: 03. Variables aleatorias y distribución de probabilidad 12 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública La varianza poblacional de una variable aleatoria continua es la esperanza de las desviaciones al cuadrado de los valores de la variable respecto de su media: La raíz cuadrada de la varianza es la desviación típica poblacional σ, que representa la dispersión de la variable aleatoria respecto de su media poblacional. Existen muchos modelos teóricos de distribuciones continuas, cada una de ellas caracterizada por una fórmula o expresión concreta para la función de densidad. A continuación detallamos la distribución normal, que es la utilizada con mayor frecuencia en estadística. Otras distribuciones continuas, como la t de Student, chi-cuadrado o F de Snedecor, nos irán apareciendo a lo largo del módulo. 3.3.1 Distribución Normal o Gaussiana La distribución Gaussiana, recibe también el nombre de distribución Normal, ya que una gran mayoría de las v.a. continuas4 de la naturaleza siguen esta distribución. Es el modelo teórico de distribución continua más utilizado en la práctica. Muchas mediciones epidemiológicas y clínicas presentan distribuciones similares al modelo teórico normal (presión arterial, colesterol sérico, índice de masa corporal) o bien pueden transformarse para conseguir distribuciones aproximadamente normales (típicamente mediante transformaciones logarítmicas de los datos originales). No obstante, como se verá en los temas posteriores, la utilidad fundamental de la distribución normal surge dentro de las técnicas de inferencia estadística: incluso cuando la distribución poblacional de una variable diste mucho de ser normal, puede probarse que, bajo ciertas condiciones, la distribución de los valores medios5 de dicha variable seguirá un modelo aproximadamente normal. Una variable aleatoria continua X sigue una distribución normal si su función de densidad es para cualquier valor x en la recta real: f ( x) 4 5 1 e 2 1 x 2 2 Incluso v.a discretas pueden ser aproximadas por la ley gaussiana. Teorema central de límite. 03. Variables aleatorias y distribución de probabilidad 13 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Esta función de densidad depende de los parámetros μ y σ, donde μ representa la esperanza o media poblacionales de la distribución y σ corresponde a su desviación típica poblacional. La distribución normal o Gaussiana con media μ y varianza σ2 se denota por N(μ, σ2). La forma de la función de densidad es la llamada campana de Gauss. Figura 3.6. Función de densidad de una v.a. de distribución normal. El parámetro μ indica el centro y σ la dispersión. La distancia del centro a los puntos de inflexión es precisamente σ. Algunas características de la distribución Normal son: La función de densidad es simétrica, mesocúrtica y unimodal (Media, mediana y moda coinciden) Los puntos de inflexión de la función de densidad están a distancia σ de μ. Si tomamos intervalos centrados en μ, y cuyos extremos están… a distancia σ, tenemos probabilidad 68% a distancia 2 σ, tenemos probabilidad 95% a distancia 2’5 σ, tenemos probabilidad 99% 03. Variables aleatorias y distribución de probabilidad 14 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Figura 3.7. A una distancia que no supera en una desviación de la media tenemos una probabilidad del 68 %. A dos desviaciones tenemos el 95 %. La distribución normal con media 0 y desviación típica 1 se denomina distribución normal tipificada o estandarizada, y suele denotarse por Z o N(0, 1). Asigna a todo valor de N(μ, σ), un valor de N(0,1) que deja exactamente la misma probabilidad por debajo. Nos permite así comparar entre dos valores de dos distribuciones normales diferentes, para saber cuál de los dos es más extremo. Figura 3.8. Función de densidad (a) y función de distribución (b) de una variable aleatoria Normal estandarizada. Para obtener las probabilidades bajo la función de densidad normal estandarizada, no se recurre al cálculo integral, ya que estas probabilidades están tabuladas. En general, estas tablas facilitan la función de distribución Ф(z) = P(Z ≤ z)6, es decir, la probabilidad de que la variable normal estandarizada tome un valor igual o inferior a z. Ejemplo 3.12 6 Para valores z negativos, Φ(z) = P(Z ≤ z) = P(Z ≥ – z) = 1 – P(Z ≤ – z) = 1 – Φ(– z) 03. Variables aleatorias y distribución de probabilidad 15 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública La probabilidad de obtener un valor inferior a 0,50 en una distribución normal estandarizada se obtiene directamente de la Tabla 3.3 como el valor de la función de distribución en 0,50; es decir, P (Z ≤ 0,50) = F(0,50) = 0,6915. Tabla 3.3. Función de distribución normal estandarizada Φ (z) = P (Z ≤ z) Asimismo, aunque en la Tabla 3.3. no aparecen las probabilidades acumuladas para valores negativos, la probabilidad de obtener un valor inferior a -0,25 en una distribución normal estandarizada puede calcularse fácilmente. Como la distribución normal estandarizada es simétrica alrededor de 0, la probabilidad a la izquierda de -0,25 es igual a la probabilidad a la derecha de 0,25, por tanto: P (Z ≤ – 0,25) = P (Z ≥ 0,25) = 1 – P (Z ≤ 0,25) = 1 – F (0,25) = 1 – 0,5987 = 0,4013. A partir de los resultados anteriores, la probabilidad de que un valor de la distribución normal estandarizada se encuentre entre – 0,25 y 0,50 viene dada por: P (– 0,25 ≤ Z ≤ 0,50) = P (Z ≤ 0,50) – P (Z ≤ – 0,25) = 0,6915 – 0,4013 = 0,2902. Un resultado que será particularmente útil en los temas de inferencia estadística es el percentil 97,5 de una distribución normal estandarizada, z0.975, valor z que deja por debajo una probabilidad del 0,975. De la Tabla 3.3, se tiene que F (1,96) = 0,9750 y, por tanto, z0,975 = 1,96. Por tratarse de una distribución simétrica en 0, el percentil 2,5 corresponde al percentil 97,5 con signo opuesto; es decir, el percentil 2,5 es z0.025 = -z0.975 = -1,96. 03. Variables aleatorias y distribución de probabilidad 16 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Así, los valores ± 1,96 abarcan el 95% central de la distribución normal estandarizada. Ejemplo 3.13 Supongamos que el colesterol HDL en una población de hombres adultos sigue una distribución normal X con media μ = 1,10 mmol/l y desviación típica σ = 0,30 mmol/l. Utilizando la estandarización de variables normales, el porcentaje de hombres de esta población que tienen niveles de colesterol HDL entre 0,90 y 1,20 mmol/l corresponde a Utilizando la tabla: P(Z ≤ 0,33) = F(0,33) = 0,6293 P (Z ≤ -0,67) = F (-0,67) = 1 – F (0,67) = 1 – 0,7486 = 0,2514. Así, resulta que P (0,90 ≤ X ≤ 1,20) = 0,6293 – 0,2514 = 0,3779; es decir, el 37,79% de los hombres de esta población tienen niveles de colesterol HDL entre 0,90 y 1,20 mmol/l. Aproximación a la normal de la ley binomial Se demuestra que una v.a. discreta X con distribución binomial, X≈ Bin(n, p) se puede aproximar mediante una distribución normal si n es suficientemente grande y p no está ni muy próximo a 0 ni a 1. Como el valor esperado y la varianza de X son respectivamente np y np(1-p), la aproximación consiste en decir que X≈ N(np, np(1-p)). 03. Variables aleatorias y distribución de probabilidad 17 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública El convenio que se suele utilizar para poder realizar esta aproximación es: Ejemplo 3.14 La probabilidad de obtener entre 12 y 14 éxitos sobre un total de 100 pruebas con una probabilidad individual de éxito del 0,10 se obtiene a partir de la distribución binomial X con parámetros n = 100 y p = 0,10. Como el cálculo utilizando la función de probabilidad de la distribución binomial es muy laborioso y se cumplen las condiciones para poder utilizar una aproximación a la distribución normal Y ≈ N (np, np(1-p)) ≈ N(10, 9) tenemos que: La distribución normal también puede emplearse como aproximación a la distribución de Poisson cuando el número esperado de casos es moderadamente grande. 3.4 TEOREMA CENTRAL DEL LÍMITE Como hemos comentado anteriormente puede probarse que, bajo ciertas condiciones, la distribución de los valores medios de una v.a. continua seguirá un modelo aproximadamente normal. Independientemente de la forma de la variable aleatoria en la población, la distribución de las medias muestrales tiende a seguir una distribución normal, particularmente cuando aumenta el tamaño de la muestra. Este es el núcleo de muchos métodos estadísticos y se conoce como teorema central del límite: Para cualquier variable aleatoria X con media μ y varianza σ2, la distribución de las medias en muestras aleatorias simples de tamaño n se aproxima, al aumentar el tamaño muestral, a una distribución normal con media μ y varianza σ2/n; es decir 03. Variables aleatorias y distribución de probabilidad 18 - 19 Diplomado en Salud Pública 2. Metodología en Salud Pública Este teorema justifica la importancia de la distribución normal: “Sea lo que sea lo que midamos, cuando se promedie sobre una muestra grande nos va a aparecer de manera natural la distribución normal”. Cuanto más grande sea la muestra, mejor se cumple este teorema. Por encima de 60 individuos la adaptación de la distribución muestral de estimadores a la distribución normal es muy buena. Entre 30 y 60 es aceptable. Por debajo de 30 individuos en la muestra empiezan a aparecer problemas. En los temas de inferencia estadística veremos diversos test para comprobar si los valores de una variable siguen o no la distribución normal. El teorema central del límite constituye la base fundamental del proceso de inferencia estadística, dado que posibilita tanto la construcción de intervalos de confianza como el contraste de hipótesis acerca de la media poblacional μ. 03. Variables aleatorias y distribución de probabilidad 19 - 19