caso 2 determinantes y consecuencias de la satisfacción del cliente

Anuncio

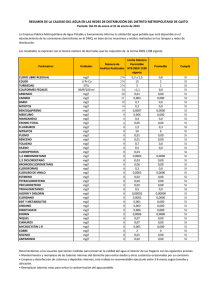

CASO 2 DETERMINANTES Y CONSECUENCIAS DE LA SATISFACCIÓN DEL CLIENTE Adaptado de Fornell, Johnson, Anderson, Cha y Bryant (1996) En el trabajo de Fornell, Johnson, Anderson, Cha y Bryant (1996), se plantea, tal y como se ilustra en la figura 1, que la satisfacción del cliente tiene sus antecedentes en la calidad percibida en la prestación del servicio, sus expectativas y el valor percibida (relación entre la calidad y el precio). Un cliente satisfecho, desde la perspectiva de las consecuencias, será un cliente que se quejará menos y más leal. La mencionada figura 1 sintetiza las relaciones mencionadas. En este mismo trabajo, los autores describen los indicadores utilizados para medir cada uno de los conceptos implicados que se han recogido en el cuadro 1. 1 El fichero con formato Excel delimitado por comas ecsi.csv contiene la información del mencionado estudio para el caso europeo (las variables son las mismas, con la única diferencia de que en lugar de 3 indicadores para la calidad percibida, hay un total de 7. Se pide: 1. Tomar el fichero de datos ecsi.csv 2. Dibujar el modelo con la asignación de variables manifiestas a latentes de la figura 2 (equivalente de SmartPLS para la figura 1) 3. Evaluar si el tamaño de la muestra permite, a priori, la utilización de PLS 4. Analizar la fiabilidad y validez del instrumento de medida, obteniendo la significatividad de los parámetros mediante bootstrapping 5. Evaluar el modelo structural 6. Escribir los resultados tal y como se trasladarían a un artículo 2 Figu ura 2. Graffo de SmartPLS paraa el modelo o ACSI Refe ferencias Forn nell, C., Joohnson, M.D., M Andeerson, E.W W., Cha, J. y Bryantt, B.E. (1996). “The Am merican Cu ustomer Saatisfacion Index: Naature, purp pose, and findings”. Jou urnal of Marketing, M 6 (Octubrre), 7-18 60 3 Solución El paso inicial es valorar si se cuenta con tamaño muestral suficiente para estimar el modelo propuesto con PLS. En realidad lo que se pretende es reflexionar críticamente sobre la regla genérica de los 10 casos y se trabaje en términos de potencia de la prueba. Dado que nuestro tamaño muestral es de 250 casos, el resultado va a ser obviamente satisfactorio, pero al menos ilustraremos la forma en que hay que abordar esta cuestión. Si revisamos la figura 2, vemos que todos los constructos son reflectivos, por lo que el condicionante va a ser cuál es el mayor número de relaciones causales antecedentes de un constructo dependiente. En la misma figura 2 observamos que es la satisfacción el constructo dependiente que recibe más relaciones causales (3), por lo que, teóricamente, PLS debería funcionar bien con 3×10=30 casos. Como insistimos durante el seminario, esta rule of thumb no puede soslayar la necesidad de realizar un análisis de potencia (probabilidad de rechazar la hipótesis nula cuando es falsa), puesto que no son admisibles valores inferiores al 80% en ciencias sociales. Si utilizamos el software que recomendamos (G*Power), vemos que para una regresión con 3 regresores, para alcanzar una potencia del 80% con un efecto de tamaño medio (f 2=.15), hacen falta 77 casos (ver también figura 3). Obviamente para un modelo como el descrito el tamaño muestral es muy inferior a lo que sería necesario para un MEC, pero superior a 30 casos. G*Power nos permite también, no sólo calcular la muestra necesaria para un nivel de potencia determinado, sino también qué potencia conseguimos con la muestra actual (250 casos). La potencia efectiva sería del 99.9%. Figura 3. Análisis de potencia 4 Constatado que tenemos un tamaño muestral suficiente para una potencia de la prueba razonable, el paso siguiente es la estimación del modelo, previo tratamiento de los valores perdidos si los hubiera (no es el caso). Las etapas son las mismas que en un MEC, por lo que no las volveremos a describir, centrándonos en los resultados: 1. Validación del instrumento de medida: a. Validez convergente b. Validez discriminante 2. Evaluación del modelo estructural: a. R cuadrados b. Relevancia predictiva c. Significatividad de las relaciones estructurales (bootstrapping) Validez convergente Los criterios son los mismos que los empleados en los MEC, fijarnos en el tamaño de las cargas y en su significatividad. Lo que ocurre es que para calcular la significatividad, hay que llevar a cabo el bootsrapping por lo que primero eliminaremos las cargas pequeñas sin hacerlo y luego ya veremos si alguna de las que hemos dejado no fuera significativa Cuadro 1. Validez convergente: tamaño de las cargas CUEX1 CUEX2 CUEX3 CUSA1 CUSA2 CUSA3 CUSCO CUSL1 CUSL2 CUSL3 PERQ1 PERQ2 PERQ3 PERQ4 PERQ5 PERQ6 PERQ7 PERV1 PERV2 Vemos Complaints Expectation Loyality Quality Satisfaction 1,0000 0,7778 0,6652 0,6258 0,7918 0,8483 0,8561 0,8134 0,2036 0,9200 0,8034 0,6382 0,7837 0,7693 0,7546 0,7745 0,7799 0,9022 0,9396 Value que la única carga que no cumple el criterio de Bagozzi y Yi (1988) de ser superior a .60 es el segundo indicador de lealtad del consumidor (CUSL2), por lo que lo eliminaríamos y volveríamos a realizar la estimación (cuadro 2). 5 Cuadro 2. Validez convergente: tamaño de las cargas, estimación final CUEX1 CUEX2 CUEX3 CUSA1 CUSA2 CUSA3 CUSCO CUSL1 CUSL3 PERQ1 PERQ2 PERQ3 PERQ4 PERQ5 PERQ6 PERQ7 PERV1 PERV2 Complaints 1,0000 Expectation 0,7778 0,6652 0,6258 Loyality Quality Satisfaction 0,7924 0,8482 0,8557 0,8223 0,9238 0,8034 0,6382 0,7837 0,7693 0,7546 0,7745 0,7799 Value 0,9022 0,9396 A expensas de comprobar que todas las cargas son significativas cuando realicemos el bootstrapping, el paso siguiente es la constatación de la fiabilidad mediante los criterios disponibles: fiabilidad compuesta, varianza extraída promedio y α de Cronbach. A diferencia de los MEC, SmartPLS nos da directamente esta información (Cuadro 3), lo que nos evita tener que realizar manualmente los cálculos. Vemos que todos los constructos tienen niveles razonables de fiabilidad atendiendo a estos indicadores. El único que plantea alguna duda es el constructo expectativas dado que, aunque su AVE es prácticamente .50 y su fiabilidad compuesta adecuada (.73), su α de Cronbach es baja (.4519). Entendemos que la información conjunta de los 3 indicadores nos debe llevar a su mantenimiento, a no ser que la significatividad de algún ítem sea cuestionable en el análisis posterior. Dado que no contamos en PLS con el test de los multiplicadores de Lagrange para evaluar si algún indicador puede tener una fuerte carga sobre constructos diferentes para los que se diseñó, una alternativa razonable es evaluar las cargas cruzadas (con en un factorial exploratorio) para determinar si la carga de cada indicador es más alta en el constructo para el que se creó que para otro (cuadro 4). Tampoco aquí apreciamos problema alguno. Finalmente, la realización de un bootsrapping para 500 submuestras de un tamaño igual al de la muestra original (250 casos) lleva al resultado que recoge el cuadro 5. Que nadie se sorprenda si al realizar por su cuenta el ejercicio, los valores t son distintos. Debe recordarse que las submuestras se eligen aleatoriamente cada vez que se realiza el bootstrapping por lo que cada vez serán distintas. Lo que no debería ocurrir es que variables significativas dejaran de serlo y viceversa. En el cuadro 5 se comprueba que todas las cargas son significativas. El conjunto de pruebas realizadas nos permite afirmar la validez convergente del instrumento de medida. 6 Cuadro 3. Validez convergente: indicadores de fiabilidad Complaints Expectation Loyality Quality Satisfaction Value AVE Composite R Square Cronbachs Communality Redundancy Reliability Alpha 1,0000 1,0000 0,2785 1,0000 1,0000 0,2785 0,4797 0,7328 0,4519 0,4797 0,7648 0,8663 0,4369 0,7027 0,7648 0,0485 0,5766 0,9047 0,3117 0,8770 0,5766 0,1788 0,6932 0,8713 0,6671 0,7792 0,6932 0,0526 0,8484 0,9180 0,3455 0,8236 0,8484 0,0305 Cuadro 4. Validez convergente: cargas cruzadas CUEX1 CUEX2 CUEX3 CUSA1 CUSA2 CUSA3 CUSCO CUSL1 CUSL3 PERQ1 PERQ2 PERQ3 PERQ4 PERQ5 PERQ6 PERQ7 PERV1 PERV2 Complaints ‐0,1831 ‐0,2245 ‐0,1258 ‐0,3338 ‐0,4160 ‐0,5475 1,0000 ‐0,2373 ‐0,4479 ‐0,3801 ‐0,3004 ‐0,4721 ‐0,3790 ‐0,3890 ‐0,4180 ‐0,4654 ‐0,2874 ‐0,3598 Expectation 0,7778 0,6652 0,6258 0,4907 0,3976 0,3900 ‐0,2554 0,2920 0,3544 0,5176 0,3211 0,4352 0,3890 0,4190 0,4443 0,4185 0,3145 0,3532 Loyality Quality Satisfaction 0,2726 0,4360 0,3713 0,3122 0,3480 0,3644 0,1926 0,3695 0,3185 0,5091 0,6423 0,7924 0,4960 0,6698 0,8482 0,6233 0,6739 0,8557 ‐0,4113 ‐0,5316 ‐0,5278 0,8223 0,3940 0,4557 0,9238 0,5338 0,6632 0,4838 0,8034 0,6791 0,3668 0,6382 0,4891 0,4650 0,7837 0,6455 0,3734 0,7693 0,5999 0,3758 0,7546 0,5235 0,3446 0,7745 0,5486 0,4444 0,7799 0,6996 0,4152 0,4736 0,4875 0,5360 0,5946 0,6200 7 Value 0,2943 0,1797 0,2745 0,4113 0,4916 0,5987 ‐0,3551 0,4128 0,4944 0,4696 0,3079 0,4736 0,3949 0,4649 0,4107 0,5535 0,9022 0,9396 Cuadro 5. Validez convergente: significatividad de las cargas CUEX1 <‐ Expectation CUEX2 <‐ Expectation CUEX3 <‐ Expectation CUSA1 <‐ Satisfaction CUSA2 <‐ Satisfaction CUSA3 <‐ Satisfaction CUSCO <‐ Complaints CUSL1 <‐ Loyality CUSL3 <‐ Loyality PERQ1 <‐ Quality PERQ2 <‐ Quality PERQ3 <‐ Quality PERQ4 <‐ Quality PERQ5 <‐ Quality PERQ6 <‐ Quality PERQ7 <‐ Quality PERV1 <‐ Value PERV2 <‐ Value Original Sample (O) 0,7778 0,6652 0,6258 0,7924 0,8482 0,8557 1,0000 0,8223 0,9238 0,8034 0,6382 0,7837 0,7693 0,7546 0,7745 0,7799 0,9022 0,9396 Sample Mean (M) Standard Deviation (STDEV) 0,7769 0,0510 0,6657 0,0912 0,6187 0,0747 0,7932 0,0286 0,8471 0,0216 0,8560 0,0181 1,0000 0,0000 0,8165 0,0449 0,9250 0,0094 0,8029 0,0261 0,6350 0,0493 0,7839 0,0284 0,7700 0,0441 0,7507 0,0389 0,7766 0,0573 0,7793 0,0304 0,9011 0,0196 0,9395 0,0074 8 Standard Error (STERR) 0,0510 0,0912 0,0747 0,0286 0,0216 0,0181 0,0000 0,0449 0,0094 0,0261 0,0493 0,0284 0,0441 0,0389 0,0573 0,0304 0,0196 0,0074 T Statistics (|O/STERR|) 15,2391 7,2935 8,3756 27,6834 39,2566 47,2900 0,0000 18,2986 98,3154 30,7462 12,9578 27,6335 17,4442 19,3768 13,5099 25,6771 46,0747 126,1607 Validez discriminante Cuando se trataba de evaluar la validez discriminante de un MEC, disponíamos de tres criterios, pero dos de ellos no son aplicables: no podemos calcular un intervalo de confianza alrededor de la estimación de la correlación entre cada par de factores, y dado que PLS no calcula un ajuste global, no disponemos de la c2 para la prueba de la diferencia entre la del modelo de medida y la que se obtiene fijando a 1 la covarianza entre los factores problemáticos. La única alternativa que nos resta es, pues, la de comparar el cuadrado de la correlación entre cada par de factores con la varianza extraída de ambos, tal y como explicamos en el caso anterior. La ventaja de SmartPLS es que nos proporciona tanto la matriz como los AVE. Por comodidad, más que calcular el cuadrado de las correlaciones, que son muchas, vale la pena comparar la correlación que nos viene dada directamente con la raíz cuadrada del AVE (que son menos a calcular), tal y como mostramos en el cuadro 6. La matriz marcada en rojo no la proporciona el programa, sino que es el resultado de juntar las dos piezas de información anteriores. Podemos comprobar cómo ningún valor de la diagonal es inferior a los contenidos en su fila y columna, quedando constatada la validez discriminante. Cuadro 6. Validez discriminante Complaints Expectation Loyality Quality Satisfaction Value Complaints Expectation Loyality Quality Satisfaction Value Complaints Expectation Loyality Quality Satisfaction Value Complaints 1,0000 ‐0,2554 ‐0,4113 ‐0,5316 ‐0,5278 ‐0,3551 Expectation 1,0000 0,3730 0,5583 0,5072 0,3641 AVE 1 0,4797 0,7648 0,5766 0,6932 0,8484 RCUAD(AVE) 1,00 0,69 0,87 0,76 0,83 0,92 Complaints 1,0000 ‐0,2554 ‐0,4113 ‐0,5316 ‐0,5278 ‐0,3551 Expectation 0,69 0,3730 0,5583 0,5072 0,3641 9 Loyality Quality Satisfaction 1,0000 0,5409 1,0000 0,6566 0,7949 1,0000 0,5228 0,5862 0,6082 Value 1,0000 Loyality Quality Satisfaction 0,87 0,5409 0,76 0,6566 0,7949 0,83 0,5228 0,5862 0,6082 Value 0,92 Evaluación del modelo estructural Recordemos PLS no tiene indicadores de ajuste global, porque no se ajusta una matriz de varianzas covarianzas teórica con una matriz muestral. Sin embargo, igual que en los MEC hasta que no obteníamos un buen ajuste no entrábamos a valorar la significatividad de las relaciones estructurales, en PLS nos encontramos con una necesidad similar. Hasta que no estemos seguros de que nuestro modelo tiene una capacidad razonable para explicar las variables dependientes que lo integran, no deberíamos entrar a valorar las significatividad o no de las relaciones estructurales. Esta valoración hay que realizarla viendo si estamos explicando una parte relevante de la varianza de las variables dependientes a través de las R2. Pero, ¿cuándo esta R2 es suficiente? Como vimos durante el seminario, el criterio de Falk y Miller (1992) de que sea al menos igual a .10 no deja de ser un criterio arbitrario. Por eso nosotros recomendamos complementarlo con una prueba de potencia de la prueba. En el ejemplo que estamos desarrollando, el cuadro 3 ya mostraba que todas las R2 eran superiores a .10. Pero, ¿cuál es el R2 mínimo que puede considerarse como razonable para una potencia del 80%, dado el tamaño muestral y el número de regresores de cada constructo dependiente? El cuadro 7 nos muestra que en el peor de los casos (5 regresores, aún cuando sabemos que ninguna variable dependiente recibe más de 3) y para un tamaño muestral de 250 casos el mínimo R2 sería del 5%, claramente superado, como se vió en el cuadro 3 por nuestros resultados. Sin embargo debe observarse que este tamaño se incrementa muy sustancialmente cuando cae el tamaño muestral, que es una de las situaciones habituales en que recurrimos a PLS. Cuadro 7. Tamaño mínimo requerido de la R2 Fuente: Hair, Black, Babin, Anderson y Tatham (2006; p.195) 10 Una alternativa cada vez más utilizada a la única consideración de la R2, es el criterio de relevancia predictiva Q2 de Stone (1974) y Geisser (1975). Como su desarrollo ya se ofreció en la teoría, simplemente recordar que existe relevancia predictiva en el constructo dependiente considerado, cuando el estadístico Q2 es positivo. El cuadro 8 muestra que, en nuestro ejercicio, todas las Q2 son positivas. Cuadro 8. Relevancia predictiva: criterio de Stone-Geisser Total Complaints Loyality Quality Satisfaction Value SSO 250 500 1750 750 500 SSE 180,8647 340,5139 1484,7052 416,2483 358,3749 1‐SSE/SSO 0,2765 0,3190 0,1516 0,4450 0,2833 Constatada la relevancia predictiva, ya se puede dar el paso final de comprobar qué relaciones son o no significativas y el tamaño de las mismas. El primer paso es tomar del bootstrapping que se realizó para determinar la significatividad de las cargas factoriales, el resultado de la significatividad de las relaciones estructurales (cuadro 9). El cuadro 10 muestra, además, los coeficientes de regresión estandarizados. De los resultados se puede constatar que no son significativos los efectos de las quejas sobre la lealtad ni de las expectativas sobre el valor, todas las demás sí son significativas. No vamos a entrar en el contenido de los resultados, ni tampoco a mostrar cómo se escribiría en un artículo el proceso de validación ni los resultados, pues en ambos casos lo haríamos de manera idéntica a cómo lo hicimos en el caso del MEC. Simplemente, a modo de síntesis de los resultados, los ilustramos en la figura 4. 11 Cuadro 9. Significatividad de las relaciones estructurales Original Sample (O) Sample Mean (M) Standard Deviation (STDEV) Complaints ‐> Loyality ‐0,0899 ‐0,0912 0,0623 Expectation ‐> Quality 0,5583 0,5635 0,0513 Expectation ‐> Satisfaction 0,0809 0,0830 0,0474 Expectation ‐> Value 0,0535 0,0589 0,0773 Quality ‐> Satisfaction 0,6253 0,6234 0,0555 Quality ‐> Value 0,5563 0,5532 0,0798 Satisfaction ‐> Complaints ‐0,5278 ‐0,5297 0,0544 Satisfaction ‐> Loyality 0,6091 0,6075 0,0631 0,2122 0,2129 0,0605 Value ‐> Satisfaction Cuadro 10. Relaciones estructurales: coeficientes estandarizados Complaints Expectation Loyality Quality Satisfaction Value Complaints Expectation ‐0,5278 Loyality Quality ‐0,0899 0,5583 0,6091 12 Satisfaction Value 0,0809 0,0535 0,6253 0,5563 0,2122 Standard Error (STERR) 0,0623 0,0513 0,0474 0,0773 0,0555 0,0798 0,0544 0,0631 0,0605 T Statistics 1,4426 10,8885 1,7046 0,6928 11,2662 6,9669 9,7063 9,6525 3,5074 13 Figura 4. Síntesis de los resultados obtenidos. R2=.311 R2=.278 Perceived Quality Customer complaints .556** R2=.667 -.528** R2=.345 Perceived Value .558 .212** Customer satisfaction -.089 .625 .053 .080* Customer expectation Customer loyalty R2=.436 Referencias Bagozzi R.P. y Yi, Y. (1988). “On the evaluation of structural equation models”. Journal of the Academy of Marketing Science, 16 (1), pp.74-94. Falk, R.F. y Miller, N.B. (1992). A primer for soft modeling. Akron, OH: University of Akron Press. Fornell, C., Johnson, M.D., Anderson, E.W., Cha, J. y Bryant, B.E. (1996). “The American Customer Satisfacion Index: Nature, purpose, and findings”. Journal of Marketing, 60 (Octubre), 7-18 Geisser, S. (1975). “The predictive sample reuse method with applications”. Journal of the American Statistical Association, 70, 320-328 Hair, J.H., Black, W.C., Babin, B.J., Anderson, R.E. y Tatham, R. L. (2006). Multivariate Data Analysis. 6 Ed. Upper Saddle River, NJ: Prentice Hall. Stone, M. (1974). “Cross validatory choice and asessment of statistical predictions”. Journal of the Royal Statistical Society, Series B, 36 (2), 111-113. 14