orientación externa automática

Anuncio

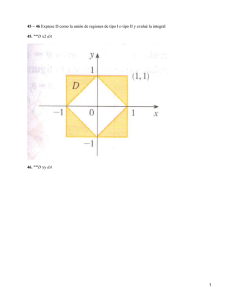

ORIENTACIÓN EXTERNA AUTOMÁTICA 1. GENERALIDADES Esta clase de orientación es también conocida como orientación absoluta, donde el problema que se trata de resolver es el de establecer una relación entre el espacio de la imagen y el espacio objeto. Para este problema lo que se trata de establecer una relación entre los dos tipos de coordenadas, que generalmente se la conseguía con puntos de apoyo o puntos de control. Si se decide utilizar puntos de apoyo se ha visto que en la fotogrametría tradicional a dado buenos resultados así también en la fotogrametría digital interactiva donde se puede identificar los puntos de apoyo que además se pueden medir. Es necesario recalcar que estos puntos no están físicamente en la imagen, y que en realidad son blancos, donde la parte más difícil es que se haga una identificación automática de estos puntos. Dentro de esto veremos los problemas de las características lineales como superficiales, ya que en la orientación externa se determina un espacio paramétrico entre los pares de puntos en la imagen y el espacio objeto, tratando de conseguir una igualdad entre las características de la imagen y el espacio objeto. Donde las superficies conocidas en el espacio objeto pueden venir de un MDT. Lo que se trata de conseguir en la orientación externa automática es una cadena de automatización como en el siguiente esquema: 2. COMPARACIÓN ENTRE ORIENTACIÓN DIRECTA E INDIRECTA Uno de los aspectos de la orientación directa es que son capaces de medir la posición del centro perspectivo de una cámara aérea (orientación externa), donde consiguen una precisión que permite la orientación directa de los fotogramas aéreos (esto quiere decir de todas las fotos). Los sistemas se basan en una combinación de GPS y de medidas inerciales (donde todo esta en reposo), este tipo de orientación a sido exitosa por ejemplo en teledetección. En realidad, estos sistemas dependen completamente de la orientación directa, ya que no tiene otra alternativa para determinar la orientación externa del sensor. Esto es distinto en fotogrametría, donde la orientación externa de la cámara se obtiene indirectamente a través de una intersección inversa espacial. Gracias a los últimos avances los sistemas de orientación directa consiguen precisiones en los parámetros de orientación que pueden compararse con los parámetros obtenidos con los métodos indirectos de orientación. La orientación es un buen ejemplo, este es un requisito previo imprescindible para todos los procesos subsiguientes, como la restitución o reconstrucción de superficies y el reconocimiento de objetos. La restitución de puntos requiere la orientación interna y la externa. Con la restitución se quiere indicar el cálculo de puntos y características o detalles en el espacio objeto, a partir de las medidas de los mismos en el espacio imagen. Para ilustrar la diferencia entre los dos métodos de orientación con respecto a la restitución, se usara el sencillo ejemplo de un par estereoscopio. Fig. 1 La Fig. 1 ilustra la restitución del punto P en el espacio objeto a partir de los puntos imagen homólogos P’ y P”, la orientación externa define la posición de los centros de proyección C’ y C”, así como la dirección de los ejes de la cámara, para esto se debe tener la orientación interna de la cámara para obtener la dirección de los rayos homólogos. La orientación interna se define por el punto principal PP, la distancia focal calibrada c, la curva de distorsión radial y el origen de la distorsión radial PS (punto de mejor simetría). Veremos ahora la restitución del punto P en los casos de orientación directa e indirecta, considerando distintas situaciones, debemos tener en cuenta que si la orientación interna es correcta (situación ideal), entonces los dos métodos son idénticos. Pero se producen errores en la orientación interna de la cámara que son difíciles de determinar, además que la distancia focal real difiere frecuentemente del valor calibrado, donde la distancia focal verdadera (cv) y a la distancia focal errónea (cЕ), una de las causantes de esta desviación son diferencias de temperatura y presión durante el vuelo, y es posible que el PP sea también afectado. En los sistemas de orientación directa, los problemas de sincronización entre el reloj GPS y el tiempo exacto de exposición producen errores de traslación “desplazamiento del punto principal”. El efecto de error, Δc, en la distancia focal sobre la reconstrucción (Δc = cE-cv). La Fig. (a) presenta esta situación en el caso de la orientación directa, donde esta orientación es conocida. Con la orientación interna verdadera, el punto reconstruido P es correcto, pero si la orientación interna es incorrecta la reconstrucción es errónea. Si la distancia focal verdadera es desconocida, se obtiene el punto P*, y un error en la restitución de ΔPZ ≈ Δc٠s, (s es la escala de la foto). Figuras a, b, c, d Mientras que en el método indirecto la orientación externa no se conoce y se la debe calcular a partir de puntos de apoyo y de la orientación interna errónea, debido a esto la orientación externa será errónea. Se puede reflejar esto en la Fig. (b) Por C’E y C”E, donde un error en la focal producirá un error en la componente Z del centro de proyección, pero la restitución es correcta ya que el error es minimizado en la orientación externa. En contraparte en las Fig. (c) y (d) muestran un error combinado en la distancia focal y en un desplazamiento del punto principal, donde la restitución en el caso de la orientación directa es incluso más problemática ahora. El punto restituido P* tiene componentes de error en todas sus coordenadas (ΔPx, y e ΔPz), en la Fig.(c). En el caso de la orientación indirecta, el error de la restitución es considerablemente mas pequeño, porque los parámetros de la orientación externa absorben una gran parte de los errores. 3. INTERSECCIÓN INVERSA DE UNA SOLA IMAGEN Esta intersección inversa de una solo imagen esta referida al hacer la determinación de los seis parámetros de la orientación externa pero en una sola fotografía, el cual es un proceso de modelado de la formación de la imagen ya que las ecuaciones de colinealidad hacen el modelado adecuado. Estas ecuaciones son de foto coordenadas observadas xp, yp de un punto objeto Xp, Yp, Zp que están en función de los parámetros de la orientación externa, posición de los centros de proyección Xc, Yc, Zc y la matriz de rotación R que determina la posición de la cámara. Ya que cada punto xp, yp produce dos ecuaciones, se debe considerar que si se tienen medidos los puntos de apoyo en la imagen la parte derecha de la ecuación contendría solo seis parámetros de la orientación externa por que las coordenadas Xc, Yc, Zc son conocidas, debido a esto serán solo necesarios tres puntos de apoyo para la orientación externa. Debido a que estas ecuaciones no son lineales es muy complicado obtener los valores aproximados iníciales de los parámetros, donde los valores para los centros de proyección se los puede obtener del vuelo realizado. Pero para hacer una referencia de los valores en la imagen, se determina el vector que esta entre los detalles del espacio imagen y del espacio objeto. El cual nos proporcionara X°c, Y°c y Z°c “calculando la altura de vuelo del avión ” , lo anterior se lo representa en donde los ángulos ω,Φ son aproximadamente cero y los valores de κ se los obtiene del vuelo realizado. 4. ORIENTACION ABSOLUTA Una vez formado el modelo estereoscópico solo queda posicionar en un sistema de coordenadas absoluto el modelo. En fotogrametría analógica esto se consigue aplicando unos nuevos giros y traslaciones y un factor de escala, esto se consigue conociendo coordenadas de al menos tres puntos identificables en la fotografía (en realidad dos puntos y la coordenada Z de un tercero) estos puntos son conocidos como puntos de apoyo. Pero en la orientación externa se trabaja con coordenadas de fotografía y coordenadas de terreno sin tener que pasar por las coordenadas modelo. La siguiente ecuación hace una relación entre las coordenadas modelo y las coordenadas espacio objeto Fig. 2: Fig. 2 p = SRm + t Donde S es una matriz de escala, R es una matriz de rotación y t es el desplazamiento entre los dos sistemas, pero como es supuesto que la escala es uniforme (S=s٠I ), se podrá determinar la ecuación de transformación de semejanza (siete parámetros) : Donde r 11...,r 33 son los elementos de la matriz de rotación 3-D,X Y Z las componentes de la traslación y s el factor de escala. Donde estos siete parámetros se determinan por un ajuste, en el cual las diferencias que existen entre los valores transformados y los valores que son datos se minimizan. Para los pares estereoscópicos aéreos, un camino mas sencillo para obtener valores aproximados convenientes, es realizar primero una transformación 2-D que proporciona X°t, Y°t, s°, k°. Entonces, Z°t ≈ s° ƒ y ω° ≈ ф° ≈ 0. 5. PARÁMETROS DE LA PRIENTACION EXTERNA A PARTIR DE LA ORIENTACIÓN RELATIVA Y ABSOLUTA 5.1. Orientación Relativa Se trata que los rayos homólogos de los haces espaciales de ambos fotogramas se corten dos a dos. La geometría proyectiva demuestra que si cinco pares de rayos homólogos (de dos fotogramas), se cortan dos a dos, se cortaran también los infinitos pares de rayos de los puntos homólogos que determinan un objeto en el espacio. 5.2. Orientación Absoluta Se trata de la posición del modelo con respecto al sistema de coordenadas XY. Tendremos entonces un parámetro factor de escala y seis parámetros definidos por tres traslaciones y tres rotaciones. Estos parámetros se obtienen de las coordenadas tanto de planimétrica y altimétrica de dos puntos del terreno y la coordenada altimétrica de un tercer punto del terreno. Estos puntos se denominan puntos de apoyo fotogramétrico (PAF), que conjuntamente con otros puntos de control permiten la resolución completa del modelo. En esta sección los parámetros de orientación relativa y absoluta pueden combinarse para obtener así los seis parámetros de la orientación externa, esto puede verse en el siguiente cuadro: Donde el sistema de coordenadas modelo en orientación relativa está definido por c’r=0 y c”r=b, siendo b la base [bx, 0, 0]τ (orientación relativa independiente) ó [bx, by, bz]τ (orientación relativa dependiente), y se debe denotar que R’r=I. 6. ORIENTACIÓN AUTOMÁTICA CON PUNTOS DE APOYO En cuanto a la identificación de puntos de apoyo se debe tener en cuanta que se debe hacer una señalización conveniente, usar puntos topográficos naturales como por ejemplo intersecciones de carreteras es muy conveniente. 6.1. SEÑALIZACIÓN DE LOS PUNTOS DE APOYO Es muy importante saber como se construyen estas marcas en el terreno, ya que será de gran importancia el momento de volcarlos en las fotografías deberán ser lo más notorio posible. Este tipo de señales pueden ser en forma de “T”, “V”, “circulares” o de “cruz”, además que deberán tener el tamaño apropiado dando también importancia al contraste que estas pueden tener, por ejemplo, una marcación en blanco resulta mejor en suelos oscuros o con hierva, mientras que en superficies reflectantes es mejor una marca oscura. Un parámetro a tomar en cuenta es el tamaño de estas señales ya que estas deben de estas en función de la escala de las fotos. Se debe resolver varios problemas antes de emplear el ajuste por mínimos cuadrados para encontrar la señal en la imagen, se necesita imágenes adecuadas de esta señal esto para crear plantillas modelos también conocidos como máscaras, para esto se debe tener en cuenta el proceso deformación de la imagen original (imagen en primer lugar, la iluminación, reflectancia de la superficie y el sensor usado). Pero todo lo anteriormente mencionado no es siempre posible, por lo que en general se trata de generar imágenes ideales de esta señal apoyándose en la escala de la imagen, debe notarse que estas plantillas no toman en cuenta las distorsiones geométricas causadas por las superficies inclinadas o no tienen en cuenta la reflectancia en las imágenes. Señal de puntería en forma de T Señal de puntería en forma de V Señal de puntería en forma de cruz 7. DETECCIÓN AUTOMÁTICA DE PUNTOS DE APOYO TOPOGRÁFICOS Debido que los puntos de apoyo no son preseñalizados generalmente, en las imágenes deben ser orientadas empleando puntos definidos por detalles, por ejemplo, cruces de carreteras, puentes, u otro punto característico del terreno. Esto requiere dos pasos, el primero es identificar el detalle de control y después se debe determinar su localización. Este es un problema de identificación, en las siguientes imágenes se dará un ejemplo de lo que se trata de mostrar : Cruce de carretera Mapa con el cruce de carretera imagen con el cruce de carretera Al lado derecho se dispone de una imagen y al lado izquierdo de un mapa, entre ambos el problema es identificar y medir los puntos de apoyo a partir del mapa por ejemplo un cruce de carreteras. Al hacer la comparación el mapa con la imagen se debe observar el número de cruces de carreteras a bajo que ángulos están estos cruces. El ejemplo que nos muestra el libro fotogrametría digital de Schenk T. es de dos cruces de carreteras que forman ángulos rectos, que para hacer la diferenciación de estas vías se deben tomar además otros aspectos como por ejemplo el ancho, tipo de pavimento e incluso tomar algunos detalles de estas que sean características propias, para esta clase de identificación se recomienda tener un amplio conocimiento de interpretación de la imagen. En el proceso de automatizar la detección de puntos de apoyo, lo que se trata de hacer es que procedan de un SIG, donde este implicado una información geométrica y topológica. En caso de que se haga la detección en forma análoga se trataría de obtener una información de la imagen, lo más parecida posible, pero como el manejo de la imagen es mas incómodo ya que una imagen en bruto no contiene información directa del objeto del que se trata de identificar. Lo que se trata de hacer en el SIG es obtener detalles alargados que reflejarían a las carreteras por ejemplo, y hacer una comparación con un SIG sobre el objeto que se quiere identificar. En el caso de las imágenes el momento de realizar este proceso no todos los detalles alargados serán carreteras e incluso se podrían cortar muchas de estas que se tratan de identificar. Pero con el método de correspondencia “comparación” de Vosselman y Haala, que hace una relación en las comparaciones de objetos donde se pretende tener los puntos de control en el espacio objeto con imágenes a color, esto tras una búsqueda, donde se podría puntualizar que las imágenes a color e infrarrojo ayudan en el proceso de extracción de detalles que son conocidos en el espacio objeto. punto de partida para construir una descripción de intersección de carreteras en una imagen El reconocimiento de puntos homólogos en el par estereoscópico lo realiza de manera Automática el software fotogramétrico Erdas Orthobase. El usuario puede establecer estrategias de búsqueda de los puntos homólogos en las imágenes. Dicha estrategia consiste en definir el tamaño de la ventana de comparación de píxeles de similar textura, el coeficiente de correlación entre las dos ventanas, el canal de la imagen a utilizar y características del terreno como el tipo de pendiente, la rugosidad, existencia de vegetación y edificios entre otras. Para que la extracción automática de puntos se realice con éxito, es necesario que las dos imágenes sean suficientemente similares. Si las imágenes no poseen texturas parecidas, no se podrá establecer correlación entre los pares de imágenes, viéndose muy afectada la calidad del resultado. Es de tener en cuenta que para distancias relativamente cortas 8, 15, 20 m el paralaje entre pares estereoscópicos puede llegar a ser muy elevado, dificultando la correlación (relacionamiento). En esta figura podemos ver como un ejemplo de las señales de puntería que reconocen parámetros para la detección de puntos. Señales de punterías 8. BIBLIOGRAFÍA CONSULTADA Pérez Alvares J. A. (2001) : Apuntes de fotogrametría II, Pág. 39-42, 162-165 Schenk T. (2002) : Fotogrametría digital Volumen I, Editorial Marcobo, Pág. 431-444 Facultad de Geología U.B. : Fotogrametría terrestre digital con cámaras no prfesionales, pag 5 Sánchez Sobrino J. A. (2006-2007) : Introducción a la Fotogrametría, Pág. 2037 Levantamiento Aereofotogramétrico, Pág. 5, 10-11 Dpto. de Geografía, Universidad Autónoma de Madrid : Análisis de cambio espacio-temporales a partir de la creación de ortoimágenes del vuelo fotogramétrico de 1933, Pág. 1-14