ayuda spss chi cuadrado – notas metodológicas

Anuncio

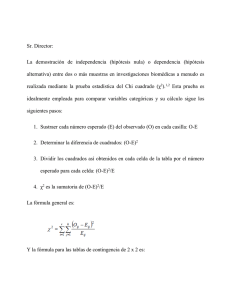

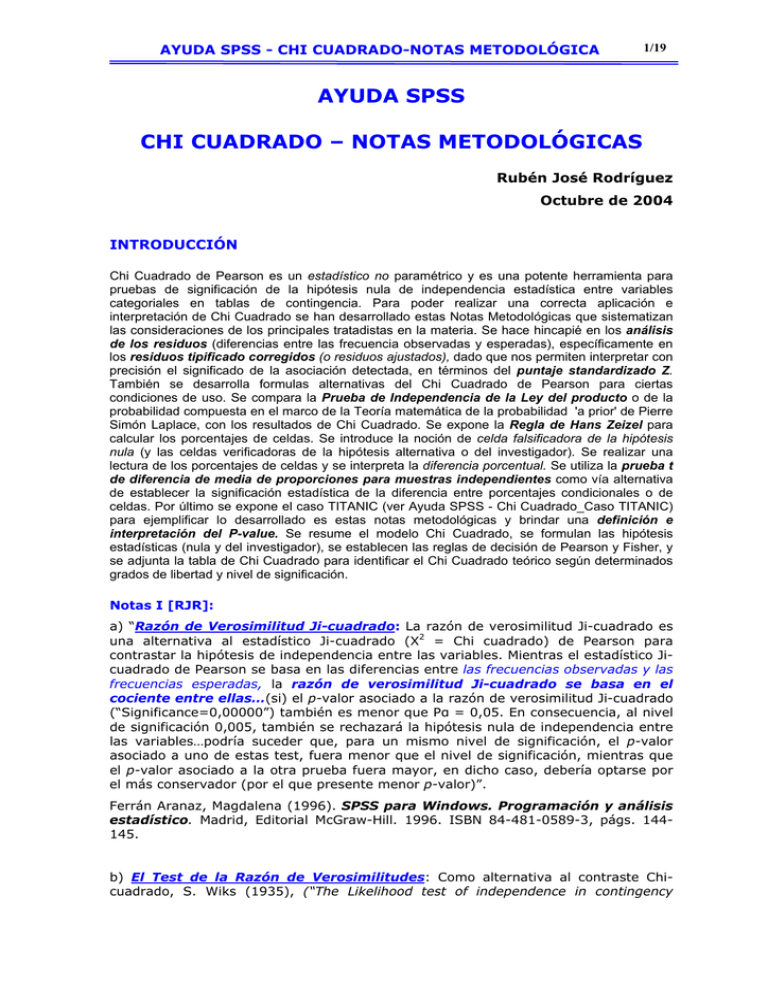

AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 1/19 AYUDA SPSS CHI CUADRADO – NOTAS METODOLÓGICAS Rubén José Rodríguez Octubre de 2004 INTRODUCCIÓN Chi Cuadrado de Pearson es un estadístico no paramétrico y es una potente herramienta para pruebas de significación de la hipótesis nula de independencia estadística entre variables categoriales en tablas de contingencia. Para poder realizar una correcta aplicación e interpretación de Chi Cuadrado se han desarrollado estas Notas Metodológicas que sistematizan las consideraciones de los principales tratadistas en la materia. Se hace hincapié en los análisis de los residuos (diferencias entre las frecuencia observadas y esperadas), específicamente en los residuos tipificado corregidos (o residuos ajustados), dado que nos permiten interpretar con precisión el significado de la asociación detectada, en términos del puntaje standardizado Z. También se desarrolla formulas alternativas del Chi Cuadrado de Pearson para ciertas condiciones de uso. Se compara la Prueba de Independencia de la Ley del producto o de la probabilidad compuesta en el marco de la Teoría matemática de la probabilidad 'a prior' de Pierre Simón Laplace, con los resultados de Chi Cuadrado. Se expone la Regla de Hans Zeizel para calcular los porcentajes de celdas. Se introduce la noción de celda falsificadora de la hipótesis nula (y las celdas verificadoras de la hipótesis alternativa o del investigador). Se realizar una lectura de los porcentajes de celdas y se interpreta la diferencia porcentual. Se utiliza la prueba t de diferencia de media de proporciones para muestras independientes como vía alternativa de establecer la significación estadística de la diferencia entre porcentajes condicionales o de celdas. Por último se expone el caso TITANIC (ver Ayuda SPSS - Chi Cuadrado_Caso TITANIC) para ejemplificar lo desarrollado es estas notas metodológicas y brindar una definición e interpretación del P-value. Se resume el modelo Chi Cuadrado, se formulan las hipótesis estadísticas (nula y del investigador), se establecen las reglas de decisión de Pearson y Fisher, y se adjunta la tabla de Chi Cuadrado para identificar el Chi Cuadrado teórico según determinados grados de libertad y nivel de significación. Notas I [RJR]: a) “Razón de Verosimilitud Ji-cuadrado: La razón de verosimilitud Ji-cuadrado es una alternativa al estadístico Ji-cuadrado (X2 = Chi cuadrado) de Pearson para contrastar la hipótesis de independencia entre las variables. Mientras el estadístico Jicuadrado de Pearson se basa en las diferencias entre las frecuencias observadas y las frecuencias esperadas, la razón de verosimilitud Ji-cuadrado se basa en el cociente entre ellas…(si) el p-valor asociado a la razón de verosimilitud Ji-cuadrado (“Significance=0,00000”) también es menor que Pα = 0,05. En consecuencia, al nivel de significación 0,005, también se rechazará la hipótesis nula de independencia entre las variables…podría suceder que, para un mismo nivel de significación, el p-valor asociado a uno de estas test, fuera menor que el nivel de significación, mientras que el p-valor asociado a la otra prueba fuera mayor, en dicho caso, debería optarse por el más conservador (por el que presente menor p-valor)”. Ferrán Aranaz, Magdalena (1996). SPSS para Windows. Programación y análisis estadístico. Madrid, Editorial McGraw-Hill. 1996. ISBN 84-481-0589-3, págs. 144145. b) El Test de la Razón de Verosimilitudes: Como alternativa al contraste Chicuadrado, S. Wiks (1935), (“The Likelihood test of independence in contingency AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 2/19 tables”, Annals of Mathematical Statistics, Nº 6, pág. 190), ha propuesto el siguiente estadístico: F G 2 2 Fi * ln i Ei siendo : Fi : Frecuencias observadas (fo ), es decir, la cantidad de casos o de valores que se han registrado para cada valor de la variable, si es una tabla de contingencia. E i : Frecuencias esperadas (f e ), suponiendo que la hipótesis nula que se ensaya es verdadera. (en general), se obtienen resultados muy similares en todos los casos y, por lo tanto, el uso de uno u otro procedimiento sería, en principio, indiferente. Ello no obstante, el test de la razón de verosimilitud presenta una ventaja con respecto al Chicuadrado: No requiere que todas frecuencias esperadas sean mayores de 5” García, Roberto M. (1995). Contraste Chi-cuadrado. Buenos Aires, Cuadernos de UADE nº 123, Departamento de Matemática y Métodos Cuantitativos, UADE, 1995, ISBN 987-519-1-012-8, pág. 27. c) Chi cuadrado de la razón de verosimilitud Likelihood ratio chi square Estadístico de bondad de ajuste similar al Chi cuadrado de Pearson. Para tamaños de muestra grandes, los dos estadísticos son equivalentes. La ventaja del chi cuadrado de la razón de verosimilitud es que puede subdividirse en una serie de partes interpretables por separado que, sumadas, equivalen al total. Diccionario Estadístico, http://www.estadistico.com/dic.html?p=122 d) “…cuando se pide el test de Ji-Cuadrado al programa, SPSS proporciona además la Razón de Verosimilitud (Likelihood Ratio), y el “Mantel-Haenzel Test” (Asociación lineal por lineal). El primero de estos está basado en la teoría de máxima verosimilitud, y su valor es dos veces la suma de las frecuencias observadas de cada celda multiplicadas por el logaritmo neperiano de la frecuencia observada dividida entre la frecuencia teórica. Con grandes tamaños de muestra adopta valores similares al test Ji-Cuadrado. El “Mantel-Haenzel Test” es una medida de avocación que analiza la relación existente entre las filas y columnas de una tabla; y se calcula multiplicando el coeficiente de correlación de Pearson por el número de casos menos uno. Como ha señalado Norusis, hay que tener en cuenta que únicamente debe ser utilizado con variables ordinales y de intervalo (Norusis, 1990:131). Díaz de Rada, Vidal (1999): Técnicas de análisis de datos para investigadores sociales. Aplicaciones prácticas con SPSS para Windows: Madrid, Ra-Ma, 1999, p. 171. [RJR] Nota II [RJR]: “Análisis de los Residuos: La prueba de la Ji-cuadrada que hemos explicado en 6.3.1. sirve para ver si la relación entre un par de variables es estadísticamente significativa. El análisis de los residuos va a utilizar las ideas de la ji-cuadrada para AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 3/19 estudiar de una manera pormenorizada la tabla: en lugar de ver si las dos variables están relacionadas estudiamos la relación entre cada pareja de categorías. Básicamente, el análisis de los residuos (diferencia entre valor observado (fo), Oij) y el valor esperado (fe), Eij) es una aplicación de la Ji-cuadrada al estudio de las parejas de categorías: observamos las frecuencias obtenidas y las comparamos con las esperadas…si la pareja de categorías no estuviera relacionada –el cálculo se realiza según el procedimiento explicado en 6.3.1. De la magnitud del residuo concluiremos sobre la relación entre las categorías…Cada casilla de la tabla incluye el número de casos, o valores observados (COUNT), los valores esperados (EXPECTED), la diferencia entre observados y esperados (RESID), los residuos estandarizados (SRESID) y estos mismos residuos ajustados según procedimiento de Haberman (ASRESID). Veamos el cálculo de cada uno de estos valores: Los residuos (RESID): (RESID) R ij (Oij Eij ) donde Oij y Eij son los valores observados y esperados, respectivamente, en casilla definida por la fila i y la columna j”. Sánchez Carrión, Juan Javier (1995): Manual de análisis estadístico de los datos, 2ª ed. Revisada, Madrid, Alianza Editorial, 1999, capítulo 6: Las tablas de contingencia: relación entre variables nominales (ordinales), pp. 341-344. [RJR]. “La diferencia entre un valor observado y el valor pronosticado por el modelo. El valor pronosticado es el número de casos que se esperarían en la casilla si no hubiera relación entre las dos variables. Un residuo positivo indica que hay más casos en la casilla de los que habría en ella si las variables de fila y columna fueran independientes”. SPSS 11.51, Ayuda contextual, Tablas de Contingencia, Chi Cuadrado, Mostrar en las celdas, Residuos. [RJR] Los residuos estandarizados (SRESID): (SRESID) SR ij (Oij Eij ) / Eij Estos residuos eliminan el efecto que sobre el valor del residuo puedan tener los marginales de ambas variables” Sánchez Carrión (1995: 341-344). [RJR] “El residuo dividido por una estimación de su error típico. Los residuos tipificados, que son conocidos también como los residuos de Pearson o residuos estandarizados, tienen una media de 0 y una desviación típica de 1”. SPSS 11.51, Ayuda contextual, Tablas de Contingencia, Chi Cuadrado, Mostrar en las celdas, Residuos tipificados. [RJR] Los residuos ajustados (ASRESID): AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 4/19 (SRESID) AR ij SRij / Vij donde Vij es la varianza estimada de SRij ,de valor igual a: Vij 1 (Oi. / n) 1 (O. j / n) siendo Oi. y O.j son las frecuencias observadas, respectivamente, en la fila i y la columna j, y n el tamaño de la muestra…Cuanto mayor sea el valor absoluto del residuo ajustado, mayor será la relación entre la pareja de categorías”. Sánchez Carrión (1995: 341-344). [RJR] “El residuo de una casilla (valor observado menos valor pronosticado) dividido por una estimación de su error típico. El residuo tipificado resultante viene expresado en unidades de desviación típica, por encima o por debajo de la media”. SPSS 15.0, Ayuda contextual, Tablas de Contingencia, Chi Cuadrado, Mostrar en las celdas, Residuos tipificados corregidos [RJR]. “Los Residuos tipificados corregidos de Haberman (1973). Estos residuos se distribuyen normalmente con media 0 y desviación típica 1. Se calculan dividiendo el residuo de cada casilla por su Error Típico (ES o SE), que en tablas bidimensionales se obtienen como la raíz cuadrada de: mij (1-ni) (1-nj)/n2 . La gran utilidad de los Residuos tipificados corregidos radica en que, puesto que se distribuye normalmente con media cero y desviación típica uno, N (0,1), son fácilmente interpretables: utilizando un nivel de confianza de 0,95, podemos afirmar que los residuos mayores de 1,96 delatan casillas con más casos de los que debería haber en esa casilla si las variables estudiadas fueran independientes; mientras que los residuos menores de -1,96 delatan casillas con menos casos de los que cabría esperar bajo la condición de independencia. En tablas de contingencia con variables nominales, una vez que hemos establecido que entre dos variables existe asociación significativa (mediante el estadístico Chicuadrado) y que hemos cuantificado esa asociación con algún índice de asociación (Coeficiente de Contingencia, CC), los residuos tipificados corregidos constituyen la mejor herramienta disponible para poder interpretar con precisión el significado de la asociación detectada…Los distintos porcentajes pueden ayudarnos a intuir posibles pautas de asociación, pero son los Residuos tipificados corregidos los que nos permite interpretar de forma precisa la relación existente entre las variables…Basta con fijarnos en aquellos (puntajes z) que son mayores que +1,96 o menores que -1,96.”. [Ver ejemplo Tabla 5 y 6 en Nota IV d)] Guía 10.0 SPSS para el Análisis de Datos, capítulo 12: Análisis de variables categóricas, p. 39 y 41. (En línea): http://www.uca.es/serv/sai/manuales/spss/Pantalla/12contin.pdf [Consulta: 10 de octubre de 2004] AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 5/19 Nota III: [RJR] “Prueba Estadística de Fisher: Prueba estadística ideada para el caso de tablas dicotómicas en las que no se pueda aplicar el test X2 por ser la frecuencia o frecuencias de alguna de sus casillas más bajas que lo permitido por dicho test, es decir, inferiores a cinco. Fórmula: P= (a+b)!(c+d)!(a+c)!(b+d)! N! a! b! c! d! Tiene el inconveniente de la dificultad de su cálculo por el número de factoriales (!) que comprende la fórmula (El paquete estadístico SPSS calcula automáticamente esta prueba)”. Sierra Bravo, Restituto (1991): Diccionario Práctico de Estadística, Madrid, Editorial Paraninfo, 1991, p. 379. [RJR] “En caso de tablas de 2 X 2 (las dos variables dicotómicas o dicotomizadas mediante un punto de corte), p-value asociado al estadístico Ji-cuadrado de Pearson puede ser poco preciso. En el caso de que el número total de observaciones en la muestra sea grande, una alternativa al estadístico Ji-cuadrado de Pearson, que incorpora una corrección por continuidad y, por lo tanto, un p-value más preciso, es Jicuadrado por Corrección de Continuidad de Yates puede ser poco preciso. En el caso de que el número total de observaciones en la muestra sea grande, una alternativa al estadístico. Si el tamaño muestral es pequeño, mediante la prueba de la probabilidad exacta de Fisher, se puede calcular la probabilidad exacta de observar un conjunto particular de frecuencias en una tabla 2 X 2. El propio programa SPSS optará por una u otra de las pruebas en función del tamaño muestral y de las frecuencias esperadas en las celdas” Ferrán Aranaz, Magdalena (1996): SPSS para Windows. Programación y Análisis Estadístico, Madrid, McGraw-Hill, 1996, capítulo 7: Tablas de contingencia y medidas de asociación, p. 145. [RJR] Nota IV: [RJR] Pruebas de independencia: Es necesario sistematizar las distintas opciones estadístico-metodológicas de analizar la independencia estadística entre dos variables, dado que en la bibliografía según sea la disciplina que trate –estadística o metodología- no desarrollan de modo exhaustivo los diferentes modos alternativos de analizar o probar la existencia o no de independencia estadística: Existen cinco modos alternativos para analizar la independencia estadística: a) Una manera es calculando la proporción entre la frecuencia condicional de una celda y la frecuencia marginal de columna, comparándola con la proporción entre la correspondiente frecuencia marginal, de esa fila, y la frecuencia total. Si se da una igualdad entre ambas proporciones, se comprueba que ambas variables son independientes. Es decir, que la distribución condición es igual a la distribución marginal, o lo que es lo mismo, la distribución bivariada se comporta del mismo modo que la distribución univariada. Por lo que la conclusión es que la introducción de la segunda variable en las columnas no afecta, no modifica las distribuciones condicionales. En caso contrario, que se de una desigualdad entre las proporciones, se sostiene la No independencia entre las categorías, y generalizando, entre las variables comparadas. Obsérvese que no se afirma la dependencia entre las variables, sino la No independencia entre las mismas. AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 6/19 b) Otro modo de comprobar lo mismo es recurrir a la Prueba de independencia, en el marco de la Teoría de Clásica de la Probabilidad formulada por Jean Batiste Laplace, donde se compara la probabilidad simple de un evento con su probabilidad condicional. En las siguientes tablas se dan simbólicamente, y se expresan analíticamente ambos casos. TABLA I Variable X Variable Y 0 1 Total 1 a b a+b 0 c d c+d Total a+c b+d n [Elaboración propia][RJR] a) Igualdad de proporciones entre distribuciones condicionales y marginales: SI: d cd Independencia bd n a) Un segundo método de la cálculo lo brinda la Prueba de independencia de la 2ª Ley de la Multiplicación de Laplace para sucesos simultáneos dependientes: P(A)=P A/B Independencia (Se lee: Si la P(A) es igual a su Probabilidad Condicional, es decir, la P(A sabiendo que se ha dado B), se concluye que ambas categorías son independientes) Aplicando ambos criterios a una tabla empírica, para averiguar si el Sexo es independiente o no respecto del Estado Civil, tenemos: TABLA 2 Sexo Estado Civil Hombre Mujer Total Solteros 8.000 5.000 13.000 Casados 10.000 12.000 22.000 1.000 4.000 5.000 21.000 40.000 Viudos Total 19.000 Sierra Bravo (1991: 365) PA/B P(A) AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 7/19 b) La proporción entre la distribución condicional comparada con la distribución marginal, del ejemplo, da: f (viudo)/f (total) ≠ f (viudo y mujer)/f (mujer) 5.000/40.000 ≠ 4.000/21.000 0,125 ≠ 0,191 No independencia La desigualdad nos confirma que el hecho de ser mujer No es independiente del Estado Civil que se posee. Se pueden comparar las proporciones de cada una de las celdas y se obtendrá la misma conclusión para cada par de categorías. Por lo que podemos generalizar las conclusiones para el conjunto del cuadro bivariado: el Sexo No es independiente del Estado Civil. b) Si P(A) es la Probabilidad Simple de que una persona sea “Viudo”, es decir, la Probabilidad de ser Viudo, es igual a la cantidad de Viudos divido el Total de personas, es decir: P (Viudo) = 5.000/40.000= 0,125 Y P (B) la Probabilidad Simple de que una persona sea “Mujer”, es igual: P (Mujer)= 21.000/40.000= 0,525 Pero, P(A/B) es la Probabilidad Condicional de “Ser Viudo sabiendo que es Mujer”, es decir, la Probabilidad de ser Viudo condicionado a que sea Mujer, es igual a: P (Viudo/Mujer)= 4.000/21.000= 0,191 Comparando los resultados, comprobamos que ambas probabilidades son distintas: P (Viudo) ≠ P (Viudo/Mujer) 0,125 ≠ 0,191 No independencia Obsérvese que analíticamente, la expresión P (Viudo/Mujer)= f (viudo y mujer)/f (mujer), con lo cual se demuestra que ambos criterios (a) y (b) de Prueba de Independencia son equivalente. c) Un tercer modo alternativo de análisis empírico de un cuadro bivariado es convertir las frecuencias absolutas en frecuencias relativas, es decir en porcentajes, y calcular la Diferencia Porcentual (d%). Para ello debemos tener en cuenta la Regla de Hans Zeisel 1: Porcentuar en el 1 Galtung, Johan (1966): Teoría y métodos de la investigación social, 2ª ed., Buenos Aires, Eudeba, Tomo II, 1969, p. 234: “La regla es muy simple: sacar porcentajes tomando siempre como base los valores de lo que se considera variable independiente en el modelo subyacente”. AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 8/19 sentido de la variable independiente, -tomando como base el marginal de esta última- y comparar los porcentajes en sentido opuesto. También debemos observar la forma de la distribución condicional relativa (distribución diagonal o rinconal), e identificar las celdas verificadoras (circuladas en rojo en el ejemplo) y las celdas falsificadoras de la hipótesis que subyace al cuadro. En nuestro ejemplo: TABLA 3 Sexo (%) Estado Civil Hombre Mujer % d% Solteros 42,1 23,8 32,5 18,3 Casados 55,6 57,1 55,0 -1,5 5,3 19,1 12,5 -13,8 100,0 ∑: 0 Viudos Total 100,0 100,0 Obsérvese que los porcentajes resaltados en azul, coinciden con las proporciones y probabilidades obtenidas mediante los criterios alternativos (a) y (b). La Diferencia porcentual, nos indica la fuerza o intensidad relativa de la asociación entre las variables, y no solamente es una Prueba de Independencia. Si la d% = 0 indica independencia estadística, o asociación nula, y si la d% = 100, estaría señalando máxima asociación. En nuestro ejemplo, (d% = -13,8) indica leve asociación. Hubiese existido asociación nula –según los subíndices de la TABLA 1- si los porcentajes hubiesen sido iguales: p 00 p01 p viudo y hombre = p viudo y mujer Y hubiese existido algún grado de asociación si los porcentajes hubiesen sido: p 00 p 01 p viudo y hombre p viudo y mujer No obstante que, la diferencia porcentual como medida de asociación, actúa como medida de influencia de una variable X sobre otra Y, debe ser interpretada mediante la prueba t de diferencia de medias de proporciones para muestras independientes (Galtung, 1969, II: 241) para medir la significación estadística del tamaño de la diferencia, pues una d% = 10%, puede ser tanto la diferencia entre 95-85% como entre 25-15%. Si bien en ambos casos la d% es igual al 10%. En el primer caso la diferencia del 10% en proporción al porcentaje menor representa un incremento porcentual (∆%) del 11,76%: AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 9/19 95 85 % 100 11, 76% 85 Mientras que en el segundo caso la diferencia del 10% en proporción al 15% representa un incremento (∆%) del 66,67%. En este sentido, se puede opinar que es más significativo este segundo caso que el primero. 25 15 % 100 66, 67% 15 d) Un cuarto modo es, justamente, la prueba t de diferencias de proporciones de dos muestras independientes, que permite verificar diferencias entre proporciones o porcentajes (d%) de dos muestra (grandes) independientes. Los componentes del modelo y los pasos para el cálculo del estadístico de prueba, son: Modelo estadístico: Distribución de diferencias de proporciones muestrales, con media igual a la Media de la distribución diferencias de proporciones muestrales y con Desvío Standard igual al Error Estándar de las diferencias de proporciones muestrales. En símbolos: D 0 D p1 q1 p2 q2 n1 n2 = ESD Hipótesis estadísticas: La hipótesis nula plantea la igualdad de las proporciones en las dos muestras, o lo que es lo mismo, que su diferencia es igual a 0. Mientras que la hipótesis alternativa, la hipótesis del investigador, plantea que las proporciones muestrales son distintas, es decir, que sus diferencias son distintas de 0, divergiendo del mero azar. Simbólicamente: H 0 p1 p2 D 0 H1 p1 p2 0; o D 0 Estadístico de prueba: Caso I: t de Student para diferencias de proporciones muestrales independientes (muestras grandes). AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA t p p 1 2 10/19 p1 p2 d% p1 q1 p2 q2 D n1 n2 Estadístico de prueba: Caso II: t de Student diferencias de medias de muestras independientes (muestras grandes). t X1 X 2 X 1 X 2 D 2 1 s n1 2 s2 n2 DX X 1 2 D Cálculo del estadístico de prueba: Si aplicamos la prueba t para el caso II, al Fichero Ventas-Beneficios-1994-95 X 83 empresas2 para poner a prueba la hipótesis nula de la no existencia de diferencia entre las medias de Beneficios antes de impuestos en l995 (bai95) entre empresas del sector servicios e industriales. Para ello, debemos dar los siguientes pasos: i. Recodificar la variable Sector (sector) asignando los viejos códigos del sector de actividad de la variable sector a la nueva variable dicotomizada sectorb, categorizada en Sector Servicios (1) y Sector Industrial (2). Dato que la prueba t compara dos medias en base a una variable de agrupación dicotómica. ii. Luego se abre la cuadro de diálogo: Comparar medias>Prueba T para muestras independientes…, del menú Analizar. iii. En dicho cuadro seleccionamos la variables bai95 y la pasamos a la ventana Contrastar variables (Test Variable), en Variables de agrupación, seleccionamos la nueva variable que recodifica los sectores: sectorb. /h 2 Visauta Vinacua, Bienvenido (1997): Análisis estadístico con SPSS para Windows (6.1), Madrid, McGraw-Hill, 1997, capítulo 4: Test de hipótesis: Comparación de medias, pp. 111-114. 11/19 AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA iv. Luego se definen los grupos: Usar valores especificados O Punto de corte. Oprimir Continuar para volver a la ventana original o primaria. Y luego Aceptar. SPSS ejecuta el comando T-Test y arroja dos tablas con los resultados que se observan en el Visor de SPSS: TABLA 4 Estadísticos de grupo Sector-ServicioIndustria Beneficios antes de impuestos (1995) N Media Desviación típ. Error típ. de la media Sector Servicios 39 23.068,74 50.154,834 8.031,201 Sector Industrial 36 10.774,83 32.247,476 5.374,579 TABLA 5 Prueba de muestras independientes Prueba de Levene para la igualdad de varianzas F Beneficios antes de impuestos (1995) Sig. Prueba T para la igualdad de medias t Sig.( bilate ral) gl Diferencia de medias Error típ. de la diferencia 95% Intervalo de confianza para la diferencia Inferior Se han asumido varianzas iguales No se han asumido varianzas iguales 2,356 ,129 Superior 1,251 73 ,215 12.293,91 9.827,639 7.292,546 31.880,367 1,272 65,413 ,208 12.293,91 9.663,658 7.003,436 31.591,256 AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 12/19 vi. Luego para visualizar los resultados reemplazamos en la fórmula del estadístico t los datos obtenidos en el output y confirmamos el t-value: t X1 X 2 X t X1 X 2 1 X 2 D 2 1 s n1 2 s2 n2 DX X 1 2 D 12.293,91 1, 251 9.827,639 vii. Por último, tomamos la decisión estadística con relación a la hipótesis nula. Dado que aplicando la Regla de Decisión de Fisher, tenemos que: Si P-Value < P Pero: Si 0,215 > 0,05 H0 y H1 H0 y H1 y concluimos que no hay diferencias en los Beneficios antes de impuestos en 1995, en las 83 empresas entre los Sectores Servicios e Industria. d) Por ultimo, una quinta forma de probar la hipótesis de independencia es mediante el estadístico Chi Cuadrado. En la tabla 6: Destino de sobrevivientes al hundimiento del TITANIC by Sexo, ponemos a prueba la hipótesis nula de que no hay diferencias entre los hombres y mujeres que perecieron. En cambio el investigador sostendrá que en los datos se puede poner a prueba la hipótesis de que en el siniestro del TITANIC se evidenció una vez más la aplicación del principio marinero “Primero las mujeres y los niños y segundo los hombres”. Por lo que esperaríamos hallar en la celda verificadora (rayado oblicuo en rojo) ‘mujeres/niños’ y ‘sobrevieron’ una proporción (p) mayor que en la celda ‘hombre’ y ‘sobrevivieron’. Observemos qué decisión nos indica tomar Chi Cuadrado respecto de la hipótesis nula. H 0 phombres y sobrevivieron pmujeres y sobrevivieron d % 0 H1 phombres y sobrevivieron pmujeres y sobrevivieron d % 0 13/19 AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA TABLA 6 Tabla de contingencia: Destino en el hundimiento del TITANIC según el Sexo del pasajero Sexo del pasajero Hombres Recuento Destino en el hundimiento Se salvaron 163 800 82,2% 32,0% 62,3% 154,5 -154,5 Residuos tipificados 7,0 -8,7 Residuos corregidos 18,2 -18,2 Recuento 138 347 485 % de Sexo de pasajero 17,8% 68,0% 37,7% Residuo -154,5 154,5 -9,0 11,1 -18,2 18,2 775 510 1285 100,0% 100,0% 100,0% Residuo Residuos tipificados Residuos corregidos Total Total 637 % de Sexo de pasajero Perecieron MujeresNiños Recuento % de Sexo de pasajero d% +50,2% -50,2% Adaptado y reelaborado de Sanchez Carrión (1999: 331-333) (S.S. Titanic, White Star Line, 14 de abril de 1912)[RJR] 14/19 AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA TABLA 7 Pruebas de chi-cuadrado Valor Sig. asintótica (bilateral) gl P-value Chi-cuadrado de Pearson 330,307(b) 1 ,000 Corrección por continuidad de Yates (a) 328,172 1 ,000 Razón de verosimilitud 338,182 1 ,000 Sig. exacta (bilateral) Estadístico exacto de Fisher ,000 Asociación lineal por lineal N de casos válidos Sig. exacta (unilateral) 330,050 1 ,000 ,000 1285 a Calculado sólo para una tabla de 2x2. b 0 casillas (,0%) tienen una frecuencia esperada inferior a 5. La frecuencia mínima esperada es 192,49. TABLA 8 Medidas simétricas Nominal por nominal Valor Sig. aproximada Phi ,507 ,000 V de Cramer ,507 ,000 Coeficiente de Contingencia ,452 ,000 N de casos válidos 1285 a Asumiendo la hipótesis alternativa. b Empleando el error típico asintótico basado en la hipótesis nula. Las conclusiones que se pueden obtener a partir de los resultados de las distintas medias, pruebas y coeficientes, son: La diferencia porcentual (d% = 82,2-32,0=50,2%) actúa como medida de la influencia que tuvo el sexo en la suerte corrida por los pasajeros. Se confirma una distribución diagonal de las frecuencias condicionales relativas, efectivamente, la celda verificadora esperada según el principio marinero, confirma que el porcentaje de mujeres/niños que sobrevivieron es 3,8 veces más (68,0/17,8) que los hombres que se salvaron. Siendo importante esta magnitud de la diferencia porcentual. Los Residuos tipificados corregidos (± 18,2) se ubican a 9,2 Desvíos Standard respecto del valor crítico ±1,96 esperado por azar (18,2/1,96= 9,2), con un intervalo de confianza de .95. Un tal desvío no puede ser atribuido al azar sino que cabe esperar que para producirse una tal diferencia es probable (95 veces de cada 100) AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 15/19 que haya operado una decisión y una voluntad en el alto mando del S.S. TITANIC, de hacer cumplir el principio marinero de salvar a las mujeres y niños primero. El valor del Chi cuadrado calculado o empírico (Chi-square value) es de una magnitud muy grande (330,307) y acusa una Significación asintótica bilateral de .000. Esta cifra es una probabilidad y significa = P-Value. Cuando esta probabilidad es inferior a 0,05, (P: Nivel de Significación = 5%) se suele rechazar la hipótesis de independencia Ho de no relación entre las variables –según la Regla de decisión de Fisher-, para aceptar la hipótesis alternativa H1, que indica que la relación entre las variables existe y es estadísticamente significativa y no se debe al azar. Se puede concluir que el capitán del S. S. Titanic hizo honor a la armada británica aplicando con firmeza el principio marinero que dice: Primero las mujeres y los niños, y luego los hombres, permitiendo que sobrevivan más mujeres que hombres, más allá del azar, que es lo sostenido por la hipótesis del investigador. En símbolos: Resumen del modelo Chi square value: 330, 337 Chi Cuadrado-Corrección por continuidad de Yates: 328,172 P : 0,05 (Nivel de significación) P-value: 0,000 (Significación asintótica bilateral) Grados de Libertad: 1 [df: (c-1)*(f-1)] Chi Cuadrado de Tabla: 3,841 (Ver Tabla de Chi Cuadrado para 1 gl y P: 0,05) Regla de decisión de Fisher: Si P-Value < P H0 y H1 Si 0,000 < 0,05 H0 y H1 Regla de decisión de Pearson: Si X 2 calculado > X 2 tabla H 0 H 1 Si 300,337 > 3,841 H 0 H1 AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICA 16/19 Distribución de la Curva de Chi-Cuadrado: Pα 0, 05 Rechazo H 0 Aceptacion H0 P-value= 0,000 Zona de Riesgo X 2 teo rico X 2 1;0 , 0 5 3 ,8 4 1 X 2 calculado Chi square value 300,337 [Elaboración Propia. RJR] Finalmente, la magnitud de los coeficientes de asociación indican, efectivamente, una relación entre ambas variables del orden de 0,452 y 0,507. Expresando una mediana fuerza de asociación teniendo en cuenta que estos coeficientes varían entre 0 y 1. CALCULADORA CHI-CUADRADO3 CORRECCION DE CONTINUIDAD DE YATES A B SUM I 637 163 800 II 138 347 485 SUM 775 510 1285 Chi-square value (X): 328.172423 Difference (p<0.05)? yes Difference (p<0.01)? yes [RJR] 3 Calculadora Chi Cuadrado-Corrección por continuidad de Yates. (En línea): Disponible: http://members.tripod.com/~gineco/CHISQUAR.HTM [Consulta: 11 de octubre de 2004] AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICAS 17/19 Table: Chi-Square Probabilities The areas given across the top are the areas to the right of the critical value. To look up an area on the left, subtract it from one, and then look it up (ie: 0.05 on the left is 0.95 on the right) AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICAS df 0.995 0.99 0.975 0.95 0.90 0.10 0.05 18/19 0.025 0.01 0.005 1 --- --- 0.001 0.004 0.016 2.706 3.841 5.024 6.635 7.879 2 0.010 0.020 0.051 0.103 0.211 4.605 5.991 7.378 9.210 10.597 3 0.072 0.115 0.216 0.352 0.584 6.251 7.815 9.348 11.345 12.838 4 0.207 0.297 0.484 0.711 1.064 7.779 9.488 11.143 13.277 14.860 5 0.412 0.554 0.831 1.145 1.610 9.236 11.070 12.833 15.086 16.750 6 0.676 0.872 1.237 1.635 2.204 10.645 12.592 14.449 16.812 18.548 7 0.989 1.239 1.690 2.167 2.833 12.017 14.067 16.013 18.475 20.278 8 1.344 1.646 2.180 2.733 3.490 13.362 15.507 17.535 20.090 21.955 9 1.735 2.088 2.700 3.325 4.168 14.684 16.919 19.023 21.666 23.589 10 2.156 2.558 3.247 3.940 4.865 15.987 18.307 20.483 23.209 25.188 11 2.603 3.053 3.816 4.575 5.578 17.275 19.675 21.920 24.725 26.757 12 3.074 3.571 4.404 5.226 6.304 18.549 21.026 23.337 26.217 28.300 13 3.565 4.107 5.009 5.892 7.042 19.812 22.362 24.736 27.688 29.819 14 4.075 4.660 5.629 6.571 7.790 21.064 23.685 26.119 29.141 31.319 15 4.601 5.229 6.262 7.261 8.547 22.307 24.996 27.488 30.578 32.801 16 5.142 5.812 6.908 7.962 9.312 23.542 26.296 28.845 32.000 34.267 17 5.697 6.408 7.564 8.672 10.085 24.769 27.587 30.191 33.409 35.718 18 6.265 7.015 8.231 9.390 10.865 25.989 28.869 31.526 34.805 37.156 19 6.844 7.633 8.907 10.117 11.651 27.204 30.144 32.852 36.191 38.582 20 7.434 8.260 9.591 10.851 12.443 28.412 31.410 34.170 37.566 39.997 21 8.034 8.897 10.283 11.591 13.240 29.615 32.671 35.479 38.932 41.401 22 8.643 9.542 10.982 12.338 14.041 30.813 33.924 36.781 40.289 42.796 23 9.260 10.196 11.689 13.091 14.848 32.007 35.172 38.076 41.638 44.181 24 9.886 10.856 12.401 13.848 15.659 33.196 36.415 39.364 42.980 45.559 25 10.520 11.524 13.120 14.611 16.473 34.382 37.652 40.646 44.314 46.928 26 11.160 12.198 13.844 15.379 17.292 35.563 38.885 41.923 45.642 48.290 AYUDA SPSS - CHI CUADRADO-NOTAS METODOLÓGICAS 19/19 27 11.808 12.879 14.573 16.151 18.114 36.741 40.113 43.195 46.963 49.645 28 12.461 13.565 15.308 16.928 18.939 37.916 41.337 44.461 48.278 50.993 29 13.121 14.256 16.047 17.708 19.768 39.087 42.557 45.722 49.588 52.336 30 13.787 14.953 16.791 18.493 20.599 40.256 43.773 46.979 50.892 53.672 40 20.707 22.164 24.433 26.509 29.051 51.805 55.758 59.342 63.691 66.766 50 27.991 29.707 32.357 34.764 37.689 63.167 67.505 71.420 76.154 79.490 60 35.534 37.485 40.482 43.188 46.459 74.397 79.082 83.298 88.379 91.952 70 43.275 45.442 48.758 51.739 55.329 85.527 90.531 95.023 100.425 104.215 80 51.172 53.540 57.153 60.391 64.278 96.578 101.879 106.629 112.329 116.321 124.116 128.299 90 59.196 61.754 65.647 69.126 73.291 107.565 113.145 118.136 100 67.328 70.065 74.222 77.929 82.358 118.498 124.342 129.5