Contrastes de hipótesis estadísticas Contraste sobre la media de

Anuncio

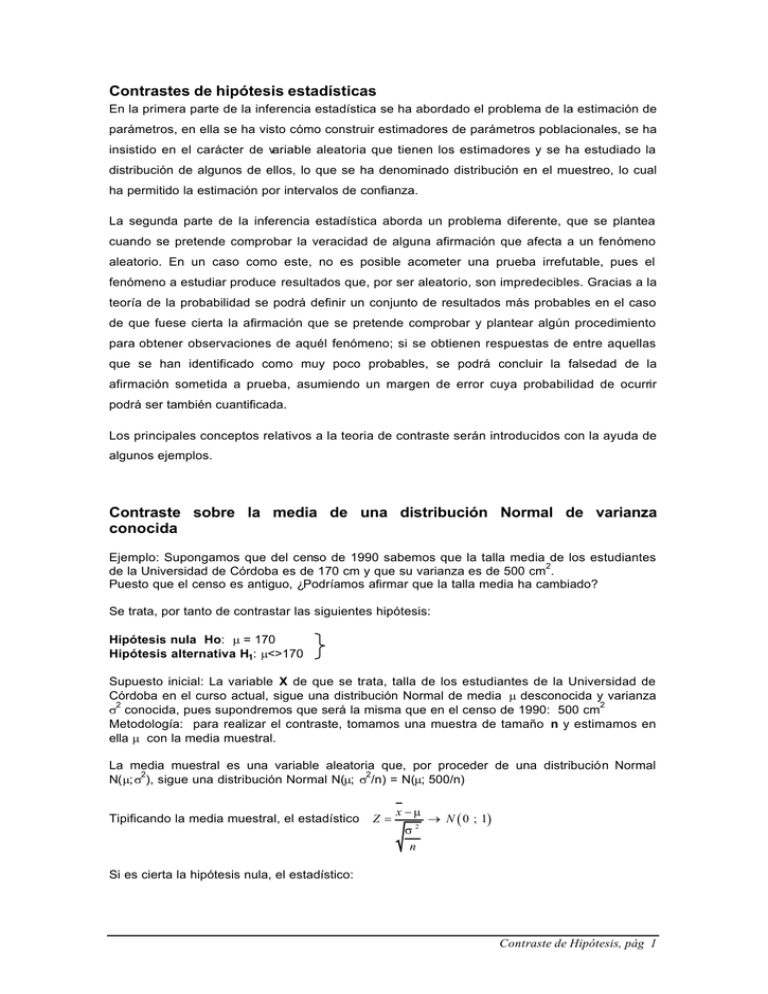

Contrastes de hipótesis estadísticas En la primera parte de la inferencia estadística se ha abordado el problema de la estimación de parámetros, en ella se ha visto cómo construir estimadores de parámetros poblacionales, se ha insistido en el carácter de variable aleatoria que tienen los estimadores y se ha estudiado la distribución de algunos de ellos, lo que se ha denominado distribución en el muestreo, lo cual ha permitido la estimación por intervalos de confianza. La segunda parte de la inferencia estadística aborda un problema diferente, que se plantea cuando se pretende comprobar la veracidad de alguna afirmación que afecta a un fenómeno aleatorio. En un caso como este, no es posible acometer una prueba irrefutable, pues el fenómeno a estudiar produce resultados que, por ser aleatorio, son impredecibles. Gracias a la teoría de la probabilidad se podrá definir un conjunto de resultados más probables en el caso de que fuese cierta la afirmación que se pretende comprobar y plantear algún procedimiento para obtener observaciones de aquél fenómeno; si se obtienen respuestas de entre aquellas que se han identificado como muy poco probables, se podrá concluir la falsedad de la afirmación sometida a prueba, asumiendo un margen de error cuya probabilidad de ocurrir podrá ser también cuantificada. Los principales conceptos relativos a la teoria de contraste serán introducidos con la ayuda de algunos ejemplos. Contraste sobre la media de una distribución Normal de varianza conocida Ejemplo: Supongamos que del censo de 1990 sabemos que la talla media de los estudiantes 2 de la Universidad de Córdoba es de 170 cm y que su varianza es de 500 cm . Puesto que el censo es antiguo, ¿Podríamos afirmar que la talla media ha cambiado? Se trata, por tanto de contrastar las siguientes hipótesis: Hipótesis nula Ho: µ = 170 Hipótesis alternativa H1: µ<>170 Supuesto inicial: La variable X de que se trata, talla de los estudiantes de la Universidad de Córdoba en el curso actual, sigue una distribución Normal de media µ desconocida y varianza 2 2 σ conocida, pues supondremos que será la misma que en el censo de 1990: 500 cm Metodología: para realizar el contraste, tomamos una muestra de tamaño n y estimamos en ella µ con la media muestral. La media muestral es una variable aleatoria que, por proceder de una distribución Normal 2 2 N(µ; σ ), sigue una distribución Normal N(µ; σ /n) = N(µ; 500/n) Tipificando la media muestral, el estadístico Z= x −µ σ2 n → N ( 0 ; 1) Si es cierta la hipótesis nula, el estadístico: Contraste de Hipótesis, pág 1 Z exp = x − 170 500 n → N ( 0 ; 1) , también llamado estadísti co experimental Regiones crítica y de aceptación: Concluiré rechazando la hipótesis nula si la media muestral es un valor que contradice claramente dicha hipótesis: si obtengo una media muestral mucho más pequeña o mucho mayor que 170. En otro caso, diré que no hay evidencias en contra de la hipótesis nula. Si la media es 170, valores muy alejados de 170 son muy improbables, pero no imposibles, existirá una probabilidad de encontrar tales valores, aún siendo cierta la hipótesis nula. Si nos encontramos con uno de estos casos y rechazamos la hipótesis nula cometemos un error, es el error tipo I. La probabilidad de cometer ese error se fija de antemano, es el nivel de significación, α = P(rechazar Ho/Ho es cierta) Puesto que la media muestral tipificada sigue una distribución N(0;1), puedo encontrar dos abcisas que definan un intervalo de probabilidad 1-α. En realidad estas dos abcisas pueden ser cualesquiera que cumplan la condición de que el área bajo la curva de densidad sea 1-α, pero debido a la simetría de la Normal, se toman Z1-α/2 ; Zα/2, o lo que es lo mismo: - Zα/2 ; Zα/2 Si, elegida una muestra, obtenemos un Zexp fuera de ese intervalo, rechazaremos la hipótesis nula. Región crítica o de rechazo: Región de aceptación: Cr = ( −∞ ; −Zα / 2 ) ∪ ( Zα / 2 ; ∞) Co = ( −Z α / 2 ; Zα / 2 ) C0 Aplicación:La siguiente serie de datos es una muestra de tamaño n=10 de una N(170;500) 172; 178; 148; 145; 188; 193; 186; 199; 187; 177 la media es:177,3 La región de aceptación, para un nivel de significación del 10% es (-1,64 ; 1,64) El estadístico experimental es:1,032 que está comprendido en la región de aceptación, por eso se concluye que no se puede rechazar la hipótesis nula. Contraste de Hipótesis, pág 2 Error de tipo II Es el que se comete al aceptar la hipótesis nula siendo falsa, o sea, cuando se rechaza la hipótesis alternativa siendo cierta. Un contraste como el planteado: Hipótesis nula Ho: µ = 170 Hipótesis alternativa H1: µ<>170 contempla infinitas posibles hipótesis alternativas, basta con que la media no sea 170. Pero en todos los casos la hipótesis nula es la misma, y la región de aceptación para un α del 10% siempre será (-1,64 ; 1,64). Supongamos que en realidad, la talla actual ha crecido y que ahora 2 la media no es 170 sino 180 cm, con una varianza de 500 cm Ahora la lista siguiente es una muestra procedente de una variable N(180;500) 190; 199; 170; 189; 179; 221; 175; 193; 150; 209 la media es:187,5 El estadístico experimental es: 2,475 que NO está comprendido en la región de aceptación, por eso se concluye (correctamente) que hay evidencias para rechazar la hipótesis nula. En casos como este decimos que el contraste resultó significativo. Sin embargo, si los valores obtenidos hubieran sido los siguientes, que también proceden de una variable N(180;500) 184; 204; 173; 188; 189; 190; 146; 157; 184; 198 la media es:181,3 La región de aceptación, para un nivel de significación del 10% es (-1,64 ; 1,64) El estadístico experimental es:1,598 que está comprendido en la región de aceptación, por eso se concluye (incorrectamente) que no se puede rechazar la hipótesis nula. Pero sabemos que la media es 180, al aceptar la hipótesis nula cometemos un error, es el error de tipo II y ocurre cuando se acepta la hipótesis nula siendo falsa. La probabilidad de cometer error de tipo II se representa como β = P(aceptar Ho/Ho es falsa) Errores de tipo I y II Para ver la relación existente entre los dos tipos de errores, lo haremos con otro ejemplo: Hipótesis nula, la media es:170, XàN(170;500) Distribución media muestral bajo Ho y H1 b = P(error tipo II) 0.06 0.05 H0 H1 0.04 0.03 0.02 C0 α/2 0.01 0 150 160 170 α/2 β 180 190 200 210 Contraste de Hipótesis, pág 3 Un caso concreto de hipótesis alternativa, la media es185, XàN(185;500) La varianza es, en ambos casos, 500 Se pueden representar las funciones de densidad de la media muestral bajo ambas hipótesis y ver que el área delimitada por densidad correspondiente a H1 (distribución que hay que considerar cuando H1 sea cierta) y la región de aceptación (valores de la media muestral que me hacen decir que H1 es falso) es lo que denominamos β = probabilidad de error de tipo II. Con la ayuda de este gráfico se puede ver que para reducir el error tipo II se puede hacer más pequeña la región de aceptación, pero entonces aumenta el error tipo I. Solo se puede disminuir ambos errores de modo simultáneo aumentando el tamaño de la muestra, pues así la varianza de la media muestral es menor, las curvas Ho y H1 son más estrechas y, para la misma región de aceptación, disminuyen el área correspondiente a α y β. Contrastes unilaterales y bilaterales: En casos como el visto hasta ahora, rechazaremos la hipótesis nula siempre que la muestra extraída contradiga claramente esa hipótesis, en nuestro ejemplo, siempre que la media muestral sea significativamente mayor menor que la propuesta como hipótesis nula. Contrastes del tipo: Ho: µ = µ0 H1: µ< µ0 Darán resultado significativo solo si la media muestral es menor que la propuesta como hipótesis nula y se denominan contrastes unilaterales. El contraste se plantea y se resuelve del mismo modo, pero como solo aceptamos H1 si la media muestral es claramente menor que 175, la región crítica es: C1 =(−∞; −Zα) y la región de aceptación es: C0 = (−Zα; ∞) En el caso de que la hipótesis alternativa sea de sentido contrario al anterior: Ho: µ = µ0 H1: µ > µ0 Las regiones crítica y de aceptación son: C1 = (Zα; ∞) y C0 = (−∞; Zα) Valor crítico o P- valor de un contraste Se ha visto que se puede construir la región de aceptación y la región crítica de un contraste antes de tomar la muestra, basta saber cuál es el estadístico de contraste, su distribución, conocer si el contraste es unilateral o bilateral y el nivel de significación deseado. Todo ello no requiere el conocimiento de los datos de la muestra. De hecho, habria que proceder así para evitar que el conocimiento de la muestra pudiese modificar el planteamiento inicial del test. No obstante, los programas estadísticos proceden de otro modo, como ellos pueden calcular la probabilidad asociada a cualquier intervalo de valores correspondientes a la distribución del estadístico de contraste, pueden informar sobre cómo de “raro” , desde el punto de vista de la hipótesis nula, es el valor obtenido. En realidad nos informan sobre la probabilidad de obtener valores tan raros o más que el obtenido, a esta probabilidad se le denomina valor crítico o Pvalor del test. Veámoslo con un ejemplo: Sea el contraste unilateral sobre la talla media de los alumnos de la Universidad de Córdoba en 2 el año 2000, que suponemos que sigue una distribución N( µ ; σ = 500) Ho: µ = 170 H1: µ > 170 Contraste de Hipótesis, pág 4 Supongamos que se ha extraido la m.a.s. de tamaño 10 , que resulta ser la siguiente: 184; 204; 173; 188; 189; 190; 146; 157; 184; 198 cuya media es:181,3 El estadístico experimental es : Z exp = x − 170 500 n → N ( 0 ; 1) Sustituyendo y operando, se obtiene Zexp = 1,598 . Desde el punto de vista de la hipótesis nula, valores tan “raros” o más que este serán aquellos que hagan aceptar H1 , es decir, aquellas muestras cuya media sea claramente mayor que 170, tanto o más que la muestra actual, o , lo que es lo mismo, que produzcan un valor de Zexp ≥ 1,598, de ser cierta la hipótesis nula, esa probabilidad se puede calcular, pues la distribución de Zexp es una N(0;1): Z → N (0;1) P( Z ≥ Z exp ) = P( Z ≥ 1.598) = 0.05501 El P-valor del contraste será, por lo tanto, 0.05501. Ahora podemos afirmar que, si la hipótesis nula es cierta, valores tan raros como el que proporciona la muestra actual o aún más favorables a la hipótesis alternativa, ocurren solo 5.5 de cada 100 veces que se obtenga una muestra, por lo que podremos aceptar o rechazar la hipótesis nula conociendo el riesgo a error que se corre. En el ejemplo actual, se puede rechazar H0 , pues el estadístico de contraste proporciona un valor de los que podríamos calificar de “raros”. No obstante, si se rechaza la hipótesis nula, el riesgo a errar es del 5.5%. En definitiva, se puede definir e valor crítico o P-valor de un contraste como el riesgo que se asume a equivocarse por rechazar la hipóteis nula. Si el riesgo a errar es grande, no la rechazaré, mientras que si este riesgo es pequeño, podré rechazarla. En general, si el P-valor es menor que α , se rechaza H0 , y si es mayor se acepta. También se puede contemplar el P-valor como el nivel de significación que debe tener un test para que el estadístico de contraste sea justamente la frontera entre la región crítica y la región de aceptación. Con esta definición se puede comprender que, cuando el contraste es bilateral, el P-valor sea el doble que para el mismo contraste unilateral. Si se realiza el contraste: Ho: µ = 170 H1: µ ≠ 170 y se obtiene la muestra anterior, el estadístico de contraste vuelve a ser Zexp = 1,598, pero ahora, la región crítica ha de ser bilateral, como se basa en una N(0;1), será además simétrica. Si se desea que Zexp sea frontera de esta región se tendrá: Cr = ( −∞ ; − Z exp ) U ( Z exp ; ∞ ) C0 = ( − Z exp ; Z exp ) P − valor = P ( Z ∈ Cr / Z → N (0;1) ) P − valor = P ( Z ≤ −Zexp U Z ≥ Zexp ) = P ( Z ≤ −Z exp ) + P ( Z ≥ Zexp ) P − valor = 2P ( Z ≤ −Zexp ) = 0.11 Contraste de Hipótesis, pág 5 Generalmente este es el resultado que proporcionan los programas estadísticos, si se desea saber el P-valor correspondiente a un contraste unilateral, basta dividir el que proprocione el programa entre dos. En el caso de contrastes unilaterales, si el P-valor que se conoce es el correspondiente a un contraste bilateral, solo se rechazará H0 cuando la cantidad experimental esté del lado de H1 y si el P-valor calculado dividiendo entre dos el que proporcione el programa, así lo aconseja. Contraste sobre la media de una distribución Normal de varianza desconocida Hasta ahora se ha supuesto que la varianza poblacional era conocida, lo que es poco verosímil si la media poblacional es desconocida. Un caso más real será aquél en que se desee efectuar un contraste sobre la media de una distribución normal de varianza desconocida: Ho: µ = µ0 H1: µ ≠ µ0 La media muestral es una variable aleatoria que, por proceder de una distribución Normal 2 2 N(µ;σ ), sigue una distribución Normal N(µ; σ /n). Si es cierta la hipótesis nula, la media 2 muestral seguirá una distribución N(µ0 ; σ /n) Tipificando la media muestral, el estadístico Z= x − µ0 → N ( 0 ; 1) σ2 n Pero ahora no es posible calcularlo, pues la varianza poblacional es desconocida. No obstante, podemos estimarla con la cuasivarianza. La variable así tipificada no sigue una distribución Normal, sino una t de Student con n-1 grados de libertad, por lo que la región de aceptación para el contraste bilateral con un nivel de significación α, se construye a partir de la t de Student C0 = (-tα/2 ; tα/2) y con ella se compara la cantidad experimental: t exp = x − µ0 s2 n Ejemplo 2: se desea realizar el contraste visto en el primer ejemplo: Ho: µ = 170 H1: µ ≠ 170 Pero ahora suponiendo que se desconoce la varianza poblacional. Para realizar el contraste, se obtiene una muestra, sea la muestra de tamaño n=10 de una N(175;500) que hemos utilizado ya : 186; 175; 185; 172; 174; 178; 178; 188; 165; 172 En esta muestra estimamos la media poblacional con la muestral:177,3 y estimamos la varianza poblacional con la cuasivarianza, que es: 325.789 La región de aceptación, para un nivel de significación del 10% y 9 grados de libertad es C0 = (-tα/2 ; tα/2) = (-1,833 ; 1,833) El estadístico experimental es: Contraste de Hipótesis, pág 6 t exp = 177.3 − 170 = 1.279, que está comprendido en la región de aceptación, por eso se 325.789 10 concluye que no se puede rechazar la hipótesis nula. Contrastes unilaterales Cuando el contraste no sea bilateral, la región crítica se sitúa en un solo extremo de la t de Student, de modo coherente con la hipótesis alternativa de que se trate: Hipótesis Ho: µ = µ0 H1: µ > µ0 Ho: µ = µ0 H1: µ < µ0 Región crítica Región de aceptación C1 = (t α ; ∞) C0 = (−∞ ; tα) C1 = (−∞ ; −tα ) C0 = (−tα ; ∞) Contraste sobre la media de una variable aleatoria que no siga la distribución Normal. Cuando no se pueda asumir la Normalidad de la variable de partida, tendremos que recurrir a algún contraste No paramétrico, que no se verán aquí. No obstante, si la muestra es suficientemente grande, se puede aplicar el T.C.L. y realizar el contraste basándonos en la distribución normal, la tabla siguiente resume los contrastes y las condiciones de aplicabilidad. Contraste Varianza poblacional 2 Ho: µ = µ0 H1: µ ≠ µ0 σ conocida n>30 2 σ desconocida, estimada con s2 2 Ho:µ = µ0 H1: µ > µ0 σ conocida σ desconocida, s2 2 σ conocida estimada con s2 Z exp = Z exp = n>30 Z exp = n>60 Z exp = n>30 Z exp = 2 σ desconocida, Estadístico experimental n>60 2 estimada con Ho: µ = µ0 H1: µ < µ0 Tamaño muestral * n>60 Z exp = Región de aceptación x − µ0 σ 2 /n x − µ0 C0 = (−Ζα/2 ; Ζα/2 ) s2/n x − µ0 σ 2 /n x − µ0 C0 = (−∞ ; Ζα) s2/n x − µ0 σ 2 /n x − µ0 C0 = (−Ζα ; ∞) s2/n *: es el tamaño de muestra mínimo requerido para que se pueda aplicar el T.C.L., con suficiente garantía de aproximación. Contraste de Hipótesis, pág 7 Ejemplo: Supóngase que el nivel medio de contaminación atmosférica sobre núcleos urbanos medido en cierta escala no deba superar las 15 unidades, que para controlar este nivel se hayan elegido aleatoriamente cien puntos de control sobre una ciudad y que estas medidas proporcionen un valor medio de 15.53 con una cuasivarianza de 4.82. Contrástese la hipótesis nula de que no se supera el máximo nivel medio admitido. Se tratará de efectuar el contraste: Ho:µ = 15 H1: µ ≥ 15 Como no se conoce la distribución de esta variable (de hecho no se indica cuál es el procedimiento ni las unidades de medida), en principio no se podría plantear el contraste habitual sobre la media de una distribución Normal, no obstante, como el tamaño muestral, n=100 es suficientemente grande, se puede admitir la aproximación Normal de la distribución de la media muestral y resolver el contraste. El estadístico de contraste es: Z exp = x − µ0 2 s n = 15.53 − 15 = 2.4141 4.82 100 La región de aceptación, para un nivel de significación del 5% es: C0 = (-∞ ; Z0.05) = (-∞ ;1.64) Conclusión: Habría evidencias para afirmar que se ha superado el nivel máximo admisible. Contraste sobre una proporción. En gran cantidad de ocasiones la variable que se mide es categórica, en esos casos, el parámetro que más habitualmente se usa para caracterizar las distintas categorías de dicha variable es la proporción. Cuando solo interese una de las posibles categorías frente a las demás, será aplicable el modelo de distribución de variable aleatoria binaria, en la que se identifica como "éxito" al conjunto de resultados que muestran la categoría que es de interés y como "fracaso" a todos los demás. En este tipo de situaciones es posible plantear contrastes sobre el parámetro p de la distribución binomial que, como se vio en el tema 7, se podrán y resolver usando la distribución en el muestreo de la variable X = número de éxitos, pues, como se sabe, es binomial de parámetros n y p. No obstante, en este punto se seguirá una metodología distinta, aplicando la aproximación Normal, cuando esto sea posible. Contrastes del tipo: Ho: p = p0 H1: p ≠ p0 Pueden ser asimilados a uno sobre la media de una variable que no sigue la distribución Normal, pues al tomar una muestra y estimar en ella la proporción de "éxitos", dicho estimador puede ser considerado la media de una variable binaria en la que asimilamos 1 a "éxito" y 0 a "fracaso": n pˆ = a = n ∑x n i = x , donde na es el número de éxitos de la muestra y xi solo toma valores 0 ó 1. En tal caso, se considera que la muestra es suficientemente grande si np0 y nq0 son ambos mayores que 5. Contraste de Hipótesis, pág 8 Si H0 es cierta, la varianza poblacional no hay que estimarla, pues es la de una variable binaria 2 de parámetro p0 : σ = p 0 q 0 El contraste se resuelve calculando: Z exp = p̂ − p 0 p0q0 n y comparándolo con una región de aceptación bilateral: C0 = (−Ζα/2 ; Ζα/2 ) De modo similar se procede para los contrastes unilaterales. Contraste Ho:p = p0 H1: p> p0 Región de aceptación Varianza, bajo H0 Población Estimador de p Tamaño muestral Estadístico experimental C0 = (−∞ ; Ζα) 2 σ =p0q0 Ho:p = p0 H1: p< p0 pq σ = 0 0 n 2 p̂ n p0 >5 y nq0>5 C0 = (−Ζα ; ∞) Z exp = p̂ − p 0 p0q0 n Ejemplo: De una determinada asignatura se comenta que se produce un número excesivo de suspensos, para comprobar la sospecha, se han elegido aleatoriamente 50 alumnos de entre los que se han presentado al primer parcial, y se ha encontrado que 30 de ellos están suspensos, pero el profesor afirma que eso no quiere decir que la proporción de suspensos sea mayor que el 50%, ¿Es eso cierto?. Es posible que el profesor tenga razón, pues la información que se posee es la de una muestra, que se supone representativa de todos sus alumnos, para comprobar la veracidad de su afirmación, se tendrá que efectuar un contraste sobre la proporción de suspensos. Si se supone la “inocencia” del profesor, el contraste se planteará: H0 : p = 0.5 H1 : p > 0.5 Como 50×0.5 = 25 >5, se puede aplicar la aproximación normal. Para un nivel de significación α = 0,01, C0 = (-∞; Z0.01) = (-∞ ; 2.326) y el estadístico de contraste: Z exp 30 − 0.5 pˆ − p 0 = = 50 = 1.4142 p0q0 0.5 ⋅ 0.5 n 50 Conclusión: No se puede rechazar que la proporción de suspensos es inferior o igual al 50% Contraste sobre la Varianza de una variable aleatoria que sigue una distribución Normal. Contrastes del tipo: 2 2 Ho: σ = σ 0 2 2 H1: σ ≠ σ 0 Contraste de Hipótesis, pág 9 Se pueden realizar siempre que la variable de partida siga una distribución Normal, pues, en tal caso, sabemos que: si X → N (µ ;σ 2 ) entonces: ( n −1) s 2 ns 2 = 2 σ2 σ → χ 2 (n − 1) Para resolver el contraste hay que suponer cierta la hipótesis nula, entonces el estadístico de contraste es: 2 χ exp = ( n −1) s 2 ns 2 = 2 σ 02 σ0 y se comparará con la región de aceptación: C 0 = ( χ 12− α / 2; χ α2 / 2 ) , bilateral por el tipo de χ 12−α / 2 es la abcisa de una distribución Chi-cuadrado con n-1 2 grados de libertad que deja a su derecha un área 1-α α /2 , y χ α / 2 es la que deja a su derecha contraste planteado, donde un área α /2 Para el caso unilateral, el estadístico de contraste es el mismo y las regiones de aceptación se construyen de modo que la región crítica sea coherente con la hipótesis alternativa. La tabla siguiente resume los contrastes sobre la varianza: Región crítica Contraste 2 2 2 2 2 2 Ho: σ = σ 0 2 2 H1: σ ≠ σ 0 Ho: σ = σ 0 2 2 H1: σ > σ 0 Ho: σ = σ 0 2 2 H1: σ < σ 0 Región de aceptación Estadístico de contraste 2 2 C1 = (0; χ 12−α / 2 ) U ( χ α2 / 2 ; ∞) C 0 = ( χ 1− α / 2; χ α / 2 ) 2 χ exp = C1 = ( χ α2 ; ∞) C 0 = (0; χ α2 ) C1 = (0; χ 12−α ) C 0 = ( χ 12−α ; ∞) ( n −1) s 2 ns 2 = 2 σ 02 σ0 Ejemplo: Supongamos la primera muestra de diez alumnos matriculados en la Universidad de Córdoba durante el año 2000, sus tallas son: 190; 199; 170; 189; 179; 221; 175; 193; 150; 209 Suponiendo que los datos procedan de una distribución Normal, contrástese la hipótesis nula 2 de que la varianza sea 500 cm contra la alternativa de que tenga otro valor, con un nivel de significación del 10%. 2 2 Ho: σ = σ 0 2 2 H1: σ ≠ σ 0 La media de este conjunto de datos es 187.5 La cuasivarianza de este conjunto de datos es 410.722. Supuesto Normalidad, la región de aceptación, basada en la distribución Chi-cuadrado con 9 grados de libertad es: 2 2 C 0 = ( χ 12−α / 2; χ α2 / 2 ) = ( χ 0.95 ; χ 0.05 ) = (3.325;16.919) y el estadístico de contraste: 2 χ exp = ( n −1) s 2 9 ⋅ 410.722 = = 7.393 σ 02 500 Conclusión: Se aceptará la hipótesis nula. Contraste de Hipótesis, pág 10 Contraste de Normalidad de Kolmogorov-Smirnov. La mayoría de los contrastes paramétricos que se han visto se basan en la Normalidad de los datos de la muestra. El contraste actual permite concluir si un conjunto de datos procede o no de una distribución Normal. El planteamiento es el siguiente: Ho: Los datos proceden de una Normal H1: Los datos no proceden de una Normal Existen varios contrastes específicos de Normalidad, el que veremos aquí sirve para cualquier tipo de distribución, no solamente la Normal, por este motivo, no es el más potente entre todos los contrastes de Normalidad disponibles. El contraste de Kolmogorov-Smirnov se basa en la idea de que si un conjunto de datos sigue un modelo de distribución, la tabla de frecuencias relativas acumuladas ( función de distribución empírica) de los datos debe aproximarse a la función de distribución teórica propuesta. Si la diferencia entre ambas distribuciones no es muy grande, las diferencias pueden ser atribuidas al azar y concluiremos que los datos siguen la ley propuesta. Si las diferencias son grandes, entonces no podremos atribuirlas al azar, sino al hecho de que los datos no siguen el modelo de distribución propuesto. Para realizar el contraste hay que comparar la frecuencia relativa acumulada con la función de distribución teórica, se calcula la diferencia entra ambas distribuciones punto a punto y el estadístico de contraste es la mayor de todas las diferencias en valor absoluto. La función de distribución empírica es escalonada y muestra un salto en cada uno de los valores observados, por ello hay que considerar dos posibles diferencias, una por cada uno de los valores de la función de distribución empírica inmediatamente antes y después de cada uno de los puntos observados, ambas diferencias calculadas respecto del valor de la función de distribución teórica en ese punto. Se toman las diferencias en valor absoluto, el estadístico de contraste es la máxima diferencia entre todas ellas. El estadístico así calculado se compara con la mínima diferencia significativa para el nivel de significación considerado, proporcionada por la tabla de Kolmogorov-Smirnov, y si es menor, concluimos que no se puede rechazar la hipótesis de Normalidad. Test de Kolmogorov Normal Frecuencia acumulada 1 d2 0.75 d1 0.5 0.25 0 130 150 170 190 210 Ejemplo La siguiente serie de datos es la muestra de tamaño n=10 de una N(175;500) que hemos utilizado en el primer ejemplo: 172; 178; 148; 145; 188; 193; 186; 199; 187; 177 Contraste de Hipótesis, pág 11 ¿Se podrá aceptar, con un nivel de significación del 5% que este conjunto de datos procede de una distribución Normal? El gráfico anterior puede aclarar la situación, pues muestra las distribuciones empírica y teórica del conjunto de datos. Para calcular la función de distribución teórica hay que conocer los dos parámetros de la 2 distribución Normal, la media (µ ), y la varianza (σ ) , si ambos son desconocidos se estimarán con la media ( x = 177.3 ) y cuasivarianza de la muestra ( s 2 = 325.789 ). El contraste se plantea entonces como: Ho: Los datos proceden de una Normal ( de media 177.3 y de varianza 325.789) H1: Los datos proceden de otra distribución (o de una Normal con otros parámetros) La función de distribución teórica es P(X ≤ x) y para calcular esta probabilidad teórica hay que tipificar los datos, pues hay que calcular probabilidades asociadas a intervalos de una variable Normal, y solo tenemos tabla de la N(0;1) Para tipificar: Media = 177.3; Cuasivarianza = 325.789 La tabla siguiente contiene los cálculos precisos para realizar el contraste: z = datos Probad1 d2 dmax tipifibilidad cados P(Z≤z) 145 145 1 1 0.1 -1.79 0.0368 0.0368 0.0632 0.0632 148 148 1 2 0.2 -1.62 0.0523 0.0477 0.1477 0.1477 172 172 1 3 0.3 -0.29 0.3845 0.1845 0.0845 0.1845 177 177 1 4 0.4 -0.02 0.4934 0.1934 0.0934 0.1934 178 178 1 5 0.5 0.04 0.5155 0.1155 0.0155 0.1155 186 186 1 6 0.6 0.48 0.6851 0.1851 0.0851 0.1851 187 187 1 7 0.7 0.54 0.7045 0.1045 0.0045 0.1045 188 188 1 8 0.8 0.59 0.7233 0.0233 0.0767 0.0767 193 193 1 9 0.9 0.87 0.8078 0.0078 0.0922 0.0922 199 199 1 10 1 1.20 0.8854 0.0146 0.1146 0.1146 (*) en este caso no hay datos repetidos, por eso esta columna y la anterior coinciden y las frecuencias absolutas son todas 1. Si hubiese datos repetidos esta columna contendrá solo los valores diferentes, y se anotará en la columna de frecuencias absolutas el nº de veces que se repiten. Datos en (*) datos Frec. Frec. ac. Frec. ac. orden distintos Abs. Abs. Rel. El estadístico de contraste es D = 0.1934 De la tabla de Kolmogorov, para n =10 y α = 0.05, el valor máximo de D es Dn = 0.410 Como D < Dn, concluimos que no se puede rechazar la hipótesis de normalidad. Nota: al estimar los parámetros poblacionales con los muestrales, las diferencias entre la distribución teórica y la empírica tienden a ser menores que las que se obtendrían si se conociesen estos parámetros y se producen menos resultados significativos que los que realmente debieran producirse. Por ello, para un caso como este se recomienda usar la tabla de Lilliefors que da valores inferiores de las diferencias significativas que las proporcionadas por la tabla de Massey, que es la que se ha proporcionado en la colección de tablas. No se ha proporcionado esta segunda tabla para no complicar más los posibles casos a considerar. Contraste de Hipótesis, pág 12