- Ninguna Categoria

Redes Neuronales Artificiales: Una Aproximación Práctica

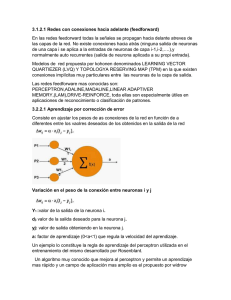

Anuncio