bitbytes

Anuncio

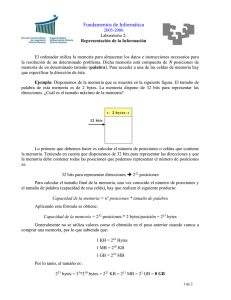

Bit es el acrónimo de Binary digit. (dígito binario). Un bit es un dígito del sistema de numeración binario. La Real

Academia Española (RAE) ha aceptado la palabra bit con el plural bits.

El bit es la unidad mínima de información empleada en informática, en cualquier dispositivo digital, o en la teoría de

la información. Con él, podemos representar dos valores cualesquiera, como verdadero o falso, abierto o cerrado,

blanco o negro, norte o sur, masculino o femenino, amarillo o azul, etc. Basta con asignar uno de esos valores al

estado de "apagado" (0), y el otro al estado de "encendido" (1).

Un kilobit 1000 bits (103). Su símbolo correcto es kb, aunque algunas veces se escribe Kb, o k.

Se utiliza comúnmente para expresar las velocidades de transmisión de datos, por ejemplo 56 kbps (o 56.000 bits)

es la máxima velocidad de transmisión de datos de un modem analógico que se puede encontrar en cualquier

ordenador.

Para las telecomunicaciones se usa comúnmente la base 10 (1000 bits), mientras que para medidas de capacidad

de almacenamiento de información se utiliza la base 2 (1024 bits), para esta última también existe una unidad que

evita esta confusión, llamada kibibit.

El Megabit (Mbit o Mb) es una unidad de medida de información muy utilizada en las transmisiones de datos de

forma telemática. Representa un millón de bits (1.000.000) y con frecuencia se le confunde con el Megabyte que

equivale a 220 (1.048.576) bytes.

Cuando se expresa una velocidad de, por ejemplo, 2 Mbits/s se quiere decir que en un segundo se transmiten 2

millones de bits, o lo que es lo mismo, 2.000.000 / 8 = 250.000 bytes.

Un gigabit es una unidad de información o de almacenamiento informático normalmente abreviada como Gbit o a

veces Gb.

1 gigabit = 109 = 1.000.000.000 bits (que equivalen a 125 megabytes decimales)

Un Terabyte es una unidad de medida informática cuyo símbolo es el TB.

Un terabyte = 1024 gigabytes.

Confirmado en 1960, viene del griego τέρας, que significa monstruo.

Debido a irregularidades en la definición y uso del Kilobyte, el número exacto de bytes en un Terabyte en la práctica,

podría ser cualquiera de los siguientes valores:

12000.0001000.000 bytes - 1012, un billón. Esta definición es la que se usa en el contexto general cuando se refiere

a almacenamiento en discos, redes u otro hardware.

12099.5111627.776 bytes - 10244 o 240. Esto es 1024 veces un Gigabyte (un Gigabyte binario). Esta es la

definición más usada en las ciencias de la computación (computer science) y en programación (computer

programming) y, la mayor parte del software, emplea también ésta definición.

Un petabit es una unidad de información de almacenamiento en la computadora, normalmente abreviado Pbit o a

veces Pb.

1 petabit = 1015 bits = 1.000.000.000.000.000 bits (mil billones).

El petabit esta cercanamente relacionado al pebibit, el cual es equivalente 250 bits.

BYTES

Voz inglesa, se pronuncia báit, que si bien la Real Academia Española ha aceptado como equivalente a octeto, es

decir a ocho bits, para fines correctos, un byte debe ser considerado como una secuencia de bits contiguos, cuyo

tamaño depende del código de información o código de carácteres en que sea definido.

Se usa comúnmente como unidad básica de almacenamiento de información en combinación con los prefijos de

cantidad

Un kilobyte (pronunciado /kilobáit/) es una unidad de medida común para la capacidad de memoria o

almacenamiento de las computadoras. Es equivalente a 1024 bytes (o a 210 bytes). Generalmente se abrevia como

KB, K, kB, Kbyte o k-byte. Las PC de IBM más antiguas, por ejemplo, tenían una capacidad máxima de 640 K, o

alrededor de 640 000 caracteres de datos.

El Megabyte (MB) es una unidad de medida de cantidad de datos informáticos. Es un múltiplo binario del octeto,

que equivale a 106 (1.000.000 bytes) octetos, traducido a efectos prácticos como 106 (1.000.000) octetos.

Un gigabyte (de símbolo GB ó GiB) es una unidad de medida informática equivalente a mil millones de bytes (no

confundir con el billón estadounidense). Dado que los ordenadores trabajan en base binaria, en lugar de que un

gigabyte sea 10³ megabytes (1000 MiB), el término gigabyte significa 210 megabytes (1024 MiB).

Un Terabyte es una unidad de medida informática cuyo símbolo es el TB, y es equivalente a 240 bytes.

Un petabyte es una unidad de almacenamiento de información. Corresponde a 1024 terabytes, cinco millones de

gigabytes, o mil veinticuatro billones de bytes. Se representa con el símbolo PB.

El sistema hexadecimal, a veces abreviado como hex, es el sistema de numeración posicional de base 16. Su uso

actual está muy vinculado a la informática y ciencias de la computación. Esto se debe a que un dígito hexadecimal

representa cuatro dígitos binarios: 4 bits = 1 nibble; por tanto, dos dígitos hexadecimales representan ocho dígitos

binarios (8 bits = 1 byte que, como es sabido, es la unidad básica de almacenamiento de información).

Dado que el sistema usual de numeración es de base decimal y, por ello, sólo se dispone de diez dígitos, se adoptó

la convención de usar las seis primeras letras del alfabeto latino para suplir los dígitos que nos faltan: A = 10, B =

11, C = 12, D = 13, E = 14 y F = 15. Como en cualquier sistema de numeración posicional, el valor numérico de

cada dígito es alterado dependiendo de su posición en la cadena de dígitos, quedando multiplicado por una cierta

potencia de la base del sistema, que en este caso es 16. Por ejemplo: 3E0,A16 = 3×162 + E×161 + 0×160 + A×16-1 =

3×256 + 14×16 + 0×1 + 10×0,0625 = 992,625.

El sistema hexadecimal actual fue introducido en el ámbito de la computación por primera vez por IBM en 1963. Una

representación anterior, con 0–9 y u–z, fue usada en 1956 por la computadora Bendix G-15.

BINARIO

En matemática el sistema binario es un sistema de numeración en el que los números se representan utilizando las

cifras cero y uno ('0' y '1').

Los ordenadores trabajan internamente con dos niveles de voltaje, por lo que su sistema de numeración natural es

el sistema binario (encendido '1', apagado '0').