A - x

Anuncio

Módulo 1

ANÁLISIS

MATEMÁTICO DE LA

OPTIMIZACIÓN

Copyright ©2005 by South-Western, a division of Thomson Learning. All rights reserved.

1

Matemática de la Optimización

• Muchas teorías económicas empiezan con el

supuesto de que un agente económico quiere

encontrar el valor óptimo de alguna función

– consumidores buscan maximizar utilidad

– empresas buscan maximizar utilidad

• Este capítulo introduce a las matemáticas que

se emplean en estos problemas

2

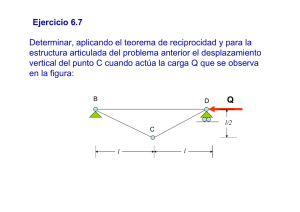

Maximización de una función de una

variable

• Ejemplo: Administrador de una firma desea

maximizar beneficios

f (q)

Utilidad máxima

* ocurre en q*

*

= f(q)

q*

Cantidad

3

Maximización de una función de una

variable

• El admimistrador posiblemente intentará variar q para

ver dónde se obtienen los beneficios máximos

– un incremento de q1 a q2 produce un aumento en

0

q

*

2

= f(q)

1

q1

q2

q*

Cantidad

4

Maximización de una función de una

variable

• Si el producto se incrementa más alla de q*, las

utilidades disminuirán

– un incremento de q* a q3 conduce a una caída en

0

q

*

= f(q)

3

q*

q3

Cantidad

5

Derivadas

• La derivada de = f(q) es el límite de /q para

cambios muy pequeños en q

d df

f (q1 h) f (q1 )

lim

dq dq h 0

h

• El valor de este ratio depende del valor de

q1

6

Valor de una derivada en un punto

• La evaluación de la derivada en el punto q =

q1 puede ser denotado

d

dq q q

1

• En nuestros ejemplos previos,

d

0

dq q q

1

d

0

dq q q

3

d

0

dq q q *

7

Condición de primer orden para un

máximo

• Para que una función de una variable to

alcance su valor máximo en algún punto, la

derivada en ese punto debe ser cero

df

dq

0

q q*

8

Condiciones de segundo orden

• La condición de primer orden (d/dq) es una

condición necesaria para un máximo, pero no es

una condición suficiente

Si la función de utilidad tuviese forma de

u, con la condición de primer orden se

obtendría q* donde se minimizaría

*

q*

Cantidad

9

Condiciones de segundo orden

• Esto puede significar que para que q* sea

un óptimo,

d

0 para q q *

dq

y

d

0 para q q *

dq

• Por lo tanto, en q*, d/dq debe ser

decreciente

10

Segundas derivadas

• La derivada de una derivada se denomina

segunda derivada

• La segunda derivada puede denotarse por

d 2 d 2 f

o 2 o f " (q)

2

dq

dq

11

Condiciones de segundo orden

• La condición de segundo orden para un

máximo (local) es

d

f " (q ) q q * 0

2

dq q q *

2

12

Reglas para hallar derivadas

db

1. Si b es una constante, entonces

0

dx

d [bf ( x)]

2. Si b es una constante, entonces

bf ' ( x)

dx

dx b

3. Si b es constante, entonces

bx b 1

dx

d ln x 1

4.

dx

x

13

Reglas para hallar derivadas

da x

x

5.

a ln a para cualquier constante a

dx

– un caso especial de esta regla es dex/dx = ex

14

Reglas para hallar derivadas

• Supongamos que f(x) y g(x) son dos

funciones de x y f’(x) y g’(x) existe

• Entonces

d [f ( x ) g ( x )]

6.

f '(x) g'(x)

dx

d [f ( x ) g ( x )]

7.

f ( x )g ' ( x ) f ' ( x )g ( x )

dx

15

Reglas para hallar derivadas

f ( x)

d

g ( x) f ' ( x) g ( x) f ( x) g ' ( x)

8.

2

dx

[ g ( x)]

dado que g ( x) 0

16

Reglas para hallar derivadas

• Si y = f(x) y x = g(z) y si existen f’(x) y

g’(x), entonces:

dy dy dx df dg

9.

dz dx dz dx dz

• Se denomina la regla de la cadena. La regla

de la cadena nos permite estudiar cómo una

variable (z) afecta otra variable (y) a través

de su influencia sobre alguna variable

intermedia (x)

17

Reglas para hallar derivadas

• Algunos ejemplos de la regla de la cadena

incluyen

deax

deax d (ax )

10.

eax a aeax

dx

d (ax ) dx

d [ln( ax )] d [ln( ax )] d (ax )

11.

ln( ax ) a a ln( ax )

dx

d (ax )

dx

d [ln( x 2 )] d [ln( x 2 )] d ( x 2 ) 1

2

12.

2 2x

2

dx

d(x )

dx

x

x18

Ejemplo de maximización de utilidad

• Suponga que la relación entre utilidad y producto es

= 1,000q - 5q2

• La condición de primer orden para un máximo es

d/dq = 1,000 - 10q = 0

q* = 100

• Dado que la segunda derivada es siempre -10, q =

100 es un máximo global

19

Funciones de varias variables

• La mayoría de los objetivos de los agentes

económicos dependen de varias variables

– existen trade-offs (disyuntivas)

• La dependencia de una variable (y) sobre una serie

de otras variables (x1,x2,…,xn) se denota por

y f (x1, x2 ,..., xn )

20

Derivadas

• La derivada parcial de y con respecto a x1 se

denota por

y f

o

o f x1 o f1

x1 x1

• Se entiende que al calcular una derivada

parcial, todas las demás x’s se mantienen

constantes

21

Derivadas parciales

• Una definición más formal de la derivada

parcial es

f

x1

x 2 ,...,x n

f ( x1 h, x 2 ,..., x n ) f ( x1, x 2 ,..., x n )

lim

h 0

h

22

Calculando derivadas parciales

1. If y f ( x1 , x2 ) ax12 bx1 x2 cx22 , entonces

f

f1 2ax1 bx2

x1

y

f

f 2 bx1 2cx2

x2

2. Si y f ( x1 , x2 ) e ax1 bx2 , entonces

f

f

ax1 bx2

f1 ae

y

f 2 be ax1 bx2

x1

x2

23

Calculando derivadas parciales

3. Si y f ( x1 , x2 ) a ln x1 b ln x2 , entonces

f

a

f

b

f1

y

f2

x1

x1

x2

x2

24

Derivadas parciales

• Las derivadas parciales son la expresión

matemática del supuesto ceteris paribus

– muestra cómo los cambios en una variable

afectan algunos resultados cuando otras

influencias se mantienen constantes

25

Derivadas parciales

• Debemos tener en cuenta cómo están

medidas las variables

– Si q representa la cantidad de gasolina

demandada (medida en billones de litros) y p

representa el precio en dólares por litro,

entonces q/p medirá el cambio en la demanda

(en billones de litros por año) para un cambio

en el precio de un dólar por litro

26

Elasticidad

• Las elasticidades miden el efecto

proporcional del cambio en una variable

sobre otra

• La elasticidad de y con respecto a x es

ey , x

y

y x y x

y

x x y x y

x

27

Elasticidad y forma funcional

• Suponga que

y = a + bx + otros términos

• En este caso,

ey,x

y x

x

x

b b

x y

y

a bx

• ey,x no es constante

– es importante notar el punto en el cual la

elasticidad va a ser computada

28

Elasticidad forma funcional

• Supongamos que

y = axb

• En este caso,

ey , x

y x

x

b 1

abx b b

x y

ax

29

Elasticidad y forma funcional

• Supongamos que

ln y = ln a + b ln x

• En este caso,

ey , x

y x

ln y

b

x y

ln x

• Las elasticidades pueden calcularse a través

de la diferenciación logarítmica

30

Derivada parcial de segundo-orden

• La derivada parcial de una derivada parcial

se denomina derivada parcial de segundoorden

(f / xi )

2f

fij

x j

x j xi

31

Teorema de Young

• Bajo condiciones generales, no importa el

orden en el cual se realiza la diferenciación

parcial para evaluar las derivadas parciales

de segundo orden

fij f ji

32

Uso de las parciales de

segundo-orden

• Las parciales de segundo-orden juegan un papel

importante en muchas teorías económicas

• Una de las más importantes es la parcial de

segundo orden de la misma variable, fii

– muestra cómo la influencia marginal de xi sobre y

(y/xi) cambia a medida que se incrementa xi

– un valor de fii < 0 indica rendimiento maginal

decreciente

33

Diferencial total

• Supongamos que y = f(x1,x2,…,xn)

• Si todas las x’s varían en una pequeña

cantidad, el efecto total sobre y será

f

f

f

dy

dx1

dx 2 ...

dx n

x1

x 2

xn

dy f1dx1 f2dx 2 ... fndx n

34

Condición de primer orden para un

máximo (o mínimo)

• Una condición necesaria para un máximo (o mínimo)

de la función f(x1,x2,…,xn) es que dy = 0 para

cualquier combinación de cambios pequeños en las x’s

• La única forma de que esto sea cierto es si

f1 f 2 ... f n 0

• Un punto en el que esta condición se verifica se

denomina punto crítico

35

Encontrar un máximo

• Supongamos que y es una función de x1 y x2

y = - (x1 - 1)2 - (x2 - 2)2 + 10

y = - x12 + 2x1 - x22 + 4x2 + 5

• Condiciones de primer orden implican que

y

2 x1 2 0

x1

y

2 x 2 4 0

x 2

O

x1* 1

*

x2 2

36

Frontera de posibilidades de producción

• Ejemplo anterior: 2x2 + y2 = 225

• Puede re-escribirse: f(x,y) = 2x2 + y2 - 225 = 0

• Dado que fx = 4x y fy = 2y, la disyuntiva de coste

de oportunidad entre x e y es

dy

fx

4x 2x

dx

fy

2y

y

37

Teorema de la función implícita

• No siempre será posible resulver funciones

implícitas de la forma g(x,y)=0 para funciones

explícitas de la forma y = f(x)

– los matemáticos han derivado las condiciones

necesarias

– en muchas aplicaciones económicas, estas

condiciones son las mismas que las condiciones de

segundo orden para un máximo (o mínimo)

38

El teorema de la envolvente

• El teorema de la envolvente considera cómo el

valor óptimo de una función en particular

cambia cuando un parámetro de esa función

cambia

• La forma más simple de verlo es mediante un

ejemplo

39

El teorema de la envolvente

• Supongamos que y es una función de x

y = -x2 + ax

• Para valores diferentes de a, esta función

representa una familia de parábolas invertidas

• Si a a asignamos un valor específico, entonces

y es una función de x solamente y el valor de x

que maximiza y puede calcularse

40

El teorema de la envolvente

Valores óptimos de x e y para valores alternativos de a

Valor de a

0

1

2

3

4

5

6

Valor de x*

0

1/2

1

3/2

2

5/2

3

Valor de y*

0

1/4

1

9/4

4

25/4

9

41

El teorema de la envolvente

y*

10

A medida que a aumenta,

el valor máximo de

for y (y*) se incrementa

9

8

7

6

5

La relación entre a

ey

es cuadrática

4

3

2

1

a

0

0

1

2

3

4

5

6

7

42

El teorema de la envolvente

• Supongamos que estamos interesados en

cómo y* cambia a medida que a cambia

• Hay dos formas de hacer esto

– calculamos la pendiente de y directamente

– mantenemos x constante en su valor óptimo y

calculamos y/a directamente

43

El teorema de la envolvente

• Para calcular la pendiente de la función,

debemos resolver para el valor óptimo de x

para cualquier valor de a

dy/dx = -2x + a = 0

x* = a/2

• Sustituyendo, obtenemos

y* = -(x*)2 + a(x*) = -(a/2)2 + a(a/2)

y* = -a2/4 + a2/2 = a2/4

44

El teorema de la envolvente

• Por lo tanto,

dy*/da = 2a/4 = a/2 = x*

• Pero, podemos ahorrar tiempo utilizando el

teorema de la envolvente

– Para cambios pequeños en a, dy*/da puede ser

computado manteniendo x en x* y calculando y/

a directamente de y

45

El teorema de la envolvente

y/ a = x

• Manteniendo x = x*

y/ a = x* = a/2

• Es el mismo resultado obtenido anteriormente

46

El teorema de la envolvente

• El teorema de la envolvente afirma que el cambio

en el valor óptimo de una función con respecto a un

parámetro de la función puede ser encontrado

diferenciando parcialmente la función objectivo

mientras se mantiene constante x (o varias x’s) en

este valor óptimo

dy * y

{x x * (a)}

da

a

47

El teorema de la envolvente

• El teorema de la envolvente puede extenderse al

caso donde y es una función de varias variables

y = f(x1,…xn,a)

• Encontrar un valor óptimo para y consistiría en

resolver n ecuaciones de primer orden

y/xi = 0

(i = 1,…,n)

48

El teorema de la envolvente

• Valores óptimos para estas x’s se determinarían

como una función de a

x1* = x1*(a)

x2* = x2*(a)

.

.

.

xn*= xn*(a)

49

El teorema de la envolvente

• Sustituyendo en la función objectivo original

resulta en una expresión para el valor óptimo de

y (y*)

y* = f [x1*(a), x2*(a),…,xn*(a),a]

• Diferenciando resulta

dy * f dx1 f dx 2

f dx n f

...

da

x1 da x 2 da

xn da a

50

El teorema de la envolvente

• Debido a las condiciones de primer orden, todos

los términos excepto f/a son iguales a cero si

las x’s están en sus valores óptimos

• Por lo tanto,

dy * f

{x x * (a)}

da

a

51

Maximización restringida

• ¿Qué ocurre si no son posibles todos los valores de

las x’s?

– puede ser que todos los valores de x tengan que ser

positivos

– las elecciones de los consumidores están limitadas por la

cantidad de poder adquisitivo disponible

• Un método para resolver problemas de

maximización restringidas es el método del

multiplicador Lagrangiano

52

Método del multiplicador

Lagrangiano

• Supongamos que queremos encontrar los

valores de x1, x2,…, xn que maximizan

y = f(x1, x2,…, xn)

sujeta a una restricción que permite utilizar

sólo ciertos valores de las x’s

g(x1, x2,…, xn) = 0

53

Método del multiplicador

Lagrangiano

• El método del multiplicador Lagrangiano

comienza con la siguiente expresión

L = f(x1, x2,…, xn ) + g(x1, x2,…, xn)

donde es una variable adicional

denominada multiplicador de Lagrange

• Cuando la restricción se mantiene, L = f

porque g(x1, x2,…, xn) = 0

54

Método del multiplicador

Lagrangiano

• Condiciones de primer orden

L/x1 = f1 + g1 = 0

L/x2 = f2 + g2 = 0

.

.

.

L/xn = fn + gn = 0

L/ = g(x1, x2,…, xn) = 0

55

Método del multiplicador

Lagrangiano

• Generalmente las condiciones de primer

orden pueden resolverse para x1, x2,…, xn y

• La solución tendrá dos propiedades:

– las x’s cumplirán con la restricción

– estas x’s harán del valor de L (y por lo tanto de

f) tan grande como sea posible

56

Método del multiplicador

Lagrangiano

• El multiplicador Lagrangiano () tiene una

importante interpretación económica

• Las condiciones de primer orden implican que

f1/-g1 = f2/-g2 =…= fn/-gn =

– los numeradores miden el beneficio marginal que una

unidad más de xi tendrán para la función f

– los denominadores reflejan la carga agregada sobre la

restricción de utilizar más xi

57

Método del multiplicador

Lagrangiano

• En las elecciones óptimas para las x’s, el ratio del

beneficio marginal de incrementar xi y el coste

marginal de incrementar xi sería el mismo para cada

x

• es el ratio común de coste-beneficio para todas

las x’s

beneficio marginal de xi

coste marginal de xi

58

Método del multiplicador

Lagrangiano

• Si se relajase la restricción en una pequeña

cantidad, no importaría que x está cambiando

• El multiplicador Lagrangiano provee una

medida de cómo la relajación dela restricción

afectaría el valor de y

• provee un “precio sombra” para la

restricción

59

Método del multiplicador

Lagrangiano

• Un valor alto de indica que y puede

incrementarse sustancialmente relajando la

restricción

– cada x tiene un alto ratio coste-benecio

• Un valor bajo de indica que no hay mucho

que ganar al relajar la restricción

• =0 implica que la restricción no es

vinculante (cambiando la restricción no

cambia la solución óptima)

60

Dualidad

• Cualquier problema de maximización

restringida está vinculado con un problema

dual de minimización restringida que enfoca

la atención sobre las restricciones del

problema original

61

Dualidad

• Individuos que maximizan su utilidad sujeta a una

restricción presupuestaria

– problema dual: los individuos minimizan el gasto

necesario para lograr un nivel dado de utilidad

• Las firmas minimizan el coste de los insunmos para

producir un nivel dado de producto

– problema dual: las firmas maximizan el producto para

costes de insumos adquiridos

62

Maximización restringida

• Supongamos que un agricultor tiene cierta

extensión de valla (P) y desea encerrar la forma

rectangular más grande posible

• Denotemos x como la extensión de un lado

• Denotemos y como la extensión del otro lado

• Problema: escoger x e y tal que se maximiza el

área (A = x·y) sujeta a la restricción de que el

perímetro es fijo en P = 2x + 2y

63

Maximización restringida

• Configurando el multiplicador Lagrangiano

L = x·y + (P - 2x - 2y)

• Las condiciones de primer orden para un

máximo son

L/x = y - 2 = 0

L/y = x - 2 = 0

L/ = P - 2x - 2y = 0

64

Maximización restringida

• Dado que y/2 = x/2 = , x debe ser igual a y

– el campo sería cuadrado

– x e y serían escogidos tal que el ratio de beneficios

marginales y costes marginales serían iguales

• Dado que x = y e y = 2, podemos utilizar la

restricción para mostrar que

x = y = P/4

= P/8

65

Maximización restringida

• Interpretación del multiplicador de Lagrange

– si el agricultor estuviese interesado en conocer qué

campo adicional puede tener valla agregando un

metro adicional de valla, sugiere que puede

saberlo dividiendo el perímetro presente (P) por 8

– por lo tanto, el multiplicador Lagrangiano provee

información acerca del valor implícito de la

restricción

66

Maximización restringida

• Problema dual: escoger x e y para minimizar la

cantidad de valla requirida para rodear el

campo

minimizar P = 2x + 2y sujeta a A = x·y

• Configurando el Lagrangiano:

LD = 2x + 2y + D(A - xy)

67

Maximización restringida

• Conditiones de primer orden:

LD/x = 2 - D·y = 0

LD/y = 2 - D·x = 0

LD/D = A - x·y = 0

• Resolviendo, tenemos

x = y = A1/2

• El multiplicador Lagrangiano (D) = 2A-1/2

68

Teorema de la envolvente &

maximización restringida

• Supongamos que queremos maximizar

y = f(x1,…,xn;a)

sujeta a la restricción

g(x1,…,xn;a) = 0

• Una forma de resolver sería fijando la

expresión para el Lagrangiano y resolver las

condiciones de primer orden

69

Teorema de la envolvente &

Maximización restringida

• Alternativamente, puede demostrarse que

dy*/da = L/a(x1*,…,xn*;a)

• El cambio en el valor máximo de y que resulta

cuando a cambia puede encontrarse

diferenciando parcialmente L y evaluando la

derivada parcial en el punto óptimo

70

Restricciones con desigualdad

• En algunos problemas económicos no necesitamos

que las restricciones se cumplan exactamente

• Por ejemplo, supongamos que buscamos

maximizar y = f(x1,x2) sujeta a

g(x1,x2) 0,

x1 0, and

x2 0

71

Restricciones con desigualdad

• Una forma de resolver este problema es

introduciendo tres nuevas variables (a, b, y

c) que convierte las desigualdades en

igualdades

• Para asegurar que se cumplen las

desigualdades, elevamos al cuadrado estas

nuevas variables para asegurar que sus

valores son positivos

72

Restricciones con desigualdad

g(x1,x2) - a2 = 0;

x1 - b2 = 0; and

x2 - c2 = 0

• Cualquier solución que obedece estas tres

restricciones de igualdad también cumplirán

con las restricciones de desigualdad

73

Restricciones de desigualdad

• Podemos establecer el siguente Lagrangiano

L = f(x1,x2) + 1[g(x1,x2) - a2] + 2[x1 - b2] + 3[x2 -

c2]

• Con lo cual obtendremos ocho condiciones

de primer orden

74

Restricciones de desigualdad

L/x1 = f1 + 1g1 + 2 = 0

L/x2 = f1 + 1g2 + 3 = 0

L/a = -2a1 = 0

L/b = -2b2 = 0

L/c = -2c3 = 0

L/1 = g(x1,x2) - a2 = 0

L/2 = x1 - b2 = 0

L/3 = x2 - c2 = 0

75

Restricciones de desigualdad

• De acuerdo con la tercera condición, ya sea a o 1

=0

– si a = 0, la restricción g(x1,x2) se cumple exactamente

– si 1 = 0, la disponibilidad de alguna holgura de la

restricción implica que su valor para la función objetivo

es 0

• Similares relaciones de complementariedad de

holguras (formadas por el conjunto de las

restricciones de menor o igual multiplicadas por

su correspondiente ) también se cumplen para x1

y x2

76

Restricciones de desigualdad

• A estos resultados se los conoce como las

condiciones de Kuhn-Tucker

– muestran que las soluciones para problemas de

optimización que involucran a restricciones con

desigualdades diferirán de problemas similares que

involucran restricciones con igualdades

– no podemos equivocarnos trabajando principalmente

con restricciones con igualdades, hay que considerar las

desigualdades

77

Condiciones de segundo orden –

funciones de una variable

• Denotemos y = f(x)

• Una condición necesaria para un máximo es

que

dy/dx = f ’(x) = 0

• Para asegurar que el punto es un máximo, y

debe ser decreciente para los movimientos

fuera de él

78

Condiciones de segundo ordenfunciones de una variable

• La diferencial total mide el cambio en y

dy = f ’(x) dx

• Para estar en un máximo, dy debe ser

decreciente para incrementos pequeños en x

• Para ver los cambios en dy, debemos utilizar la

segunda derivada de y

79

Condiciones de segundo orden –

funciones de una variable

d [f ' ( x )dx ]

2

d y

dx f " ( x )dx dx f " ( x )dx

dx

2

• Notemos que d 2y < 0 implica que f ’’(x)dx2 <

0

• Dado que dx2 debe ser positivo, f ’’(x) < 0

• Esto significa que la función f debe tener una

forma cócava en el punto crítico

80

Condiciones de segundo orden –

funciones de dos variables

• Supongamos que y = f(x1, x2)

• Las condiciones de primer orden para un máximo

son

y/x1 = f1 = 0

y/x2 = f2 = 0

• Para asegurar que el punto es un máximo, y debe

disminuir para movimientos en cualquier

dirección fuera del punto crítico

81

Condiciones de segundo orden –

funciones de dos variables

• La pendiente en la dirección x1 (f1) debe ser

decreciente en el punto crítico

• La pendiente en la dirección x2 (f2) debe ser

decreciente en el punto crítico

• Pero, se deben establecer condiciones sobre las

derivadas parciales cruzadas (f12 = f21) para

asegurar que dy es decreciente para todos los

movimientos a través del punto crítico

82

Condiciones de segundo orden –

funciones de dos variables

• La diferencial total de y está dado por

dy = f1 dx1 + f2 dx2

• La diferencial de esta función es

d 2y = (f11dx1 + f12dx2)dx1 + (f21dx1 + f22dx2)dx2

d 2y = f11dx12 + f12dx2dx1 + f21dx1 dx2 + f22dx22

• Por el teorema de Young, f12 = f21 y

d 2y = f11dx12 + 2f12dx1dx2 + f22dx22

83

Condiciones de segundo ordenfunciones de dos variables

d 2y = f11dx12 + 2f12dx1dx2 + f22dx22

• Para que esta ecuación sea indefectiblemente negativa

para cualquier cambio en las x’s, f11 y f22 deben ser

negativas

• Si dx2 = 0, entonces d 2y = f11 dx12

– para d 2y < 0, f11 < 0

• Si dx1 = 0, entonces d 2y = f22 dx22

– para d 2y < 0, f22 < 0

84

Condiciones de segundo orden –

funciones de dos variables

d 2y = f11dx12 + 2f12dx1dx2 + f22dx22

• Si ni dx1 o dx2 son cero, entonces d 2y será sin

ambigüedad negativo sólo si

f11 f22 - f122 > 0

– las derivadas parciales de segundo orden (f11 y f22)

deben ser suficientemente negativas tal que compensan

cualquier tipo de efectos contratio de las derivadas

parciales cruzadas (f12 = f21)

85

Maximización restringida

• Supongamos que queremos escoger x1 y x2

para maximizar

y = f(x1, x2)

• Sujeta a la restricción linear

c - b1x1 - b2x2 = 0

• Podemos establecer el Lagrangiano

L = f(x1, x2) + (c - b1x1 - b2x2)

86

Maximización restringida

• Las condiciones de primer orden son

f1 - b1 = 0

f2 - b2 = 0

c - b1x1 - b2x2 = 0

• Para asegurar que tenemos un máximo,

debemos usar la diferencial total de “segundo”

orden

d 2y = f11dx12 + 2f12dx1dx2 + f22dx22

87

Maximización restringida

• Sólo los valores de x1 y x2 que satisfacen la

restricción pueden ser consideradas como

alternativas válidas para el punto crítico

• Por ello, debemos calcular la diferencial total de la

restricción

-b1 dx1 - b2 dx2 = 0

dx2 = -(b1/b2)dx1

• Estos son los cambios relativos permitidos en x1 y x2

88

Maximización restringida

• Debido a las condiciones de primer orden que

implican que f1/f2 = b1/b2, podemos sustituir y

obtener

dx2 = -(f1/f2) dx1

• Dado

d 2y = f11dx12 + 2f12dx1dx2 + f22dx22

podemos sustituir dx2 y tenemos

d 2y = f11dx12 - 2f12(f1/f2)dx12 + f22(f12/f22)dx12

89

Maximización restringida

• Combinando términos y reordenando

d 2y = f11 f22 - 2f12f1f2 + f22f12 [dx12/ f22]

• Por lo tanto, para d 2y < 0, debe ser cierto que

f11 f22 - 2f12f1f2 + f22f12 < 0

• Esta ecuación caracteriza un conjunto de funciones

denominadas funciones cuasi-cóncavas

– cualquier par de puntos dentro del conjunto puede formar

una línea introducida completamente en el conjunto

90

Funciones cóncavas y cuasicóncavas

• Las diferencias entre las funciones cóncavas

y cuasi-cóncavas pueden ilustrarse con la

función

y = f(x1,x2) = (x1x2)k

donde las x’s pueden tomar solamente

valores positivos y k puede tomar una

variedad de valores positivos

91

Funciones cóncavas y cuasicóncavas

• No importa que valores toma k, esta función

es cuasi-cóncava

• Si la función es cóncava o no depende del

valor de k

– si k < 0.5, la función es cóncava

– si k > 0.5, la función es convexa

92

Funciones homogéneas

• Una función f(x1,x2,…xn) es homogénea de

grado k si

f(tx1,tx2,…txn) = tk f(x1,x2,…xn)

– cuando una función es homogénea de grado uno,

duplicando todos los argumentos duplica el valor

de la función

– cuando una función es homogéna de grado cero,

duplicando todos los argumentos deja la función

sin cambios

93

Funciones homogéneas

• Si una función es homogénea de grado k, las

derivadas parciales de la función será

homogénea de grado k-1

94

Teorema de Euler

• Si diferenciamos la definición de

homogeneidad con respecto a la

proporcionalidad del factor t, obtenemos

ktk-1f(x1,…,xn) x1f1(tx1,…,txn) + … + xnfn(x1,…,xn)

• Esta relación se denomina teorema de Euler

95

Teorema de Euler

• El teorema de Euler muestra que, para

funciones homogéneas, hay una relación

definida entre los valores de la función y

los valores de sus derivadas parciales

96

Funciones homotéticas

• Una función homotética es una que se

forma tomando una transformación

monotónica de una función homogénea

– no tienen las propiedades de homogeneidad de

sus funciones subyacentes

97

Funciones homotéticas

• Tanto para funciones homogéneas como

para las homotéticas, las disyuntivas

implícitas entre las variables en la función

dependen solamente de los ratios de

aquellas variables, no de sus valores

absolutos

98

Funciones homotéticas

• Supongamos que examinamos la función implícita

de dos variables f(x,y) = 0

• La disyuntiva implícita entre x e y para una

función de dos variables

dy/dx = -fx/fy

• Si asumimos que f es homogénea de grado k, sus

derivadas parciales serán homogéneas de grado k1

99

Funciones homotéticas

• La disyuntiva implícita entre x e y es

dy

t k 1fx (tx, ty )

fx (tx, ty )

k 1

dx

t fy (tx, ty )

fy (tx, ty )

• Si t = 1/y,

x

x

F ' fx ,1

fx ,1

y

y

dy

dx

x

x

F ' fy ,1

fy ,1

y

y

100

Funciones homotéticas

• La disyuntiva no está afectada por la

transformación monotónica y permanece

una función solamente del ratio x e y

101

Puntos importantes a

considerar:

• Utilizando matemáticas tenemos una

forma conveniente para que los

economistas desarrollen sus modelos

– las implicaciones de varios supuestos

económicos pueden estudiarse a través de

herramientas matemáticas

102

Puntos importantes a

considerar:

• Las derivadas se usan a menudo en

economía porque los economistas están

interesados en cómo los cambios marginales

en una variable afectan a otras

– las derivadas parciales incorporan el supuesto

ceteris paribus utilizando en muchos modelos

económicos

103

Puntos importantes a

considerar:

• Las matemáticas para optimización es

una herramienta importante para el

desarrollo de modelos que asumen que

los agentes económicos racionalmente

persiguen algunas metas

– las condiciones de primer orden requieren

todas las derivadas parciales sean cero

104

Puntos importantes a

considerar:

• La mayoría de los problemas de

optimización económica involucran

restricciones en las elecciones que los

agentes pueden realizar

– las condiciones de primer orden para un

máximo sugieren que cada actividad puede

operar a un nivel en el cual el beneficio

marginal de la actividad es igual a su coste

marginal

105

Puntos importantes a

considerar:

• El multiplicador Lagrangiano se emplea

para ayudar a resolver problemas de

maximization

– el multiplicador Lagrangiano puede ser

interpretado como el valor implícito (precio

sombra) de la restricción

106

Puntos importantes a

considerar:

• El teorema de la función implícita ilustra

la dependencia de las elecciones que

resultan de un problema de optimización

sobre los parámetros del problema

107

Puntos importantes a

considerar:

• El teorema de la envolvente examina

cómo las elecciones óptimas cambiarán

a medida que cambia el parámetro del

problema

• Algunos problemas de optimización

pueden involucrar restricciones que son

desigualdades antes que igualdades

108

Puntos importantes a

considerar:

• Condiciones de primer orden son

necesarias pero no suficientes para

asegurar un máximo o un mínimo

– las condiciones de segundo orden que

describen la curvatura de una función deben

revisarse

109

Puntos importantes a

considerar:

• Ciertos tipos de funciones ocurren en muchos

problemas económicos

– funciones cuasi-cóncavas obedecen las condiciones

de segundo orden de problemas de máximo o

mínimo restringido donde las restricciones son

lineales

– las funciones homotéticas tienen la propiedad de

que las disyuntivas implícitas entre las variables

dependen solamente de los ratios de estas variables

110