Resumen 3: Matrices, determinantes y sistemas de ecua

Anuncio

Resumen 3: Matrices, determinantes y sistemas de ecuaciones lineales

1

Matrices

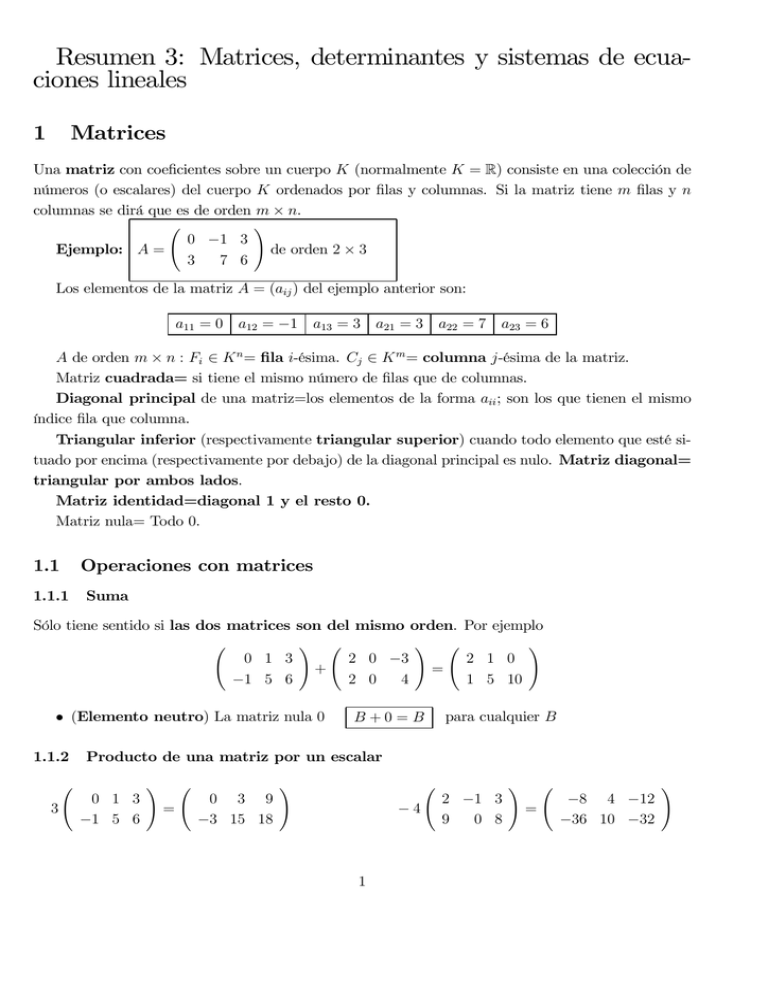

Una matriz con coeficientes sobre un cuerpo K (normalmente K = R) consiste en una colección de

números (o escalares) del cuerpo K ordenados por filas y columnas. Si la matriz tiene m filas y n

columnas se dirá que es de orden m × n.

Ã

!

0 −1 3

Ejemplo: A =

de orden 2 × 3

3

7 6

Los elementos de la matriz A = (aij ) del ejemplo anterior son:

a11 = 0 a12 = −1 a13 = 3 a21 = 3 a22 = 7 a23 = 6

A de orden m × n : Fi ∈ K n = fila i-ésima. Cj ∈ K m = columna j-ésima de la matriz.

Matriz cuadrada= si tiene el mismo número de filas que de columnas.

Diagonal principal de una matriz=los elementos de la forma aii ; son los que tienen el mismo

índice fila que columna.

Triangular inferior (respectivamente triangular superior) cuando todo elemento que esté situado por encima (respectivamente por debajo) de la diagonal principal es nulo. Matriz diagonal=

triangular por ambos lados.

Matriz identidad=diagonal 1 y el resto 0.

Matriz nula= Todo 0.

1.1

Operaciones con matrices

1.1.1

Suma

Sólo tiene sentido si las dos matrices son del mismo orden. Por ejemplo

Ã

! Ã

! Ã

!

0 1 3

2 0 −3

2 1 0

+

=

−1 5 6

2 0

4

1 5 10

• (Elemento neutro) La matriz nula 0

1.1.2

3

Ã

B+0=B

para cualquier B

Producto de una matriz por un escalar

0 1 3

−1 5 6

!

=

Ã

0 3 9

−3 15 18

!

−4

1

Ã

2 −1 3

9

0 8

!

=

Ã

−8 4 −12

−36 10 −32

!

1.1.3

Producto de matrices

Para poder multiplicar dos matrices el número de columnas de la primera debe coincidir con el

número de filas de la segunda.

Para obtener el elemento del producto AB que está situado en la fila i, columna j,

hay que hacer el producto escalar del vector-fila Fi de A por el vector-columna Cj de B.

El producto no tiene por qué ser conmutativo.

Potencia n-ésima de A

n veces A

z

}|

{

n

A =A · A · ... · A

1. Elemento neutro (matriz identidad):

y

IA = A

1.1.4

AI = A

Trasposición de matrices

Las filas de A son las⎛columnas de su ⎞

traspuesta At

1 −3

0

⎟

⎜

Matriz simétrica ⎝ −3

5

4 ⎠

0

4 −2

1.2

Sistemas escalonados. Método de Gauss

Una matriz escalonada es la que cumple que cada fila tiene más ceros iniciales que la anterior,

exceptuando las filas nulas que pudieran aparecer al final. Ejemplo:

⎛

⎜

⎜

⎜

⎝

1 −3 0 3

7

0

0 4 5

0

0

0 0 1 −4

0

0 0 0

0

⎞

⎟

⎟

⎟

⎠

El método de triangulación o escalonación de Gauss se utiliza para la escalonación del

sistema inicial. Se hace uso de 3 tipos de transformaciones elementales:

1. Cambiar el orden de las filas, ecuaciones o vectores.

2. Sumarle a una fila, ecuación o vector múltiplos de otras/os.

3. Multiplicar una fila, ecuación o vector por algún escalar no nulo.

1.3

Rango

r(A) es el número de filas no nulas que resultan después de escalonar la matriz A.

2

1.4

Inversa

A es invertible cuando tiene inversa B = A−1 ; ésta cumple que

AB = BA = I

Propiedad: Una matriz cuadrada de orden n es invertible si y sólo si tiene rango n.

1.4.1

Método de Gauss-Jordan para el cálculo de la inversa

En la forma (A|In ) aplicamos a la matriz A el método de Gauss-Jordan (variante del método

de Gauss), consistente en hacer operaciones (sólo por fila) hasta obtener la matriz identidad. El

resultado de aplicarle a la matriz identidad que hay a la derecha de A esas mismas operaciones nos

proporciona precisamente A−1 .

2

Determinantes

|A| es un número.

Orden 1 −→ |a| = a

¯

¯ a b

¯

Orden 2 −→ ¯

¯ c d

¯

¯

¯

¯ = ad − bc

¯

¯

¯ a11 a12 a13

¯

¯

Orden 3 −→ ¯ a21 a22 a23

¯

¯ a31 a32 a33

¯

¯

¯

¯

¯=

¯

¯

= a11 a22 a33 + a21 a32 a13 + a31 a12 a23 − a13 a22 a31 − a23 a32 a11 − a33 a12 a21

2.1

Propiedades de los determinantes

1. Para todo α ∈ K se tiene que

det(F1 , ..., αFi , ..., Fn ) = α det(F1 , ..., Fi , ..., Fn )

2. Para todo i, j ∈ {1, 2, ..., n} (i 6= j) se tiene que

det(F1 , ..., Fj , ..., Fi , ..., Fn ) = − det(F1 , ..., Fi , ..., Fj , ..., Fn )

3. Para todo i, j ∈ {1, 2, ..., n} (i 6= j) se tiene que

det(F1 , ..., Fi + αFj , ..., Fn ) = det(F1 , ..., Fi , ..., Fn )

para todo i, j ∈ {1, 2, ..., n} (i 6= j) y todo α ∈ K.

3

4. det(F1 , ..., Fn ) = 0 si y sólo si los vectores F1 , F2 , ..., Fn son LD. De esto se deduce que:

5. Si A es una matriz triangular superior o inferior (en particular si es una matriz diagonal)

entonces det A es el producto de los elementos de la diagonal.

2.2

Menor, menor complementario, adjunto

Menor de una matriz A =determinante de cualquier submatriz cuadrada suya.

En una matriz cuadrada A de orden n se llama adjunto del elemento aij al determinante de

orden n − 1 de la submatriz resultante de eliminar en A la fila i y la columna j, que son en las que

está situado el elemento, multiplicado por (−1)i+j .

2.2.1

Cálculo del determinante desarrollando por adjuntos

|A| = suma de los productos de los elementos de cualquier fila o columna por sus respectivos adjuntos.

2.2.2

Rango de una matriz utilizando menores

Propiedad: El rango de A es el mayor orden para el que existen menores no nulos de ese

orden dentro de A. En particular se tiene que si encontramos un menor de orden r no nulo, entonces

r(A) ≥ r.

2.3

Cálculo de la inversa de una matriz mediante adjuntos

A−1 =

3

1

(Adj(A))t

|A|

Sistemas de ecuaciones lineales

Un sistema de ecuaciones de la forma

⎧

⎪

a11 x1 + a12 x2 + .... + a1n xn = b1

⎪

⎪

⎪

⎨ a x + a x + .... + a x = b

21 1

22 2

2n n

2

(∗)

⎪

......

⎪

⎪

⎪

⎩ a x + a x + .... + a x = b

m1 1

m2 2

mn n

m

donde los aij y los bi son escalares del cuerpo K y los xj representan las incógnitas del sistema

(también escalares del cuerpo K, en este caso, indeterminados), se llamará sistema de ecuaciones

lineales o sistema lineal sobre el cuerpo K. Se dirá que el sistema tiene m ecuaciones y n

incógnitas. A los aij se les llama coeficientes del sistema, a los bi términos independientes.

4

Agrupando los elementos anteriores tenemos

A = (aij ) −→ matriz de coeficientes, de orden m × n

⎛

⎞

b1

⎜ b ⎟

⎜ 2 ⎟

B=⎜

⎟ −→ vector de términos independientes, de orden m × 1

⎝ ... ⎠

bm

⎛

⎜

⎜

X=⎜

⎝

x1

x2

...

xn

⎞

⎟

⎟

⎟ −→ vector de las incógnitas, de orden n × 1

⎠

Definimos la matriz ampliada (A|B), de orden m × (n + 1), como la que se forma añadiendo la

columna B a la matriz A.

Una solución del sistema de ecuaciones lineales (*) es un vector S = (s1 , s2 , ..., sn ) ∈ K n tal que

al sustituir cada incógnita xj por el correspondiente sj se verifican todas las ecuaciones.

Sistema compatible (SC), si tiene alguna solución, o incompatible (SI), si no tiene ninguna

solución.

SCD= solución única, SCI= más de una (infinitas).

En los SCI al conjunto de todas las soluciones se le llama solución general y ésta quedará en

función de una serie de parámetros. Al menor número de parámetros que se necesitan para expresar

la solución general lo llamaremos grado de indeterminación o grados de libertad del sistema.

Diremos que un sistema AX = B es homogéneo si todos los términos independientes son nulos.

Sus soluciones forman el llamado núcleo de la matriz A.

3.1

Sistemas equivalentes. Método de Gauss para resolver sistemas lineales

Utilizaremos el método de Gauss. Esto permite:

1. Cambiar de orden las ecuaciones.

2. Multiplicar una ecuación por un escalar no nulo.

3. Sumar a una ecuación un múltiplo de otra.

Además, aquí es posible también:

4. Cambiar de orden las incógnitas.

para transformar el sistema lineal inicial en otro equivalente, es decir, con las mismas soluciones.

Una vez escalonado:

5

• Si en algún momento nos sale un absurdo entonces estamos con un SI.

• En caso contrario podremos escalonar hasta el final y estaremos con un SC. Si:

∗ Todas las incógnitas corresponden con pivotes: SCD.

∗ Hay más incógnitas que pivotes; SCI. A la hora de resolver hay que tener en cuenta

que las incógnitas que no correspondan a pivotes van a ser los parámetros del sistema.

Durante este proceso también pueden ir eliminándose ecuaciones ”triviales” de la forma 0 = 0 o

bien ecuaciones que sean CL de otras.

3.2

Teorema de Rouché-Fröbenius

Teorema: Un sistema de ecuaciones lineales es compatible si y sólo si el rango de la matriz de

coeficientes coincide con el de la matriz ampliada. En este caso, el sistema es compatible determinado

si este rango coincide con el número de incógnitas del espacio. Cuando el sistema es compatible

indeterminado los grados de libertad se calculan como la diferencia entre el número de incógnitas y

el rango.

Un sistema homogéneo AX = 0 tiene solución no nula (ker A 6= 0) si y sólo si r(A) < n.

3.3

Método de Cramer

Teorema: Si A cuadrada de orden n y AX = B es SCD. Entonces la solución del sistema

i|

(x1 , x2 , ..., xn ) se halla así: xi = |M

para todo i, donde Mi es la matriz obtenida a partir de A

|A|

sustituyendo la columna i-ésima por la columna de términos independientes B.

6