Pulsa aquí para acceder al artículo.

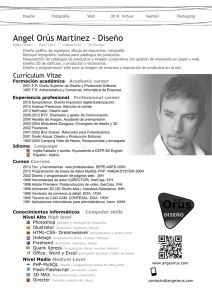

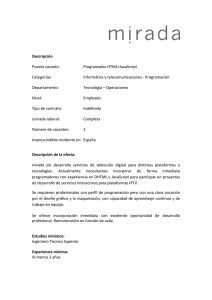

Anuncio